- يعتمد الذكاء الاصطناعي الحديث على خوارزميات التحسين التي تعمل على أتمتة المهام وتحليل كميات كبيرة من البيانات وتمكين نماذج الأعمال الجديدة.

- وتشمل المخاطر الرئيسية التحيز الخوارزمي، وفقدان الوظائف، وانتهاكات الخصوصية، والتلاعب بالمعلومات، والهجمات الإلكترونية الأكثر تطوراً.

- ويضيف الذكاء الاصطناعي التوليدي تحديات محددة: الهلوسة، والتزييف العميق، والاعتماد على التكنولوجيا، وارتفاع التكاليف، وقضايا الملكية الفكرية والسمعة.

- إن الحوكمة القوية والأطر التنظيمية الواضحة واستخدام الذكاء الاصطناعي لإدارة المخاطر كلها عوامل أساسية لتسخير إمكاناته دون فقدان السيطرة على تأثيره.

La دمج الذكاء الاصطناعي مع جميع جوانب حياتنا يحدث هذا التطور بوتيرة أسرع بكثير مما تتخيله معظم المؤسسات والأفراد. فمنذ خوارزميات التوصية الأولى، انتقلنا في وقت قياسي إلى نماذج توليدية قادرة على كتابة التقارير، وتحليل العقود، وإنشاء صور فائقة الواقعية، واتخاذ قرارات آلية في العمليات التجارية الحيوية.

يفتح هذا التوسع المتسارع مجموعة هائلة من الاحتمالات، ولكن أيضًا فهو يحمل معه المخاطر والمعضلات الأخلاقية والتحديات التنظيمية. هذه قضايا لا يمكن تجاهلها. لا يتعلق الأمر بالاختيار بين رؤية كارثية أو تفاؤل تقني ساذج، بل يتعلق بالفهم الهادئ لما يفعله الذكاء الاصطناعي الحالي، وما لا يفعله، وأين يضيف القيمة الأكبر، وأين يمكن أن يصبح مشكلة خطيرة إذا لم يُدار بحكمة.

ماذا نفهم اليوم بالذكاء الاصطناعي؟

عندما نتحدث عن الذكاء الاصطناعي في الحياة اليومية، فإننا في الواقع نشير إلى مجموعة من خوارزميات التحسين والنماذج الإحصائية المدربة على كميات كبيرة من البياناتإنها ليست آلات واعية أو "أدمغة" تفكر مثل الإنسان، بل هي أنظمة تتعلم الأنماط وتولد مخرجات مفيدة (أو معقولة) لمهام محددة للغاية.

في عالم الأعمال، أصبحت الذكاء الاصطناعي شائعًا لأنه إنه يسمح لك بأتمتة المهام الروتينية، وتحليل قواعد البيانات الضخمة، ودعم عملية اتخاذ القرار. بدقة وسرعة لا يمكن لفريق بشري تحقيقهما. من التشخيص الطبي المساعد إلى الكشف المبكر عن الاحتيال المالي، تتزايد حالات الاستخدام في جميع القطاعات.

ومع ذلك، من المهم التمييز بين ما يسمى الذكاء الاصطناعي المقيد (الذي يحل مشاكل محددة: تصنيف الصور، ترجمة النصوص، التوصية بالمحتوى...) والافتراضي الذكاء الاصطناعي العامالذي يطمح إلى التفكير في أي مهمة كالإنسان. حاليًا، ما نستخدمه على نطاق واسع هو أنظمة محدودة، مهما بدت نماذج مثل ChatGPT وBard وDALL-E مثيرة للإعجاب.

تم تصميم هذه النماذج، وخاصة نماذج اللغة، لـ حساب الاستجابة الأكثر احتمالا وقبولا اجتماعيا بناءً على مُدخلات، ليس لفهم العالم أو لتحقيق أهدافهم الخاصة. إنهم يُحاكيون المنطق، لكن في الواقع، الأمر عبارة عن حسابات إحصائية مُعقدة، وليس وعيًا أو نية.

كيف يعمل الذكاء الاصطناعي: التقنيات الرئيسية

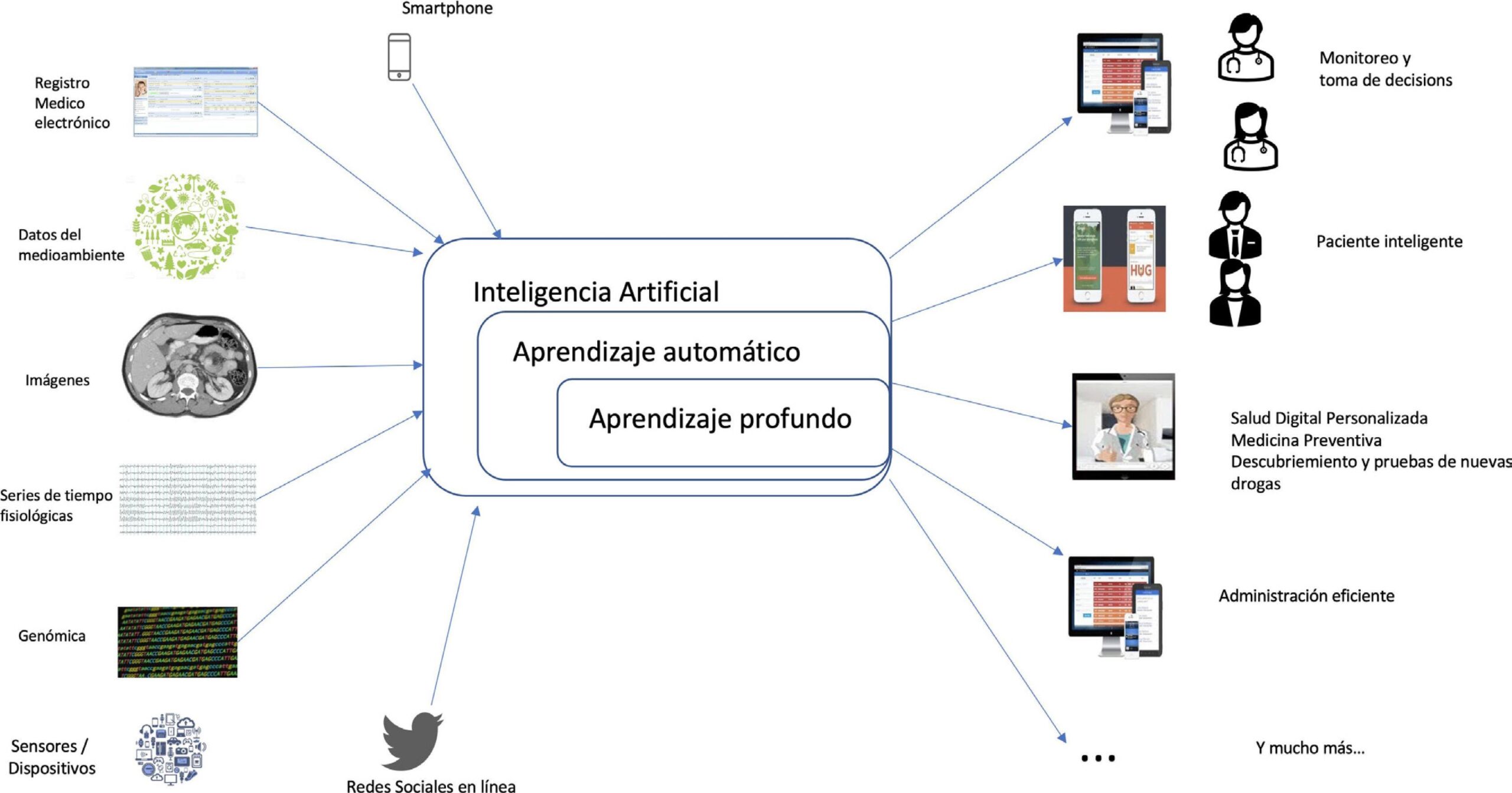

تعتمد معظم تطبيقات الذكاء الاصطناعي الحديثة على ثلاثة عناصر تكنولوجية أساسية: التعلم الآلي والتعلم العميق ومعالجة اللغة الطبيعيةوالتي تضاف إليها الرؤية الحاسوبية لكل ما يتعلق بالصور والفيديو.

التعلم الآلي أو التعلم التلقائي

التعلم الآلي (ML) هو الفرع الذي يركز على بناء خوارزميات قادرة على التعلم من البياناتدون الحاجة إلى برمجة كل قاعدة بشكل صريح. يكتشف النظام الأنماط، وبناءً عليها، يُجري تنبؤات وتصنيفات وتوصيات.

في التعلم الخاضع للإشراف، يتم تدريب النماذج باستخدام بيانات مُسمّاة تشير إلى الإجابة الصحيحة (على سبيل المثال، ما إذا كانت المعاملة احتيالية أم لا). من ناحية أخرى، في التعلم غير الخاضع للإشراف، تكتشف الخوارزمية الهياكل والمجموعات المخفية في البيانات غير المُسمّاة، وهو أمر مفيد جدًا لـ تقسيم العملاء، واكتشاف الشذوذ، أو سلوكيات المجموعة.

ومن الأمثلة النموذجية في الصناعة استخدام التعلم الآلي لـ تحليل البيانات في الوقت الحقيقي من أجهزة استشعار المصنع (درجة الحرارة، الاهتزازات، دورات الاستخدام) وتوقع موعد تعطل الجهاز، وبالتالي تمكين الصيانة التنبؤية.

التعلم العميق

التعلم العميق هو مجموعة فرعية من التعلم الآلي الذي يستخدم الشبكات العصبية الاصطناعية متعددة الطبقات لتعلم تمثيلات متزايدة التعقيد للبيانات. هذه الشبكات مستوحاة من بنية الدماغ، مع أن وظيفتها الفعلية تختلف اختلافًا كبيرًا عن البيولوجيا.

بفضل التعلم العميق، أصبحت التطبيقات مثل التعرف على الصوت، والرؤية الحاسوبية المتقدمة، وأنظمة التوصية، أو القيادة الذاتيةبفضل القدرة على الوصول إلى مجموعات بيانات هائلة وقوة حوسبة هائلة، تستطيع هذه الشبكات اكتشاف علاقات دقيقة للغاية كان من المستحيل نمذجتها في السابق.

في قطاعات مثل صناعة السيارات، على سبيل المثال، يتم استخدام التعلم العميق تفسير صور الكاميرا وبيانات الرادار والليدار من خلال مركبة ذاتية القيادة، يمكنك تقدير المسافات والتنبؤ بالمسارات واتخاذ القرار بشأن المناورات بشكل شبه فوري.

معالجة اللغة الطبيعية

تهتم معالجة اللغة الطبيعية (NLP) بتمكين الأنظمة من لفهم اللغة البشرية وتحليلها وتوليدهاالنص والصوت. يشمل ذلك مهامًا مثل تصنيف المستندات، وتلخيص النصوص، والترجمة، والإجابة على الأسئلة، أو إجراء المحادثات.

نماذج اللغة الكبيرة الحالية (LLMs) قادرة على اكتشاف الهياكل النحوية والفروق الدلالية في كميات هائلة من النصوصهذا يسمح لهم بإنتاج استجابات طبيعية بشكل مدهش. تُستخدم هذه التقنيات في برامج الدردشة الآلية، والمساعدين الافتراضيين، وتحليل المشاعر، وخدمة العملاء، والدعم الداخلي في الشركات.

رؤية الكمبيوتر

تركز الرؤية الآلية على تمكين الآلات تفسير الصور ومقاطع الفيديو بمستوى من التفاصيل مماثل لمستوى الشخصومن الأمثلة على ذلك اكتشاف الأشياء، أو التعرف على الوجوه، أو قراءة الأحرف، أو قياس الأبعاد، أو تحديد العيوب في جزء صناعي.

لقد أصبحت هذه التكنولوجيا مكونًا أساسيًا في مراقبة الجودة في المصانع وأنظمة المراقبة وتشخيصات التصوير الطبي وتجارب الواقع المعزز، من بين العديد من الاستخدامات الأخرى.

مزايا وفرص الذكاء الاصطناعي

على المستوى الاقتصادي والاجتماعي، يفتح الذكاء الاصطناعي الباب أمام موجة جديدة من الابتكار في المنتجات والخدمات ونماذج الأعمالوفي أوروبا، على سبيل المثال، يُعتبر محركًا أساسيًا لتحويل القطاعات مثل الاقتصاد الأخضر، التكنولوجيا الصناعيةالزراعة، الصحة، السياحة أو الموضة.

في عالم الأعمال، واحدة من أعظم نقاط قوة الذكاء الاصطناعي هي... أتمتة العمليات المتكررة والمهام المملةيمكن للروبوتات المادية والبرامج الذكية التعامل مع العمليات الميكانيكية، وتصنيف الحوادث، وتوليد الاستجابات القياسية، أو استخراج البيانات، مما يوفر وقت الأشخاص للمهام الإبداعية والاستراتيجية.

ميزة رئيسية أخرى هي القدرة على تقليل الخطأ البشري في الأنشطة عالية التكرار أو عالية الدقةمن اكتشاف العيوب الدقيقة في الأجزاء باستخدام كاميرات الأشعة تحت الحمراء إلى إدخال البيانات تلقائيًا، تعمل الذكاء الاصطناعي على تقليل الأخطاء وتحسين إمكانية تتبع ما يحدث.

وفي الوقت نفسه، تساهم الأنظمة الذكية دقة ملحوظة في تحليل كميات كبيرة من المعلوماتيُولّد هذا مؤشرات مفيدة لاتخاذ القرارات بشأن الاستثمارات، وتعديل الأسعار، وتحديد حجم الموظفين، أو إعادة تصميم العمليات. تُعزز هذه القدرة التحليلية جودة قرارات الأعمال.

في مجال الرعاية الصحية، يتم استخدام الذكاء الاصطناعي بالفعل لدعم التشخيصات القائمة على الصور الطبية، وتصميم علاجات مخصصة، وتسريع اكتشاف الأدويةوفي القطاع المصرفي والمالي، يساعد على اكتشاف الاحتيال وتقييم مخاطر الائتمان وأتمتة العمليات في أسواق الأوراق المالية.

وتستفيد الخدمات العامة أيضًا من: تحسين النقل، وإدارة النفايات الذكية، وتوفير الطاقة، والتعليم الشخصي، أو الحكومة الإلكترونية الأكثر كفاءة هذه خطوط تطبيق واضحة. في الوقت نفسه، يُشير المحللون إلى أن الاستخدام المسؤول للذكاء الاصطناعي يُمكن أن يُسهم في تعزيز الديمقراطية من خلال المساعدة في مكافحة التضليل، وكشف الهجمات الإلكترونية، وتحسين الشفافية في عمليات الشراء.

الذكاء الاصطناعي التوليدي: قفزة جديدة في القدرات... وفي المخاطر

لقد كان ظهور الذكاء الاصطناعي التوليدي بمثابة نقطة تحول، حيث أصبحت هذه الأنظمة قادرة على إنشاء محتوى أصلي وموثوقالنصوص الفنية والصور والصوت والفيديو أو الكود والأمثلة العملية مثل كيفية إنشاء ملصقات WhatsApp باستخدام ChatGPT.

بالنسبة للشركات، هذا يفتح إمكانية إنتاج المستندات أو الحملات التسويقية أو التقارير أو النماذج الأولية بشكل أسرعبالإضافة إلى دعم الفرق بمساعدين في الإنتاجية. ومع ذلك، يطرح هذا أيضًا تحديات إضافية تتعلق بالجودة والملكية الفكرية والأمان والسمعة.

ومن بين المخاطر الأكثر وضوحا هو توليد معلومات غير صحيحة أو "هلوسة"يُصنّع النموذج بيانات أو مراجع تبدو مقنعة، لكنها لا تتوافق مع الواقع. إذا لم تُراجع هذه البيانات بدقة، فقد يؤدي ذلك إلى اتخاذ قرارات خاطئة، لا سيما في مجالات حيوية مثل الرعاية الصحية والقانون والمالية.

يضاف إلى ذلك مسألة أمن المعلومات والخصوصيةإذا تم تغذية نموذج ببيانات حساسة (العملاء والمرضى واستراتيجيات الأعمال) دون وجود الضمانات المناسبة، فهناك خطر التسريبات أو عدم الامتثال التنظيمي أو إعادة استخدام هذه المعلومات بشكل غير صحيح.

علاوة على ذلك، يمكن للذكاء الاصطناعي التوليدي أن يعزز الاعتماد المفرط على التكنولوجيامع ارتفاع التكاليف المرتبطة باستخدام النماذج الكبيرة، ويمكن أن يؤدي ذلك إلى تجانس المحتوى والمقترحات بشكل مفرط، مما يقلل من التمايز للعلامات التجارية إذا كانت جميعها تستخدم نفس الأدوات دون تخصيصها.

المخاطر المتقاطعة للذكاء الاصطناعي

وبعيدًا عن الجانب التوليدي، فإن النشر الهائل للذكاء الاصطناعي يجلب معه مجموعة من المخاطر الهيكلية التي تؤثر على العمالة والحقوق الأساسية والأمن والاستقرار الاقتصاديإن فهمهم أمر ضروري لكي نتمكن من إدارتهم.

النزوح الوظيفي وفجوة المهارات

إن الأتمتة التي تعتمد على الذكاء الاصطناعي لها تأثير غامض على التوظيف: فهو يلغي بعض الوظائف، ويحول أخرى، ويخلق مهنًا جديدة.تعتبر المهام الإدارية، أو أعمال المكتب الروتينية للغاية، أو مهام التحكم الأساسية معرضة للخطر بشكل خاص.

بدون سياسة واضحة إعادة التدريب المهني وتحديث المهاراتقد يتخلف الكثيرون عن الركب في سوق العمل، مما يفاقم التفاوتات القائمة. في نظام اقتصادي مُخطط، يُمكن تنظيم هذا التحول بشكل أفضل؛ أما في النظام الرأسمالي الحالي، فعادةً ما يُترجم إلى عدم استقرار وهشاشة في ظل تعديل هيكل الإنتاج.

التحيزات والتمييز الخوارزمي

تتعلم الخوارزميات من البيانات التاريخية التي غالبًا ما إنها تعكس التحيزات وعدم المساواة وهياكل السلطة الموجودةوإذا لم يتم تصحيح هذه التحيزات، فإن الأنظمة تعيد إنتاجها وتضخيمها في عمليات التوظيف، والموافقة على القروض، وإدارة التأمين، أو حتى في النظام القضائي.

نحن نعلم بالفعل عن حالات نماذج اختيار الموظفين التي لقد عاقبوا النساء بشكل منهجي لأنهم تدربوا باستخدام نماذج ذكورية في الغالب، أو أدوات تقييم مخاطر جنائية متحيزة عنصريًا. يتطلب تخفيف هذه المخاطر عمليات تدقيق مستقلة، وفرق تطوير متنوعة، وبيانات تدريب متوازنة ومراجعة.

الخصوصية والمراقبة والحقوق الأساسية

تعمل الذكاء الاصطناعي بشكل أفضل كلما زادت البيانات المتوفرة لديه، مما يحفز جمع كميات كبيرة من المعلومات الشخصيةيمكن أن تشكل أنظمة التعرف على الوجه، والتتبع عبر الإنترنت، وإنشاء ملفات تعريف سلوكية مفصلة، أو تحليل وسائل التواصل الاجتماعي، انتهاكًا للخصوصية، وفي الأيدي الخطأ، تصبح أدوات مراقبة.

يركز التشريع الأوروبي (بما في ذلك قانون الذكاء الاصطناعي القادم) على الحد من الاستخدامات عالية المخاطر، مثل التعرف البيومتري الجماعي أو اتخاذ القرارات الآلية دون إمكانية التدخل البشريومع ذلك، لا يزال خطر الانتهاكات قائما، وخاصة في السياقات التي تقل فيها الرقابة الديمقراطية.

الأمن والهجمات الإلكترونية والاستخدام الخبيث

الذكاء الاصطناعي هو سلاح ذو حدين: فهو قادر على فعل الكثير للوقاية من تهديدات الأمن السيبراني والكشف عنها والاستجابة لها بشكل أفضلكما يُمكن أن يُعزز قدرات المهاجمين. ومن المخاطر أتمتة حملات التصيد الاحتيالي، أو توليد برمجيات خبيثة أكثر تعقيدًا، أو تجاوز أنظمة الكشف باستخدام نماذج خصوم.

وفي المجال العسكري والأمن الوطني، كان تأثير الأسلحة المستقلة، وأنظمة الدفاع الآلية، والحرب السيبرانية المدعومة بالذكاء الاصطناعيولا يزال المجتمع الدولي بعيداً عن التوصل إلى إجماع قوي بشأن الحدود الأخلاقية والقانونية لهذه التطبيقات.

التلاعب بالمعلومات والتزييف العميق

مع الذكاء الاصطناعي التوليدي، من السهل نسبيًا إنشاء مقاطع فيديو وتسجيلات صوتية وصور مزيفة ولكنها قابلة للتصديق للغايةتُعرف هذه المواد باسم "التزييف العميق". يمكن استخدامها للابتزاز، أو التلاعب السياسي، أو تشويه السمعة، أو حملات التضليل الجماهيرية.

وفي الوقت نفسه، يمكن للخوارزميات التي تقوم بتخصيص المحتوى على وسائل التواصل الاجتماعي حصر المستخدمين في غرف صدى الصوتهذا يُعزز وجهات النظر المتطرفة ويزيد من استقطاب المجال العام. وهكذا، يُصبح الذكاء الاصطناعي مُضخّمًا للديناميكيات القائمة، بنطاق يصعب السيطرة عليه.

عدم القدرة على التنبؤ وتعقيد الأنظمة

مع تزايد تعقيد النماذج واستقلاليتها، لقد أصبح سلوكهم أقل شفافية، حتى بالنسبة لمبدعيهم.وهذا يجعل من الصعب تفسير سبب اتخاذ قرار معين، وهو أمر بالغ الأهمية في المجالات الخاضعة للتنظيم.

إذا تم تفويض وظائف حيوية (الرعاية الصحية، والبنية الأساسية، والعدالة، والنقل) إلى أنظمة غير شفافة، فإن خطر الفشل النظامي، والتأثيرات المتتالية، وفقدان السيطرة البشريةومن هنا تأتي أهمية تصميم نماذج قابلة للتفسير، مع إمكانية التتبع والقدرة على التدخل اليدوي.

التحديات الأخلاقية والتنظيمية والمسؤولية

لقد أثار صعود الذكاء الاصطناعي قضايا معقدة: من المسؤول إذا تسببت خوارزمية ما في ضرر؟ كيف نضمن العدالة والشفافية؟ ما هي الحدود التي يجب فرضها؟ إن اللوائح التقليدية تتخلف عن وتيرة الابتكار، وهذا من شأنه أن يخلق ثغرات قانونية.

يعمل الاتحاد الأوروبي على تعزيز قانون الذكاء الاصطناعي الذي تصنيف التطبيقات حسب مستويات المخاطر ويضع متطلبات أكثر صرامة للقطاعات ذات التأثير الكبير (الصحة، والنقل، والتوظيف، والعدالة، والأمن). ومن المتوقع وجود التزامات تتعلق بالتوثيق، والتدقيق، وإدارة بيانات التدريب، والإشراف البشري.

هناك قضية حساسة بشكل خاص وهي المسؤولية في حالة الأضرارإذا تسببت سيارة ذاتية القيادة في حادث، أو رفض نظام آلي منح قرض ظلماً، فهل يتحمل المسؤولية مُصنّع الأجهزة، أو مطوّر النموذج، أو الشركة المُشغّلة، أو المستخدم النهائي؟ فالنظام المُتراخي قد يُثبّط الجودة، بينما النظام المُتزمّت قد يُخنق الابتكار.

بالتوازي مع ذلك، تتطلب أخلاقيات الذكاء الاصطناعي تجاوز الامتثال الرسمي للقانون. يجب على المنظمات والمطورين والجهات التنظيمية - الاتفاق على مبادئ العدالة وعدم التمييز واحترام الاستقلال وتقليل الضرروهذا يتطلب حتماً نقاشاً عاماً مستنيراً، لا يشمل الشركات والحكومات فحسب، بل أيضاً المواطنين والمجموعات المتضررة.

حوكمة الذكاء الاصطناعي في المنظمات: من الفوضى إلى إطار عمل مشترك

في العديد من الشركات، بدأ اعتماد الذكاء الاصطناعي بشكل غير رسمي: يقوم كل قسم باختبار نموذجه الخاص أو دمج خدمة خارجية بمفرده.يستخدم قسم التسويق مولد النصوص، ويقوم قسم العمليات بتدريب مصنف الحوادث، ويقوم قسم الموارد البشرية بإجراء تجارب على أدوات فحص السيرة الذاتية…

يتمتع هذا النهج "من نموذج إلى نموذج" بميزة السرعة، ولكنه في الأمد المتوسط يسبب التفتت التكنولوجي وتكرار الجهود وانعدام السيطرةوتظهر العشرات من الحلول المعزولة، دون استراتيجية مشتركة، أو إمكانية تتبع، أو مقاييس مشتركة للتكلفة والقيمة.

المخاطر تتراكم: من غير المعروف عدد النماذج الموجودة في الإنتاج، أو البيانات التي تستخدمها، أو من الذي يقوم بصيانتها.سجلات القرارات غير مكتملة، مما يعيق عمليات التدقيق الداخلية أو التنظيمية. ويستمر تضخم فاتورة الخدمات السحابية دون أن يكون لدى أي جهة رؤية واضحة لعائداتها.

البديل هو التحرك نحو إطار الحوكمة المركزية يتيح ذلك استمرار التجارب، ولكن على أسس مشتركة: كتالوجات النماذج، وسياسات البيانات، وضوابط الوصول، وأدوات المراقبة المشتركة، وإمكانية التتبع، وتقييم المخاطر. تسعى البنى المتخصصة، مثل منصات الذكاء الاصطناعي للمؤسسات، تحديدًا إلى الجمع بين المرونة المحلية والتحكم العالمي.

بدون هذا الانضباط، يصبح الذكاء الاصطناعي مصدرًا الديون الفنية وعدم اليقين القانوني وتجاوز التكاليفومع ذلك، فإنها تصبح بمثابة طبقة استراتيجية أخرى، على مستوى الأمن السيبراني أو إدارة البيانات، قادرة على توفير مزايا تنافسية مستدامة.

تطبيقات الذكاء الاصطناعي في إدارة مخاطر المؤسسة

ومن المفارقات أن العديد من التهديدات المرتبطة بالذكاء الاصطناعي يمكن التخفيف منها استخدام الذكاء الاصطناعي نفسه كحليف لإدارة المخاطر داخل المؤسسات. وفي مجالات مثل المخاطر التشغيلية، والامتثال التنظيمي، ومكافحة غسل الأموال، وأمن المعلومات، يُستخدَم هذا النظام بالفعل بنتائج جيدة.

من ناحية أخرى، تسمح الخوارزميات تحليل كميات كبيرة من البيانات الداخلية والخارجية في وقت قصير جدًا، من خلال اكتشاف أنماط السلوك الشاذة، أو الاتجاهات المثيرة للقلق، أو مجموعات العوامل التي تسبق عادة الحوادث ذات الصلة.

كما أن لها قيمة خاصة النماذج التنبؤيةتساعد هذه الأدوات على توقع حدوث مخاطر معينة بناءً على الاتجاهات التاريخية. وهذا يسمح بتخطيط التدابير الوقائية، وتعزيز الضوابط، وتكييف التغطية التأمينية.

في مجال منع الاحتيال، يمكن للذكاء الاصطناعي المراقبة في الوقت الفعلي المعاملات، والوصول إلى النظام، والحركات الماليةتحديد المعاملات المشبوهة التي لا تُلاحظ. وبالمثل، في إدارة مخاطر الامتثال، تُسهّل خوارزميات التجزئة تصنيف العملاء أو المنتجات أو الولايات القضائية وفقًا لملفّات تعرضهم.

كل هذا يتطلب، مع ذلك، بيانات عالية الجودة ومحكومة جيدًا وتمثيليةبدون أساس معلوماتي متين، تُنتج النماذج نتائج إيجابية خاطئة، وتحيزات، وقرارات خاطئة. التكنولوجيا لا تُغني عن الحكم المهني، بل تُكمّله وتزيد من كفاءته.

وفي السنوات الأخيرة، ظهرت أيضًا حلول محددة تعتمد على الذكاء الاصطناعي التوليدي والتي تعمل كـ مساعدو الطيارين لإدارة المخاطرتساعد هذه الأدوات في تحديد التهديدات ووصفها وتقييمها بناءً على اللوائح المعمول بها، وطبيعة القطاع، وعمليات كل شركة. وعند دمجها في منصات قوية مزودة بضوابط مناسبة، تُحسّن هذه الأدوات المساعدة إنتاجية فرق إدارة المخاطر بشكل ملحوظ.

إن الجمع بين كل ما سبق يرسم صورة متناقضة: إن الذكاء الاصطناعي لديه إمكانات هائلة لتحسين كيفية إنتاجنا واتخاذنا القرارات وعيشنا، ولكنه يعمل أيضًا على تضخيم التفاوتات والأخطاء والصراعات إذا تم استخدامه دون معايير أو سيطرة.ويتطلب إيجاد التوازن الاستثمار في التدريب، وتعزيز التنظيم، ونشر أطر حوكمة قوية، وإبقاء الأشخاص دائمًا في مركز القرارات، واستخدام الذكاء الاصطناعي كأداة وليس كغاية في حد ذاته.

جدول المحتويات

- ماذا نفهم اليوم بالذكاء الاصطناعي؟

- كيف يعمل الذكاء الاصطناعي: التقنيات الرئيسية

- مزايا وفرص الذكاء الاصطناعي

- الذكاء الاصطناعي التوليدي: قفزة جديدة في القدرات... وفي المخاطر

- المخاطر المتقاطعة للذكاء الاصطناعي

- التحديات الأخلاقية والتنظيمية والمسؤولية

- حوكمة الذكاء الاصطناعي في المنظمات: من الفوضى إلى إطار عمل مشترك

- تطبيقات الذكاء الاصطناعي في إدارة مخاطر المؤسسة