- Съвременният изкуствен интелект се основава на оптимизационни алгоритми, които автоматизират задачи, анализират големи обеми от данни и дават възможност за нови бизнес модели.

- Основните рискове включват алгоритмично пристрастие, загуба на работа, нарушения на поверителността, манипулиране на информация и по-сложни кибератаки.

- Генеративният изкуствен интелект добавя специфични предизвикателства: халюцинации, фалшиви измислици, технологична зависимост, нарастващи разходи и проблеми с интелектуалната собственост и репутацията.

- Силното управление, ясните регулаторни рамки и използването на изкуствен интелект за управление на рисковете са ключови за овладяване на неговия потенциал, без да се губи контрол върху неговото въздействие.

La комбиниране на изкуствения интелект с всички аспекти на живота ни Това се случва много по-бързо, отколкото повечето организации и хора биха могли да си представят. От първите алгоритми за препоръки, ние преминахме за рекордно кратко време към генеративни модели, способни да пишат отчети, да анализират договори, да създават хиперреалистични изображения и да вземат автоматизирани решения в критични бизнес процеси.

Това ускорено разширяване отваря огромен набор от възможности, но също така Това носи със себе си рискове, етични дилеми и регулаторни предизвикателства. Това са проблеми, които не могат да бъдат игнорирани. Не става въпрос за избор между апокалиптична визия или наивен технооптимизъм, а за спокойно разбиране какво всъщност прави настоящият изкуствен интелект, какво не прави, къде добавя най-голяма стойност и къде може да се превърне в сериозен проблем, ако не се управлява разумно.

Какво разбираме днес под изкуствен интелект?

Когато говорим за изкуствен интелект в ежедневието, всъщност имаме предвид набор от алгоритми за оптимизация и статистически модели, обучени върху големи обеми данниТе не са съзнателни машини или „мозъци“, които мислят като човек, а системи, които учат модели и генерират резултати, полезни (или правдоподобни) за много специфични задачи.

В света на бизнеса, изкуственият интелект стана популярен, защото Това ви позволява да автоматизирате рутинни задачи, да анализирате огромни бази данни и да подпомагате вземането на решения. с прецизност и скорост, недостижими за човешки екип. От асистирана медицинска диагностика до ранно откриване на финансови измами, случаите на употреба се умножават във всички сектори.

Важно е обаче да се прави разлика между т.нар. Ограничен изкуствен интелект (тази, която решава специфични проблеми: класифициране на изображения, превод на текстове, препоръчване на съдържание...) и хипотетичната Общ изкуствен интелекткоето би се стремило да разсъждава за всяка задача като човешко същество. В момента това, което използваме в голям мащаб, са ограничени системи, колкото и впечатляващи да изглеждат модели като ChatGPT, Bard или DALL-E.

Тези модели, особено езиковите модели, са предназначени да изчислете най-вероятния и социално приемлив отговор Даден им е входен сигнал, не за да разбират света или да имат свои собствени цели. Те имитират разсъждения, но „под капака“ се крие сложно статистическо изчисление, а не съзнание или намерение.

Как работи изкуственият интелект: ключови техники

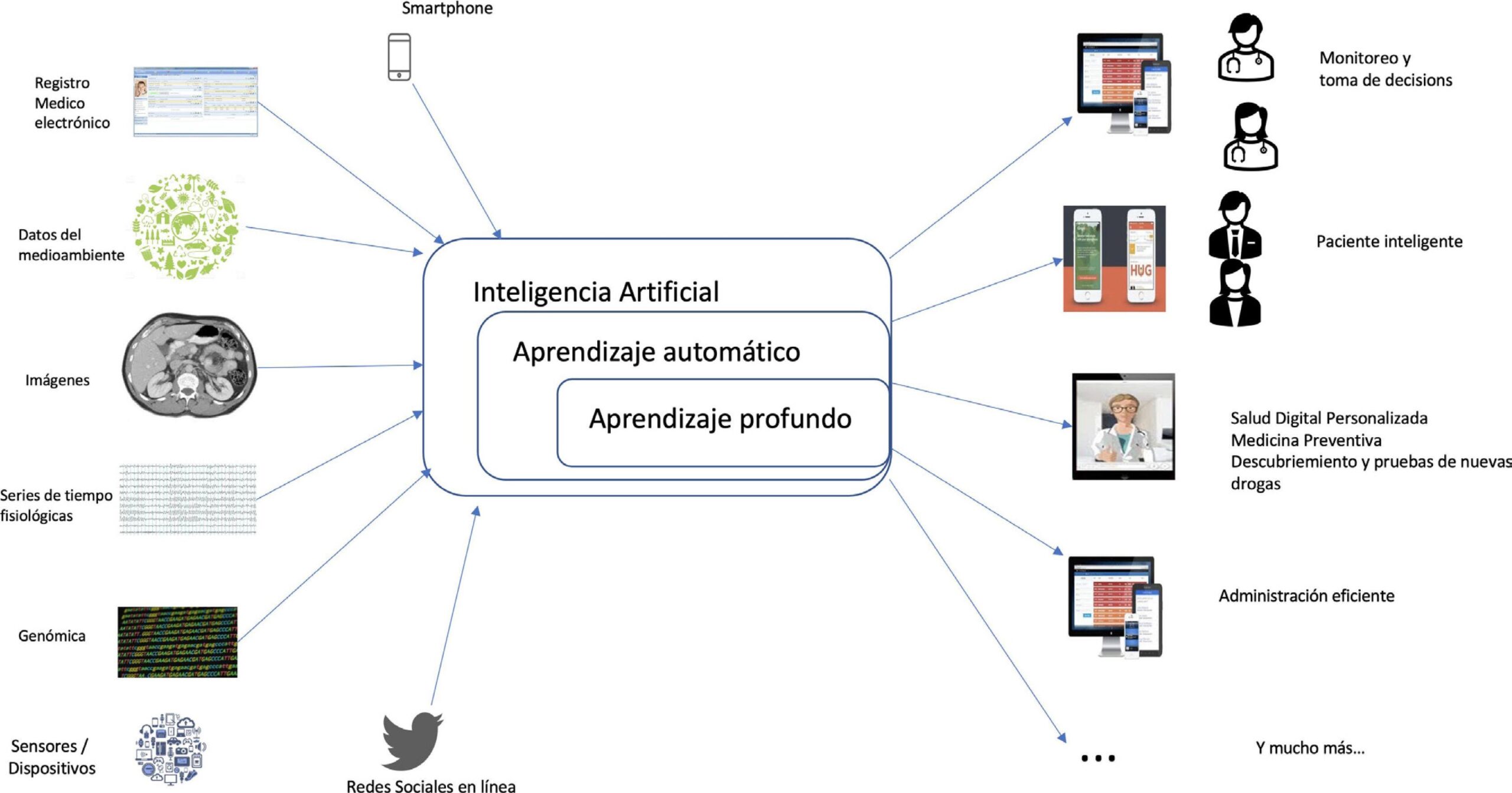

Повечето съвременни приложения за изкуствен интелект разчитат на три основни технологични градивни елемента: машинно обучение, дълбоко обучение и обработка на естествен езиккъм което се добавя компютърно зрение за всичко, свързано с изображения и видео.

Машинно обучение или автоматично обучение

Машинното обучение (МО) е клонът, който се фокусира върху изграждат алгоритми, способни да се учат от даннибез да е необходимо изрично програмиране на всяко правило. Системата намира модели и въз основа на тях прави прогнози, класификации или препоръки.

При контролирано обучение моделите се обучават с обозначени данни, указващи верния отговор (например, дали дадена транзакция е била измамна или не). При обучение без надзор, от друга страна, алгоритъмът открива скрити структури и групи в немаркирани данни, което е много полезно за сегментиране на клиенти, откриване на аномалии или групово поведение.

Типичен пример в индустрията е използването на машинно обучение за анализирайте данни в реално време от фабрични сензори (температура, вибрации, цикли на употреба) и предвиждат кога дадена машина ще се повреди, като по този начин позволяват прогнозна поддръжка.

Дълбоко обучение

Дълбокото обучение е подмножество на машинното обучение, което използва многослойни изкуствени невронни мрежи да учат все по-сложни представяния на данни. Тези мрежи са вдъхновени от структурата на мозъка, въпреки че действителното им функциониране се различава значително от биологичното.

Благодарение на дълбокото обучение, приложения като разпознаване на глас, усъвършенствано компютърно зрение, системи за препоръки или автономно шофиранеС достъп до огромни масиви от данни и изчислителна мощност, тези мрежи могат да откриват много фини взаимовръзки, които преди това бяха невъзможни за моделиране.

В сектори като автомобилната индустрия, например, дълбокото обучение се използва за... Интерпретиране на изображения от камери и данни от радари и лидари на автономно превозно средство, да оценяват разстоянията, да предвиждат траекториите и да вземат решения за маневри почти мигновено.

Обработка на естествен език

Обработката на естествен език (NLP) се занимава с това да позволи на системите да да разбира, анализира и генерира човешки езиккакто текст, така и глас. Това включва задачи като класифициране на документи, обобщаване на текстове, превод, отговаряне на въпроси или водене на разговори.

Съвременните модели на големи езици (LLM) са способни на откриване на синтактични структури и семантични нюанси в огромни количества текстТова им позволява да генерират изненадващо естествени отговори. Използват се в чатботове, виртуални асистенти, анализ на настроенията, обслужване на клиенти и вътрешна поддръжка в компаниите.

компютърно зрение

Машинното зрение се фокусира върху подпомагането на машините интерпретират изображения и видеоклипове с ниво на детайлност, подобно на това на човекОткриване на обекти, разпознаване на лица, четене на символи, измерване на размери или идентифициране на дефекти в индустриална част са някои примери.

Тази технология се е превърнала в ключов компонент в контрол на качеството във фабрики, системи за наблюдение, медицинска образна диагностика и преживявания с добавена реалност, наред с много други приложения.

Предимства и възможности на ИИ

На икономическо и социално ниво, изкуственият интелект отваря вратата към нова вълна от иновации в продукти, услуги и бизнес моделиВ Европа например, това се счита за основен двигател за трансформацията на сектори като зелената икономика, индустриална технологияселско стопанство, здравеопазване, туризъм или мода.

В света на бизнеса, една от най-големите силни страни на изкуствения интелект е... автоматизация на повтарящи се процеси и досадни задачиФизическите роботи и интелигентният софтуер могат да се справят с механични операции, класификация на инциденти, генериране на стандартни отговори или извличане на данни, освобождавайки времето на хората за творчески и стратегически задачи.

Друго ключово предимство е възможността да намаляване на човешките грешки при дейности с висока повторяемост или висока прецизностОт откриване на микродефекти в части с помощта на инфрачервени камери до автоматично въвеждане на данни, изкуственият интелект минимизира грешките и подобрява проследимостта на случващото се.

В същото време интелигентните системи допринасят забележителна точност при анализа на големи обеми информацияТова генерира полезни показатели за вземане на решения относно инвестиции, коригиране на цените, определяне на персонала или препроектиране на процесите. Тази аналитична способност повишава качеството на бизнес решенията.

В здравеопазването изкуственият интелект вече се използва за да подкрепя диагнози, базирани на медицински изображения, да проектира персонализирани лечения и да ускори откриването на лекарстваВ банковото дело и финансите помага за откриване на измами, оценка на кредитните рискове и автоматизиране на операции на фондовите пазари.

Обществените услуги също се възползват от: Оптимизация на транспорта, интелигентно управление на отпадъците, енергоспестяване, персонализирано образование или по-ефективно електронно управление Това са ясни области на приложение. Същевременно анализаторите посочват, че отговорното използване на изкуствен интелект може да допринесе за укрепване на демокрацията, като помогне за борба с дезинформацията, откриване на кибератаки и подобряване на прозрачността в процесите на обществени поръчки.

Генеративен изкуствен интелект: нов скок във възможностите... и в рисковете

Появата на генеративния изкуствен интелект бележи повратна точка, тъй като тези системи са способни на създавайте оригинално и правдоподобно съдържаниеТехнически текстове, изображения, аудио, видео или код, както и практически примери, като например Как да създадете стикери за WhatsApp с ChatGPT.

За бизнеса това отваря възможността за създават документи, маркетингови кампании, отчети или прототипи много по-бързокакто и подкрепа на екипи с помощници за производителност. Това обаче създава и допълнителни предизвикателства по отношение на качеството, интелектуалната собственост, сигурността и репутацията.

Сред най-видимите рискове е генерирането на невярна информация или „халюцинации“Моделът изфабрикува данни или препратки, които изглеждат убедителни, но не съответстват на реалността. Ако не бъдат правилно прегледани, това може да доведе до погрешни решения, особено в критични области като здравеопазване, право или финанси.

Към това се добавя и въпросът за информационна сигурност и поверителностАко даден модел се захранва с чувствителни данни (клиенти, пациенти, бизнес стратегия) без подходящи предпазни мерки, съществува риск от изтичане на информация, несъответствие с регулаторните изисквания или неправилно повторно използване на тази информация.

Освен това, генеративният изкуствен интелект може да насърчи прекомерна технологична зависимост, с нарастващи разходи, свързани с използването на големи модели, и може прекомерно да хомогенизира съдържанието и предложенията, намалявайки диференциацията за марките, ако всички те използват едни и същи инструменти, без да ги персонализират.

Междусекторни рискове, свързани с изкуствения интелект

Отвъд генеративния аспект, масовото внедряване на изкуствен интелект носи със себе си набор от Структурни рискове, които засягат заетостта, основните права, сигурността и икономическата стабилностРазбирането им е от съществено значение, за да можем да ги управляваме.

Загуба на работа и недостиг на умения

Автоматизацията, задвижвана от изкуствен интелект, има двусмислен ефект върху заетостта: Премахва определени позиции, трансформира други и създава нови професии.Административните задачи, рутинната офис работа или основните контролни задачи са особено уязвими.

Без ясна политика на професионална преквалификация и актуализиране на умениятаМного хора може да изостанат на пазара на труда, което ще задълбочи съществуващите неравенства. В една планова икономическа система този преход би могъл да бъде по-добре организиран; в сегашния капитализъм той обикновено се превръща в нестабилност и несигурност, докато производствената структура се адаптира.

Алгоритмични отклонения и дискриминация

Алгоритмите се учат от исторически данни, които често Те отразяват съществуващите предразсъдъци, неравенства и структури на власттаАко тези пристрастия не бъдат коригирани, системите ги възпроизвеждат и усилват в процесите на наемане, одобряване на заеми, управление на застраховките или дори в съдебната система.

Вече знаем за случаи на модели за подбор на персонал, които Те систематично наказваха жените защото са били обучавани, използвайки предимно мъжки шаблони или инструменти за оценка на криминалния риск, основани на расови предразсъдъци. Смекчаването на този риск изисква независими одити, разнообразни екипи за разработка и балансирани и прегледани данни за обучението.

Поверителност, наблюдение и основни права

Изкуственият интелект работи по-добре, колкото повече данни има, което стимулира масово събиране на лична информацияСистемите за разпознаване на лица, онлайн проследяването, създаването на подробни поведенчески профили или анализът на социалните медии могат да нарушат поверителността и, в неправилни ръце, да се превърнат в инструменти за наблюдение.

Европейското законодателство (включително предстоящия Закон за изкуствения интелект) се фокусира върху ограничаването на високорисковите употреби, като например масова биометрична идентификация или автоматизирано вземане на решения без възможност за човешка намесаВъпреки това, опасността от злоупотреби остава, особено в контексти с по-малко демократичен контрол.

Сигурност, кибератаки и злонамерена употреба

Изкуственият интелект е нож с две остриета: той може да направи много за... за по-добро предотвратяване, откриване и реагиране на киберзаплахиТова може също така да подобри възможностите на нападателите. Автоматизирането на фишинг кампании, генерирането на по-усъвършенстван зловреден софтуер или заобикалянето на системите за откриване с помощта на примери на злонамерени лица са някои от рисковете.

Във военната сфера и сферата на националната сигурност, въздействието на автономни оръжия, автоматизирани отбранителни системи и кибервойна, поддържана от изкуствен интелектМеждународната общност все още е далеч от солиден консенсус относно етичните и правните ограничения на тези приложения.

Манипулация на информацията и дийпфейкове

С генеративния изкуствен интелект е сравнително лесно да се създава фалшиви, но много правдоподобни видеоклипове, аудиозаписи и изображенияТе са известни като дийпфейкове. Тези материали могат да бъдат използвани за изнудване, политически манипулации, репутационни атаки или масови дезинформационни кампании.

В същото време, алгоритмите, които персонализират съдържанието в социалните медии, могат затваряне на потребителите в ехо камериТова подсилва крайните гледни точки и допълнително поляризира публичната сфера. По този начин изкуственият интелект се превръща в усилвател на съществуващата динамика, с обхват, който е трудно да се контролира.

Непредсказуемост и сложност на системите

Тъй като моделите стават по-сложни и автономни, Поведението им става все по-малко прозрачно, дори за техните създатели.Това затруднява обяснението защо е взето определено решение, което е от решаващо значение в регулираните области.

Ако ключови функции (здравеопазване, инфраструктура, правосъдие, транспорт) бъдат делегирани на непрозрачни системи, рискът от системни повреди, каскадни ефекти и загуба на човешки контролОттук е и важността на проектирането на обясними модели, с проследимост и възможност за ръчна намеса.

Етични, регулаторни и свързани с отговорността предизвикателства

Възходът на изкуствения интелект повдигна сложни въпроси: Кой носи отговорност, ако даден алгоритъм причини вреда? Как се гарантират справедливостта и прозрачността? Какви ограничения трябва да се наложат? Традиционните регулации изостават от темпото на иновациите и това създава правни вратички.

Европейският съюз насърчава закон за изкуствения интелект, който класифицира приложенията по нива на риск и установява по-строги изисквания за секторите с голямо въздействие (здравеопазване, транспорт, заетост, правосъдие, сигурност). Предвиждат се задължения относно документацията, одита, управлението на данни за обучение и човешкия надзор.

Един особено деликатен въпрос е отговорност в случай на щетиАко самоуправляващ се автомобил причини инцидент или автоматизирана система неправомерно откаже заем, отговорност носи производителят на хардуер, разработчикът на модела, компанията, която го управлява, или крайният потребител? Твърде хлабава система може да обезкуражи качеството; твърде твърда система може да задуши иновациите.

Успоредно с това, етиката на изкуствения интелект изисква да се надхвърли официалното спазване на закона. Организациите, разработчиците и регулаторните органи трябва постигат съгласие относно принципите на справедливост, недискриминация, зачитане на автономията и минимизиране на вредатаИ това неизбежно изисква информиран обществен дебат, в който да участват не само компании и правителства, но и граждани и засегнати групи.

Управление на ИИ в организациите: от хаос към обща рамка

В много компании внедряването на изкуствен интелект е започнало неформално: Всеки отдел тества свой собствен модел или интегрира външна услуга самостоятелно.Маркетингът използва генератор на текст, оперативният отдел обучава класификатор на инциденти, човешките ресурси експериментират с инструменти за проверка на автобиографии…

Този подход „модел към модел“ има предимството на бързината, но в средносрочен план води до технологична фрагментация, дублиране на усилия и липса на контролПоявяват се десетки изолирани решения, без обща стратегия, проследимост или споделени показатели за разходи и стойност.

Рисковете се натрупват: Не е известно колко модела са в производство, какви данни използват или кой ги поддържа.Записите с решенията са непълни, което възпрепятства вътрешните или регулаторните одити. А сметката за облачни услуги продължава да расте, без никой да има ясна представа за възвръщаемостта.

Алтернативата е да се премине към рамка за централизирано управление което позволява продължаване на експериментирането, но на обща основа: каталози на модели, политики за данни, контрол на достъпа, споделени инструменти за мониторинг, проследимост и оценка на риска. Специализираните архитектури, като например корпоративните платформи за изкуствен интелект, се стремят именно да комбинират локалната гъвкавост с глобалния контрол.

Без тази дисциплина, изкуственият интелект се превръща в източник на технически дълг, правна несигурност и превишаване на разходитеС него обаче се превръща в още един стратегически слой, на ниво киберсигурност или управление на данни, способен да осигури устойчиви конкурентни предимства.

Приложения на изкуствен интелект в управлението на корпоративния риск

Парадоксално е, че много от заплахите, свързани с изкуствения интелект, могат да бъдат смекчени. използване на самия изкуствен интелект като съюзник за управление на рисковете в организациите. В области като оперативни рискове, съответствие с регулаторните изисквания, борба с прането на пари и информационна сигурност, той вече се използва с добри резултати.

От една страна, алгоритмите позволяват анализирайте големи количества вътрешни и външни данни за много кратко време, откриване на аномални модели на поведение, тревожни тенденции или комбинации от фактори, които обикновено предшестват съответните инциденти.

Особено ценни са също прогнозни моделиТези инструменти помагат за предвиждане на материализирането на определени рискове въз основа на исторически тенденции. Това позволява планиране на превантивни мерки, засилване на контрола или адаптиране на застрахователното покритие.

При предотвратяване на измами, изкуственият интелект може да наблюдава в реално време транзакции, достъп до системата и финансови движенияидентифициране на подозрителни транзакции, които убягват на човешкото око. По подобен начин, при управлението на риска, свързан със съответствието, алгоритмите за сегментиране улесняват класифицирането на клиенти, продукти или юрисдикции според техния профил на експозиция.

Всичко това обаче изисква, качествени, добре управлявани и представителни данниБез солидна информационна основа, моделите генерират фалшиви положителни резултати, пристрастия и неправилни решения. Технологията не замества професионалната преценка, а по-скоро я допълва и я прави по-ефективна.

През последните години се появиха и специфични решения, базирани на генеративен изкуствен интелект, които действат като втори пилоти за управление на рискаТези инструменти помагат за идентифициране, описание и оценка на заплахите въз основа на приложимите разпоредби, индустрията и процесите на всяка компания. Когато са интегрирани в надеждни платформи с подходящи контроли, тези асистенти значително повишават производителността на екипите за управление на риска.

Комбинацията от всичко гореизброено рисува противоречива картина: Изкуственият интелект има огромен потенциал да подобри начина, по който произвеждаме, решаваме и живеем, но също така усилва неравенствата, грешките и конфликтите, ако се използва без критерии или контрол.Намирането на баланса включва инвестиране в обучение, засилване на регулациите, внедряване на солидни рамки за управление и винаги поставяне на хората в центъра на решенията, като се използва ИИ като инструмент, а не като самоцел.

Съдържание

- Какво разбираме днес под изкуствен интелект?

- Как работи изкуственият интелект: ключови техники

- Предимства и възможности на ИИ

- Генеративен изкуствен интелект: нов скок във възможностите... и в рисковете

- Междусекторни рискове, свързани с изкуствения интелект

- Етични, регулаторни и свързани с отговорността предизвикателства

- Управление на ИИ в организациите: от хаос към обща рамка

- Приложения на изкуствен интелект в управлението на корпоративния риск