- ChatGPT comet errors estructurals en raonament, dades i sentit comú, malgrat la seva aparença “intel·ligent”.

- Els errors deriven del mode d'entrenament estadístic, els biaixos de dades i la manca de comprensió real.

- Moltes professions i tasques educatives canviaran, però la IA actuarà sobretot com a assistent, no com a substituta total.

- Usar ChatGPT amb verificació de fonts, bons prompts i revisió humana permet aprofitar-ho sense assumir riscos excessius.

La intel·ligència artificial generativa s'ha colat al nostre dia a dia, i ChatGPT s'ha convertit en l'eina estrella per escriure, resumir, programar o cercar idees. Tot i això, per molt impressionant que sembli, està lluny de ser perfecta. Confiar cegament en les respostes et pot donar més d'un ensurt si no coneixes bé on coixeja.

Per això, cada vegada més experts insisteixen que entendre les tasques on ChatGPT falla és gairebé tan important com saber fer-lo servir. No es tracta de demonitzar la tecnologia, sinó aprendre a conviure amb els seus límits: quan és fiable, quan cal agafar les respostes amb pinces i com aprofitar-la sense perdre el judici crític humà.

Per què és clau conèixer les limitacions de ChatGPT

Darrere de la interfície del xat hi ha un sistema complex que combina grans models de llenguatge amb mecanismes interns que prioritzen velocitat o raonament segons la pregunta. Aquesta “decisió” automàtica no sempre coincideix amb el que l'usuari necessita: de vegades preval contestar ràpid encara que el problema exigeixi pensar pas a pas. Pots aprofundir en com els paràmetres de la intel·ligència artificial influeixen en aquest comportament.

A més, el comportament del model canvia amb cada actualització, cosa que fa que ChatGPT pugui respondre de manera diferent a la mateixa consulta en moments diferents. A això se sumen límits de context en converses llargues, on comença a “oblidar” parts del fil, i filtres de seguretat que bloquegen temes sensibles o perfectament legítims per excés de prudència.

Aquest còctel de factors provoca que, a la pràctica, l'experiència d'ús oscil·la entre allò brillant i allò frustrant en qüestió de segons. La diferència entre un resultat útil i un de desastrós sol estar en si l'usuari sap detectar quan la IA està sortint de la pista i com reconduir-la.

Diversos estudis i enquestes recents mostren que una part important dels usuaris no acaba de refiar-se de les respostes de ChatGPT. En una enquesta de l'OCU, moltes persones assenyalaven la “falta de confiança” en la informació generada com a principal motiu per no fer-lo servir cada dia, malgrat haver-ho provat.

En conseqüència, especialistes en intel·ligència artificial i en educació recomanen utilitzar ChatGPT com una font addicional i mai com a àrbitre definitiu de la veritat. Validar dades amb altres fonts, tenir coneixements mínims del tema i assumir que es pot inventar informació (les famoses “al·lucinacions”) és, ara com ara, obligatori.

Errors freqüents i limitacions tècniques de ChatGPT

A la literatura tècnica s'ha documentat que aquests sistemes tendeixen a al·lucinar respostes versemblants però falses, sobretot quan la pregunta és ambigua, molt específica o s'aparta de les dades que van veure durant l'entrenament. El problema és que la manera de redactar és tan convincent que és difícil detectar l'error si l'usuari no domina el tema. Eines com extensions per detectar contingut generat per IA poden ajudar a identificar algunes d'aquestes al·lucinacions.

Experts com el professor Josep Curto subratllen que algunes de les fallades més comunes són de calat profund i afecten la fiabilitat global del sistema. Entre ells esmenta descripcions errònies de fets verificables, respostes incompletes, explicacions inventades del procés de raonament del model i un comportament menys precís en idiomes diferents de l'anglès.

A més, encara que es van introduint millores, les restriccions ètiques i de seguretat no sempre estan ben calibrades. De vegades bloquegen sol·licituds legítimes mentre permeten altres problemàtiques, o produeixen respostes carregades de biaixos heretats de les dades d'entrenament, tant culturals com a polítics o de gènere.

Malgrat tot, investigacions contínues en aprenentatge profund i processament del llenguatge natural han aconseguit que les versions més recents, com GPT‑4, assoleixin rendiments propers a l'humà en tasques complexes de matemàtiques, programació, dret, medicina o psicologia. Però rendiment alt no significa infal·libilitat, i els punts cecs segueixen aquí.

7 tasques on ChatGPT falla (o és poc fiable)

Tot i que ChatGPT pot ser molt útil en moltes situacions, hi ha certs tipus de tasques on la probabilitat d'obtenir una resposta incorrecta, esbiaixada o enganyosa augmenta considerablement. Convé conèixer bé aquests escenaris per extremar la precaució.

1. Raonament lògic i matemàtiques complexes

Quan el problema exigeix càlculs encadenats, demostracions lògiques o proves matemàtiques formals, ChatGPT sol patinar. Pot equivocar-se en operacions senzilles, saltar-se passos clau o presentar com a correctes resultats directament erronis.

Això es nota especialment a exercicis amb molts passos intermedis, combinatòria, probabilitat, àlgebra avançada o geometria. Encara que el text sembli ben argumentat, petites relliscades en un pas arrosseguen tot el resultat, i el model no té forma de “revisar” de debò el seu propi raonament.

2. Sentit comú, intuïció i context humà

La IA interpreta allò que se li diu de forma literal, de manera que captar ironies, dobles sentits, sarcasmes o referències culturals molt localitzades li resulta complicat. Això dóna lloc a respostes que, per a un humà, són clarament “fora de lloc”.

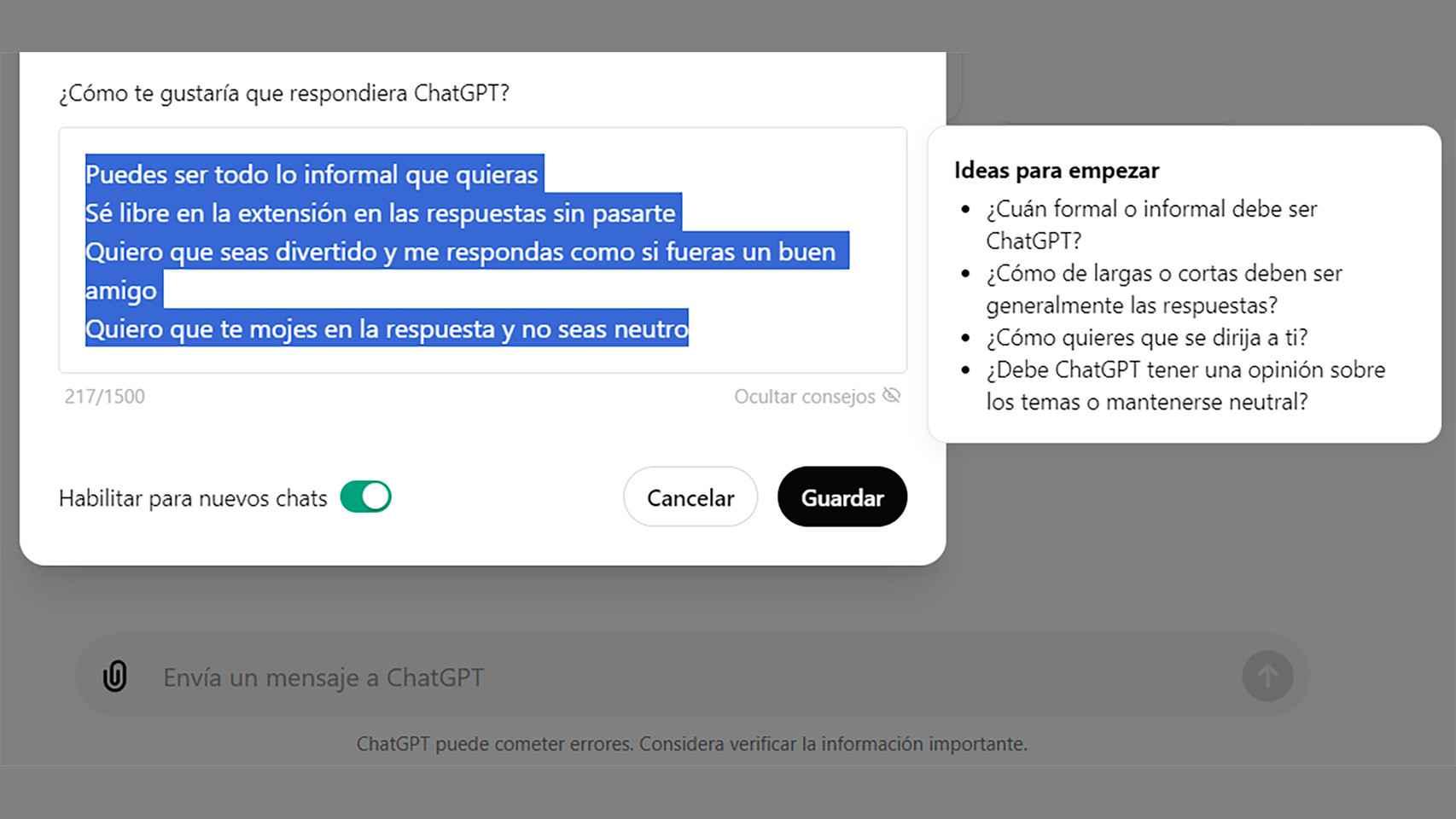

Quan la tasca exigeix empatia genuïna, comprensió emocional profunda o coneixement pràctic del món real, el model es limita a imitar patrons de llenguatge, però sense vivències pròpies. Pot semblar empàtic, però no sent res ni percep situacions com ho faria una persona. Per millorar el to i adaptar respostes convé personalitzar ChatGPT i ajustar estils i rols.

3. Memòria de llarg termini i continuïtat de projectes

Encara que sembli que “recorda” la conversa, ChatGPT té un context limitat i pot perdre parts de l'historial sense avís. Converses molt llargues o projectes que s'allarguen en el temps acaben patint talls de memòria.

Això afecta directament a tasques com ara redacció de llibres, informes extensos o projectes de programació de diverses sessions. Si no es guarda i gestiona el contingut externament, es corre el risc de perdre consistència, repetir decisions ja preses o contradir-se sense que el model en sigui conscient.

4. Supòsit estalvi de temps que surt car

Molta gent va a ChatGPT per anar més ràpid, però quan les respostes contenen errors subtils o manca informació clau, revisar i corregir pot trigar més que fer-ho des de zero. Això es nota molt en tasques professionals que requereixen un alt estàndard de qualitat.

En àmbits com informes tècnics, documentació legal, continguts acadèmics o codi de producció, el temps extra invertit en verificació pot fer que el suposat benefici dutilitzar la IA es dilueixi per complet si no es té un procés rigorós de revisió.

5. Dades desactualitzades i manca de connexió en temps real

Els models com GPT‑3 o GPT‑4 s'entrenen amb un tall temporal de dades, per la qual cosa no tenen accés directe a la web per consultar informació en temps real. Depenent de la versió, el vostre coneixement es pot aturar en un any concret.

Això implica que, en temes de actualitat, canvis legislatius recents, novetats científiques o notícies d'última hora, les respostes poden estar obsoletes o ser directament falses. Si l'usuari no contrasta amb fonts actualitzades, l'error passa desapercebut.

6. Rendiment variable i saturació

En moments d'alta demanda, especialment en comptes gratuïts, la qualitat i la velocitat de les respostes es poden veure afectades. El model pot contestar amb menys detall, tallar les respostes abans d'hora o donar solucions més superficials.

Aquesta variabilitat fa que no sempre sigui un substitut fiable per a tasques crítiques amb terminis estrictes. Dependre totalment del servei en hores punta sense un pla B es pot convertir en un risc operatiu per a empreses i professionals.

7. Restriccions, filtres i biaixos

Per motius de seguretat, ChatGPT inclou filtres per evitar continguts nocius, il·legals o extremadament sensibles. El problema és que aquests sistemes de moderació no són perfectes i, de vegades, bloquegen sol·licituds legítimes o responen de manera vaga per excés de prudència.

Tot i així, diversos investigadors han mostrat que els models poden continuar generant respostes amb biaixos racistes, sexistes o ideològics, reflectint els prejudicis presents a les dades d'entrenament. S'han documentat casos de bots entrenats amb tècniques semblants que acaben produint continguts discriminatoris. La avaluació ètica de chatbots ajuda a entendre i mitigar aquests biaixos.

Errors de fons: per què ChatGPT s'equivoca tant

En analitzar aquests errors, filòsofs de la ment i experts en IA apunten a límits estructurals: ChatGPT no pensa, ni entén, ni té consciència del que diu. La seva aparent intel·ligència emergeix de correlacions estadístiques a gran escala, no de raonament autèntic.

El professor Ned Block, per exemple, ha assenyalat experiments amb models generatius d'imatge en què es demana dibuixar un rellotge marcant hores com les 12.03 o les 6.28 i gairebé sempre apareix un rellotge a les 10.10.. Aquesta hora domina a les fotos publicitàries d?Internet perquè és estèticament atractiva i no tapa el logotip.

Aquest comportament il·lustra com els models tendeixen a replicar els patrons més freqüents de les dades d'entrenament, encara que contradiguin la instrucció concreta. No entenen la noció d'hora: només repeteixen la configuració estadísticament més comuna.

Una cosa semblant passa quan es demana una imatge de una persona escrivint amb la mà esquerra. Molts models acaben generant sistemàticament dretans, perquè la majoria d'exemples a les dades també ho són. Aconseguir un esquerrà ben representat requereix insistir amb prompts molt específics i tot i així no sempre surt bé.

Aquest tipus de fallades estructurals fa que ni tan sols els desenvolupadors aconsegueixin corregir del tot alguns biaixos profundament arrelats. L´entrenament per reforç amb feedback humà ajuda, però reforçar manualment tots els casos possibles (totes les hores del rellotge, totes les postures d´escriptura, etc.) és inviable.

En el pla textual, el problema es tradueix a explicacions massa segures de coses que el model realment no “sap”. Podeu detallar pas a pas un suposat mètode que mai ha executat o inventar referències acadèmiques i enllaços amb un aire totalment convincent.

Com es va entrenar ChatGPT i per què això influeix en els seus errors

Models com GPT-3 i GPT-4 es basen en l'arquitectura Transformer, i s'han entrenat amb quantitats massives de text procedents d'Internet: pàgines web, llibres, articles científics, notícies i altres recursos públics com Wikipedia o Common Crawl.

El procés té dues grans fases. Primer, un preentrenament massiu en què el model aprèn a predir la següent paraula en milions de frases. En aquesta etapa no se li ensenya “gramàtica” explícita, sinó que dedueix patrons en omplir buits al text, una mena d'exercici gegant de completar paraules.

Després es realitza un ajustament fi per a tasques concretes, com ara traducció, resum, resposta a preguntes o diàleg conversacional. Aquí entren en joc dades més petites i específiques, etiquetades per ensenyar al model quin tipus de resposta es considera adequada en cada context.

En el cas de ChatGPT, també s'ha fet servir aprenentatge per reforç amb retroalimentació humana (RLHF). Entrenadors humans avaluaven diverses possibles respostes del model a una mateixa entrada i les ordenaven de millor a pitjor. Amb aquesta informació, el sistema aprenia a preferir les sortides més ben valorades.

Aquest enfocament millora la qualitat percebuda de les respostes, però no elimina el problema de fons: el model segueix sense tenir comprensió semàntica ni accés directe a la realitat. Només afina les seves probabilitats per sonar més útil, educat i segur, cosa que de vegades fa encara més perilloses les al·lucinacions.

A més, encara que s'apliquen tècniques de neteja de dades, regularització i avaluació humana per reduir biaixos i estereotips presents als textos d'entrenament, és impossible filtrar-los del tot. Per això les empreses recomanen supervisar de manera contínua les sortides, sobretot en aplicacions sensibles.

Impacte de ChatGPT en estudis i món laboral

Des del seu llançament, ChatGPT ha revifat el debat sobre com afectarà la IA generativa els treballs humans i el sistema educatiu. Grans tecnològiques el presenten com a “copilot” o assistent, però molts estudis apunten a transformacions profundes en nombroses professions.

Investigacions d'universitats com Nova York o Pennsilvània, juntament amb anàlisis d'OpenAI i altres entitats, mostren que tasques basades en llenguatge (escriptura, traducció, anàlisi de textos, documentació, comptabilitat bàsica) són especialment vulnerables a lautomatització parcial.

Al mercat laboral, s'han identificat com a especialment exposats teleoperadors de vendes, professors universitaris d´idiomes i literatura, docents d´història o dret, traductors, administratius i certs perfils de redacció. No vol dir que tots hagin de desaparèixer, però sí que bona part de les seves funcions es podrà recolzar fortament a la IA.

Altres estudis troben efectes positius clars. En proves amb desenvolupadors de programari, per exemple, els qui usaven assistents de codificació basats en models similars completaven les tasques fins a un 55% més ràpid que els que treballaven sense ajuda. La productivitat en tasques rutinàries augmenta, cosa que permet dedicar més temps a problemes complexos.

En educació, el debat és especialment calent. Hi ha experiències que mostren que cada vegada és més difícil distingir si un assaig curt ho ha escrit un estudiant o ChatGPT, fins i tot per a docents experimentats i autors professionals. En alguns experiments, professors i experts fallaven en identificar el veritable autor.

Davant això, molts educadors comencen a plantejar més avaluació oral, treballs a classe i activitats on es vegi el procés de pensament de l'alumne, no només el producte final. Altres proposen fer servir ChatGPT com a eina didàctica: punt de partida que l'estudiant ha de criticar, corregir, comparar amb fonts reals i millorar.

Bones pràctiques per utilitzar ChatGPT sense caure en les trampes

Malgrat tots aquests problemes, ChatGPT és extremadament útil si se li dóna el rol adequat. La clau és a combinar un bon disseny de prompts amb un control humà rigorós del que genera, especialment quan hi ha implicacions acadèmiques, legals o professionals.

Una primera recomanació bàsica és verificar sempre dades, xifres, referències i noms propis abans de fer-los servir. No n'hi ha prou que “soni bé”: cal comprovar amb fonts fiables (articles científics, legislació oficial, llibres de referència, bases de dades especialitzades, etc.).

també convé no basar decisions crítiques en una única resposta del model. Quan l'assumpte és important, el prudent és contrastar diverses opinions (altres eines, experts humans, documentació) i fer servir el xat només com a suport o generador d'esborranys.

El disseny de les instruccions influeix moltíssim: prompts clars, específics i ben estructurats redueixen l'ambigüitat i solen produir sortides més útils. Demanar que expliqui el raonament pas a pas, que inclogui contraexemples o que assenyali possibles limitacions pot ajudar a detectar errors.

Finalment, resulta molt potent fer servir ChatGPT com generador de plantilles, esquemes, esborranys i llistes d'idees sobre les quals treballa després la persona, en lloc d'acceptar sense més ni més el text final. D'aquesta manera, s'estalvia temps a la part més mecànica, però el contingut final continua sent reelaborat i validat per un humà.

L'experiència dels darrers anys mostra que la intel·ligència artificial generativa funciona millor quan la tractem com a assistent potent però fal·lible. Amb una mica d'esperit crític, un bon criteri per escollir tasques i un sistema seriós de revisió, es converteix en una aliada valuosa en lloc d'un risc silenciós.

Taula de Continguts

- Per què és clau conèixer les limitacions de ChatGPT

- Errors freqüents i limitacions tècniques de ChatGPT

- 7 tasques on ChatGPT falla (o és poc fiable)

- 1. Raonament lògic i matemàtiques complexes

- 2. Sentit comú, intuïció i context humà

- 3. Memòria de llarg termini i continuïtat de projectes

- 4. Supòsit estalvi de temps que surt car

- 5. Dades desactualitzades i manca de connexió en temps real

- 6. Rendiment variable i saturació

- 7. Restriccions, filtres i biaixos

- Errors de fons: per què ChatGPT s'equivoca tant

- Com es va entrenar ChatGPT i per què això influeix en els seus errors

- Impacte de ChatGPT en estudis i món laboral

- Bones pràctiques per utilitzar ChatGPT sense caure en les trampes