- Microsoft Fabric centralizuje data, řízení, umělou inteligenci a analýzy v reálném čase na platformě OneLake a v rámci unifikovaných funkcí.

- Platforma posiluje správu a řízení, zabezpečení a náklady prostřednictvím Purview, zabezpečení OneLake, DLP, DSPM a integrace s Azure Cost Management.

- Nástroje Data Factory, Dataflow Gen2 a migrace usnadňují přesun stávajících úloh a orchestraci složitých kanálů.

- Copilot, datoví agenti, MCP a nové úlohy, jako je Fabric IQ a Real-Time Intelligence, pohánějí pokročilé scénáře umělé inteligence a automatizace.

Pokud už nějakou dobu pracujete s daty v ekosystému Microsoftu, jistě jste si všimli, že Microsoft Fabric se stal ústředním bodem moderní analytikySjednocení všeho, co bylo dříve rozprostřeno mezi Power BI, Azure Synapse, Data Factory a dalšími službami, do jedné platformy. V tomto článku se důkladně a detailně podíváme na nejnovější funkce, plán a praktické důsledky platformy Fabric pro analytiku, správu a řízení, umělou inteligenci a výpočetní techniku v reálném čase.

Myšlenka je taková, že po dočtení budete mít jasnou představu o Co dnes nabízí Microsoft Fabric, kam směřuje a jak ovlivňuje datovou architekturu? vaší organizace: možnosti správy a řízení s Purview, automatizace s API a Gitem, nové funkce umělé inteligence, analýza dat v reálném čase, zabezpečení v OneLake, migrace, výkon a mnoho dalšího.

Microsoft Fabric a framework pro zavedení cloudu: správa, náklady a automatizace

V rámci rámce pro přijetí cloudu (CAF) společnost Microsoft publikuje řadu průvodců pro sladění Návrh Microsoft Fabric s designovými pilíři vstupních zónZávěrečná část této série se zabývá třemi klíčovými oblastmi: řízením, optimalizací kapacity a automatizací/DevOps.

V sekci správy a řízení Náklady na kapacitu Fabric jsou zveřejňovány prostřednictvím služby Azure Cost Management.Díky tomu můžete nativně integrovat data o využití kapacity F (a dalších SKU) do řídicích panelů nákladů, upozornění a analýz výdajů Azure. Nejde jen o zobrazení faktury: tyto informace můžete porovnat se značkami, předplatnými nebo skupinami zdrojů, abyste pochopili, kdo co a proč utratí.

Technická architektura a obchodní model Fabricu umožňují zákazníkům jemná kontrola spotřeby kapacity pro optimalizaci provozních nákladůV praxi se to projevuje v několika pákách:

- Škálování schopností FZvyšovat nebo snižovat kapacitu na základě předvídatelných špiček, jako jsou prodejní kampaně, účetní termíny nebo velké objemy dat.

- Možnosti pozastavení a obnoveníSprávci sítí Fabric mohou pozastavit kapacitu F, když není potřeba (například přes noc nebo o víkendech v nekritických prostředích), aby snížili výpočetní náklady.

- Ochrana proti přepětíDva parametry na úrovni kapacity řídí způsob správy úloh na pozadí, aby se zabránilo jejich zahlcení prostředí: Práh odmítnutí na pozadí a Práh obnovy na pozadí.

- Rezervace kapacityJe možné rezervovat kapacitu na definovaná období za účelem získání slev, za předpokladu, že je očekávaná spotřeba důkladně naplánována.

V oblasti správy dat se Fabric spoléhá na Microsoft Purview jako centrální komponenta pro katalogizaci, rodokmen a klasifikaciZ Purview je možné aplikovat štítky citlivosti, sledovat souvislosti mezi původem, transformacemi a spotřebou, certifikovat datová aktiva nebo vylepšovat kampaně na podporu kvality dat, a to vše při integraci prvků Fabric (Lakehouse, Warehouse, KQL, Power BI atd.).

Sekce „Automatizace platforem a DevOps“ je primárně strukturována kolem Integrace s Gitem, deployment pipeline a REST APIPracovní prostory Fabric lze propojit s repozitáři Git, aby na stejném projektu datového inženýrství, datové vědy nebo analýzy v reálném čase mohlo spolupracovat více vývojářů, aniž by se práce překrývala.

Git a Deployment Pipelines umožňují kontrolovaným způsobem řídit vývojové, testovací a produkční cyklyPropagace obsahu, sledování změn, synchronizace artefaktů a správa verzí. Od března 2025 tyto kanály podporují (v obecném nebo náhledovém stavu) širokou škálu typů prvků, jako jsou triggery, dashboardy, datové toky, datové kanály, datamarty, jezerní sklady, datové sklady KQL, poznámkové bloky, stránkované sestavy, organizační aplikace atd.

Mezitím Fabric odhaluje velmi široká sada REST API s jehož pomocí lze automatizovat téměř jakoukoli administrativní úlohu nebo úlohu nasazení: mimo jiné vytváření pracovních prostorů a složek, hromadnou migraci položek, správu připojení a bran, extrakci definic, aktivaci kanálů nebo poznámkových bloků.

Klíčové aktualizace v oblasti analytiky, umělé inteligence a správy pro Microsoft Fabric

Vývoj Fabricu se vyznačuje obrovským množstvím náhledových funkcí a nových možností, které Dotýkají se prakticky všech oblastí platformyPoté jsou seskupeny a diskutovány strukturovaným způsobem, aby bylo možné vidět celý rozsah.

Funkce umělé inteligence v datovém skladu a multimodální funkce

V oblasti relačních dat zahrnuje Fabric Data Warehouse AI funguje přímo v T-SQL (náhled). To umožňuje:

- Klasifikujte nebo kategorizujte text.

- Analyzujte sentiment.

- Extrahujte strukturované informace z volného textu.

- Překládat text mezi jazyky.

- Správná gramatika.

Cílem je to Pro obohacení dat o umělou inteligenci není třeba opouštět kontext SQL.Tyto funkce jsou kombinovány s obecnější multimodální podporou ve funkcích umělé inteligence platformy Fabric, které nyní dokáží zpracovávat obrázky (JPG/JPEG, PNG, GIF, WebP), PDF a běžné textové formáty, stejně jako vstupy ve formě cest k souborům.

Utility jako například aifunc.load pro ingestování složek do tabulek Díky možnostem promptu a schématu vám `aifunc.list_file_paths` umožňuje iterovat cestami k souborům a `ai.infer_schema` odvozuje schémata kompatibilní s `ai.extract`. To vše vám umožňuje transformovat a obohacovat data bez nutnosti budovat složité procesy od nuly.

OneLake, Delta, Apache Iceberg a multiplatformní přístup

Na úložné vrstvě zůstává OneLake sjednoceným jezerem, kde se nachází celý Fabric. Jedním z hlavních vylepšení je možnost Vystavení tabulek Delta Lake jako tabulek Apache Iceberg bez nutnosti přesouvat nebo duplikovat data, aby enginy kompatibilní s Iceberg mohly přímo číst, co je na OneLake.

Kromě toho OneLake nyní podporuje Data Apache Iceberg zapsaná přímo aplikací Snowflake, spotřebovaná ve Fabricu s přístupem bez kopírováníTato strategie posiluje interoperabilitu: Fabric nechce být izolovaným datovým centrem, ale datovým „centrem“, které mohou ostatní enginy využívat bez duplikování úložiště.

Ve stejném duchu připouští i OneLake zkratky pro úložiště Azure Blob StorageOneDrive a SharePoint a rozšiřuje zabezpečení o přístupové role, zabezpečení na úrovni složek, řádků a sloupců a model zabezpečení, který mohou třetí strany respektovat díky rozšíření modelu autorizovaného enginu.

Jedním obzvláště důležitým bodem je federace katalogu OneLake v Azure Databricks, která umožňuje Přístup s nulovou kopií z katalogu Unity k tabulkám OneLakeTímto způsobem OneLake zůstává zdrojem pravdy, ale Databricks se mohou dotazovat na data přímo a synchronizovat pouze metadata.

SQL Database on Fabric: výkon, zabezpečení a virtualizace

Databáze SQL ve službě Fabric získává vlastní funkce: Možnosti ZMĚNY SABY DATABÁZEPodpora pro řazení a fulltextové indexování v náhledu. Na úrovni výkon databáze A co se týče nákladů, existuje několik vylepšení:

- Automatické zhutňování indexů pro snížení úložiště, I/O operací a zlepšení doby dotazování bez nutnosti plánování úloh údržby.

- Maximální limit virtuálních jader pro řízení využití výpočetních zdrojů (4 nebo 32 virtuálních jader), které jsou navrženy tak, aby zabránily příliš velké spotřebě sdílené kapacity úlohou.

- Vlastní SQL fondy které poskytují správcům pracovních prostorů podrobnou kontrolu nad alokací zdrojů a směrováním dotazů podle názvu aplikace.

Je také povoleno Virtualizace dat v databázi SQL, který umožňuje dotazování externích dat uložených v OneLake pomocí T-SQL, spojování souborů v běžných formátech s lokálními relačními tabulkami pomocí joinů, bez nutnosti fyzického importu dat.

Z hlediska zabezpečení podporuje databáze SQL Soukromý odkaz na úrovni klienta (náhled)Díky tomu je snazší směrovat datový provoz soukromým a kontrolovaným způsobem a integrovat se s celkovou konfigurací zabezpečené sítě Fabric.

Real-time Intelligence, Eventhouse, Eventstream a Activator

Modul Real-Time Intelligence (RTI) se stal jedním z klíčových rozlišovacích znaků Fabricu. Eventhouse a Eventstream se spojují do přijímat, zpracovávat a spouštět události v reálném čase ze všech druhů zdrojů a Activator organizuje akce, které se spustí za určitých podmínek.

Mezi nejvýkonnější nové funkce patří:

- Detekce anomálií bez kódu s automatickým výběrem modelu, jednoduchým rozhraním a flexibilními upozorněními.

- Obchodní akce, které zachycují klíčové obchodní momenty generované z funkcí uživatelských dat a poznámkových bloků a umožňují aktivovat upozornění, vlastní logiku, toky, modely umělé inteligence nebo úlohy Spark.

- Integrace funkcí aktivátoru a uživatelských databy funkce vytvořené ve Fabricu mohly zpracovávat události z libovolného zdroje, včetně interních událostí ze samotné platformy a z OneLake.

- Schopnost zpracovávat události pomocí SQL (operátor SQL v Eventstreamu), což umožňuje transformaci toků v reálném čase se známou syntaxí SQL.

Jsou přidány příslušné konektory, jako například Cribl (pro příjem protokolů a telemetrie z více zdrojů), konektor se Solace PubSub+ a podporu streamování přes privátní sítě prostřednictvím Azure Virtual Network, VPN, ExpressRoute nebo privátních koncových bodů.

Pro datová schémata a smlouvy zavádí Eventstream Registr schémat který definuje a ověřuje schémata událostí pro robustnější kanály a podporuje propojení registru schémat Confluent s Kafkou v Confluent Cloudu s respektováním stávajících smluv.

Funkce Copilota a umělé inteligence napříč platformou

Copilot v Fabricu je nyní k dispozici globálně a působí v… Power BI, datová továrna, datová věda a datové inženýrství a psaní KQL dotazůKromě toho byly začleněny specifické funkce:

- Copilot pro Dataflow Gen2 (moderní Get Data), který pomáhá přijímat a transformovat data pomocí instrukcí v přirozeném jazyce.

- Copilot pro datový sklad (chat), přístupné z tlačítka na pásu karet pro urychlení skladovacích úloh prostřednictvím dialogového okna.

- Copilot pro koncový bod analytiky SQL, který generuje a optimalizuje SQL dotazy z popisů podniků.

- Copilot na noteboocích se znalostí kontextu pracovního prostoru, Lakehouse, struktury poznámkových bloků a prostředí pro provádění, schopnost generovat vícekrokový kód, refaktorovat, sumarizovat složité poznámkové bloky a diagnostikovat chyby pomocí možnosti „Opravit pomocí Copilota“.

- Automatické doplňování kódu (doplňování kódu v kódu) a doplňování kódu v kódu Notebook Copilot (preview), psát Python rychleji a s menším počtem chyb.

Kromě toho se základna technologií umělé inteligence rozšiřuje o Integrované předpřipravené nástroje pro slévárnu (Azure OpenAI, Azure Language, Azure Translator), pluginy OpenAI pro Eventhouse (ai_embed_text a ai_chat_completion) a řadu agentů a datových agentů, které umožňují dalším aplikacím, včetně Copilot Studio, pracovat s daty Fabric orchestrovaným způsobem.

Datoví agenti Fabric, MCP a nástroje pro vývojáře

Úvod do látky datoví agenti schopní orchestrovat přístup k datům a nástrojům Pro agenty s umělou inteligencí, s Python SDK a přímou integrací s Microsoft Copilot Studio. To usnadňuje vytváření konverzačních asistentů, kteří pracují s podnikovými daty řízenými v platformě Fabric.

Souběžně s tím, Kontextový protokol modelu (MCP) Stává se klíčovou součástí integrace mezi agenty umělé inteligence a službami Fabric. K dispozici jsou dedikované servery MCP pro Activator a Eventhouse a vývojově orientovaný Fabric MCP, který:

- Umožňuje asistentům s umělou inteligencí generovat kód a obsah pro položky Fabric.

- Integruje se s vývojářskými nástroji, jako jsou VS Code a GitHub Codespaces.

- Představuje nástroje pro konzultace a práci s daty v reálném čase v Eventhouse.

Pro každodenní práci vývojáře je třeba zdůraznit několik klíčových prvků, včetně vývojové prostředí: Rozšíření MSSQL pro VS Code s podporou databáze Fabric SQL, ovladač Microsoft ADO.NET a ovladač ODBC pro Fabric Data Engineering (připojení k Spark SQL přes Livy) a konektor Spark pro databáze SQL, který zjednodušuje ověřený přístup ze Sparku k databázím SQL v Azure a Fabricu.

Také se objevuje CLI fabric, dostupný jako integrovaná úloha v Azure DevOps, která umožňuje automatizovat správu pracovních prostorů, položek a nasazení bez nutnosti ruční instalace externích nástrojů.

Datová továrna, migrace dat a orchestrace ve Fabricu

Vrstva datové integrace Fabricu se spoléhá na Data Factory a Dataflow Gen2, které přijímají funkce pro... Orchestrace bude chytřejší, automatizovanější a s jednoduššími migracemi. z existujících platforem.

Dataflow Gen2: výkon, veřejná API a diagnostika

V Dataflow Gen2 najdeme v náhledové verzi několik funkcí:

- Pokročilá úprava cílových dotazů upravit logiku v cílovém umístění přímo z vlastního vývojového prostředí.

- Rozdělené výpočtycož umožňuje paralelní běh částí datového toku, čímž se zkracuje celková doba vyhodnocení.

- Stáhnout diagnostiku na úrovni provádění, se strukturovanými balíčky protokolů pro analýzu výkonu a řešení incidentů.

- Veřejná rozhraní API pro programově vytvářet, aktualizovat, mazat, plánovat a monitorovat datové toky.

- Veřejné parametry s podporou CI/CDkteré umožňují obnovování datových toků předáváním hodnot z kanálů nebo jiných zdrojů.

- Nedávná data pro rychlý přístup k naposledy použitým položkám na pásu karet Power Query a v moderní funkci Načíst data.

To vše je doplněno schopnostmi Programové vyhodnocení Power Query pomocí RESTTo otevírá dveře ke spouštění M skriptů jako součásti automatizovaných procesů, jejich integraci se Sparkem, kanály nebo externími nástroji s využitím konektorů Power Query.

Datová továrna: adaptivní výkon, konektivita a DBT

V „klasičtější“ části integrace představuje Data Factory v rámci Fabricu:

- Adaptivní ladění výkonu pro aktivitu kopírování, která inteligentně upravuje parametry výkonu podle konfigurace a kontextu provádění.

- Podpora sběru změn dat (CDC) v úloze kopírování, aby se průběžně replikovaly pouze změny (vkládání, aktualizace, mazání).

- Místní brány s možností ručního upgradu spravováno z portálu Fabric, API nebo skriptů.

- nedávné připojení, který přidává k připojením vlastnosti posledního použití pro usnadnění auditu a správy životního cyklu.

- nativní DBT Job, který umožňuje spouštění DBT projektů v rámci Fabricu s integrovanou orchestrací, testováním, dokumentací a správou.

- Vyvolání aktivity balíčku SSIS v kanálech, pro spouštění balíčků SSIS přímo z orchestrace v prostředí Fabric.

Uživatelský zážitek je také vylepšen díky Výběr webu SharePointu (SharePoint Site Picker), který eliminuje nutnost ručního psaní URL adres a s podporou MCP pro Data Factory, takže asistenti s umělou inteligencí mohou vytvářet a nasazovat Dataflow Gen2 jednoduše z instrukcí v přirozeném jazyce.

Nástroje pro migraci a replikaci dat

Společnost Microsoft silně propaguje migraci na platformu Fabric prostřednictvím několika specifických nástrojů:

- Posouzení migrace Fabric pro Data Factory, který analyzuje přípravu ADF kanálů a migruje ty podporované do pracovního prostoru Fabric s mapováním připojení.

- Asistent migrace pro datový skladkterý se nyní může přímo připojit ke zdrojovému datovému skladu a přesunout ho do datového skladu Fabric.

- Asistent migrace pro databázi SQL, zaměřený na migraci lokálních úloh SQL Serveru s importem schématu přes DACPAC, detekcí nekompatibility a doporučeními.

Pokud jde o replikaci, je poskytována podpora zrcadlení více provozních zdrojů (Azure Database for MySQL, Google BigQuery, SQL Server atd.) do Fabricu s možností kontroly replikace tabulek, restartování procesů zrcadlení přes REST a v případě Databricks mapování politik Unity Catalogu na zabezpečení OneLake.

Součástí je také replikační konektor od Lakehouse s využitím Datový kanál Delta Change, která umožňuje změny na deskách Lakehouse Delta směrem ke kompatibilním destinacím, aniž by bylo nutné znovu vynalézat kolo s využitím domácích řešení CDC.

Zabezpečení, pokročilá správa a monitorování v platformě Fabric

Jednou z největších obav u jakékoli analytické platformy je, jak zabezpečit data, řídit využití a sledovat spotřebu zdrojůLátka v těchto oblastech rychle dozrává.

Bezpečnost a ochrana dat ve společnosti OneLake

OneLake přidává kompletní model zabezpečení přístupu k datům s:

- Role pro přístup k datům pro Lakehouse s konfigurovatelnými oprávněními z bezpečnostního rozhraní založeného na složkách.

- Podpora zabezpečení pro zkratky, aby třetí strany mohly respektovat definované zásady.

- API pro zabezpečení přístupu k datům OneLake, které umožňuje automatizovanou správu oprávnění.

- Rozšíření modelu na externí enginy (bezpečnostní autorizace OneLake pro třetí strany).

Souběžně s tím se rozšiřuje ochrana o Omezení přístupu DLP nad všemi strukturovanými daty v OneLake (SQL, KQL, datové sklady) a je zaveden DSPM pro AI pro Fabric Copiloty a datové agenty, který monitoruje interakce umělé inteligence a hledá citlivé informace a rizikové chování, s integrací s Purview Audit a eDiscovery.

Pokud jde o identitu, objevují se charakteristiky, jako například: identity spojené s položkami (například Lakehouse a Eventstream) prostřednictvím rozhraní REST API, která eliminují závislost na vlastníkovi pro určité operace, a ověřování zástupců OneDrive a SharePointu pomocí identit pracovního prostoru nebo instančních objektů služeb.

Centralizovaná správa a katalog OneLake

Zkušenosti s řízením dat jsou posíleny nový centralizovaný panel v katalogu OneLakekde si vlastníci dat mohou prohlédnout souhrnný přehled položek, které vytvořili, dostávat doporučení pro kroky v oblasti správy a řízení a mít přístup ke všem dostupným nástrojům pro zlepšení zabezpečení a dodržování předpisů.

Kromě toho, a API pro vyhledávání v katalogu OneLake spolu s nástrojem MCP, který umožňuje objevovat položky v celém prostředí Fabric z kódu nebo agentů AI v jediném volání s respektováním oprávnění katalogu a metadat.

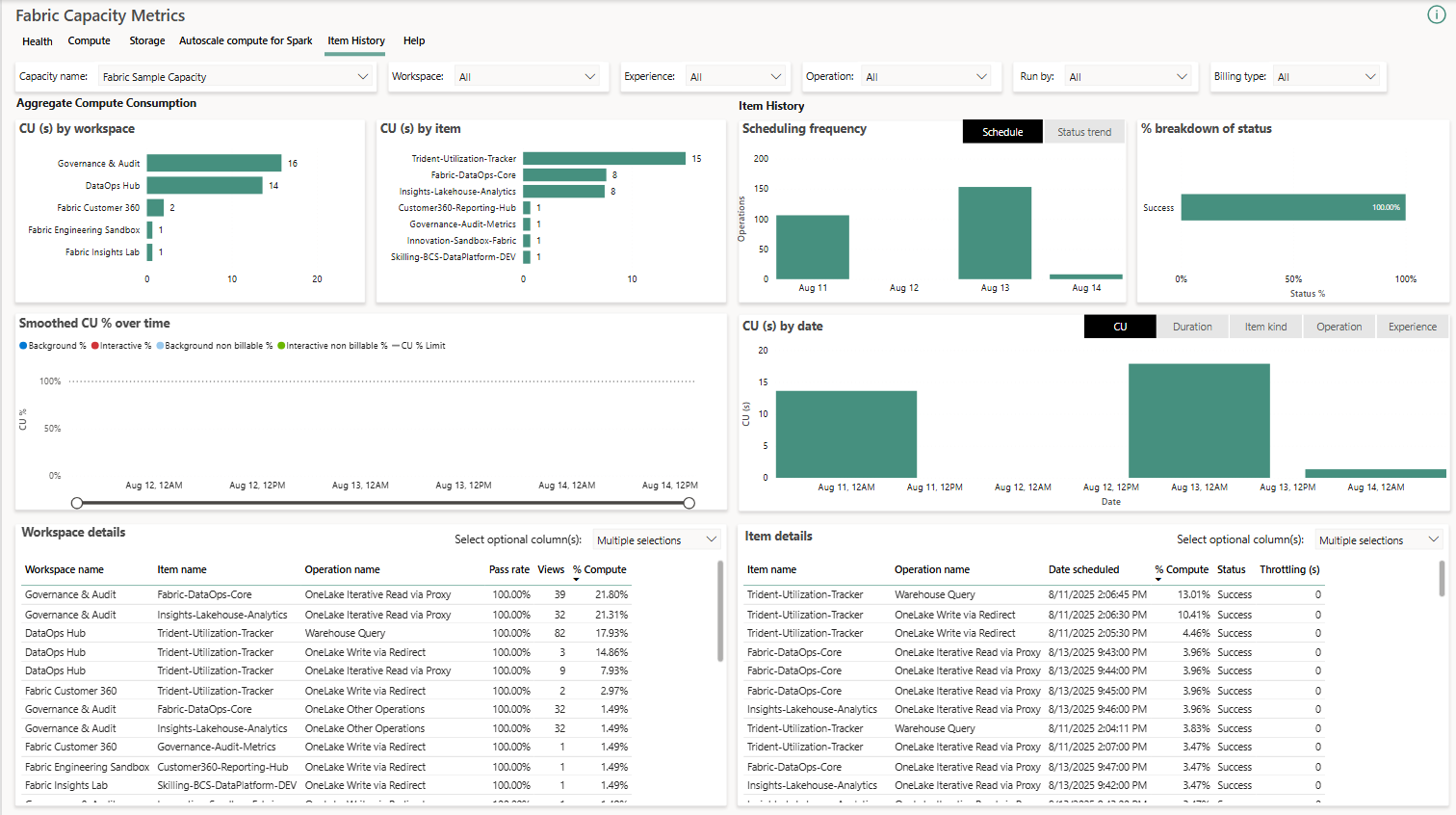

Monitorování kapacit, spotřeby a práce

Látka poskytuje několik vrstev pozorovatelnosti:

- Monitorování pracovního prostoru, která v platformě Fabric vytváří databázi, kde jsou konsolidovány protokoly a metriky z více položek (včetně úloh kopírování s podrobným monitorováním).

- Monitorování pracovního prostoru pro úlohu kopírovánís metrikami, jako je propustnost, objem dat, chybové kódy a časy, to vše zaměřené na centralizovanou analýzu.

- Historie položek při aplikaci metrik kapacity, s 30denními zobrazeními spotřeby CU pro každou položku, filtrovatelnými podle pracovního prostoru a typu.

- Přepěťová ochrana na úrovni pracovního prostorucož umožňuje nastavit prahové hodnoty spotřeby pro každý pracovní prostor v 24hodinovém posuvném okně, automaticky blokovat ty, které je překračují, a označit pracovní prostory jako „kriticky důležité“, aby se vyloučily z omezení.

Doplňuje to počáteční sada Rozhraní API pro správu fabric zaměřené na objevování pracovních prostorů, položek a podrobností o přístupu uživatelů, usnadňování dynamických inventur a pravidelných kontrol přístupu.

Obchodní modelování, plánování a nové úlohy

Kromě technické vrstvy společnost Microsoft zavádí nové pracovní zátěže zaměřené na podnikání o platformě Fabric. Jedním z nejvýznamnějších je Fabric IQ, který se snaží sjednotit obchodní sémantiku, data a modely pro inteligentní agenty, kteří se rozhodují na základě holistického pohledu na organizaci.

V rámci Fabric IQ se zobrazí následující:

- Ontologie (náhled), což je typ položky, kde jsou entity, vztahy, vlastnosti a omezení definovány podle obchodního jazyka společnosti.

- Plán (náhled), platforma bez kódování pro plánování, reporting, analytiku, integraci a kolaborativní správu.

Objevuje se také inteligence v reálném čase tvůrce digitálních dvojčat, položka specializovaná na modelování digitálních dvojčat na základě dat v reálném čase s cílem optimalizovat fyzické operace, monitorovat stavy a simulovat scénáře.

Na druhou stranu je představen Pracovní zátěž Fabric IQ jako samostatná pracovní úloha a podpůrné nástroje pro správu a sémantické zarovnání se nadále rozšiřují, čímž se uzavírá kruh mezi datovými modely, obchodní logikou a aplikacemi umělé inteligence/analytiky.

Vylepšení výkonu, uživatelského prostředí a produktivity

Na závěr tohoto přezkumu je třeba zdůraznit řadu průřezových vylepšení, která Ne vždy se dostanou na titulní stránky novin, ale výrazně ovlivňují každodenní život. týmů.

V sekci Spark a distribuované výpočty představuje Fabric:

- Fabric Runtime 2.0 (náhled) s Apache Spark 4.0, Delta Lake 4.0, Javou 21, Scalou 2.13 a Pythonem 3.12 na Azure Linuxu 3.0.

- Nástroj pro porovnání aplikací Sparkcož umožňuje paralelně vybrat a porovnat až čtyři spuštění Sparku.

- Diagnostický emitor jisker, který shromažďuje protokoly, metriky a události z aplikací Spark a odesílá je do cílových míst, jako jsou centra událostí, úložiště nebo Log Analytics.

- Diagnostická knihovna JobInsight, knihovna pro analýzu dokončených spuštění Sparku prostřednictvím API (dotazy, úlohy, fáze, úkoly, vykonavatele, protokoly událostí).

Ve vrstvě skladu se přidávají následující položky: shlukování dat Pro zlepšení výkonu a snížení nákladů na přístup jsou k dispozici sloupce IDENTITY pro náhradní klíče a podpora správy verzí a CI/CD prostřednictvím projektů databáze SQL ve VS Code (správa zdrojového kódu ve skladu).

Uživatelská zkušenost portálu Fabric se také vyvíjí s Prohlížení v záložkách a průzkumník objektůTo vám umožňuje otevírat více položek najednou a rychle mezi nimi přepínat. V kombinaci s vylepšeními, jako je automatické vázání Lakehouse v Gitu a sada nástrojů pro údržbu Lakehouse (údržbové aktivity a aktualizace koncových bodů SQL), to přispívá k uživatelsky přívětivější a agilnější platformě.

Konečně, funkce jako například Hromadný import/export definic položek (pro migrace, šablony a zálohy metadat), REST pro složky, podpora parametrů při aktivaci položek z Activatoru a načítání dat OneLake v Excelu s integrovaným katalogem doplňují ekosystém, který začíná pokrývat prakticky všechny obvyklé potřeby moderního datového týmu.

Díky celé této sadě funkcí – od centralizované správy, granulárního zabezpečení a inteligentní orchestrace až po umělou inteligenci zabudovanou v SQL, analýzu v reálném čase, digitální dvojčata a agenty MCP – si Microsoft Fabric upevňuje pozici kompletní datové platformy, kde… Klíčem už není jen ukládání a vizualizace dat, ale řízení, automatizace a využívání umělé inteligence k řízení každé fáze životního cyklu dat.což umožňuje organizacím postupně vyvíjet své architektury, migrovat to, co již mají, a umožňovat nová řešení mnohem rychleji než v tradičních přístupech.

Obsah

- Microsoft Fabric a framework pro zavedení cloudu: správa, náklady a automatizace

- Klíčové aktualizace v oblasti analytiky, umělé inteligence a správy pro Microsoft Fabric

- Funkce umělé inteligence v datovém skladu a multimodální funkce

- OneLake, Delta, Apache Iceberg a multiplatformní přístup

- SQL Database on Fabric: výkon, zabezpečení a virtualizace

- Real-time Intelligence, Eventhouse, Eventstream a Activator

- Funkce Copilota a umělé inteligence napříč platformou

- Datoví agenti Fabric, MCP a nástroje pro vývojáře

- Datová továrna, migrace dat a orchestrace ve Fabricu

- Zabezpečení, pokročilá správa a monitorování v platformě Fabric

- Obchodní modelování, plánování a nové úlohy

- Vylepšení výkonu, uživatelského prostředí a produktivity