- ChatGPT macht trotz seines "intelligenten" Anscheins strukturelle Fehler in Schlussfolgerungen, Daten und gesundem Menschenverstand.

- Die Fehler resultieren aus der statistischen Trainingsmethode, Datenverzerrungen und einem mangelnden wirklichen Verständnis.

- Viele Berufe und Bildungsaufgaben werden sich verändern, aber KI wird in erster Linie als Assistent und nicht als vollständiger Ersatz fungieren.

- Durch die Verwendung von ChatGPT mit Quellenverifizierung, guten Eingabeaufforderungen und menschlicher Überprüfung können Sie die Vorteile nutzen, ohne übermäßige Risiken einzugehen.

Generative künstliche Intelligenz hat sich in unseren Alltag eingeschlichen, ChatGPT hat sich zum wichtigsten Werkzeug für das Schreiben, Zusammenfassen, Planen und Finden von Ideen entwickelt.So beeindruckend es auch erscheinen mag, perfekt ist es bei Weitem nicht. Blindlings seinen Antworten zu vertrauen, kann zu mehr als einer unangenehmen Überraschung führen, wenn man sich mit dem Thema nicht gut auskennt. wo es hinkt.

Deshalb bestehen immer mehr Experten darauf, dass Zu verstehen, bei welchen Aufgaben ChatGPT versagt, ist fast genauso wichtig wie zu wissen, wie man es benutzt.Es geht nicht darum, die Technologie zu verteufeln, sondern darum, mit ihren Grenzen leben zu lernen: wann sie zuverlässig ist, wann man ihre Antworten mit Vorsicht genießen sollte und wie man sie einsetzt, ohne das menschliche kritische Urteilsvermögen zu verlieren.

Warum es so wichtig ist, die Grenzen von ChatGPT zu kennen

Hinter der Chat-Oberfläche verbirgt sich ein komplexes System, das Es kombiniert große Sprachmodelle mit internen Mechanismen, die je nach Fragestellung entweder Geschwindigkeit oder logisches Denken priorisieren.Diese automatische „Entscheidung“ entspricht nicht immer den Bedürfnissen des Nutzers: Manchmal hat eine schnelle Reaktion Vorrang, selbst wenn das Problem ein schrittweises Vorgehen erfordert. Sie können genauer untersuchen, wie die Parameter der künstlichen Intelligenz dieses Verhalten beeinflussen.

Darüber hinaus ändert sich das Verhalten des Modells mit jedem Update, was es ChatGPT kann auf dieselbe Anfrage zu verschiedenen Zeiten unterschiedlich reagieren.Hinzu kommen Kontextbeschränkungen in längeren Konversationen, bei denen Teile des Gesprächsverlaufs „vergessen“ werden, sowie Sicherheitsfilter, die aus übertriebener Vorsicht sensible oder völlig legitime Themen blockieren.

Dieses Zusammenspiel von Faktoren bedeutet in der Praxis, Das Nutzererlebnis kann innerhalb von Sekunden von brillant zu frustrierend umschlagen.Der Unterschied zwischen einem nützlichen und einem katastrophalen Ergebnis liegt in der Regel darin, ob der Benutzer erkennen kann, wann die KI vom Kurs abweicht und wie er sie umlenken kann.

Mehrere aktuelle Studien und Umfragen zeigen, dass Ein erheblicher Teil der Nutzer vertraut den Antworten von ChatGPT nicht vollständig.In einer OCU-Umfrage gaben viele Menschen „fehlendes Vertrauen“ in die generierten Informationen als Hauptgrund dafür an, dass sie es nicht täglich nutzen, obwohl sie es ausprobiert hatten.

Folglich empfehlen Spezialisten für künstliche Intelligenz und Bildung Nutzen Sie ChatGPT als zusätzliche Informationsquelle und niemals als alleinige Wahrheitsinstanz.Die Validierung von Daten anhand anderer Quellen, das Vorhandensein eines Mindestwissens über das Thema und die Annahme, dass Informationen gefälscht werden können (die berühmten „Halluzinationen“), sind heutzutage unerlässlich.

Häufige Fehler und technische Einschränkungen von ChatGPT

Die Fachliteratur hat dokumentiert, dass Diese Systeme liefern tendenziell plausible, aber falsche Antworten.Insbesondere wenn die Frage mehrdeutig oder sehr spezifisch ist oder von den während der Schulung behandelten Daten abweicht. Das Problem besteht darin, dass die Formulierung so überzeugend ist, dass der Fehler schwer zu erkennen ist, wenn der Nutzer mit dem Thema nicht vertraut ist. Tools wie Erweiterungen zur Erkennung KI-generierter Inhalte Sie können helfen, einige dieser Halluzinationen zu identifizieren.

Experten wie Professor Josep Curto betonen, dass Einige der häufigsten Fehler sind gravierend und beeinträchtigen die Gesamtzuverlässigkeit des Systems.Dazu nennt er fehlerhafte Beschreibungen überprüfbarer Fakten, unvollständige Antworten, erfundene Erklärungen des „Denkprozesses“ des Modells und ein weniger genaues Verhalten in anderen Sprachen als Englisch.

Darüber hinaus werden zwar Verbesserungen eingeführt, Ethische und sicherheitsrelevante Beschränkungen sind nicht immer gut abgestimmt.Manchmal blockieren sie legitime Anfragen, während sie andere problematische Anfragen zulassen, oder sie liefern Antworten, die mit Verzerrungen behaftet sind, die aus den Trainingsdaten stammen, seien sie kultureller, politischer oder geschlechtsspezifischer Natur.

Dennoch hat die laufende Forschung im Bereich des Deep Learning und der Verarbeitung natürlicher Sprache dazu geführt, dass Die neuesten Versionen, wie beispielsweise GPT-4, erreichen bei komplexen Aufgaben eine nahezu menschliche Leistung. Mathematik, Programmierung, Jura, Medizin oder Psychologie. Doch hohe Leistung bedeutet nicht Unfehlbarkeit, und blinde Flecken gibt es weiterhin.

7 Aufgaben, bei denen ChatGPT versagt (oder unzuverlässig ist)

Obwohl ChatGPT in vielen Situationen sehr nützlich sein kann, gibt es bestimmte Aufgabentypen, bei denen Die Wahrscheinlichkeit, eine falsche, voreingenommene oder irreführende Antwort zu erhalten, steigt erheblich.Es ist wichtig, mit diesen Szenarien vertraut zu sein, um äußerste Vorsicht walten zu lassen.

1. Logisches Denken und komplexe Mathematik

Wenn das Problem erfordert Verkettete Berechnungen, logische Beweise oder formale mathematische BeweiseChatGPT macht häufig Fehler. Es kann bei einfachen Operationen Fehler machen, wichtige Schritte auslassen oder falsche Ergebnisse als korrekt darstellen.

Dies ist besonders auffällig bei Übungen mit vielen Zwischenschritten, Kombinatorik, Wahrscheinlichkeitsrechnung, fortgeschrittene Algebra oder GeometrieAuch wenn der Text gut argumentiert erscheinen mag, führen kleine Fehler in einem Schritt dazu, dass das gesamte Ergebnis verfälscht wird, und das Modell hat keine Möglichkeit, seine eigene Argumentation wirklich zu "überprüfen".

2. Gesunder Menschenverstand, Intuition und menschlicher Kontext

Die KI interpretiert das Gesagte wörtlich, daher Ihm fällt es schwer, Ironie, Doppeldeutigkeiten, Sarkasmus oder stark lokal geprägte kulturelle Bezüge zu verstehen.Dies führt zu Reaktionen, die für einen Menschen eindeutig „unangemessen“ sind.

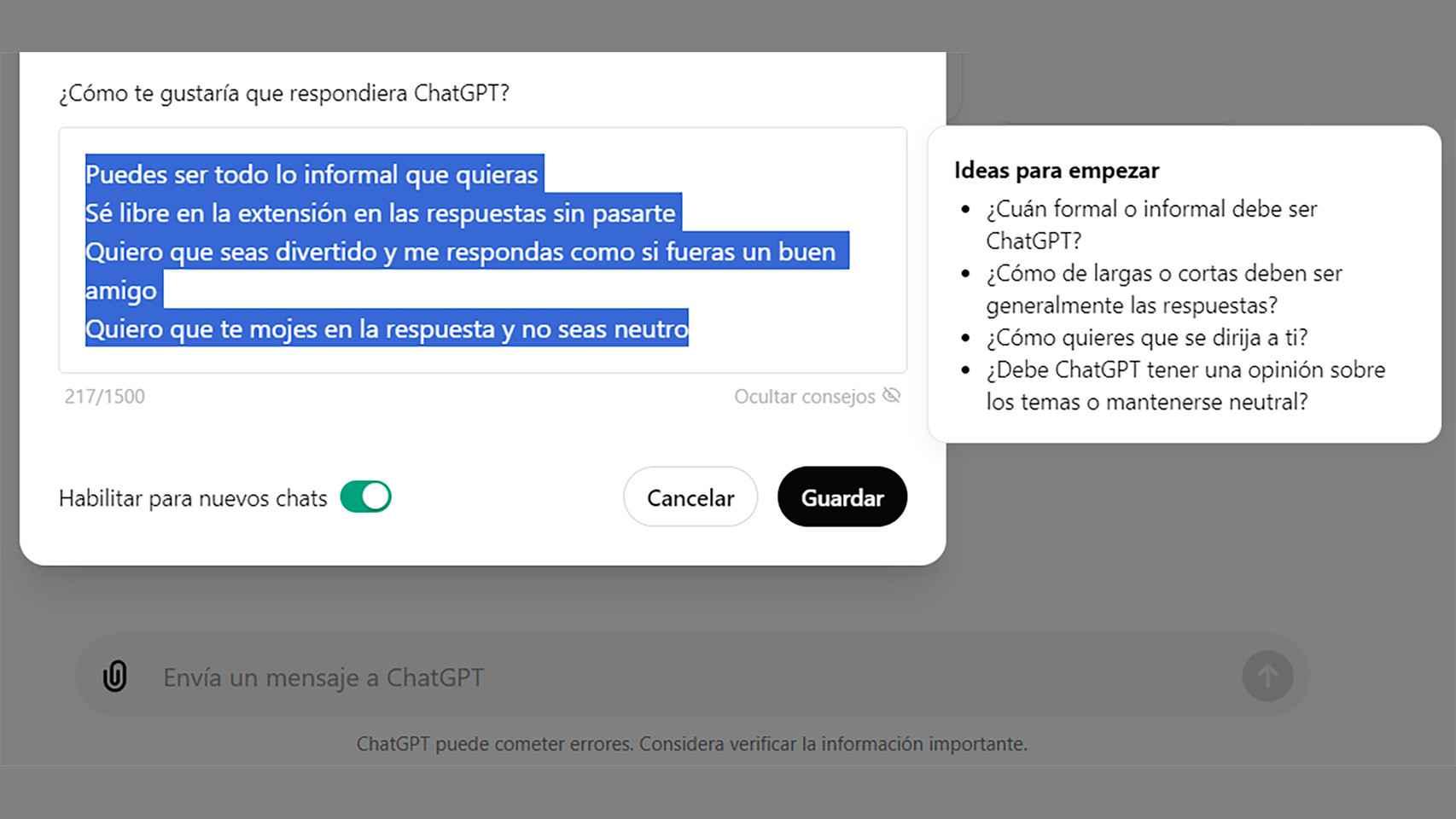

Wenn die Aufgabe es erfordert echte Empathie, tiefes emotionales Verständnis oder praktische Kenntnisse der realen WeltDas Modell imitiert lediglich Sprachmuster, jedoch ohne persönliche Erfahrungen. Es mag einfühlsam klingen, empfindet aber nichts und nimmt Situationen wie ein Mensch wahr. Um den Tonfall zu verbessern und die Reaktionen anzupassen, ist Folgendes ratsam: ChatGPT anpassen und Stile und Rollen anpassen.

3. Langzeitgedächtnis und Projektkontinuität

Auch wenn es den Anschein hat, als ob er sich an das Gespräch „erinnert“, ChatGPT verfügt nur über begrenzten Kontext und kann Teile des Verlaufs ohne Vorwarnung verlieren.Sehr lange Gespräche oder Projekte, die sich in die Länge ziehen, leiden letztendlich unter Gedächtnislücken.

Dies wirkt sich direkt aus Aufgaben wie das Schreiben von Büchern, umfangreichen Berichten oder mehrteiligen ProgrammierprojektenWenn Inhalte nicht extern gespeichert und verwaltet werden, besteht die Gefahr, dass die Konsistenz verloren geht, bereits getroffene Entscheidungen wiederholt werden oder man sich selbst widerspricht, ohne dass das Modell davon Kenntnis hat.

4. Vermeintliche Zeitersparnis, die Sie am Ende mehr kostet

Viele Menschen wenden sich an ChatGPT, um einen schnelleren Service zu erhalten, aber Wenn Antworten subtile Fehler enthalten oder wichtige Informationen fehlen, kann die Überprüfung und Korrektur länger dauern als ein komplett neues Verständnis.Dies zeigt sich besonders deutlich bei professionellen Aufgaben, die einen hohen Qualitätsstandard erfordern.

In Gebieten wie technische Berichte, juristische Dokumentation, akademische Inhalte oder ProduktionscodeDer zusätzliche Zeitaufwand für die Überprüfung kann den vermeintlichen Nutzen des Einsatzes von KI völlig zunichtemachen, wenn kein strenger Überprüfungsprozess stattfindet.

5. Veraltete Daten und fehlende Echtzeitverbindung

Modelle wie GPT-3 oder GPT-4 werden anhand eines zeitlich über einen längeren Zeitraum verteilten Datensatzes trainiert, daher Sie haben keinen direkten Zugang zum Internet, um Echtzeitinformationen abzurufen.Je nach Version kann Ihr Wissen bei einem bestimmten Jahr enden.

Dies impliziert, dass in Angelegenheiten von Aktuelle Ereignisse, jüngste Gesetzesänderungen, wissenschaftliche Entwicklungen oder EilmeldungenDie Antworten könnten veraltet oder schlichtweg falsch sein. Wenn der Benutzer sie nicht anhand aktualisierter Quellen überprüft, bleibt der Fehler unbemerkt.

6. Variable Leistung und Sättigung

In Zeiten hoher Nachfrage, insbesondere nach kostenlosen Konten, Die Qualität und Geschwindigkeit der Reaktionen können beeinträchtigt werden.Das Modell antwortet möglicherweise weniger detailliert, bricht Antworten vorzeitig ab oder liefert oberflächlichere Lösungen.

Diese Variabilität bedeutet, dass Es ist nicht immer ein zuverlässiger Ersatz für kritische Aufgaben mit engen Fristen.Sich während der Spitzenzeiten vollständig auf den Dienst zu verlassen, ohne einen Ausweichplan zu haben, kann für Unternehmen und Freiberufler zu einem Betriebsrisiko werden.

7. Einschränkungen, Filter und Verzerrungen

Aus Sicherheitsgründen beinhaltet ChatGPT Filter zum Schutz vor schädlichen, illegalen oder äußerst sensiblen InhaltenDas Problem ist, dass diese Moderationssysteme nicht perfekt sind und manchmal legitime Anfragen blockieren oder aus übertriebener Vorsicht vage antworten.

Dennoch haben mehrere Forscher gezeigt, dass Die Modelle können weiterhin Antworten mit rassistischen, sexistischen oder ideologischen Vorurteilen generieren.Dies spiegelt die in den Trainingsdaten vorhandenen Verzerrungen wider. Es sind Fälle dokumentiert, in denen mit ähnlichen Techniken trainierte Bots diskriminierende Inhalte produzierten. ethische Bewertung von Chatbots Es hilft, diese Verzerrungen zu verstehen und abzuschwächen.

Grundlegende Fehler: Warum ChatGPT so viele Fehler macht

Bei der Analyse dieser Fehlschläge weisen Philosophen des Geistes und KI-Experten auf strukturelle Beschränkungen hin: ChatGPT denkt nicht, versteht nicht und ist sich auch nicht bewusst, was es sagt.Ihre scheinbare Intelligenz beruht auf groß angelegten statistischen Korrelationen, nicht auf echtem logischem Denken.

Professor Ned Block hat beispielsweise auf Experimente mit generativen Bildmodellen hingewiesen, in denen Sie werden aufgefordert, eine Uhr zu zeichnen, die Uhrzeiten wie 12:03 oder 6:28 anzeigt, und fast immer erscheint eine Uhr bei 10:10.Diese Tageszeit dominiert in Online-Werbefotos, weil sie ästhetisch ansprechend ist und das Logo nicht verdeckt.

Dieses Verhalten veranschaulicht, wie Modelle neigen dazu, die häufigsten Muster in ihren Trainingsdaten zu reproduzieren, selbst wenn diese der spezifischen Anweisung widersprechen.Sie verstehen den Begriff der Zeit nicht: Sie wiederholen lediglich die statistisch häufigste Einstellung.

Etwas Ähnliches geschieht, wenn ein Bild angefordert wird. eine Person, die mit der linken Hand schreibtViele Modelle erzeugen systematisch rechtshändige Charaktere, da die meisten Beispiele in den Daten ebenfalls rechtshändig sind. Um einen gut repräsentierten linkshändigen Charakter zu erhalten, ist die ständige Verwendung sehr spezifischer Eingabeaufforderungen erforderlich, und selbst dann funktioniert es nicht immer.

Diese Art von Strukturversagen verursacht Selbst Entwickler können einige tief verwurzelte Vorurteile nicht vollständig korrigieren.Verstärkungstraining mit menschlichem Feedback ist hilfreich, aber die manuelle Verstärkung aller möglichen Fälle (alle Uhrzeiten, alle Schreibhaltungen usw.) ist nicht durchführbar.

Auf textueller Ebene lässt sich das Problem wie folgt übersetzen: übermäßig selbstsichere Erklärungen von Dingen, die das Modell tatsächlich nicht "weiß".Er kann Schritt für Schritt eine vermeintliche Methode detailliert beschreiben, die er selbst nie angewendet hat, oder akademische Referenzen und Links erfinden, und das mit absolut überzeugender Wirkung.

Wie ChatGPT trainiert hat und warum das seine Fehler beeinflusst

Modelle wie GPT-3 und GPT-4 basieren auf der Transformer-Architektur, und Sie wurden mit riesigen Textmengen aus dem Internet trainiert.: Webseiten, Bücher, wissenschaftliche Artikel, Nachrichten und andere öffentliche Ressourcen wie Wikipedia oder Common Crawl.

Der Prozess umfasst zwei Hauptphasen. Zuerst ein massives Vortraining, bei dem das Modell lernt, das nächste Wort in Millionen von Sätzen vorherzusagen.In dieser Phase wird keine explizite „Grammatik“ gelehrt, sondern Muster werden durch das Ausfüllen von Lücken im Text abgeleitet, eine Art riesige Wortergänzungsübung.

Anschließend erfolgt eine Feinabstimmung für spezifische Aufgaben, wie zum Beispiel Übersetzung, Zusammenfassung, Beantwortung von Fragen oder GesprächsdialogHier kommen kleinere, spezifischere Datenpunkte ins Spiel, die so beschriftet werden, dass das Modell lernt, welche Art von Reaktion in jedem Kontext als angemessen gilt.

Im Fall von ChatGPT wurde es ebenfalls verwendet. Reinforcement Learning mit menschlichem Feedback (RLHF)Menschliche Trainer bewerteten mehrere mögliche Reaktionen des Modells auf dieselbe Eingabe und ordneten sie nach ihrer Qualität. Mithilfe dieser Informationen lernte das System, die am besten bewerteten Ausgaben zu bevorzugen.

Dieser Ansatz verbessert zwar die wahrgenommene Qualität der Antworten, beseitigt aber nicht das zugrundeliegende Problem: Dem Modell mangelt es noch an semantischem Verständnis und direktem Zugang zur Realität.Es erhöht lediglich Ihre Chancen, hilfsbereiter, höflicher und selbstbewusster zu klingen, was die Halluzinationen manchmal noch gefährlicher macht.

Darüber hinaus werden zwar Datenbereinigungs-, Regularisierungs- und menschliche Bewertungstechniken angewendet auf Vorurteile und Stereotypen in Schulungstexten reduzierenEine vollständige Filterung ist unmöglich. Deshalb empfehlen Unternehmen, die Ausgabe kontinuierlich zu überwachen, insbesondere bei sensiblen Anwendungen.

Auswirkungen von ChatGPT auf das Studium und die Arbeitswelt

Seit seinem Start hat ChatGPT die Debatte über Wie wird generative KI die menschliche Arbeitswelt und das Bildungssystem beeinflussen?Große Technologieunternehmen stellen es als „Co-Piloten“ oder Assistenten dar, doch viele Studien weisen auf tiefgreifende Veränderungen in zahlreichen Berufen hin.

Forschungen von Universitäten wie der New York University und der University of Pennsylvania sowie Analysen von OpenAI und anderen Institutionen zeigen, dass sprachbasierte Aufgaben (Schreiben, Übersetzen, Textanalyse, Dokumentation, einfache Buchhaltung) Sie sind besonders anfällig für Teilautomatisierung.

Auf dem Arbeitsmarkt wurden sie als besonders gefährdet identifiziert. Telemarketing-Mitarbeiter im Vertrieb, Universitätsprofessoren für Sprachen und Literatur, Geschichts- oder Rechtslehrer, Übersetzer, Verwaltungsangestellte und bestimmte SchreibprofileDas heißt nicht, dass sie alle verschwinden werden, aber es bedeutet, dass ein großer Teil ihrer Funktionen in hohem Maße auf KI zurückgreifen kann.

Andere Studien belegen eindeutig positive Effekte. Beispielsweise in Tests mit Softwareentwicklern Diejenigen, die auf ähnlichen Modellen basierende Programmierassistenten nutzten, erledigten Aufgaben bis zu 55 % schneller. als diejenigen, die ohne Hilfe arbeiteten. Die Produktivität bei Routineaufgaben steigt, wodurch mehr Zeit für komplexere Probleme zur Verfügung steht.

Im Bildungsbereich wird die Debatte besonders hitzig geführt. Es gibt Erfahrungen, die zeigen, dass Es wird zunehmend schwieriger zu erkennen, ob ein kurzer Aufsatz von einem Schüler oder von ChatGPT verfasst wurde.Selbst erfahrenen Lehrern und professionellen Autoren gelang es in einigen Experimenten nicht, den wahren Autor zu identifizieren.

Als Reaktion darauf beginnen viele Pädagogen, höhere Standards zu setzen. mehr mündliche Beurteilungen, Unterrichtsarbeit und Aktivitäten, die den Denkprozess des Schülers veranschaulichennicht nur das Endprodukt. Andere schlagen vor, ChatGPT als Lehrmittel zu nutzen: einen Ausgangspunkt, den der Student kritisieren, korrigieren, mit realen Quellen vergleichen und verbessern muss.

Bewährte Methoden zur Nutzung von ChatGPT, ohne in dessen Fallen zu tappen

Trotz all dieser Probleme ist ChatGPT äußerst nützlich, wenn es die richtige Rolle erhält. Der Schlüssel liegt darin, eine gute Prompt-Gestaltung mit strenger menschlicher Kontrolle der generierten Ergebnisse verbindeninsbesondere wenn akademische, rechtliche oder berufliche Implikationen bestehen.

Eine erste grundlegende Empfehlung lautet: Überprüfen Sie stets Fakten, Zahlen, Quellenangaben und Eigennamen. Bevor Sie sie verwenden, genügt es nicht, dass es sich "gut anhört": Sie müssen es anhand zuverlässiger Quellen überprüfen (wissenschaftliche Artikel, offizielle Gesetze, Nachschlagewerke, spezialisierte Datenbanken usw.).

Es ist auch bequem Treffen Sie keine kritischen Entscheidungen auf der Grundlage einer einzelnen Modellantwort.Wenn es um eine wichtige Angelegenheit geht, ist es ratsam, verschiedene Meinungen zu vergleichen (andere Tools, menschliche Experten, Dokumentation) und den Chat nur als Unterstützung oder zur Erstellung von Entwürfen zu nutzen.

Die Gestaltung der Anleitung hat einen enormen Einfluss: Klare, präzise und gut strukturierte Aufgabenstellungen reduzieren Mehrdeutigkeiten und führen tendenziell zu nützlicheren Ergebnissen.Wenn man sie bittet, ihre Argumentation Schritt für Schritt zu erläutern, Gegenbeispiele anzuführen oder auf mögliche Einschränkungen hinzuweisen, kann dies helfen, Fehler aufzudecken.

Schließlich die Verwendung von ChatGPT als Generator von Vorlagen, Gliederungen, Entwürfen und Ideenlisten, an denen die Person dann weiterarbeitet.Anstatt den endgültigen Text einfach zu akzeptieren, spart dies Zeit bei den eher mechanischen Aspekten, aber der endgültige Inhalt wird dennoch von einem Menschen überarbeitet und freigegeben.

Die Erfahrungen der letzten Jahre zeigen, dass Generative künstliche Intelligenz funktioniert am besten, wenn wir sie als einen leistungsstarken, aber fehlbaren Assistenten behandeln.Mit kritischem Denken, gutem Urteilsvermögen bei der Aufgabenwahl und einem seriösen Überprüfungssystem wird es zu einem wertvollen Verbündeten statt zu einem stillen Risiko.

Inhaltsverzeichnis

- Warum es so wichtig ist, die Grenzen von ChatGPT zu kennen

- Häufige Fehler und technische Einschränkungen von ChatGPT

- 7 Aufgaben, bei denen ChatGPT versagt (oder unzuverlässig ist)

- 1. Logisches Denken und komplexe Mathematik

- 2. Gesunder Menschenverstand, Intuition und menschlicher Kontext

- 3. Langzeitgedächtnis und Projektkontinuität

- 4. Vermeintliche Zeitersparnis, die Sie am Ende mehr kostet

- 5. Veraltete Daten und fehlende Echtzeitverbindung

- 6. Variable Leistung und Sättigung

- 7. Einschränkungen, Filter und Verzerrungen

- Grundlegende Fehler: Warum ChatGPT so viele Fehler macht

- Wie ChatGPT trainiert hat und warum das seine Fehler beeinflusst

- Auswirkungen von ChatGPT auf das Studium und die Arbeitswelt

- Bewährte Methoden zur Nutzung von ChatGPT, ohne in dessen Fallen zu tappen