- Microsoft Fabric zentralisiert Daten, Governance, KI und Echtzeitanalysen auf OneLake und bietet einheitliche Funktionen.

- Die Plattform stärkt Governance, Sicherheit und Kosten durch Purview, OneLake Security, DLP, DSPM und die Integration mit Azure Cost Management.

- Data Factory, Dataflow Gen2 und Migrationstools erleichtern das Verschieben bestehender Workloads und die Orchestrierung komplexer Pipelines.

- Copilot, Datenagenten, MCP und neue Workloads wie Fabric IQ und Real-Time Intelligence treiben fortschrittliche KI- und Automatisierungsszenarien voran.

Wenn Sie schon länger mit Daten im Microsoft-Ökosystem arbeiten, ist Ihnen sicherlich aufgefallen, dass Microsoft Fabric hat sich zum zentralen Knotenpunkt moderner Analytik entwickelt.Die Zusammenführung aller bisher auf Power BI, Azure Synapse, Data Factory und andere Dienste verteilten Funktionen auf einer einzigen Plattform. In diesem Artikel beleuchten wir detailliert die neuesten Funktionen, die Roadmap und die praktischen Auswirkungen von Fabric für Analytik, Governance, KI und Echtzeitverarbeitung.

Die Idee ist, dass Sie nach dem Lesen ein klares Verständnis davon haben werden. Was bietet Microsoft Fabric heute, wohin entwickelt es sich und wie wirkt es sich auf die Datenarchitektur aus? Ihrer Organisation: Governance-Funktionen mit Purview, Automatisierung mit APIs und Git, neue KI-Funktionen, Echtzeitinformationen, Sicherheit in OneLake, Migrationen, Leistung und vieles mehr.

Microsoft Fabric und das Cloud-Adoptionsframework: Governance, Kosten und Automatisierung

Im Rahmen des Cloud Adoption Framework (CAF) hat Microsoft eine Reihe von Leitfäden veröffentlicht, um die Ausrichtung zu erleichtern. Microsoft Fabric-Design mit den Designsäulen von LandezonenDer letzte Teil dieser Reihe behandelt drei Schlüsselbereiche: Governance, Kapazitätsoptimierung und Automatisierung/DevOps.

Im Bereich Governance Die Kosten für die Fabric-Kapazität werden über Azure Cost Management offengelegt.Dies ermöglicht die native Integration von Nutzungsdaten für F-Kapazitäten (und andere SKUs) in Azure-Kosten-Dashboards, Warnungen und Ausgabenanalysen. Es geht nicht nur um die Rechnungsansicht: Sie können diese Informationen mit Tags, Abonnements oder Ressourcengruppen verknüpfen, um zu verstehen, wer wie viel ausgibt und warum.

Die technische Architektur und das Geschäftsmodell von Fabric ermöglichen es Kunden die Kapazitätsnutzung präzise steuern, um die Betriebskosten zu optimierenIn der Praxis bedeutet dies mehrere Hebel:

- Skalierung der Fähigkeiten F: Erhöhung oder Verringerung der Kapazität basierend auf vorhersehbaren Spitzenlasten, wie z. B. Verkaufsaktionen, Buchhaltungsfristen oder großen Datenmengen.

- Pause- und FortsetzungsfunktionenFabric-Administratoren können eine F-Kapazität pausieren, wenn sie nicht benötigt wird (z. B. über Nacht oder an Wochenenden in nicht kritischen Umgebungen), um die Rechenkosten zu senken.

- ÜberspannungsschutzZwei Kapazitätsparameter steuern, wie Hintergrundprozesse verwaltet werden, um eine Überlastung der Umgebung zu verhindern: Schwellenwert für die Ablehnung von Hintergrundprozessen und Schwellenwert für die Wiederherstellung von Hintergrundprozessen.

- KapazitätsreservierungenEs ist möglich, Kapazitäten für bestimmte Zeiträume zu reservieren, um Rabatte zu erhalten, vorausgesetzt, der erwartete Verbrauch wird genau geplant.

Im Bereich der Daten-Governance setzt Fabric auf Microsoft Purview als zentrale Komponente für Katalogisierung, Abstammung und KlassifizierungMit Purview können Sensitivitätskennzeichnungen angewendet, die Herkunft zwischen Ursprüngen, Transformationen und Nutzung nachvollzogen, Datenbestände zertifiziert oder Datenqualitätskampagnen optimiert werden, und all dies unter Einbeziehung der Elemente von Fabric (Lakehouse, Warehouse, KQL, Power BI usw.).

Der Abschnitt „Plattformautomatisierung und DevOps“ ist im Wesentlichen wie folgt strukturiert: Integration mit Git, Deployment-Pipelines und REST-APIsFabric-Arbeitsbereiche können mit Git-Repositories verknüpft werden, sodass mehrere Entwickler an demselben Datenverarbeitungs-, Datenwissenschafts- oder Echtzeitanalyseprojekt zusammenarbeiten können, ohne dass es zu Überschneidungen kommt.

Git und Deployment-Pipelines ermöglichen Entwicklungs-, Test- und Produktionslebenszyklen kontrolliert orchestrierenInhaltsverbreitung, Änderungsnachverfolgung, Artefaktsynchronisierung und Versionsverwaltung. Seit März 2025 unterstützen diese Pipelines (im allgemeinen oder Vorschau-Status) eine Vielzahl von Elementtypen wie Trigger, Dashboards, Datenflüsse, Datenpipelines, Datamarts, Lakehouses, Data Warehouses, KQL, Notebooks, paginierte Berichte, Organisationsanwendungen usw.

Unterdessen enthüllt Fabric ein sehr breites Spektrum an REST-APIs womit sich nahezu jede administrative Aufgabe oder Bereitstellungsaufgabe automatisieren lässt: Erstellung von Arbeitsbereichen und Ordnern, Massenmigration von Elementen, Verwaltung von Verbindungen und Gateways, Extraktion von Definitionen, Aktivierung von Pipelines oder Notebooks, unter anderem.

Wichtige Neuerungen in den Bereichen Analytik, KI und Governance für Microsoft Fabric

Die Weiterentwicklung von Fabric zeichnet sich durch eine Vielzahl von Vorschaufunktionen und neuen Möglichkeiten aus, Sie berühren praktisch alle Bereiche der Plattform.Anschließend werden sie gruppiert und strukturiert besprochen, sodass der gesamte Umfang sichtbar wird.

KI-Funktionen im Data Warehouse und multimodale Funktionen

Im Bereich relationaler Daten integriert Fabric Data Warehouse KI-Funktionen direkt in T-SQL (Vorschau). Dies ermöglicht:

- Texte klassifizieren oder kategorisieren.

- Stimmungsanalyse.

- Strukturierte Informationen aus Freitext extrahieren.

- Texte zwischen Sprachen übersetzen.

- Korrekte Grammatik.

Das Ziel ist das Es ist nicht notwendig, den SQL-Kontext zu verlassen, um Daten mit KI anzureichern.Diese Funktionen werden mit einer allgemeineren multimodalen Unterstützung in den KI-Funktionen von Fabric kombiniert, die nun Bilder (JPG/JPEG, PNG, GIF, WebP), PDFs und gängige Textformate sowie Eingaben in Form von Dateipfaden verarbeiten können.

Versorgungsunternehmen wie aifunc.load zum Einlesen von Ordnern in Tabellen Mit den Optionen `prompt` und `schema` ermöglicht `aifunc.list_file_paths` das Durchlaufen von Dateipfaden, und `ai.infer_schema` leitet Schemas ab, die mit `ai.extract` kompatibel sind. All dies ermöglicht es Ihnen, Daten zu transformieren und anzureichern, ohne komplexe Pipelines von Grund auf neu erstellen zu müssen.

OneLake, Delta, Apache Iceberg und plattformübergreifender Zugriff

Auf der Speicherebene bleibt OneLake der einheitliche Speichersee, in dem sich die gesamte Fabric-Architektur befindet. Eine der wichtigsten Verbesserungen ist die Möglichkeit, Delta-Lake-Tabellen als Apache-Iceberg-Tabellen entlarven ohne Daten zu verschieben oder zu duplizieren, sodass Iceberg-kompatible Engines direkt auf die Daten auf OneLake zugreifen können.

Darüber hinaus unterstützt OneLake nun Apache Iceberg-Daten, die direkt von Snowflake geschrieben und in Fabric über kopierfreien Zugriff genutzt werdenDiese Strategie stärkt die Interoperabilität: Fabric will kein Datensilo sein, sondern ein Daten-"Hub", den andere Engines nutzen können, ohne den Speicher zu duplizieren.

In ähnlicher Weise räumt OneLake ein: Verknüpfungen zu Azure Blob StorageOneDrive und SharePoint werden integriert und die Sicherheit wird durch Zugriffsrollen, Ordner-, Zeilen- und Spaltensicherheit sowie ein Sicherheitsmodell erweitert, das dank der Erweiterung des Autorisierungs-Engine-Modells auch von Drittanbietern respektiert werden kann.

Ein besonders relevanter Punkt ist die Föderation des OneLake-Katalogs in Azure Databricks, die Folgendes ermöglicht: Zero-Copy-Zugriff vom Unity-Katalog auf OneLake-TabellenAuf diese Weise bleibt OneLake die zentrale Datenquelle, aber Databricks kann die Daten direkt abfragen und synchronisiert nur die Metadaten.

SQL-Datenbank auf Fabric: Leistung, Sicherheit und Virtualisierung

Die SQL-Datenbank von Fabric gewinnt an eigenen Funktionen: ALTER DATABASE SET optionsUnterstützung für Sortierung und Volltextindizierung in der Vorschau. Auf der Ebene von Datenbankleistung Und hinsichtlich der Kosten gibt es mehrere Verbesserungen:

- Automatische Indexverdichtung um Speicherplatz und E/A zu reduzieren und die Abfragezeiten zu verbessern, ohne Wartungsarbeiten einplanen zu müssen.

- Maximales vCore-Limit zur Kontrolle der Nutzung von Rechenressourcen (4 oder 32 vCores), die entwickelt wurden, um zu verhindern, dass eine Arbeitslast zu viel der gemeinsam genutzten Kapazität beansprucht.

- Benutzerdefinierte SQL-Pools die Workspace-Administratoren eine detaillierte Kontrolle über die Ressourcenzuweisung und das Abfrage-Routing nach Anwendungsnamen ermöglichen.

Es ist auch aktiviert Datenvirtualisierung in SQL-Datenbanken, wodurch externe Daten, die in OneLake gespeichert sind, mit T-SQL abgefragt und Dateien in gängigen Formaten mit lokalen relationalen Tabellen mittels Joins verknüpft werden können, ohne dass die Daten physisch importiert werden müssen.

In puncto Sicherheit unterstützt die SQL-Datenbank Privater Link auf Mandantenebene (Vorschau)Dadurch wird es einfacher, den Datenverkehr auf private und kontrollierte Weise zu kanalisieren und ihn in die gesamte sichere Netzwerkkonfiguration von Fabric zu integrieren.

Echtzeit-Intelligenz, Eventhouse, Eventstream und Activator

Das Echtzeit-Intelligenzmodul (RTI) hat sich zu einem der wichtigsten Alleinstellungsmerkmale von Fabric entwickelt. Eventhouse und Eventstream arbeiten zusammen, um Echtzeitereignisse erfassen, verarbeiten und auslösen aus allen möglichen Quellen, und Activator orchestriert die Aktionen, die unter bestimmten Bedingungen ausgelöst werden.

Zu den leistungsstärksten neuen Funktionen gehören:

- Anomalieerkennung ohne Code mit automatischer Modellauswahl, einfacher Benutzeroberfläche und flexiblen Benachrichtigungen.

- Geschäftsereignisse, die wichtige Geschäftsmomente erfassen, die aus Benutzerdatenfunktionen und Notebooks generiert werden, und es Ihnen ermöglichen, Warnungen, benutzerdefinierte Logik, Abläufe, KI-Modelle oder Spark-Jobs zu aktivieren.

- Integration der Activator-Benutzerdatenfunktionensodass in Fabric erstellte Funktionen Ereignisse aus beliebigen Quellen verarbeiten können, einschließlich interner Ereignisse der Plattform selbst und von OneLake.

- Fähigkeit zur Verarbeitung von Ereignissen mit SQL (SQL-Operator in Eventstream)Dadurch wird die Transformation von Echtzeit-Datenflüssen mit bekannter SQL-Syntax ermöglicht.

Relevante Konnektoren werden hinzugefügt, wie zum Beispiel Kribl (für die Protokoll- und Telemetrieerfassung aus mehreren Quellen), ein Konnektor mit Solace PubSub+ und Streaming-Unterstützung über private Netzwerke via Azure Virtual Network, VPN, ExpressRoute oder private Endpunkte.

Für Datenschemata und Verträge führt Eventstream ein Schemaregistrierung die Ereignisschemata für robustere Pipelines definiert und validiert sowie die Confluent Schema Registry unterstützt, um eine Verbindung mit Kafka in Confluent Cloud herzustellen und gleichzeitig bestehende Verträge zu berücksichtigen.

Copilot- und KI-Funktionen auf der gesamten Plattform

Copilot in Fabric ist jetzt weltweit verfügbar und hat eine Präsenz in Power BI, Data Factory, Data Science & Data Engineering und das Schreiben von KQL-AbfragenDarüber hinaus wurden spezifische Funktionen integriert:

- Copilot für Dataflow Gen2 (Modern Get Data), was dabei hilft, Daten mithilfe von Anweisungen in natürlicher Sprache aufzunehmen und zu transformieren.

- Copilot für Data Warehouse (Chat), über eine Schaltfläche im Menüband zugänglich, um Lagerprozesse durch Dialoge zu beschleunigen.

- Copilot für SQL-Analyse-Endpunkt, das SQL-Abfragen aus Geschäftsbeschreibungen generiert und optimiert.

- Copilot auf Notebooks Kenntnisse des Workspace-Kontexts, Lakehouse, der Notebook-Struktur und der Ausführungsumgebung ermöglichen es, mehrstufigen Code zu generieren, Refactoring durchzuführen, komplexe Notebooks zusammenzufassen und Fehler mithilfe der Option „Fix with Copilot“ zu diagnostizieren.

- Inline-Autovervollständigung (Inline-Codevervollständigung) und Notebook Copilot Inline-Codevervollständigung (Vorschau), um schneller und mit weniger Fehlern Python zu schreiben.

Darüber hinaus wird die KI-Technologiebasis erweitert mit vorkonfigurierte Foundry Tools integriert (Azure OpenAI, Azure Language, Azure Translator), OpenAI-Plugins für Eventhouse (ai_embed_text und ai_chat_completion) sowie eine Reihe von Agenten und Datenagenten, die es anderen Anwendungen, einschließlich Copilot Studio, ermöglichen, Fabric-Daten orchestriert zu verarbeiten.

Fabric Data Agents, MCP und Entwicklertools

Stoffvorstellung Datenagenten, die den Zugriff auf Daten und Tools orchestrieren können. Für KI-Agenten mit einem Python SDK und direkter Integration in Microsoft Copilot Studio. Dies vereinfacht die Entwicklung von Dialogassistenten, die mit in Fabric verwalteten Unternehmensdaten arbeiten.

Parallel dazu die Model Context Protocol (MCP) Es wird zu einer Schlüsselkomponente der Integration zwischen KI-Agenten und Fabric-Diensten. Es gibt dedizierte MCP-Server für Activator und Eventhouse sowie einen entwicklungsorientierten Fabric MCP, der Folgendes ermöglicht:

- Es ermöglicht KI-Assistenten, Code und Inhalte für Fabric-Artikel zu generieren.

- Es integriert sich in Entwicklungswerkzeuge wie VS Code und GitHub Codespaces.

- Es stellt Werkzeuge für die Abfrage und Nutzung von Echtzeitdaten in Eventhouse vor.

Für die tägliche Arbeit des Entwicklers sind mehrere wichtige Punkte hervorzuheben, darunter die Entwicklungsumgebung: MSSQL-Erweiterung für VS Code mit Unterstützung für die Fabric SQL-Datenbank, der Microsoft ADO.NET-Treiber und ODBC-Treiber für Fabric Data Engineering (Verbindung zu Spark SQL über Livy) und ein Spark-Connector für SQL-Datenbanken, der den authentifizierten Zugriff von Spark auf SQL-Datenbanken in Azure und Fabric vereinfacht.

Außerdem erscheint die Fabric CLI, verfügbar als integrierte Aufgabe in Azure DevOps, die es Ihnen ermöglicht, die Verwaltung von Arbeitsbereichen, Elementen und Bereitstellungen zu automatisieren, ohne externe Tools manuell installieren zu müssen.

Data Factory, Datenmigrationen und Orchestrierung in Fabric

Die Datenintegrationsschicht von Fabric basiert auf Data Factory und Dataflow Gen2, die Funktionen empfangen, um... Die Orchestrierung wird intelligenter, besser automatisierbar und die Migrationen werden einfacher. von bestehenden Plattformen.

Dataflow Gen2: Leistung, öffentliche APIs und Diagnose

In Dataflow Gen2 finden wir mehrere Funktionen in der Vorschau:

- Erweiterte Bearbeitung von Zielabfragen Die Logik am Zielort direkt aus der Autorenumgebung heraus anzupassen.

- Partitionierte BerechnungDadurch können Teile des Datenflusses parallel ausgeführt werden, wodurch sich die gesamte Auswertungszeit verkürzt.

- Diagnose herunterladen auf der Ausführungsebene, mit strukturierten Protokollpaketen für die Leistungsanalyse und die Störungsbehebung.

- Öffentliche APIs zur programmatischen Erstellung, Aktualisierung, Löschung, Planung und Überwachung von Datenflüssen.

- Öffentliche Parameter mit CI/CD-Unterstützungdie es ermöglichen, Datenflüsse durch die Übergabe von Werten aus Pipelines oder anderen Quellen zu aktualisieren.

- Aktuelle Daten für den schnellen Zugriff auf zuletzt verwendete Elemente im Power Query-Menüband und in Modern Get Data.

All dies wird ergänzt durch die Fähigkeiten von Power Query programmatisch über REST auswertenDies eröffnet die Möglichkeit, M-Skripte im Rahmen automatisierter Prozesse auszuführen, sie mit Spark, Pipelines oder externen Tools zu integrieren und dabei die Vorteile von Power Query-Konnektoren zu nutzen.

Data Factory: adaptive Leistung, Konnektivität und dbt

Im eher „klassischen“ Teil der Integration führt Data Factory innerhalb von Fabric Folgendes ein:

- Adaptive Leistungsoptimierung für Kopiervorgänge, die die Leistungsparameter intelligent an die Konfiguration und den Ausführungskontext anpassen.

- Unterstützung für Change Data Capture (CDC) im Kopierauftrag, um nur Änderungen (Einfügungen, Aktualisierungen, Löschungen) kontinuierlich zu replizieren.

- Lokale Gateways mit manueller Upgrade-Option Die Steuerung erfolgt über das Fabric-Portal, die API oder Skripte.

- jüngste Verbindung, wodurch Verbindungen Eigenschaften der letzten Nutzung hinzugefügt werden, um die Prüfung und das Lebenszyklusmanagement zu erleichtern.

- native dbt Job, wodurch die Durchführung von dbt-Projekten innerhalb von Fabric mit integrierter Orchestrierung, Tests, Dokumentation und Governance ermöglicht wird.

- SSIS-Paketaktivität aufrufen in Pipelines, um SSIS-Pakete direkt aus der Orchestrierung in Fabric auszuführen.

Das Benutzererlebnis wird außerdem verbessert durch SharePoint-Siteauswahl (SharePoint Site Picker), wodurch das manuelle Eintippen von URLs vermieden wird, und mit MCP-Unterstützung für Data Factory, sodass KI-Assistenten Dataflow Gen2 einfach anhand von Anweisungen in natürlicher Sprache erstellen und bereitstellen können.

Tools für Datenmigration und -replikation

Microsoft fördert die Migration zu Fabric mit Hilfe mehrerer spezifischer Tools:

- Bewertung der Fabric-Migration für Data Factory, das die Vorbereitung von ADF-Pipelines analysiert und die unterstützten Pipelines in einen Fabric-Arbeitsbereich mit Verbindungszuordnung migriert.

- Migrationsassistent für Data Warehousewelches nun direkt mit dem Quell-Data-Warehouse verbunden werden kann, um die Daten in das Fabric Data Warehouse zu verschieben.

- Migrationsassistent für SQL-Datenbanken, mit dem Ziel, lokale SQL Server-Workloads zu migrieren, mit Schema-Import über DACPAC, Inkompatibilitätserkennung und Empfehlungen.

Hinsichtlich der Replikation wird Unterstützung bereitgestellt für Spiegelung mehrerer operativer Quellen (Azure Database for MySQL, Google BigQuery, SQL Server usw.) zu Fabric, mit der Möglichkeit, zu steuern, welche Tabellen repliziert werden, Spiegelungsprozesse über REST neu zu starten und, im Falle von Databricks, Unity Catalog-Richtlinien der OneLake-Sicherheit zuzuordnen.

Ebenfalls enthalten ist ein Replikationskonnektor von Lakehouse. Delta-Änderungsdatenfeed, wodurch Änderungen an den Lakehouse Delta-Boards in Richtung kompatibler Ziele ermöglicht werden, ohne dass das Rad mit den hauseigenen Lösungen von CDC neu erfunden werden muss.

Sicherheit, fortschrittliche Governance und Überwachung in Fabric

Eine der größten Sorgen bei jeder Analyseplattform ist, wie Daten sichern, Nutzung steuern und Ressourcenverbrauch überwachenDie Stoffindustrie entwickelt sich in diesen Bereichen rasant weiter.

Sicherheit und Datenschutz bei OneLake

OneLake fügt ein vollständiges Modell hinzu Datenzugriffssicherheit mit:

- Datenzugriffsrollen für Lakehouse mit konfigurierbaren Berechtigungen über eine ordnerbasierte Sicherheitsschnittstelle.

- Sicherheitsunterstützung für Verknüpfungen, damit Dritte die definierten Richtlinien einhalten können.

- OneLake Data Access Security API, die eine automatisierte Berechtigungsverwaltung ermöglicht.

- Erweiterung des Modells auf externe Engines (OneLake-Sicherheitsautorisierung für Drittanbieter).

Parallel dazu wird der Schutz erweitert mit DLP beschränkt den Zugriff über alle strukturierten Daten in OneLake (SQL, KQL, Data Warehouses) und wird eingeführt DSPM für KI für Fabric Copiloten und Datenagenten, das KI-Interaktionen auf sensible Informationen und riskante Verhaltensweisen überwacht, mit Integration in Purview Audit und eDiscovery.

Im Hinblick auf die Identität zeigen sich unter anderem folgende Merkmale: mit Gegenständen verknüpfte Identitäten (zum Beispiel Lakehouse und Eventstream) über REST-APIs, wodurch die Abhängigkeit vom Besitzer für bestimmte Operationen entfällt, sowie die Authentifizierung von OneDrive- und SharePoint-Verknüpfungen mithilfe von Arbeitsbereichsidentitäten oder Dienstprinzipalen.

Zentralisierte Verwaltung und OneLake-Katalog

Die Erfahrung im Bereich Data Governance wird durch ein neues zentrales Bedienfeld im OneLake-Katalogwo Dateneigentümer eine aggregierte Ansicht der von ihnen erstellten Elemente einsehen, Empfehlungen für Governance-Maßnahmen erhalten und auf alle verfügbaren Tools zur Verbesserung von Sicherheit und Compliance zugreifen können.

Darüber hinaus OneLake Catalog Search API zusammen mit einem MCP-Tool, das es ermöglicht, Elemente in der gesamten Fabric-Umgebung mit einem einzigen Aufruf über Code oder KI-Agenten zu ermitteln und dabei Katalogberechtigungen und Metadaten zu berücksichtigen.

Überwachung von Kapazitäten, Verbrauch und Arbeit

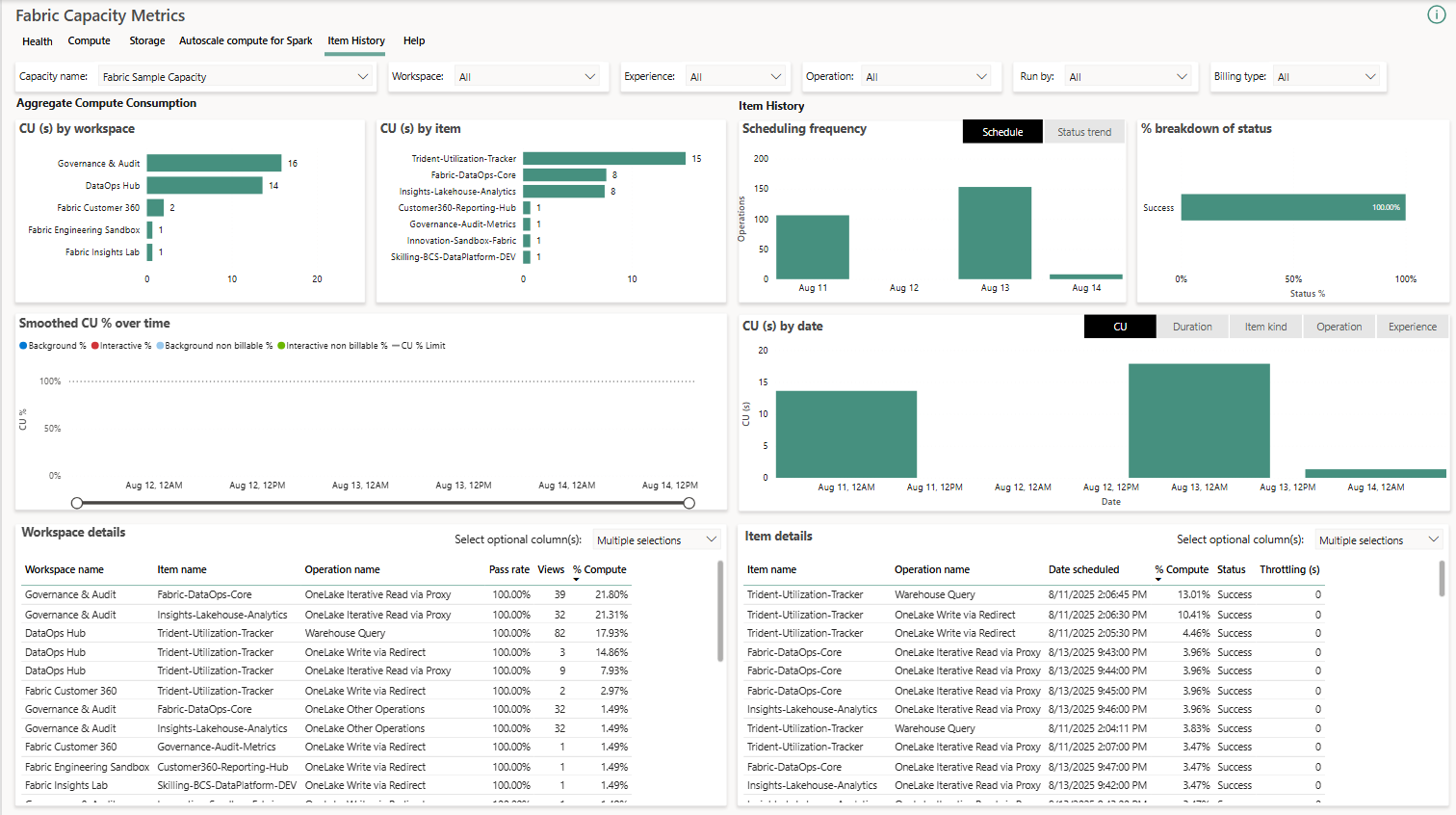

Fabric bietet mehrere Ebenen der Beobachtbarkeit:

- Arbeitsbereichsüberwachung, wodurch in Fabric eine Datenbank erstellt wird, in der Protokolle und Metriken von mehreren Elementen konsolidiert werden (einschließlich Kopieraufträgen mit detaillierter Überwachung).

- Arbeitsbereichsüberwachung für Kopierauftragmit Kennzahlen wie Durchsatz, Datenvolumen, Fehlercodes und Zeiten, die alle auf eine zentrale Analyse ausgerichtet sind.

- Artikelhistorie bei der Anwendung von Kapazitätskennzahlen, mit 30-Tage-Ansichten zum CU-Verbrauch für jeden Artikel, filterbar nach Arbeitsbereich und Typ.

- Überspannungsschutz auf ArbeitsplatzebeneDies ermöglicht das Festlegen von Verbrauchsschwellenwerten pro Arbeitsbereich in einem gleitenden 24-Stunden-Fenster, das automatische Blockieren von Arbeitsbereichen, die diese Schwellenwerte überschreiten, und das Kennzeichnen von Arbeitsbereichen als „geschäftskritisch“, um sie von Beschränkungen auszunehmen.

Ergänzend dazu ein erster Satz von Fabric Admin APIs mit Fokus auf die Ermittlung von Arbeitsbereichen, Artikeln und Benutzerzugriffsdetails, die die Erstellung dynamischer Inventarlisten und die Durchführung regelmäßiger Zugriffskontrollen ermöglichen.

Geschäftsmodellierung, Planung und neue Arbeitslasten

Über die technische Ebene hinaus führt Microsoft Folgendes ein: neue geschäftsorientierte Arbeitslasten über Fabric. Eine der bekanntesten Anwendungen ist Fabric IQ, das darauf abzielt, Geschäftssemantik, Daten und Modelle für intelligente Agenten zu vereinheitlichen, die Entscheidungen auf der Grundlage einer ganzheitlichen Sicht der Organisation treffen.

Innerhalb von Fabric IQ werden folgende Elemente angezeigt:

- Ontologie (Vorschau), ein Elementtyp, bei dem Entitäten, Beziehungen, Eigenschaften und Einschränkungen gemäß der Geschäftssprache des Unternehmens definiert werden.

- Plan (Vorschau), eine No-Code-Plattform für Planung, Reporting, Analysen, Integration und kollaboratives Management.

Echtzeitintelligenz entsteht ebenfalls. Ersteller digitaler Zwillinge, ein Gerät, das auf die Modellierung digitaler Zwillinge auf Basis von Echtzeitdaten spezialisiert ist, mit dem Ziel, physische Abläufe zu optimieren, Zustände zu überwachen und Szenarien zu simulieren.

Andererseits wird es eingeführt Fabric IQ-Arbeitslast als separate Arbeitslast und unterstützende Tools für Governance und semantische Ausrichtung werden immer weiter ausgebaut, wodurch der Kreis zwischen Datenmodellen, Geschäftslogik und KI-/Analyseanwendungen geschlossen wird.

Leistungs-, Benutzererfahrungs- und Produktivitätsverbesserungen

Zum Abschluss dieser Betrachtung lohnt es sich, einige übergreifende Verbesserungen hervorzuheben, die Sie schaffen es zwar nicht immer in die Schlagzeilen, aber sie beeinflussen das tägliche Leben maßgeblich. der Mannschaften.

Im Abschnitt „Spark und verteiltes Rechnen“ stellt Fabric Folgendes vor:

- Fabric Runtime 2.0 (Vorschau) mit Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 und Python 3.12 auf Azure Linux 3.0.

- Spark-App-VergleichstoolDies ermöglicht es Ihnen, bis zu vier Spark-Ausführungen parallel auszuwählen und zu vergleichen.

- Funkendiagnose-Emitter, das Protokolle, Metriken und Ereignisse von Spark-Anwendungen sammelt und an Ziele wie Event Hubs, Speicher oder Log Analytics sendet.

- JobInsight-Diagnosebibliothek, eine Bibliothek zur Analyse abgeschlossener Spark-Ausführungen über APIs (Abfragen, Jobs, Phasen, Aufgaben, Executors, Ereignisprotokolle).

In der Lagerschicht werden folgende Elemente hinzugefügt: Datenclustering Zur Verbesserung der Performance und Reduzierung der Zugriffskosten werden IDENTITY-Spalten für Ersatzschlüssel sowie Versionskontrolle und CI/CD-Unterstützung durch SQL-Datenbankprojekte in VS Code (Warehouse-Quellcodeverwaltung) verwendet.

Die Benutzererfahrung des Fabric-Portals entwickelt sich ebenfalls weiter mit Tabbasiertes Browsen und Objekt-ExplorerDies ermöglicht es Ihnen, mehrere Elemente gleichzeitig zu öffnen und schnell zwischen ihnen zu wechseln. In Kombination mit Verbesserungen wie der automatischen Lakehouse-Bindung in Git und den Hilfsprogrammen für die Lakehouse-Wartung (Wartungsaktivitäten und Aktualisierung von SQL-Endpunkten) trägt dies zu einer benutzerfreundlicheren und agileren Plattform bei.

Schließlich gibt es noch Funktionen wie Massenimport/-export von Artikeldefinitionen (für Migrationen, Vorlagen und Metadatensicherungen), REST für Ordner, Parameterunterstützung bei Elementaktivierungen aus Activator und OneLake-Datenladen in Excel mit integriertem Katalog vervollständigen ein Ökosystem, das praktisch alle üblichen Bedürfnisse eines modernen Datenteams abdeckt.

Mit diesem gesamten Funktionsumfang – von zentralisierter Governance, detaillierter Sicherheit und intelligenter Orchestrierung bis hin zu in SQL integrierter KI, Echtzeitanalysen, digitalen Zwillingen und MCP-Agenten – festigt Microsoft Fabric seine Position als vollständige Datenplattform, auf der Der Schlüssel liegt nicht mehr nur in der Speicherung und Visualisierung von Daten, sondern in der Steuerung, Automatisierung und Nutzung von KI zur Kontrolle jedes einzelnen Teils des Datenlebenszyklus.Dies ermöglicht es Organisationen, ihre Architekturen schrittweise weiterzuentwickeln, ihre bestehenden Systeme zu migrieren und neue Lösungen viel schneller zu realisieren als mit traditionellen Ansätzen.

Inhaltsverzeichnis

- Microsoft Fabric und das Cloud-Adoptionsframework: Governance, Kosten und Automatisierung

- Wichtige Neuerungen in den Bereichen Analytik, KI und Governance für Microsoft Fabric

- KI-Funktionen im Data Warehouse und multimodale Funktionen

- OneLake, Delta, Apache Iceberg und plattformübergreifender Zugriff

- SQL-Datenbank auf Fabric: Leistung, Sicherheit und Virtualisierung

- Echtzeit-Intelligenz, Eventhouse, Eventstream und Activator

- Copilot- und KI-Funktionen auf der gesamten Plattform

- Fabric Data Agents, MCP und Entwicklertools

- Data Factory, Datenmigrationen und Orchestrierung in Fabric

- Sicherheit, fortschrittliche Governance und Überwachung in Fabric

- Geschäftsmodellierung, Planung und neue Arbeitslasten

- Leistungs-, Benutzererfahrungs- und Produktivitätsverbesserungen