- Microsoft Fabric centralise les données, la gouvernance, l'IA et l'analyse en temps réel sur OneLake et des capacités unifiées.

- La plateforme renforce la gouvernance, la sécurité et les coûts grâce à Purview, la sécurité OneLake, la DLP, la DSPM et l'intégration avec Azure Cost Management.

- Data Factory, Dataflow Gen2 et les outils de migration facilitent le déplacement des charges de travail existantes et l'orchestration de pipelines complexes.

- Copilot, les agents de données, MCP et les nouvelles charges de travail telles que Fabric IQ et Real-Time Intelligence pilotent des scénarios d'IA et d'automatisation avancés.

Si vous travaillez avec des données dans l'écosystème Microsoft depuis un certain temps, vous aurez remarqué que Microsoft Fabric est devenu le centre névralgique de l'analyse moderne.Fabric centralise toutes les fonctionnalités auparavant dispersées entre Power BI, Azure Synapse, Data Factory et d'autres services sur une plateforme unique. Cet article présente en détail les dernières fonctionnalités, la feuille de route et les implications pratiques de Fabric pour l'analytique, la gouvernance, l'IA et le calcul en temps réel.

L'idée est que, lorsque vous aurez terminé la lecture, vous aurez une compréhension claire de Que propose Microsoft Fabric aujourd'hui, quelle est son évolution et quel est son impact sur l'architecture des données ? de votre organisation : capacités de gouvernance avec Purview, automatisation avec les API et Git, nouvelles fonctionnalités d’IA, renseignements en temps réel, sécurité dans OneLake, migrations, performances et bien plus encore.

Microsoft Fabric et le cadre d'adoption du cloud : gouvernance, coûts et automatisation

Dans le cadre du Cloud Adoption Framework (CAF), Microsoft a publié une série de guides visant à harmoniser les pratiques. Conception de Microsoft Fabric avec les piliers de conception des zones d'atterrissageLa dernière partie de cette série aborde trois domaines clés : la gouvernance, l’optimisation des capacités et l’automatisation/DevOps.

Dans la section gouvernance, Les coûts de capacité du réseau sont exposés via Azure Cost Management.Cela vous permet d'intégrer nativement les données d'utilisation de la capacité F (et d'autres références) aux tableaux de bord de coûts, aux alertes et aux analyses de dépenses Azure. Il ne s'agit pas seulement de consulter la facture : vous pouvez croiser ces informations avec des balises, des abonnements ou des groupes de ressources pour comprendre qui dépense quoi et pourquoi.

L'architecture technique et le modèle commercial de Fabric permettent aux clients contrôler précisément la consommation de capacité afin d'optimiser les coûts d'exploitationEn pratique, cela se traduit par plusieurs leviers :

- Mise à l'échelle des capacités F: augmenter ou diminuer la capacité en fonction des pics prévisibles, tels que les campagnes de vente, les échéances comptables ou les volumes importants de données.

- Fonctionnalités de pause et de repriseLes administrateurs de Fabric peuvent suspendre une capacité F lorsqu'elle n'est pas nécessaire (par exemple, la nuit ou le week-end dans des environnements non critiques) afin de réduire les coûts de calcul.

- Protection contre les surtensionsDeux paramètres de capacité contrôlent la manière dont les tâches en arrière-plan sont gérées afin d'éviter qu'elles ne saturent l'environnement : le seuil de rejet des tâches en arrière-plan et le seuil de récupération des tâches en arrière-plan.

- Réservations de capacitéIl est possible de réserver de la capacité pour des périodes définies afin d'obtenir des remises, à condition que la consommation prévue soit rigoureusement planifiée.

En matière de gouvernance des données, Fabric s'appuie sur Microsoft Purview comme composant central pour le catalogage, la traçabilité et la classificationPurview permet d'appliquer des étiquettes de sensibilité, de visualiser la lignée entre les origines, les transformations et la consommation, de certifier les actifs de données ou de dynamiser les campagnes de qualité des données, tout en intégrant les éléments de Fabric (Lakehouse, Warehouse, KQL, Power BI, etc.).

La section « Automatisation de la plateforme et DevOps » est principalement structurée autour de Intégration avec Git, les pipelines de déploiement et les API RESTLes espaces de travail Fabric peuvent être liés à des dépôts Git afin que plusieurs développeurs puissent collaborer sur le même projet d'ingénierie des données, de science des données ou d'analyse en temps réel sans chevauchement de travail.

Git et les pipelines de déploiement permettent orchestrer les cycles de vie du développement, des tests et de la production de manière contrôléePromotion de contenu, suivi des modifications, synchronisation des artefacts et gestion des versions : depuis mars 2025, ces pipelines prennent en charge (en version finale ou préliminaire) un large éventail d’éléments tels que les déclencheurs, les tableaux de bord, les flux de données, les pipelines de données, les datamarts, les lakehouses, les entrepôts de données, les requêtes KQL, les notebooks, les rapports paginés, les applications organisationnelles, etc.

Pendant ce temps, Fabric révèle un ensemble très large d'API REST avec lequel automatiser presque toutes les tâches administratives ou de déploiement : création d’espaces de travail et de dossiers, migration en masse d’éléments, gestion des connexions et des passerelles, extraction de définitions, activation de pipelines ou de notebooks, entre autres.

Principales nouveautés en matière d'analyse, d'IA et de gouvernance pour Microsoft Fabric

L'évolution de Fabric est marquée par un grand nombre de fonctionnalités en avant-première et de nouvelles capacités qui Ils abordent pratiquement tous les aspects de la plateformeElles sont ensuite regroupées et discutées de manière structurée afin que toute l'étendue du problème puisse être appréhendée.

Fonctions d'IA dans l'entrepôt de données et fonctions multimodales

Dans le domaine des données relationnelles, Fabric Data Warehouse intègre Les fonctions d'IA sont directement intégrées à T-SQL (aperçu). Ceci permet :

- Classer ou catégoriser un texte.

- Analyser les sentiments.

- Extraire des informations structurées à partir de texte libre.

- Traduire des textes entre différentes langues.

- Grammaire correcte.

L'objectif est que Il n’est pas nécessaire de sortir du contexte SQL pour enrichir les données avec l’IACes fonctions sont combinées à une prise en charge multimodale plus générale dans les fonctions d'IA de Fabric, qui peuvent désormais traiter des images (JPG/JPEG, PNG, GIF, WebP), des PDF et des formats de texte courants, ainsi que des entrées sous forme de chemins de fichiers.

Services publics tels que aifunc.load pour l'ingestion de dossiers dans des tables Grâce aux options d'invite et de schéma, `aifunc.list_file_paths` permet de parcourir les chemins de fichiers, et `ai.infer_schema` infère les schémas compatibles avec `ai.extract`. Vous pouvez ainsi transformer et enrichir vos données sans avoir à créer de pipelines complexes.

OneLake, Delta, Apache Iceberg et accès multiplateforme

Au niveau du stockage, OneLake demeure le lac unifié où réside l'ensemble de Fabric. L'une des principales améliorations est la possibilité de Exposition des tables Delta Lake en tant que tables Apache Iceberg sans déplacer ni dupliquer les données, afin que les moteurs compatibles avec Iceberg puissent lire directement ce qui se trouve sur OneLake.

De plus, OneLake prend désormais en charge Les données Apache Iceberg écrites directement par Snowflake sont consommées dans Fabric via un accès sans copie.Cette stratégie renforce l'interopérabilité : Fabric ne veut pas être un silo, mais un « hub » de données que d'autres moteurs peuvent exploiter sans dupliquer le stockage.

Dans le même ordre d'idées, OneLake admet raccourcis vers Azure Blob StorageOneDrive et SharePoint, et étend la sécurité avec des rôles d'accès, une sécurité au niveau des dossiers, des lignes et des colonnes, et un modèle de sécurité que les tiers peuvent respecter grâce à l'extension du modèle de moteur autorisé.

Un point particulièrement pertinent est la fédération du catalogue OneLake dans Azure Databricks, qui permet Accès sans copie depuis le catalogue Unity aux tables OneLakeDe cette manière, OneLake reste la source de référence, mais Databricks peut interroger directement les données, en synchronisant uniquement les métadonnées.

Base de données SQL sur Fabric : performances, sécurité et virtualisation

La base de données SQL de Fabric acquiert ses propres fonctionnalités : Options de l'ensemble ALTER DATABASEPrise en charge du classement et de l'indexation en texte intégral en prévisualisation. Au niveau de performances de la base de données Et en ce qui concerne les coûts, plusieurs améliorations ont été constatées :

- compactage automatique de l'index pour réduire le stockage et les E/S et améliorer les temps de requête sans avoir à planifier de tâches de maintenance.

- Limite maximale de vCores pour contrôler l'utilisation des ressources de calcul (4 ou 32 vCores), conçu pour empêcher une charge de travail de consommer trop de capacité partagée.

- Pools SQL personnalisés qui offrent aux administrateurs d'espace de travail un contrôle précis sur l'allocation des ressources et le routage des requêtes par nom d'application.

Il est également activé Virtualisation des données dans une base de données SQL, qui permet d'interroger des données externes stockées dans OneLake avec T-SQL, en joignant des fichiers dans des formats courants avec des tables relationnelles locales à l'aide de jointures, sans avoir à importer physiquement les données.

En matière de sécurité, la base de données SQL prend en charge Lien privé au niveau du locataire (aperçu)Cela facilite l'acheminement du trafic de données de manière privée et contrôlée, en s'intégrant à la configuration réseau sécurisée globale de Fabric.

Intelligence en temps réel, Eventhouse, Eventstream et Activateur

Le module d'intelligence en temps réel (RTI) est devenu l'un des principaux atouts de Fabric. Eventhouse et Eventstream s'associent pour ingérer, traiter et déclencher des événements en temps réel provenant de sources diverses, Activator orchestre les actions déclenchées sous certaines conditions.

Parmi les nouvelles fonctionnalités les plus puissantes, on trouve :

- Détection d'anomalies sans code avec sélection automatique du modèle, interface simple et alertes flexibles.

- Business Events, qui capturent les moments clés de l'activité générés par les fonctions de données utilisateur et les notebooks, et vous permettent d'activer des alertes, une logique personnalisée, des flux, des modèles d'IA ou des tâches Spark.

- Intégration des fonctions de données utilisateur et de l'activateurafin que les fonctions créées dans Fabric puissent traiter des événements provenant de n'importe quelle source, y compris les événements internes de la plateforme elle-même et de OneLake.

- Capacité à traiter les événements avec SQL (opérateur SQL dans Eventstream), permettant la transformation de flux en temps réel avec une syntaxe SQL connue.

Des connecteurs pertinents sont ajoutés, tels que : Crèche (pour l'ingestion des journaux et des données de télémétrie provenant de sources multiples), un connecteur avec Solace PubSub+ et une prise en charge du streaming sur les réseaux privés via Azure Virtual Network, VPN, ExpressRoute ou des points de terminaison privés.

Pour les schémas de données et les contrats, Eventstream introduit un Registre de schémas qui définit et valide les schémas d'événements pour des pipelines plus robustes, et prend en charge le registre de schémas Confluent pour se connecter à Kafka dans Confluent Cloud tout en respectant les contrats existants.

Capacités de copilote et d'IA sur l'ensemble de la plateforme

Copilot in Fabric est désormais disponible dans le monde entier, avec une présence dans Power BI, Data Factory, science des données et ingénierie des données, et écriture de requêtes KQLDe plus, des fonctionnalités spécifiques ont été intégrées :

- Copilote pour Dataflow Gen2 (Récupération de données moderne), qui permet d'ingérer et de transformer des données grâce à des instructions en langage naturel.

- Copilote pour entrepôt de données (chat), accessible via un bouton du ruban pour accélérer les tâches d'entreposage grâce à une boîte de dialogue.

- Copilote pour le point de terminaison d'analyse SQL, qui génère et optimise les requêtes SQL à partir des descriptions métier.

- Copilote sur ordinateurs portables avec une connaissance du contexte de l'espace de travail, de Lakehouse, de la structure des notebooks et de l'environnement d'exécution, capable de générer du code en plusieurs étapes, de refactoriser, de résumer des notebooks complexes et de diagnostiquer les erreurs avec l'option « Corriger avec Copilot ».

- Saisie semi-automatique en ligne (complétion de code en ligne) et saisie semi-automatique en ligne de Notebook Copilot (aperçu), pour écrire du Python plus rapidement et avec moins d'erreurs.

De plus, la base technologique de l'IA est en cours d'expansion. Outils Foundry préconfigurés intégrés (Azure OpenAI, Azure Language, Azure Translator), plugins OpenAI pour Eventhouse (ai_embed_text et ai_chat_completion) et une série d'agents et d'agents de données qui permettent à d'autres applications, notamment Copilot Studio, de travailler sur les données Fabric de manière orchestrée.

Agents de données Fabric, MCP et outils de développement

Fabric introduit agents de données capables d'orchestrer l'accès aux données et aux outils Pour les agents d'IA, grâce à un kit de développement logiciel (SDK) Python et une intégration directe avec Microsoft Copilot Studio, il est facile de créer des assistants conversationnels capables d'exploiter des données d'entreprise gérées dans Fabric.

En parallèle, le Protocole de contexte de modèle (MCP) Il devient un élément clé de l'intégration entre les agents d'IA et les services Fabric. Il existe des serveurs MCP dédiés pour Activator et Eventhouse, ainsi qu'un MCP Fabric orienté développement qui :

- Il permet aux assistants IA de générer du code et du contenu pour les articles Fabric.

- Il s'intègre aux outils de développement tels que VS Code et GitHub Codespaces.

- Il présente des outils permettant de consulter et d'exploiter les données en temps réel dans Eventhouse.

Dans le cadre du travail quotidien d'un développeur, plusieurs éléments clés sont à souligner, notamment : environnement de développement: Extension MSSQL pour VS Code avec prise en charge de la base de données Fabric SQL, le pilote Microsoft ADO.NET et le pilote ODBC pour Fabric Data Engineering (connexion à Spark SQL via Livy), ainsi qu'un connecteur Spark pour les bases de données SQL qui simplifie l'accès authentifié de Spark aux bases de données SQL dans Azure et Fabric.

Apparaît également le Interface de ligne de commande (CLI) Fabric, disponible en tant que tâche intégrée dans Azure DevOps, qui vous permet d'automatiser la gestion des espaces de travail, des éléments et des déploiements sans installer manuellement d'outils externes.

Data Factory, migrations de données et orchestration dans Fabric

La couche d'intégration de données de Fabric s'appuie sur Data Factory et Dataflow Gen2, qui reçoivent des fonctions pour... L'orchestration sera plus intelligente, plus automatisable et les migrations seront simplifiées. à partir des plateformes existantes.

Dataflow Gen2 : performances, API publiques et diagnostics

Dans Dataflow Gen2, plusieurs fonctionnalités sont disponibles en avant-première :

- Édition avancée des requêtes cibles pour ajuster la logique à destination directement depuis l'environnement de création lui-même.

- Calcul partitionnéce qui permet à certaines parties du flux de données de s'exécuter en parallèle, réduisant ainsi le temps d'évaluation total.

- Télécharger les diagnostics au niveau de l'exécution, avec des paquets de journaux structurés pour l'analyse des performances et la résolution des incidents.

- API publiques pour la création, la mise à jour, la suppression, la planification et la surveillance programmatiques des flux de données.

- Paramètres publics avec prise en charge CI/CDqui permettent d'actualiser les flux de données en transmettant des valeurs provenant de pipelines ou d'autres sources.

- Données récentes pour un accès rapide aux éléments récemment utilisés dans le ruban Power Query et dans la fonction « Obtenir des données » moderne.

Tout ceci est complété par les capacités de Évaluer Power Query par programmation via RESTCela ouvre la voie à l'exécution de scripts M dans le cadre de processus automatisés, à leur intégration avec Spark, des pipelines ou des outils externes, en tirant parti des connecteurs Power Query.

Data Factory : performances adaptatives, connectivité et dbt

Dans la partie plus « classique » de l'intégration, Data Factory au sein de Fabric introduit :

- Réglage adaptatif des performances pour les activités de copie, qui ajustent intelligemment les paramètres de performance en fonction de la configuration et du contexte d'exécution.

- Prise en charge de la capture des données modifiées (CDC) dans les tâches de copie, pour répliquer uniquement les modifications (insertions, mises à jour, suppressions) en continu.

- Passerelles sur site avec option de mise à niveau manuelle géré depuis le portail Fabric, l'API ou des scripts.

- connexion récente, qui ajoute des propriétés de dernière utilisation aux connexions afin de faciliter l'audit et la gestion du cycle de vie.

- Emploi natif dbt, qui permet d'exécuter des projets dbt au sein de Fabric avec une orchestration, des tests, une documentation et une gouvernance intégrés.

- Invoquer l'activité du package SSIS dans les pipelines, pour exécuter des packages SSIS à partir de l'orchestration elle-même dans Fabric.

L'expérience utilisateur est également améliorée grâce à un sélecteur de site SharePoint (Sélecteur de site SharePoint) qui évite de saisir les URL manuellement, et avec la prise en charge MCP pour Data Factory, afin que les assistants IA puissent créer et déployer Dataflow Gen2 simplement à partir d'instructions en langage naturel.

Outils de migration et de réplication des données

Microsoft encourage fortement la migration vers Fabric via plusieurs outils spécifiques :

- Évaluation de la migration de la structure pour Data Factory, qui analyse la préparation des pipelines ADF et migre ceux qui sont pris en charge vers un espace de travail Fabric avec mappage de connexion.

- Assistant de migration pour entrepôt de donnéesqui peut désormais se connecter directement à l'entrepôt de données source pour le transférer vers Fabric Data Warehouse.

- Assistant de migration pour base de données SQL, destiné à la migration des charges de travail SQL Server sur site, avec importation de schéma via DACPAC, détection des incompatibilités et recommandations.

En ce qui concerne la réplication, un soutien est apporté à mise en miroir de plusieurs sources opérationnelles (Azure Database pour MySQL, Google BigQuery, SQL Server, etc.) vers Fabric, avec la possibilité de contrôler quelles tables sont répliquées, de redémarrer les processus de mise en miroir via REST et, dans le cas de Databricks, de mapper les politiques Unity Catalog à la sécurité OneLake.

Un connecteur de réplication Lakehouse est également inclus. Flux de données sur les variations delta, ce qui permet de modifier les tableaux d'affichage de Lakehouse Delta pour des destinations compatibles sans avoir à réinventer la roue grâce aux solutions internes du CDC.

Sécurité, gouvernance avancée et surveillance dans Fabric

L'une des principales préoccupations concernant toute plateforme analytique est la manière dont sécuriser les données, contrôler leur utilisation et surveiller la consommation des ressourcesLe tissu évolue rapidement sur ces points.

Sécurité et protection des données chez OneLake

OneLake ajoute un modèle complet de sécurité d'accès aux données avec:

- Rôles d'accès aux données pour Lakehouse avec des autorisations configurables à partir d'une interface de sécurité basée sur les dossiers.

- Prise en charge de la sécurité pour les raccourcis afin que les tiers puissent respecter les politiques définies.

- L'API de sécurité d'accès aux données OneLake permet une gestion automatisée des autorisations.

- Extension du modèle aux moteurs externes (autorisation de sécurité OneLake pour les tiers).

En parallèle, la protection est étendue avec DLP restreint l'accès sur l'ensemble des données structurées dans OneLake (SQL, KQL, entrepôts de données) et est introduit DSPM pour l'IA pour les copilotes Fabric et les agents de données, qui surveille les interactions de l'IA pour détecter les informations sensibles et les comportements à risque, avec une intégration avec Purview Audit et eDiscovery.

En termes d'identité, des caractéristiques telles que les suivantes apparaissent : identités associées aux articles (par exemple, Lakehouse et Eventstream) via des API REST, qui éliminent la dépendance au propriétaire pour certaines opérations, et l'authentification des raccourcis OneDrive et SharePoint à l'aide d'identités d'espace de travail ou de principaux de service.

Gouvernance centralisée et catalogue OneLake

L'expérience en matière de gouvernance des données est renforcée par un nouveau panneau centralisé dans le catalogue OneLakeoù les propriétaires de données peuvent consulter une vue agrégée des éléments qu'ils ont créés, recevoir des recommandations sur les mesures de gouvernance et accéder à tous les outils disponibles pour améliorer la sécurité et la conformité.

De plus, un API de recherche du catalogue OneLake ainsi qu'un outil MCP, qui permet de découvrir des éléments dans tout l'environnement Fabric à partir de code ou d'agents IA, en un seul appel, en respectant les autorisations du catalogue et les métadonnées.

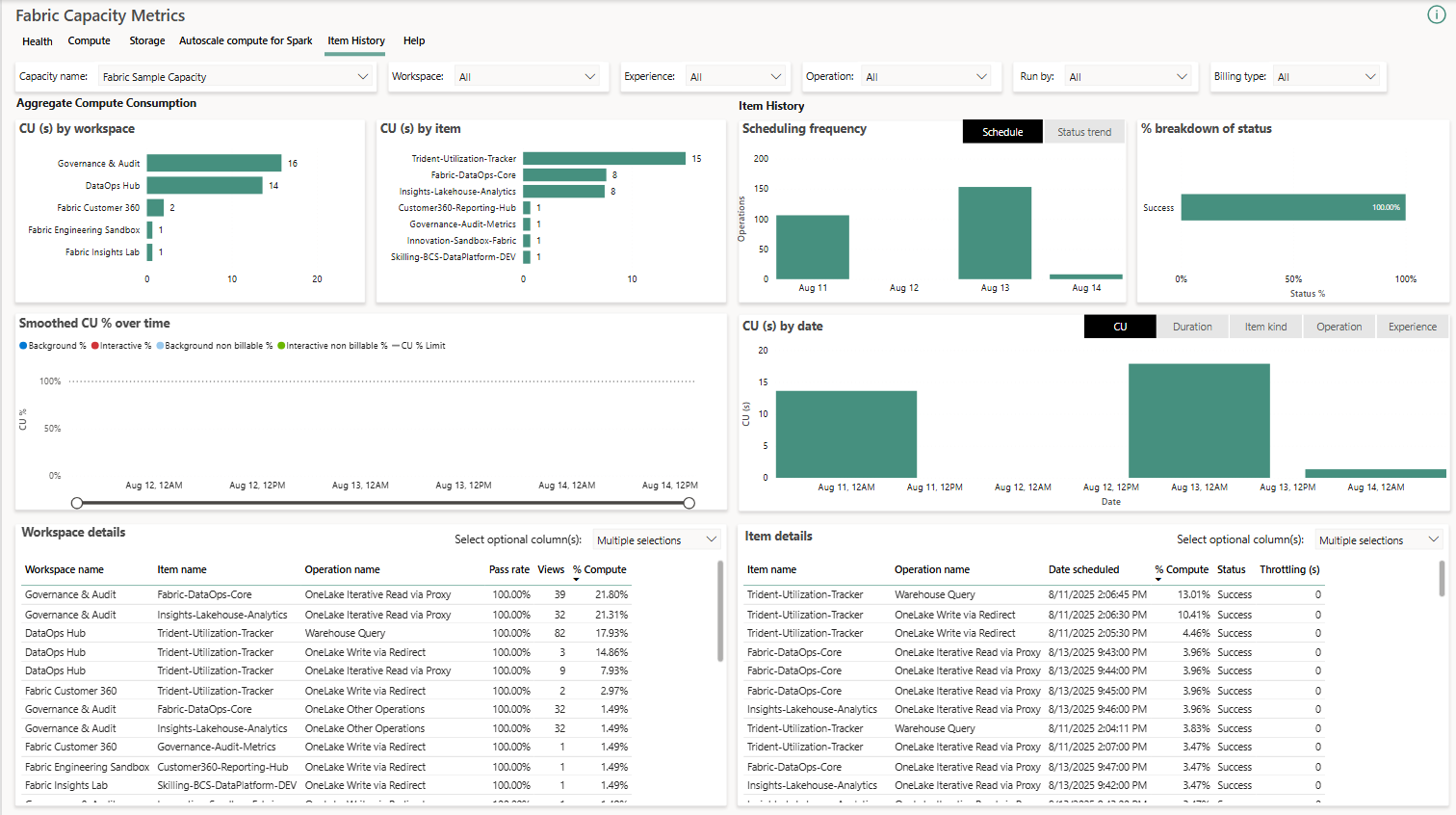

Suivi des capacités, de la consommation et du travail

Fabric offre plusieurs niveaux d'observabilité :

- Surveillance de l'espace de travail, qui crée une base de données dans Fabric où les journaux et les métriques de plusieurs éléments sont consolidés (y compris les tâches de copie avec une surveillance détaillée).

- Surveillance de l'espace de travail pour la tâche de copieavec des indicateurs tels que le débit, le volume de données, les codes d'erreur et les temps, tous orientés vers une analyse centralisée.

- Historique des articles dans l'application des indicateurs de capacité, avec des vues sur 30 jours de la consommation CU pour chaque élément, filtrables par espace de travail et par type.

- Protection contre les surtensions au niveau de l'espace de travailqui permet de définir des seuils de consommation par espace de travail sur une période glissante de 24 heures, de bloquer automatiquement ceux qui les dépassent et de marquer les espaces de travail comme « essentiels à la mission » pour les exclure des limitations.

En complément, un premier ensemble de API d'administration de Fabric axé sur la découverte des espaces de travail, des éléments et des détails d'accès des utilisateurs, facilitant les inventaires dynamiques et les contrôles d'accès périodiques.

Modélisation d'entreprise, planification et nouvelles charges de travail

Au-delà de la couche technique, Microsoft introduit nouvelles charges de travail orientées affaires À propos de Fabric. L'une des solutions les plus importantes est Fabric IQ, qui vise à unifier la sémantique métier, les données et les modèles pour des agents intelligents prenant des décisions basées sur une vision globale de l'organisation.

Dans Fabric IQ, les éléments suivants apparaissent :

- Ontologie (aperçu), un type d'élément où les entités, les relations, les propriétés et les contraintes sont définies selon le langage métier de l'entreprise.

- Plan (aperçu), une plateforme sans code pour la planification, le reporting, l'analyse, l'intégration et la gestion collaborative.

L'intelligence en temps réel émerge également. Créateur de jumeaux numériques, un élément spécialisé dans la modélisation de jumeaux numériques à partir de données en temps réel, dans le but d'optimiser les opérations physiques, de surveiller les états et de simuler des scénarios.

D'autre part, il est introduit Charge de travail Fabric IQ en tant que charge de travail distincte, et les outils de support pour la gouvernance et l'alignement sémantique continuent de se développer, bouclant ainsi la boucle entre les modèles de données, la logique métier et les applications d'IA/analytique.

Améliorations des performances, de l'expérience utilisateur et de la productivité

Pour conclure cette analyse, il convient de souligner un certain nombre d'améliorations transversales qui Elles ne font pas toujours la une des journaux, mais elles influencent grandement la vie quotidienne. des équipes.

Dans la section consacrée à Spark et au calcul distribué, Fabric présente :

- Fabric Runtime 2.0 (aperçu) avec Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 et Python 3.12 sur Azure Linux 3.0.

- Outil de comparaison d'applications Sparkqui vous permet de sélectionner et de comparer jusqu'à quatre exécutions Spark en parallèle.

- Émetteur de diagnostic Spark, qui collecte les journaux, les métriques et les événements des applications Spark et les envoie vers des destinations telles que Event Hubs, le stockage ou Log Analytics.

- Bibliothèque de diagnostics JobInsight, une bibliothèque permettant d'analyser les exécutions Spark terminées via des API (requêtes, tâches, étapes, exécuteurs, journaux d'événements).

Dans la couche entrepôt, les éléments suivants sont ajoutés : regroupement de données Pour améliorer les performances et réduire les coûts d'accès, colonnes IDENTITY pour les clés de substitution, et prise en charge du contrôle de version et de l'intégration continue/déploiement continu (CI/CD) via les projets de base de données SQL dans VS Code (contrôle de source Warehouse).

L'expérience utilisateur du portail Fabric évolue également avec Navigation par onglets et explorateur d'objetsCela vous permet d'ouvrir plusieurs éléments simultanément et de passer rapidement de l'un à l'autre. Cette fonctionnalité, combinée à des améliorations telles que la liaison automatique de Lakehouse dans Git et la suite d'utilitaires pour la maintenance de Lakehouse (activités de maintenance et actualisation des points de terminaison SQL), contribue à une plateforme plus conviviale et agile.

Enfin, des fonctionnalités telles que Importation/exportation en masse de définitions d'articles (pour les migrations, les modèles et les sauvegardes de métadonnées), REST pour les dossiers, la prise en charge des paramètres dans les activations d'éléments depuis Activator et le chargement des données OneLake dans Excel avec catalogue intégré, complètent un écosystème qui commence à couvrir pratiquement tous les besoins habituels d'une équipe de données moderne.

Grâce à cet ensemble complet de fonctionnalités — de la gouvernance centralisée à la sécurité granulaire, en passant par l'orchestration intelligente, l'IA intégrée à SQL, l'analyse en temps réel, les jumeaux numériques et les agents MCP —, Microsoft Fabric consolide sa position de plateforme de données complète. L'enjeu n'est plus seulement de stocker et de visualiser les données, mais de les gouverner, de les automatiser et d'exploiter l'IA pour contrôler chaque étape du cycle de vie des données.permettant aux organisations de faire évoluer progressivement leurs architectures, en migrant ce qu'elles possèdent déjà et en mettant en œuvre de nouvelles solutions beaucoup plus rapidement qu'avec les approches traditionnelles.

Table des matières

- Microsoft Fabric et le cadre d'adoption du cloud : gouvernance, coûts et automatisation

- Principales nouveautés en matière d'analyse, d'IA et de gouvernance pour Microsoft Fabric

- Fonctions d'IA dans l'entrepôt de données et fonctions multimodales

- OneLake, Delta, Apache Iceberg et accès multiplateforme

- Base de données SQL sur Fabric : performances, sécurité et virtualisation

- Intelligence en temps réel, Eventhouse, Eventstream et Activateur

- Capacités de copilote et d'IA sur l'ensemble de la plateforme

- Agents de données Fabric, MCP et outils de développement

- Data Factory, migrations de données et orchestration dans Fabric

- Sécurité, gouvernance avancée et surveillance dans Fabric

- Modélisation d'entreprise, planification et nouvelles charges de travail

- Améliorations des performances, de l'expérience utilisateur et de la productivité