- L'IA moderne repose sur des algorithmes d'optimisation qui automatisent les tâches, analysent de grands volumes de données et permettent de nouveaux modèles commerciaux.

- Les principaux risques comprennent les biais algorithmiques, les pertes d'emploi, les atteintes à la vie privée, la manipulation de l'information et les cyberattaques plus sophistiquées.

- L'IA générative soulève des défis spécifiques : hallucinations, deepfakes, dépendance technologique, hausse des coûts et problèmes de propriété intellectuelle et de réputation.

- Une gouvernance solide, des cadres réglementaires clairs et le recours à l'IA pour gérer les risques sont essentiels pour exploiter son potentiel sans perdre le contrôle de son impact.

La intégrer l'intelligence artificielle à tous les aspects de notre vie Cela se produit beaucoup plus vite que la plupart des organisations et des individus ne l'auraient imaginé. Des premiers algorithmes de recommandation, nous sommes passés en un temps record à des modèles génératifs capables de rédiger des rapports, d'analyser des contrats, de créer des images hyperréalistes et de prendre des décisions automatisées dans les processus métier critiques.

Cette expansion accélérée ouvre un vaste champ de possibilités, mais aussi Elle comporte des risques, des dilemmes éthiques et des défis réglementaires. Ce sont des enjeux qu'il est impossible d'ignorer. Il ne s'agit pas de choisir entre une vision apocalyptique et un techno-optimisme naïf, mais de comprendre sereinement ce que l'IA actuelle fait réellement, ce qu'elle ne fait pas, où elle apporte le plus de valeur ajoutée et où elle peut devenir un problème majeur si elle n'est pas gérée avec sagesse.

Que comprenons-nous aujourd'hui par intelligence artificielle ?

Quand on parle d'IA dans la vie de tous les jours, on fait en réalité référence à un ensemble de algorithmes d'optimisation et modèles statistiques entraînés sur de grands volumes de donnéesCe ne sont pas des machines conscientes ou des « cerveaux » qui pensent comme une personne, mais des systèmes qui apprennent des schémas et génèrent des résultats utiles (ou plausibles) pour des tâches très spécifiques.

Dans le monde des affaires, l'IA est devenue populaire parce que Il permet d'automatiser les tâches routinières, d'analyser d'énormes bases de données et d'aider à la prise de décision. Avec une précision et une rapidité qu'une équipe humaine ne pourrait atteindre. Du diagnostic médical assisté à la détection précoce des fraudes financières, les cas d'utilisation se multiplient dans tous les secteurs.

Il est toutefois important de faire la distinction entre les soi-disant Intelligence artificielle restreinte (celui qui résout des problèmes spécifiques : classification d’images, traduction de textes, recommandation de contenu…) et l’hypothétique Intelligence artificielle généralequi ambitionnerait de raisonner sur n'importe quelle tâche comme un être humain. Actuellement, nous utilisons à grande échelle des systèmes limités, aussi impressionnants que puissent paraître des modèles comme ChatGPT, Bard ou DALL-E.

Ces modèles, notamment les modèles de langage, sont conçus pour calculer la réponse la plus probable et socialement acceptable Face à une donnée d'entrée, ils ne cherchent pas à comprendre le monde ni à poursuivre leurs propres objectifs. Ils imitent le raisonnement, mais sous-tendent des calculs statistiques sophistiqués, et non la conscience ou l'intention.

Comment fonctionne l'IA : techniques clés

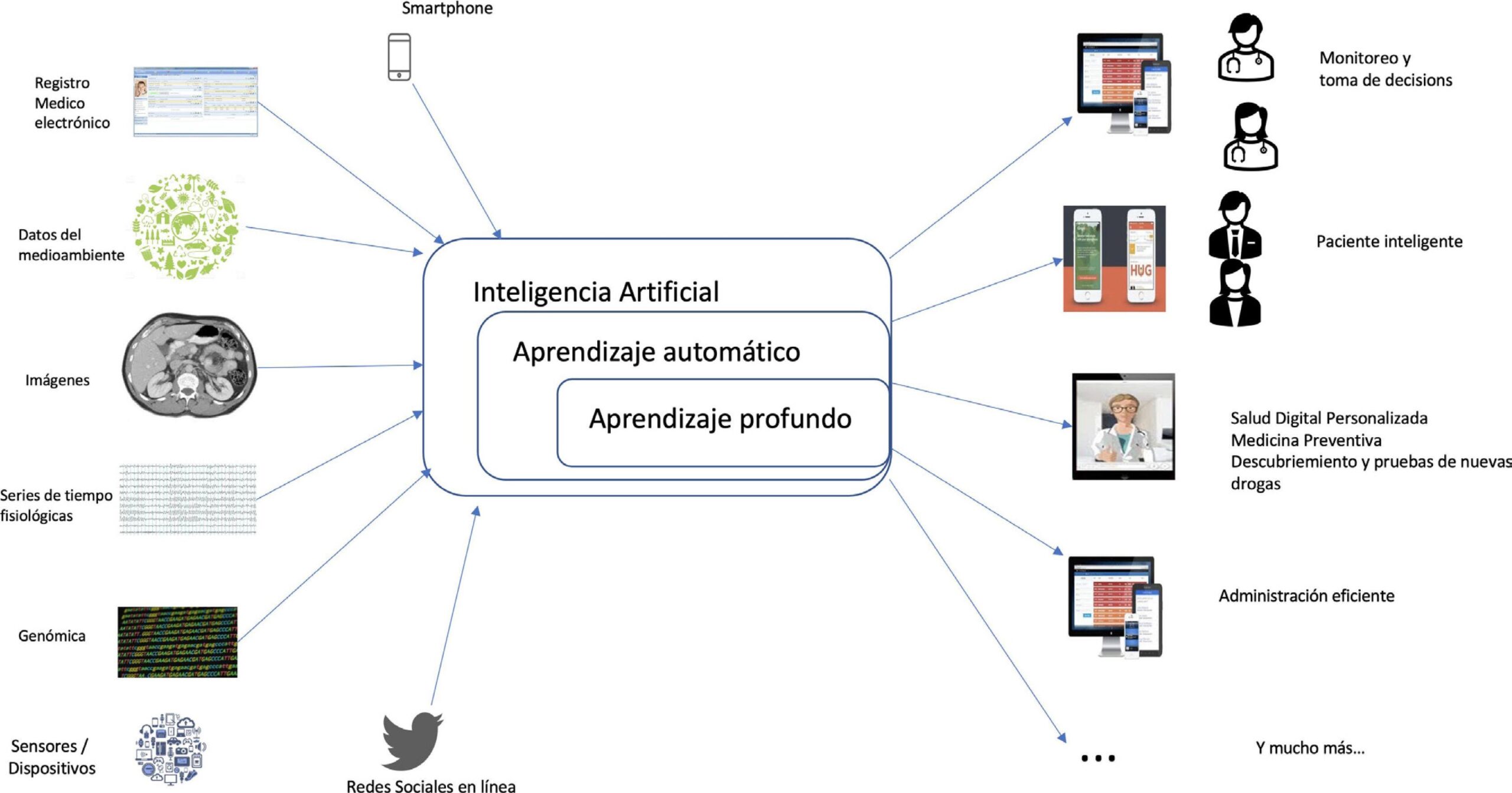

La plupart des applications d'IA modernes reposent sur trois grands éléments technologiques : apprentissage automatique, apprentissage profond et traitement du langage naturelÀ cela s'ajoute la vision par ordinateur pour tout ce qui concerne les images et la vidéo.

apprentissage automatique ou apprentissage automatique

L'apprentissage automatique (ML) est la branche qui se concentre sur concevoir des algorithmes capables d'apprendre à partir des donnéessans qu'il soit nécessaire de programmer explicitement chaque règle. Le système détecte des schémas et, sur cette base, effectue des prédictions, des classifications ou des recommandations.

Dans l'apprentissage supervisé, les modèles sont entraînés avec données étiquetées indiquant la réponse correcte (par exemple, déterminer si une transaction était frauduleuse ou non). En revanche, dans l'apprentissage non supervisé, l'algorithme détecte des structures et des groupes cachés dans des données non étiquetées, ce qui est très utile pour segmenter les clients, détecter les anomalies ou regrouper les comportements.

Un exemple typique dans le secteur est l'utilisation du ML pour analyser les données en temps réel provenant des capteurs d'usine (température, vibrations, cycles d'utilisation) et anticiper les pannes de machines, permettant ainsi une maintenance prédictive.

Apprentissage profond

L'apprentissage profond est un sous-ensemble de l'apprentissage automatique qui utilise réseaux neuronaux artificiels multicouches Ces réseaux permettent d'apprendre des représentations de données de plus en plus complexes. Ils s'inspirent de la structure du cerveau, bien que leur fonctionnement réel diffère considérablement de celui du cerveau biologique.

Grâce à l'apprentissage profond, des applications comme reconnaissance vocale, vision par ordinateur avancée, systèmes de recommandation ou conduite autonomeGrâce à l'accès à d'énormes ensembles de données et à une puissance de calcul considérable, ces réseaux peuvent détecter des relations très subtiles qui étaient auparavant impossibles à modéliser.

Dans des secteurs comme l'automobile, par exemple, l'apprentissage profond est utilisé pour interprétation des images de caméras et des données radar et lidar d'un véhicule autonome, estimer les distances, prédire les trajectoires et décider des manœuvres de manière quasi instantanée.

Traitement du langage naturel

Le traitement automatique du langage naturel (TALN) vise à permettre aux systèmes de comprendre, analyser et générer le langage humainCela inclut le traitement de texte et la communication orale. Des tâches telles que le classement de documents, la synthèse de textes, la traduction, la réponse à des questions ou la tenue de conversations sont également concernées.

Les grands modèles de langage (LLM) actuels sont capables de détecter les structures syntaxiques et les nuances sémantiques dans de vastes quantités de texteCela leur permet de produire des réponses étonnamment naturelles. Elles sont utilisées dans les chatbots, les assistants virtuels, l'analyse des sentiments, le service client et le support interne en entreprise.

vision par ordinateur

La vision industrielle se concentre sur l'activation des machines interpréter des images et des vidéos avec un niveau de détail similaire à celui d'une personneDétecter des objets, reconnaître des visages, lire des caractères, mesurer des dimensions ou identifier des défauts dans une pièce industrielle sont quelques exemples.

Cette technologie est devenue un élément clé de Contrôle de la qualité en usine, systèmes de surveillance, diagnostic par imagerie médicale et des expériences de réalité augmentée, parmi de nombreuses autres utilisations.

Avantages et opportunités de l'IA

Sur le plan économique et social, l'IA ouvre la porte à une nouvelle vague d'innovation dans les produits, les services et les modèles commerciauxEn Europe, par exemple, elle est considérée comme un moteur essentiel de la transformation de secteurs tels que l'économie verte, technologie industrielleagriculture, santé, tourisme ou mode.

Dans le monde des affaires, l'un des plus grands atouts de l'IA est... automatisation des processus répétitifs et des tâches fastidieusesLes robots physiques et les logiciels intelligents peuvent gérer les opérations mécaniques, la classification des incidents, la génération de réponses standard ou l'extraction de données, libérant ainsi du temps pour des tâches créatives et stratégiques.

Un autre avantage clé est la capacité de réduire les erreurs humaines dans les activités répétitives ou de haute précisionDe la détection de micro-défauts dans les pièces à l'aide de caméras infrarouges à la saisie automatique des données, l'IA minimise les erreurs et améliore la traçabilité des opérations.

Parallèlement, les systèmes intelligents contribuent une précision remarquable dans l'analyse de grands volumes d'informationsCela génère des indicateurs utiles pour décider des investissements, ajuster les prix, dimensionner les effectifs ou repenser les processus. Cette capacité d'analyse renforce la qualité des décisions commerciales.

Dans le domaine de la santé, l'IA est déjà utilisée pour pour faciliter les diagnostics basés sur l'imagerie médicale, concevoir des traitements personnalisés et accélérer la découverte de médicamentsDans le secteur bancaire et financier, il permet de détecter les fraudes, d'évaluer les risques de crédit et d'automatiser les opérations sur les marchés boursiers.

Les services publics en bénéficient également : Optimisation des transports, gestion intelligente des déchets, économies d'énergie, éducation personnalisée ou administration électronique plus efficace Ce sont là des pistes d'application évidentes. Parallèlement, les analystes soulignent qu'une utilisation responsable de l'IA peut contribuer à renforcer la démocratie en aidant à lutter contre la désinformation, à détecter les cyberattaques et à améliorer la transparence des procédures d'acquisition.

Intelligence artificielle générative : un nouveau bond en avant en matière de capacités… et de risques

L'émergence de l'IA générative a marqué un tournant, car ces systèmes sont capables de créer du contenu original et crédibleTextes techniques, images, fichiers audio, vidéos ou codes, et exemples pratiques tels que Comment créer des stickers WhatsApp avec ChatGPT.

Pour les entreprises, cela ouvre la possibilité de Produire des documents, des campagnes marketing, des rapports ou des prototypes beaucoup plus rapidementElle permet également d'accompagner les équipes grâce à des copilotes de productivité. Toutefois, elle soulève aussi des défis supplémentaires en matière de qualité, de propriété intellectuelle, de sécurité et de réputation.

Parmi les risques les plus visibles figure la génération de informations incorrectes ou « hallucinations »Le modèle produit des données ou des références qui paraissent convaincantes mais ne correspondent pas à la réalité. Faute d'une vérification adéquate, cela peut conduire à des décisions erronées, notamment dans des domaines critiques comme la santé, le droit ou la finance.

À cela s'ajoute la question de sécurité et confidentialité des informationsSi un modèle est alimenté par des données sensibles (clients, patients, stratégie commerciale) sans les protections appropriées, il existe un risque de fuites, de non-conformité réglementaire ou de réutilisation inappropriée de ces informations.

De plus, l'IA générative peut favoriser un dépendance technologique excessive, avec des coûts croissants associés à l'utilisation de grands modèles, et peut homogénéiser excessivement le contenu et les propositions, réduisant ainsi la différenciation des marques si elles utilisent toutes les mêmes outils sans les personnaliser.

Risques transversaux liés à l'intelligence artificielle

Au-delà de l'aspect génératif, le déploiement massif de l'IA entraîne un ensemble de Risques structurels qui affectent l'emploi, les droits fondamentaux, la sécurité et la stabilité économiqueLes comprendre est essentiel pour pouvoir les gérer.

Déplacements d'emplois et pénurie de compétences

L’automatisation pilotée par l’IA a un effet ambigu sur l’emploi : Elle supprime certains postes, en transforme d'autres et crée de nouvelles professions.Les tâches administratives, les travaux de bureau très routiniers ou les tâches de contrôle de base sont particulièrement vulnérables.

Sans politique claire de recyclage professionnel et mise à jour des compétencesDe nombreuses personnes risquent d'être laissées pour compte sur le marché du travail, ce qui creusera les inégalités existantes. Dans un système économique planifié, cette transition pourrait être mieux organisée ; dans le capitalisme actuel, elle se traduit généralement par de l'instabilité et de la précarité pendant la restructuration du tissu productif.

Biais algorithmiques et discrimination

Les algorithmes apprennent à partir de données historiques qui souvent Elles reflètent les préjugés, les inégalités et les structures de pouvoir existants.Si ces biais ne sont pas corrigés, les systèmes les reproduisent et les amplifient dans les processus d'embauche, l'approbation des prêts, la gestion des assurances, voire même dans le système judiciaire.

Nous connaissons déjà des exemples de modèles de sélection du personnel qui Ils ont systématiquement pénalisé les femmes Parce qu'elles avaient été formées à l'aide de modèles majoritairement masculins ou d'outils d'évaluation des risques criminels présentant des biais raciaux. Pour atténuer ce risque, il est nécessaire de procéder à des audits indépendants, de constituer des équipes de développement diversifiées et d'utiliser des données de formation équilibrées et vérifiées.

Vie privée, surveillance et droits fondamentaux

L'IA fonctionne mieux avec davantage de données, ce qui incite à… collecte massive d'informations personnellesLes systèmes de reconnaissance faciale, le suivi en ligne, la création de profils comportementaux détaillés ou l'analyse des médias sociaux peuvent porter atteinte à la vie privée et, entre de mauvaises mains, devenir des outils de surveillance.

La législation européenne (y compris la future loi sur l'IA) vise à limiter les utilisations à haut risque, telles que : Identification biométrique de masse ou prise de décision automatisée sans possibilité d'intervention humainePour autant, le risque d’abus demeure, notamment dans les contextes où le contrôle démocratique est moins présent.

Sécurité, cyberattaques et utilisation malveillante

L'IA est une arme à double tranchant : elle peut faire beaucoup pour pour mieux prévenir, détecter et répondre aux menaces de cybersécuritéCela peut aussi renforcer les capacités des attaquants. L'automatisation des campagnes d'hameçonnage, la génération de logiciels malveillants plus sophistiqués ou le contournement des systèmes de détection à l'aide d'exemples d'adversaires ne sont que quelques exemples des risques encourus.

Dans le domaine militaire et de la sécurité nationale, l'impact de armes autonomes, systèmes de défense automatisés et cyberguerre assistée par l'IALa communauté internationale est encore loin de parvenir à un consensus solide sur les limites éthiques et juridiques de ces applications.

Manipulation de l'information et deepfakes

Avec l'IA générative, il est relativement facile de créer Vidéos, enregistrements audio et images truqués mais très crédiblesOn les appelle des deepfakes. Ces contenus peuvent servir à l'extorsion, à la manipulation politique, aux attaques contre la réputation ou aux campagnes de désinformation massives.

Parallèlement, les algorithmes qui personnalisent le contenu sur les réseaux sociaux peuvent enfermer les utilisateurs dans des chambres d'échoCela renforce les points de vue extrêmes et polarise davantage l'espace public. L'IA devient ainsi un amplificateur des dynamiques existantes, avec une portée difficile à contrôler.

Imprévisibilité et complexité des systèmes

À mesure que les modèles deviennent plus complexes et autonomes, Leur comportement devient de moins en moins transparent, même pour leurs créateurs.Cela rend difficile d'expliquer pourquoi une décision particulière a été prise, ce qui est crucial dans les domaines réglementés.

Si des fonctions essentielles (santé, infrastructures, justice, transports) sont déléguées à des systèmes opaques, le risque de défaillances systémiques, effets en cascade et perte de contrôle humainD’où l’importance de concevoir des modèles explicables, avec traçabilité et possibilité d’intervention manuelle.

Défis éthiques, réglementaires et de responsabilité

L'essor de l'IA a soulevé des questions complexes : Qui est responsable si un algorithme cause un préjudice ? Comment garantir l’équité et la transparence ? Quelles limites devraient être imposées ? Les réglementations traditionnelles sont à la traîne par rapport au rythme de l'innovation, ce qui crée des failles juridiques.

L'Union européenne promeut une loi sur l'IA qui classe les applications par niveaux de risque Elle établit des exigences plus strictes pour les secteurs à fort impact (santé, transports, emploi, justice, sécurité). Des obligations relatives à la documentation, à l'audit, à la gestion des données de formation et au contrôle humain sont prévues.

Une question particulièrement délicate est celle-ci : responsabilité en cas de dommagesSi une voiture autonome provoque un accident ou si un système automatisé refuse indûment un prêt, la responsabilité incombe-t-elle au constructeur du matériel, au développeur du modèle, à l'entreprise exploitant le système ou à l'utilisateur final ? Un système trop laxiste peut nuire à la qualité ; un système trop rigide peut étouffer l'innovation.

Parallèlement, l'éthique de l'IA exige d'aller au-delà du simple respect formel de la loi. Les organisations, les développeurs et les organismes de réglementation doivent s’accorder sur les principes de justice, de non-discrimination, de respect de l’autonomie et de minimisation des préjudicesEt cela nécessite inévitablement un débat public éclairé, impliquant non seulement les entreprises et les gouvernements, mais aussi les citoyens et les groupes concernés.

Gouvernance de l'IA dans les organisations : du chaos à un cadre commun

Dans de nombreuses entreprises, l'adoption de l'IA a commencé de manière informelle : Chaque département teste son propre modèle ou intègre un service externe de manière autonome.Le service marketing utilise un générateur de texte, le service des opérations entraîne un classificateur d'incidents, les ressources humaines expérimentent des outils de sélection de CV…

Cette approche « de modèle à modèle » a l’avantage de la rapidité, mais à moyen terme, elle entraîne des problèmes. fragmentation technologique, duplication des efforts et manque de contrôleDes dizaines de solutions isolées émergent, sans stratégie commune, sans traçabilité, ni indicateurs de coûts et de valeur partagés.

Les risques s'accumulent : On ignore combien de modèles sont en production, quelles données ils utilisent et qui en assure la maintenance.Les dossiers de décision sont incomplets, ce qui entrave les audits internes et réglementaires. De plus, la facture des services cloud ne cesse d'augmenter sans que personne n'ait une vision claire du retour sur investissement.

L'alternative est de s'orienter vers un cadre de gouvernance centralisé Cela permet de poursuivre les expérimentations, mais sur une base commune : catalogues de modèles, politiques de données, contrôles d’accès, outils de surveillance partagés, traçabilité et évaluation des risques. Les architectures spécialisées, telles que les plateformes d’IA d’entreprise, visent précisément à allier agilité locale et contrôle global.

Sans cette discipline, l'IA devient une source de dette technique, incertitude juridique et dépassements de coûtsElle devient ainsi une couche stratégique supplémentaire, au niveau de la cybersécurité ou de la gestion des données, capable de fournir des avantages concurrentiels durables.

Applications de l'IA dans la gestion des risques d'entreprise

Paradoxalement, bon nombre des menaces associées à l'IA peuvent être atténuées. utiliser l'IA comme alliée pour gérer les risques Au sein des organisations, son utilisation est déjà couronnée de succès dans des domaines tels que les risques opérationnels, la conformité réglementaire, la lutte contre le blanchiment d'argent et la sécurité de l'information.

D'une part, les algorithmes permettent analyser de grandes quantités de données internes et externes en très peu de temps, en détectant des schémas comportementaux anormaux, des tendances inquiétantes ou des combinaisons de facteurs qui précèdent généralement les incidents pertinents.

Les modèles prédictifsCes outils permettent d'anticiper la concrétisation de certains risques en se basant sur les tendances historiques. Cela permet de planifier des mesures préventives, de renforcer les contrôles ou d'adapter la couverture d'assurance.

En matière de prévention de la fraude, l'IA peut effectuer une surveillance en temps réel. transactions, accès au système et mouvements financiersL’identification des transactions suspectes qui échappent à l’œil humain est également essentielle. De même, en matière de gestion des risques de conformité, les algorithmes de segmentation facilitent la classification des clients, des produits ou des juridictions selon leur profil d’exposition.

Tout cela nécessite cependant, des données de qualité, bien gérées et représentativesSans une base informationnelle solide, les modèles génèrent des faux positifs, des biais et des décisions erronées. La technologie ne remplace pas le jugement professionnel, mais le complète et le rend plus efficace.

Ces dernières années, des solutions spécifiques basées sur l'IA générative ont également émergé et agissent comme copilotes pour la gestion des risquesCes outils permettent d'identifier, de décrire et d'évaluer les menaces en fonction de la réglementation applicable, du secteur d'activité et des processus propres à chaque entreprise. Intégrés à des plateformes robustes dotées de contrôles appropriés, ils accroissent considérablement la productivité des équipes de gestion des risques.

La combinaison de tous ces éléments brosse un tableau ambivalent : L'intelligence artificielle possède un potentiel énorme pour améliorer notre façon de produire, de décider et de vivre, mais elle amplifie également les inégalités, les erreurs et les conflits si elle est utilisée sans critères ni contrôle.Trouver cet équilibre implique d'investir dans la formation, de renforcer la réglementation, de déployer des cadres de gouvernance solides et de toujours placer l'humain au cœur des décisions, en utilisant l'IA comme un outil et non comme une fin en soi.

Table des matières

- Que comprenons-nous aujourd'hui par intelligence artificielle ?

- Comment fonctionne l'IA : techniques clés

- Avantages et opportunités de l'IA

- Intelligence artificielle générative : un nouveau bond en avant en matière de capacités… et de risques

- Risques transversaux liés à l'intelligence artificielle

- Défis éthiques, réglementaires et de responsabilité

- Gouvernance de l'IA dans les organisations : du chaos à un cadre commun

- Applications de l'IA dans la gestion des risques d'entreprise