- A Microsoft Fabric a OneLake-en és az egységes funkciókon központosítja az adatokat, az irányítást, a mesterséges intelligenciát és a valós idejű elemzéseket.

- A platform a Purview, a OneLake biztonság, a DLP, a DSPM és az Azure Cost Management integrációja révén erősíti az irányítást, a biztonságot és a költségeket.

- A Data Factory, a Dataflow Gen2 és a migrációs eszközök megkönnyítik a meglévő munkaterhelések áthelyezését és az összetett folyamatok összehangolását.

- A Copilot, az adatügynökök, az MCP és az olyan új munkaterhelések, mint a Fabric IQ és a valós idejű intelligencia, fejlett mesterséges intelligencia és automatizálási forgatókönyveket tesznek lehetővé.

Ha egy ideje már dolgozol adatokkal a Microsoft ökoszisztémájában, akkor észrevehetted, hogy A Microsoft Fabric a modern analitika központi központjává váltMindent egyesítünk egyetlen platformon, ami korábban a Power BI, az Azure Synapse, a Data Factory és más szolgáltatások között volt. Ebben a cikkben alaposan és részletesen áttekintjük a Fabric legújabb funkcióit, ütemtervét és gyakorlati vonatkozásait az analitika, az irányítás, a mesterséges intelligencia és a valós idejű számítástechnika terén.

A lényeg az, hogy mire befejezed az olvasást, világosan megérted majd, Mit kínál ma a Microsoft Fabric, merre tart, és hogyan befolyásolja az adatarchitektúrát? szervezetének: irányítási képességek a Purview segítségével, automatizálás API-kkal és Gittel, új mesterséges intelligencia funkciók, valós idejű intelligencia, biztonság a OneLake-ben, migrációk, teljesítmény és még sok más.

A Microsoft Fabric és a felhőalapú bevezetési keretrendszer: irányítás, költségek és automatizálás

A Microsoft a Felhőalapú Adaptációs Keretrendszer (CAF) keretében útmutatókat tett közzé a következők összehangolása érdekében: Microsoft Fabric tervezés a leszállózónák tervezési pilléreivelA sorozat utolsó része három kulcsfontosságú területtel foglalkozik: irányítás, kapacitásoptimalizálás és automatizálás/DevOps.

Az irányítási részben A hálózat kapacitásának költségei az Azure Cost Managementen keresztül érhetők el.Ez lehetővé teszi az F kapacitás (és más SKU) használati adatainak natív integrálását az Azure költség-dashboardjaiba, riasztásaiba és költéselemzéseibe. Nem csak a számla megtekintésére van szükség: ezeket az információkat kereszthivatkozásokkal is összevetheti címkékkel, előfizetésekkel vagy erőforráscsoportokkal, hogy megértse, ki mire és miért költ.

A Fabric technikai architektúrája és üzleti modellje lehetővé teszi az ügyfelek számára, hogy finoman szabályozza a kapacitásfelhasználást az üzemeltetési költségek optimalizálása érdekébenA gyakorlatban ez több tényezőt is magában foglal:

- Képességek skálázása F: a kapacitás növelése vagy csökkentése előre látható csúcsok, például értékesítési kampányok, könyvelési határidők vagy nagy adatmennyiségek alapján.

- Szüneteltetési és folytatási lehetőségekA hálózati rendszergazdák szüneteltethetik az F kapacitást, amikor nincs rá szükség (például éjszaka vagy hétvégén nem kritikus környezetekben) a számítási költségek csökkentése érdekében.

- Túlfeszültség-védelemKét kapacitásszintű paraméter szabályozza, hogyan kezeli a rendszer a háttérben futó feladatokat, hogy megakadályozzák azok a környezet telítődését: a Háttérben futó elutasítási küszöbérték és a Háttérben futó helyreállítási küszöbérték.

- KapacitásfoglalásokLehetőség van kapacitás lefoglalására meghatározott időszakokra kedvezmények igénybevétele érdekében, feltéve, hogy a várható fogyasztást szigorúan megtervezik.

Az adatkezelés területén a Fabric a következőkre támaszkodik: A Microsoft Purview, mint a katalogizálás, a származás és az osztályozás központi összetevőjeA Purview-ból lehetőség van érzékenységi címkék alkalmazására, az eredet, az átalakítások és a felhasználás közötti leszármazás megtekintésére, adatvagyon tanúsítására vagy adatminőségi kampányok fellendítésére, mindezt a Fabric elemeinek (Lakehouse, Warehouse, KQL, Power BI stb.) integrálása mellett.

A „Platformautomatizálás és DevOps” szakasz elsősorban a következő köré épül fel: Integráció Gittel, telepítési folyamatokkal és REST API-kkalA Fabric munkaterületek összekapcsolhatók a Git-tárházakkal, így több fejlesztő is együttműködhet ugyanazon az adatmérnöki, adattudományi vagy valós idejű elemzési projekten átfedés nélküli munka nélkül.

A Git és a telepítési folyamatok lehetővé teszik a fejlesztési, tesztelési és termelési életciklusok ellenőrzött módon történő összehangolásaTartalompromóció, változáskövetés, összetevő-szinkronizálás és verziókezelés. 2025 márciusa óta ezek a folyamatok (általános vagy előnézeti állapotban) számos elemtípust támogatnak, például triggereket, irányítópultokat, adatfolyamokat, adatfolyamokat, adatmartokat, tóházakat, raktárakat, KQL-t, jegyzetfüzeteket, lapozott jelentéseket, szervezeti alkalmazásokat stb.

Eközben a Fabric leleplezi egy nagyon széles REST API-készlet amellyel szinte bármilyen adminisztratív vagy telepítési feladat automatizálható: munkaterületek és mappák létrehozása, elemek tömeges migrálása, kapcsolatok és átjárók kezelése, definíciók kinyerése, folyamatok vagy jegyzetfüzetek aktiválása, és így tovább.

Főbb frissítések az analitika, a mesterséges intelligencia és az irányítás területén a Microsoft Fabric számára

A Fabric fejlődését számos előnézeti funkció és új képesség jellemzi, amelyek Gyakorlatilag a platform minden területét érintikEzután csoportosítják és strukturált módon megvitatják őket, hogy a teljes hatókör látható legyen.

MI-függvények az adattárházban és multimodális függvények

A relációs adatok területén a Fabric Data Warehouse magában foglalja a következőket: A mesterséges intelligencia közvetlenül a T-SQL-ben működik (előnézet). Ez lehetővé teszi:

- Szöveg osztályozása vagy kategorizálása.

- Érzelmek elemzése.

- Strukturált információk kinyerése szabad szövegből.

- Szöveg fordítása nyelvek között.

- Helyes nyelvtan.

A cél az Nem kell elhagyni az SQL kontextust az adatok mesterséges intelligenciával való gazdagításáhozEzeket a függvényeket a Fabric AI-függvényeiben található általánosabb multimodális támogatással kombinálják, amelyek mostantól képesek képeket (JPG/JPEG, PNG, GIF, WebP), PDF-eket és gyakori szövegformátumokat, valamint fájlútvonalak formájában érkező bemeneteket feldolgozni.

Közművek, mint például aifunc.load a mappák táblákba való betöltéséhez A prompt és séma opciókkal az `aifunc.list_file_paths` lehetővé teszi a fájlelérési utak végigjárását, az `ai.infer_schema` pedig az `ai.extract`-tal kompatibilis sémákat következtet ki. Mindez lehetővé teszi az adatok átalakítását és gazdagítását anélkül, hogy komplex folyamatokat kellene a nulláról építeni.

OneLake, Delta, Apache Iceberg és többplatformos hozzáférés

A tárolórétegen a OneLake marad az egységes tó, ahol az összes Fabric található. Az egyik fő fejlesztés a következő képesség: Delta Lake táblák Apache Iceberg táblákként való megjelenítése adatok áthelyezése vagy másolása nélkül, így az Iceberg-kompatibilis motorok közvetlenül beolvashatják a OneLake-en található tartalmat.

Ezenkívül a OneLake mostantól támogatja a következőket: Apache Iceberg adatokat közvetlenül a Snowflake írt, másolásmentes hozzáféréssel felhasználva a FabricbenEz a stratégia megerősíti az interoperabilitást: a Fabric nem siló, hanem egy adat „központ” akar lenni, amelyet más motorok kihasználhatnak a tárolás duplikálása nélkül.

Hasonlóképpen, a OneLake elismeri, hogy parancsikonok az Azure Blob Storage-hozOneDrive és SharePoint, és kiterjeszti a biztonságot hozzáférési szerepkörökkel, mappa-, sor- és oszlopszintű biztonsággal, valamint egy olyan biztonsági modellel, amelyet harmadik felek is tiszteletben tarthatnak a jogosult motormodell kiterjesztésének köszönhetően.

Egy különösen fontos szempont a OneLake katalógus Azure Databricksben történő összevonása, amely lehetővé teszi a következőket: Másolásmentes hozzáférés az Unity Catalogból a OneLake táblákhozIly módon a OneLake továbbra is az igazság forrása marad, de a Databricks közvetlenül lekérdezheti az adatokat, csak a metaadatokat szinkronizálva.

SQL Database on Fabric: teljesítmény, biztonság és virtualizáció

A Fabric SQL adatbázisa saját képességekre tesz szert: Adatbáziskészlet módosítása beállításokTámogatás a rendezés és a teljes szöveges indexelés előzetes verzióban. A következő szinten: adatbázis teljesítménye Ami a költségeket illeti, számos fejlesztés van:

- Automatikus indextömörítés a tárhely és az I/O csökkentése, valamint a lekérdezési idők javítása karbantartási feladatok ütemezése nélkül.

- Maximális virtuális magok korlátja a számítási erőforrások (4 vagy 32 virtuális mag) használatának szabályozására, amelynek célja, hogy megakadályozza a munkaterhelés túl nagy megosztott kapacitásfogyasztását.

- Egyéni SQL-készletek amelyek részletes szabályozást biztosítanak a munkaterület-adminisztrátoroknak az erőforrás-elosztás és a lekérdezések útválasztása felett alkalmazásnév alapján.

Ez is engedélyezve van Adatvirtualizáció SQL adatbázisban, amely lehetővé teszi a OneLake-ben tárolt külső adatok lekérdezését T-SQL segítségével, a gyakori formátumú fájlok helyi relációs táblákkal való összekapcsolását joinok használatával, az adatok fizikai importálása nélkül.

Biztonsági szempontból az SQL adatbázis támogatja a következőket: Privát hivatkozás a bérlői szinten (előzetes verzió)Ez megkönnyíti az adatforgalom privát és ellenőrzött módon történő irányítását, integrálódva a Fabric általános biztonságos hálózati konfigurációjába.

Valós idejű intelligencia, Eventhouse, Eventstream és Activator

A valós idejű intelligencia (RTI) modul a Fabric egyik legfontosabb megkülönböztető jegyévé vált. Az Eventhouse és az Eventstream egyesülnek, hogy... valós idejű események beolvasása, feldolgozása és kiváltása mindenféle forrásból, és az Activator összehangolja a bizonyos feltételek mellett aktiválódó műveleteket.

A legerősebb új funkciók közé tartoznak:

- Anomáliaészlelés kód nélkül automatikus modellválasztással, egyszerű felülettel és rugalmas riasztásokkal.

- Üzleti események, amelyek rögzítik a felhasználói adatfüggvényekből és jegyzetfüzetekből generált kulcsfontosságú üzleti pillanatokat, és lehetővé teszik riasztások, egyéni logikák, folyamatok, AI-modellek vagy Spark-feladatok aktiválását.

- Aktivátor-felhasználói adatfüggvények integrációjaígy a Fabricban létrehozott függvények bármilyen forrásból származó eseményeket feldolgozhatnak, beleértve a platform belső eseményeit és a OneLake-ből származó eseményeket is.

- Események SQL-lel történő feldolgozásának képessége (SQL operátor az Eventstreamben), lehetővé téve a valós idejű folyamatok átalakítását ismert SQL szintaxissal.

Releváns csatlakozókat adunk hozzá, például Cribl (naplók és telemetria betöltéséhez több forrásból), egy összekötő a Solace PubSub+ szolgáltatással, valamint streamelési támogatás privát hálózatokon keresztül Azure Virtual Network, VPN, ExpressRoute vagy privát végpontokon keresztül.

Az adatsémák és szerződések esetében az Eventstream bevezet egy Sémajegyzék amely eseménysémákat definiál és validál a robusztusabb folyamatfolyamatokhoz, valamint támogatja a Confluent Schema Registry Kafkához való csatlakozását a Confluent Cloudban, a meglévő szerződések tiszteletben tartása mellett.

Másodpilóta és mesterséges intelligencia képességek a platformon

A Copilot in Fabric mostantól globálisan elérhető, jelen van a következő országokban: Power BI, Data Factory, adattudomány és adatmérnökség, valamint KQL-lekérdezések írásaEzenkívül a következő speciális képességeket is beépítették:

- Copilot a Dataflow Gen2-höz (Modern Get Data), amely természetes nyelven írt utasításokkal segíti az adatok bevitelét és átalakítását.

- Copilot for Data Warehouse (csevegés), amely a menüszalagon található gombbal érhető el, hogy párbeszédpanelen keresztül felgyorsítsa a raktározási feladatokat.

- Copilot az SQL analitikai végponthoz, amely üzleti leírásokból generál és optimalizál SQL lekérdezéseket.

- Másodpilóta a notebookokon Ismeri a munkaterület kontextusát, a Lakehouse-t, a jegyzetfüzet struktúráját és a végrehajtási környezetet, képes többlépéses kódot generálni, refaktorálni, összetett jegyzetfüzeteket összegezni és hibákat diagnosztizálni a „Javítás Copilottal” opcióval.

- Beágyazott automatikus kiegészítés (beágyazott kódkiegészítés) és Notebook Copilot beágyazott kódkiegészítés (előzetes verzió), hogy gyorsabban és kevesebb hibával írjunk Pythont.

Továbbá a mesterséges intelligencia technológiai bázisa bővül a következőkkel: előre gyártott, integrált öntödei szerszámok (Azure OpenAI, Azure Language, Azure Translator), OpenAI bővítmények az Eventhouse-hoz (ai_embed_text és ai_chat_completion), valamint egy sor ügynök és adatügynök, amelyek lehetővé teszik más alkalmazások, köztük a Copilot Studio számára, hogy összehangolt módon dolgozzanak a Fabric-adatokon.

Fabric adatügynökök, MCP és fejlesztői eszközök

Szövet bemutatása adatügynökök, amelyek képesek az adatokhoz és eszközökhöz való hozzáférés megszervezésére MI-ügynökök számára Python SDK-val és közvetlen integrációval a Microsoft Copilot Studio-val. Ez megkönnyíti a Fabricben szabályozott vállalati adatokkal dolgozó beszélgetési asszisztensek létrehozását.

Ezzel párhuzamosan a Model Context Protocol (MCP) Kulcsfontosságú elemévé válik az AI-ügynökök és a Fabric-szolgáltatások közötti integrációnak. Dedikált MCP-kiszolgálók vannak az Activator és az Eventhouse számára, valamint egy fejlesztésorientált Fabric MCP, amely:

- Lehetővé teszi a mesterséges intelligencia asszisztensek számára, hogy kódot és tartalmat generáljanak a Fabric elemekhez.

- Integrálható olyan fejlesztőeszközökkel, mint a VS Code és a GitHub Codespaces.

- Eszközöket kínál a valós idejű adatok megtekintéséhez és az azokra való reagáláshoz az Eventhouse-ban.

A fejlesztő mindennapi munkájához számos kulcsfontosságú elemet kell kiemelni, beleértve a következőket: fejlesztőkörnyezet: MSSQL-bővítmény VS Code-hoz, Fabric SQL-adatbázis támogatással, a Microsoft ADO.NET illesztőprogramot és az ODBC illesztőprogramot a Fabric Data Engineeringhez (Spark SQL-hez való csatlakozás Livy-n keresztül), valamint egy Spark-összekötőt az SQL-adatbázisokhoz, amely leegyszerűsíti a Sparkból az Azure-ban és a Fabricben található SQL-adatbázisokhoz való hitelesített hozzáférést.

Úgy is megjelenik, hogy Fabric CLI, amely integrált feladatként érhető el az Azure DevOpsban, és lehetővé teszi a munkaterületek, elemek és központi telepítések kezelésének automatizálását külső eszközök manuális telepítése nélkül.

Data Factory, adatmigrációk és vezénylés Fabricben

A Fabric adatintegrációs rétege a Data Factory és a Dataflow Gen2 rendszerre támaszkodik, amelyek fogadó függvényeket... Az összehangolás intelligensebb, automatizálhatóbb és egyszerűbb migrációkkal jár majd. a meglévő platformokról.

Dataflow Gen2: teljesítmény, nyilvános API-k és diagnosztika

A Dataflow Gen2-ben számos funkciót találunk előzetes verzióban:

- Célzott lekérdezések speciális szerkesztése a célhely logikájának közvetlenül a szerzői környezetből történő módosításához.

- Particionált számításamely lehetővé teszi az adatfolyam egyes részeinek párhuzamos futtatását, csökkentve a teljes kiértékelési időt.

- Diagnosztika letöltése végrehajtási szinten, strukturált naplócsomagokkal a teljesítményelemzéshez és az incidensek megoldásához.

- Nyilvános API-k adatfolyamok programozott létrehozásához, frissítéséhez, törléséhez, ütemezéséhez és monitorozásához.

- Nyilvános paraméterek CI/CD támogatássalamelyek lehetővé teszik az adatfolyamok frissítését az értékek csővezetékekből vagy más forrásokból történő átadásával.

- Legfrissebb adatok a Power Query menüszalagján és a modern adatlekérésekben található legutóbb használt elemek gyors eléréséhez.

Mindezt kiegészítik a következő képességek Power Query programozott kiértékelése REST-en keresztülEz megnyitja az utat az M szkriptek automatizált folyamatok részeként történő futtatása előtt, integrálva őket Sparkkal, folyamatokkal vagy külső eszközökkel, kihasználva a Power Query összekötők előnyeit.

Adatgyár: adaptív teljesítmény, konnektivitás és adatgyár

Az integráció „klasszikusabb” részében a Data Factory within Fabric bemutatja a következőket:

- Adaptív teljesítményhangolás másolási tevékenységhez, amely intelligensen igazítja a teljesítményparamétereket a konfigurációs és végrehajtási kontextusnak megfelelően.

- Változásadatok rögzítése (CDC) támogatása másolási feladatban, hogy csak a változtatásokat (beszúrásokat, frissítéseket, törléseket) replikálja folyamatosan.

- Helyszíni átjárók manuális frissítési lehetőséggel a Fabric portálról, API-ból vagy szkriptekből kezelhető.

- legutóbbi kapcsolat, amely utolsó használatú tulajdonságokat ad a kapcsolatokhoz az auditálás és az életciklus-kezelés megkönnyítése érdekében.

- natív DBT állás, amely lehetővé teszi a dbt projektek Fabric-en belüli futtatását integrált vezényléssel, teszteléssel, dokumentációval és irányítással.

- SSIS csomag tevékenység meghívása folyamatokban, hogy SSIS csomagokat futtasson magából a Fabricben lévő vezénylésből.

A felhasználói élményt a következő fokozza: SharePoint webhelyválasztó (SharePoint webhelyválasztó), amely elkerüli az URL-ek kézi beírását, és MCP-támogatással rendelkezik a Data Factory számára, így a mesterséges intelligencia által támogatott asszisztensek egyszerűen, természetes nyelvi utasításokból hozhatják létre és telepíthetik a Dataflow Gen2-t.

Adatmigrációs és replikációs eszközök

A Microsoft számos konkrét eszközzel határozottan támogatja a Fabricra való átállást:

- Fabric migrációs felmérés Data Factory-hoz, amely elemzi az ADF-folyamatok előkészítését, és a támogatottakat egy Fabric munkaterületre migrálja kapcsolati leképezéssel.

- Migrációs asszisztens az adattárházhozamely mostantól közvetlenül csatlakozhat a forrásadattárházhoz, hogy áthelyezhesse azt a Fabric Data Warehouse-ba.

- Migrációs asszisztens SQL adatbázishoz, amelynek célja a helyszíni SQL Server munkaterhelések migrálása, sémaimportálással DACPAC-en keresztül, inkompatibilitás-észleléssel és ajánlásokkal.

A replikációval kapcsolatban támogatást nyújtanak a következőknek: több működési forrás tükrözése (Azure Database for MySQL, Google BigQuery, SQL Server stb.) a Fabricbe, azzal a képességgel, hogy szabályozható legyen, mely táblák replikálódjanak, újraindíthatók a tükrözési folyamatok REST-en keresztül, és Databricks esetén leképezhetőek legyenek az Unity Catalog szabályzatai a OneLake biztonsághoz.

Tartalmaz egy Lakehouse replikációs csatlakozót is, amely a következőt használja: Delta változás adatcsatorna, amely a Lakehouse Delta tábláin végrehajtott változtatásokat kompatibilis célállomások felé teszi elérhetővé anélkül, hogy a CDC saját fejlesztésű megoldásaival újra fel kellene találni a kereket.

Biztonság, fejlett irányítás és monitorozás a Fabricben

Az egyik legnagyobb aggodalom minden analitikai platformmal kapcsolatban az, hogy hogyan biztonságos adatok, a használat szabályozása és az erőforrás-fogyasztás nyomon követéseA szövetek gyorsan érnek ezeken a frontokon.

Biztonság és adatvédelem a OneLake-nél

A OneLake egy teljes modellt ad hozzá a adathozzáférési biztonság val vel:

- Adathozzáférési szerepkörök a Lakehouse számára, konfigurálható engedélyekkel egy mappa alapú biztonsági felületről.

- Biztonsági támogatás a gyorsbillentyűkhöz, hogy harmadik felek is tiszteletben tarthassák a meghatározott szabályzatokat.

- OneLake adathozzáférési biztonsági API, amely lehetővé teszi az automatikus jogosultságkezelést.

- A modell kiterjesztése külső motorokra (OneLake biztonsági engedélyezés harmadik felek számára).

Ezzel párhuzamosan a védelmet is bővítik DLP korlátozza a hozzáférést a OneLake összes strukturált adatára (SQL, KQL, adattárházak) kiterjed, és bevezetésre kerül DSPM mesterséges intelligenciához, Fabric Copilots és adatügynökök számára, amely a mesterséges intelligencia interakcióit figyeli az érzékeny információk és a kockázatos viselkedések szempontjából, integrálva a Purview Audit és az eDiscovery szolgáltatással.

Az identitás tekintetében az alábbi jellemzők jelennek meg: az elemekhez kapcsolódó identitások (például Lakehouse és Eventstream) REST API-kon keresztül, amelyek kiküszöbölik a tulajdonostól való függőséget bizonyos műveleteknél, valamint a OneDrive és a SharePoint parancsikonok hitelesítését munkaterület-identitások vagy szolgáltatásnevek használatával.

Központosított irányítás és OneLake katalógus

Az adatkezelési tapasztalatot megerősíti egy új központi panel a OneLake katalógusbanahol az adattulajdonosok összesített nézetben megtekinthetik az általuk létrehozott elemeket, irányítási intézkedési javaslatokat kaphatnak, és hozzáférhetnek az összes elérhető eszközhöz a biztonság és a megfelelőség javítása érdekében.

Ezenkívül egy OneLake katalóguskeresési API egy MCP eszközzel együtt, amely lehetővé teszi az elemek Fabric környezetben történő felderítését kódból vagy AI-ügynökökből egyetlen hívással, tiszteletben tartva a katalógusengedélyeket és a metaadatokat.

Kapacitások, fogyasztás és munka monitorozása

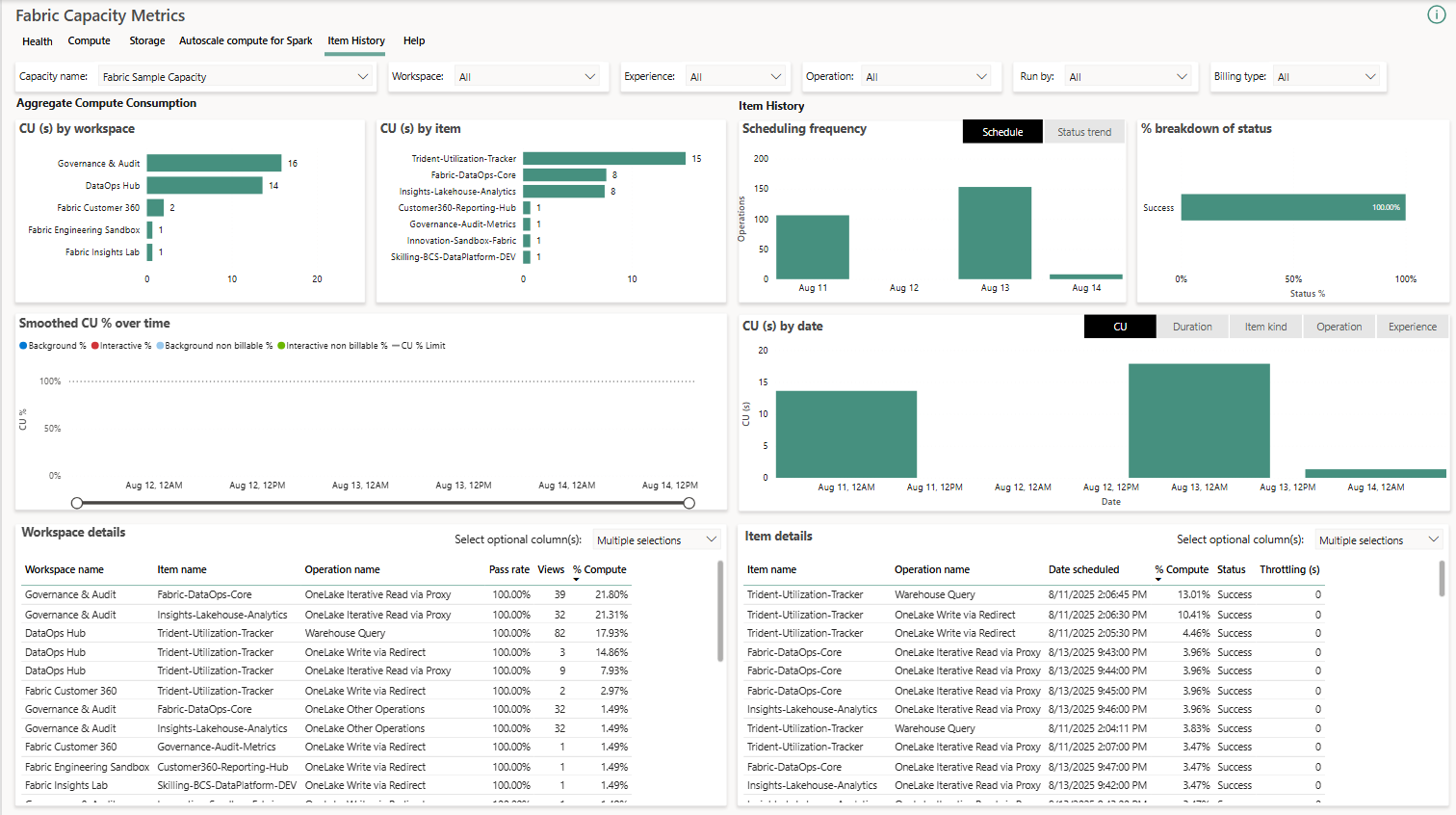

A Fabric több szintű megfigyelhetőséget biztosít:

- Munkaterület-felügyelet, amely egy adatbázist hoz létre a Fabricben, ahol több elem naplói és metrikái összevonhatók (beleértve a részletes monitorozással rendelkező másolási feladatokat is).

- Munkaterület-figyelés másolási feladathozolyan mérőszámokkal, mint az átviteli sebesség, az adatmennyiség, a hibakódok és az idők, amelyek mind a központosított elemzésre irányulnak.

- Elemtörténet a kapacitási metrikák alkalmazásában, 30 napos nézetekkel az egyes elemek CU-felhasználásáról, munkaterület és típus szerint szűrhető.

- Munkaterület-szintű túlfeszültség-védelemamely lehetővé teszi a felhasználási küszöbértékek beállítását munkaterületenként egy 24 órás gördülő ablakban, az azokat túllépők automatikus blokkolását, valamint a munkaterületek „kritikus fontosságúként” való megjelölését a korlátozások alóli kizárás érdekében.

Ezt kiegészítve egy kezdeti sor Fabric Admin API-k a munkaterületek, tételek és felhasználói hozzáférési adatok felderítésére, a dinamikus leltározás és az időszakos hozzáférés-vezérlés elősegítésére összpontosít.

Üzleti modellezés, tervezés és új munkaterhelések

A technikai rétegen túl a Microsoft bemutatja a következőket: új, üzleti orientációjú munkaterhelések a Fabricről. Az egyik legkiemelkedőbb a Fabric IQ, amely az üzleti szemantika, az adatok és a modellek egységesítésére törekszik intelligens ágensek számára, akik a szervezet holisztikus szemlélete alapján hoznak döntéseket.

A Fabric IQ-n belül a következők jelennek meg:

- Ontológia (előnézet), egy olyan elemtípus, ahol az entitások, kapcsolatok, tulajdonságok és korlátozások a vállalat üzleti nyelvének megfelelően vannak definiálva.

- Terv (előnézet), egy kódmentes platform tervezéshez, jelentéskészítéshez, elemzéshez, integrációhoz és együttműködésen alapuló menedzsmenthez.

A valós idejű intelligencia is megjelenik digitális ikerépítő, egy digitális ikrek valós idejű adatokon alapuló modellezésére szakosodott eszköz, amelynek célja a fizikai műveletek optimalizálása, az állapotok monitorozása és a forgatókönyvek szimulálása.

Másrészt bevezetik Fabric IQ munkaterhelés különálló munkaterhelésként működik, és az irányítási és szemantikai igazítási támogató eszközök folyamatosan bővülnek, bezárva a kört az adatmodellek, az üzleti logika és a mesterséges intelligencia/analitikai alkalmazások között.

Teljesítmény-, felhasználói élmény- és termelékenységjavítások

Az áttekintés lezárásaként érdemes kiemelni számos átfogó fejlesztést, amelyek Nem mindig kerülnek a címlapokra, de nagyban befolyásolják a mindennapi életet. a csapatok közül.

A Spark és elosztott számítástechnika részben a Fabric bemutatja:

- Fabric Runtime 2.0 (előzetes verzió) Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 és Python 3.12 rendszerekkel Azure Linux 3.0 rendszeren.

- Spark alkalmazás-összehasonlító eszközamely lehetővé teszi akár négy Spark-végrehajtás párhuzamos kiválasztását és összehasonlítását.

- Szikradiagnosztikai emitter, amely naplókat, metrikákat és eseményeket gyűjt a Spark-alkalmazásokból, és elküldi azokat olyan célhelyekre, mint az Event Hubs, a Storage vagy a Log Analytics.

- JobInsight diagnosztikai könyvtár, egy könyvtár a befejezett Spark-végrehajtások API-kon (lekérdezések, feladatok, szakaszok, feladatok, végrehajtók, eseménynaplók) keresztüli elemzéséhez.

A raktár rétegben a következők kerülnek hozzáadásra: adatcsoportosítás A teljesítmény javítása és a hozzáférési költségek csökkentése érdekében IDENTITY oszlopok kerültek bevezetésre a helyettesítő kulcsokhoz, valamint verziókövetés és CI/CD-támogatás került bevezetésre SQL Database projekteken keresztül a VS Code-ban (Warehouse verziókövetés).

A Fabric portál felhasználói élménye is fejlődik Lapfüles böngészés és objektumböngészőEz lehetővé teszi több elem egyidejű megnyitását és a gyors váltást közöttük. Ez, valamint az olyan fejlesztések, mint a Lakehouse automatikus kötése a Gitben és a Lakehouse karbantartásához szükséges segédprogramok (karbantartási tevékenységek és SQL végpontok frissítése), egy felhasználóbarátabb és agilisabb platformot eredményeznek.

Végül olyan funkciók, mint Tételdefiníciók tömeges importálása/exportálása (migrációkhoz, sablonokhoz és metaadat-mentésekhez), a REST mappákhoz, a paraméterek támogatása az Activatorból történő elemaktiválásokban, valamint a OneLake adatbetöltés Excelben integrált katalógussal, egy olyan ökoszisztémát alkot, amely gyakorlatilag egy modern adatkezelő csapat összes szokásos igényét lefedi.

Ezzel a teljes képességkészlettel – a központosított irányítástól, a részletes biztonságon és az intelligens vezénylésen át az SQL-be ágyazott mesterséges intelligenciáig, a valós idejű elemzésekig, a digitális ikrekig és az MCP-ügynökökig – a Microsoft Fabric megszilárdítja pozícióját, mint teljes értékű adatplatform, ahol A kulcs már nem csak az adatok tárolása és vizualizálása, hanem a mesterséges intelligencia irányítása, automatizálása és kihasználása az adatéletciklus minden részének ellenőrzésére.lehetővé téve a szervezetek számára, hogy fokozatosan fejlesszék architektúráikat, migrálják a már meglévőket, és sokkal gyorsabban tegyék lehetővé az új megoldásokat, mint a hagyományos megközelítések esetében.

Tartalomjegyzék

- A Microsoft Fabric és a felhőalapú bevezetési keretrendszer: irányítás, költségek és automatizálás

- Főbb frissítések az analitika, a mesterséges intelligencia és az irányítás területén a Microsoft Fabric számára

- MI-függvények az adattárházban és multimodális függvények

- OneLake, Delta, Apache Iceberg és többplatformos hozzáférés

- SQL Database on Fabric: teljesítmény, biztonság és virtualizáció

- Valós idejű intelligencia, Eventhouse, Eventstream és Activator

- Másodpilóta és mesterséges intelligencia képességek a platformon

- Fabric adatügynökök, MCP és fejlesztői eszközök

- Data Factory, adatmigrációk és vezénylés Fabricben

- Biztonság, fejlett irányítás és monitorozás a Fabricben

- Üzleti modellezés, tervezés és új munkaterhelések

- Teljesítmény-, felhasználói élmény- és termelékenységjavítások