- ChatGPT maakt ondanks zijn "intelligente" uiterlijk structurele fouten in redenering, gegevens en gezond verstand.

- De fouten komen voort uit de statistische trainingsmethode, vertekeningen in de gegevens en een gebrek aan echt begrip.

- Veel beroepen en onderwijstaken zullen veranderen, maar AI zal voornamelijk als assistent fungeren, niet als een volledige vervanging.

- Door ChatGPT te gebruiken met bronverificatie, duidelijke prompts en menselijke beoordeling, kunt u er optimaal van profiteren zonder onnodige risico's te nemen.

Generatieve kunstmatige intelligentie is ons dagelijks leven binnengeslopen, en ChatGPT is uitgegroeid tot hét hulpmiddel voor het schrijven, samenvatten, plannen en vinden van ideeën.Hoe indrukwekkend het ook mag lijken, het is verre van perfect. Blindelings vertrouwen op de antwoorden kan tot meer dan één onaangename verrassing leiden als je het onderwerp niet goed beheerst. waar het mank loopt.

Daarom staan steeds meer deskundigen erop dat Het begrijpen van de taken waarbij ChatGPT tekortschiet, is bijna net zo belangrijk als weten hoe je het moet gebruiken.Het gaat er niet om technologie te demoniseren, maar om te leren leven met de beperkingen ervan: wanneer het betrouwbaar is, wanneer je de antwoorden met een korreltje zout moet nemen en hoe je het kunt gebruiken zonder je menselijk kritisch oordeel te verliezen.

Waarom het cruciaal is om de beperkingen van ChatGPT te kennen.

Achter de chatinterface schuilt een complex systeem dat Het combineert grote taalmodellen met interne mechanismen die, afhankelijk van de vraag, prioriteit geven aan snelheid of redenering.Deze automatische "beslissing" sluit niet altijd aan bij de behoeften van de gebruiker: soms krijgt een snelle reactie voorrang, zelfs als het probleem stapsgewijs denken vereist. Je kunt dieper ingaan op hoe de parameters van kunstmatige intelligentie dat gedrag beïnvloeden.

Bovendien verandert het gedrag van het model bij elke update, waardoor het ChatGPT kan op verschillende momenten anders reageren op dezelfde vraag.Daarbij komen nog de contextbeperkingen bij lange gesprekken, waarbij het systeem delen van de conversatie begint te "vergeten", en beveiligingsfilters die gevoelige of volkomen legitieme onderwerpen uit overmatige voorzichtigheid blokkeren.

Deze combinatie van factoren betekent in de praktijk dat: De gebruikerservaring kan in een oogwenk omslaan van fantastisch naar frustrerend.Het verschil tussen een nuttig resultaat en een rampzalig resultaat zit hem meestal in de vraag of de gebruiker kan herkennen wanneer de AI de verkeerde kant opgaat en hoe hij deze kan bijsturen.

Uit diverse recente onderzoeken en enquêtes blijkt dat Een aanzienlijk deel van de gebruikers vertrouwt de antwoorden van ChatGPT niet volledig.In een enquête van OCU noemden veel mensen "gebrek aan vertrouwen" in de gegenereerde informatie als de belangrijkste reden om het niet dagelijks te gebruiken, ondanks dat ze het wel hadden geprobeerd.

Daarom bevelen specialisten op het gebied van kunstmatige intelligentie en onderwijs aan Gebruik ChatGPT als een aanvullende bron en nooit als de absolute waarheid.Het controleren van gegevens met andere bronnen, het beschikken over minimale kennis van het onderwerp en de aanname dat informatie verzonnen kan zijn (de beruchte "hallucinaties") is tegenwoordig een vereiste.

Veelvoorkomende fouten en technische beperkingen van ChatGPT

Uit de technische literatuur blijkt dat Deze systemen produceren doorgaans plausibele, maar onjuiste antwoorden.vooral wanneer de vraag dubbelzinnig, zeer specifiek is of afwijkt van de gegevens die ze tijdens de training hebben gezien. Het probleem is dat de formulering zo overtuigend is dat het moeilijk is om de fout te ontdekken als de gebruiker niet bekend is met het onderwerp. Hulpmiddelen zoals uitbreidingen voor het detecteren van door AI gegenereerde inhoud Ze kunnen helpen bij het identificeren van sommige van die hallucinaties.

Deskundigen zoals professor Josep Curto benadrukken dat Sommige van de meest voorkomende storingen zijn ingrijpend en beïnvloeden de algehele betrouwbaarheid van het systeem.Hij noemt onder andere onjuiste beschrijvingen van controleerbare feiten, onvolledige antwoorden, verzonnen verklaringen van het 'redeneerproces' van het model en minder nauwkeurig gedrag in andere talen dan het Engels.

Bovendien worden er weliswaar verbeteringen doorgevoerd, Ethische en veiligheidsvoorschriften zijn niet altijd goed op elkaar afgestemd.Soms blokkeren ze legitieme verzoeken terwijl ze andere problematische verzoeken wel toestaan, of ze produceren reacties die doorspekt zijn met vooroordelen die zijn overgenomen uit trainingsgegevens, of die nu cultureel, politiek of gendergerelateerd zijn.

Niettemin heeft voortdurend onderzoek naar deep learning en natuurlijke taalverwerking geleid tot De nieuwste versies, zoals GPT-4, bereiken prestaties die de menselijke capaciteiten benaderen bij complexe taken. Wiskunde, programmeren, recht, geneeskunde of psychologie. Maar hoge prestaties betekenen niet onfeilbaarheid, en blinde vlekken blijven bestaan.

7 taken waarbij ChatGPT faalt (of onbetrouwbaar is)

Hoewel ChatGPT in veel situaties erg nuttig kan zijn, zijn er bepaalde soorten taken waarbij De kans op een onjuist, bevooroordeeld of misleidend antwoord neemt aanzienlijk toe.Het is belangrijk om vertrouwd te zijn met deze scenario's om uiterste voorzichtigheid te kunnen betrachten.

1. Logisch redeneren en complexe wiskunde

Wanneer het probleem dit vereist kettingberekeningen, logische bewijsvoeringen of formele wiskundige bewijzenChatGPT maakt vaak fouten. Het kan misgaan bij eenvoudige bewerkingen, belangrijke stappen overslaan of onjuiste resultaten als correct presenteren.

Dit is vooral merkbaar in Oefeningen met veel tussenstappen, combinatoriek, kansrekening, geavanceerde algebra of meetkunde.Hoewel de tekst wellicht goed onderbouwd lijkt, kunnen kleine foutjes in één stap het hele resultaat ondermijnen, en het model heeft geen manier om zijn eigen redenering echt te "controleren".

2. Gezond verstand, intuïtie en menselijke context

De AI interpreteert wat haar wordt verteld letterlijk, dus Hij vindt het moeilijk om ironie, dubbele betekenissen, sarcasme of zeer lokale culturele verwijzingen te begrijpen.Dit leidt tot reacties die voor een mens duidelijk "misplaatst" zijn.

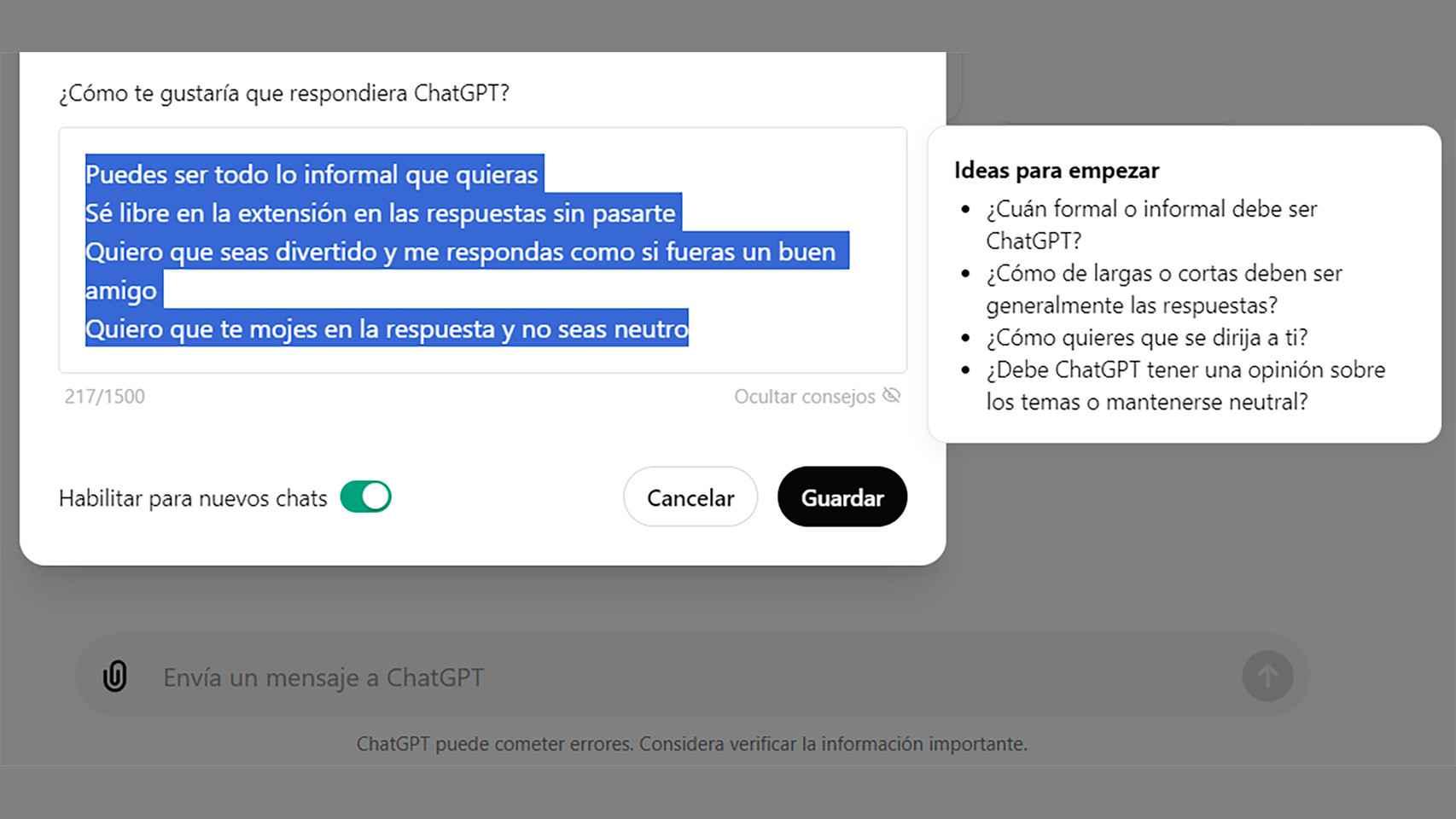

Wanneer de taak erom vraagt Echte empathie, diepgaand emotioneel begrip of praktische kennis van de echte wereld.Het model imiteert slechts taalpatronen, maar zonder persoonlijke ervaringen. Het klinkt misschien empathisch, maar het voelt niets en ervaart situaties zoals een mens dat zou doen. Om de toon te verbeteren en reacties aan te passen, is het raadzaam om... ChatGPT aanpassen en stijlen en rollen aanpassen.

3. Langetermijngeheugen en projectcontinuïteit

Hoewel het lijkt alsof hij zich het gesprek "herinnert", ChatGPT heeft een beperkte context en kan delen van de geschiedenis zonder voorafgaande kennisgeving verliezen.Langdurige gesprekken of projecten die zich voortslepen, leiden vaak tot geheugenverlies.

Dit heeft directe gevolgen taken zoals het schrijven van boeken, uitgebreide rapporten of programmeerprojecten die meerdere sessies omvatten.Als content niet extern wordt opgeslagen en beheerd, bestaat het risico op inconsistentie, het herhalen van reeds genomen beslissingen of zelftegenstrijdigheid zonder dat het model zich daarvan bewust is.

4. Vermeende tijdsbesparing die uiteindelijk meer kost.

Veel mensen kiezen voor ChatGPT voor snellere service, maar Wanneer antwoorden subtiele fouten bevatten of belangrijke informatie missen, kan het nakijken en corrigeren langer duren dan helemaal opnieuw beginnen.Dit is vooral merkbaar bij professionele taken die een hoge kwaliteitsstandaard vereisen.

In gebieden zoals technische rapporten, juridische documentatie, academische inhoud of productiecodeDe extra tijd die aan verificatie wordt besteed, kan het vermeende voordeel van het gebruik van AI volledig tenietdoen als er geen rigoureus beoordelingsproces is.

5. Verouderde gegevens en gebrek aan realtimeverbinding

Modellen zoals GPT-3 of GPT-4 worden getraind met behulp van een dataset die een bepaalde tijdsperiode bestrijkt, dus Ze hebben geen directe toegang tot het internet om actuele informatie te raadplegen.Afhankelijk van de versie kan uw kennis tot een specifiek jaar reiken.

Dit houdt in dat, in zaken van Actualiteiten, recente wetswijzigingen, wetenschappelijke ontwikkelingen of belangrijk nieuws.De antwoorden kunnen verouderd of ronduit onjuist zijn. Als de gebruiker de informatie niet raadpleegt met actuele bronnen, blijft de fout onopgemerkt.

6. Variabele prestaties en verzadiging

Tijdens perioden van grote vraag, met name naar gratis accounts, De kwaliteit en snelheid van reacties kunnen hierdoor worden beïnvloed.Het model kan minder gedetailleerde antwoorden geven, reacties voortijdig afbreken of oppervlakkigere oplossingen bieden.

Deze variabiliteit betekent dat Het is niet altijd een betrouwbaar alternatief voor cruciale taken met strakke deadlines.Volledig afhankelijk zijn van de dienstverlening tijdens piekuren zonder een back-upplan kan een operationeel risico vormen voor bedrijven en professionals.

7. Beperkingen, filters en vooroordelen

Om veiligheidsredenen bevat ChatGPT het volgende: Filters om schadelijke, illegale of zeer gevoelige inhoud te voorkomen.Het probleem is dat deze moderatiesystemen niet perfect zijn en soms legitieme verzoeken blokkeren of vaag reageren uit overmatige voorzichtigheid.

Desondanks hebben verschillende onderzoekers aangetoond dat De modellen kunnen reacties blijven genereren met racistische, seksistische of ideologische vooroordelen.Dit weerspiegelt de vooroordelen die in de trainingsdata aanwezig zijn. Er zijn gevallen gedocumenteerd van bots die met vergelijkbare technieken zijn getraind en uiteindelijk discriminerende inhoud produceren. ethische evaluatie van chatbots Het helpt om deze vooroordelen te begrijpen en te verminderen.

Fundamentele fouten: waarom ChatGPT zoveel fouten maakt

Bij de analyse van deze mislukkingen wijzen filosofen van de geest en AI-experts op structurele beperkingen: ChatGPT denkt niet, begrijpt niet en is zich niet bewust van wat het zegt.Hun schijnbare intelligentie komt voort uit grootschalige statistische correlaties, niet uit oprecht redeneren.

Professor Ned Block heeft bijvoorbeeld gewezen op experimenten met generatieve beeldmodellen waarin Je wordt gevraagd een klok te tekenen die tijden zoals 12:03 of 6:28 aangeeft, en bijna altijd verschijnt er een klok op 10:10.Dat tijdstip is populair in online advertentiefoto's omdat het esthetisch aantrekkelijk is en het logo niet verbergt.

Dit gedrag illustreert hoe Modellen hebben de neiging om de meest voorkomende patronen in hun trainingsgegevens te repliceren, zelfs als die in tegenspraak zijn met de specifieke instructie.Ze "begrijpen" het begrip tijd niet: ze herhalen alleen de statistisch meest voorkomende situatie.

Iets soortgelijks gebeurt wanneer een afbeelding wordt opgevraagd. een persoon die met zijn linkerhand schrijftVeel modellen genereren systematisch rechtshandige personages, omdat de meeste voorbeelden in de data ook rechtshandig zijn. Om een goed vertegenwoordigd linkshandig personage te krijgen, is het nodig om consequent zeer specifieke aanwijzingen te gebruiken, en zelfs dan lukt het niet altijd.

Dit type structurele schade veroorzaakt Zelfs ontwikkelaars kunnen sommige diepgewortelde vooroordelen niet volledig corrigeren.Versterkingstraining met menselijke feedback is nuttig, maar het handmatig versterken van alle mogelijke gevallen (alle uren op de klok, alle schrijfhoudingen, enz.) is onhaalbaar.

Op tekstueel niveau vertaalt het probleem zich in het volgende: overdreven zelfverzekerde verklaringen van dingen die het model in werkelijkheid niet "weet".Hij kan stap voor stap een zogenaamde methode beschrijven die hij nooit heeft toegepast, of academische referenties en verbanden verzinnen met een volstrekt overtuigende uitstraling.

Hoe ChatGPT getraind heeft en waarom dat zijn fouten beïnvloedt

Modellen zoals GPT-3 en GPT-4 zijn gebaseerd op de Transformer-architectuur, en Ze zijn getraind met enorme hoeveelheden tekst van het internet.: webpagina's, boeken, wetenschappelijke artikelen, nieuws en andere openbare bronnen zoals Wikipedia of Common Crawl.

Het proces bestaat uit twee hoofdfasen. Ten eerste, een Een grootschalige voorbereidende training waarbij het model leert het volgende woord in miljoenen zinnen te voorspellen.In dit stadium wordt er geen expliciete "grammatica" onderwezen, maar worden patronen afgeleid door de gaten in de tekst in te vullen, een soort gigantische woordaanvullingsoefening.

Vervolgens wordt er een fijnafstelling uitgevoerd voor specifieke taken, zoals: vertaling, samenvatting, antwoord op vragen of gespreksdialoogHier komen kleinere, meer specifieke gegevenspunten in beeld, die van labels worden voorzien om het model te leren welk type reactie in elke context als gepast wordt beschouwd.

Ook bij ChatGPT is het gebruikt. Reinforcement learning met menselijke feedback (RLHF)Menselijke trainers beoordeelden verschillende mogelijke reacties van het model op dezelfde input en rangschikten deze van beste tot slechtste. Met deze informatie leerde het systeem de voorkeur te geven aan de best beoordeelde outputs.

Deze aanpak verbetert de waargenomen kwaliteit van de antwoorden, maar lost het onderliggende probleem niet op: Het model mist nog steeds semantisch begrip en directe toegang tot de realiteit.Het vergroot alleen maar je kansen om behulpzamer, beleefder en zelfverzekerder over te komen, wat de hallucinaties soms juist nog gevaarlijker maakt.

Bovendien worden, hoewel technieken voor gegevensopschoning, regularisatie en menselijke evaluatie worden toegepast op Verminder de vooroordelen en stereotypen die in trainingsteksten voorkomen.Het is onmogelijk om ze volledig te filteren. Daarom raden bedrijven aan om de output continu te monitoren, vooral bij gevoelige toepassingen.

De impact van ChatGPT op studies en de arbeidsmarkt.

Sinds de lancering heeft ChatGPT het debat over opnieuw aangewakkerd. Welke gevolgen zal generatieve AI hebben voor banen en het onderwijs?Grote technologiebedrijven presenteren het als een "co-piloot" of assistent, maar veel studies wijzen op ingrijpende veranderingen in tal van beroepen.

Onderzoek van universiteiten zoals New York University en de University of Pennsylvania, samen met analyses van OpenAI en andere instanties, toont aan dat Taalgerelateerde taken (schrijven, vertalen, tekstanalyse, documentatie, basisboekhouding) Ze zijn bijzonder kwetsbaar voor gedeeltelijke automatisering.

Op de arbeidsmarkt worden zij aangemerkt als een groep die bijzonder kwetsbaar is. Verkoopmedewerkers die via telemarketing werken, universiteitsprofessoren in talen en literatuur, docenten geschiedenis of rechten, vertalers, administratief personeel en bepaalde schrijfprofielen.Dit betekent niet dat ze allemaal zullen verdwijnen, maar wel dat een groot deel van hun functies sterk afhankelijk zal worden van AI.

Andere onderzoeken tonen duidelijk positieve effecten aan. Bijvoorbeeld in tests met softwareontwikkelaars, Degenen die codeerassistenten gebruikten die gebaseerd waren op vergelijkbare modellen, voltooiden taken tot 55% sneller. dan degenen die zonder hulp werkten. De productiviteit bij routinetaken neemt toe, waardoor er meer tijd overblijft voor complexe problemen.

In het onderwijs is het debat bijzonder fel. Er zijn voorbeelden die aantonen dat Het wordt steeds moeilijker om te onderscheiden of een kort essay door een student is geschreven of door ChatGPT.zelfs voor ervaren docenten en professionele auteurs. In sommige experimenten slaagden docenten en experts er niet in de ware auteur te identificeren.

Als reactie hierop beginnen veel docenten de volgende vragen te stellen: meer mondelinge beoordelingen, klassikale opdrachten en activiteiten die het denkproces van de leerling aantonenNiet alleen het eindproduct. Anderen stellen voor om ChatGPT als leermiddel te gebruiken: een startpunt dat de student moet bekritiseren, corrigeren, vergelijken met echte bronnen en verbeteren.

Beste werkwijzen voor het gebruik van ChatGPT zonder in de valkuilen te trappen.

Ondanks al deze problemen is ChatGPT buitengewoon nuttig als het de juiste rol krijgt. De sleutel zit hem in... Combineer een goed promptontwerp met strenge menselijke controle over wat het genereert.vooral wanneer er academische, juridische of professionele implicaties zijn.

Een eerste basisaanbeveling is Controleer altijd feiten, cijfers, bronnen en namen. Voordat je ze gebruikt, is het niet voldoende dat het "goed klinkt": je moet het controleren met betrouwbare bronnen (wetenschappelijke artikelen, officiële wetgeving, naslagwerken, gespecialiseerde databases, enz.).

Het is ook handig Neem geen cruciale beslissingen op basis van één enkel modelresultaat.Als het om een belangrijke kwestie gaat, is het verstandig om meerdere meningen te vergelijken (andere tools, menselijke experts, documentatie) en de chat alleen te gebruiken als ondersteuning of om een concept te genereren.

De vormgeving van de instructies heeft een enorme impact: Duidelijke, specifieke en goed gestructureerde aanwijzingen verminderen de onduidelijkheid en leiden doorgaans tot nuttigere resultaten.Door hen te vragen hun redenering stap voor stap uit te leggen, tegenvoorbeelden te geven of mogelijke beperkingen aan te wijzen, kunnen fouten worden opgespoord.

Tot slot, door ChatGPT te gebruiken als generator van sjablonen, schema's, concepten en ideeënlijsten waar de persoon vervolgens mee aan de slag gaatIn plaats van de definitieve tekst simpelweg te accepteren, bespaart dit tijd op de meer mechanische aspecten, maar de uiteindelijke inhoud wordt nog steeds door een mens herwerkt en gevalideerd.

De ervaringen van de afgelopen jaren tonen aan dat Generatieve kunstmatige intelligentie werkt het best wanneer we haar beschouwen als een krachtige, maar feilbare assistent.Met een kritische instelling, een goed oordeel bij het kiezen van taken en een serieus evaluatiesysteem wordt het een waardevolle bondgenoot in plaats van een stille bedreiging.

Inhoud

- Waarom het cruciaal is om de beperkingen van ChatGPT te kennen.

- Veelvoorkomende fouten en technische beperkingen van ChatGPT

- 7 taken waarbij ChatGPT faalt (of onbetrouwbaar is)

- 1. Logisch redeneren en complexe wiskunde

- 2. Gezond verstand, intuïtie en menselijke context

- 3. Langetermijngeheugen en projectcontinuïteit

- 4. Vermeende tijdsbesparing die uiteindelijk meer kost.

- 5. Verouderde gegevens en gebrek aan realtimeverbinding

- 6. Variabele prestaties en verzadiging

- 7. Beperkingen, filters en vooroordelen

- Fundamentele fouten: waarom ChatGPT zoveel fouten maakt

- Hoe ChatGPT getraind heeft en waarom dat zijn fouten beïnvloedt

- De impact van ChatGPT op studies en de arbeidsmarkt.

- Beste werkwijzen voor het gebruik van ChatGPT zonder in de valkuilen te trappen.