- AI gjør det mulig å oppdage og reagere på cybertrusler og fysisk kriminalitet med større hastighet, nøyaktighet og kontekst.

- Angripere er også avhengige av AI for svindel, deepfakes og automatisering av utnyttelse av sårbarheter.

- Beskyttelse av AI krever sikring av data, modeller og API-er, med full synlighet på tvers av hybride og multiskymiljøer.

- Å integrere sikkerhet gjennom design og fokusere på robusthet gjør AI til et reelt konkurransefortrinn.

La kunstig intelligens anvendt på sikkerhet Det har blitt et av de største samtaleemnene i bedrifter, offentlige forvaltninger og politimyndigheter. Overgangen til skyen, hybridmiljøer og den massive dataveksten har fullstendig endret spillereglene, og angripere utnytter dette i et halsbrekkende tempo.

Samtidig åpner AI et stort mulighetsvindu: fra oppdage cyberangrep i sanntid Dette inkluderer å forutse fysiske forbrytelser i spesifikke områder og automatisere kjedelige oppgaver i sikkerhetsoperasjonssentre. Alt dette potensialet kommer imidlertid med svært alvorlige risikoer hvis selve AI-en, dens data og grensesnittene rundt den ikke er ordentlig beskyttet.

Det nye trussellandskapet og hvorfor kunstig intelligens er nøkkelen

Det nåværende cybertrusselmiljøet er mye mer kompleks og aggressiv som var for bare noen få år siden. Den massive migrasjonen til skyen og hybridarkitekturer har ført til at angrepsflater har skutt i været: nå er data spredt på tvers av lokale datasentre, forskjellige skyleverandører og kantmiljøer, noe som kompliserer kontrollen betraktelig.

Denne endringen sammenfaller med en tydelig mangel på cybersikkerhetsfagfolkBare i USA er det hundretusenvis av ubesatte stillinger, noe som resulterer i overbelastede team med lite tid til grundig forskning og tvunget til å prioritere forhastet.

Resultatet er at angrepene skjer i dag. hyppigere og dyrereNylige rapporter plasserer gjennomsnittlig global kostnad for et datainnbrudd overstiger 4 millioner dollar, med kumulative tosifrede økninger på bare tre år. Når man analyserer virkningen av AI på disse hendelsene, er forskjellen slående: organisasjoner som ikke bruker AI i sikkerhetsstrategien sin betaler i gjennomsnitt betydelig mer per brudd enn de som gjør det.

Selskaper som har AI-baserte sikkerhetsfunksjoner De klarer å kutte gjennomsnittskostnadene ved et datainnbrudd med hundretusenvis av dollar. Selv det å ha delvis eller begrenset AI-kontroll representerer en betydelig besparelse sammenlignet med de som ikke har investert noe på dette området.

I denne sammenhengen er ikke AI bare «en bonus»: den er i ferd med å bli en essensiell strategisk brikke for å kunne overvåke store mengder sikkerhetsinformasjon, oppdage unormal atferd og reagere på hendelser før de eskalerer.

Hvordan nettkriminelle bruker kunstig intelligens

Den andre siden av mynten er at de samme fremskrittene innen AI som hjelper med forsvar også har vært raskt tatt i bruk av angripereEvnen til å generere overbevisende falskt innhold til lav kostnad endrer svindel, desinformasjon og til og med personlig utpressing.

På den ene siden lar avanserte tekstgeneratorer deg lage falske nyheter, phishing-e-poster Og svært polerte sosialtekniske meldinger, skreddersydd til offerets kontekst og skrevet i en stil som etterligner journalister eller bedriftsledere. Vi snakker ikke lenger om e-poster fulle av feil, men snarere svært troverdig kommunikasjon.

På den annen side, verktøyene for å lage video- og lyddeepfakes De har tatt et stort sprang fremover. Med spesialisert programvare kan angripere legge ansikter over ekte videoer (deepfaces) eller klone stemmer (deepvoices) med et nivå av realisme som lett lurer alle som ikke er forberedt.

Et illustrerende tilfelle er telefonsvindel basert på stemmekloning av et familiemedlemEtter å ha innhentet lydopptak av en person, trener de kriminelle en modell som er i stand til å imitere personens tonefall, aksent og måte å snakke på. Deretter ringer de en slektning, utgir seg for å være det familiemedlemmet, dikter opp en nødsituasjon og ber om en umiddelbar pengeoverføring. Når offeret gjenkjenner stemmen, senker de garden fullstendig.

Utover ren bedrag, brukes AI også til automatisere oppdagelsen av sårbarheterDette inkluderer å perfeksjonere brute-force-angrep mot legitimasjon eller å skrive ondsinnet kode. Politimyndigheter og organisasjoner som FBI har allerede oppdaget en klar økning i inntrenging knyttet til ondsinnet bruk av generativ AI, og mange cybersikkerhetsfagfolk erkjenner at en betydelig del av veksten i angrep skyldes nettopp disse nye verktøyene.

AI-applikasjoner innen cybersikkerhet: fra endepunkt til sky

Stilt overfor denne økte risikoen, forvandler også AI cyberforsvar på tvers av hele teknologistakkenBedrifter integrerer maskinlæringsfunksjoner i endepunktløsninger, brannmurer, SIEM-plattformer og skyspesifikke verktøy.

På brukersiden er løsningene til AI-drevet endepunktsikkerhet De analyserer kontinuerlig oppførselen til prosesser, filer og tilkoblinger. I stedet for å stole utelukkende på signaturer, lærer de hva som er «normalt» på hver enhet og oppdager mistenkelige avvik, for eksempel plutselig utførelse av ukjente skript eller massekryptering av filer som er typisk for ransomware.

Neste generasjons AI-baserte brannmurer (NGFW-er med intelligente funksjoner) er i stand til å inspisere kryptert trafikk, oppdage avvikende mønstre og korrelere hendelser på tvers av flere porter og protokoller. Dette muliggjør avbrudd i kommunikasjonen med kommando- og kontrollservere eller blokkering av datautrensningsforsøk som ellers ville gått uoppdaget hen.

På det globale overvåkingslaget, plattformene til Sikkerhetsinformasjon og hendelsesstyring (SIEM) Og XDR-løsninger genererer tusenvis av varsler daglig. AI brukes til å prioritere, gruppere relaterte hendelser og gjøre den skredet av rådata om til noen få hendelser med stor innvirkning som virkelig fortjener umiddelbar oppmerksomhet.

Videre er de distribuert i skymiljøer AI-baserte målrettede sikkerhetsløsninger Disse teknologiene identifiserer feilkonfigurasjoner, overdreven tilgang til tillatelser eller uvanlig dataflyt mellom regioner og tjenester. I tillegg overvåker AI-drevne nettverksdeteksjons- og responsteknologier (NDR) intern nettverkstrafikk for å se atferd som er typisk for en angriper som allerede er inne i systemet.

Fordeler med AI for sikkerhetsteam

Nettsikkerhetsteam står overfor en dobbel utfordring: å håndtere en enorm mengde data og en økende teknisk kompleksitetHer har AI blitt en viktig alliert for å gjøre mer med de samme ressursene.

En av de klareste fordelene er mye raskere trusseldeteksjonDer en analytiker tidligere måtte gjennomgå hendelser manuelt, lærer algoritmer nå angrepsmønstre, brukervaner og typisk systematferd. Dette lar dem identifisere kritiske hendelser i løpet av sekunder, selv når de manifesterer seg som en kombinasjon av subtile signaler spredt over forskjellige datakilder.

Et annet nøkkelpoeng er reduksjon av falske positive og falske negative resultaterVed hjelp av mønstergjenkjenning, avviksdeteksjon og kontinuerlige læringsteknikker filtrerer AI ut «støyen» fra irrelevante varsler og fokuserer på de som virkelig utgjør en trussel. Dette forhindrer at team brenner ut ved å reagere på varsler som til slutt ikke fører noen vei.

Generativ AI endrer også måten analytikere jobber med informasjon på. Ved å kunne oversette tekniske data til naturlig språkVerktøyene kan produsere tydelige rapporter som enkelt deles med ledere eller andre avdelinger, forklare hva en spesifikk sårbarhet innebærer, eller detaljere de anbefalte trinnene for å rette den.

Denne evnen til å presentere informasjon på en forståelig måte og veilede responsen gjør det Junioranalytikere kan ta på seg mer komplekse oppgaver uten å måtte mestre spørrespråk eller avanserte verktøy fra dag én. I praksis genererer AI utbedringstrinn, konkrete forslag og tilleggskontekst som akselererer læringskurven.

Til slutt gir AI et mer komplett bilde av miljøet til aggregerte og korrelerte data av sikkerhetsregistre, nettverkstrafikkSkytelemetri og eksterne trusselinformasjonskilder bidrar til å avdekke angrepsmønstre som ellers ville gått ubemerket hen fra ett enkelt system.

Autentisering, passord og atferdsanalyse

Utover inntrengingsdeteksjon endrer AI måten vi Identiteter er beskyttet og tilgang administreresTradisjonelle passord finnes fortsatt, men de kombineres i økende grad med atferdsanalysemodeller og tilleggsfaktorer drevet av AI.

AI brukes i systemer av adaptiv autentisering De vurderer konteksten for hver pålogging: plassering, enhet, tidspunkt, brukshistorikk, skrivehastighet og andre faktorer. Hvis noe virker uvanlig, øker systemet sikkerhetsnivået ved å be om ytterligere informasjon eller blokkere økten.

Parallelt tillater atferdsanalyseløsninger oppdage phishing-forsøk eller kompromitterte kontoer ved å studere hvordan brukere samhandler med applikasjoner, hvilke ressurser de bruker og hvordan de navigerer i nettverket. En betydelig endring i disse mønstrene kan tyde på at noen bruker stjålne påloggingsinformasjon.

Sårbarhetshåndtering er også avhengig av AI for å gå utover de typiske endeløse listene med feil. Modellene analyserer hvilke sårbarheter som er mest sannsynlig å bli utnyttet basert på angripernes faktiske aktivitet, tilgjengeligheten av offentlige utnyttelser og eksponeringen av hver ressurs, noe som bidrar til å prioritere oppdateringsarbeidet.

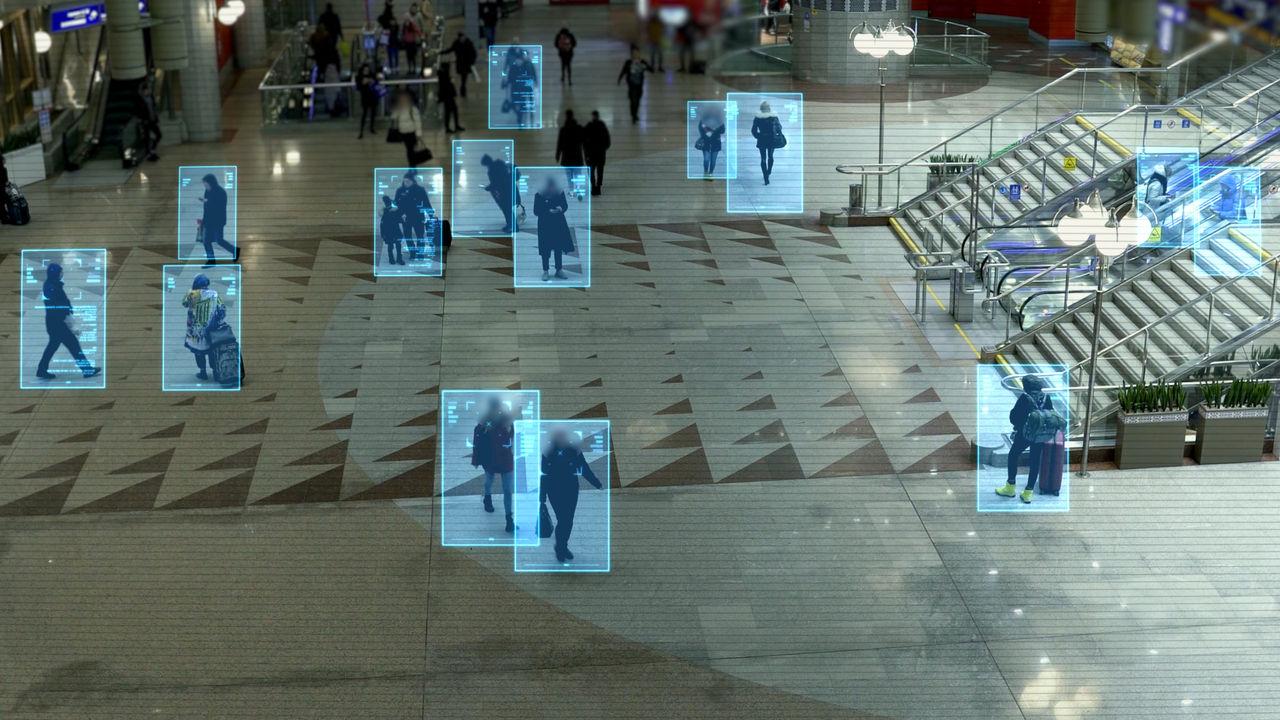

I fysiske miljøer, den overvåking med kameraer og sensorer Den drives av AI-modeller som er i stand til å oppdage mistenkelig oppførselIdentifisere bilskilt, gjenkjenne bevegelsesmønstre eller varsle om uvanlige sammenkomster. Ved å kombinere denne informasjonen med historiske data og kontekst kan tidlige varslingssystemer aktiveres i områder med høy kriminalitetsaktivitet.

Kriminalitetsforebygging og -prediksjon i den fysiske verden

Utenfor cyberspace begynner også AI å spille en viktig rolle i kriminalitetsforebygging i bymiljøerVed å analysere store mengder historiske data kan myndighetene identifisere mønstre som hjelper dem med å bedre planlegge ressurser.

Blant de vanligste bruksområdene er analyse av kriminalitetsmønstreDenne informasjonen bidrar til å bestemme hvilke typer kriminalitet som er konsentrert i bestemte områder, på hvilke tidspunkter de er hyppigst, og hvordan de utvikler seg over tid. Den brukes til å justere patruljer, forbedre belysning, installere flere kameraer og utforme målrettede forebyggingskampanjer.

AI brukes også i tidlige varslingssystemer Disse systemene kombinerer sanntidsdata (kameraer, sensorer, sosiale medier, til og med værvariabler) for å anslå når visse hendelser mest sannsynlig vil inntreffe. Selv om de ikke er ufeilbarlige, kan de bidra til å forutse risikoscenarier.

Innen forskningsfeltet tillater algoritmer utføre digital rettsmedisinsk analyse De bruker store mengder rettsmedisinske data (fingeravtrykk, DNA, saksjournaler, arrestasjonshistorikk) for å identifisere sammenhenger som ville være svært vanskelige å se ved første øyekast. Dette lar dem koble sammen tilsynelatende urelaterte saker eller forbedre søket etter mistenkte.

All denne utplasseringen må stadig balanseres med respekt for personvern og menneskerettigheterRisikoen for skjevhet i treningsdata er reell: hvis modeller mates med allerede partiske politiregistre, kan de forsterke eksisterende diskriminering ved å «forutsi» mer kriminalitet i bestemte lokalsamfunn, selv om det underliggende problemet er noe annet.

Risikoer og utfordringer: datasikkerhet, modellsikkerhet og API-sikkerhet

For at AI skal være pålitelig, kan ikke sikkerhet lenger begrenses til å beskytte servere eller nettverk. Det er avgjørende. beskytte sin egen intelligens: dataene som mater modellene, AI-arkitekturene og grensesnittene som gjør dem tilgjengelige.

Modeller er bare så gode som treningsdataene deres. Hvis disse dataene er... manipulert eller partiskAI vil ta feilaktige beslutninger. Et veldig tydelig eksempel kan sees i modeller som brukes til personellutvelgelsesprosesser: hvis de er trent med historikk der visse profiler systematisk har blitt favorisert, kan AI forsterke skjevheter basert på kjønn, rase eller opprinnelse, og diskriminere mot perfekt kvalifiserte kandidater.

På et rent teknisk nivå står språkmodeller og andre avanserte AI-er overfor nye angrepskategorier, som for eksempel rask injeksjonDet består av å skjule ondsinnede instruksjoner i datainngangen for å endre modellens oppførsel, omgå begrensninger eller få den til å returnere skadelig informasjon.

En annen stor risiko er eksponering av sensitiv informasjonHvis systemene er feilkonfigurert, kan de avsløre konfidensielle kundedata, forretningshemmeligheter eller fragmenter av selve treningssettet, enten direkte eller gjennom teknikker som medlemskapsinferens eller modellutvinning.

API-ene som brukes til å få tilgang til, trene eller utnytte AI-modeller representerer en kritisk front. Uten en robust autentisering, forespørselsbegrensning og inndatavalideringDe blir enkle mål for brute-force-angrep, masseskraping eller uautoriserte endringer i modellparametere. Det er ingen tilfeldighet at et flertall av selskaper har blitt utsatt for API-relaterte sikkerhetshendelser de siste månedene.

Kompleksiteten i hybride miljøer og behovet for total synlighet

De fleste organisasjoner kjører sine AI-løsninger i hybrid infrastruktur som kombinerer offentlig sky, privat sky, lokal og i økende grad edge computing. Denne spredningen gjør det vanskelig å opprettholde et klart bilde av hvor dataene er, hvordan de beveger seg og hvem som har tilgang til dem til enhver tid.

Mangel på synlighet skaper fragmenterte kontroller og blindsonerNoen modeller trenes i én sky, forbedres i en annen, og distribueres deretter i forskjellige land, med data som flyttes fra ett miljø til et annet. Uten tilstrekkelig observerbarhet kan sikkerhetsbrudd eller manglende samsvar med regelverk lett oppstå uten at noen oppdager dem i tide.

Videre, i motsetning til tradisjonell programvare, AI-modeller De utvikler seg med brukDe kan tilpasse parameterne sine i henhold til de nye dataene de behandler, noe som gjør det vanskelig å oppdage om de har blitt manipulert eller om de gradvis har avviket fra forventet oppførsel.

Derfor er det avgjørende å utplassere kontinuerlig overvåking og avansert analyse, inkludert sikkerhet i hjemmelaboratoriet dittNår det gjelder ytelse, responser og beslutninger til modellene, er det bare på denne måten som man kan identifisere merkelige mønstre, subtile degraderinger eller angrepsforsøk som går ubemerket hen i tradisjonelle logger.

Dette behovet for kontroll strekker seg også til nettverks- og applikasjonslagene. Webapplikasjons- og API-beskyttelsesteknologier, kombinert med dyp trafikkinspeksjon, muliggjør deteksjon av mistenkelige spørringer, forsøk på å hente ut data eller unormal oppførsel overfor AI-tjenester, og blokkere dem før de kompromitterer sensitiv informasjon.

Sikkerhet gjennom design og robusthet som et konkurransefortrinn

For at AI skal være en reell forretningsdrivkraft og ikke en konstant kilde til skrekk, må sikkerheten integrere fra dag énDet er ikke nok å bare bygge modellen, sette den i produksjon og så lappe den sammen i en fei.

En moden strategi innebærer validere og beskytte dataene I alle faser, bruk strenge tilgangskontroller, separate utviklings-, test- og produksjonsmiljøer, og signer modellartefakter kryptografisk for å sikre deres integritet gjennom hele livssyklusen.

Det er også nøkkelen til designkapasiteten til automatisert deteksjon og responsNår en modell oppfører seg merkelig, når et API mottar et avvikende forespørselsmønster, eller når en uventet endring oppdages i et datasett, må systemet kunne reagere raskt, isolere komponenter og varsle de aktuelle teamene.

Motstandskraft, forstått som AIs evne til å tåle angrep og gjenopprette uten å miste funksjonalitetDette er i ferd med å bli en viktig tillitsfaktor for ledere. Hvis en organisasjon vet at modellene deres er sikre, observerbare og kompatible, vil den ha mye mer frihet til å innovere og eksperimentere med avanserte brukstilfeller.

I praksis kombinerer mange selskaper spesialiserte cybersikkerhetstjenester med applikasjonsbeskyttelse og trafikkstyringsløsninger som tillater bruk av strategier for dybdeforsvar: avansert trafikkinspeksjon, miljøisolering, begrensning av dataeksponering, modellovervåking og intelligent forespørselsruting basert på kostnad, samsvar og ytelse.

Alt dette eliminerer ikke behovet for menneskelig tilsyn, men det reduserer manuelle og repeterende oppgaver drastisk. AI håndterer varslingssortering, hendelseskorrelasjon og informasjonsoppsummering, mens spesialister fokuserer på å forstå angripernes intensjoner, undersøke komplekse hendelser og utforme mer robuste cyberforsvar.

Til syvende og sist krever bruken av AI i sikkerhet at man antar tre grunnleggende ideer: at AI og sikkerhet må bevege seg fremover sammen.Å beskytte AI innebærer å ivareta data, modeller og grensesnitt (ikke bare infrastruktur), og robustheten som genereres av en godt beskyttet AI, oversettes til en reell konkurransefordel over de som improviserer underveis.

Kunstig intelligens har gått fra å være et marginalt eksperiment til å bli drivkraften bak digital innovasjon i så godt som alle sektorer. Å integrere den i sikkerhet – samtidig som man sikrer tilstrekkelig beskyttelse – gjør det mulig å redusere virkningen av sikkerhetsbrudd, forutse trusler, forbedre kriminalitetsforebygging og frigjøre menneskelige team fra mye av det tunge arbeidet, forutsatt at det opprettholdes en nøye balanse mellom effektivitet, etikk og respekt for menneskerettigheter.

Innholdsfortegnelse

- Det nye trussellandskapet og hvorfor kunstig intelligens er nøkkelen

- Hvordan nettkriminelle bruker kunstig intelligens

- AI-applikasjoner innen cybersikkerhet: fra endepunkt til sky

- Fordeler med AI for sikkerhetsteam

- Autentisering, passord og atferdsanalyse

- Kriminalitetsforebygging og -prediksjon i den fysiske verden

- Risikoer og utfordringer: datasikkerhet, modellsikkerhet og API-sikkerhet

- Kompleksiteten i hybride miljøer og behovet for total synlighet

- Sikkerhet gjennom design og robusthet som et konkurransefortrinn