- Microsoft Fabric sentraliserer data, styring, AI og sanntidsanalyse på OneLake og enhetlige funksjoner.

- Plattformen styrker styring, sikkerhet og kostnader gjennom Purview, OneLake-sikkerhet, DLP, DSPM og integrasjon med Azure Cost Management.

- Data Factory, Dataflow Gen2 og migreringsverktøy gjør det enkelt å flytte eksisterende arbeidsbelastninger og orkestrere komplekse pipelines.

- Copilot, dataagenter, MCP og nye arbeidsbelastninger som Fabric IQ og Real-Time Intelligence driver avanserte AI- og automatiseringsscenarier.

Hvis du har jobbet med data i Microsofts økosystem en stund, har du sikkert lagt merke til at Microsoft Fabric har blitt det sentrale knutepunktet for moderne analyseSamle alt som tidligere var spredt over Power BI, Azure Synapse, Data Factory og andre tjenester til én enkelt plattform. I denne artikkelen skal vi ta en grundig og detaljert titt på de nyeste funksjonene, veikartet og praktiske implikasjoner av Fabric for analyse, styring, AI og sanntidsdatabehandling.

Tanken er at du vil ha en klar forståelse av når du er ferdig med å lese Hva tilbyr Microsoft Fabric i dag, hvor går det, og hvordan påvirker det dataarkitekturen? av organisasjonen din: styringsmuligheter med Purview, automatisering med API-er og Git, nye AI-funksjoner, sanntidsintelligens, sikkerhet i OneLake, migreringer, ytelse og mye mer.

Microsoft Fabric og Cloud Adoption Framework: styring, kostnader og automatisering

Innenfor Cloud Adoption Framework (CAF) har Microsoft publisert en rekke veiledninger for å samkjøre Microsoft Fabric-design med designpilarene til landingssonerDen siste delen av denne serien tar for seg tre nøkkelområder: styring, kapasitetsoptimalisering og automatisering/DevOps.

I styringsdelen, Kostnader for fabrikasjonskapasitet eksponeres gjennom Azure Cost ManagementDette lar deg integrere bruksdata for F-kapasitet (og andre SKU-er) direkte i Azures kostnadsdashboards, varsler og forbruksanalyser. Det handler ikke bare om å se regningen: du kan kryssreferere denne informasjonen med tagger, abonnementer eller ressursgrupper for å forstå hvem som bruker hva og hvorfor.

Fabrics tekniske arkitektur og forretningsmodell gjør det mulig for kunder finjuster kapasitetsforbruket for å optimalisere driftskostnadeneI praksis betyr dette flere grep:

- Skalering av kapasiteter FØk eller reduser kapasiteten basert på forutsigbare topper, for eksempel salgskampanjer, regnskapsfrister eller store databelastninger.

- Pause- og gjenopptaksmuligheterFabric-administratorer kan sette en F-kapasitet på pause når den ikke er nødvendig (for eksempel over natten eller i helger i ikke-kritiske miljøer) for å kutte ned på databehandlingskostnadene.

- OverspenningsvernTo kapasitetsnivåparametere styrer hvordan bakgrunnsjobber administreres for å forhindre at de metter miljøet: Terskel for bakgrunnsavvisning og terskel for bakgrunnsgjenoppretting.

- KapasitetsreservasjonerDet er mulig å reservere kapasitet for definerte perioder for å oppnå rabatter, forutsatt at det forventede forbruket planlegges nøye.

Innen datastyring er Fabric avhengig av Microsoft Purview som den sentrale komponenten for katalogisering, avstamning og klassifiseringFra Purview er det mulig å bruke sensitivitetsetiketter, se avstanden mellom opprinnelse, transformasjoner og forbruk, sertifisere dataressurser eller forbedre datakvalitetskampanjer, alt samtidig som man integrerer elementene i Fabric (Lakehouse, Warehouse, KQL, Power BI, osv.).

Seksjonen «Plattformautomatisering og DevOps» er hovedsakelig strukturert rundt Integrasjon med Git, distribusjonsrørledninger og REST API-erFabric-arbeidsområder kan kobles til Git-repositorier, slik at flere utviklere kan samarbeide om det samme datateknikk-, datavitenskaps- eller sanntidsanalyseprosjektet uten overlappende arbeid.

Git og Deployment Pipelines tillater orkestrere utviklings-, test- og produksjonslivssykluser på en kontrollert måteInnholdspromotering, endringssporing, artefaktsynkronisering og versjonshåndtering. Siden mars 2025 har disse pipelines støttet (generelt eller i forhåndsvisningstilstand) et bredt spekter av elementtyper som triggere, dashbord, dataflyter, datapipelines, datamarts, lakehouses, lager, KQL, notatbøker, paginerte rapporter, organisasjonsapplikasjoner osv.

I mellomtiden avslører Fabric et veldig bredt sett med REST API-er som kan automatisere nesten alle administrative eller distribusjonsoppgaver: oppretting av arbeidsområder og mapper, massemigrering av elementer, administrasjon av tilkoblinger og gatewayer, uttrekking av definisjoner, aktivering av pipelines eller notatbøker, blant annet.

Viktige oppdateringer innen analyse, AI og styring for Microsoft Fabric

Utviklingen av Fabric er preget av et stort antall forhåndsvisningsfunksjoner og nye muligheter som De berører praktisk talt alle områder av plattformenDeretter grupperes og diskuteres de på en strukturert måte, slik at hele omfanget kan sees.

AI-funksjoner i datalager og multimodale funksjoner

Innen relasjonsdata inkluderer Fabric Data Warehouse AI fungerer direkte i T-SQL (forhåndsvisning). Dette tillater:

- Klassifiser eller kategoriser tekst.

- Analyser følelser.

- Hent ut strukturert informasjon fra fritekst.

- Oversett tekst mellom språk.

- Korrekt grammatikk.

Målet er at Det er ikke nødvendig å forlate SQL-konteksten for å berike data med AIDisse funksjonene er kombinert med mer generell multimodal støtte i Fabrics AI-funksjoner, som nå kan behandle bilder (JPG/JPEG, PNG, GIF, WebP), PDF-er og vanlige tekstformater, samt inndata i form av filstier.

Verktøy som aifunc.load for å innta mapper i tabeller Med prompt- og schema-alternativer lar `aifunc.list_file_paths` deg iterere gjennom filstier, og `ai.infer_schema` utleder skjemaer som er kompatible med `ai.extract`. Alt dette lar deg transformere og berike data uten å bygge komplekse pipelines fra bunnen av.

OneLake, Delta, Apache Iceberg og tilgang til flere plattformer

På lagringslaget forblir OneLake den enhetlige innsjøen der hele Fabric befinner seg. En av de største forbedringene er muligheten til å Vise Delta Lake-tabeller som Apache Iceberg-tabeller uten å flytte eller duplisere data, slik at Iceberg-kompatible søkemotorer direkte kan lese hva som er på OneLake.

I tillegg støtter OneLake nå Apache Iceberg-data skrevet direkte av Snowflake, konsumert i Fabric via kopifri tilgangDenne strategien forsterker interoperabiliteten: Fabric ønsker ikke å være en silo, men et data-"knutepunkt" som andre motorer kan utnytte uten å duplisere lagring.

I samme trekk innrømmer OneLake snarveier til Azure Blob StorageOneDrive og SharePoint, og utvider sikkerheten med tilgangsroller, sikkerhet på mappe-, rad- og kolonnenivå, og en sikkerhetsmodell som tredjeparter kan respektere takket være utvidelsen av den autoriserte motormodellen.

Et spesielt relevant punkt er sammenslåingen av OneLake-katalogen i Azure Databricks, som muliggjør Nullkopitilgang fra Unity Catalog til OneLake-tabellerPå denne måten forblir OneLake kilden til sannheten, men Databricks kan spørre dataene direkte og synkronisere bare metadataene.

SQL Database on Fabric: ytelse, sikkerhet og virtualisering

Fabrics SQL-database får sine egne funksjoner: ENDRE DATABASESETT-alternativerStøtte for sortering og fulltekstindeksering i forhåndsvisning. På nivå med databaseytelse Og når det gjelder kostnader, er det flere forbedringer:

- Automatisk indekskomprimering for å redusere lagring, I/O og forbedre spørretider uten å måtte planlegge vedlikeholdsjobber.

- Maksimal grense for virtuelle kjerner for å kontrollere bruken av dataressurser (4 eller 32 virtuelle kjerner), utformet for å forhindre at en arbeidsmengde bruker for mye på delt kapasitet.

- Tilpassede SQL-pooler som gir arbeidsområdeadministratorer detaljert kontroll over ressursallokering og spørringsruting etter applikasjonsnavn.

Den er også aktivert Datavirtualisering i SQL-database, som tillater spørring av eksterne data lagret i OneLake med T-SQL, og sammenføyning av filer i vanlige formater med lokale relasjonstabeller ved hjelp av sammenføyninger, uten å måtte importere dataene fysisk.

Når det gjelder sikkerhet, støtter SQL-databasen Privat lenke på leietakernivå (forhåndsversjon)Dette gjør det enklere å kanalisere datatrafikk på en privat og kontrollert måte, og integrere med Fabrics overordnede sikre nettverkskonfigurasjon.

Sanntidsintelligens, Eventhouse, Eventstream og Activator

Real-Time Intelligence (RTI)-modulen har blitt en av Fabrics viktigste differensieringsfaktorer. Eventhouse og Eventstream kombineres for å innta, behandle og utløse sanntidshendelser fra alle slags kilder, og Activator orkestrerer handlingene som utløses under visse forhold.

Blant de kraftigste nye funksjonene er:

- Anomalideteksjon uten kode med automatisk modellvalg, enkelt grensesnitt og fleksible varsler.

- Forretningsarrangementer, som fanger opp viktige forretningsøyeblikk generert fra brukerdatafunksjoner og notatbøker, og lar deg aktivere varsler, tilpasset logikk, flyter, AI-modeller eller Spark-jobber.

- Integrasjon av aktivator-brukerdatafunksjonerslik at funksjoner opprettet i Fabric kan behandle hendelser fra enhver kilde, inkludert interne hendelser fra selve plattformen og fra OneLake.

- Mulighet til å behandle hendelser med SQL (SQL-operator i Eventstream), som tillater transformasjon av sanntidsflyter med kjent SQL-syntaks.

Relevante kontakter legges til, som f.eks. Cribl (for logg- og telemetriinntak fra flere kilder), en kobling med Solace PubSub+ og strømmestøtte over private nettverk via Azure Virtual Network, VPN, ExpressRoute eller private endepunkter.

For dataskjemaer og kontrakter introduserer Eventstream en Skjemaregister som definerer og validerer hendelsesskjemaer for mer robuste pipelines, og støtte for Confluent Schema Registry for å koble til Kafka i Confluent Cloud samtidig som eksisterende kontrakter respekteres.

Copilot- og AI-funksjoner på tvers av plattformen

Copilot i Fabric er nå tilgjengelig globalt, med en tilstedeværelse i Power BI, Data Factory, datavitenskap og datautvikling og skriving av KQL-spørringerI tillegg er det innlemmet spesifikke funksjoner:

- Copilot for Dataflow Gen2 (Modern Get Data), som bidrar til å innta og transformere data med instruksjoner på naturlig språk.

- Copilot for datalager (chat), tilgjengelig fra en knapp på båndet for å akselerere lageroppgaver via dialog.

- Copilot for SQL-analyseendepunkt, som genererer og optimaliserer SQL-spørringer fra forretningsbeskrivelser.

- Copilot på bærbare datamaskiner med kunnskap om arbeidsområdekontekst, Lakehouse, notatbokstruktur og utførelsesmiljø, i stand til å generere flertrinnskode, refaktorere, oppsummere komplekse notatbøker og diagnostisere feil med alternativet «Fiks med Copilot».

- Innebygd autofullføring (innebygd kodefullføring) og innebygd kodefullføring i Notebook Copilot (forhåndsvisning), for å skrive Python raskere og med færre feil.

Videre utvides AI-teknologibasen med integrerte forhåndsbygde støperiverktøy (Azure OpenAI, Azure Language, Azure Translator), OpenAI-pluginer for Eventhouse (ai_embed_text og ai_chat_completion) og en serie agenter og dataagenter som lar andre applikasjoner, inkludert Copilot Studio, jobbe med Fabric-data på en orkestrert måte.

Fabric Data Agents, MCP og utviklerverktøy

Stoff introduksjon Dataagenter som er i stand til å orkestrere tilgang til data og verktøy For AI-agenter, med en Python SDK og direkte integrasjon med Microsoft Copilot Studio. Dette gjør det enkelt å bygge samtaleassistenter som fungerer med styrte bedriftsdata i Fabric.

Parallelt er det Model Context Protocol (MCP) Det blir en nøkkelkomponent i integrasjonen mellom AI-agenter og Fabric-tjenester. Det finnes dedikerte MCP-servere for Activator og Eventhouse, og en utviklingsorientert Fabric MCP som:

- Det lar AI-assistenter generere kode og innhold for Fabric-elementer.

- Den integreres med utviklingsverktøy som VS Code og GitHub Codespaces.

- Den presenterer verktøy for konsultasjon og handling basert på sanntidsdata i Eventhouse.

For utviklerens daglige arbeid er det flere viktige deler å fremheve, inkludert utviklingsmiljø: MSSQL-utvidelse for VS Code med støtte for Fabric SQL-database, Microsoft ADO.NET-driveren og ODBC-driveren for Fabric Data Engineering (tilkobling til Spark SQL via Livy), og en Spark-kobling for SQL-databaser som forenkler autentisert tilgang fra Spark til SQL-databaser i Azure og Fabric.

Dukker også opp Stoff CLI, tilgjengelig som en integrert oppgave i Azure DevOps, som lar deg automatisere administrasjonen av arbeidsområder, elementer og distribusjoner uten å måtte installere eksterne verktøy manuelt.

Data Factory, datamigreringer og orkestrering i Fabric

Fabrics dataintegrasjonslag er avhengig av Data Factory og Dataflow Gen2, som mottar funksjoner for å... Orkestreringen vil bli smartere, mer automatiserbar og med enklere migreringer. fra eksisterende plattformer.

Dataflow Gen2: ytelse, offentlige API-er og diagnostikk

I Dataflow Gen2 finner vi flere funksjoner i forhåndsvisning:

- Avansert redigering av målspørringer å justere logikken på destinasjonen direkte fra selve redigeringsmiljøet.

- Partisjonert beregningsom tillater at deler av dataflyten kjører parallelt, noe som reduserer den totale evalueringstiden.

- Last ned diagnostikk på utførelsesnivå, med strukturerte loggpakker for ytelsesanalyse og hendelsesløsning.

- Offentlige APIer for programmatisk oppretting, oppdatering, sletting, planlegging og overvåking av dataflyter.

- Offentlige parametere med CI/CD-støttesom tillater oppdatering av dataflyter ved å sende verdier fra pipelines eller andre kilder.

- Nylige data for rask tilgang til nylig brukte elementer i Power Query-båndet og i Moderne Hent data.

Alt dette suppleres av kapasiteter fra Evaluer Power Query programmatisk via RESTDette åpner døren for å kjøre M-skript som en del av automatiserte prosesser, integrere dem med Spark, pipelines eller eksterne verktøy, og dra nytte av Power Query-koblinger.

Data Factory: adaptiv ytelse, tilkobling og dbt

I den mer «klassiske» delen av integrasjonen introduserer Data Factory i Fabric:

- Adaptiv ytelsestuning for kopieringsaktivitet, som intelligent justerer ytelsesparametere i henhold til konfigurasjon og utførelseskontekst.

- Endre støtte for datafangst (CDC) i kopieringsjobben, for å bare replikere endringer (innsettinger, oppdateringer, slettinger) kontinuerlig.

- Lokale gatewayer med manuell oppgraderingsmulighet administrert fra Fabric-portalen, API-et eller skript.

- nylig forbindelse, som legger til egenskaper for siste bruk i tilkoblinger for å forenkle revisjon og livssyklusadministrasjon.

- innfødt dbt-jobb, som tillater kjøring av dbt-prosjekter i Fabric med integrert orkestrering, testing, dokumentasjon og styring.

- Aktivitet for å kalle på SSIS-pakke i pipelines, for å kjøre SSIS-pakker fra selve orkestreringen i Fabric.

Brukeropplevelsen er også forbedret med en SharePoint-nettstedsvelger (SharePoint Site Picker) som unngår å skrive URL-er for hånd, og med MCP-støtte for Data Factory, slik at AI-assistenter kan opprette og distribuere Dataflow Gen2 enkelt fra instruksjoner på naturlig språk.

Verktøy for datamigrering og replikering

Microsoft promoterer sterkt migreringen til Fabric gjennom flere spesifikke verktøy:

- Vurdering av stoffmigrering for datafabrikk, som analyserer forberedelsen av ADF-pipelines og migrerer de støttede til et Fabric-arbeidsområde med tilkoblingskartlegging.

- Migreringsassistent for datalagersom nå kan kobles direkte til kildelageret for å flytte det til Fabric Data Warehouse.

- Migreringsassistent for SQL-database, med sikte på å migrere lokale SQL Server-arbeidsbelastninger, med skjemaimport via DACPAC, inkompatibilitetsdeteksjon og anbefalinger.

Når det gjelder replikering, gis det støtte til speiling av flere driftskilder (Azure Database for MySQL, Google BigQuery, SQL Server osv.) til Fabric, med muligheten til å kontrollere hvilke tabeller som replikeres, starte speilingsprosesser på nytt via REST og, i tilfelle Databricks, tilordne Unity Catalog-policyer til OneLake-sikkerhet.

Det er også inkludert en replikasjonskobling fra Lakehouse som bruker Delta Change-datafeed, som eksponerer endringer på Lakehouse Delta-kort mot kompatible destinasjoner uten å måtte oppfinne hjulet på nytt med CDCs hjemmelagde løsninger.

Sikkerhet, avansert styring og overvåking i Fabric

En av de største bekymringene i enhver analyseplattform er hvordan sikre data, styre bruk og overvåke ressursforbrukStoff modnes raskt på disse frontene.

Sikkerhet og databeskyttelse hos OneLake

OneLake legger til en komplett modell av sikkerhet for datatilgang med:

- Datatilgangsroller for Lakehouse med konfigurerbare tillatelser fra et mappebasert sikkerhetsgrensesnitt.

- Sikkerhetsstøtte for snarveier slik at tredjeparter kan respektere de definerte retningslinjene.

- OneLake API for datatilgangssikkerhet, som muliggjør automatisert tillatelsesadministrasjon.

- Utvidelse av modellen til eksterne motorer (OneLake-sikkerhetsautorisasjon for tredjeparter).

Parallelt utvides beskyttelsen med DLP begrenser tilgang over alle strukturerte data i OneLake (SQL, KQL, varehus) og introduseres DSPM for AI for Fabric Copilots og dataagenter, som overvåker AI-interaksjoner for sensitiv informasjon og risikabel atferd, med integrasjon med Purview Audit og eDiscovery.

Når det gjelder identitet, fremstår kjennetegn som følgende: identiteter knyttet til elementer (for eksempel Lakehouse og Eventstream) via REST API-er, som eliminerer eieravhengigheten for visse operasjoner, og autentisering av OneDrive- og SharePoint-snarveier ved hjelp av arbeidsområdeidentiteter eller tjenesteprinsipper.

Sentralisert styring og OneLake-katalog

Erfaringen med datastyring forsterkes av en nytt sentralisert panel i OneLake-katalogender dataeiere kan se en samlet oversikt over elementene de har opprettet, motta anbefalinger for styringstiltak og få tilgang til alle tilgjengelige verktøy for å forbedre sikkerhet og samsvar.

I tillegg en OneLake Catalog Search API sammen med et MCP-verktøy, som tillater å oppdage elementer i hele Fabric-miljøet fra kode eller AI-agenter, i et enkelt kall, med respekt for katalogtillatelser og metadata.

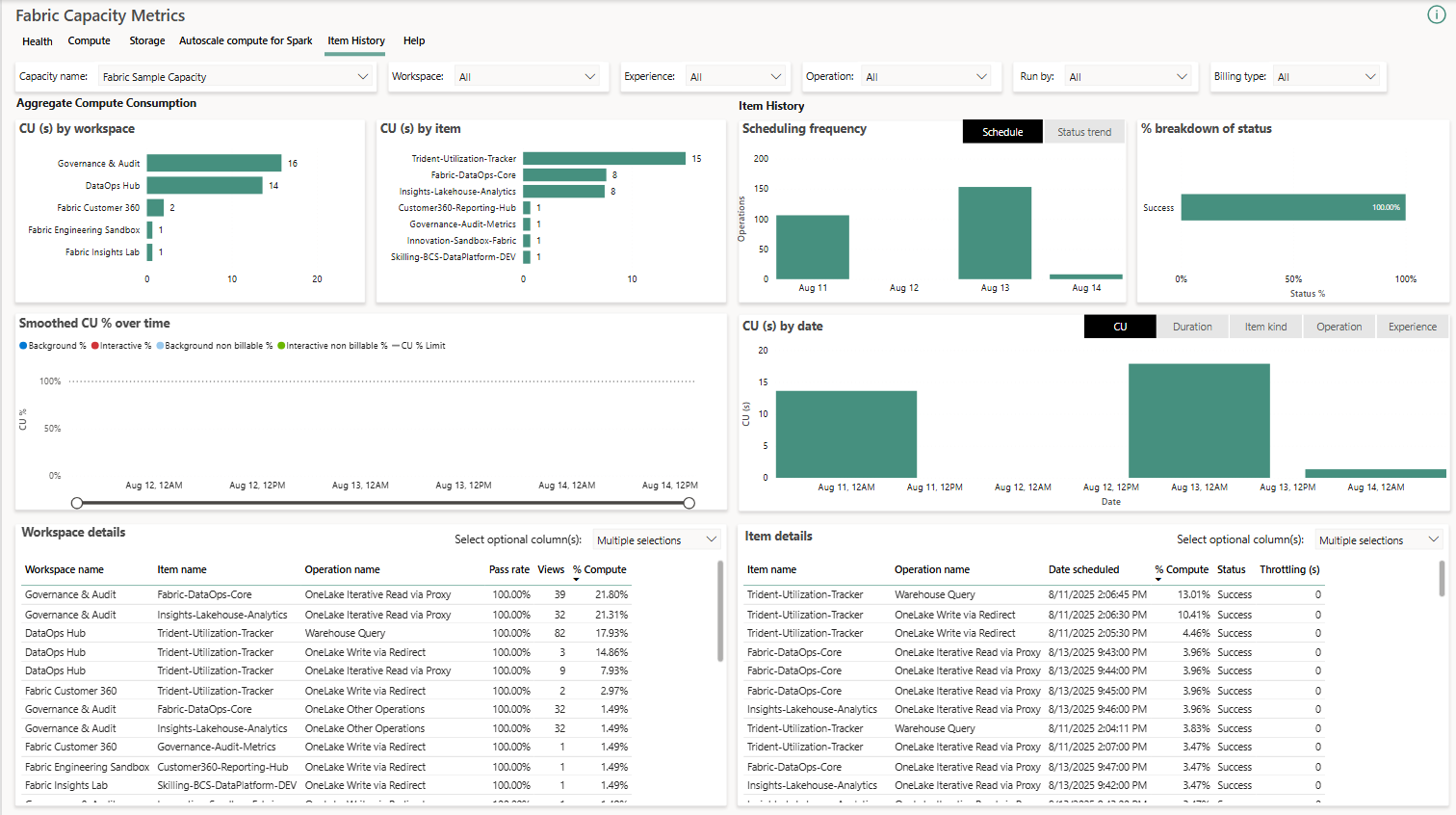

Overvåking av kapasitet, forbruk og arbeid

Stoff gir flere lag med observerbarhet:

- Overvåking av arbeidsplass, som oppretter en database i Fabric der logger og målinger fra flere elementer konsolideres (inkludert kopieringsjobber med detaljert overvåking).

- Arbeidsområdeovervåking for kopieringsjobbmed målinger som gjennomstrømning, datavolum, feilkoder og tider, alt rettet mot sentralisert analyse.

- Varehistorikk i bruken av kapasitetsmålinger, med 30-dagers visninger av CU-forbruk for hvert element, filtrerbart etter arbeidsområde og type.

- Overspenningsvern på arbeidsplassnivåsom tillater å sette forbruksterskler per arbeidsområde i et 24-timers rullerende vindu, automatisk blokkere de som overskrider dem, og merke arbeidsområder som "virksomhetskritiske" for å ekskludere dem fra begrensninger.

Som et supplement til dette, et innledende sett med API-er for administrasjon av stoff fokusert på å oppdage arbeidsområder, elementer og brukertilgangsdetaljer, legge til rette for dynamiske varelager og periodiske tilgangskontroller.

Forretningsmodellering, planlegging og nye arbeidsmengder

Utover det tekniske laget introduserer Microsoft nye forretningsorienterte arbeidsbelastninger om Fabric. En av de mest fremtredende er Fabric IQ, som søker å forene forretningssemantikk, data og modeller for intelligente agenter som tar beslutninger basert på et helhetlig syn på organisasjonen.

Innenfor Fabric IQ finner du:

- Ontologi (forhåndsvisning), en type element der enheter, relasjoner, egenskaper og begrensninger er definert i henhold til selskapets forretningsspråk.

- Plan (forhåndsvisning), en plattform uten kode for planlegging, rapportering, analyse, integrasjon og samarbeidende administrasjon.

Sanntidsintelligens dukker også opp digital tvillingbygger, et produkt spesialisert på modellering av digitale tvillinger basert på sanntidsdata, med sikte på å optimalisere fysiske operasjoner, overvåke tilstander og simulere scenarier.

På den annen side er det introdusert Fabric IQ-arbeidsmengde som en separat arbeidsmengde, og støtteverktøy for styring og semantisk justering fortsetter å utvides, noe som lukker sirkelen mellom datamodeller, forretningslogikk og AI/analyseapplikasjoner.

Forbedringer av ytelse, brukeropplevelse og produktivitet

For å avslutte denne gjennomgangen er det verdt å fremheve en rekke tverrgående forbedringer som De havner ikke alltid i overskriftene, men de påvirker hverdagen i stor grad. av lagene.

I delen om Spark og distribuert databehandling introduserer Fabric:

- Fabric Runtime 2.0 (forhåndsversjon) med Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 og Python 3.12 på Azure Linux 3.0.

- Spark-appsammenligningsverktøysom lar deg velge og sammenligne opptil fire Spark-kjøringer parallelt.

- Gnistdiagnostisk sender, som samler inn logger, målinger og hendelser fra Spark-applikasjoner og sender dem til destinasjoner som Event Hubs, lagring eller Log Analytics.

- JobInsight-diagnostikkbibliotek, et bibliotek for å analysere fullførte Spark-kjøringer via API-er (spørringer, jobber, faser, oppgaver, kjørere, hendelseslogger).

I lagerlaget legges følgende til: dataklynging For å forbedre ytelsen og redusere tilgangskostnader, IDENTITY-kolonner for surrogatnøkler, og versjonskontroll og CI/CD-støtte gjennom SQL Database-prosjekter i VS Code (Warehouse source control).

Brukeropplevelsen til Fabric-portalen utvikler seg også med Fanebasert nettlesing og objektutforskerDette lar deg åpne flere elementer samtidig og raskt bytte mellom dem. Dette, kombinert med forbedringer som Lakehouse auto-binding i Git og verktøypakken for Lakehouse-vedlikehold (vedlikeholdsaktiviteter og oppdatering av SQL-endepunkter), bidrar til en mer brukervennlig og smidig plattform.

Til slutt, funksjoner som Masseimport/eksport av varedefinisjoner (for migreringer, maler og sikkerhetskopier av metadata), REST for mapper, parameterstøtte i elementaktiveringer fra Activator og OneLake-datainnlasting i Excel med integrert katalog, fullfører et økosystem som begynner å dekke så godt som alle vanlige behov til et moderne datateam.

Med hele dette settet med funksjoner – fra sentralisert styring, detaljert sikkerhet og intelligent orkestrering, til AI innebygd i SQL, sanntidsanalyse, digitale tvillinger og MCP-agenter – befester Microsoft Fabric sin posisjon som en komplett dataplattform der Nøkkelen er ikke lenger bare å lagre og visualisere data, men å styre, automatisere og utnytte AI til å kontrollere alle deler av datalivssyklusen.slik at organisasjoner kan utvikle arkitekturene sine gradvis, migrere det de allerede har og muliggjøre nye løsninger mye raskere enn med tradisjonelle tilnærminger.

Innholdsfortegnelse

- Microsoft Fabric og Cloud Adoption Framework: styring, kostnader og automatisering

- Viktige oppdateringer innen analyse, AI og styring for Microsoft Fabric

- AI-funksjoner i datalager og multimodale funksjoner

- OneLake, Delta, Apache Iceberg og tilgang til flere plattformer

- SQL Database on Fabric: ytelse, sikkerhet og virtualisering

- Sanntidsintelligens, Eventhouse, Eventstream og Activator

- Copilot- og AI-funksjoner på tvers av plattformen

- Fabric Data Agents, MCP og utviklerverktøy

- Data Factory, datamigreringer og orkestrering i Fabric

- Sikkerhet, avansert styring og overvåking i Fabric

- Forretningsmodellering, planlegging og nye arbeidsmengder

- Forbedringer av ytelse, brukeropplevelse og produktivitet