- Moderne AI er basert på optimaliseringsalgoritmer som automatiserer oppgaver, analyserer store datamengder og muliggjør nye forretningsmodeller.

- De viktigste risikoene inkluderer algoritmisk skjevhet, tap av jobb, brudd på personvernet, informasjonsmanipulering og mer sofistikerte cyberangrep.

- Generativ AI medfører spesifikke utfordringer: hallusinasjoner, dypfalsk, teknologisk avhengighet, økende kostnader og problemer med immaterielle rettigheter og omdømme.

- Sterk styring, tydelige regulatoriske rammeverk og bruk av AI for å håndtere risikoer er nøkkelen til å utnytte potensialet uten å miste kontrollen over dens innvirkning.

La kombinerer kunstig intelligens med alle aspekter av livene våre Det skjer mye raskere enn de fleste organisasjoner og enkeltpersoner kunne ha forestilt seg. Fra de første anbefalingsalgoritmene har vi på rekordtid gått over til generative modeller som er i stand til å skrive rapporter, analysere kontrakter, lage hyperrealistiske bilder og ta automatiserte beslutninger i kritiske forretningsprosesser.

Denne akselererte ekspansjonen åpner for et enormt spekter av muligheter, men også Det medfører risikoer, etiske dilemmaer og regulatoriske utfordringer. Dette er problemstillinger som ikke kan ignoreres. Det handler ikke om å velge mellom en apokalyptisk visjon eller naiv teknooptimisme, men om å rolig forstå hva dagens kunstige intelligens faktisk gjør, hva den ikke gjør, hvor den tilfører mest verdi, og hvor den kan bli et alvorlig problem hvis den ikke håndteres klokt.

Hva forstår vi i dag med kunstig intelligens?

Når vi snakker om AI i hverdagen, refererer vi faktisk til et sett med optimaliseringsalgoritmer og statistiske modeller trent på store datamengderDe er ikke bevisste maskiner eller «hjerner» som tenker som en person, men systemer som lærer mønstre og genererer resultater som er nyttige (eller plausible) for svært spesifikke oppgaver.

I næringslivet har AI blitt populært fordi Det lar deg automatisere rutineoppgaver, analysere enorme databaser og støtte beslutningstaking. med en presisjon og hastighet som er uoppnåelig for et menneskelig team. Fra assistert medisinsk diagnose til tidlig oppdagelse av økonomisk svindel, mangedobles brukstilfellene på tvers av alle sektorer.

Det er imidlertid viktig å skille mellom de såkalte Begrenset kunstig intelligens (den som løser spesifikke problemer: klassifisering av bilder, oversettelse av tekster, anbefaling av innhold…) og den hypotetiske Generell kunstig intelligenssom ville strebe etter å resonnere om enhver oppgave som et menneske. For tiden bruker vi i stor skala begrensede systemer, uansett hvor imponerende modeller som ChatGPT, Bard eller DALL-E kan virke.

Disse modellene, spesielt språkmodeller, er utformet for å beregn det mest sannsynlige og sosialt akseptable svaret Gitt en input, ikke for å forstå verden eller ha sine egne mål. De etterligner resonnement, men under panseret er det sofistikert statistisk beregning, ikke bevissthet eller intensjon.

Hvordan AI fungerer: viktige teknikker

De fleste moderne AI-applikasjoner er avhengige av tre viktige teknologiske byggesteiner: maskinlæring, dyp læring og naturlig språkbehandlingsom det er lagt til datasyn for alt relatert til bilder og video.

Maskinlæring eller automatisk læring

Maskinlæring (ML) er grenen som fokuserer på bygge algoritmer som er i stand til å lære fra datauten å måtte programmere hver regel eksplisitt. Systemet finner mønstre og lager prediksjoner, klassifiseringer eller anbefalinger basert på dem.

I veiledet læring trenes modeller med merkede data som indikerer det riktige svaret (for eksempel om en transaksjon var svindel eller ikke). I uovervåket læring, derimot, oppdager algoritmen skjulte strukturer og grupper i umerkede data, noe som er veldig nyttig for segmentere kunder, oppdage avvik eller gruppere atferd.

Et typisk eksempel i bransjen er bruken av ML til analyser sanntidsdata fra fabrikksensorer (temperatur, vibrasjoner, brukssykluser) og forutse når en maskin kommer til å svikte, og dermed muliggjøre prediktivt vedlikehold.

Dyp læring

Dyp læring er en delmengde av maskinlæring som bruker flerlags kunstige nevrale nettverk å lære stadig mer komplekse representasjoner av data. Disse nettverkene er inspirert av hjernens struktur, selv om deres faktiske funksjon avviker betydelig fra biologien.

Takket være dyp læring, applikasjoner som stemmegjenkjenning, avansert datasyn, anbefalingssystemer eller autonom kjøringMed tilgang til enorme datasett og datakraft kan disse nettverkene oppdage svært subtile sammenhenger som tidligere var umulige å modellere.

I sektorer som bilindustrien brukes for eksempel dyp læring til å tolke kamerabilder og radar- og lidardata av et autonomt kjøretøy, estimere avstander, forutsi baner og bestemme manøvrer nesten umiddelbart.

Naturlig språkbehandling

Naturlig språkbehandling (NLP) handler om å gjøre det mulig for systemer å å forstå, analysere og generere menneskelig språkbåde tekst og tale. Dette inkluderer oppgaver som å klassifisere dokumenter, oppsummere tekster, oversette, svare på spørsmål eller holde samtaler.

Nåværende store språkmodeller (LLM-er) er i stand til å oppdage syntaktiske strukturer og semantiske nyanser i store tekstmengderDette gjør at de kan produsere overraskende naturlige svar. De brukes i chatboter, virtuelle assistenter, sentimentanalyse, kundeservice og intern support i bedrifter.

datamaskin syn

Maskinvisjon fokuserer på å muliggjøre maskiner tolke bilder og videoer med et detaljnivå som ligner på en personsÅ oppdage objekter, gjenkjenne ansikter, lese tegn, måle dimensjoner eller identifisere defekter i en industriell del er noen eksempler.

Denne teknologien har blitt en nøkkelkomponent i kvalitetskontroll i fabrikker, overvåkingssystemer, medisinsk bildediagnostikk og utvidet virkelighetsopplevelser, blant mange andre bruksområder.

Fordeler og muligheter med AI

På et økonomisk og sosialt nivå åpner AI døren for en ny bølge av innovasjon innen produkter, tjenester og forretningsmodellerI Europa, for eksempel, anses det som en viktig drivkraft for transformasjonen av sektorer som den grønne økonomien, industriell teknologilandbruk, helse, turisme eller mote.

I næringslivet er en av AIs største styrker... automatisering av repeterende prosesser og kjedelige oppgaverFysiske roboter og intelligent programvare kan håndtere mekaniske operasjoner, hendelsesklassifisering, generering av standardresponser eller datautvinning, noe som frigjør folks tid til kreative og strategiske oppgaver.

En annen viktig fordel er muligheten til å redusere menneskelige feil i aktiviteter med mye repetisjon eller høy presisjonFra å oppdage mikrofeil i deler ved hjelp av infrarøde kameraer til automatisk datainntasting, minimerer AI feil og forbedrer sporbarheten av hva som skjer.

Samtidig bidrar intelligente systemer bemerkelsesverdig nøyaktighet i analysen av store mengder informasjonDette genererer nyttige indikatorer for å bestemme investeringer, justere priser, bemanne eller omstrukturere prosesser. Denne analytiske evnen styrker kvaliteten på forretningsbeslutninger.

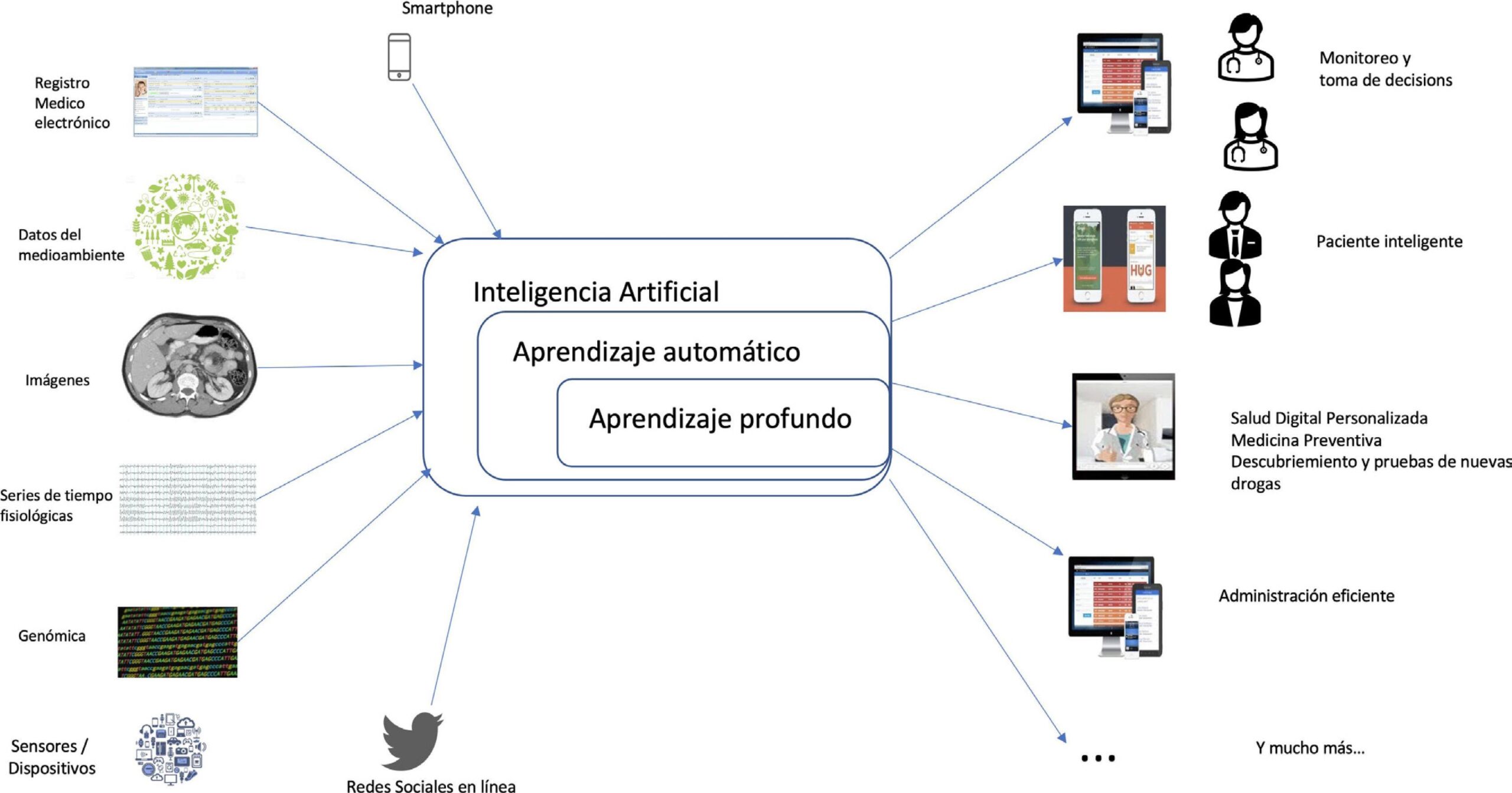

Innen helsevesenet brukes kunstig intelligens allerede til å støtte diagnoser basert på medisinske bilder, designe personlige behandlinger og akselerere legemiddelutviklingInnen bank og finans bidrar det til å oppdage svindel, vurdere kredittrisikoer og automatisere operasjoner i aksjemarkedene.

Offentlige tjenester drar også nytte av: Transportoptimalisering, intelligent avfallshåndtering, energisparing, personlig tilpasset utdanning eller mer effektiv e-forvaltning Dette er klare anvendelsesområder. Samtidig peker analytikere på at ansvarlig bruk av kunstig intelligens kan bidra til å styrke demokratiet ved å bekjempe desinformasjon, oppdage cyberangrep og forbedre åpenheten i anskaffelsesprosesser.

Generativ AI: et nytt sprang i kapasiteter … og i risikoer

Fremveksten av generativ AI har markert et vendepunkt, ettersom disse systemene er i stand til lage originalt og troverdig innholdTekniske tekster, bilder, lyd, video eller kode, og praktiske eksempler som Slik lager du WhatsApp-klistremerker med ChatGPT.

For bedrifter åpner dette opp for muligheten til å produsere dokumenter, markedsføringskampanjer, rapporter eller prototyper mye raskeresamt støtte team med produktivitetskoordinatorer. Det byr imidlertid også på ytterligere utfordringer når det gjelder kvalitet, immaterielle rettigheter, sikkerhet og omdømme.

Blant de mest synlige risikoene er genereringen av feil informasjon eller «hallusinasjoner»Modellen fabrikkerer data eller referanser som virker overbevisende, men som ikke samsvarer med virkeligheten. Hvis dette ikke gjennomgås på riktig måte, kan det føre til feilaktige beslutninger, spesielt på kritiske områder som helsevesen, jus eller finans.

I tillegg til dette kommer spørsmålet om informasjonssikkerhet og personvernHvis en modell mates med sensitive data (kunder, pasienter, forretningsstrategi) uten nødvendige sikkerhetstiltak, er det risiko for lekkasjer, manglende overholdelse av regelverk eller feilaktig gjenbruk av denne informasjonen.

Videre kan generativ AI fremme en overdreven teknologisk avhengighet, med økende kostnader forbundet med bruk av store modeller, og kan i overkant homogenisere innhold og forslag, noe som reduserer differensiering for merkevarer hvis de alle bruker de samme verktøyene uten å tilpasse dem.

Tverrgående risikoer ved kunstig intelligens

Utover det generative aspektet, bringer den massive utrullingen av AI med seg et sett med Strukturelle risikoer som påvirker sysselsetting, grunnleggende rettigheter, sikkerhet og økonomisk stabilitetÅ forstå dem er viktig for å kunne håndtere dem.

Jobbforskyvning og kompetansegap

AI-drevet automatisering har en tvetydig effekt på sysselsettingen: Det eliminerer visse stillinger, forvandler andre og skaper nye yrker.Administrative oppgaver, svært rutinepreget kontorarbeid eller grunnleggende kontrolloppgaver er spesielt sårbare.

Uten en klar politikk for faglig omskolering og kompetanseoppdateringMange mennesker kan bli hengende etter på arbeidsmarkedet, noe som øker eksisterende ulikheter. I et planlagt økonomisk system kunne denne overgangen vært bedre organisert; i dagens kapitalisme fører det vanligvis til ustabilitet og usikkerhet mens produksjonsstrukturen justeres.

Algoritmiske skjevheter og diskriminering

Algoritmer lærer av historiske data som ofte De gjenspeiler eksisterende fordommer, ulikheter og maktstrukturerHvis disse skjevhetene ikke korrigeres, reproduserer og forsterker systemene dem i ansettelsesprosesser, lånegodkjenninger, forsikringshåndtering eller til og med i rettssystemet.

Vi kjenner allerede til tilfeller av modeller for personalutvelgelse som De straffet kvinner systematisk fordi de hadde blitt trent ved hjelp av hovedsakelig mannlige maler, eller rasistisk partiske verktøy for vurdering av kriminell risiko. Å redusere denne risikoen krever uavhengige revisjoner, mangfoldige utviklingsteam og balanserte og gjennomgåtte opplæringsdata.

Personvern, overvåking og grunnleggende rettigheter

AI fungerer bedre jo mer data den har, noe som gir insentiver til en masseinnsamling av personopplysningerAnsiktsgjenkjenningssystemer, sporing på nett, oppretting av detaljerte atferdsprofiler eller analyse av sosiale medier kan krenke personvernet og i gale hender bli overvåkingsverktøy.

Europeisk lovgivning (inkludert den kommende AI-loven) fokuserer på å begrense høyrisikobruk, som for eksempel massebiometrisk identifikasjon eller automatisert beslutningstaking uten mulighet for menneskelig inngripenLikevel er faren for overgrep fortsatt til stede, spesielt i sammenhenger med mindre demokratisk tilsyn.

Sikkerhet, cyberangrep og ondsinnet bruk

AI er et tveegget sverd: den kan gjøre mye for å for å bedre forebygge, oppdage og reagere på cybersikkerhetstruslerDet kan også forbedre angripernes muligheter. Noen av risikoene er å automatisere phishing-kampanjer, generere mer sofistikert skadelig programvare eller omgå deteksjonssystemer ved hjelp av fiendtlige eksempler.

Innen militær og nasjonal sikkerhetssfære, virkningen av autonome våpen, automatiserte forsvarssystemer og AI-støttet cyberkrigføringDet internasjonale samfunnet er fortsatt langt fra en robust enighet om de etiske og juridiske grensene for disse bruksområdene.

Informasjonsmanipulasjon og dypforfalskninger

Med generativ AI er det relativt enkelt å lage falske, men svært troverdige videoer, lyd og bilderDisse er kjent som deepfakes. Disse kan brukes til utpressing, politisk manipulasjon, omdømmeangrep eller massedesinformasjonskampanjer.

Samtidig kan algoritmer som tilpasser innhold på sosiale medier å lukke brukere inn i ekkokamreDette forsterker ekstreme synspunkter og polariserer den offentlige sfæren ytterligere. AI blir dermed en forsterker av eksisterende dynamikk, med en rekkevidde som er vanskelig å kontrollere.

Uforutsigbarhet og kompleksitet i systemer

Etter hvert som modellene blir mer komplekse og autonome, Oppførselen deres blir mindre og mindre gjennomsiktig, selv for skaperne deres.Dette gjør det vanskelig å forklare hvorfor en bestemt beslutning er tatt, noe som er kritisk i regulerte områder.

Hvis viktige funksjoner (helsevesen, infrastruktur, justis, transport) delegeres til ugjennomsiktige systemer, øker risikoen for systemiske feil, kaskadeeffekter og tap av menneskelig kontrollDerfor er det viktig å designe forklarbare modeller, med sporbarhet og kapasitet for manuell inngripen.

Etiske, regulatoriske og ansvarsmessige utfordringer

Fremveksten av AI har reist komplekse problemstillinger: Hvem er ansvarlig hvis en algoritme forårsaker skade? Hvordan garanteres rettferdighet og åpenhet? Hvilke grenser bør settes? Tradisjonelle regelverk henger etter innovasjonstakten, og dette skaper juridiske smutthull.

Den europeiske union fremmer en AI-lov som klassifiserer applikasjoner etter risikonivåer og etablerer strengere krav for sektorer med høy innvirkning (helse, transport, sysselsetting, justis, sikkerhet). Det er forutsett forpliktelser angående dokumentasjon, revisjon, håndtering av opplæringsdata og menneskelig tilsyn.

Et spesielt delikat spørsmål er ansvar i tilfelle skaderHvis en selvkjørende bil forårsaker en ulykke, eller et automatisert system feilaktig avslår et lån, er det maskinvareprodusenten, modellutvikleren, selskapet som driver det, eller sluttbrukeren som er ansvarlig? Et system som er for slapt kan hemme kvaliteten; et som er for rigid kan kvele innovasjon.

Parallelt krever AI-etikk at man går utover formell overholdelse av loven. Organisasjoner, utviklere og regulatorer må enige om prinsipper om rettferdighet, ikke-diskriminering, respekt for autonomi og minimering av skadeOg det krever uunngåelig en informert offentlig debatt, som ikke bare involverer selskaper og myndigheter, men også borgere og berørte grupper.

AI-styring i organisasjoner: fra kaos til et felles rammeverk

I mange selskaper har bruken av kunstig intelligens startet uformelt: Hver avdeling tester sin egen modell eller integrerer en ekstern tjeneste på egenhånd.Markedsføring bruker en tekstgenerator, drift trener en hendelsesklassifisering, personalavdelingen eksperimenterer med CV-screeningsverktøy ...

Denne «modell-til-modell»-tilnærmingen har fordelen av hastighet, men på mellomlang sikt forårsaker den teknologisk fragmentering, dobbeltarbeid og mangel på kontrollDusinvis av isolerte løsninger dukker opp, uten en felles strategi, sporbarhet eller delte kostnads- og verdimålinger.

Risikoene hoper seg opp: Det er ukjent hvor mange modeller som er i produksjon, hvilke data de bruker, eller hvem som vedlikeholder dem.Beslutningsdokumentasjonen er ufullstendig, noe som hindrer interne eller regulatoriske revisjoner. Og regningen for skytjenester fortsetter å vokse uten at noen har et klart bilde av avkastningen.

Alternativet er å bevege seg mot en sentralisert styringsrammeverk som tillater fortsatt eksperimentering, men på et felles grunnlag: modellkataloger, datapolicyer, tilgangskontroller, delte overvåkingsverktøy, sporbarhet og risikovurdering. Spesialiserte arkitekturer, som for eksempel AI-plattformer for bedrifter, søker nettopp å kombinere lokal smidighet med global kontroll.

Uten denne disiplinen blir AI en kilde til teknisk gjeld, juridisk usikkerhet og kostnadsoverskridelserMed det blir det imidlertid et annet strategisk lag, på nivå med cybersikkerhet eller datahåndtering, som er i stand til å gi bærekraftige konkurransefortrinn.

AI-applikasjoner i bedriftsrisikostyring

Paradoksalt nok kan mange av truslene knyttet til AI reduseres. bruke AI som en alliert for å håndtere risikoer i organisasjoner. Innenfor områder som operasjonell risiko, samsvar med regelverk, anti-hvitvasking og informasjonssikkerhet, brukes det allerede med gode resultater.

På den ene siden tillater algoritmer analysere store mengder interne og eksterne data på svært kort tid, oppdage anomale atferdsmønstre, bekymringsfulle trender eller kombinasjoner av faktorer som vanligvis går forut for relevante hendelser.

Også spesielt verdifulle er prediktive modellerDisse verktøyene bidrar til å forutse materialiseringen av visse risikoer basert på historiske trender. Dette gjør det mulig å planlegge forebyggende tiltak, styrke kontrollene eller tilpasse forsikringsdekningen.

I svindelforebygging kan AI overvåke i sanntid transaksjoner, systemtilgang og økonomiske bevegelseridentifisere mistenkelige transaksjoner som ikke er synlige for det menneskelige øyet. På samme måte, i compliance-risikostyring, forenkler segmenteringsalgoritmer klassifiseringen av kunder, produkter eller jurisdiksjoner i henhold til deres eksponeringsprofil.

Alt dette krever imidlertid, kvalitetsdata, godt styrte og representative dataUten et solid informasjonsgrunnlag genererer modeller falske positiver, skjevheter og feilaktige beslutninger. Teknologi erstatter ikke faglig dømmekraft, men utfyller den og gjør den mer effektiv.

I de senere årene har det også dukket opp spesifikke løsninger basert på generativ AI som fungerer som medpiloter for risikostyringDisse verktøyene bidrar til å identifisere, beskrive og vurdere trusler basert på gjeldende regelverk, bransjen og hvert enkelt selskaps prosesser. Når de integreres i robuste plattformer med passende kontroller, øker disse assistentene produktiviteten til risikoteamene betydelig.

Kombinasjonen av alt det ovennevnte maler et ambivalent bilde: Kunstig intelligens har et enormt potensial til å forbedre hvordan vi produserer, bestemmer og lever, men den forsterker også ulikheter, feil og konflikter hvis den brukes uten kriterier eller kontroll.Å finne balansen innebærer å investere i opplæring, styrke reguleringer, implementere solide styringsrammeverk og alltid sette mennesker i sentrum for beslutninger, bruke AI som et verktøy og ikke som et mål i seg selv.

Innholdsfortegnelse

- Hva forstår vi i dag med kunstig intelligens?

- Hvordan AI fungerer: viktige teknikker

- Fordeler og muligheter med AI

- Generativ AI: et nytt sprang i kapasiteter … og i risikoer

- Tverrgående risikoer ved kunstig intelligens

- Etiske, regulatoriske og ansvarsmessige utfordringer

- AI-styring i organisasjoner: fra kaos til et felles rammeverk

- AI-applikasjoner i bedriftsrisikostyring