- Microsoft Fabric centralizuje dáta, riadenie, umelú inteligenciu a analýzy v reálnom čase na platforme OneLake a v rámci zjednotených funkcií.

- Platforma posilňuje riadenie, bezpečnosť a náklady prostredníctvom Purview, zabezpečenia OneLake, DLP, DSPM a integrácie so službou Azure Cost Management.

- Nástroje Data Factory, Dataflow Gen2 a migrácie uľahčujú presun existujúcich pracovných záťaží a orchestráciu zložitých kanálov.

- Copilot, dátoví agenti, MCP a nové pracovné zaťaženia, ako napríklad Fabric IQ a Real-Time Intelligence, poháňajú pokročilé scenáre umelej inteligencie a automatizácie.

Ak už nejaký čas pracujete s dátami v ekosystéme spoločnosti Microsoft, určite ste si všimli, že Microsoft Fabric sa stal ústredným centrom modernej analytikyZjednotenie všetkého, čo bolo predtým rozptýlené v službách Power BI, Azure Synapse, Data Factory a ďalších, do jednej platformy. V tomto článku sa dôkladne a detailne pozrieme na najnovšie funkcie, plán a praktické dôsledky platformy Fabric pre analytiku, riadenie, umelú inteligenciu a výpočty v reálnom čase.

Myšlienka je taká, že po dočítaní budete mať jasnú predstavu o Čo dnes ponúka Microsoft Fabric, kam smeruje a ako ovplyvňuje dátovú architektúru? vašej organizácie: možnosti riadenia s Purview, automatizácia s API a Gitom, nové funkcie umelej inteligencie, inteligencia v reálnom čase, bezpečnosť v OneLake, migrácie, výkon a oveľa viac.

Microsoft Fabric a rámec pre prijatie cloudu: riadenie, náklady a automatizácia

V rámci rámca pre prijatie cloudu (CAF) spoločnosť Microsoft publikuje sériu sprievodcov na zosúladenie Dizajn Microsoft Fabric s dizajnovými piliermi vstupných zónZáverečná časť tejto série sa zaoberá tromi kľúčovými oblasťami: riadením, optimalizáciou kapacity a automatizáciou/DevOps.

V sekcii riadenia, Náklady na kapacitu Fabric sú zverejnené prostredníctvom služby Azure Cost Management.Vďaka tomu môžete natívne integrovať údaje o používaní kapacity F (a ďalších skladových jednotiek) do dashboardov nákladov, upozornení a analýz výdavkov v službe Azure. Nejde len o zobrazenie faktúry: tieto informácie môžete porovnať so značkami, predplatnými alebo skupinami zdrojov, aby ste pochopili, kto koľko míňa a prečo.

Technická architektúra a obchodný model spoločnosti Fabric umožňujú zákazníkom presná kontrola spotreby kapacity s cieľom optimalizovať prevádzkové nákladyV praxi sa to prejavuje niekoľkými pákovými mechanizmami:

- Škálovanie schopností F: zvýšiť alebo znížiť kapacitu na základe predvídateľných špičiek, ako sú predajné kampane, účtovné termíny alebo veľké zaťaženie dát.

- Možnosti pozastavenia a obnoveniaSprávcovia infraštruktúry môžu pozastaviť kapacitu F, keď nie je potrebná (napríklad cez noc alebo cez víkendy v nekritických prostrediach), aby znížili výpočtové náklady.

- Ochrana pred prepätímDva parametre na úrovni kapacity riadia spôsob riadenia úloh na pozadí, aby sa zabránilo ich zahlteniu prostredia: Prahová hodnota odmietnutia na pozadí a Prahová hodnota obnovy na pozadí.

- Rezervácie kapacityJe možné rezervovať kapacitu na definované obdobia a získať zľavy za predpokladu, že očakávaná spotreba je prísne naplánovaná.

V oblasti správy údajov sa Fabric spolieha na Microsoft Purview ako ústredný komponent pre katalogizáciu, rodokmeň a klasifikáciuZ Purview je možné aplikovať označenia citlivosti, zobraziť prepojenie medzi pôvodom, transformáciami a spotrebou, certifikovať dátové aktíva alebo posilniť kampane zamerané na kvalitu dát, a to všetko pri integrácii prvkov Fabric (Lakehouse, Warehouse, KQL, Power BI atď.).

Sekcia „Automatizácia platformy a DevOps“ je primárne štruktúrovaná okolo Integrácia s Gitom, kanálmi nasadenia a REST APIPracovné priestory Fabric je možné prepojiť s repozitármi Git, aby viacerí vývojári mohli spolupracovať na tom istom projekte dátového inžinierstva, dátovej vedy alebo analýzy v reálnom čase bez prekrývania práce.

Git a Deployment Pipelines umožňujú kontrolovaným spôsobom riadiť vývojové, testovacie a produkčné cyklyPropagácia obsahu, sledovanie zmien, synchronizácia artefaktov a správa verzií. Od marca 2025 tieto kanály podporujú (vo všeobecnom alebo ukážkovom stave) širokú škálu typov prvkov, ako sú spúšťače, dashboardy, toky údajov, dátové kanály, dátové tržnice, jazerné sklady, KQL, poznámkové bloky, stránkované zostavy, organizačné aplikácie atď.

Medzitým Fabric odhaľuje veľmi široká sada REST API pomocou ktorého je možné automatizovať takmer akúkoľvek administratívnu úlohu alebo úlohu nasadenia: vytváranie pracovných priestorov a priečinkov, hromadná migrácia položiek, správa pripojení a brán, extrakcia definícií, aktivácia kanálov alebo poznámkových blokov a ďalšie.

Kľúčové aktualizácie v oblasti analytiky, umelej inteligencie a riadenia pre Microsoft Fabric

Vývoj Fabricu sa vyznačuje obrovským množstvom ukážkových funkcií a nových možností, ktoré Dotýkajú sa prakticky všetkých oblastí platformyNásledne sú zoskupené a prediskutované štruktúrovaným spôsobom, aby bolo možné vidieť celý rozsah.

Funkcie umelej inteligencie v dátovom sklade a multimodálne funkcie

V oblasti relačných dát zahŕňa Fabric Data Warehouse AI funguje priamo v T-SQL (ukážka). Toto umožňuje:

- Klasifikovať alebo kategorizovať text.

- Analyzujte sentiment.

- Extrahujte štruktúrované informácie z voľného textu.

- Prekladať text medzi jazykmi.

- Správna gramatika.

Cieľom je to Na obohatenie dát o umelú inteligenciu nie je potrebné opustiť kontext SQL.Tieto funkcie sú kombinované so všeobecnejšou multimodálnou podporou vo funkciách umelej inteligencie v platforme Fabric, ktoré teraz dokážu spracovať obrázky (JPG/JPEG, PNG, GIF, WebP), súbory PDF a bežné textové formáty, ako aj vstupy vo forme ciest k súborom.

Inžinierske siete ako napríklad aifunc.load na prijímanie priečinkov do tabuliek Vďaka možnostiam výzvy a schémy vám `aifunc.list_file_paths` umožňuje iterovať cez cesty k súborom a `ai.infer_schema` odvodzuje schémy kompatibilné s `ai.extract`. To všetko vám umožňuje transformovať a obohacovať dáta bez budovania zložitých kanálov od začiatku.

OneLake, Delta, Apache Iceberg a multiplatformový prístup

Na úložnej vrstve zostáva OneLake jednotným jazerom, kde sa nachádza celý Fabric. Jedným z hlavných vylepšení je možnosť Odhalenie tabuliek Delta Lake ako tabuliek Apache Iceberg bez presúvania alebo duplikovania údajov, aby enginy kompatibilné s Iceberg mohli priamo čítať, čo sa nachádza na OneLake.

Okrem toho OneLake teraz podporuje Dáta Apache Iceberg zapísané priamo aplikáciou Snowflake a spotrebované v prostredí Fabric bez kopírovaniaTáto stratégia posilňuje interoperabilitu: Fabric nechce byť izolovaným priestorom, ale dátovým „centrom“, ktoré môžu iné enginy využívať bez duplikovania úložiska.

V rovnakom duchu pripúšťa aj OneLake skratky k úložisku Azure Blob StorageOneDrive a SharePoint a rozširuje zabezpečenie o prístupové roly, zabezpečenie na úrovni priečinkov, riadkov a stĺpcov a model zabezpečenia, ktorý môžu tretie strany rešpektovať vďaka rozšíreniu modelu autorizovaného enginu.

Obzvlášť dôležitým bodom je federácia katalógu OneLake v Azure Databricks, ktorá umožňuje Prístup s nulovou kópiou z katalógu Unity k tabuľkám OneLakeTýmto spôsobom OneLake zostáva zdrojom pravdy, ale Databricks môžu priamo dotazovať dáta a synchronizovať iba metadáta.

Databáza SQL na Fabric: výkon, bezpečnosť a virtualizácia

Databáza SQL od Fabric získava vlastné možnosti: Možnosti ZMENIŤ NASTAVENIE DATABÁZYPodpora zoradenia a indexovania celého textu v ukážke. Na úrovni výkon databázy A čo sa týka nákladov, existuje niekoľko vylepšení:

- Automatické zhutňovanie indexov na zníženie úložiska, I/O operácií a zlepšenie časov dotazov bez nutnosti plánovania úloh údržby.

- Maximálny limit virtuálnych jadier na riadenie využívania výpočtových zdrojov (4 alebo 32 vCore), ktoré sú navrhnuté tak, aby zabránili nadmernej spotrebe zdieľanej kapacity pracovnou záťažou.

- Vlastné SQL fondy ktoré poskytujú správcom pracovného priestoru podrobnú kontrolu nad alokáciou zdrojov a smerovaním dotazov podľa názvu aplikácie.

Je tiež povolené Virtualizácia dát v databáze SQL, ktorý umožňuje dotazovanie externých údajov uložených v OneLake pomocou T-SQL, spájanie súborov v bežných formátoch s lokálnymi relačnými tabuľkami pomocou spojení bez nutnosti fyzického importu údajov.

Z hľadiska bezpečnosti databáza SQL podporuje Súkromné prepojenie na úrovni nájomníka (ukážka)Vďaka tomu je jednoduchšie súkromne a kontrolovane smerovať dátovú prevádzku a integrovať sa s celkovou konfiguráciou zabezpečenej siete Fabric.

Real-time Intelligence, Eventhouse, Eventstream a Activator

Modul Real-Time Intelligence (RTI) sa stal jedným z kľúčových rozlišovacích znakov spoločnosti Fabric. Eventhouse a Eventstream sa spájajú do prijímať, spracovávať a spúšťať udalosti v reálnom čase zo všetkých druhov zdrojov a Activator riadi akcie, ktoré sa spúšťajú za určitých podmienok.

Medzi najvýkonnejšie nové funkcie patria:

- Detekcia anomálií bez kódu s automatickým výberom modelu, jednoduchým rozhraním a flexibilnými upozorneniami.

- Obchodné udalosti, ktoré zachytávajú kľúčové obchodné momenty generované z funkcií používateľských údajov a poznámkových blokov a umožňujú vám aktivovať upozornenia, vlastnú logiku, postupy, modely umelej inteligencie alebo úlohy Spark.

- Integrácia funkcií aktivátora a používateľských dátaby funkcie vytvorené vo Fabric mohli spracovávať udalosti z akéhokoľvek zdroja vrátane interných udalostí zo samotnej platformy a z OneLake.

- Schopnosť spracovať udalosti pomocou SQL (operátor SQL v Eventstream), čo umožňuje transformáciu tokov v reálnom čase so známou syntaxou SQL.

Pridávajú sa relevantné konektory, ako napríklad Cribl (na príjem protokolov a telemetrie z viacerých zdrojov), konektor so Solace PubSub+ a podporu streamovania cez súkromné siete prostredníctvom Azure Virtual Network, VPN, ExpressRoute alebo súkromných koncových bodov.

Pre dátové schémy a zmluvy zavádza Eventstream Register schém ktorý definuje a overuje schémy udalostí pre robustnejšie kanály a podporuje prepojenie registra schém Confluent s Kafkou v Confluent Cloude pri rešpektovaní existujúcich zmlúv.

Funkcie Copilota a umelej inteligencie naprieč celou platformou

Copilot v Fabric je teraz dostupný globálne a pôsobí v Power BI, dátová továreň, dátová veda a dátové inžinierstvo a písanie KQL dotazovOkrem toho boli začlenené špecifické schopnosti:

- Copilot pre Dataflow Gen2 (moderné získavanie údajov), ktorý pomáha prijímať a transformovať dáta pomocou inštrukcií v prirodzenom jazyku.

- Copilot pre dátový sklad (chat), prístupné pomocou tlačidla na páse s nástrojmi na urýchlenie skladovacích úloh prostredníctvom dialógového okna.

- Copilot pre koncový bod analytiky SQL, ktorý generuje a optimalizuje SQL dotazy z popisov firiem.

- Copilot na notebookoch so znalosťou kontextu pracovného priestoru, Lakehouse, štruktúry notebookov a prostredia vykonávania, schopný generovať viackrokový kód, refaktorovať, sumarizovať zložité notebooky a diagnostikovať chyby pomocou možnosti „Opraviť pomocou Copilota“.

- Automatické dopĺňanie v kóde (dopĺňanie kódu v kóde) a dopĺňanie kódu v kóde Notebook Copilot (ukážka), písať Python rýchlejšie a s menším počtom chýb.

Okrem toho sa rozširuje technologická základňa umelej inteligencie integrované predpripravené nástroje Foundry (Azure OpenAI, Azure Language, Azure Translator), pluginy OpenAI pre Eventhouse (ai_embed_text a ai_chat_completion) a séria agentov a dátových agentov, ktoré umožňujú iným aplikáciám vrátane Copilot Studio pracovať s dátami Fabric orchestrovaným spôsobom.

Dátoví agenti Fabric, MCP a nástroje pre vývojárov

Úvod do látky dátoví agenti schopní riadiť prístup k údajom a nástrojom Pre agentov s umelou inteligenciou, s Python SDK a priamou integráciou s Microsoft Copilot Studio. To uľahčuje vytváranie konverzačných asistentov, ktorí pracujú s riadenými podnikovými dátami v prostredí Fabric.

Súbežne s tým, Kontextový protokol modelu (MCP) Stáva sa kľúčovou súčasťou integrácie medzi agentmi umelej inteligencie a službami Fabric. Existujú dedikované servery MCP pre Activator a Eventhouse a vývojovo orientovaný Fabric MCP, ktorý:

- Umožňuje asistentom s umelou inteligenciou generovať kód a obsah pre položky Fabric.

- Integruje sa s vývojovými nástrojmi ako VS Code a GitHub Codespaces.

- Predstavuje nástroje na konzultácie a prácu s údajmi v reálnom čase v Eventhouse.

V každodennej práci vývojára je potrebné zdôrazniť niekoľko kľúčových prvkov, vrátane vývojové prostredie: Rozšírenie MSSQL pre VS Code s podporou pre databázu Fabric SQL, ovládač Microsoft ADO.NET a ovládač ODBC pre Fabric Data Engineering (pripojenie k Spark SQL cez Livy) a konektor Spark pre databázy SQL, ktorý zjednodušuje overený prístup zo Sparku k databázam SQL v Azure a Fabric.

Taktiež sa objavuje Rozhranie rozhrania Fabric CLI, dostupná ako integrovaná úloha v Azure DevOps, ktorá umožňuje automatizovať správu pracovných priestorov, položiek a nasadení bez manuálnej inštalácie externých nástrojov.

Dátová továreň, migrácie dát a orchestrácia vo Fabric

Vrstva dátovej integrácie Fabric sa spolieha na Data Factory a Dataflow Gen2, ktoré prijímajú funkcie na... Orchestrácia bude inteligentnejšia, automatizovanejšia a s jednoduchšími migráciami. z existujúcich platforiem.

Dataflow Gen2: výkon, verejné API a diagnostika

V Dataflow Gen2 nájdeme v ukážkovej verzii niekoľko funkcií:

- Pokročilá úprava cieľových dopytov upraviť logiku v cieli priamo zo samotného prostredia pre tvorbu.

- Rozdelené výpočtyčo umožňuje, aby časti toku údajov bežali paralelne, čím sa skracuje celkový čas vyhodnocovania.

- Stiahnutie diagnostických údajov na úrovni vykonávania so štruktúrovanými protokolovými balíkmi pre analýzu výkonu a riešenie incidentov.

- Verejné API na programovo vytváranie, aktualizáciu, odstraňovanie, plánovanie a monitorovanie tokov údajov.

- Verejné parametre s podporou CI/CDktoré umožňujú obnovovanie tokov údajov odovzdávaním hodnôt z kanálov alebo iných zdrojov.

- Nedávne údaje pre rýchly prístup k naposledy použitým položkám na páse s nástrojmi Power Query a v modernej funkcii Získať údaje.

Toto všetko je doplnené schopnosťami Programové vyhodnotenie Power Query pomocou RESTToto otvára dvere k spúšťaniu M skriptov ako súčasti automatizovaných procesov, ich integrácii so Sparkom, kanálmi alebo externými nástrojmi s využitím konektorov Power Query.

Dátová továreň: adaptívny výkon, konektivita a DBT

V „klasickejšej“ časti integrácie predstavuje Data Factory v rámci Fabricu:

- Adaptívne ladenie výkonu pre aktivitu kopírovania, ktorá inteligentne upravuje výkonnostné parametre podľa konfigurácie a kontextu vykonávania.

- Podpora zachytávania zmien údajov (CDC) v úlohe kopírovania, aby sa priebežne replikovali iba zmeny (vkladanie, aktualizácie, vymazanie).

- Lokálne brány s možnosťou manuálnej aktualizácie spravované z portálu Fabric, rozhrania API alebo skriptov.

- nedávne pripojenie, ktorý pridáva k pripojeniam vlastnosti posledného použitia na uľahčenie auditu a správy životného cyklu.

- natívna úloha DBT, čo umožňuje spúšťanie DBT projektov v rámci Fabricu s integrovanou orchestráciou, testovaním, dokumentáciou a riadením.

- Vyvolať aktivitu balíka SSIS v kanáloch na spúšťanie balíkov SSIS zo samotnej orchestrácie v prostredí Fabric.

Používateľský zážitok je tiež vylepšený vďaka Výber lokality SharePoint (SharePoint Site Picker), ktorý zabraňuje manuálnemu písaniu URL adries a s podporou MCP pre Data Factory, aby asistenti s umelou inteligenciou mohli vytvárať a nasadzovať Dataflow Gen2 jednoducho z inštrukcií v prirodzenom jazyku.

Nástroje na migráciu a replikáciu údajov

Spoločnosť Microsoft dôrazne podporuje migráciu na platformu Fabric prostredníctvom niekoľkých špecifických nástrojov:

- Posúdenie migrácie Fabric pre Data Factory, ktorá analyzuje prípravu ADF kanálov a migruje tie podporované do pracovného priestoru Fabric s mapovaním pripojení.

- Asistent migrácie pre dátový skladktorý sa teraz môže priamo pripojiť k zdrojovému skladu a presunúť ho do dátového skladu Fabric.

- Asistent migrácie pre databázu SQL, zameraný na migráciu lokálnych pracovných záťaží SQL Servera s importom schémy prostredníctvom DACPAC, detekciou nekompatibility a odporúčaniami.

Pokiaľ ide o replikáciu, podpora sa poskytuje zrkadlenie viacerých operačných zdrojov (Azure Database for MySQL, Google BigQuery, SQL Server atď.) do Fabric s možnosťou kontroly nad replikáciou tabuliek, reštartovania procesov zrkadlenia prostredníctvom REST a v prípade Databricks mapovania politík Unity Catalog na zabezpečenie OneLake.

Súčasťou je aj replikačný konektor od Lakehouse pomocou Informačný kanál údajov o zmene delta, ktorá umožňuje zmeny na doskách Lakehouse Delta smerom ku kompatibilným destináciám bez nutnosti znovu vynájsť koleso s vlastnými riešeniami CDC.

Bezpečnosť, pokročilá správa a monitorovanie v prostredí Fabric

Jedným z najväčších problémov na akejkoľvek analytickej platforme je, ako zabezpečiť údaje, riadiť používanie a monitorovať spotrebu zdrojovLátka v týchto oblastiach rýchlo dozrieva.

Bezpečnosť a ochrana údajov v OneLake

OneLake pridáva kompletný model zabezpečenie prístupu k údajom s:

- Roly prístupu k údajom pre Lakehouse s konfigurovateľnými povoleniami z bezpečnostného rozhrania založeného na priečinkoch.

- Podpora zabezpečenia pre skratky, aby tretie strany mohli rešpektovať definované pravidlá.

- API pre zabezpečenie prístupu k údajom OneLake, ktoré umožňuje automatizovanú správu povolení.

- Rozšírenie modelu na externé enginy (bezpečnostná autorizácia OneLake pre tretie strany).

Súbežne sa rozširuje ochrana o Obmedzenie prístupu DLP nad všetkými štruktúrovanými dátami v OneLake (SQL, KQL, sklady) a je zavedený DSPM pre AI pre Fabric Copilots a dátových agentov, ktorý monitoruje interakcie umelej inteligencie s cieľom nájsť citlivé informácie a rizikové správanie, s integráciou s Purview Audit a eDiscovery.

Pokiaľ ide o identitu, objavujú sa charakteristiky, ako napríklad: identity spojené s položkami (napríklad Lakehouse a Eventstream) prostredníctvom rozhraní REST API, ktoré eliminujú závislosť od vlastníka pre určité operácie, a overovanie skratiek OneDrive a SharePoint pomocou identít pracovného priestoru alebo princípov služieb.

Centralizované riadenie a katalóg OneLake

Skúsenosti s riadením údajov sú posilnené nový centralizovaný panel v katalógu OneLakekde si vlastníci údajov môžu pozrieť súhrnný prehľad položiek, ktoré vytvorili, dostávať odporúčania týkajúce sa opatrení v oblasti riadenia a mať prístup ku všetkým dostupným nástrojom na zlepšenie zabezpečenia a dodržiavania predpisov.

Okrem toho, a API pre vyhľadávanie v katalógu OneLake spolu s nástrojom MCP, ktorý umožňuje objavovať položky v celom prostredí Fabric z kódu alebo agentov AI v rámci jediného volania, pričom rešpektuje povolenia katalógu a metadáta.

Monitorovanie kapacít, spotreby a práce

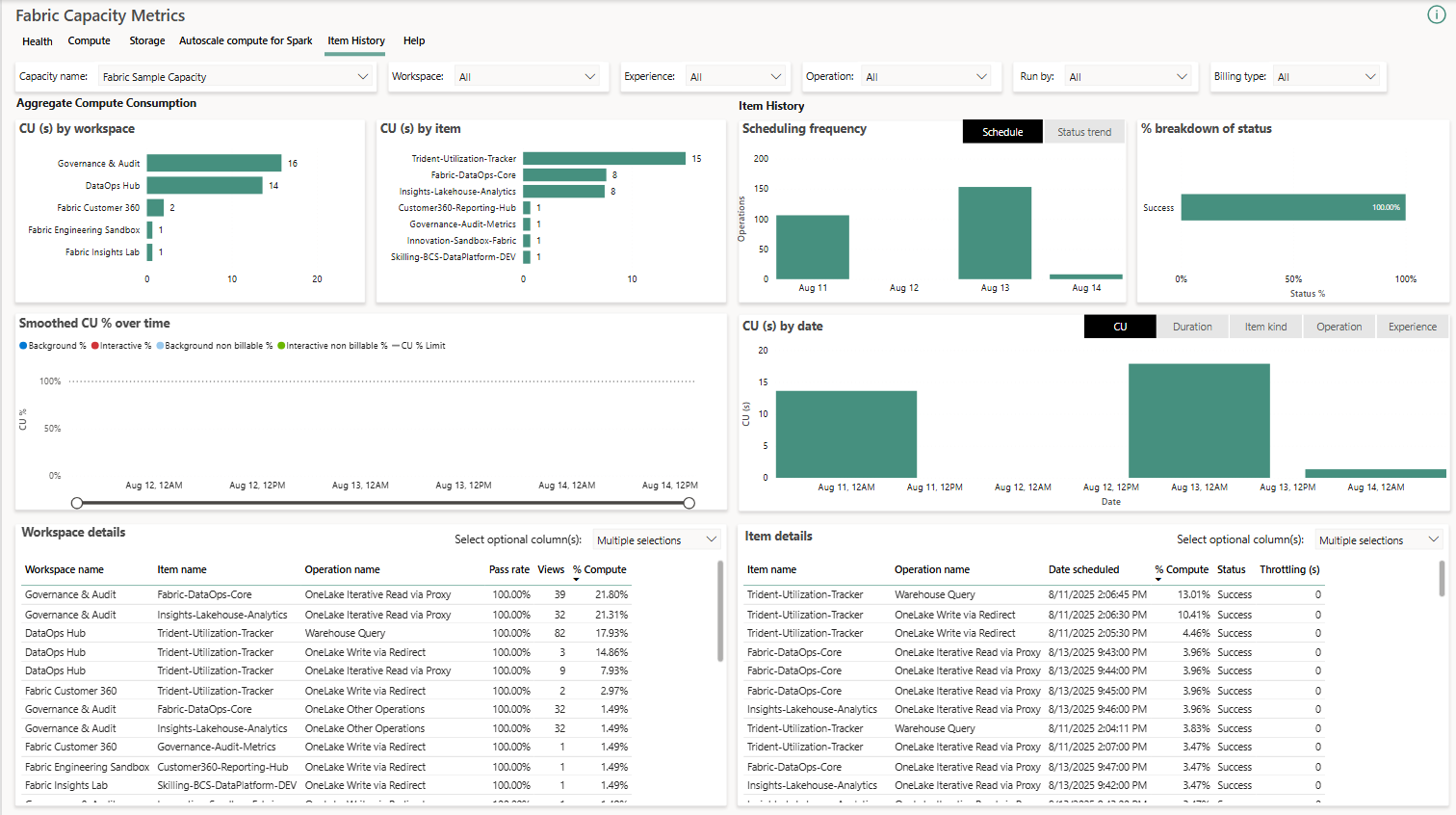

Látka poskytuje niekoľko vrstiev pozorovateľnosti:

- Monitorovanie pracovného priestoru, ktorá vytvára databázu v prostredí Fabric, kde sú konsolidované protokoly a metriky z viacerých položiek (vrátane úloh kopírovania s podrobným monitorovaním).

- Monitorovanie pracovného priestoru pre úlohu kopírovanias metrikami ako priepustnosť, objem dát, chybové kódy a časy, všetky zamerané na centralizovanú analýzu.

- História položiek pri aplikácii metrík kapacity, s 30-dňovými zobrazeniami spotreby CU pre každú položku, filtrovateľnými podľa pracovného priestoru a typu.

- Prepäťová ochrana na úrovni pracovného priestoručo umožňuje nastaviť prahové hodnoty spotreby pre každý pracovný priestor v 24-hodinovom posuvnom okne, automaticky blokovať tie, ktoré ich prekročia, a označiť pracovné priestory ako „kriticky dôležité“, aby sa vylúčili z obmedzení.

Ako doplnok k tomu, počiatočný súbor Rozhrania API pre správu fabric zamerané na objavovanie pracovných priestorov, položiek a podrobností o prístupe používateľov, uľahčovanie dynamických inventárov a pravidelných kontrol prístupu.

Obchodné modelovanie, plánovanie a nové pracovné zaťaženia

Okrem technickej úrovne spoločnosť Microsoft predstavuje nové pracovné zaťaženia orientované na podnikanie o Fabric. Jedným z najvýznamnejších je Fabric IQ, ktorý sa snaží zjednotiť obchodnú sémantiku, dáta a modely pre inteligentných agentov, ktorí robia rozhodnutia na základe holistického pohľadu na organizáciu.

V rámci Fabric IQ sa zobrazujú nasledujúce prvky:

- Ontológia (ukážka), typ položky, kde sú entity, vzťahy, vlastnosti a obmedzenia definované podľa obchodného jazyka spoločnosti.

- Plán (ukážka), platforma bez kódovania pre plánovanie, reporting, analytiku, integráciu a kolaboratívnu správu.

Objavuje sa aj inteligencia v reálnom čase tvorca digitálnych dvojčiat, položka špecializovaná na modelovanie digitálnych dvojčiat na základe údajov v reálnom čase s cieľom optimalizovať fyzické operácie, monitorovať stavy a simulovať scenáre.

Na druhej strane sa zavádza Pracovná záťaž Fabric IQ ako samostatná pracovná záťaž a podporné nástroje pre riadenie a sémantické zarovnanie sa neustále rozširujú, čím sa uzatvára kruh medzi dátovými modelmi, obchodnou logikou a aplikáciami umelej inteligencie/analytiky.

Vylepšenia výkonu, používateľskej skúsenosti a produktivity

Na záver tohto preskúmania je potrebné zdôrazniť niekoľko prierezových zlepšení, ktoré Nie vždy sa dostanú na titulné stránky novín, ale výrazne ovplyvňujú každodenný život. tímov.

V sekcii Spark a distribuované výpočty Fabric predstavuje:

- Fabric Runtime 2.0 (ukážka) s Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 a Python 3.12 na Azure Linux 3.0.

- Nástroj na porovnávanie aplikácií Sparkčo vám umožňuje vybrať a porovnať až štyri spustenia Spark paralelne.

- Diagnostický emitor iskier, ktorý zhromažďuje protokoly, metriky a udalosti z aplikácií Spark a odosiela ich do cieľových umiestnení, ako sú centrá udalostí, úložiská alebo Log Analytics.

- Diagnostická knižnica JobInsight, knižnica na analýzu dokončených spustení Spark prostredníctvom API (dotazy, úlohy, fázy, úlohy, vykonávače, protokoly udalostí).

Vo vrstve skladu sa pridávajú: zhlukovanie údajov Na zlepšenie výkonu a zníženie nákladov na prístup, stĺpce IDENTITY pre náhradné kľúče a podpora riadenia verzií a CI/CD prostredníctvom projektov databázy SQL vo VS Code (riadenie zdrojového kódu Warehouse).

Používateľská skúsenosť portálu Fabric sa tiež vyvíja s Prehliadanie v záložkách a prieskumník objektovTo vám umožňuje otvoriť viacero položiek naraz a rýchlo medzi nimi prepínať. V kombinácii s vylepšeniami, ako je automatické viazanie Lakehouse v Gite a sada nástrojov na údržbu Lakehouse (činnosti údržby a aktualizácia koncových bodov SQL), to prispieva k užívateľsky prívetivejšej a agilnejšej platforme.

Nakoniec, funkcie ako napríklad Hromadný import/export definícií položiek (pre migrácie, šablóny a zálohy metadát), REST pre priečinky, podpora parametrov pri aktiváciách položiek z Activatoru a načítavanie údajov OneLake v Exceli s integrovaným katalógom dopĺňajú ekosystém, ktorý začína pokrývať prakticky všetky bežné potreby moderného dátového tímu.

Vďaka celej tejto sade funkcií – od centralizovanej správy, granulárneho zabezpečenia a inteligentnej orchestrácie až po umelú inteligenciu zabudovanú v SQL, analýzy v reálnom čase, digitálne dvojčatá a agentov MCP – si Microsoft Fabric upevňuje pozíciu kompletnej dátovej platformy, kde… Kľúčom už nie je len ukladanie a vizualizácia údajov, ale riadenie, automatizácia a využívanie umelej inteligencie na kontrolu každej časti životného cyklu údajov.čo umožňuje organizáciám postupne vyvíjať svoje architektúry, migrovať to, čo už majú, a umožňovať nové riešenia oveľa rýchlejšie ako pri tradičných prístupoch.

obsah

- Microsoft Fabric a rámec pre prijatie cloudu: riadenie, náklady a automatizácia

- Kľúčové aktualizácie v oblasti analytiky, umelej inteligencie a riadenia pre Microsoft Fabric

- Funkcie umelej inteligencie v dátovom sklade a multimodálne funkcie

- OneLake, Delta, Apache Iceberg a multiplatformový prístup

- Databáza SQL na Fabric: výkon, bezpečnosť a virtualizácia

- Real-time Intelligence, Eventhouse, Eventstream a Activator

- Funkcie Copilota a umelej inteligencie naprieč celou platformou

- Dátoví agenti Fabric, MCP a nástroje pre vývojárov

- Dátová továreň, migrácie dát a orchestrácia vo Fabric

- Bezpečnosť, pokročilá správa a monitorovanie v prostredí Fabric

- Obchodné modelovanie, plánovanie a nové pracovné zaťaženia

- Vylepšenia výkonu, používateľskej skúsenosti a produktivity