- Microsoft Fabric centraliserar data, styrning, AI och realtidsanalys på OneLake och enhetliga funktioner.

- Plattformen stärker styrning, säkerhet och kostnadseffektivitet genom Purview, OneLake-säkerhet, DLP, DSPM och integration med Azure Cost Management.

- Data Factory, Dataflow Gen2 och migreringsverktyg gör det enkelt att flytta befintliga arbetsbelastningar och orkestrera komplexa pipelines.

- Copilot, dataagenter, MCP och nya arbetsbelastningar som Fabric IQ och Real-Time Intelligence driver avancerade AI- och automatiseringsscenarier.

Om du har arbetat med data i Microsofts ekosystem ett tag har du säkert märkt att Microsoft Fabric har blivit det centrala navet för modern analysAtt samla allt som tidigare varit spridet över Power BI, Azure Synapse, Data Factory och andra tjänster till en enda plattform. I den här artikeln ska vi ta en grundlig och detaljerad titt på de senaste funktionerna, färdplanen och de praktiska konsekvenserna av Fabric för analys, styrning, AI och realtidsdatabehandling.

Tanken är att du, när du har läst klart, har en klar förståelse för Vad erbjuder Microsoft Fabric idag, vart är det på väg och hur påverkar det dataarkitekturen? av din organisation: styrningsfunktioner med Purview, automatisering med API:er och Git, nya AI-funktioner, realtidsinformation, säkerhet i OneLake, migreringar, prestanda och mycket mer.

Microsoft Fabric och molnimplementeringsramverket: styrning, kostnader och automatisering

Inom ramverket för molnimplementering (CAF) har Microsoft publicerat en serie guider för att anpassa Microsoft Fabric-design med designpelarna för landningszonerDen sista delen av den här serien behandlar tre nyckelområden: styrning, kapacitetsoptimering och automatisering/DevOps.

I styrningsavsnittet, Kostnader för fabrikskapacitet exponeras via Azure Cost ManagementDetta gör att du kan integrera användningsdata för F-kapacitet (och andra SKU-enheter) direkt i Azures kostnadsdashboards, aviseringar och utgiftsanalyser. Det handlar inte bara om att se fakturan: du kan korsreferera denna information med taggar, prenumerationer eller resursgrupper för att förstå vem som spenderar vad och varför.

Fabrics tekniska arkitektur och affärsmodell gör det möjligt för kunderna Finjustera kapacitetsförbrukningen för att optimera driftskostnadernaI praktiken innebär detta flera hävstångseffekter:

- Skalning av kapacitet Föka eller minska kapaciteten baserat på förutsägbara toppar, såsom försäljningskampanjer, bokföringsdeadlines eller stora databelastningar.

- Pausa och återuppta funktionerFabric-administratörer kan pausa en F-kapacitet när den inte behövs (till exempel över natten eller på helger i icke-kritiska miljöer) för att minska beräkningskostnaderna.

- ÖverspänningsskyddTvå parametrar på kapacitetsnivå styr hur bakgrundsjobb hanteras för att förhindra att de överbelastar miljön: Tröskelvärde för bakgrundsavvisning och Tröskelvärde för bakgrundsåterställning.

- KapacitetsreservationerDet är möjligt att reservera kapacitet under definierade perioder för att få rabatter, förutsatt att den förväntade förbrukningen planeras noggrant.

Inom området datastyrning förlitar sig Fabric på Microsoft Purview som den centrala komponenten för katalogisering, härstamning och klassificeringFrån Purview är det möjligt att tillämpa känslighetsetiketter, se kopplingen mellan ursprung, transformationer och konsumtion, certifiera datatillgångar eller förbättra datakvalitetskampanjer, allt samtidigt som man integrerar elementen i Fabric (Lakehouse, Warehouse, KQL, Power BI, etc.).

Avsnittet "Plattformsautomation och DevOps" är huvudsakligen strukturerat kring Integration med Git, distributionspipelines och REST API:erFabric-arbetsytor kan länkas till Git-repositories så att flera utvecklare kan samarbeta i samma data engineering-, data science- eller realtidsanalysprojekt utan överlappande arbete.

Git och Deployment Pipelines tillåter orkestrera utvecklings-, testnings- och produktionslivscykler på ett kontrollerat sättInnehållsmarknadsföring, ändringsspårning, artefaktsynkronisering och versionshantering. Sedan mars 2025 har dessa pipelines stödt (i generellt eller förhandsgranskningstillstånd) ett brett utbud av elementtyper såsom triggers, dashboards, dataflöden, datapipelines, datamarts, lakehouses, lager, KQL, anteckningsböcker, paginerade rapporter, organisationsapplikationer etc.

Samtidigt avslöjar Fabric en mycket bred uppsättning REST API:er med vilken man kan automatisera nästan alla administrativa eller distributionsuppgifter: skapande av arbetsytor och mappar, massmigrering av objekt, hantering av anslutningar och gateways, extrahering av definitioner, aktivering av pipelines eller anteckningsböcker, bland annat.

Viktiga uppdateringar inom analys, AI och styrning för Microsoft Fabric

Utvecklingen av Fabric präglas av ett stort antal förhandsgranskningsfunktioner och nya funktioner som De berör praktiskt taget alla delar av plattformenDe grupperas och diskuteras sedan på ett strukturerat sätt så att hela omfattningen kan ses.

AI-funktioner i datalager och multimodala funktioner

Inom området relationsdata innehåller Fabric Data Warehouse AI fungerar direkt i T-SQL (förhandsvisning). Detta möjliggör:

- Klassificera eller kategorisera text.

- Analysera känslor.

- Extrahera strukturerad information från fritext.

- Översätt text mellan språk.

- Korrekt grammatik.

Målet är det Det finns ingen anledning att lämna SQL-kontexten för att berika data med AIDessa funktioner kombineras med mer generellt multimodalt stöd i Fabrics AI-funktioner, som nu kan bearbeta bilder (JPG/JPEG, PNG, GIF, WebP), PDF-filer och vanliga textformat, samt indata i form av sökvägar.

Verktyg som aifunc.load för att mata in mappar i tabeller Med prompt- och schemaalternativ kan du använda `aifunc.list_file_paths` för att iterera genom filsökvägar, och `ai.infer_schema` härleder scheman som är kompatibla med `ai.extract`. Allt detta gör att du kan transformera och berika data utan att bygga komplexa pipelines från grunden.

OneLake, Delta, Apache Iceberg och multiplattformsåtkomst

På lagringslagret förblir OneLake den enhetliga sjön där hela Fabric finns. En av de största förbättringarna är möjligheten att Visa Delta Lake-tabeller som Apache Iceberg-tabeller utan att flytta eller duplicera data, så att Iceberg-kompatibla sökmotorer direkt kan läsa vad som finns på OneLake.

Dessutom stöder OneLake nu Apache Iceberg-data skriven direkt av Snowflake, konsumerad i Fabric via kopieringsfri åtkomstDenna strategi förstärker interoperabiliteten: Fabric vill inte vara en silo, utan ett data"nav" som andra motorer kan utnyttja utan att duplicera lagring.

I samma anda medger OneLake genvägar till Azure Blob StorageOneDrive och SharePoint, och utökar säkerheten med åtkomstroller, säkerhet på mapp-, rad- och kolumnnivå, och en säkerhetsmodell som tredje part kan respektera tack vare utökningen av den auktoriserade motormodellen.

En särskilt relevant punkt är federeringen av OneLake-katalogen i Azure Databricks, vilket möjliggör Nollkopieringsåtkomst från Unity Catalog till OneLake-tabellerPå så sätt förblir OneLake sanningskällan, men Databricks kan fråga data direkt och synkronisera endast metadata.

SQL Database on Fabric: prestanda, säkerhet och virtualisering

Fabrics SQL-databas får sina egna funktioner: Alternativ för ÄNDRING AV DATABASANSETStöd för sortering och fulltextindexering i förhandsgranskning. På nivån av databasprestanda Och vad gäller kostnaden finns det flera förbättringar:

- Automatisk indexkomprimering för att minska lagring, I/O och förbättra frågetider utan att behöva schemalägga underhållsjobb.

- Maximal gräns för virtuella kärnor för att kontrollera användningen av datorresurser (4 eller 32 virtuella kärnor), utformade för att förhindra att en arbetsbelastning förbrukar för mycket i delad kapacitet.

- Anpassade SQL-pooler som ger arbetsyteadministratörer detaljerad kontroll över resursallokering och frågeroutning efter applikationsnamn.

Den är också aktiverad Datavirtualisering i SQL-databas, vilket möjliggör frågor om extern data lagrad i OneLake med T-SQL, och sammankoppling av filer i vanliga format med lokala relationstabeller med hjälp av kopplingar, utan att behöva importera data fysiskt.

När det gäller säkerhet stöder SQL-databasen Privat länk på hyresgästnivå (förhandsvisning)Detta gör det enklare att kanalisera datatrafik på ett privat och kontrollerat sätt, och integrera med Fabrics övergripande säkra nätverkskonfiguration.

Realtidsinformation, Eventhouse, Eventstream och Activator

Modulen Realtidsintelligens (RTI) har blivit en av Fabrics viktigaste differentieringsfaktorer. Eventhouse och Eventstream kombineras för att inhämta, bearbeta och utlösa händelser i realtid från alla möjliga källor, och Activator orkestrerar de åtgärder som utlöses under vissa förhållanden.

Bland de kraftfullaste nya funktionerna är:

- Avvikelsedetektering utan kod med automatiskt modellval, enkelt gränssnitt och flexibla aviseringar.

- Affärshändelser, som fångar viktiga affärsmoment som genereras från användardatafunktioner och anteckningsböcker, och låter dig aktivera aviseringar, anpassad logik, flöden, AI-modeller eller Spark-jobb.

- Integrering av aktivator-användardatafunktionerså att funktioner som skapats i Fabric kan bearbeta händelser från vilken källa som helst, inklusive interna händelser från själva plattformen och från OneLake.

- Möjlighet att bearbeta händelser med SQL (SQL-operator i Eventstream), vilket möjliggör transformation av realtidsflöden med känd SQL-syntax.

Relevanta kontakter läggs till, t.ex. Cribl (för logg- och telemetriinmatning från flera källor), en anslutning med Solace PubSub+ och stöd för strömning över privata nätverk via Azure Virtual Network, VPN, ExpressRoute eller privata slutpunkter.

För datascheman och kontrakt introducerar Eventstream en Schema Registry vilket definierar och validerar händelsescheman för mer robusta pipelines, och stöd för Confluent Schema Registry för att ansluta till Kafka i Confluent Cloud samtidigt som befintliga kontrakt respekteras.

Copilot- och AI-funktioner över hela plattformen

Copilot i Fabric är nu tillgängligt globalt, med närvaro i Power BI, Data Factory, Data Science & Data Engineering och skrivande av KQL-frågorDessutom har specifika funktioner införlivats:

- Copilot för Dataflow Gen2 (Modern Get Data), vilket hjälper till att ta in och omvandla data med instruktioner på naturligt språk.

- Copilot för datalager (chatt), tillgänglig från en knapp i menyfliksområdet för att påskynda lagerhanteringsuppgifter via dialogruta.

- Copilot för SQL-analysslutpunkt, som genererar och optimerar SQL-frågor från affärsbeskrivningar.

- Copilot på bärbara datorer med kunskap om arbetsytans kontext, Lakehouse, anteckningsbokens struktur och exekveringsmiljö, kunna generera flerstegskod, refaktorera, sammanfatta komplexa anteckningsböcker och diagnostisera fel med alternativet "Fix with Copilot".

- Inline-autokomplettering (inline-kodkomplettering) och Notebook Copilot inline-kodkomplettering (förhandsvisning), för att skriva Python snabbare och med färre fel.

Dessutom utökas AI-teknikbasen med integrerade förbyggda gjuteriverktyg (Azure OpenAI, Azure Language, Azure Translator), OpenAI-plugins för Eventhouse (ai_embed_text och ai_chat_completion) och en serie agenter och dataagenter som gör det möjligt för andra applikationer, inklusive Copilot Studio, att arbeta med Fabric-data på ett orkestrerat sätt.

Fabric Data Agents, MCP och utvecklarverktyg

Tyg introducera Dataagenter som kan orkestrera åtkomst till data och verktyg För AI-agenter, med ett Python SDK och direkt integration med Microsoft Copilot Studio. Detta gör det enkelt att bygga konversationsassistenter som arbetar med styrda företagsdata i Fabric.

Parallellt med Model Context Protocol (MCP) Det blir en nyckelkomponent i integrationen mellan AI-agenter och Fabric-tjänster. Det finns dedikerade MCP-servrar för Activator och Eventhouse, och en utvecklingsorienterad Fabric MCP som:

- Det låter AI-assistenter generera kod och innehåll för Fabric-artiklar.

- Den integreras med utvecklingsverktyg som VS Code och GitHub Codespaces.

- Den presenterar verktyg för konsultation och agerande utifrån realtidsdata i Eventhouse.

För utvecklarens dagliga arbete finns det flera viktiga delar att lyfta fram, inklusive utvecklingsmiljö: MSSQL-tillägg för VS Code med stöd för Fabric SQL-databas, Microsoft ADO.NET-drivrutinen och ODBC-drivrutinen för Fabric Data Engineering (anslutning till Spark SQL via Livy) och en Spark-anslutning för SQL-databaser som förenklar autentiserad åtkomst från Spark till SQL-databaser i Azure och Fabric.

Även framträder Tyg CLI, tillgänglig som en integrerad uppgift i Azure DevOps, vilket gör att du kan automatisera hanteringen av arbetsytor, objekt och distributioner utan att manuellt installera externa verktyg.

Data Factory, datamigreringar och orkestrering i Fabric

Fabrics dataintegrationslager förlitar sig på Data Factory och Dataflow Gen2, som tar emot funktioner för att... Orkestreringen kommer att bli smartare, mer automatiserbar och med enklare migreringar. från befintliga plattformar.

Dataflow Gen2: prestanda, offentliga API:er och diagnostik

I Dataflow Gen2 hittar vi flera funktioner i förhandsvisningen:

- Avancerad redigering av målfrågor för att justera logiken vid destinationen direkt från själva redigeringsmiljön.

- Partitionerad beräkningvilket gör att delar av dataflödet kan köras parallellt, vilket minskar den totala utvärderingstiden.

- Ladda ner diagnostik på exekveringsnivå, med strukturerade loggpaket för prestandaanalys och incidentlösning.

- Offentliga API:er för att programmatiskt skapa, uppdatera, ta bort, schemalägga och övervaka dataflöden.

- Offentliga parametrar med CI/CD-stödvilket möjliggör uppdatering av dataflöden genom att skicka värden från pipelines eller andra källor.

- Nyligen publicerade uppgifter för snabb åtkomst till senast använda objekt i Power Query-menyfliksområdet och i Modern Hämta data.

Allt detta kompletteras av kapaciteten hos Utvärdera Power Query programmatiskt via RESTDetta öppnar dörren för att köra M-skript som en del av automatiserade processer, integrera dem med Spark, pipelines eller externa verktyg, och dra nytta av Power Query-kopplingar.

Data Factory: adaptiv prestanda, anslutning och dbt

I den mer "klassiska" delen av integrationen introducerar Data Factory inom Fabric:

- Adaptiv prestandajustering för kopieringsaktivitet, som intelligent justerar prestandaparametrar enligt konfiguration och körningskontext.

- Ändra stöd för datainsamling (CDC) i kopieringsjobb, för att endast replikera ändringar (infogningar, uppdateringar, borttagningar) kontinuerligt.

- Lokala gateways med manuell uppgraderingsmöjlighet hanteras från Fabric-portalen, API:et eller skript.

- senaste anslutningen, vilket lägger till egenskaper för senaste användning till anslutningar för att underlätta granskning och livscykelhantering.

- infödd dbt-jobb, vilket möjliggör körning av dbt-projekt inom Fabric med integrerad orkestrering, testning, dokumentation och styrning.

- Anropa SSIS-paketaktivitet i pipelines, för att köra SSIS-paket från själva orkestreringen i Fabric.

Användarupplevelsen förbättras också med en SharePoint-webbplatsväljare (SharePoint Site Picker) som undviker att skriva URL:er för hand, och med MCP-stöd för Data Factory, så att AI-assistenter kan skapa och distribuera Dataflow Gen2 helt enkelt från instruktioner på naturligt språk.

Verktyg för datamigrering och replikering

Microsoft marknadsför starkt migreringen till Fabric genom flera specifika verktyg:

- Utvärdering av tygmigrering för Data Factory, som analyserar förberedelsen av ADF-pipelines och migrerar de som stöds till en Fabric-arbetsyta med anslutningsmappning.

- Migreringsassistent för datalagersom nu kan ansluta direkt till källlagret för att flytta det till Fabric Data Warehouse.

- Migreringsassistent för SQL-databas, som syftar till att migrera lokala SQL Server-arbetsbelastningar, med schemaimport via DACPAC, inkompatibilitetsdetektering och rekommendationer.

När det gäller replikering ges stöd till spegling av flera operativa källor (Azure Database for MySQL, Google BigQuery, SQL Server, etc.) till Fabric, med möjlighet att styra vilka tabeller som replikeras, starta om speglingsprocesser via REST och, när det gäller Databricks, mappa Unity Catalog-policyer till OneLake-säkerhet.

Även en replikeringsanslutning från Lakehouse medföljer Delta Change-dataflöde, vilket exponerar ändringar av Lakehouse Delta-kort mot kompatibla destinationer utan att behöva uppfinna hjulet på nytt med CDC:s egna lösningar.

Säkerhet, avancerad styrning och övervakning i Fabric

En av de största problemen med alla analysplattformar är hur säkra data, styra användningen och övervaka resursförbrukningenTyger mognar snabbt på dessa fronter.

Säkerhet och dataskydd på OneLake

OneLake lägger till en komplett modell av dataåtkomstsäkerhet med:

- Dataåtkomstroller för Lakehouse med konfigurerbara behörigheter från ett mappbaserat säkerhetsgränssnitt.

- Säkerhetsstöd för genvägar så att tredje part kan respektera de definierade policyerna.

- OneLake API för dataåtkomstsäkerhet, vilket möjliggör automatiserad behörighetshantering.

- Utökning av modellen till externa motorer (OneLake-säkerhetsauktorisering för tredje part).

Parallellt utökas skyddet med DLP begränsar åtkomst över all strukturerad data i OneLake (SQL, KQL, lager) och introduceras DSPM för AI för Fabric Copilots och dataagenter, som övervakar AI-interaktioner för känslig information och riskabla beteenden, med integration med Purview Audit och eDiscovery.

När det gäller identitet framträder egenskaper som följande: identiteter associerade med objekt (till exempel Lakehouse och Eventstream) via REST API:er, vilket eliminerar ägarberoendet för vissa åtgärder, och autentisering av OneDrive- och SharePoint-genvägar med hjälp av arbetsyteidentiteter eller tjänsteprinciper.

Centraliserad styrning och OneLake-katalog

Erfarenheten av datastyrning förstärks av en ny centraliserad panel i OneLake-katalogendär dataägare kan se en aggregerad vy över de objekt de har skapat, få rekommendationer för styrningsåtgärder och få tillgång till alla tillgängliga verktyg för att förbättra säkerhet och efterlevnad.

Dessutom en OneLake Catalog Search API tillsammans med ett MCP-verktyg, som gör det möjligt att upptäcka objekt i hela Fabric-miljön från kod eller AI-agenter, i ett enda anrop, med respekt för katalogbehörigheter och metadata.

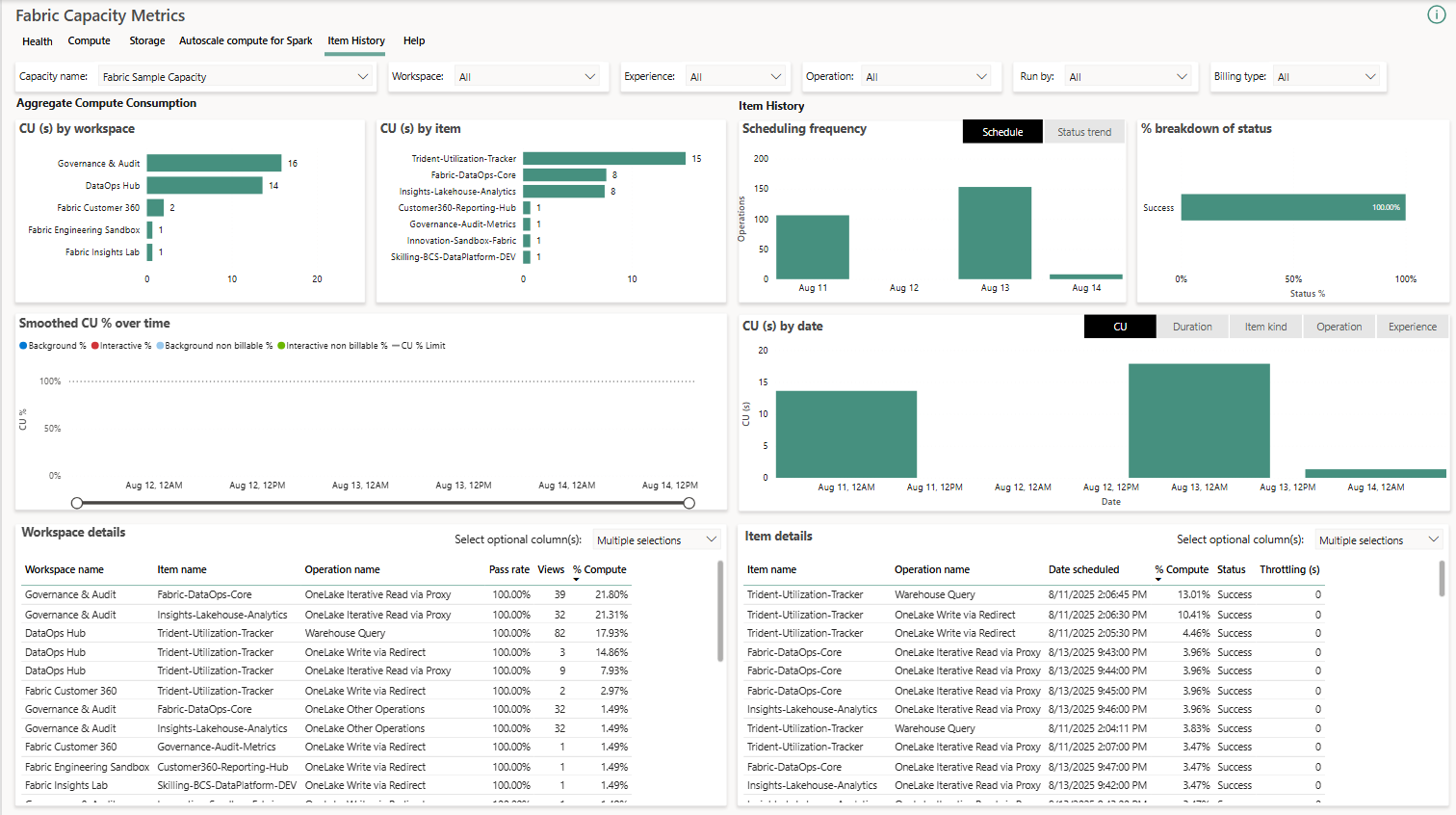

Övervakning av kapacitet, förbrukning och arbete

Tyg ger flera lager av observerbarhet:

- Övervakning av arbetsyta, vilket skapar en databas i Fabric där loggar och mätvärden från flera objekt konsolideras (inklusive kopieringsjobb med detaljerad övervakning).

- Arbetsyteövervakning för kopieringsjobbmed mätvärden som genomströmning, datavolym, felkoder och tider, allt inriktat på centraliserad analys.

- Artikelhistorik vid tillämpning av kapacitetsmått, med 30-dagarsvyer av CU-förbrukning för varje objekt, filtrerbar efter arbetsyta och typ.

- Överspänningsskydd på arbetsplatsnivåvilket gör det möjligt att ställa in förbrukningsgränser per arbetsyta i ett rullande 24-timmarsfönster, automatiskt blockera de som överskrider dem och markera arbetsytor som "verksamhetskritiska" för att undanta dem från begränsningar.

Som komplement till detta, en första uppsättning API:er för administration av fabriken fokuserade på att upptäcka arbetsytor, objekt och användaråtkomstdetaljer, underlätta dynamiska inventeringar och regelbundna åtkomstkontroller.

Affärsmodellering, planering och nya arbetsbelastningar

Utöver det tekniska lagret introducerar Microsoft nya affärsinriktade arbetsbelastningar om Fabric. En av de mest framträdande är Fabric IQ, som syftar till att förena affärssemantik, data och modeller för intelligenta agenter som fattar beslut baserat på en helhetssyn på organisationen.

Inom Fabric IQ visas följande:

- Ontologi (förhandsvisning), en typ av objekt där entiteter, relationer, egenskaper och begränsningar definieras enligt företagets affärsspråk.

- Plan (förhandsvisning), en kodfri plattform för planering, rapportering, analys, integration och samarbetsbaserad hantering.

Realtidsintelligens framträder också digital tvillingbyggare, en produkt specialiserad på modellering av digitala tvillingar baserat på realtidsdata, med syftet att optimera fysiska operationer, övervaka tillstånd och simulera scenarier.

Å andra sidan introduceras det Arbetsbelastningen i Fabric IQ som en separat arbetsbelastning, och supportverktyg för styrning och semantisk anpassning fortsätter att expandera, vilket sluter cirkeln mellan datamodeller, affärslogik och AI/analysapplikationer.

Förbättringar av prestanda, användarupplevelse och produktivitet

För att avsluta denna granskning är det värt att lyfta fram ett antal övergripande förbättringar som De hamnar inte alltid i rubrikerna, men de påverkar det dagliga livet i hög grad. av lagen.

I avsnittet om Spark och distribuerad databehandling introducerar Fabric:

- Fabric Runtime 2.0 (förhandsvisning) med Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 och Python 3.12 på Azure Linux 3.0.

- Jämförelseverktyg för Spark-apparvilket låter dig välja och jämföra upp till fyra Spark-körningar parallellt.

- Gnistdiagnostisk emitter, som samlar in loggar, mätvärden och händelser från Spark-program och skickar dem till destinationer som Event Hubs, lagring eller Log Analytics.

- JobInsight-diagnostikbibliotek, ett bibliotek för att analysera slutförda Spark-körningar via API:er (frågor, jobb, steg, uppgifter, körningar, händelseloggar).

I lagerlagret läggs följande till: dataklustring För att förbättra prestanda och minska åtkomstkostnader, IDENTITY-kolumner för surrogatnycklar, samt versionskontroll och CI/CD-stöd genom SQL Database-projekt i VS Code (Warehouse source control).

Användarupplevelsen av Fabric-portalen utvecklas också med Flikar och objektutforskareDetta gör att du kan öppna flera objekt samtidigt och snabbt växla mellan dem. Detta, i kombination med förbättringar som Lakehouse auto-binding i Git och verktygssviten för Lakehouse-underhåll (underhållsaktiviteter och uppdatering av SQL-slutpunkten), bidrar till en mer användarvänlig och smidig plattform.

Slutligen, funktioner som Massimport/export av artikeldefinitioner (för migreringar, mallar och säkerhetskopior av metadata), REST för mappar, parameterstöd vid objektaktivering från Activator och OneLake-datainläsning i Excel med integrerad katalog, kompletterar ett ekosystem som börjar täcka praktiskt taget alla vanliga behov hos ett modernt datateam.

Med hela denna uppsättning funktioner – från centraliserad styrning, detaljerad säkerhet och intelligent orkestrering, till AI inbäddad i SQL, realtidsanalys, digitala tvillingar och MCP-agenter – befäster Microsoft Fabric sin position som en komplett dataplattform där Nyckeln är inte längre bara att lagra och visualisera data, utan att styra, automatisera och utnyttja AI för att kontrollera varje del av datalivscykeln.vilket gör det möjligt för organisationer att utveckla sina arkitekturer gradvis, migrera det de redan har och möjliggöra nya lösningar mycket snabbare än med traditionella metoder.

Innehållsförteckning

- Microsoft Fabric och molnimplementeringsramverket: styrning, kostnader och automatisering

- Viktiga uppdateringar inom analys, AI och styrning för Microsoft Fabric

- AI-funktioner i datalager och multimodala funktioner

- OneLake, Delta, Apache Iceberg och multiplattformsåtkomst

- SQL Database on Fabric: prestanda, säkerhet och virtualisering

- Realtidsinformation, Eventhouse, Eventstream och Activator

- Copilot- och AI-funktioner över hela plattformen

- Fabric Data Agents, MCP och utvecklarverktyg

- Data Factory, datamigreringar och orkestrering i Fabric

- Säkerhet, avancerad styrning och övervakning i Fabric

- Affärsmodellering, planering och nya arbetsbelastningar

- Förbättringar av prestanda, användarupplevelse och produktivitet