- La IA actual se basa en algoritmos de optimización que automatizan tareas, analizan grandes volúmenes de datos y habilitan nuevos modelos de negocio.

- Los principales riesgos incluyen sesgos algorítmicos, pérdida de empleo, vulneraciones de privacidad, manipulación informativa y ciberataques más sofisticados.

- La IA generativa añade desafíos específicos: alucinaciones, deepfakes, dependencia tecnológica, costes crecientes y problemas de propiedad intelectual y reputación.

- Una gobernanza sólida, marcos regulatorios claros y el uso de la IA para gestionar riesgos son claves para aprovechar su potencial sin descontrolar su impacto.

La combinación de la inteligencia artificial con todos los ámbitos de nuestra vida está ocurriendo mucho más rápido de lo que la mayoría de organizaciones y personas podían imaginar. De los primeros algoritmos de recomendación hemos pasado en tiempo récord a modelos generativos capaces de redactar informes, analizar contratos, crear imágenes hiperrealistas o tomar decisiones automáticas en procesos críticos de negocio.

Esta expansión acelerada abre un abanico enorme de posibilidades, pero también trae consigo riesgos, dilemas éticos y desafíos regulatorios que no se pueden pasar por alto. No se trata de elegir entre una visión apocalíptica o un tecno-optimismo ingenuo, sino de entender con calma qué hace realmente la IA actual, qué no hace, dónde aporta más valor y en qué puntos puede convertirse en un problema serio si no se gobierna con cabeza.

Qué entendemos hoy por inteligencia artificial

Cuando hablamos de IA en el día a día, en realidad nos referimos a un conjunto de algoritmos de optimización y modelos estadísticos entrenados con grandes volúmenes de datos. No son máquinas conscientes ni «cerebros» que piensen como una persona, sino sistemas que aprenden patrones y generan salidas que resultan útiles (o plausibles) para tareas muy concretas.

En el ámbito empresarial, la IA se ha popularizado porque permite automatizar tareas rutinarias, analizar enormes bases de datos y apoyar la toma de decisiones con una precisión y velocidad inalcanzables para un equipo humano. Desde el diagnóstico médico asistido hasta la detección temprana de fraudes financieros, los casos de uso se multiplican en todos los sectores.

Conviene diferenciar, eso sí, entre la llamada Inteligencia Artificial Restringida (la que resuelve problemas específicos: clasificar imágenes, traducir textos, recomendar contenidos…) y la hipotética ปัญญาประดิษฐ์ทั่วไป, que aspiraría a razonar sobre cualquier tarea como un ser humano. A día de hoy, lo que usamos de forma masiva son sistemas restringidos, por muy impresionantes que parezcan modelos como ChatGPT, Bard o DALL‑E.

Estos modelos, especialmente los de lenguaje, están diseñados para calcular la respuesta más probable y socialmente aceptable dada una entrada, no para entender el mundo ni tener objetivos propios. Imitan razonamiento, pero bajo el capó se trata de cálculo estadístico sofisticado, no de conciencia ni intención.

Cómo funciona la IA: técnicas clave

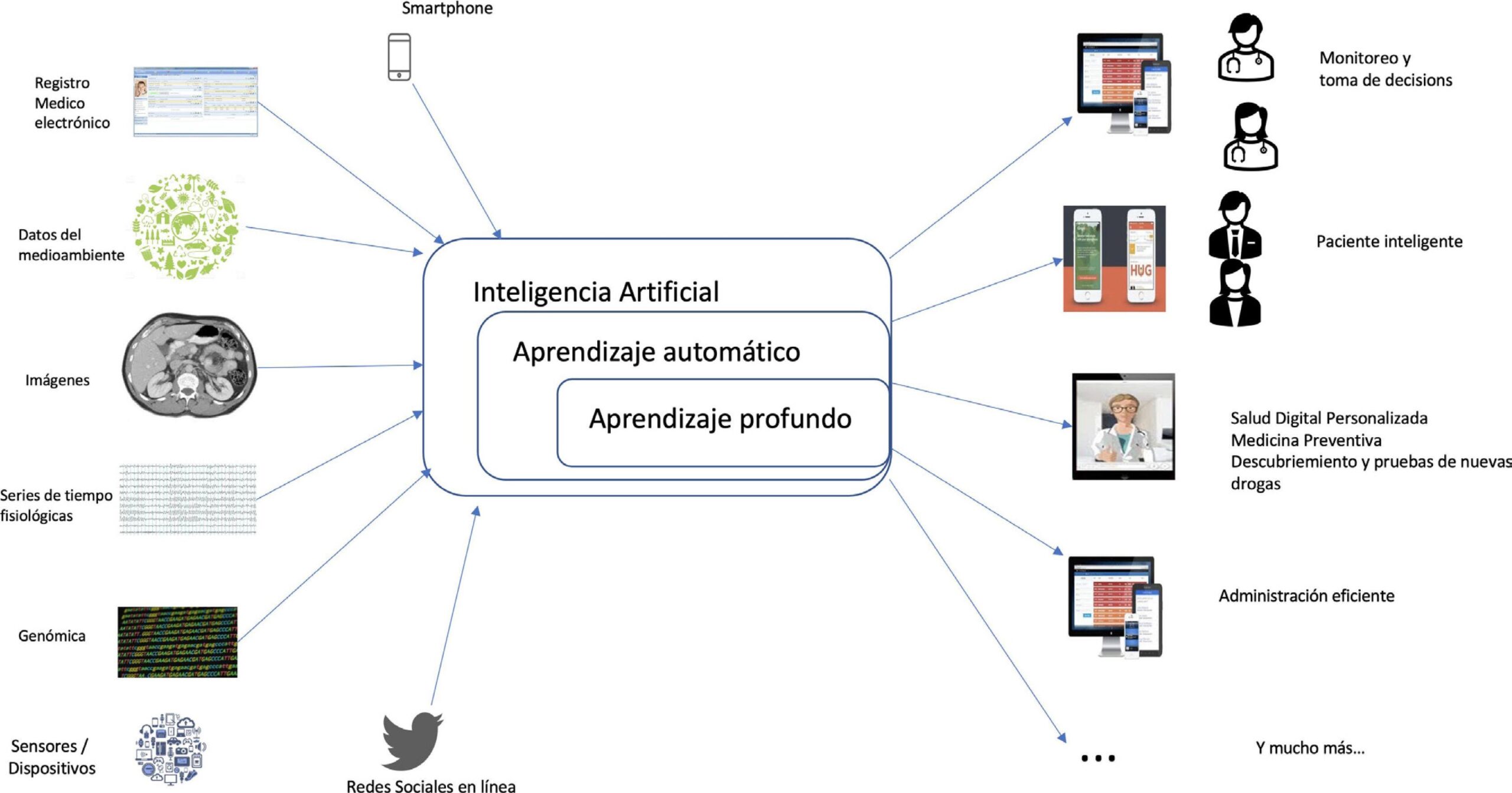

La mayoría de aplicaciones modernas de IA se apoyan en tres grandes bloques tecnológicos: aprendizaje automático, aprendizaje profundo y procesamiento del lenguaje natural, a los que se suma la visión por computador para todo lo referente a imágenes y vídeo.

Machine learning o aprendizaje automático

El machine learning (ML) es la rama que se centra en construir algoritmos capaces de aprender a partir de datos, sin necesidad de programar de forma explícita cada regla. El sistema encuentra patrones y, a partir de ellos, hace predicciones, clasificaciones o recomendaciones.

En el aprendizaje supervisado, los modelos se entrenan con datos etiquetados que indican la respuesta correcta (por ejemplo, si una transacción fue fraudulenta o no). En el aprendizaje no supervisado, en cambio, el algoritmo detecta estructuras y grupos ocultos en datos sin etiquetar, algo muy útil para segmentar clientes, detectar anomalías o agrupar comportamientos.

Un ejemplo típico en la industria es el uso de ML para analizar en tiempo real datos de sensores de fábricas (temperatura, vibraciones, ciclos de uso) y anticipar cuándo una máquina va a fallar, habilitando así el mantenimiento predictivo.

Deep learning o aprendizaje profundo

El deep learning es un subconjunto del ML que utiliza redes neuronales artificiales con muchas capas para aprender representaciones cada vez más complejas de los datos. Estas redes se inspiran en la estructura del cerebro, aunque su funcionamiento real difiere bastante de la biología.

Gracias al deep learning han despegado aplicaciones como el reconocimiento de voz, la visión por computador avanzada, los sistemas de recomendación o la conducción autónoma. Al disponer de enormes conjuntos de datos y potencia de cómputo, estas redes pueden detectar relaciones muy sutiles que antes eran imposibles de modelar.

En sectores como la automoción, por ejemplo, el aprendizaje profundo se utiliza para interpretar las imágenes de las cámaras y los datos de radares y lidar de un vehículo autónomo, estimar distancias, predecir trayectorias y decidir maniobras de forma casi instantánea.

การประมวลผลภาษาธรรมชาติ

El procesamiento del lenguaje natural (PLN) se ocupa de que los sistemas puedan entender, analizar y generar lenguaje humano, tanto en texto como en voz. Esto incluye tareas como clasificar documentos, resumir textos, traducir, responder preguntas o mantener conversaciones.

Los grandes modelos de lenguaje (LLM) actuales son capaces de detectar estructuras sintácticas y matices semánticos en cantidades ingentes de texto, lo que les permite producir respuestas sorprendentemente naturales. Se emplean en chatbots, asistentes virtuales, análisis de sentimiento, atención al cliente y soporte interno en empresas.

วิสัยทัศน์คอมพิวเตอร์

La visión artificial se centra en permitir que las máquinas interpreten imágenes y vídeos con un nivel de detalle similar al de una persona. Detectar objetos, reconocer caras, leer caracteres, medir dimensiones o identificar defectos en una pieza industrial son algunos ejemplos.

Esta tecnología se ha convertido en una pieza clave en control de calidad en fábricas, sistemas de vigilancia, diagnóstico médico por imagen y experiencias de realidad aumentada, entre muchos otros usos.

Ventajas y oportunidades de la IA

En el plano económico y social, la IA abre la puerta a una nueva oleada de innovación en productos, servicios y modelos de negocio. En Europa, por ejemplo, se considera un motor esencial para la transformación de sectores como la economía verde, la เทคโนโลยีอุตสาหกรรม, la agricultura, la salud, el turismo o la moda.

En el ámbito empresarial, una de las grandes bazas de la IA es la automatización de procesos repetitivos y tareas tediosas. Robots físicos y software inteligente pueden encargarse de operaciones mecánicas, clasificación de incidencias, generación de respuestas estándar o extracción de datos, liberando tiempo de las personas para labores creativas y estratégicas.

Otra ventaja clave es la capacidad para reducir el error humano en actividades de alta repetición o gran precisión. Desde la detección de microdefectos en piezas mediante cámaras infrarrojas hasta la introducción automática de datos, la IA minimiza fallos y mejora la trazabilidad de lo que ocurre.

Al mismo tiempo, los sistemas inteligentes aportan una precisión notable en el análisis de grandes volúmenes de información, generando indicadores útiles para decidir inversiones, ajustar precios, dimensionar plantillas o rediseñar procesos. Esta capacidad analítica refuerza la calidad de las decisiones de negocio.

En salud, la IA ya se utiliza para apoyar diagnósticos a partir de imágenes médicas, diseñar tratamientos personalizados y acelerar el descubrimiento de fármacos. En banca y finanzas, ayuda a detectar fraudes, evaluar riesgos de crédito y automatizar operaciones en mercados bursátiles.

Los servicios públicos también se benefician: optimización del transporte, gestión inteligente de residuos, ahorro energético, educación personalizada o administración electrónica más eficiente son líneas claras de aplicación. En paralelo, los analistas apuntan a que un uso responsable de la IA puede contribuir a reforzar la democracia, ayudando a combatir la desinformación, detectar ciberataques y mejorar la transparencia en procesos de contratación.

IA generativa: nuevo salto en capacidades… y en riesgos

La irrupción de la IA generativa ha marcado un antes y un después, ya que estos sistemas son capaces de crear contenido original y verosímil: textos técnicos, imágenes, audio, vídeo o código, y ejemplos prácticos como cómo crear stickers de WhatsApp con ChatGPT.

Para las empresas, esto abre la posibilidad de producir documentos, campañas de marketing, informes o prototipos de forma mucho más rápida, así como de apoyar a los equipos con copilotos de productividad. Sin embargo, también plantea retos adicionales en términos de calidad, propiedad intelectual, seguridad y reputación.

Entre los riesgos más visibles está la generación de información incorrecta o «alucinaciones»: el modelo inventa datos o referencias con apariencia convincente pero que no se corresponden con la realidad. Si no se revisa adecuadamente, esto puede conducir a decisiones erróneas, sobre todo en ámbitos críticos como el sanitario, legal o financiero.

A esto se suma la cuestión de la seguridad de la información y la privacidad. Si se alimenta a un modelo con datos sensibles (clientes, pacientes, estrategia de negocio) sin las debidas garantías, existe el riesgo de fugas, incumplimiento normativo o reutilización indebida de esa información.

Además, la IA generativa puede fomentar una dependencia tecnológica excesiva, con costes crecientes asociados al uso de grandes modelos, y puede homogeneizar en exceso contenidos y propuestas, restando diferenciación a las marcas si todas utilizan las mismas herramientas sin personalizarlas.

Riesgos transversales de la inteligencia artificial

Más allá de la parte generativa, el despliegue masivo de IA trae consigo un conjunto de riesgos estructurales que afectan al empleo, a los derechos fundamentales, a la seguridad y a la estabilidad económica. Entenderlos es imprescindible para poder gestionarlos.

Desplazamiento de empleo y brecha de capacidades

La automatización impulsada por la IA tiene un efecto ambiguo sobre el empleo: elimina determinados puestos, transforma otros y crea nuevas profesiones. Tareas administrativas, trabajos de oficina muy rutinarios o labores de control básico son especialmente vulnerables.

Sin una política clara de reciclaje profesional y actualización de competencias, muchas personas pueden quedarse descolgadas del mercado laboral, ampliando desigualdades existentes. En un sistema económico planificado, esta transición podría organizarse mejor; en el capitalismo actual, suele traducirse en inestabilidad y precariedad mientras se ajusta el tejido productivo.

Sesgos algorítmicos y discriminación

Los algoritmos aprenden de datos históricos que, a menudo, reflejan prejuicios, desigualdades y estructuras de poder existentes. Si esos sesgos no se corrigen, los sistemas los reproducen y amplifican en procesos de contratación, concesión de préstamos, gestión de seguros o incluso en el sistema judicial.

Conocemos ya casos de modelos de selección de personal que penalizaban sistemáticamente a mujeres porque habían sido entrenados con plantillas mayoritariamente masculinas, o de herramientas de evaluación de riesgo penal con sesgos raciales. Para mitigar este riesgo se requieren auditorías independientes, equipos diversos de desarrollo y datos de entrenamiento equilibrados y revisados.

Privacidad, vigilancia y derechos fundamentales

La IA funciona mejor cuanto más datos tiene, lo que incentiva una การรวบรวมข้อมูลส่วนบุคคลจำนวนมาก. Sistemas de reconocimiento facial, seguimiento en línea, creación de perfiles detallados de comportamiento o análisis de redes sociales pueden vulnerar la privacidad y, en manos equivocadas, convertirse en herramientas de vigilancia.

La legislación europea (incluida la futura AI Act) pone el foco en limitar usos de alto riesgo, como la identificación biométrica masiva o la toma de decisiones automatizadas sin posibilidad de recurso humano. Aun así, el peligro de abusos sigue presente, especialmente en contextos con menor supervisión democrática.

Seguridad, ciberataques y uso malicioso

La IA es una herramienta de doble filo: lo mismo que ayuda a prevenir, detectar y responder mejor a amenazas de ciberseguridad, también puede potenciar las capacidades de los atacantes. Automatizar campañas de phishing, generar malware más sofisticado o burlar sistemas de detección mediante ejemplos adversarios son algunos de los riesgos.

En el terreno militar y de la seguridad nacional, se discute el impacto de armas autónomas, sistemas de defensa automatizados y guerra cibernética apoyada en IA. La comunidad internacional aún está lejos de un consenso robusto sobre los límites éticos y legales de estas aplicaciones.

Manipulación de la información y deepfakes

Con la IA generativa es relativamente sencillo crear vídeos, audios e imágenes falsas pero muy creíbles, los conocidos deepfakes. Estas piezas pueden utilizarse para extorsión, manipulación política, ataques reputacionales o campañas de desinformación masiva.

Al mismo tiempo, los algoritmos que personalizan contenidos en redes sociales pueden encerrar a los usuarios en cámaras de eco, reforzando puntos de vista extremos y polarizando aún más la esfera pública. La IA se convierte así en un amplificador de dinámicas ya presentes, con un alcance difícil de controlar.

Imprevisibilidad y complejidad de los sistemas

A medida que los modelos se vuelven más complejos y autónomos, su comportamiento resulta cada vez menos transparente incluso para sus creadores. Esto dificulta explicar por qué se ha tomado una decisión concreta, algo crítico en ámbitos regulados.

Si se delegan funciones cruciales (sanidad, infraestructuras, justicia, transporte) en sistemas opacos, aumenta el riesgo de fallos sistémicos, efectos en cascada y pérdida de control humano. De ahí la importancia de diseñar modelos explicables, con trazabilidad y capacidad de intervención manual.

Desafíos éticos, regulatorios y de responsabilidad

El auge de la IA ha puesto sobre la mesa cuestiones complejas: ¿quién responde si un algoritmo causa un daño?, ¿cómo se garantizan la equidad y la transparencia?, ¿qué límites deben imponerse? La normativa tradicional va por detrás del ritmo de la innovación, y eso genera vacíos legales.

La Unión Europea está impulsando una Ley de IA que clasifica las aplicaciones por niveles de riesgo y establece requisitos más estrictos para las de alto impacto (salud, transporte, empleo, justicia, seguridad). Se prevén obligaciones de documentación, auditoría, gestión de datos de entrenamiento y supervisión humana.

Una cuestión especialmente delicada es la responsabilidad en caso de daños. Si un coche autónomo provoca un accidente o un sistema automatizado deniega indebidamente un crédito, ¿es responsable el fabricante del hardware, el desarrollador del modelo, la empresa que lo opera o el usuario final? Un esquema demasiado laxo puede desincentivar la calidad; uno excesivamente rígido puede frenar la innovación.

En paralelo, la ética de la IA exige ir más allá del cumplimiento formal de la ley. Organizaciones, desarrolladores y reguladores deben acordar principios de justicia, no discriminación, respeto a la autonomía y minimización de daños. Y eso pasa, inevitablemente, por un debate público informado, donde participen no solo empresas y gobiernos, sino también ciudadanía y colectivos afectados.

Gobernanza de la IA en las organizaciones: del caos al marco común

En muchas empresas, la adopción de IA ha empezado de forma informal: cada departamento prueba su propio modelo o integra un servicio externo por su cuenta. Marketing usa un generador de textos, Operaciones entrena un clasificador de incidencias, Recursos Humanos experimenta con herramientas de cribado de CV…

Este enfoque «modelo a modelo» tiene la ventaja de la rapidez, pero a medio plazo provoca fragmentación tecnológica, duplicidad de esfuerzos y falta de control. Surgen decenas de soluciones aisladas, sin una estrategia común, sin trazabilidad ni métricas compartidas de coste y valor.

Los riesgos se acumulan: no se sabe cuántos modelos hay en producción, ni qué datos usan, ni quién los mantiene. Los registros de decisiones son incompletos, dificultando auditorías internas o regulatorias. Y la factura de servicios en la nube crece sin que nadie tenga una visión clara del retorno.

La alternativa es avanzar hacia un marco de gobernanza centralizado que permita seguir experimentando, pero sobre una base común: catálogos de modelos, políticas de datos, controles de acceso, herramientas compartidas de monitorización, trazabilidad y evaluación de riesgos. Arquitecturas especializadas, como las plataformas corporativas de IA, buscan precisamente combinar agilidad local con control global.

Sin esta disciplina, la IA se convierte en una fuente de deuda técnica, inseguridad jurídica y sobrecostes. Con ella, en cambio, pasa a ser una capa estratégica más, al nivel de la ciberseguridad o la gestión del dato, capaz de aportar ventajas competitivas sostenibles.

Aplicaciones de la IA en la gestión de riesgos empresariales

Paradójicamente, muchas de las amenazas asociadas a la IA pueden mitigarse utilizando la propia IA como aliada para gestionar riesgos dentro de las organizaciones. En ámbitos como los riesgos operacionales, el cumplimiento normativo, la prevención de blanqueo o la seguridad de la información, ya se usa con buenos resultados.

Por un lado, los algoritmos permiten analizar grandes cantidades de datos internos y externos en muy poco tiempo, detectando patrones de comportamiento anómalos, tendencias preocupantes o combinaciones de factores que suelen preceder a incidentes relevantes.

También son especialmente valiosos los แบบจำลองการทำนาย, que ayudan a anticipar la materialización de determinados riesgos a partir de comportamientos históricos. Esto da margen para planificar medidas preventivas, reforzar controles o adaptar coberturas de seguro.

En prevención de fraudes, la IA puede monitorizar en tiempo real transacciones, accesos a sistemas y movimientos financieros, identificando operaciones sospechosas que escapan al ojo humano. Igualmente, en la gestión de riesgos de cumplimiento, algoritmos de segmentación facilitan clasificar clientes, productos o jurisdicciones según su perfil de exposición.

Todo esto requiere, eso sí, datos de calidad, bien gobernados y representativos. Sin una buena base informacional, los modelos generan falsos positivos, sesgos y decisiones equivocadas. La tecnología no sustituye al criterio profesional, sino que lo complementa y lo hace más eficiente.

En los últimos años han surgido, además, soluciones específicas basadas en IA generativa que actúan como copilotos para la gestión de riesgos, ayudando a identificar, describir y valorar amenazas a partir de la normativa aplicable, el sector y los procesos de cada empresa. Cuando se integran dentro de plataformas robustas y con controles adecuados, estos asistentes multiplican la productividad de los equipos de riesgo.

La combinación de todo lo anterior dibuja un escenario ambivalente: la inteligencia artificial tiene un potencial enorme para mejorar nuestra forma de producir, decidir y vivir, pero amplifica también desigualdades, errores y conflictos si se usa sin criterio ni control. Encontrar el equilibrio pasa por invertir en formación, reforzar la regulación, desplegar marcos de gobernanza sólidos y mantener siempre a las personas en el centro de las decisiones, usando la IA como herramienta y no como fin en sí mismo.

สารบัญ

- Qué entendemos hoy por inteligencia artificial

- Cómo funciona la IA: técnicas clave

- Ventajas y oportunidades de la IA

- IA generativa: nuevo salto en capacidades… y en riesgos

- Riesgos transversales de la inteligencia artificial

- Desafíos éticos, regulatorios y de responsabilidad

- Gobernanza de la IA en las organizaciones: del caos al marco común

- Aplicaciones de la IA en la gestión de riesgos empresariales