- Isinasaayos ng Microsoft Fabric ang datos, pamamahala, AI, at real-time analytics sa OneLake at mga pinag-isang kakayahan.

- Pinapalakas ng plataporma ang pamamahala, seguridad, at gastos sa pamamagitan ng Purview, seguridad ng OneLake, DLP, DSPM, at integrasyon sa Azure Cost Management.

- Pinapadali ng Data Factory, Dataflow Gen2, at mga tool sa migration ang paglipat ng mga kasalukuyang workload at pag-oorganisa ng mga kumplikadong pipeline.

- Ang copilot, mga data agent, MCP, at mga bagong workload tulad ng Fabric IQ at Real-Time Intelligence ay nagtutulak ng mga advanced na senaryo ng AI at automation.

Kung matagal ka nang gumagamit ng datos sa ecosystem ng Microsoft, mapapansin mo na Ang Microsoft Fabric ay naging pangunahing sentro ng modernong analyticsPinagsasama-sama ang lahat ng dating nakakalat sa Power BI, Azure Synapse, Data Factory, at iba pang mga serbisyo sa iisang plataporma. Sa artikulong ito, titingnan natin nang masinsinan at detalyado ang mga pinakabagong tampok, roadmap, at praktikal na implikasyon ng Fabric para sa analytics, pamamahala, AI, at real-time computing.

Ang ideya ay, kapag natapos mo nang basahin, magkakaroon ka ng malinaw na pag-unawa sa Ano ang iniaalok ng Microsoft Fabric ngayon, saan ito patungo, at paano ito nakakaapekto sa arkitektura ng datos? ng iyong organisasyon: mga kakayahan sa pamamahala gamit ang Purview, automation gamit ang mga API at Git, mga bagong feature ng AI, real-time intelligence, seguridad sa OneLake, mga migrasyon, performance at marami pang iba.

Microsoft Fabric at ang Cloud Adoption Framework: pamamahala, mga gastos, at automation

Sa loob ng Cloud Adoption Framework (CAF), naglalathala ang Microsoft ng isang serye ng mga gabay upang ihanay ang Disenyo ng Microsoft Fabric gamit ang mga haligi ng disenyo ng mga landing zoneAng huling bahagi ng seryeng ito ay tumatalakay sa tatlong pangunahing aspeto: pamamahala, pag-optimize ng kapasidad, at automation/DevOps.

Sa seksyon ng pamamahala, Ang mga gastos sa kapasidad ng tela ay inilalantad sa pamamagitan ng Azure Cost ManagementNagbibigay-daan ito sa iyong i-integrate ang datos ng paggamit ng kapasidad ng F (at iba pang SKU) sa mga cost dashboard, alerto, at spend analytics ng Azure. Hindi lang ito tungkol sa pagtingin sa bayarin: maaari mong i-cross-reference ang impormasyong ito gamit ang mga tag, subscription, o resource group para maunawaan kung sino ang gumagastos ng ano at bakit.

Ang teknikal na arkitektura at modelo ng negosyo ng Fabric ay nagbibigay-daan sa mga customer maingat na kontrolin ang pagkonsumo ng kapasidad upang ma-optimize ang mga gastos sa pagpapatakboSa pagsasagawa, ito ay isinasalin sa ilang mga lever:

- Pag-scale ng mga kakayahan F: dagdagan o bawasan ang kapasidad batay sa mga nahuhulaang peak, tulad ng mga kampanya sa pagbebenta, mga deadline ng accounting, o malalaking data load.

- Mga kakayahan sa paghinto at pagpapatuloyMaaaring i-pause ng mga fabric administrator ang isang F capacity kapag hindi ito kinakailangan (halimbawa, magdamag o tuwing Sabado at Linggo sa mga hindi kritikal na kapaligiran) upang mabawasan ang mga gastos sa pag-compute.

- Proteksyon sa pag-surgeDalawang parameter sa antas ng kapasidad ang kumokontrol kung paano pinamamahalaan ang mga trabaho sa background upang maiwasan ang mga ito na mapuno ang kapaligiran: Background Rejection Threshold at Background Recovery Threshold.

- Mga reserbasyon ng kapasidadPosibleng magreserba ng kapasidad para sa mga takdang panahon upang makakuha ng mga diskwento, sa kondisyon na ang inaasahang pagkonsumo ay maingat na pinaplano.

Sa larangan ng pamamahala ng datos, umaasa ang Fabric sa Microsoft Purview bilang pangunahing bahagi para sa katalogo, linya ng lahi, at klasipikasyonMula sa Purview, posibleng maglagay ng mga sensitivity label, makita ang pinagmulan, mga pagbabago, at pagkonsumo, magsertipika ng mga data asset, o magpalakas ng mga kampanya sa kalidad ng data, habang isinasama ang mga elemento ng Fabric (Lakehouse, Warehouse, KQL, Power BI, atbp.).

Ang seksyong "Platform Automation at DevOps" ay pangunahing nakabalangkas sa Pagsasama sa Git, mga deployment pipeline, at mga REST APIMaaaring iugnay ang mga workspace ng fabric sa mga repositoryo ng Git upang ang maraming developer ay makapagtulungan sa iisang proyekto ng data engineering, data science, o real-time analytics nang walang magkakapatong na trabaho.

Pinapayagan ng mga Pipeline ng Git at Deployment ang ayusin ang mga siklo ng buhay ng pag-unlad, pagsubok, at produksyon sa isang kontroladong paraanPag-promote ng nilalaman, pagsubaybay sa pagbabago, pag-synchronize ng artifact, at pamamahala ng bersyon. Simula Marso 2025, ang mga pipeline na ito ay sumuporta (sa pangkalahatan o sa estado ng preview) ng malawak na hanay ng mga uri ng elemento tulad ng mga trigger, dashboard, dataflow, data pipeline, datamart, lakehouse, warehouse, KQL, notebook, paginated report, mga application ng organisasyon, atbp.

Samantala, inilalantad ng Fabric isang napakalawak na hanay ng mga REST API kung saan maaaring i-automate ang halos anumang administratibo o deployment na gawain: paglikha ng mga workspace at folder, maramihang paglipat ng mga item, pamamahala ng mga koneksyon at gateway, pagkuha ng mga kahulugan, pag-activate ng mga pipeline o notebook, bukod sa iba pang mga bagay.

Mga pangunahing update sa analytics, AI, at pamamahala para sa Microsoft Fabric

Ang ebolusyon ng Fabric ay minarkahan ng napakaraming tampok ng preview at mga bagong kakayahan na Halos lahat ng bahagi ng plataporma ay sakop nilaPagkatapos ay pinapangkat-pangkat ang mga ito at tinatalakay sa isang nakabalangkas na paraan upang makita ang buong saklaw.

Mga tungkulin ng AI sa Data Warehouse at mga tungkuling multimodal

Sa larangan ng relational data, isinasama ng Fabric Data Warehouse ang Direktang gumagana ang AI sa T-SQL (preview). Pinapayagan nito ang:

- Uriin o ikategorya ang teksto.

- Suriin ang damdamin.

- Kumuha ng nakabalangkas na impormasyon mula sa malayang teksto.

- Magsalin ng teksto sa pagitan ng mga wika.

- Tamang gramatika.

Ang layunin ay iyon Hindi na kailangang umalis sa konteksto ng SQL para pagyamanin ang data gamit ang AIAng mga tungkuling ito ay pinagsama sa mas pangkalahatang suportang multimodal sa mga tungkuling AI ng Fabric, na maaari na ngayong magproseso ng mga imahe (JPG/JPEG, PNG, GIF, WebP), mga PDF at mga karaniwang format ng teksto, pati na rin ang mga input sa anyo ng mga path ng file.

Mga utility tulad ng aifunc.load para sa pag-ingest ng mga folder sa mga talahanayan Gamit ang mga opsyon sa prompt at schema, pinapayagan ka ng `aifunc.list_file_paths` na mag-ulit sa mga file path, at ang `ai.infer_schema` ay nagbubuod ng mga schema na tugma sa `ai.extract`. Ang lahat ng ito ay nagbibigay-daan sa iyong baguhin at pagyamanin ang data nang hindi bumubuo ng mga kumplikadong pipeline mula sa simula.

OneLake, Delta, Apache Iceberg at multiplatform access

Sa storage layer, ang OneLake ay nananatiling pinag-isang lawa kung saan matatagpuan ang buong Fabric. Isa sa mga pangunahing pagpapabuti ay ang kakayahang Paglalantad ng mga talahanayan ng Delta Lake bilang mga talahanayan ng Apache Iceberg nang hindi naglilipat o nagdodoble ng data, nang sa gayon ay direktang mabasa ng mga Iceberg-compatible engine ang nasa OneLake.

Bukod pa rito, sinusuportahan na ngayon ng OneLake ang Ang datos ng Apache Iceberg ay direktang isinulat ni Snowflake, na ginagamit sa Fabric sa pamamagitan ng copy-free accessPinapatibay ng estratehiyang ito ang interoperability: Hindi nais ng Fabric na maging isang silo, kundi isang "hub" ng data na maaaring samantalahin ng ibang mga engine nang hindi dinoble ang storage.

Kasabay nito, inamin ng OneLake mga shortcut papunta sa Azure Blob StorageOneDrive at SharePoint, at nagpapalawak ng seguridad gamit ang mga access role, seguridad sa antas ng folder, row at column, at isang modelo ng seguridad na maaaring igalang ng mga ikatlong partido salamat sa pagpapalawak ng awtorisadong modelo ng engine.

Isang partikular na mahalagang punto ay ang pagsasama-sama ng katalogo ng OneLake sa Azure Databricks, na nagbibigay-daan sa Walang kopyang access mula sa Unity Catalog papunta sa mga OneLake tableSa ganitong paraan, nananatiling pinagmumulan ng katotohanan ang OneLake, ngunit maaaring direktang i-query ng Databricks ang data, na isi-synchronize lamang ang metadata.

SQL Database sa Fabric: pagganap, seguridad, at virtualization

Ang SQL database ng Fabric ay nagkakaroon ng sarili nitong mga kakayahan: Mga opsyon sa pagbabago ng set ng databaseSuporta para sa collation at full-text indexing sa preview. Sa antas ng pagganap ng database At tungkol sa gastos, mayroong ilang mga pagpapabuti:

- Awtomatikong pagsiksik ng indeks upang mabawasan ang storage, I/O at mapabuti ang oras ng query nang hindi kinakailangang mag-iskedyul ng mga trabaho sa pagpapanatili.

- Pinakamataas na limitasyon ng vCores upang kontrolin ang paggamit ng mga mapagkukunan ng computing (4 o 32 vCores), na idinisenyo upang maiwasan ang labis na pagkonsumo ng workload sa ibinahaging kapasidad.

- Mga Pasadyang SQL Pool na nagbibigay sa mga administrador ng workspace ng detalyadong kontrol sa paglalaan ng mapagkukunan at pagruruta ng query ayon sa pangalan ng application.

Ito ay pinagana rin Virtualisasyon ng datos sa database ng SQL, na nagbibigay-daan sa pag-query sa mga panlabas na datos na nakaimbak sa OneLake gamit ang T-SQL, pagsasama-sama ng mga file sa mga karaniwang format gamit ang mga lokal na relational table gamit ang mga join, nang hindi kinakailangang pisikal na i-import ang datos.

Sa usapin ng seguridad, sinusuportahan ng SQL database ang Pribadong Link sa antas ng nangungupahan (preview)Ginagawa nitong mas madali ang pagpapadala ng trapiko ng datos sa pribado at kontroladong paraan, na isinasama sa pangkalahatang ligtas na configuration ng network ng Fabric.

Real-Time Intelligence, Eventhouse, Eventstream at Activator

Ang Real-Time Intelligence (RTI) module ay naging isa sa mga pangunahing nagpapaiba sa Fabric. Pinagsasama ng Eventhouse at Eventstream ang pag-ingest, pagproseso at pag-trigger ng mga real-time na kaganapan mula sa lahat ng uri ng mapagkukunan, at inaayos ng Activator ang mga aksyon na nati-trigger sa ilalim ng ilang partikular na kundisyon.

Kabilang sa mga pinakamakapangyarihang bagong tampok ay:

- Pagtuklas ng anomalya nang walang code na may awtomatikong pagpili ng modelo, simpleng interface at mga nababaluktot na alerto.

- Mga Kaganapan sa Negosyo, na kumukuha ng mga mahahalagang sandali sa negosyo na nabuo mula sa mga Function at Notebook ng Data ng Gumagamit, at nagbibigay-daan sa iyong i-activate ang mga alerto, custom na lohika, mga daloy, mga modelo ng AI o mga trabaho sa Spark.

- Pagsasama ng mga Tungkulin ng Activator-User Dataupang ang mga function na nilikha sa Fabric ay makapagproseso ng mga event mula sa anumang pinagmulan, kabilang ang mga internal na event mula mismo sa platform at mula sa OneLake.

- Kakayahang iproseso ang mga kaganapan gamit ang SQL (SQL Operator sa Eventstream), na nagpapahintulot sa pagbabago ng mga real-time na daloy gamit ang kilalang syntax ng SQL.

Ang mga kaugnay na konektor ay idinagdag tulad ng Cribl (para sa pag-log at telemetry ingestion mula sa maraming pinagmulan), isang konektor na may Solace PubSub+, at suporta sa streaming sa mga pribadong network sa pamamagitan ng Azure Virtual Network, VPN, ExpressRoute o mga pribadong endpoint.

Para sa mga iskema at kontrata ng datos, ipinakikilala ng Eventstream ang isang Rehistro ng Iskema na tumutukoy at nagpapatunay sa mga scheme ng kaganapan para sa mas matatag na mga pipeline, at suporta para sa Confluent Schema Registry upang kumonekta sa Kafka sa Confluent Cloud habang nirerespeto ang mga umiiral na kontrata.

Mga kakayahan ng Copilot at AI sa buong platform

Ang Copilot in Fabric ay makukuha na ngayon sa buong mundo, na may presensya sa Power BI, Data Factory, Data Science at Data Engineering at pagsusulat ng mga KQL queryBilang karagdagan, isinama ang mga partikular na kakayahan:

- Copilot para sa Dataflow Gen2 (Modernong Pagkuha ng Data), na tumutulong sa pag-intindi at pagbabago ng data gamit ang mga tagubilin sa natural na wika.

- Kopilot para sa Data Warehouse (chat), mapupuntahan mula sa isang buton sa ribbon upang mapabilis ang mga gawain sa pag-iimbak sa pamamagitan ng dialog.

- Copilot para sa SQL analytics endpoint, na bumubuo at nag-o-optimize ng mga SQL query mula sa mga paglalarawan ng negosyo.

- Copilot sa mga notebook may kaalaman sa konteksto ng workspace, lakehouse, istruktura ng notebook at kapaligiran sa pagpapatupad, kayang bumuo ng multistep code, mag-refactor, magbubuod ng mga kumplikadong notebook at mag-diagnose ng mga error gamit ang opsyong "Fix with Copilot".

- Inline autocompletion (inline code completion) at Notebook Copilot inline code completion (preview), para mas mabilis na makapagsulat ng Python at mas kaunting error.

Bukod pa rito, ang base ng teknolohiya ng AI ay pinalalawak kasama ng isinama ang mga paunang-built na Tool ng Foundry (Azure OpenAI, Azure Language, Azure Translator), mga plugin ng OpenAI para sa Eventhouse (ai_embed_text at ai_chat_completion) at isang serye ng mga ahente at data agent na nagpapahintulot sa iba pang mga aplikasyon, kabilang ang Copilot Studio, na gumana sa data ng Fabric sa isang maayos na paraan.

Mga Ahente ng Datos ng Tela, MCP at mga tool ng developer

Pagpapakilala ng tela mga ahente ng datos na may kakayahang pangasiwaan ang pag-access sa datos at mga tool Para sa mga AI agent, gamit ang Python SDK at direktang integrasyon sa Microsoft Copilot Studio. Ginagawa nitong madali ang pagbuo ng mga conversational assistant na gumagana gamit ang pinamamahalaang data ng enterprise sa Fabric.

Sa parallel, ang Model Context Protocol (MCP) Ito ay nagiging isang mahalagang bahagi ng integrasyon sa pagitan ng mga AI agent at mga serbisyo ng Fabric. May mga nakalaang MCP server para sa Activator at Eventhouse, at isang development-oriented na Fabric MCP na:

- Pinapayagan nito ang mga AI assistant na bumuo ng code at nilalaman para sa mga item na gawa sa Fabric.

- Nakakapag-integrate ito sa mga development tool tulad ng VS Code at GitHub Codespaces.

- Nagpapakita ito ng mga kagamitan para sa pagkonsulta at pagkilos batay sa real-time na datos sa Eventhouse.

Para sa pang-araw-araw na gawain ng developer, may ilang mahahalagang bagay na dapat bigyang-diin, kabilang ang kapaligiran sa pag-unlad: Ekstensyon ng MSSQL para sa VS Code na may suporta para sa database ng Fabric SQL, ang Microsoft ADO.NET Driver at ang ODBC Driver para sa Fabric Data Engineering (koneksyon sa Spark SQL sa pamamagitan ng Livy), at isang Spark connector para sa mga SQL database na nagpapadali sa napatotohanang pag-access mula sa Spark patungo sa mga SQL database sa Azure at Fabric.

Lumilitaw din ang Tela CLI, na magagamit bilang isang pinagsamang gawain sa Azure DevOps, na nagbibigay-daan sa iyong i-automate ang pamamahala ng mga workspace, item, at deployment nang hindi manu-manong nag-i-install ng mga panlabas na tool.

Data Factory, paglilipat ng datos at orkestrasyon sa Fabric

Ang data integration layer ng Fabric ay umaasa sa Data Factory at Dataflow Gen2, na tumatanggap ng mga function para... Ang orkestrasyon ay magiging mas matalino, mas awtomatiko, at may mas simpleng mga paglipat. mula sa mga umiiral na plataporma.

Dataflow Gen2: pagganap, mga pampublikong API, at mga diagnostic

Sa Dataflow Gen2, makikita natin ang ilang feature sa preview:

- Advanced na pag-edit ng mga target na query upang ayusin ang lohika sa patutunguhan nang direkta mula sa mismong kapaligiran ng pag-akda.

- Nakahati na computena nagpapahintulot sa mga bahagi ng daloy ng datos na tumakbo nang sabay-sabay, na binabawasan ang kabuuang oras ng pagsusuri.

- I-download ang mga diagnostic sa antas ng pagpapatupad, na may mga nakabalangkas na pakete ng log para sa pagsusuri ng pagganap at paglutas ng insidente.

- Mga pampublikong API para sa programatikong paglikha, pag-update, pagtanggal, pag-iiskedyul, at pagsubaybay sa mga daloy ng data.

- Mga pampublikong parameter na may suporta sa CI/CDna nagpapahintulot sa pag-refresh ng mga daloy ng datos sa pamamagitan ng pagpasa ng mga halaga mula sa mga pipeline o iba pang mga mapagkukunan.

- Kamakailang datos para sa mabilis na pag-access sa mga kamakailang ginamit na item sa Power Query ribbon at sa Modern Get Data.

Ang lahat ng ito ay kinukumpleto ng mga kakayahan ng Suriin ang Power Query sa pamamagitan ng programa gamit ang RESTBinubuksan nito ang pinto sa pagpapatakbo ng mga M script bilang bahagi ng mga awtomatikong proseso, pagsasama ng mga ito sa Spark, mga pipeline, o mga panlabas na tool, at sinasamantala ang mga Power Query connector.

Data Factory: adaptive performance, koneksyon at dbt

Sa mas "klasikong" bahagi ng integrasyon, ipinakikilala ng Data Factory sa loob ng Fabric ang:

- Pag-tune ng adaptive performance para sa aktibidad ng pagkopya, na matalinong nag-aayos ng mga parameter ng pagganap ayon sa konteksto ng configuration at execution.

- Baguhin ang suporta sa Data Capture (CDC) sa trabahong Kopyahin, para kopyahin lamang ang mga pagbabago (mga pagsingit, pag-update, pagtanggal) nang tuluy-tuloy.

- Mga gateway na nasa loob ng lugar na may opsyong manu-manong pag-upgrade pinamamahalaan mula sa Fabric portal, API o mga script.

- kamakailang koneksyon, na nagdaragdag ng mga katangian ng huling paggamit sa mga koneksyon upang mapadali ang pag-awdit at pamamahala ng lifecycle.

- Trabaho ng katutubong dbt, na nagpapahintulot sa pagpapatakbo ng mga proyektong dbt sa loob ng Fabric na may pinagsamang orkestrasyon, pagsubok, dokumentasyon, at pamamahala.

- I-invoke ang aktibidad ng SSIS Package sa mga pipeline, para patakbuhin ang mga SSIS package mula mismo sa orchestration sa Fabric.

Pinahuhusay din ang karanasan ng gumagamit gamit ang isang Tagapili ng site ng SharePoint (SharePoint Site Picker) na umiiwas sa manu-manong pag-type ng mga URL, at may suporta ng MCP para sa Data Factory, upang ang mga AI assistant ay makalikha at makapag-deploy ng Dataflow Gen2 mula lamang sa mga tagubilin sa natural na wika.

Mga tool sa paglipat at pagkopya ng datos

Mariing itinataguyod ng Microsoft ang paglipat sa Fabric sa pamamagitan ng ilang partikular na tool:

- Pagtatasa ng Paglipat ng Tela para sa Pabrika ng Data, na sumusuri sa paghahanda ng mga pipeline ng ADF at inililipat ang mga sinusuportahan sa isang workspace ng Fabric na may connection mapping.

- Katulong sa Paglipat para sa Data Warehousena maaari na ngayong direktang kumonekta sa source warehouse upang ilipat ito sa Fabric Data Warehouse.

- Katulong sa Paglipat para sa SQL database, na naglalayong ilipat ang mga on-premise na workload ng SQL Server, kasama ang schema import sa pamamagitan ng DACPAC, pagtukoy ng hindi pagkakatugma at mga rekomendasyon.

Tungkol sa replikasyon, ang suporta ay ibinibigay sa pag-mirror ng maraming pinagmumulan ng operasyon (Azure Database para sa MySQL, Google BigQuery, SQL Server, atbp.) sa Fabric, na may kakayahang kontrolin kung aling mga talahanayan ang kinokopya, i-restart ang mga proseso ng pag-mirror sa pamamagitan ng REST at, sa kaso ng Databricks, i-map ang mga patakaran ng Unity Catalog sa seguridad ng OneLake.

Kasama rin ang isang replication connector mula sa Lakehouse gamit ang Feed ng Datos ng Pagbabago ng Delta, na naglalantad ng mga pagbabago sa mga board ng Lakehouse Delta patungo sa mga tugmang destinasyon nang hindi kinakailangang muling likhain ang gulong gamit ang mga lokal na solusyon ng CDC.

Seguridad, advanced na pamamahala, at pagsubaybay sa Fabric

Isa sa mga pinakamalaking alalahanin sa anumang platform ng analytics ay kung paano ligtas na datos, pamahalaan ang paggamit, at subaybayan ang pagkonsumo ng mapagkukunanMabilis na nahihinog ang tela sa mga aspetong ito.

Seguridad at proteksyon ng datos sa OneLake

Nagdagdag ang OneLake ng kumpletong modelo ng seguridad sa pag-access ng datos na may:

- Mga tungkulin sa pag-access ng data para sa Lakehouse na may mga pahintulot na maaaring i-configure mula sa isang interface ng seguridad na nakabatay sa folder.

- Suporta sa seguridad para sa mga shortcut upang masunod ng mga ikatlong partido ang mga tinukoy na patakaran.

- OneLake data access security API, na nagbibigay-daan para sa awtomatikong pamamahala ng pahintulot.

- Pagpapalawak ng modelo sa mga panlabas na makina (awtorisasyon sa seguridad ng OneLake para sa mga ikatlong partido).

Kasabay nito, ang proteksyon ay pinalalawak kasama ng Paghihigpit sa pag-access ng DLP sa lahat ng nakabalangkas na datos sa OneLake (SQL, KQL, mga bodega) at ipinakikilala DSPM para sa AI para sa mga Fabric Copilot at data agent, na sumusubaybay sa mga interaksyon ng AI para sa sensitibong impormasyon at mga mapanganib na pag-uugali, na may integrasyon sa Purview Audit at eDiscovery.

Sa usapin ng pagkakakilanlan, lumilitaw ang mga katangian tulad ng sumusunod: mga pagkakakilanlan na nauugnay sa mga bagay (halimbawa, Lakehouse at Eventstream) sa pamamagitan ng mga REST API, na nag-aalis ng dependency ng may-ari para sa ilang partikular na operasyon, at pagpapatotoo ng mga shortcut ng OneDrive at SharePoint gamit ang mga pagkakakilanlan ng workspace o mga prinsipyo ng serbisyo.

Sentralisadong pamamahala at katalogo ng OneLake

Ang karanasan sa pamamahala ng datos ay pinatitibay ng isang bagong sentralisadong panel sa katalogo ng OneLakekung saan makikita ng mga may-ari ng datos ang pinagsama-samang pagtingin sa mga aytem na kanilang nilikha, makatanggap ng mga rekomendasyon sa aksyon sa pamamahala, at ma-access ang lahat ng magagamit na tool upang mapabuti ang seguridad at pagsunod.

Bilang karagdagan, isang OneLake Catalog Search API kasama ang isang MCP tool, na nagbibigay-daan sa pagtuklas ng mga item sa buong Fabric environment mula sa code o AI agent, sa isang tawag lamang, na nirerespeto ang mga pahintulot sa katalogo at metadata.

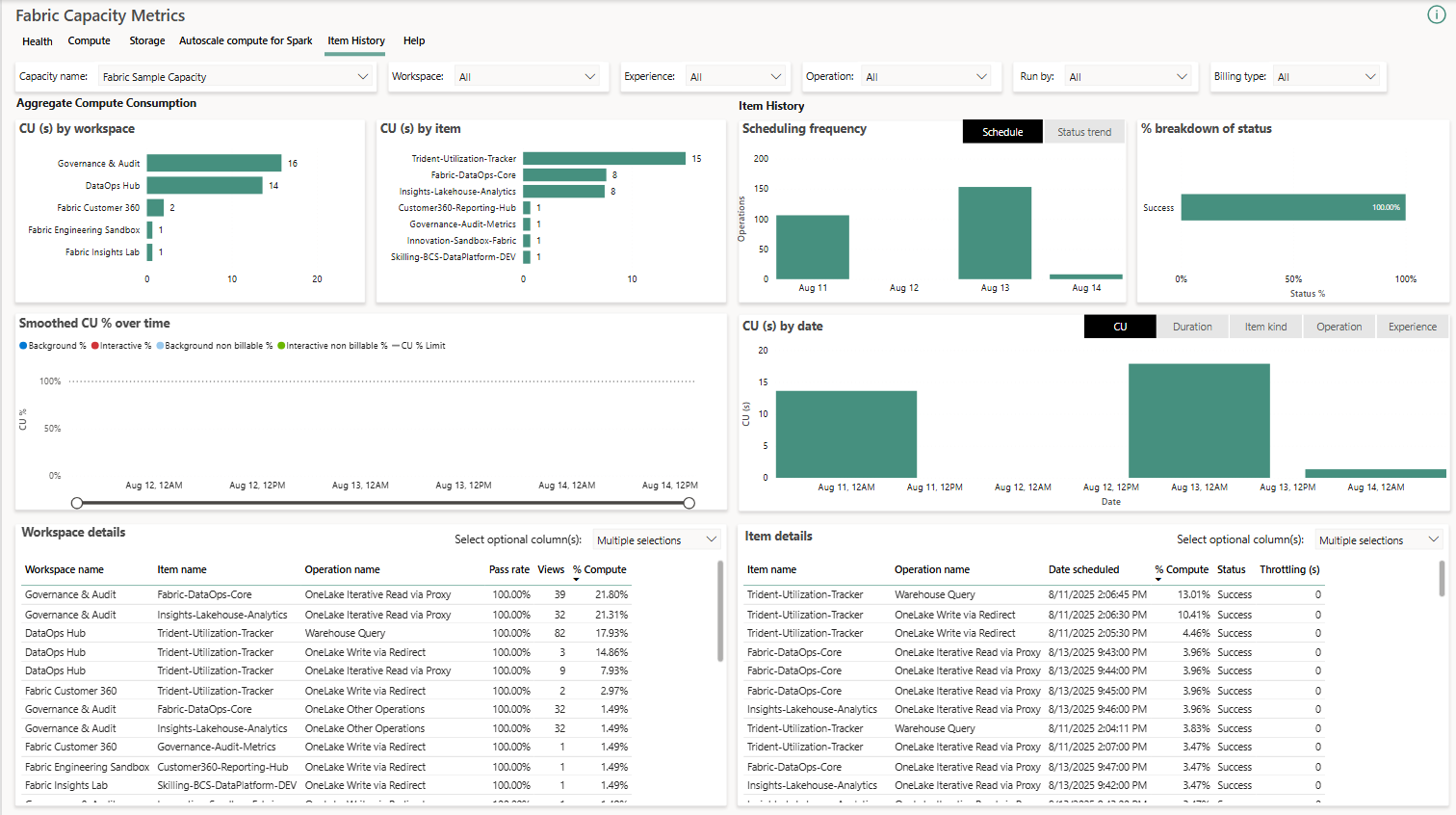

Pagsubaybay sa mga kapasidad, pagkonsumo at trabaho

Ang tela ay nagbibigay ng ilang mga patong ng kakayahang maobserbahan:

- Pagsubaybay sa lugar ng trabaho, na lumilikha ng database sa Fabric kung saan pinagsasama-sama ang mga log at sukatan mula sa maraming item (kabilang ang mga trabahong Kopyahin na may detalyadong pagsubaybay).

- Pagsubaybay sa workspace para sa trabahong pangkopyana may mga sukatan tulad ng throughput, dami ng data, mga error code at oras, na lahat ay nakatuon sa sentralisadong pagsusuri.

- Kasaysayan ng Aytem sa aplikasyon ng mga sukatan ng kapasidad, na may 30-araw na pagtingin sa pagkonsumo ng CU para sa bawat item, maaaring i-filter ayon sa workspace at uri.

- Proteksyon sa surge sa antas ng workspacena nagpapahintulot sa pagtatakda ng mga limitasyon sa pagkonsumo bawat workspace sa loob ng 24-oras na rolling window, awtomatikong hinaharangan ang mga lumalagpas sa mga ito, at minamarkahan ang mga workspace bilang "mahalaga sa misyon" upang maibukod ang mga ito sa mga limitasyon.

Bilang karagdagan dito, isang paunang hanay ng Mga Fabric Admin API nakatuon sa pagtuklas ng mga workspace, mga item at mga detalye ng access ng user, pagpapadali ng mga dynamic na imbentaryo at mga pana-panahong kontrol sa access.

Pagmomodelo ng negosyo, pagpaplano, at mga bagong workload

Higit pa sa teknikal na antas, ipinakikilala ng Microsoft mga bagong workload na nakatuon sa negosyo tungkol sa Fabric. Isa sa mga pinakakilala ay ang Fabric IQ, na naglalayong pag-isahin ang semantika ng negosyo, datos, at mga modelo para sa matatalinong ahente na gumagawa ng mga desisyon batay sa isang holistic na pananaw sa organisasyon.

Sa loob ng Fabric IQ, ang mga sumusunod ay lilitaw:

- Ontolohiya (paunang tanaw), isang uri ng aytem kung saan ang mga entity, relasyon, katangian, at limitasyon ay binibigyang kahulugan ayon sa lengguwahe ng negosyo ng kumpanya.

- Plano (preview), isang platapormang walang code para sa pagpaplano, pag-uulat, analytics, integrasyon, at pamamahala ng pakikipagtulungan.

Lumilitaw din ang Real-Time Intelligence tagabuo ng digital twin, isang aytem na dalubhasa sa pagmomodelo ng digital twins batay sa real-time na datos, na may layuning i-optimize ang mga pisikal na operasyon, pagsubaybay sa mga estado, at paggaya ng mga senaryo.

Sa kabilang banda, ipinakilala ito Trabaho sa trabaho ng Fabric IQ bilang isang hiwalay na workload, at ang mga tool sa suporta para sa pamamahala at semantic alignment ay patuloy na lumalawak, na nagsasara ng bilog sa pagitan ng mga modelo ng data, business logic at mga aplikasyon ng AI/analytics.

Mga pagpapabuti sa pagganap, karanasan ng gumagamit, at produktibidad

Bilang pagtatapos sa pagsusuring ito, mahalagang bigyang-diin ang ilang mga pagpapabuti sa iba't ibang aspeto na Hindi sila palaging nababalita, ngunit malaki ang impluwensya nila sa pang-araw-araw na buhay. ng mga koponan.

Sa seksyon ng Spark at distributed computing, ipinakikilala ng Fabric ang:

- Oras ng Pagtakbo ng Tela 2.0 (preview) gamit ang Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 at Python 3.12 sa Azure Linux 3.0.

- Kagamitan sa paghahambing ng Spark appna nagbibigay-daan sa iyong pumili at maghambing ng hanggang apat na pagpapatupad ng Spark nang magkasabay.

- Spark Diagnostic Emitter, na nangongolekta ng mga log, sukatan, at kaganapan mula sa mga application ng Spark at ipinapadala ang mga ito sa mga destinasyon tulad ng Event Hubs, storage, o Log Analytics.

- Aklatan ng mga diagnostic ng JobInsight, isang library para sa pagsusuri ng mga nakumpletong execution ng Spark sa pamamagitan ng mga API (mga query, trabaho, yugto, gawain, tagapagpatupad, mga event log).

Sa layer ng bodega, ang mga sumusunod ay idinaragdag: pagkumpol ng datos Upang mapabuti ang pagganap at mabawasan ang mga gastos sa pag-access, mga hanay ng IDENTITY para sa mga surrogate key, at kontrol sa bersyon at suporta sa CI/CD sa pamamagitan ng mga proyekto ng SQL Database sa VS Code (Warehouse source control).

Ang karanasan ng gumagamit ng Fabric portal ay nagbabago rin kasabay ng Pag-browse gamit ang tab at explorer ng bagayNagbibigay-daan ito sa iyong magbukas ng maraming item nang sabay-sabay at mabilis na lumipat sa pagitan ng mga ito. Ito, kasama ang mga pagpapabuti tulad ng Lakehouse auto-binding sa Git at ang suite ng mga utility para sa pagpapanatili ng Lakehouse (mga aktibidad sa pagpapanatili at pag-refresh ng SQL endpoint), ay nakakatulong sa isang mas user-friendly at maliksi na platform.

Panghuli, ang mga tampok tulad ng Maramihang pag-import/pag-export ng mga kahulugan ng item (para sa mga migration, template at metadata backup), REST para sa mga folder, suporta sa parameter sa mga item activation mula sa Activator, at paglo-load ng data ng OneLake sa Excel na may integrated catalog, ay kumukumpleto sa isang ecosystem na nagsisimulang sumaklaw sa halos lahat ng karaniwang pangangailangan ng isang modernong data team.

Gamit ang buong hanay ng mga kakayahan na ito—mula sa sentralisadong pamamahala, detalyadong seguridad, at matalinong orkestrasyon, hanggang sa AI na naka-embed sa SQL, real-time analytics, digital twins, at mga MCP agent—pinatitibay ng Microsoft Fabric ang posisyon nito bilang isang kumpletong platform ng data kung saan Ang susi ay hindi na lamang ang pag-iimbak at pagpapakita ng imahe ng datos, kundi pati na rin ang pamamahala, pag-automate, at paggamit ng AI upang kontrolin ang bawat bahagi ng siklo ng buhay ng datos.nagpapahintulot sa mga organisasyon na unti-unting paunlarin ang kanilang mga arkitektura, inililipat ang kung ano ang mayroon na sila at nagbibigay-daan sa mga bagong solusyon nang mas mabilis kaysa sa mga tradisyonal na pamamaraan.

Talaan ng nilalaman

- Microsoft Fabric at ang Cloud Adoption Framework: pamamahala, mga gastos, at automation

- Mga pangunahing update sa analytics, AI, at pamamahala para sa Microsoft Fabric

- Mga tungkulin ng AI sa Data Warehouse at mga tungkuling multimodal

- OneLake, Delta, Apache Iceberg at multiplatform access

- SQL Database sa Fabric: pagganap, seguridad, at virtualization

- Real-Time Intelligence, Eventhouse, Eventstream at Activator

- Mga kakayahan ng Copilot at AI sa buong platform

- Mga Ahente ng Datos ng Tela, MCP at mga tool ng developer

- Data Factory, paglilipat ng datos at orkestrasyon sa Fabric

- Seguridad, advanced na pamamahala, at pagsubaybay sa Fabric

- Pagmomodelo ng negosyo, pagpaplano, at mga bagong workload

- Mga pagpapabuti sa pagganap, karanasan ng gumagamit, at produktibidad