- Microsoft Fabric centraliza datos, gobierno, IA y analítica en tiempo real sobre OneLake y capacidades unificadas.

- La plataforma refuerza gobernanza, seguridad y coste mediante Purview, OneLake security, DLP, DSPM e integración con Azure Cost Management.

- Data Factory, Dataflow Gen2 y herramientas de migración facilitan mover cargas existentes y orquestar pipelines complejos.

- Copilot, data agents, MCP y nuevas workloads como Fabric IQ y Real-Time Intelligence impulsan escenarios avanzados de IA y automatización.

Si llevas tiempo trabajando con datos en el ecosistema de Microsoft, habrás visto que Microsoft Fabric se ha convertido en el eje central de la analítica moderna, unificando en una sola plataforma todo lo que antes estaba repartido entre Power BI, Azure Synapse, Data Factory y otros servicios. En este artículo vamos a repasar con calma y en profundidad las últimas novedades, la hoja de ruta y las implicaciones prácticas de Fabric para analítica, gobernanza, IA y tiempo real.

La idea es que, cuando termines de leer, tengas una visión clara de qué está ofreciendo hoy Microsoft Fabric, hacia dónde va y cómo afecta a la arquitectura de datos de tu organización: capacidades de gobierno con Purview, automatización con APIs y Git, nuevas funciones de IA, real-time intelligence, seguridad en OneLake, migraciones, rendimiento y mucho más.

Microsoft Fabric y el Cloud Adoption Framework: gobierno, costes y automatización

Dentro del Cloud Adoption Framework (CAF), Microsoft ha ido publicando una serie de guías para alinear el diseño de Microsoft Fabric con los pilares de diseño de landing zones. En la última parte de esta serie se abordan tres áreas clave: gobernanza, optimización de capacidad y automatización / DevOps.

En la parte de gobernanza, los costes de capacidad de Fabric se exponen a través de Azure Cost Management. Esto permite integrar de forma nativa los consumos de las capacidades F (y otras SKUs) en paneles de costes, alertas y análisis de gasto de Azure. No se trata solo de ver la factura: puedes cruzar esta información con tags, suscripciones o grupos de recursos para entender quién está gastando qué y por qué.

La arquitectura técnica y el modelo comercial de Fabric permiten a los clientes controlar muy fino el consumo de capacidad para optimizar costes operativos. En la práctica, esto se traduce en varias palancas:

- Escalado de capacidades F: subir o bajar capacidad en función de picos predecibles, como campañas comerciales, cierres contables o grandes cargas de datos.

- Pausar y reanudar capacidades: los administradores de Fabric pueden pausar una capacidad F cuando no se necesita (por ejemplo, por la noche o los fines de semana en entornos no críticos) para recortar gasto de cómputo.

- Protección frente a picos (surge protection): dos parámetros a nivel de capacidad controlan cómo se gestionan los trabajos en segundo plano para evitar que saturen el entorno: Background Rejection Threshold y Background Recovery Threshold.

- Reservas de capacidad: es posible reservar capacidad durante periodos definidos para obtener descuentos, siempre que se planifique con rigor el consumo esperado.

En el ámbito de gobierno de datos, Fabric se apoya en Microsoft Purview como pieza central para catálogo, linaje y clasificación. Desde Purview es posible aplicar etiquetas de sensibilidad, ver el linaje entre orígenes, transformaciones y consumos, certificar activos de datos o impulsar campañas de calidad de datos, todo ello integrando los elementos de Fabric (Lakehouse, Warehouse, KQL, Power BI, etc.).

La parte de «Platform Automation y DevOps» se articula principalmente en torno a integración con Git, pipelines de despliegue y APIs REST. Los espacios de trabajo de Fabric pueden vincularse con repositorios Git para que varios desarrolladores colaboren en el mismo proyecto de ingeniería de datos, ciencia de datos o analítica en tiempo real sin pisarse el trabajo.

Git y los Deployment Pipelines permiten orquestar ciclos de vida de desarrollo, prueba y producción de forma controlada: promoción de contenidos, revisión de cambios, sincronización de artefactos y gestión de versiones. Desde marzo de 2025, estos pipelines dan soporte (en estado general o en preview) a una lista amplia de tipos de elementos como activadores, paneles, dataflows, data pipelines, datamarts, lakehouses, warehouses, KQL, notebooks, informes paginados, aplicaciones de organización, etc.

En paralelo, Fabric expone un conjunto muy amplio de APIs REST con las que automatizar casi cualquier tarea administrativa o de despliegue: creación de espacios de trabajo y carpetas, migración masiva de items, gestión de conexiones y gateways, extracción de definiciones, activación de pipelines o notebooks, entre otras cosas.

Novedades clave en analítica, IA y gobernanza de Microsoft Fabric

La evolución de Fabric viene marcada por un número enorme de funciones en preview y nuevas capacidades que tocan prácticamente todas las áreas de la plataforma. A continuación se agrupan y comentan de forma estructurada para que se vea todo el alcance.

Funciones de IA en Data Warehouse y funciones multimodales

En el área de datos relacionales, Fabric Data Warehouse incorpora funciones de IA directamente en T‑SQL (preview). Esto permite:

- Clasificar o categorizar texto.

- Analizar sentimiento.

- Extraer información estructurada a partir de texto libre.

- Traducir texto entre idiomas.

- Corregir gramática.

El objetivo es que no haya que salir del contexto SQL para enriquecer los datos con IA. Estas funciones se combinan con un soporte multimodal más general en las AI functions de Fabric, que ahora pueden procesar imágenes (JPG/JPEG, PNG, GIF, WebP), PDFs y formatos de texto habituales, además de inputs en forma de rutas de ficheros.

Se incluyen utilidades como aifunc.load para ingesta de carpetas a tablas con opción de prompt y esquema, aifunc.list_file_paths para recorrer rutas de ficheros y ai.infer_schema para inferir esquemas compatibles con ai.extract. Todo esto permite transformar y enriquecer datos sin construir canalizaciones complejas desde cero.

OneLake, Delta, Apache Iceberg y accesos multiplataforma

En la capa de almacenamiento, OneLake sigue siendo el lago unificado donde se asienta todo Fabric. Una de las grandes mejoras es la capacidad de exponer tablas Delta Lake como tablas Apache Iceberg sin mover ni duplicar datos, de forma que motores compatibles con Iceberg puedan leer directamente lo que hay en OneLake.

Además, OneLake soporta ahora datos Apache Iceberg escritos directamente por Snowflake, consumidos en Fabric mediante accesos sin copia. Esta estrategia refuerza la interoperabilidad: Fabric no quiere ser un silo, sino un «hub» de datos que otros motores puedan explotar sin duplicar almacenamiento.

En esta misma línea, OneLake admite atajos (shortcuts) a Azure Blob Storage, OneDrive y SharePoint, y extiende la seguridad con roles de acceso, seguridad a nivel de carpeta, fila y columna, y un modelo de seguridad que terceros pueden respetar gracias a la extensión del modelo de motor autorizado.

Un punto especialmente relevante es la federación del catálogo OneLake en Azure Databricks, que habilita acceso cero copia desde Unity Catalog a las tablas de OneLake. De esta forma OneLake sigue siendo la fuente de verdad, pero Databricks puede consultar los datos directamente, sincronizando solo el metadato.

SQL Database en Fabric: rendimiento, seguridad y virtualización

El SQL database de Fabric va ganando capacidades propias: ALTER DATABASE SET options, soporte de intercalaciones (collation) y full-text indexing en preview. A nivel de rendimiento de bases de datos y coste, hay varias mejoras:

- Compactación automática de índices para reducir almacenamiento, I/O y mejorar tiempos de consulta sin tener que programar jobs de mantenimiento.

- Límite de vCores máximo para controlar el uso de cómputo (4 o 32 vCores), pensado para evitar que un workload consuma de más en capacidades compartidas.

- Pools SQL personalizados que dan a los administradores de espacio de trabajo control granular sobre la asignación de recursos y el ruteo de consultas por nombre de aplicación.

También se habilita la virtualización de datos en SQL database, que permite consultar datos externos almacenados en OneLake con T‑SQL, uniendo ficheros en formatos habituales con tablas relacionales locales mediante joins, sin tener que importar los datos físicamente.

En el apartado de seguridad, SQL database soporta Private Link a nivel de tenant (preview), lo que facilita canalizar el tráfico de datos de manera privada y controlada, integrándose con la configuración general de red segura de Fabric.

Real-Time Intelligence, Eventhouse, Eventstream y Activator

El bloque de Real-Time Intelligence (RTI) se ha convertido en uno de los grandes diferenciales de Fabric. Eventhouse y Eventstream se combinan para ingestar, procesar y activar eventos en tiempo real desde todo tipo de fuentes, y Activator orquesta las acciones que se disparan ante ciertas condiciones.

Entre las novedades más potentes destacan:

- Detección de anomalías sin código con selección automática de modelo, interfaz sencilla y alertas flexibles.

- Business Events, que capturan momentos clave del negocio generados desde User Data Functions y Notebooks, y permiten activar alertas, lógica personalizada, flujos, modelos de IA o trabajos Spark.

- Integración Activator-User Data Functions, de modo que funciones creadas en Fabric pueden procesar eventos de cualquier origen, incluidos eventos internos de la propia plataforma y de OneLake.

- Capacidad de procesar eventos con SQL (SQL Operator en Eventstream), permitiendo transformar flujos en tiempo real con sintaxis SQL conocida.

Se añaden conectores relevantes como Cribl (para ingestión de log y telemetría desde múltiples fuentes), un conector con Solace PubSub+, y soporte de streaming sobre redes privadas mediante Azure Virtual Network, VPN, ExpressRoute o endpoints privados.

Para esquemas y contratos de datos, Eventstream introduce un Schema Registry que define y valida esquemas de eventos para canalizaciones más robustas, y soporte del Confluent Schema Registry para conectar con Kafka en Confluent Cloud respetando los contratos existentes.

Copilot y capacidades de IA en toda la plataforma

Copilot en Fabric ya está disponible de forma global, con presencia en Power BI, Data Factory, Data Science & Data Engineering y escritura de consultas KQL. Además, se han ido incorporando capacidades específicas:

- Copilot para Dataflow Gen2 (Modern Get Data), que ayuda a ingestar y transformar datos con instrucciones en lenguaje natural.

- Copilot para Data Warehouse (chat), accesible desde un botón en la cinta para acelerar tareas de warehousing mediante diálogo.

- Copilot para SQL analytics endpoint, que genera y optimiza consultas SQL a partir de descripciones de negocio.

- Copilot en notebooks con conocimiento del contexto de workspace, lakehouse, estructura del notebook y entorno de ejecución, capaz de generar código multistep, refactorizar, resumir cuadernos complejos y diagnosticar errores con la opción «Fix with Copilot».

- Autocompletado en línea (inline code completion) y Notebook Copilot inline code completion (preview), para escribir Python de forma más rápida y con menos errores.

Además, se está ampliando la base tecnológica de IA con prebuilt Foundry Tools integradas (Azure OpenAI, Azure Language, Azure Translator), plugins de OpenAI para Eventhouse (ai_embed_text y ai_chat_completion) y una serie de agentes y data agents que permiten que otras aplicaciones, incluido Copilot Studio, trabajen sobre datos de Fabric de manera orquestada.

Fabric Data Agents, MCP y herramientas para desarrolladores

Fabric introduce data agents capaces de orquestar acceso a datos y herramientas para agentes de IA, con SDK en Python y una integración directa con Microsoft Copilot Studio. Esto facilita construir asistentes conversacionales que trabajen con datos empresariales gobernados en Fabric.

En paralelo, el Model Context Protocol (MCP) se convierte en una pieza clave de la integración entre agentes de IA y servicios de Fabric. Existen servidores MCP dedicados para Activator y Eventhouse, y un Fabric MCP orientado a desarrollo que:

- Permite a asistentes de IA generar código y contenido de items de Fabric.

- Se integra con herramientas de desarrollo como VS Code y GitHub Codespaces.

- Expone herramientas para consultar y actuar sobre datos en tiempo real en Eventhouse.

Para el día a día del desarrollador, hay varias piezas a destacar, incluido el entorno de desarrollo: MSSQL extension para VS Code con soporte para SQL database de Fabric, el Microsoft ADO.NET Driver y el ODBC Driver para Fabric Data Engineering (conexión a Spark SQL vía Livy), y un conector Spark para SQL databases que simplifica el acceso autenticado desde Spark a bases de datos SQL en Azure y en Fabric.

También aparece el Fabric CLI, disponible como tarea integrada en Azure DevOps, que permite automatizar gestión de espacios de trabajo, items y despliegues sin instalar herramientas externas de forma manual.

Data Factory, migraciones y orquestación de datos en Fabric

La capa de integración de datos de Fabric se apoya en Data Factory y Dataflow Gen2, que van recibiendo funciones para que la orquestación sea más inteligente, más automatizable y con migraciones más sencillas desde plataformas existentes.

Dataflow Gen2: rendimiento, APIs públicas y diagnósticos

En Dataflow Gen2 encontramos varias funciones en preview:

- Edición avanzada de consultas de destino para ajustar la lógica en destino directamente desde el propio entorno de autoría.

- Partitioned compute, que permite que partes del dataflow se ejecuten en paralelo, reduciendo el tiempo total de evaluación.

- Descarga de diagnósticos a nivel de ejecución, con paquetes de logs estructurados para análisis de rendimiento y resolución de incidencias.

- APIs públicas para creación, actualización, borrado, planificación y monitorización de dataflows de forma programática.

- Parámetros públicos con soporte CI/CD, que permiten refrescar dataflows pasando valores desde pipelines u otros orígenes.

- Reciente data para acceso rápido a elementos usados recientemente en la cinta de Power Query y en Modern Get Data.

Todo esto se complementa con capacidades de evaluar Power Query de forma programática vía REST, lo que abre la puerta a ejecutar scripts M como parte de procesos automatizados, integrarlos con Spark, pipelines o herramientas externas, aprovechando los conectores de Power Query.

Data Factory: rendimiento adaptativo, conectividad y dbt

En la parte más «clásica» de integración, Data Factory dentro de Fabric introduce:

- Adaptive performance tuning para copy activity, que ajusta de forma inteligente parámetros de rendimiento según la configuración y el contexto de ejecución.

- Soporte de Change Data Capture (CDC) en Copy job, para replicar solo cambios (inserts, updates, deletes) de forma continua.

- Gateways on‑premises con opción de actualización manual administrada desde el portal de Fabric, API o scripts.

- Conexión reciente (connection recency), que añade propiedades de último uso a las conexiones para facilitar auditoría y gestión de ciclo de vida.

- dbt Job nativo, que permite ejecutar proyectos dbt dentro de Fabric con orquestación, pruebas, documentación y gobierno integrados.

- Invoke SSIS Package activity en pipelines, para ejecutar paquetes SSIS desde la propia orquestación en Fabric.

También se refuerza la experiencia de usuario con un selector de sitios SharePoint (SharePoint Site Picker) que evita teclear URLs a mano, y con soporte MCP para Data Factory, de forma que asistentes de IA puedan crear y desplegar Dataflow Gen2 simplemente a partir de instrucciones en lenguaje natural.

Herramientas de migración y replicación de datos

Microsoft está empujando fuerte la migración hacia Fabric mediante varias herramientas específicas:

- Fabric Migration Assessment para Data Factory, que analiza la preparación de pipelines ADF y migra los soportados a un workspace de Fabric con mapeo de conexiones.

- Migration Assistant para Data Warehouse, que ya puede conectarse directamente al almacén origen para moverlo a Fabric Data Warehouse.

- Migration Assistant para SQL database, orientado a migrar cargas de SQL Server on-premises, con importación de esquemas vía DACPAC, detección de incompatibilidades y recomendaciones.

En cuanto a replicación, se da soporte a mirroring de varias fuentes operacionales (Azure Database for MySQL, Google BigQuery, SQL Server, etc.) hacia Fabric, con posibilidad de controlar qué tablas se replican, reiniciar procesos de mirroring por REST y, en el caso de Databricks, mapear políticas de Unity Catalog a OneLake security.

También se incluye un conector de replicación desde Lakehouse usando Delta Change Data Feed, que expone cambios de tablas Delta de Lakehouse hacia destinos compatibles sin tener que reinventar la rueda con soluciones caseras de CDC.

Seguridad, gobernanza avanzada y monitorización en Fabric

Una de las grandes preocupaciones en cualquier plataforma analítica es cómo asegurar el dato, gobernar el uso y monitorizar el consumo de recursos. Fabric está madurando rápido en estos frentes.

Seguridad en OneLake y protección de datos

OneLake añade un modelo completo de seguridad de acceso a datos con:

- Roles de acceso a datos para lakehouse con permisos configurables desde una interfaz de seguridad por carpetas.

- Soporte de seguridad de atajos (shortcuts) para que terceros puedan respetar las políticas definidas.

- API de seguridad de acceso a datos en OneLake, que permite automatizar la gestión de permisos.

- Extensión del modelo a motores externos (autorización de OneLake security para terceros).

En paralelo, se amplía la protección con DLP restrict access sobre todos los datos estructurados en OneLake (SQL, KQL, warehouses) y se introduce DSPM for AI para Fabric Copilots y data agents, que monitoriza interacciones de IA en busca de información sensible y comportamientos de riesgo, con integración con Purview Audit y eDiscovery.

En el plano de identidad, aparecen características como las identidades asociadas a items (por ejemplo, Lakehouse y Eventstream) vía API REST, que eliminan la dependencia del propietario para ciertas operaciones, y la autenticación de shortcuts de OneDrive y SharePoint mediante identidades de workspace o service principals.

Gobernanza centralizada y catálogo OneLake

La experiencia de gobierno de datos se refuerza con un nuevo panel centralizado en el catálogo de OneLake, donde los propietarios de datos pueden ver una visión agregada de los items que han creado, recibir recomendaciones de acciones de gobierno y acceder a todas las herramientas disponibles para mejorar seguridad y cumplimiento.

Además, se habilita una API de búsqueda del catálogo OneLake junto con una herramienta MCP, que permiten descubrir items en todo el entorno de Fabric desde código o desde agentes de IA, en una sola llamada, respetando permisos y metadatos del catálogo.

Monitorización de capacidades, consumos y trabajos

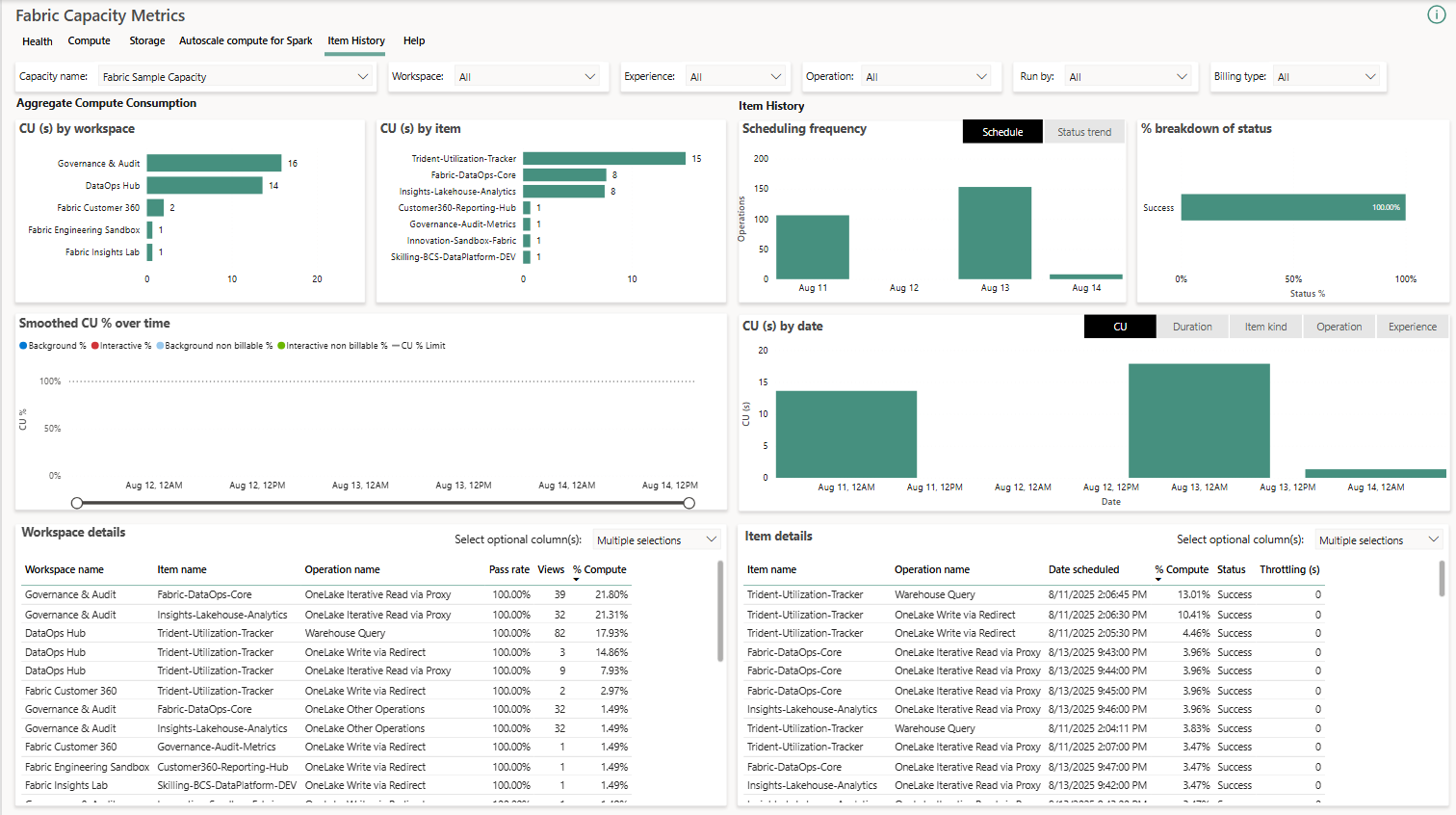

Fabric proporciona varias capas de observabilidad:

- Workspace monitoring, que crea una base de datos en Fabric donde se consolidan logs y métricas de múltiples items (incluyendo Copy jobs con monitorización detallada).

- Workspace monitoring para Copy job, con métricas como throughput, volumen de datos, códigos de error y tiempos, todo orientado a análisis centralizados.

- Item History en la aplicación de métricas de capacidad, con vistas de 30 días sobre el consumo de CUs de cada item, filtrables por workspace y tipo.

- Workspace-level surge protection, que permite fijar umbrales de consumo por workspace en una ventana móvil de 24 horas, bloquear automáticamente a los que se exceden y marcar espacios de trabajo como «críticos» (mission critical) para excluirlos de las limitaciones.

Complementando esto, se publica un conjunto inicial de Fabric Admin APIs centradas en descubrir espacios de trabajo, items y detalles de acceso de usuarios, facilitando inventarios dinámicos y controles de acceso periódicos.

Modelado de negocio, planificación y nuevas cargas de trabajo

Más allá de la capa técnica, Microsoft está introduciendo nuevas cargas de trabajo orientadas a negocio sobre Fabric. Una de las más destacadas es Fabric IQ, que busca unificar semántica de negocio, datos y modelos para agentes inteligentes que tomen decisiones basadas en una vista holística de la organización.

Dentro de Fabric IQ aparecen:

- Ontology (preview), un tipo de item donde se definen entidades, relaciones, propiedades y restricciones según el lenguaje de negocio de la compañía.

- Plan (preview), una plataforma sin código para planificación, reporting, analítica, integración y gestión colaborativa.

En Real-Time Intelligence surge también digital twin builder, un item especializado en modelar digital twins basados en datos en tiempo real, con el objetivo de optimizar operaciones físicas, monitorizar estados y simular escenarios.

Por otro lado, se introduce Fabric IQ workload como carga de trabajo separada, y se siguen expandiendo herramientas de apoyo para gobierno y alineamiento semántico, cerrando el círculo entre modelos de datos, lógica de negocio y aplicaciones de IA/analítica.

Rendimiento, experiencia de usuario y mejoras de productividad

Para cerrar el repaso, merece la pena destacar una serie de mejoras transversales que no siempre salen en los titulares, pero marcan mucho el día a día de los equipos.

En la parte de Spark y cómputo distribuido, Fabric introduce:

- Fabric Runtime 2.0 (preview) con Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 y Python 3.12 sobre Azure Linux 3.0.

- Comparador de aplicaciones Spark, que permite seleccionar y comparar hasta cuatro ejecuciones de Spark en paralelo.

- Spark Diagnostic Emitter, que recoge logs, métricas y eventos de aplicaciones Spark y los envía a destinos como Event Hubs, almacenamiento o Log Analytics.

- JobInsight diagnostics library, una librería para analizar ejecuciones completadas de Spark vía APIs (consultas, jobs, stages, tareas, ejecutores, event logs).

En la capa de warehouse, se añaden clusterización de datos para mejorar rendimiento y reducir costes de acceso, columnas IDENTITY para claves sustitutas, y soporte de control de versiones y CI/CD mediante projectos SQL Database en VS Code (Warehouse source control).

La experiencia de usuario del portal de Fabric también evoluciona con navegación por pestañas y explorador de objetos, permitindo abrir varios items a la vez y cambiar entre ellos de forma rápida. Esto, unido a mejoras como el auto-binding de lakehouse en Git o la suite de utilidades para mantenimiento de Lakehouse (actividades de mantenimiento y refresco del endpoint SQL), contribuye a que la plataforma sea más cómoda y ágil.

Por último, funcionalidades como Bulk import/export de definiciones de items (para migraciones, plantillas y backups de metadatos), REST para carpetas, soporte de parámetros en activaciones de items desde Activator, y carga de datos de OneLake en Excel con catálogo integrado, terminan de redondear un ecosistema que empieza a cubrir prácticamente todas las necesidades habituales de un equipo de datos moderno.

Con todo este conjunto de capacidades —desde gobierno centralizado, seguridad detallada y orquestación inteligente, hasta IA embebida en SQL, analítica en tiempo real, twins digitales y agentes MCP— Microsoft Fabric se consolida como una plataforma de datos completa donde la clave ya no es solo almacenar y visualizar, sino gobernar, automatizar y explotar con IA cada parte del ciclo de vida del dato, permitiendo a las organizaciones evolucionar sus arquitecturas poco a poco, migrando lo que ya tienen y habilitando nuevas soluciones mucho más rápido que en los enfoques tradicionales.

Tabla de Contenidos

- Microsoft Fabric y el Cloud Adoption Framework: gobierno, costes y automatización

- Novedades clave en analítica, IA y gobernanza de Microsoft Fabric

- Funciones de IA en Data Warehouse y funciones multimodales

- OneLake, Delta, Apache Iceberg y accesos multiplataforma

- SQL Database en Fabric: rendimiento, seguridad y virtualización

- Real-Time Intelligence, Eventhouse, Eventstream y Activator

- Copilot y capacidades de IA en toda la plataforma

- Fabric Data Agents, MCP y herramientas para desarrolladores

- Data Factory, migraciones y orquestación de datos en Fabric

- Seguridad, gobernanza avanzada y monitorización en Fabric

- Modelado de negocio, planificación y nuevas cargas de trabajo

- Rendimiento, experiencia de usuario y mejoras de productividad