- AI gør det muligt at opdage og reagere på cybertrusler og fysisk kriminalitet med større hastighed, præcision og kontekst.

- Angribere bruger også kunstig intelligens til svindel, deepfakes og automatisering af udnyttelse af sårbarheder.

- Beskyttelse af AI kræver sikring af data, modeller og API'er med fuld synlighed på tværs af hybrid- og multicloud-miljøer.

- Integrering af sikkerhed gennem design og fokus på robusthed gør AI til en reel konkurrencefordel.

La kunstig intelligens anvendt til sikkerhed Det er blevet et af de største samtaleemner i virksomheder, offentlige forvaltninger og retshåndhævende myndigheder. Skiftet til skyen, hybridmiljøer og den massive vækst af data har fuldstændig ændret spillereglerne, og angribere udnytter dette med halsbrækkende hastighed.

Samtidig åbner AI et enormt vindue af muligheder: fra opdage cyberangreb i realtid Dette inkluderer at forudse fysisk kriminalitet i specifikke områder og automatisere kedelige opgaver i sikkerhedsoperationscentre. Alt dette potentiale indebærer dog meget alvorlige risici, hvis selve AI'en, dens data og de omkringliggende grænseflader ikke er ordentligt beskyttet.

Det nye trusselsbillede og hvorfor AI er nøglen

Det nuværende cybertrusselsmiljø er meget mere kompleks og aggressiv hvilket var for blot et par år siden. Den massive migrering til skyen og hybridarkitekturer har fået antallet af angrebsflader til at stige voldsomt: nu er data spredt på tværs af lokale datacentre, forskellige cloududbydere og edge-miljøer, hvilket i høj grad komplicerer kontrollen.

Denne ændring falder sammen med en klar mangel på cybersikkerhedsprofessionelleAlene i USA er der hundredtusindvis af ubesatte stillinger, hvilket resulterer i overbelastede teams med begrænset tid til dybdegående research og tvunget til at prioritere forhastet.

Resultatet er, at angrebene finder sted i dag. hyppigere og dyrereNylige rapporter placerer gennemsnitlige globale omkostninger ved et databrud overstiger 4 millioner dollars, med kumulative tocifrede stigninger på bare tre år. Når man analyserer AI's indvirkning på disse hændelser, er forskellen slående: organisationer, der ikke bruger AI i deres sikkerhedsstrategi, betaler i gennemsnit betydeligt mere pr. brud end dem, der gør.

Virksomheder, der har AI-baserede sikkerhedsfunktioner De formår at reducere de gennemsnitlige omkostninger ved et databrud med hundredtusindvis af dollars. Selv delvis eller begrænset AI-kontrol repræsenterer en betydelig besparelse sammenlignet med dem, der ikke har investeret noget i dette område.

I denne sammenhæng er AI ikke bare "en bonus": den er ved at blive en essentielt strategisk stykke at kunne overvåge store mængder sikkerhedsinformation, opdage unormal adfærd og reagere på hændelser, før de eskalerer.

Hvordan cyberkriminelle bruger kunstig intelligens

Den anden side af medaljen er, at de samme fremskridt inden for AI, der hjælper med forsvar, også er blevet gjort hurtigt overtaget af angribereEvnen til at generere overbevisende falsk indhold til lave omkostninger ændrer svindel, desinformation og endda personlig afpresning.

På den ene side giver avancerede tekstgeneratorer dig mulighed for at oprette falske nyheder, phishing-e-mails Og højglanspolerede social engineering-beskeder, skræddersyet til offerets kontekst og skrevet i en stil, der efterligner journalisters eller erhvervslederes. Vi taler ikke længere om e-mails fyldt med fejl, men snarere om yderst troværdig kommunikation.

På den anden side værktøjerne til at skabe deepfakes af video og lyd De har taget et kæmpe spring fremad. Med specialiseret software kan angribere indsætte ansigter oven på rigtige videoer (deepfaces) eller klone stemmer (deepvoices) med et niveau af realisme, der nemt narrer enhver, der ikke er forberedt.

Et illustrativt tilfælde er telefonsvindel baseret på stemmekloning af et familiemedlemEfter at have fået fat i lydoptagelser af en person, træner de kriminelle en model, der er i stand til at imitere personens tone, accent og måde at tale på. De ringer derefter til en slægtning, udgiver sig for at være det pågældende familiemedlem, opdigter en nødsituation og anmoder om en hurtig pengeoverførsel. Når offeret genkender stemmen, sænker offeret fuldstændig paraderne.

Ud over direkte bedrag bruges AI også til automatiser opdagelse af sårbarhederDette inkluderer at perfektionere brute-force-angreb mod legitimationsoplysninger eller skrive ondsindet kode. Retshåndhævende myndigheder og organisationer som FBI har allerede registreret en klar stigning i indtrængen relateret til ondsindet brug af generativ AI, og mange cybersikkerhedsprofessionelle anerkender, at en betydelig del af væksten i angreb netop skyldes disse nye værktøjer.

AI-applikationer inden for cybersikkerhed: fra endpoint til cloud

Stillet over for denne øgede risiko transformerer AI også cyberforsvar på tværs af hele teknologistakkenVirksomheder integrerer maskinlæringsfunktioner i endpoint-løsninger, firewalls, SIEM-platforme og cloud-specifikke værktøjer.

I brugerens ende er løsningerne fra AI-drevet endpoint-sikkerhed De analyserer løbende processers, filers og forbindelsers opførsel. I stedet for udelukkende at stole på signaturer, lærer de, hvad der er "normalt" på hver enhed, og registrerer mistænkelige afvigelser, såsom pludselig udførelse af ukendte scripts eller massekryptering af filer, der er typisk for ransomware.

Næste generations AI-baserede firewalls (NGFW'er med intelligente funktioner) er i stand til at inspicer krypteret trafik, opdag unormale mønstre og korrelere hændelser på tværs af flere porte og protokoller. Dette muliggør afbrydelse af kommunikationen med kommando- og kontrolservere eller blokering af dataeksfiltreringsforsøg, der ellers ville gå uopdaget hen.

På det globale overvågningslag, platformene for Security Information and Event Management (SIEM) Og XDR-løsninger genererer tusindvis af advarsler dagligt. AI bruges til at prioritere, gruppere relaterede hændelser og omdanne den lavine af rådata til et par hændelser med stor indflydelse, der virkelig fortjener øjeblikkelig opmærksomhed.

Derudover implementeres de i cloud-miljøer AI-baserede målrettede sikkerhedsløsninger Disse teknologier identificerer fejlkonfigurationer, overdrevne tilladelser eller usædvanlig databevægelse mellem regioner og tjenester. Derudover overvåger AI-drevne Network Detection and Response (NDR)-teknologier intern netværkstrafik for adfærd, der er typisk for en angriber, der allerede er inde i systemet.

Fordele ved AI for sikkerhedsteams

Cybersikkerhedsteams står over for en dobbelt udfordring: at håndtere en enorm mængde data og en stigende teknisk kompleksitetHer er AI blevet en vigtig allieret til at gøre mere med de samme ressourcer.

En af de klareste fordele er meget hurtigere trusselsdetekteringHvor en analytiker tidligere skulle gennemgå hændelser manuelt, lærer algoritmer nu angrebsmønstre, brugervaner og typisk systemadfærd. Dette giver dem mulighed for at identificere kritiske hændelser på få sekunder, selv når de manifesterer sig som en kombination af subtile signaler spredt på tværs af forskellige datakilder.

Et andet nøglepunkt er reduktion af falsk positive og falsk negative resultaterVed hjælp af mønstergenkendelse, anomalidetektion og kontinuerlige læringsteknikker filtrerer AI "støjen" fra irrelevante advarsler fra og fokuserer på dem, der virkelig udgør en trussel. Dette forhindrer teams i at brænde ud ved at reagere på advarsler, der i sidste ende ikke fører nogen vegne.

Generativ AI ændrer også den måde, analytikere arbejder med information på. Ved at være i stand til oversætte tekniske data til naturligt sprogVærktøjerne kan producere klare rapporter, der nemt kan deles med ledere eller andre afdelinger, forklare, hvad en specifik sårbarhed indebærer, eller detaljere de anbefalede trin til at rette den.

Denne evne til at præsentere information på en forståelig måde og styre svaret gør det Junioranalytikere kan påtage sig mere komplekse opgaver uden at skulle mestre forespørgselssprog eller avancerede værktøjer fra dag ét. I praksis genererer AI afhjælpningstrin, konkrete forslag og yderligere kontekst, der accelererer læringskurven.

Endelig giver AI et mere komplet overblik over miljøet aggregerede og korrelerede data af sikkerhedsregistre, netværkstrafikCloud-telemetri og eksterne trusselsinformationskilder hjælper med at afsløre angrebsmønstre, der ellers ville gå ubemærket hen fra et enkelt system.

Godkendelse, adgangskoder og adfærdsanalyse

Ud over indtrængningsdetektion ændrer AI den måde, vi Identiteter er beskyttet, og adgang administreresTraditionelle adgangskoder findes stadig, men de kombineres i stigende grad med adfærdsanalysemodeller og yderligere faktorer drevet af AI.

AI bruges i systemer af adaptiv godkendelse De vurderer konteksten for hvert login: placering, enhed, tidspunkt, brugshistorik, skrivehastighed og andre faktorer. Hvis noget virker usædvanligt, øger systemet sikkerhedsniveauet ved at anmode om yderligere oplysninger eller blokere sessionen.

Parallelt hermed tillader adfærdsanalyseløsninger opdage phishing-forsøg eller kompromitterede konti ved at undersøge, hvordan brugere interagerer med applikationer, hvilke ressourcer de tilgår, og hvordan de navigerer på netværket. En betydelig ændring i disse mønstre kan indikere, at nogen bruger stjålne loginoplysninger.

Sårbarhedsstyring er også afhængig af AI for at gå ud over de typiske endeløse lister over fejl. Modellerne analyserer hvilke sårbarheder der er mest sandsynlige at blive udnyttet baseret på angribernes faktiske aktivitet, tilgængeligheden af offentlige angreb og eksponeringen af hvert aktiv, hvilket hjælper med at prioritere patching-indsatsen.

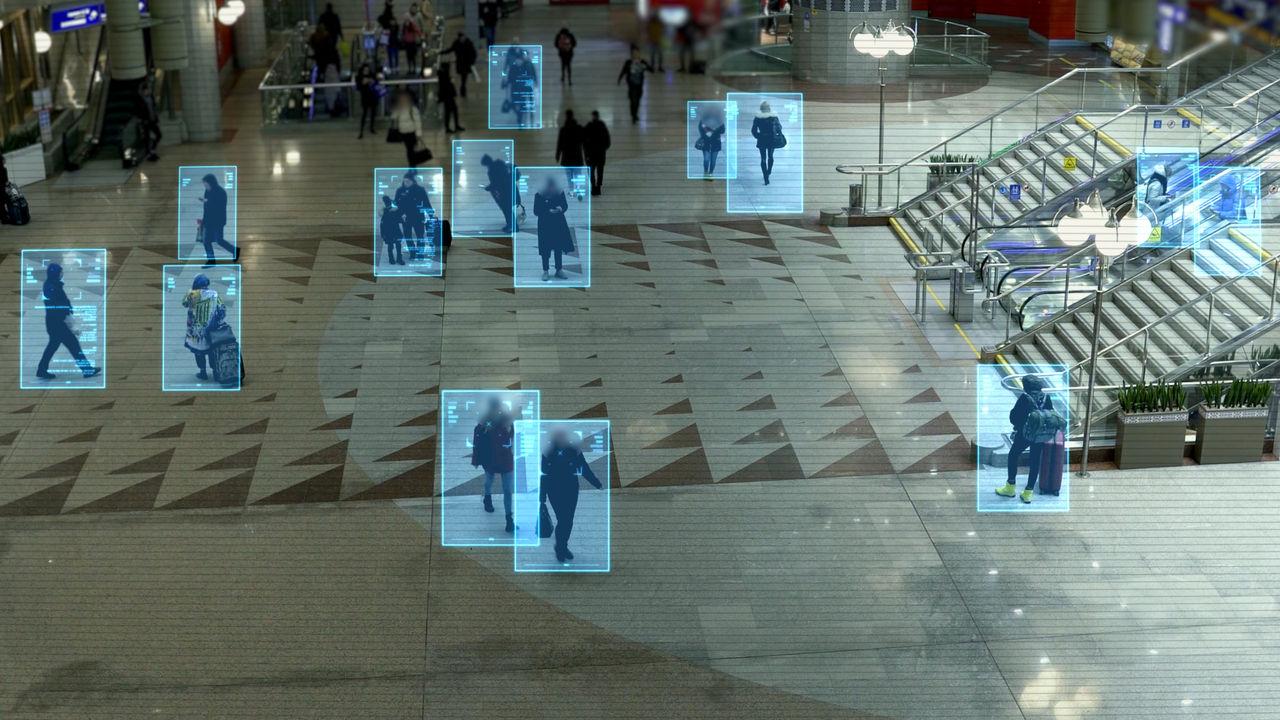

I fysiske miljøer, den overvågning med kameraer og sensorer Den er drevet af AI-modeller, der er i stand til at opdage mistænkelig adfærdIdentifikation af nummerplader, genkendelse af bevægelsesmønstre eller advarsler om usædvanlige forsamlinger. Ved at kombinere disse oplysninger med historiske data og kontekst kan tidlige varslingssystemer aktiveres i områder med høj kriminalitetsaktivitet.

Kriminalitetsforebyggelse og -forudsigelse i den fysiske verden

Uden for cyberspace er kunstig intelligens også begyndt at spille en vigtig rolle i kriminalitetsforebyggelse i bymiljøerVed at analysere store mængder historiske data kan myndighederne identificere mønstre, der hjælper dem med bedre at planlægge ressourcer.

Blandt de mest almindelige anvendelser er analyse af kriminalitetsmønstreDisse oplysninger hjælper med at bestemme, hvilke typer kriminalitet der er koncentreret i bestemte områder, på hvilke tidspunkter de er hyppigst, og hvordan de udvikler sig over tid. De bruges til at justere patruljer, forbedre belysningen, installere yderligere kameraer og udforme målrettede forebyggelseskampagner.

AI bruges også i tidlige varslingssystemer Disse systemer kombinerer realtidsdata (kameraer, sensorer, sociale medier, endda vejrvariabler) for at estimere, hvornår bestemte hændelser er mest sandsynlige. Selvom de ikke er ufejlbarlige, kan de hjælpe med at forudse risikoscenarier.

Inden for forskningsområdet tillader algoritmer udføre digital retsmedicinsk analyse De bruger store mængder retsmedicinske data (fingeraftryk, DNA, sagsregistre, anholdelseshistorik) til at identificere forbindelser, der ville være meget vanskelige at se ved første øjekast. Dette giver dem mulighed for at forbinde tilsyneladende uafhængige sager eller forfine søgningen efter mistænkte.

Al denne implementering skal konstant afbalanceres med respeto a la privacidad y a los derechos humanosRisikoen for bias i træningsdata er reel: Hvis modeller fodres med allerede forudindtagede politiregistre, kan de forstærke eksisterende diskrimination ved at "forudsige" mere kriminalitet i bestemte lokalsamfund, selvom det underliggende problem er noget andet.

Risici og udfordringer: datasikkerhed, modelsikkerhed og API-sikkerhed

For at AI kan være troværdig, kan sikkerhed ikke længere begrænses til at beskytte servere eller netværk. Det er afgørende. beskytte sin egen intelligens: de data, der fodrer modellerne, AI-arkitekturerne og de grænseflader, der gør dem tilgængelige.

Modeller er kun så gode som deres træningsdata. Hvis disse data er... manipuleret eller forudindtagetAI vil træffe fejlagtige beslutninger. Et meget tydeligt eksempel kan ses i modeller, der bruges til personaleudvælgelsesprocesser: Hvis de er trænet med historik, hvor bestemte profiler systematisk er blevet favoriseret, kan AI forstærke bias baseret på køn, race eller oprindelse og diskriminere mod perfekt kvalificerede kandidater.

På et rent teknisk niveau står sprogmodeller og andre avancerede AI'er over for nye kategorier af angreb, såsom hurtig injektionDet består i at skjule ondsindede instruktioner i datainputtet for at ændre modellens adfærd, omgå begrænsninger eller få den til at returnere skadelige oplysninger.

En anden væsentlig risiko er eksponering af følsomme oplysningerHvis systemerne er forkert konfigureret, kan de afsløre fortrolige kundedata, forretningshemmeligheder eller fragmenter af selve træningssættet, enten direkte eller gennem teknikker som medlemskabsinferens eller modeludtrækning.

De API'er, der bruges til at tilgå, træne eller udnytte AI-modeller, repræsenterer en kritisk front. Uden en sådan robust godkendelse, anmodningsbegrænsning og inputvalideringDe bliver nemme mål for brute-force-angreb, massescraping eller uautoriserede ændringer af modelparametre. Det er ikke tilfældigt, at et flertal af virksomheder har oplevet API-relaterede sikkerhedshændelser i de seneste måneder.

Kompleksiteten af hybride miljøer og behovet for total synlighed

De fleste organisationer kører deres AI-løsninger i hybride infrastrukturer der kombinerer offentlig cloud, privat cloud, on-premise og i stigende grad edge computing. Denne spredning gør det vanskeligt at opretholde et klart overblik over, hvor dataene er, hvordan de bevæger sig, og hvem der har adgang til dem på et givet tidspunkt.

Manglende synlighed skaber fragmenterede kontroller og blinde vinklerNogle modeller trænes i én cloud, forfines i en anden og implementeres derefter i forskellige lande, hvor data flyttes fra ét miljø til et andet. Uden tilstrækkelig observerbarhed kan der nemt opstå sikkerhedsbrud eller manglende overholdelse af lovgivningen, uden at nogen opdager dem i tide.

Desuden, i modsætning til traditionel software, AI-modeller De udvikler sig med brugDe kan tilpasse deres parametre i henhold til de nye data, de behandler, hvilket gør det vanskeligt at opdage, om de er blevet manipuleret, eller om de gradvist har afveget fra deres forventede adfærd.

Derfor er det afgørende at udrulle kontinuerlig overvågning og avanceret analyse, inklusive sikkerhed i dit hjemmelaboratoriumMed hensyn til modellernes ydeevne, reaktioner og beslutninger er det kun på denne måde, at mærkelige mønstre, subtile forringelser eller angrebsforsøg, der går ubemærket hen i traditionelle logfiler, kan identificeres.

Dette behov for kontrol strækker sig også til netværks- og applikationslagene. Webapplikations- og API-beskyttelsesteknologier kombineret med dybdegående trafikinspektionsfunktioner muliggør detektion af mistænkelige forespørgsler, forsøg på at udtrække data eller unormal adfærd over for AI-tjenester, blokering af dem, før de kompromitterer følsomme oplysninger.

Sikkerhed gennem design og robusthed som en konkurrencefordel

For at AI kan være en reel forretningsmæssig løftestang og ikke en konstant kilde til skræmmeeffekter, skal sikkerheden integrere fra dag étDet er ikke nok bare at bygge modellen, sætte den i produktion og så lappe den sammen i en fart.

En moden strategi involverer validere og beskytte dataene I alle faser skal du anvende strenge adgangskontroller, separate udviklings-, test- og produktionsmiljøer og kryptografisk signere modelartefakter for at sikre deres integritet gennem hele livscyklussen.

Det er også nøglen til designkapaciteter hos automatiseret detektion og responsNår en model opfører sig mærkeligt, når en API modtager et unormalt anmodningsmønster, eller når der registreres en uventet ændring i et datasæt, skal systemet være i stand til at reagere hurtigt, isolere komponenter og underrette de relevante teams.

Modstandsdygtighed, forstået som AI's evne til at modstå angreb og gendanne uden at miste funktionalitetDette er ved at blive en essentiel tillidsfaktor for ledere. Hvis en organisation ved, at dens modeller er sikre, observerbare og kompatible, vil den have meget mere frihed til at innovere og eksperimentere med avancerede use cases.

I praksis kombinerer mange virksomheder specialiserede cybersikkerhedstjenester med applikationsbeskyttelse og trafikstyringsløsninger der tillader anvendelse af dybdegående forsvarsstrategier: avanceret trafikinspektion, miljøisolering, afbødning af dataeksponering, modelovervågning og intelligent anmodningsrouting baseret på omkostninger, overholdelse af regler og ydeevne.

Alt dette eliminerer ikke behovet for menneskelig overvågning, men det reducerer drastisk manuelle og gentagne opgaver. AI håndterer alarmsortering, hændelseskorrelation og informationsopsummering, mens specialister fokuserer på at forstå angribernes intentioner, undersøge komplekse hændelser og designe mere robuste cyberforsvar.

I sidste ende kræver brugen af AI inden for sikkerhed tre grundlæggende ideer: AI og sikkerhed skal bevæge sig fremad sammen.Beskyttelse af AI indebærer at beskytte data, modeller og grænseflader (ikke kun infrastruktur), og den robusthed, der genereres af en velbeskyttet AI, omsættes til en reel konkurrencefordel i forhold til dem, der improviserer undervejs.

Kunstig intelligens har udviklet sig fra at være et marginalt eksperiment til at være drivkraften bag digital innovation i stort set alle sektorer. Integration af kunstig intelligens i sikkerhed – samtidig med at tilstrækkelig beskyttelse sikres – gør det muligt at afbøde virkningen af sikkerhedsbrud, forudse trusler, forbedre kriminalitetsforebyggelsen og frigøre menneskelige teams fra meget af det hårde arbejde, forudsat at der opretholdes en omhyggelig balance mellem effektivitet, etik og respekt for menneskerettigheder.

Indholdsfortegnelse

- Det nye trusselsbillede og hvorfor AI er nøglen

- Hvordan cyberkriminelle bruger kunstig intelligens

- AI-applikationer inden for cybersikkerhed: fra endpoint til cloud

- Fordele ved AI for sikkerhedsteams

- Godkendelse, adgangskoder og adfærdsanalyse

- Kriminalitetsforebyggelse og -forudsigelse i den fysiske verden

- Risici og udfordringer: datasikkerhed, modelsikkerhed og API-sikkerhed

- Kompleksiteten af hybride miljøer og behovet for total synlighed

- Sikkerhed gennem design og robusthed som en konkurrencefordel