- Un buen diagnóstico en Linux se basa en recopilar datos, analizar logs y aplicar cambios de forma ordenada y reversible.

- Las herramientas de sistema (journalctl, dmesg, smartctl, lm-sensors, fsck, ethtool, htop, etc.) permiten localizar fallos de software y hardware.

- Entender tipos de errores (kernel, sistema de archivos, red, aplicaciones y hardware) ayuda a elegir las pruebas adecuadas en cada caso.

- Copias de seguridad, actualización regular y documentación propia reducen riesgos y facilitan resolver futuros problemas con mayor rapidez.

Si usas Linux a diario, tarde o temprano te tocará enfrentarte a algún fallo raro: un sistema que no arranca, un servicio que se cae sin motivo aparente, una wifi que se desconecta cada dos por tres o un disco que empieza a hacer ruidos preocupantes. Lejos de ser un drama, estos problemas son una oportunidad fantástica para aprender cómo funciona tu sistema por dentro y desarrollar una metodología sólida de diagnóstico de problemas en Linux.

Frente al enfoque más automatizado de otros sistemas (como los solucionadores de problemas de Windows o comandos tipo DISM / SFC), en Linux cuentas con un ecosistema muy potente de herramientas de diagnóstico, registros detallados y utilidades de monitorización. El truco no es memorizar comandos sin más, sino entender el proceso: cómo recopilar información, cómo interpretarla y cómo actuar sin empeorar la situación.

Enfoque general para diagnosticar problemas en Linux

La resolución de problemas en Linux no debería ser un «a ver qué pasa si toco aquí», sino un proceso ordenado y repetible basado en lógica y observación. Cuanto más sistemático seas, más rápido llegarás a la causa raíz y menos posibilidades tendrás de romper algo por el camino.

Un primer principio básico es recopilar toda la información posible sobre el fallo antes de tocar nada. Eso implica anotar el mensaje de error exacto, cuándo aparece y qué estabas haciendo justo antes. Detalles como «empezó después de una actualización», «pasa sólo con este programa» o «ocurre cuando conecto este dispositivo USB» son oro puro para el diagnóstico.

También conviene fijarse en si el problema es reproducible de forma consistente o si aparece de manera intermitente. Saber si puedes provocar el error a voluntad te permitirá probar soluciones de forma controlada y confirmar si realmente han funcionado.

Mientras recoges datos, es fundamental activar tu lado más observador: mensajes en pantalla, luces de diagnóstico de la placa base, ruidos mecánicos inusuales en discos o ventiladores, olor a quemado, zonas excesivamente calientes al tacto… Tus sentidos (vista, oído, olfato y tacto) también forman parte del kit de diagnóstico, especialmente cuando sospechas de un problema físico de hardware.

Con la información inicial en la mano, el siguiente paso lógico es acotar el origen del fallo: ¿es de software (kernel, sistema de archivos, servicios, aplicaciones), de configuración (red, permisos, drivers) o de hardware (RAM, disco, temperatura, fuente, NIC, GPU, etc.)? Esta clasificación te guiará hacia las herramientas adecuadas en cada caso.

Principios clave de la resolución de problemas en Linux

Un buen diagnóstico se apoya en unos pocos principios esenciales que conviene interiorizar cuanto antes. El primero es reunir datos de forma metódica: no basta con «me falla la wifi», necesitas saber si hay cortes, si el problema está sólo en tu equipo, si afecta a un servicio concreto o a toda la conectividad, qué dice el registro del sistema, si hay errores en el driver, etc.

La siguiente fase es analizar la información recabada con las herramientas adecuadas. En Linux dispones de registros del sistema muy detallados, comandos de monitorización de recursos y utilidades específicas de red y hardware. Lo habitual es combinar varias fuentes: por ejemplo, usar journalctl y dmesg para revisar mensajes del kernel y servicios, top o htop para revisar carga, y herramientas de red como ping, ss o tcpdump para ver qué pasa con las conexiones.

Una vez tienes una hipótesis razonable, llega el momento de probar soluciones con cabeza. Esto significa aplicar un cambio cada vez, comprobar el resultado y, si no funciona, revertirlo. Nunca deberías hacer un «cóctel» de cambios simultáneos porque, si el problema desaparece, no sabrás cuál de ellos lo ha resuelto, y si empeora, tampoco tendrás claro qué lo ha roto.

Otro pilar básico, que muchos pasan por alto, es la documentación. Ir anotando qué comandos ejecutas, qué ficheros has tocado y qué resultado obtienes te permite repetir una solución que ha funcionado, compartirla con otros y evitar perder el tiempo volviendo a investigar lo mismo semanas después. Además, contribuyes al espíritu de comunidad de Linux cuando compartes tus notas en foros o wikis.

Por último, recuerda la regla de la simplicidad. Cuanto más complejo es un sistema, con servicios, demonios y capas de abstracción por todas partes, más posibilidades hay de que algo falle. Siempre que puedas, mantén tu sistema lo más simple y limpio posible: menos servicios innecesarios, menos software redundante, menos capas exóticas. Eso reduce la superficie donde pueden aparecer problemas y facilita muchísimo el diagnóstico.

Preparar el sistema antes de tocar nada: copias de seguridad y actualizaciones

Antes de lanzarte a modificar configuraciones, reparar sistemas de archivos o actualizar kernels, deberías asegurarte de que, si algo se tuerce, podrás recuperar tu información. Las copias de seguridad en Linux son tu red de seguridad, especialmente cuando vas a tocar particiones, discos o servicios críticos.

Una opción muy flexible es usar rsync para copias de seguridad incrementales. Normalmente se combina con opciones como -a (modo archivo, preserva permisos, propietario y fechas), -v (salida detallada) y un parámetro de progreso para ver cómo avanza la copia. Lo importante es tener un directorio de destino accesible y con espacio suficiente, preferiblemente en un disco externo o en una partición distinta del sistema.

Si prefieres empaquetar todo en un único archivo, puedes recurrir a tar, usando parámetros como -c para crear, -z para comprimir con gzip, -v para ver el progreso y -f para especificar el nombre del archivo resultante. Después, es recomendable comprobar la integridad de la copia listando su contenido con el propio tar, de forma que te asegures de que el archivo de respaldo no está corrupto.

En cuanto al destino, la clave está en que la copia no viva en el mismo disco que el sistema que quieres proteger. Un disco USB externo, almacenamiento en la nube vía herramientas como rclone o una partición independiente son elecciones sensatas. La idea es que, si tu disco principal muere o el sistema queda inutilizable, tengas algo desde donde restaurar.

Otro paso previo muy recomendable es actualizar el sistema. Un buen número de problemas desaparecen simplemente al instalar versiones corregidas de paquetes y kernels. En Debian/Ubuntu, lo habitual es ejecutar la secuencia de actualización de la lista de paquetes y posterior actualización de paquetes instalados, revisando la salida en busca de errores. En Fedora o derivados, los comandos de actualización de paquetes cumplen una función similar, y lo mismo ocurre con pacman -Syu en Arch Linux, donde es especialmente importante mantener el sistema al día al ser una distribución de lanzamiento continuo.

Comprobaciones básicas de hardware: CPU, RAM, discos y sensores

Cuando un sistema va muy lento, se cuelga de forma aleatoria o se reinicia sin motivo aparente, no asumas de entrada que es culpa del software. Muchas veces la raíz del problema está en un hardware degradado, temperaturas excesivas o módulos de memoria defectuosos.

Para tener una vista general del hardware puedes usar comandos como lshw (información detallada de dispositivos), lsblk (listado de discos y particiones) o utilidades específicas como dmidecode, que extrae datos del BIOS/UEFI. Por ejemplo, con dmidecode -t memory obtienes información de los módulos de RAM instalados (tipo DDR, capacidad, etc.), mientras que con dmidecode -t 16 puedes ver la capacidad máxima de memoria soportada por la placa base. Para profundizar en aspectos operativos de la memoria, consulta la gestión de memoria en Linux.

Si quieres un resumen rápido de los componentes de memoria, lshw -short -C memory ofrece una visión abreviada, y con dmidecode –type memory | grep -E «Speed|Configured Clock Speed» puedes comparar la velocidad nominal de los módulos frente a la velocidad configurada por el chipset. Es una buena forma de descubrir, por ejemplo, que un módulo que soporta 3200 MT/s está funcionando a 2400 MT/s porque comparte canal con otro más lento.

La vigilancia de la temperatura es otro aspecto crítico. Con el paquete lm-sensors puedes obtener lecturas de temperatura y voltajes de CPU y otros sensores de la placa. Tras instalarlo, es recomendable ejecutar sudo sensors-detect para detectar y activar todos los sensores disponibles, y luego usar comandos como watch -n 2 sensors para monitorizar en tiempo real si la CPU o la RAM se calientan más de la cuenta.

Para las unidades de disco (HDD o SSD SATA), utilidades como hddtemp permiten leer la temperatura del dispositivo, mientras que el paquete psensor o herramientas gráficas como xsensors proporcionan vistas históricas y gráficas de las temperaturas. Ver un SSD trabajando constantemente al límite de su rango térmico, por ejemplo, es una pista clara de que algo no está bien a nivel de ventilación o carga.

Diagnóstico del estado del disco y del sistema de archivos

Los fallos de disco y los errores de sistema de archivos son responsables de infinidad de problemas: desde ficheros corruptos hasta sistemas que no arrancan. En Linux dispones de varias utilidades para comprobar el estado físico del disco y la integridad lógica del sistema de archivos.

Para empezar, puedes listar los dispositivos de almacenamiento conectados con comandos como lsblk -fm o fdisk -l, filtrando si lo deseas las unidades virtuales de tipo loop. Así verificas qué discos y particiones reconoce el sistema, sus sistemas de archivos y puntos de montaje.

La suite smartmontools (con el comando smartctl) es esencial para explotar la tecnología SMART integrada en los discos modernos. Primero hay que asegurarse de que SMART está activado en el disco con una orden de activación adecuada. A partir de ahí, puedes consultar atributos como Power_On_Hours para ver cuántas horas lleva funcionando el disco, o ejecutar un smartctl -H para obtener una evaluación rápida del estado de salud del dispositivo.

Además de las comprobaciones instantáneas, smartctl permite lanzar pruebas de diagnóstico automáticas: un test corto para un chequeo rápido y un test largo o extendido para una revisión mucho más a fondo. Posteriormente, puedes revisar los resultados y atributos detallados con un comando que muestre toda la información del disco. Si detectas sectores reasignados, errores crecientes o un estado «pre-fail», es el momento de ir pensando en cambiar ese disco.

Otra herramienta importante es fsck, que se encarga de revisar y reparar errores lógicos en sistemas de archivos. Ejecutar fsck sobre una partición implica cierto riesgo si hay datos importantes, así que es imprescindible tener copia de seguridad previa. Puedes combinarlo con badblocks para localizar y marcar sectores defectuosos, de forma que el sistema evite usarlos en el futuro, aunque si empiezan a aparecer muchos bloques dañados lo prudente es sustituir el disco.

Para diagnosticar problemas de espacio, df -h te muestra el uso de las particiones en términos de gigabytes, mientras que df -i revela el porcentaje de inodos consumidos. Es perfectamente posible tener gigas libres pero el 100% de inodos ocupados, lo que provocará fallos al crear archivos nuevos pese a existir espacio. Es una situación típica en servidores que manejan millones de ficheros pequeños.

Análisis de memoria: errores ECC, pruebas y estabilidad

La memoria RAM defectuosa puede causar síntomas muy diversos: desde simples cuelgues aleatorios hasta corrupción silenciosa de datos. Si tu sistema dispone de memoria ECC, el propio hardware es capaz de corregir ciertos errores, pero eso no significa que puedas olvidarte del problema: los errores corregidos son una señal de que un módulo empieza a fallar.

Los sistemas Linux pueden exponer esta información a través del subsistema EDAC. Si instalas los módulos correspondientes, verás en los registros del sistema mensajes que distinguen entre errores corregidos (CE, Corrected Error) y errores no corregibles (UE, Uncorrected Error). Los primeros indican que el hardware ha podido reparar el bit dañado, mientras que los segundos suelen desembocar en un kernel panic inmediato para evitar que se escriban datos corruptos a disco.

Una forma sencilla de comprobar si el kernel ha registrado errores EDAC es revisar la salida de dmesg | grep EDAC. Si encuentras CEs repetidos en el mismo módulo, eso te dice claramente qué banco de memoria deberías reemplazar antes de que esos errores pasen a ser no corregibles. Para técnicas y herramientas avanzadas, consulta esta guía sobre debugging de memoria en Linux.

Para pruebas más exhaustivas, lo habitual es recurrir a utilidades externas como memtest86, que se ejecutan arrancando desde un medio externo (USB o similar). Estas herramientas someten a la RAM a patrones intensivos de lectura/escritura para detectar fallos que en un uso normal podrían pasar desapercibidos durante meses. Es recomendable dejar que el test complete varias pasadas para estar razonablemente seguro.

También puedes someter al equipo a estrés general con utilidades como stress, que permiten cargar CPU, E/S y memoria durante un tiempo determinado, observando si aparecen bloqueos, kernel oops o pánicos. Si el sistema falla de forma reproducible bajo carga, es probable que tengas un problema físico (temperaturas, alimentación, RAM) o alguna inestabilidad en el kernel o controladores.

Monitorización del sistema: CPU, procesos, E/S y GPU

Para entender qué está pasando en tu máquina en un momento dado, necesitas buenas herramientas de monitorización. Linux ofrece diversas utilidades en consola que permiten ver de un vistazo qué procesos consumen más CPU, memoria, E/S de disco o uso de GPU.

Los comandos clásicos como top o su versión más amigable htop te muestran los procesos activos, uso de CPU, memoria y carga media. Para vigilar específicamente la actividad de disco por proceso, iotop es de gran ayuda, mientras que nmon proporciona una visión global de múltiples subsistemas (CPU, memoria, red, disco) en una interfaz de texto muy completa.

En el terreno gráfico, el uso de la GPU puede convertirse en cuello de botella en sistemas que ejecutan aplicaciones con uso intensivo de gráficos o tareas de cómputo acelerado. Para tarjetas Intel, el paquete intel-gpu-tools incluye comandos como intel_gpu_top, que muestran en tiempo real la carga de la GPU, colas de ejecución y memoria usada.

Si trabajas con tarjetas NVIDIA, puedes apoyarte en herramientas en Python como gpustat o en monitores generales como glances (con soporte para GPU habilitado), que muestran consumo de memoria de vídeo, uso de GPU y procesos que la están utilizando. Para GPU AMD Radeon, utilidades como radeontop ofrecen algo parecido, con barras de uso para las diferentes unidades internas del chip.

En caso de sospechar que el driver gráfico es parte del problema (fallos al entrar en entorno gráfico, cuelgues al usar compositores, etc.), conviene revisar qué hardware de vídeo tienes instalado con comandos como lspci -vnn | grep VGA -A 12, lshw -C display o inxi -G, y comprobar si estás usando drivers libres, propietarios u obsoletos. En distribuciones como Ubuntu puedes activar repositorios específicos de drivers gráficos (por ejemplo, para Radeon) y actualizar a versiones más recientes optimizadas para tu GPU.

Diagnóstico de la red: NIC, pérdidas de paquetes y configuración

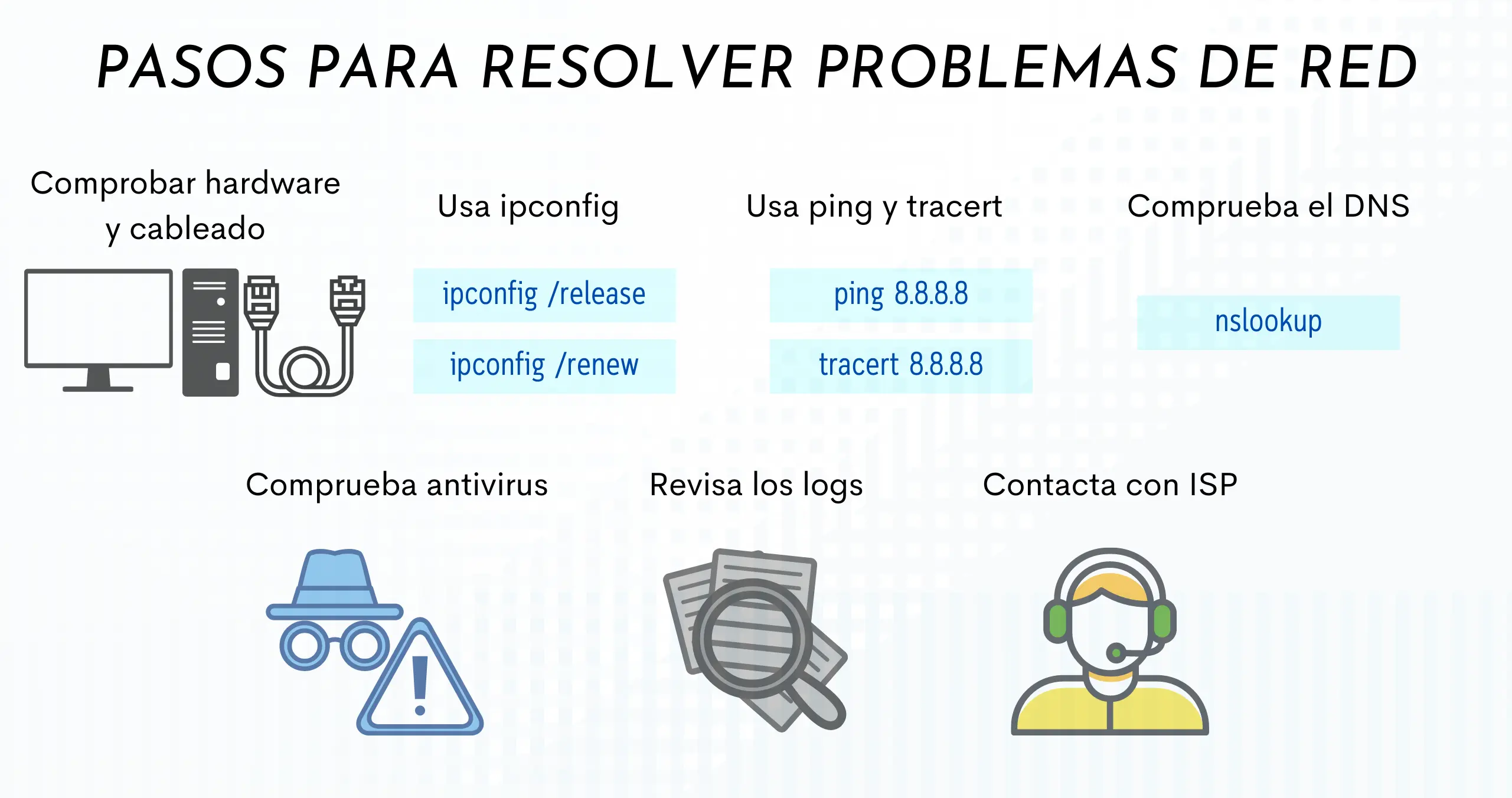

Los problemas de red pueden ir desde «no tengo conexión» hasta «todo va lento salvo tal servicio». Para no volverte loco, lo primero es distinguir si el fallo está en tu máquina, en la red local o en Internet. En Linux tienes varias capas de herramientas para probar conectividad, ver estadísticas de la NIC y detectar pérdidas de paquetes, y esta guía de diagnóstico de redes IP y DNS profundiza en las comprobaciones y soluciones.

Comandos básicos como ping te permiten comprobar si llegas a un host concreto (por ejemplo, tu router o un dominio externo), mientras que traceroute te enseña el camino que siguen los paquetes hasta el destino, útil para ver en qué salto se pierden. Para ver qué puertos están abiertos y qué procesos los están usando, ss es el reemplazo moderno de netstat, con opciones para listar conexiones TCP/UDP activas.

Cuando sospechas que el problema está en la propia tarjeta de red, utilidades como ethtool resultan muy valiosas. Con comandos que muestran estadísticas detalladas puedes monitorizar en tiempo real errores de RX/TX, paquetes descartados, problemas de buffer o desbordamientos FIFO, usando combinaciones con watch para refrescar constantemente la salida y detectar patrones de pérdida de paquetes.

Otra medida muy ilustrativa es revisar los contadores de errores de las interfaces con netstat -ni (o herramientas equivalentes más modernas). Ahí verás columnas de paquetes recibidos y transmitidos correctamente, junto con los paquetes descartados. Si el porcentaje de paquetes perdidos (RX-DRP / RX-OK o TX-DRP / TX-OK multiplicado por 100) supera cifras pequeñas como un 0,2%, el impacto en el rendimiento de la conexión puede ser brutal, llegando a partir la velocidad efectiva a la mitad o peor.

No es raro encontrarse con tarjetas de red recién compradas que, por defecto de fábrica o problemas de diseño, muestran tasas de error inaceptables. Cambiar a un modelo diferente y repetir las pruebas suele ser la confirmación definitiva de que el cuello de botella era la NIC. Por eso es tan importante contar con datos objetivos de pérdidas y errores antes de culpar al proveedor de Internet o al router.

También conviene comprobar el estado de dispositivos de radio como wifi o Bluetooth con comandos como rfkill, que indican si están bloqueados por soft o hard. Para datos de fabricante, modelo y capacidades de las interfaces de red, lshw -C network o inxi -Nx proporcionan información muy detallada, mientras que ethtool nombre_interfaz | grep -i speed te dice a qué velocidad está enlazando la tarjeta (10/100/1000 Mbps, etc.).

Logs del sistema y niveles de gravedad en Linux

Los registros del sistema son tu libro de historia: todo lo que ha pasado (o casi) queda escrito ahí. Entender cómo funcionan y cómo filtrarlos te ahorra muchísimo tiempo. En sistemas modernos basados en systemd, journalctl es la herramienta central para consultar el journal binario, mientras que en sistemas más tradicionales seguirás encontrando archivos de texto en /var/log.

Entre los ficheros más habituales están /var/log/syslog o /var/log/messages, que recogen eventos generales del sistema, y /var/log/auth.log para temas de autenticación. Puedes usar herramientas como less y grep para filtrarlos por palabras clave (error, fail, timeout, etc.). Cuando trabajas con el journal de systemd, puedes ver los mensajes del último arranque con opciones específicas, revisar logs de un servicio concreto o filtrar por rangos temporales (por ejemplo, desde hace dos horas).

El comando dmesg muestra el buffer de mensajes del kernel, muy útil para detectar problemas de hardware, controladores que no cargan, errores en el bus PCI, advertencias de memoria, etc. Con el parámetro -T obtienes marcas de tiempo legibles, y filtrando por niveles de severidad puedes centrarte en lo más crítico. Además, con dmesg -w puedes ver en tiempo real cómo se van generando mensajes, algo muy práctico cuando conectas/disconectas dispositivos o cuando sospechas de un error que precede a un kernel panic.

Los mensajes se clasifican por niveles de gravedad, lo que te ayuda a priorizar. Existen niveles desde 0 (emergencia), que indica una situación extremadamente grave que puede causar caídas o inestabilidad severa, pasando por 1 (alerta), 2 (crítico) y 3 (error no crítico), hasta advertencias (nivel 4), avisos dignos de mención (nivel 5), mensajes informativos (nivel 6) y mensajes de depuración (nivel 7). Entender estos niveles te permite filtrar el ruido y centrarte en lo realmente importante cuando los logs son muy verbosos.

Usando tuberías con grep puedes extraer sólo las líneas de un cierto nivel en los logs de texto plano, mientras que las herramientas de systemd ofrecen parámetros específicos para filtrar por prioridad en el journal. Dominar estos filtros es la diferencia entre perderte en miles de líneas y localizar en segundos el mensaje que te da la pista que necesitabas.

Tipos de errores en Linux: kernel, sistema de archivos, red, aplicaciones y hardware

Para diagnosticar con precisión, conviene tener claro qué tipo de error estás viendo. Los problemas en Linux se pueden agrupar, a grandes rasgos, en errores de núcleo, de sistema de archivos, de red, de aplicaciones y de hardware, aunque a menudo estén relacionados entre sí.

Los errores del kernel abarcan desde simples avisos («warnings») hasta situaciones críticas como los kernel oops y los kernel panic. Un kernel oops es un fallo grave en el que el kernel mata el proceso que ha causado la infracción, pero intenta seguir funcionando. Puede ser síntoma de falta de memoria, controladores defectuosos, incompatibilidades, corrupción de datos o bugs. Si el problema afecta a un subsistema esencial, ese oops puede degenerar en un kernel panic, que es el equivalente en Linux a la clásica pantalla azul de otros sistemas.

El kernel panic es un «hard panic»: el sistema se detiene casi por completo, se muestra un mensaje de error (a menudo críptico) en pantalla y, según la configuración, puede forzar un reinicio automático. Suele estar provocado por acceso a memoria inválida, drivers esenciales que fallan, partición raíz inaccesible, problemas graves de RAM, fallos del proceso init, errores en initramfs, kernels mal instalados o no soportados o parches inestables. El propio kernel puede hacer un volcado de memoria (Kernel Crash Dump) para su análisis posterior.

Los errores de sistema de archivos se manifiestan como imposibilidad de montar particiones, mensajes de corrupción, archivos ilegibles o desaparición de datos. Apagados bruscos, cortes de energía, sectores defectuosos o bugs en el driver del sistema de archivos pueden estar detrás. Aquí entran en juego fsck, smartctl y las copias de seguridad que hayas hecho antes de tocar nada.

En el ámbito de redes, los síntomas pueden ir desde desconexiones esporádicas, baja velocidad de transferencia, grandes latencias o imposibilidad total de conexión. Las causas incluyen configuraciones erróneas (IP, rutas, DNS, firewall), drivers de NIC con problemas, interferencias en wifi, errores físicos en el cableado o saturación en algún punto de la ruta. Las herramientas de diagnóstico de red que hemos visto ayudan a aislar en qué capa se está produciendo el fallo.

Los errores de aplicaciones abarcan desde programas que se cierran inesperadamente, no arrancan, dan mensajes de librerías ausentes o se quedan colgados sin responder. A menudo se deben a dependencias rotas, versiones incompatibles de bibliotecas, errores en el código, scripts mal escritos o condiciones de carrera. Herramientas como strace (para seguir llamadas al sistema) o lsof (para ver archivos abiertos y conexiones de red de un proceso) pueden aportar información valiosa.

Por último, los errores de hardware incluyen desde conectores mal enchufados, cables dañados, puertos rotos o suciedad acumulada, hasta averías electrónicas por sobrecalentamiento, humedad o envejecimiento. También entran aquí conflictos entre componentes (IRQ, DMA, etc.) y problemas de alimentación o de rendimiento (throttling por temperatura, falta de RAM, CPU insuficiente). De nuevo, usar tus sentidos junto con herramientas de monitorización y tests de estrés te ayudará a identificar qué componente físico está fallando.

Pasos prácticos para un proceso de diagnóstico ordenado

Aunque cada problema es un mundo, puedes seguir una especie de «esqueleto» de pasos que se adapta a casi cualquier situación. El primero, ya mencionado, es definir el problema con precisión: qué falla, desde cuándo, en qué condiciones, qué cambió justo antes (instalación de software, actualización, cambio de hardware, etc.). Si puedes reproducir el fallo de forma fiable, mejor que mejor.

El segundo paso es revisar el estado del sistema y los registros: usar journalctl y dmesg para buscar mensajes relevantes (especialmente en niveles de error, crítico o alerta), comprobar la carga con top/htop, la memoria libre con comandos de uso de memoria, el uso de disco con df y los logs específicos del servicio o aplicación afectada. Buscar palabras clave como error, fail, panic o timeout suele darte pistas muy rápidas.

En tercer lugar, conviene investigar en fuentes externas. Con una búsqueda bien formulada del mensaje de error («Ubuntu 20.04 wifi disconnects», por ejemplo) muchas veces llegarás a hilos de foros, wikis de tu distribución o reportes de bugs donde otros usuarios ya han sufrido lo mismo. No olvides consultar las páginas de manual (man), documentación oficial, HOWTOs y wikis; ese famoso «RTFM» sigue siendo uno de los mejores consejos.

Una vez tienes varias hipótesis, pasas a la etapa de pruebas: reiniciar un servicio concreto, modificar temporalmente un archivo de configuración (con copia de seguridad), desactivar un módulo del kernel, arrancar con otro kernel disponible en el gestor de arranque, probar otro dispositivo físico, etc. La clave aquí es hacer cambios reversibles y controlados, uno por uno, y comprobar tras cada paso si el problema persiste.

Cuando finalmente das con la solución que elimina el fallo, queda el último paso, que es muchas veces el más infravalorado: verificar la estabilidad en el tiempo y documentar lo que has hecho. Idealmente deberías reiniciar el equipo (si el problema afectaba al arranque) o dejar el sistema bajo carga durante un tiempo, comprobar que no reaparecen errores en logs y anotar la solución en tu propio «cuaderno de bitácora» técnico. Esa experiencia te servirá para evitar que se repita el problema, o para resolverlo en minutos la próxima vez.

Con todo este conjunto de ideas, herramientas y métodos, Linux deja de ser una caja negra misteriosa y se convierte en un entorno en el que puedes diagnosticar desde un simple aviso en los logs hasta un kernel panic o una RAM moribunda con bastante precisión. No se trata de memorizar mil comandos, sino de interiorizar un enfoque sistemático, apoyarte en la documentación y en la comunidad, y no tener miedo a mirar «debajo del capó» cuando algo se tuerce.

Tabla de Contenidos

- Enfoque general para diagnosticar problemas en Linux

- Principios clave de la resolución de problemas en Linux

- Preparar el sistema antes de tocar nada: copias de seguridad y actualizaciones

- Comprobaciones básicas de hardware: CPU, RAM, discos y sensores

- Diagnóstico del estado del disco y del sistema de archivos

- Análisis de memoria: errores ECC, pruebas y estabilidad

- Monitorización del sistema: CPU, procesos, E/S y GPU

- Diagnóstico de la red: NIC, pérdidas de paquetes y configuración

- Logs del sistema y niveles de gravedad en Linux

- Tipos de errores en Linux: kernel, sistema de archivos, red, aplicaciones y hardware

- Pasos prácticos para un proceso de diagnóstico ordenado