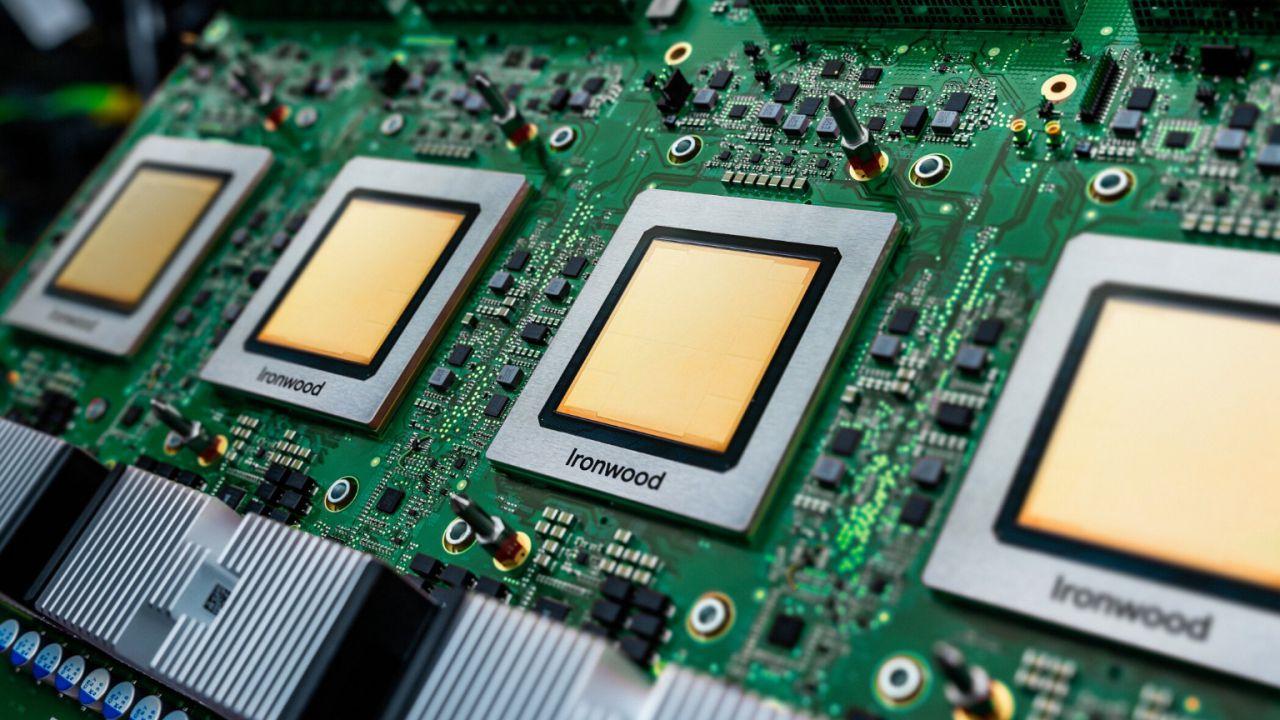

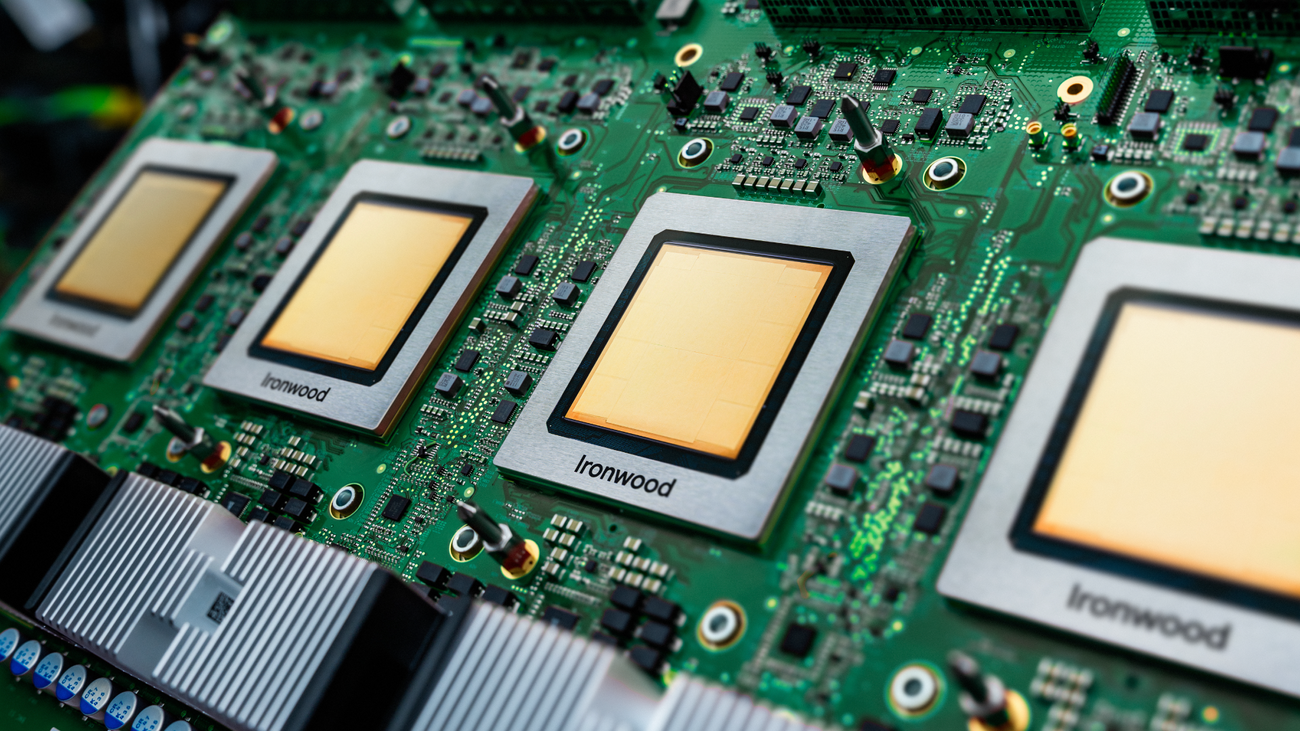

- Google TPU v7 Ironwood est la septième génération de TPU et est spécialement conçue pour l'ère de l'inférence, avec 4.614 TFLOPS FP8 et 192 Go de HBM3e par puce.

- L'architecture peut être étendue jusqu'à 9 216 puces dans un superpod avec 1,77 PB de mémoire partagée, des réseaux ICI de 9,6 Tb/s et un refroidissement liquide optimisé pour près de 10 MW.

- Intégré à l'hypercalculateur IA avec les processeurs Axion, Ironwood offre un excellent équilibre entre performances, efficacité énergétique et coût pour les charges de travail IA massives.

- Le méga-contrat avec Anthropic et la stratégie d'intégration verticale renforcent le rôle de Google en tant que concurrent clé de Nvidia sur le marché des puces d'IA.

L'accélération de la L'intelligence artificielle est en train de changer de phase.Il ne suffit plus d'entraîner des modèles géants et de se vanter de leurs paramètres : le véritable enjeu est désormais de savoir comment les faire fonctionner quotidiennement pour des millions d'utilisateurs, sans que les coûts énergétiques et autres ne s'envolent. infrastructure de IA Ils sont déclenchés. C'est dans ce contexte qu'apparaît Google TPU v7 Ironwood, un composant matériel conçu pour une IA qui non seulement réagit, mais pense, raisonne et agit en continu.

Ironwood est le septième génération de la Unités de traitement des tenseurs (TPU) de Google D'après Google, il s'agit de sa puce la plus puissante, évolutive et efficace à ce jour. Elle est conçue pour l'ère de l'inférence, où l'important n'est plus tant le temps d'entraînement d'un nouveau modèle que son coût de fonctionnement, d'exploitation et de génération de résultats 24 h/24. Examinons de plus près la puce Google TPU v7 Ironwood : qu'est-ce qui la rend si spéciale et pourquoi elle bouscule le marché face à Nvidia et aux autres géants du secteur ?

Qu'est-ce que Google TPU v7 Ironwood et pourquoi est-il si important ?

Ironwood est, en essence, un accélérateur d'IA sur mesure conçu par Google pour exécuter des modèles d'intelligence artificielle de nouvelle génération. Il fait partie de la famille des unités de traitement tensoriel (TPU), des puces spécialement conçues pour les charges de travail d'apprentissage automatique qui alimentent les services internes de Google (recherche, YouTube, publicité, traduction, etc.) depuis près d'une décennie, et plus récemment, les solutions Google Cloud.

Cette septième génération s'appuie sur toute l'expérience acquise avec les TPU précédentes et poursuit un objectif clair : Optimiser les performances dans les tâches d'inférence et de raisonnement complexesans sacrifier la capacité d'apprentissage. Modèles de langage étendus (LLM), mélange d'experts, systèmes de rappel augmenté et Agents IA Ironwood est conçu pour les charges de travail qui nécessitent de conserver beaucoup de contexte en mémoire.

Au lieu d'être simplement « une puce plus rapide », Ironwood est intégré à l'architecture. Hypercalculateur IA Google CloudCette approche consiste à concevoir conjointement le calcul, le réseau, le stockage et les logiciels. Cela permet un réglage précis, du silicium à l'orchestrateur de conteneurs, afin de maximiser chaque watt et chaque cycle d'horloge.

Un autre point clé est qu'Ironwood est le Premier TPU conçu de A à Z pour l'ère de l'inférenceJusqu'à présent, la plupart des systèmes d'IA étaient conçus principalement pour entraîner d'énormes modèles ; désormais, l'accent est mis sur l'exécution répétée et efficace de ces modèles, grâce à des agents qui non seulement réagissent, mais anticipent, recherchent des données, les combinent et en tirent des conclusions.

Caractéristiques techniques clés du TPU v7 Ironwood

Sur le plan technique, Ironwood affiche des performances impressionnantes, même sur un marché aussi concurrentiel que celui des puces d'IA. Chaque puce offre 4.614 téraflops de puissance en précision FP8Cela représente plus de 16 fois la capacité de calcul du TPU v4 et un bond en avant considérable par rapport aux générations précédentes.

Pour alimenter une telle capacité, chaque puce intègre 192 Go de mémoire HBM3e Doté d'une technologie de pointe, avec une bande passante d'environ 7,3 à 7,4 To/s, ce système combine puissance de calcul et mémoire à haute vitesse, permettant ainsi de traiter des modèles gigantesques et des contextes très longs sans être ralenti par des goulots d'étranglement.

Ironwood est fabriqué avec un procédé avancé de 5 nanomètres et sa consommation électrique est d'environ 600 watts par puce. Cela peut paraître élevé, mais compte tenu des performances offertes par watt consommé, le résultat est très compétitif : par rapport à la génération précédente Trillium (TPU v6e), Ironwood double les performances par watt.

Ces améliorations sont perceptibles tant au niveau de la formation que de la maintenance. Pour la formation, Ironwood peut accélérer le processus pour les modèles de nouvelle génération (tels que Gemini ou Veo) et ceux d'autres fournisseurs ; pour la maintenance, il permet l'exécution de… inférences massives avec des coûts énergétiques plus bas, un point crucial maintenant que les centres de données d'IA se mesurent en gigawatts.

De la puce au Superpod : comment Ironwood évolue

La véritable magie d'Ironwood ne réside pas seulement dans une seule copeau, mais dans la manière dont il est... passe à l'échelle supérieure pour former des superordinateurs d'IAChaque SoC Ironwood est monté sur une carte (PCBA) avec quatre puces, et chaque rack intègre 16 de ces cartes, ce qui donne un total de 64 puces par rack.

À partir de là, les étagères sont regroupées pour former un Superpod IronwoodUn superpod complet comprend 144 racks, soit 9 216 puces interconnectées. Cela représente une puissance de calcul FP8 d'environ 42,5 exaflops et approximativement 1,77 pétaoctet de mémoire HBM partagée, constituant ainsi une ressource logique considérable pour les modèles d'IA.

L'interconnexion entre les puces s'effectue via le réseau. Interconnexion inter-puces (ICI)Avec une conception en tore 3D (4x4x4) et des vitesses allant jusqu'à 9,6 Tb/s, cette topologie permet une latence réduite et des taux de transfert élevés même lorsque le système passe à des milliers d'accélérateurs, ce qui est essentiel pour les charges de travail d'entraînement distribué et d'inférence hautement parallèles.

Au-delà du superpod, l'infrastructure peut être étendue encore davantage en combinant blocs de 64 puces connectées et en les reliant par un réseau optique dorsal pouvant atteindre 1,8 PB/s. Cette combinaison de câbles en cuivre passifs, de fibres optiques et de commutateurs optiques offre une flexibilité considérable pour la configuration de clusters personnalisés destinés à différents clients et modèles.

En termes de puissance, un déploiement de cette envergure se rapproche de 10 mégawatts de capacité électriqueCe chiffre impose de prendre très au sérieux le refroidissement et l'efficacité énergétique. Chaque rack est conçu pour consommer plus de 100 kW ; l'ensemble du système a donc été pensé dès le départ pour un refroidissement liquide et une distribution électrique avancée.

Réfrigération, consommation et efficacité énergétique

Face à de telles densités de puissance monstrueuses, la question qui se pose est évidente : Comment Google parvient-il à maintenir tout cela sous contrôle thermique ? La solution réside dans un système de refroidissement liquide de pointe, conçu spécifiquement pour les superpods Ironwood.

Chaque rack intègre un circuit de distribution de réfrigérant (CBU) avec Détecteurs de fuites et redondance électrique à 416 V CACette configuration permet non seulement d'éviter la surchauffe, mais aussi d'assurer une haute fiabilité pour les charges de travail critiques d'IA, où une panne prolongée peut entraîner des pertes de millions d'euros ou des interruptions de service à grande échelle.

Ironwood ne vise pas seulement à être le système le plus puissant, mais aussi l'un des plus efficaces. Comparé à Trillium, le TPU v7 atteint doubler les performances pour chaque watt consomméCela signifie qu'avec le même budget énergétique qu'en 2024, un centre de données équipé d'Ironwood pourrait gérer jusqu'à deux fois plus d'inférence en 2026.

Cette approche répond à une réalité inconfortable du secteur : C’est l’énergie, et non le silicium, qui devient le facteur limitant. Pour accompagner le développement de l'IA. Les réseaux électriques de nombreux pays commencent à atteindre leur capacité maximale dans des zones clés pour les centres de données ; par conséquent, optimiser l'utilisation de chaque watt n'est plus un avantage, mais une nécessité.

De plus, l'architecture d'Ironwood est optimisée pour minimiser les transferts de données inutiles, une source importante de consommation d'énergie dans les systèmes distribués. L'association d'une mémoire HBM massive et d'un réseau à haut débit vise précisément cet objectif. Travailler plus près des données et réduire les déplacements coûteux autour du centre de données.

Ironwood au sein de l'hyperordinateur IA et de la couche logicielle

Ironwood ne vit pas isolé ; il est profondément intégré à la Architecture d'hypercalculateur IA de Google CloudCe concept réunit dans un même cadre de conception le matériel (TPU et CPU Axion), le réseau haut débit, le stockage et le logiciel d'orchestration et de planification.

Au niveau logiciel, Google mise sur sa plateforme Pathways, qui permet coordonner des dizaines de milliers de TPU Ironwood comme s'il s'agissait d'une seule et même ressource logique. Outre Pathways, des outils tels que MaxText (pour formation LLM à grande échelle) et l'intégration avec Kubernetes Engine via Cluster Director, qui optimise la planification et la résilience du cluster.

Pour la partie inférence, Google a étendu la prise en charge de vLLM pour fonctionner avec les GPU et les TPUCela simplifie la migration des modèles et des charges de travail entre différents types d'accélérateurs, avec un minimum de modifications de code. De plus, selon les données communiquées par l'entreprise, GKE Inference Gateway peut réduire la latence des requêtes initiales jusqu'à 96 % et diminuer le coût du service d'environ 30 %.

Tout cela signifie que les clients ont non seulement accès à une puce rapide, mais aussi à une plateforme complète optimisée de bout en boutIDC cite en effet des retours sur investissement de 353 % sur trois ans pour les clients d'IA Hypercomputer, avec des réductions des coûts informatiques de près de 28 %.

L'objectif ultime est clair : que les entreprises puissent Exploiter la puissance du Bois de Fer sans devenir fou Gestion d'infrastructures complexes. L'utilisateur idéal définit simplement ses modèles et ses besoins, et le plan de contrôle Google Cloud orchestre de manière transparente les TPU, Axion, le réseau, le stockage et les logiciels.

L’« âge de l’inférence » et le rôle d’Ironwood

Pendant des années, une grande partie du discours en IA a tourné autour de modèles de plus en plus grandsCependant, le marché s'est heurté à une dure réalité : aussi spectaculaire que soit la formation, les revenus durables proviennent de la production d'inférences à grande échelle, jour après jour.

Google parle de « l’ère de l’inférence » Pour marquer cette nouvelle étape, au lieu de simples modèles réactifs qui attendent une requête de l'utilisateur, nous passons à des agents d'IA capables de collecter des données, d'analyser les contextes, de coordonner les sous-processus et de prendre l'initiative de proposer des recommandations et des informations traitées.

Ironwood est conçu précisément pour ce type de charge : modèles avec un raisonnement complexe, des contextes étendus et des états persistantsLa grande quantité de mémoire partagée et de bande passante réseau est conçue pour permettre à plusieurs composants d'un même système d'IA de fonctionner de manière coordonnée sans être submergés par le trafic.

Dans ce contexte, Google adopte une stratégie différente de celle de Nvidia. Tandis que les puces Blackwell continuent de dominer l'entraînement de pointe et promettent des vitesses d'inférence très élevées dans certaines configurations, Google se concentre sur optimiser l'exécution continue et massive des modèles en productionIntégrer le matériel et le cloud dans un seul et même ensemble cohérent.

L'entreprise n'a pas l'intention de remplacer Nvidia sur tous les fronts, mais capter une part croissante du marché total de l'inférenceCertaines estimations internes suggèrent que, d'ici 2027, les TPU de Google pourraient représenter jusqu'à 30 % de ce marché, notamment auprès des grands clients déjà abonnés à Google Cloud.

L'accord avec Anthropic et le coup de pouce commercial

Le principal essor commercial d'Ironwood provient de... Anthropic, concepteur des modèles ClaudeLe 23 octobre 2025, la société a signé un accord colossal avec Google, s'engageant à utiliser jusqu'à un million de TPU et à investir des dizaines de milliards de dollars dans l'infrastructure sur Google Cloud.

Ce contrat prévoit un consommation d'énergie dépassant 1 gigawatt d'ici 2026Ce chiffre est impressionnant et donne une idée de l'ampleur des opérations des principaux acteurs de l'IA. Du jour au lendemain, Ironwood est passé d'un projet ambitieux en phase de développement à une entreprise bien réelle, soutenue par une forte demande.

Pour Google, cet accord résout l'une de ses plus grandes craintes : Augmenter la capacité des centres de données sans en garantir l'utilisationAvec Anthropic comme client principal, l'entreprise peut planifier de nouvelles installations, des contrats énergétiques et des déploiements de superpods Ironwood avec une bien meilleure visibilité sur le retour sur investissement.

Le choix d'Ironwood par Anthropic, plutôt que d'attendre la prochaine génération de processeurs Nvidia ou de recourir à du matériel propriétaire d'autres hyperscalers, est un signe clair de… confiance dans l'efficacité et le délai de commercialisation des TPU de Google« Plus d’inférence, moins d’énergie » est, en pratique, la devise implicite de ce mouvement.

Ces types d'accords à long terme aident également Google à mieux négocier ses propres coûts (de la fabrication de puces à la fourniture d'énergie) et renforce sa position sur un marché où la demande en calculs d'IA dépasse largement l'offre disponible.

Impact sur le marché des puces d'IA et concurrence avec Nvidia

Le lancement d'Ironwood représente un un élément qui change la donne sur le marché du matériel d'IACe marché a été jusqu'à présent largement dominé par les GPU Nvidia. Google n'est pas le seul à se lancer : AWS développe sa gamme Trainium2 et Microsoft poursuit son programme Maia, malgré des retards.

Nvidia reste leader dans le domaine de l'entraînement de pointe, avec ses architectures Hopper, Blackwell et la future Rubin, qui visent des configurations de plusieurs exaflops par rack. Cependant, Google oriente le marché vers une approche différente. modèle de plusieurs écosystèmes intégrés verticalementoù chaque géant du cloud conçoit ses propres puces, réseaux, logiciels et services cloud.

Dans ce nouveau contexte, Ironwood se positionne comme Une alternative solide pour les entreprises à la recherche d'une infrastructure d'inférence à grande échelle sans dépendre entièrement de l'écosystème CUDA. L'association de TPU personnalisés et de processeurs Axion, combinée à Google Cloud, constitue une offre très attractive pour les entreprises qui recherchent des coûts, des performances et une disponibilité prévisibles.

Cette décision met également la pression sur Nvidia, qui doit justifier des prix élevés dans un contexte où ce n'est plus la seule option viableÀ mesure qu'Amazon, Microsoft et Google renforcent leurs propres infrastructures, le marché s'éloigne du modèle de fournisseur unique pour se tourner vers un ensemble de solutions fermées, mais hautement optimisées, au sein de chaque cloud.

Cependant, le succès d'Ironwood et des TPU en général dépendra fortement de La pile logicielle de Google continue de mûrir au rythme de l'écosystème CUDA.Si les taux d'utilisation des clusters diminuent (par exemple, de 90 % à 70 %), l'efficacité globale en souffre et la compétitivité des prix pourrait être affectée.

Axion : le module complémentaire CPU pour l'infrastructure d'IA

Parallèlement au lancement d'Ironwood, Google a renforcé son La famille de processeurs personnalisés AxionBasée sur l'architecture Arm Neoverse, la plateforme Axion gère les tâches d'apprentissage automatique les plus complexes, tandis que les TPU prennent en charge les charges de travail générales liées à l'IA.

Les nouvelles instances N4A offrent jusqu'à 64 vCPU, 512 Go de mémoire DDR5 et réseau de 50 Gbit/sAvec des performances et un rapport prix/efficacité jusqu'à 100 % supérieurs à ceux des machines x86 équivalentes. Par ailleurs, C4A Metal est la première version dédiée au matériel nu basée sur Arm de Google Cloud, conçue pour des applications telles que le développement Android, l'automobile et les simulations avancées.

Des entreprises comme Vimeo ont signalé Amélioration de 30 % du transcodage vidéoZoomInfo annonce une augmentation de 60 % de l'efficacité de ses processus d'analyse de données. D'autres entreprises, comme Rise, affirment avoir réduit leur consommation d'énergie d'environ 20 % tout en maintenant une latence stable.

L'idée sous-jacente est qu'Axion agit comme couche de base informatique à usage généralPréparation des données, microservices, services web, logique métier, etc. Sur cette base, les TPU d'Ironwood se concentrent sur ce qu'ils font de mieux : accélérer l'entraînement, l'inférence et le raisonnement des modèles d'IA.

Ce tandem renforce l'idée que le L'informatique de nouvelle génération sera hybride.Des processeurs performants gèrent le flux de travail, tandis que des TPU (ou autres accélérateurs) assurent le calcul intensif. L'ensemble est mis en œuvre par la plateforme d'hypercalculateurs IA et les outils Google Cloud.

Perspectives d'investissement et protection des marges pour Alphabet

D'un point de vue financier, Ironwood est bien plus qu'une puce performante : c'est un élément stratégique pour protéger les marges d'Alphabet Dans le secteur de l'IA dans le cloud, les hyperscalers sont en bonne voie d'atteindre des capacités de puissance à deux chiffres en gigawatts d'ici 2027, et tout indique que les investissements dans les infrastructures resteront massifs.

En concevant ses propres puces, Google peut capter de la valeur tout au long de la chaîneDe la conception de puces au déploiement dans le cloud, au lieu de revendre du matériel tiers avec des marges réduites, elle transforme les CAPEX en un avantage concurrentiel et un outil pour différencier ses services.

L'amélioration des performances par watt d'Ironwood signifie que chaque mégawatt de capacité de centre de données est optimisé. Ses performances sont bien meilleures en termes d'inférences fournies.Si l'on combine cela avec des optimisations logicielles (vLLM, Pathways, GKE Inference Gateway, etc.), Google peut proposer des prix agressifs sans compromettre sa rentabilité.

Le contrat avec Anthropic ajoute un élément de stabilité supplémentaire à la Le plan de dépenses d'investissement de GoogleAu lieu de construire des infrastructures « à l'aveuglette » en attendant l'arrivée des clients, vous pouvez désormais dimensionner une grande partie de votre expansion en vous basant sur des accords à long terme, réduisant ainsi l'incertitude et le risque de surcapacité.

Malgré tout, des questions demeurent : Google parviendra-t-il à attirer davantage de grands clients ? Les projets énergétiques et les nouvelles sous-stations respecteront-ils les délais ? Son infrastructure logicielle maintiendra-t-elle un taux d’utilisation élevé ? Le potentiel est là, mais la mise en œuvre sera cruciale pour qu’Ironwood devienne un acteur majeur du secteur. un succès technique comme moteur de profits durables. CECI NE CONSTITUE PAS UN CONSEIL EN INVESTISSEMENT.

Globalement, la TPU v7 Ironwood de Google représente un bond générationnel qui va bien au-delà des téraflops affichés sur une fiche technique : elle combine puissance brute, mémoire partagée massive, réseaux optiques avancés, refroidissement liquide et cloud profondément intégré pour prendre en charge la nouvelle génération d’agents et de modèles d’IA fonctionnant 24 h/24 et 7 j/7. Dans un monde où l’énergie est rare, où les modèles se développent sans cesse et où la concurrence pour le contrôle de la pile d’IA est féroce, Ironwood s'impose comme le cœur d'une infrastructure conçue pour donner vie à « l'ère de l'inférence ». et de redéfinir comment, où et à quel coût l'intelligence artificielle est mise en œuvre à l'échelle planétaire.

Table des matières

- Qu'est-ce que Google TPU v7 Ironwood et pourquoi est-il si important ?

- Caractéristiques techniques clés du TPU v7 Ironwood

- De la puce au Superpod : comment Ironwood évolue

- Réfrigération, consommation et efficacité énergétique

- Ironwood au sein de l'hyperordinateur IA et de la couche logicielle

- L’« âge de l’inférence » et le rôle d’Ironwood

- L'accord avec Anthropic et le coup de pouce commercial

- Impact sur le marché des puces d'IA et concurrence avec Nvidia

- Axion : le module complémentaire CPU pour l'infrastructure d'IA

- Perspectives d'investissement et protection des marges pour Alphabet