- Microsoft Fabric memusatkan data, tata kelola, AI, dan analitik waktu nyata pada OneLake dan kemampuan terpadu.

- Platform ini memperkuat tata kelola, keamanan, dan biaya melalui Purview, keamanan OneLake, DLP, DSPM, dan integrasi dengan Azure Cost Management.

- Data Factory, Dataflow Gen2, dan alat migrasi memudahkan pemindahan beban kerja yang ada dan mengorkestrasi pipeline yang kompleks.

- Copilot, agen data, MCP, dan beban kerja baru seperti Fabric IQ dan Real-Time Intelligence mendorong skenario AI dan otomatisasi tingkat lanjut.

Jika Anda telah lama bekerja dengan data di ekosistem Microsoft, Anda pasti menyadari bahwa... Microsoft Fabric telah menjadi pusat utama analitik modern.Menyatukan semua hal yang sebelumnya tersebar di Power BI, Azure Synapse, Data Factory, dan layanan lainnya ke dalam satu platform. Dalam artikel ini, kita akan membahas secara menyeluruh dan detail fitur-fitur terbaru, peta jalan, dan implikasi praktis Fabric untuk analitik, tata kelola, AI, dan komputasi waktu nyata.

Idenya adalah, setelah Anda selesai membaca, Anda akan memiliki pemahaman yang jelas tentang Apa yang ditawarkan Microsoft Fabric saat ini, ke mana arahnya, dan bagaimana pengaruhnya terhadap arsitektur data? dari organisasi Anda: kemampuan tata kelola dengan Purview, otomatisasi dengan API dan Git, fitur AI baru, intelijen waktu nyata, keamanan di OneLake, migrasi, kinerja, dan masih banyak lagi.

Microsoft Fabric dan Kerangka Kerja Adopsi Cloud: tata kelola, biaya, dan otomatisasi

Dalam Kerangka Adopsi Cloud (Cloud Adoption Framework/CAF), Microsoft telah menerbitkan serangkaian panduan untuk menyelaraskan Desain Microsoft Fabric dengan pilar desain zona pendaratan.Bagian terakhir dari seri ini membahas tiga area utama: tata kelola, optimalisasi kapasitas, dan otomatisasi/DevOps.

Pada bagian tata kelola, Biaya kapasitas fabric diungkapkan melalui Azure Cost Management.Ini memungkinkan Anda untuk mengintegrasikan data penggunaan kapasitas F (dan SKU lainnya) secara langsung ke dalam dasbor biaya Azure, peringatan, dan analitik pengeluaran. Ini bukan hanya tentang melihat tagihan: Anda dapat menghubungkan informasi ini dengan tag, langganan, atau grup sumber daya untuk memahami siapa yang membelanjakan apa dan mengapa.

Arsitektur teknis dan model bisnis Fabric memungkinkan pelanggan Mengontrol konsumsi kapasitas secara cermat untuk mengoptimalkan biaya operasional.Dalam praktiknya, hal ini diterjemahkan menjadi beberapa pengungkit:

- Penskalaan kemampuan F: meningkatkan atau mengurangi kapasitas berdasarkan puncak yang dapat diprediksi, seperti kampanye penjualan, tenggat waktu akuntansi, atau beban data yang besar.

- Kemampuan untuk menjeda dan melanjutkanAdministrator fabric dapat menghentikan sementara kapasitas F ketika tidak dibutuhkan (misalnya, semalaman atau pada akhir pekan di lingkungan yang tidak kritis) untuk mengurangi biaya komputasi.

- Perlindungan lonjakan arusDua parameter tingkat kapasitas mengontrol bagaimana pekerjaan latar belakang dikelola untuk mencegahnya membebani lingkungan: Ambang Batas Penolakan Latar Belakang dan Ambang Batas Pemulihan Latar Belakang.

- Reservasi kapasitasDimungkinkan untuk memesan kapasitas untuk periode tertentu guna mendapatkan diskon, dengan syarat konsumsi yang diharapkan direncanakan secara cermat.

Di bidang tata kelola data, Fabric mengandalkan Microsoft Purview sebagai komponen utama untuk katalogisasi, penelusuran asal usul, dan klasifikasi.Dari Purview, dimungkinkan untuk menerapkan label sensitivitas, melihat silsilah antara asal, transformasi, dan konsumsi, mensertifikasi aset data, atau meningkatkan kampanye kualitas data, semuanya sambil mengintegrasikan elemen-elemen Fabric (Lakehouse, Warehouse, KQL, Power BI, dll.).

Bagian "Otomasi Platform dan DevOps" pada dasarnya disusun berdasarkan Integrasi dengan Git, pipeline deployment, dan REST API.Ruang kerja Fabric dapat dihubungkan ke repositori Git sehingga banyak pengembang dapat berkolaborasi dalam proyek rekayasa data, ilmu data, atau analitik waktu nyata yang sama tanpa tumpang tindih pekerjaan.

Git dan Deployment Pipelines memungkinkan Mengatur siklus hidup pengembangan, pengujian, dan produksi secara terkontrol.Promosi konten, pelacakan perubahan, sinkronisasi artefak, dan manajemen versi. Sejak Maret 2025, pipeline ini telah mendukung (secara umum atau dalam keadaan pratinjau) berbagai jenis elemen seperti pemicu, dasbor, aliran data, pipeline data, datamart, lakehouse, gudang data, KQL, notebook, laporan berhalaman, aplikasi organisasi, dll.

Sementara itu, Fabric mengungkap serangkaian API REST yang sangat luas yang dengannya hampir semua tugas administratif atau penyebaran dapat diotomatiskan: pembuatan ruang kerja dan folder, migrasi item secara massal, pengelolaan koneksi dan gateway, ekstraksi definisi, aktivasi pipeline atau notebook, dan lain sebagainya.

Pembaruan penting dalam analitik, AI, dan tata kelola untuk Microsoft Fabric

Evolusi Fabric ditandai dengan sejumlah besar fitur pratinjau dan kemampuan baru yang Mereka membahas hampir semua area platform tersebut.Kemudian, hal-hal tersebut dikelompokkan dan dibahas secara terstruktur sehingga cakupan keseluruhannya dapat terlihat.

Fungsi AI dalam Gudang Data dan fungsi multimodal

Di bidang data relasional, Fabric Data Warehouse menggabungkan Fungsi AI terintegrasi langsung dalam T-SQL. (pratinjau). Ini memungkinkan:

- Mengklasifikasikan atau mengkategorikan teks.

- Analisis sentimen.

- Ekstrak informasi terstruktur dari teks bebas.

- Terjemahkan teks antar bahasa.

- Tata bahasa yang benar.

Tujuannya adalah itu Tidak perlu keluar dari konteks SQL untuk memperkaya data dengan AI.Fungsi-fungsi ini dikombinasikan dengan dukungan multimodal yang lebih umum dalam fungsi AI Fabric, yang sekarang dapat memproses gambar (JPG/JPEG, PNG, GIF, WebP), PDF, dan format teks umum, serta input berupa jalur file.

Fasilitas seperti aifunc.load untuk memasukkan folder ke dalam tabel. Dengan opsi prompt dan skema, `aifunc.list_file_paths` memungkinkan Anda untuk melakukan iterasi melalui jalur file, dan `ai.infer_schema` menyimpulkan skema yang kompatibel dengan `ai.extract`. Semua ini memungkinkan Anda untuk mentransformasi dan memperkaya data tanpa membangun pipeline yang kompleks dari awal.

OneLake, Delta, Apache Iceberg dan akses multiplatform

Pada lapisan penyimpanan, OneLake tetap menjadi danau terpadu tempat semua Fabric berada. Salah satu peningkatan utama adalah kemampuan untuk Mengungkap tabel Delta Lake sebagai tabel Gunung Es Apache. tanpa memindahkan atau menduplikasi data, sehingga mesin yang kompatibel dengan Iceberg dapat langsung membaca apa yang ada di OneLake.

Selain itu, OneLake sekarang mendukung Data Apache Iceberg yang ditulis langsung oleh Snowflake, dikonsumsi di Fabric melalui akses tanpa salin.Strategi ini memperkuat interoperabilitas: Fabric tidak ingin menjadi silo, tetapi menjadi "pusat" data yang dapat dimanfaatkan oleh mesin lain tanpa menduplikasi penyimpanan.

Sejalan dengan hal itu, OneLake mengakui jalan pintas ke Azure Blob StorageOneDrive dan SharePoint, serta memperluas keamanan dengan peran akses, keamanan tingkat folder, baris, dan kolom, dan model keamanan yang dapat dihormati oleh pihak ketiga berkat perluasan model mesin otorisasi.

Salah satu poin yang sangat relevan adalah federasi katalog OneLake di Azure Databricks, yang memungkinkan Akses tanpa penyalinan (zero-copy) dari Unity Catalog ke tabel OneLake.Dengan cara ini, OneLake tetap menjadi sumber kebenaran, tetapi Databricks dapat melakukan kueri data secara langsung, hanya menyinkronkan metadata.

SQL Database on Fabric: performa, keamanan, dan virtualisasi

Basis data SQL Fabric semakin memiliki kemampuannya sendiri: ALTER DATABASE SET optionsDukungan untuk kolasi dan pengindeksan teks lengkap dalam pratinjau. Pada level kinerja basis data Dan terkait biaya, ada beberapa peningkatan:

- Pemadatan indeks otomatis untuk mengurangi penyimpanan, I/O, dan meningkatkan waktu kueri tanpa harus menjadwalkan pekerjaan pemeliharaan.

- Batas vCore maksimum untuk mengontrol penggunaan sumber daya komputasi (4 atau 32 vCore), dirancang untuk mencegah beban kerja mengonsumsi terlalu banyak kapasitas bersama.

- Kumpulan SQL Kustom yang memberikan administrator ruang kerja kendali terperinci atas alokasi sumber daya dan perutean kueri berdasarkan nama aplikasi.

Ini juga diaktifkan Virtualisasi data dalam basis data SQL, yang memungkinkan untuk melakukan kueri data eksternal yang tersimpan di OneLake dengan T-SQL, menggabungkan file dalam format umum dengan tabel relasional lokal menggunakan join, tanpa harus mengimpor data secara fisik.

Dari segi keamanan, basis data SQL mendukung Tautan Pribadi di tingkat penyewa (pratinjau)Hal ini mempermudah pengalihan lalu lintas data secara pribadi dan terkontrol, serta terintegrasi dengan konfigurasi jaringan aman Fabric secara keseluruhan.

Intelijen Waktu Nyata, Eventhouse, Eventstream, dan Activator

Modul Real-Time Intelligence (RTI) telah menjadi salah satu pembeda utama Fabric. Eventhouse dan Eventstream bergabung untuk Menerima, memproses, dan memicu peristiwa secara real-time. dari berbagai macam sumber, dan Activator mengatur tindakan yang dipicu dalam kondisi tertentu.

Di antara fitur-fitur baru yang paling canggih adalah:

- Deteksi anomali tanpa kode dengan pemilihan model otomatis, antarmuka sederhana, dan peringatan yang fleksibel.

- Acara Bisnis, yang menangkap momen-momen bisnis penting yang dihasilkan dari Fungsi Data Pengguna dan Notebook, serta memungkinkan Anda untuk mengaktifkan peringatan, logika khusus, alur kerja, model AI, atau pekerjaan Spark.

- Integrasi Fungsi Data Pengguna Aktivatorsehingga fungsi yang dibuat di Fabric dapat memproses peristiwa dari sumber mana pun, termasuk peristiwa internal dari platform itu sendiri dan dari OneLake.

- Kemampuan untuk memproses peristiwa dengan SQL (Operator SQL di Eventstream), memungkinkan transformasi aliran data waktu nyata dengan sintaks SQL yang dikenal.

Konektor yang relevan ditambahkan seperti buaian (untuk penyerapan log dan telemetri dari berbagai sumber), konektor dengan Solace PubSub+, dan dukungan streaming melalui jaringan pribadi melalui Azure Virtual Network, VPN, ExpressRoute, atau titik akhir pribadi.

Untuk skema data dan kontrak, Eventstream memperkenalkan sebuah Registri Skema yang mendefinisikan dan memvalidasi skema peristiwa untuk pipeline yang lebih tangguh, dan dukungan untuk Confluent Schema Registry untuk terhubung dengan Kafka di Confluent Cloud sambil tetap menghormati kontrak yang ada.

Kemampuan Copilot dan AI di seluruh platform.

Copilot di Fabric kini tersedia secara global, dengan kehadiran di Power BI, Data Factory, Ilmu Data & Rekayasa Data, dan penulisan kueri KQL.Selain itu, kemampuan khusus telah diintegrasikan:

- Copilot untuk Dataflow Gen2 (Pengambilan Data Modern)yang membantu memasukkan dan mengubah data dengan instruksi dalam bahasa alami.

- Copilot untuk Data Warehouse (obrolan), dapat diakses melalui tombol pada pita untuk mempercepat tugas pergudangan melalui dialog.

- Copilot untuk titik akhir analitik SQLyang menghasilkan dan mengoptimalkan kueri SQL dari deskripsi bisnis.

- Kopilot di buku catatan Dengan pengetahuan tentang konteks ruang kerja, lakehouse, struktur notebook, dan lingkungan eksekusi, mampu menghasilkan kode multi-langkah, melakukan refactoring, meringkas notebook yang kompleks, dan mendiagnosis kesalahan dengan opsi "Perbaiki dengan Copilot".

- Fitur pelengkapan otomatis sebaris (penyelesaian kode sebaris) dan pelengkapan kode sebaris Notebook Copilot (pratinjau), untuk menulis kode Python lebih cepat dan dengan lebih sedikit kesalahan.

Selain itu, basis teknologi AI sedang diperluas dengan Foundry Tools yang sudah terpasang dan terintegrasi (Azure OpenAI, Azure Language, Azure Translator), plugin OpenAI untuk Eventhouse (ai_embed_text dan ai_chat_completion) dan serangkaian agen dan agen data yang memungkinkan aplikasi lain, termasuk Copilot Studio, untuk bekerja pada data Fabric secara terkoordinasi.

Agen Data Fabric, MCP, dan alat pengembang

Pengenalan kain Agen data yang mampu mengatur akses ke data dan alat. Untuk agen AI, dengan SDK Python dan integrasi langsung dengan Microsoft Copilot Studio. Ini memudahkan untuk membangun asisten percakapan yang bekerja dengan data perusahaan yang terkelola di Fabric.

Secara paralel, Protokol Konteks Model (MCP) Ini menjadi komponen kunci dari integrasi antara agen AI dan layanan Fabric. Terdapat server MCP khusus untuk Activator dan Eventhouse, serta Fabric MCP yang berorientasi pada pengembangan yang:

- Fitur ini memungkinkan asisten AI untuk menghasilkan kode dan konten untuk item Fabric.

- Platform ini terintegrasi dengan alat pengembangan seperti VS Code dan GitHub Codespaces.

- Dokumen ini menyajikan alat untuk berkonsultasi dan mengambil tindakan berdasarkan data waktu nyata di Eventhouse.

Untuk pekerjaan pengembang sehari-hari, ada beberapa hal penting yang perlu disorot, termasuk: pengembangan lingkungan: Ekstensi MSSQL untuk VS Code dengan dukungan untuk basis data Fabric SQL., Microsoft ADO.NET Driver dan ODBC Driver untuk Fabric Data Engineering (koneksi ke Spark SQL melalui Livy), dan konektor Spark untuk basis data SQL yang menyederhanakan akses terautentikasi dari Spark ke basis data SQL di Azure dan Fabric.

Juga muncul Kain CLI, tersedia sebagai tugas terintegrasi di Azure DevOps, yang memungkinkan Anda untuk mengotomatiskan pengelolaan ruang kerja, item, dan penyebaran tanpa perlu menginstal alat eksternal secara manual.

Data Factory, migrasi data, dan orkestrasi di Fabric.

Lapisan integrasi data Fabric bergantung pada Data Factory dan Dataflow Gen2, yang merupakan fungsi penerima untuk... Orkestrasi akan lebih cerdas, lebih mudah diotomatisasi, dan dengan migrasi yang lebih sederhana. dari platform yang sudah ada.

Dataflow Gen2: performa, API publik, dan diagnostik

Di Dataflow Gen2, kita menemukan beberapa fitur dalam versi pratinjau:

- Pengeditan lanjutan pada kueri target. untuk menyesuaikan logika di tujuan secara langsung dari lingkungan pembuatan konten itu sendiri.

- Komputasi terpartisiyang memungkinkan sebagian aliran data berjalan secara paralel, sehingga mengurangi total waktu evaluasi.

- Unduh diagnostik pada tingkat eksekusi, dengan paket log terstruktur untuk analisis kinerja dan penyelesaian insiden.

- API Publik untuk membuat, memperbarui, menghapus, menjadwalkan, dan memantau aliran data secara terprogram.

- Parameter publik dengan dukungan CI/CDyang memungkinkan penyegaran aliran data dengan meneruskan nilai dari pipeline atau sumber lain.

- Data terkini untuk akses cepat ke item yang baru saja digunakan di pita Power Query dan di Dapatkan Data Modern.

Semua ini dilengkapi dengan kemampuan dari Evaluasi Power Query secara terprogram melalui REST.Hal ini membuka peluang untuk menjalankan skrip M sebagai bagian dari proses otomatis, mengintegrasikannya dengan Spark, pipeline, atau alat eksternal, dengan memanfaatkan konektor Power Query.

Data Factory: kinerja adaptif, konektivitas, dan dbt

Pada bagian integrasi yang lebih "klasik", Data Factory dalam Fabric memperkenalkan:

- Penyetelan kinerja adaptif untuk aktivitas penyalinan, yang secara cerdas menyesuaikan parameter kinerja sesuai dengan konfigurasi dan konteks eksekusi.

- Dukungan Change Data Capture (CDC) dalam pekerjaan penyalinan., untuk mereplikasi hanya perubahan (penyisipan, pembaruan, penghapusan) secara terus menerus.

- Gateway lokal dengan opsi peningkatan manual. Dikelola dari portal Fabric, API, atau skrip.

- koneksi baru-baru iniyang menambahkan properti penggunaan terakhir ke koneksi untuk memfasilitasi audit dan manajemen siklus hidup.

- Pekerjaan dbt asli, yang memungkinkan menjalankan proyek dbt di dalam Fabric dengan orkestrasi, pengujian, dokumentasi, dan tata kelola yang terintegrasi.

- Jalankan aktivitas Paket SSIS dalam pipeline, untuk menjalankan paket SSIS dari orkestrasi itu sendiri di Fabric.

Pengalaman pengguna juga ditingkatkan dengan Pemilih situs SharePoint (SharePoint Site Picker) yang menghindari pengetikan URL secara manual, dan dengan dukungan MCP untuk Data Factory, sehingga asisten AI dapat membuat dan menyebarkan Dataflow Gen2 hanya dari instruksi bahasa alami.

Alat migrasi dan replikasi data

Microsoft gencar mempromosikan migrasi ke Fabric melalui beberapa alat khusus:

- Penilaian Migrasi Fabric untuk Data Factoryyang menganalisis persiapan pipeline ADF dan memigrasikan pipeline yang didukung ke ruang kerja Fabric dengan pemetaan koneksi.

- Asisten Migrasi untuk Gudang Datayang sekarang dapat terhubung langsung ke gudang data sumber untuk memindahkannya ke Fabric Data Warehouse.

- Asisten Migrasi untuk basis data SQL, yang ditujukan untuk memigrasikan beban kerja SQL Server on-premises, dengan impor skema melalui DACPAC, deteksi ketidakkompatibilitas, dan rekomendasi.

Terkait replikasi, dukungan diberikan kepada pencerminan berbagai sumber operasional (Azure Database for MySQL, Google BigQuery, SQL Server, dll.) ke Fabric, dengan kemampuan untuk mengontrol tabel mana yang direplikasi, memulai ulang proses mirroring melalui REST dan, dalam kasus Databricks, memetakan kebijakan Unity Catalog ke keamanan OneLake.

Termasuk juga konektor replikasi dari Lakehouse yang menggunakan Umpan Data Perubahan Delta, yang mengungkap perubahan pada papan Lakehouse Delta menuju tujuan yang kompatibel tanpa harus menciptakan sesuatu yang baru dengan solusi buatan CDC.

Keamanan, tata kelola tingkat lanjut, dan pemantauan di Fabric

Salah satu kekhawatiran terbesar dalam platform analitik apa pun adalah bagaimana Mengamankan data, mengatur penggunaan, dan memantau konsumsi sumber daya.Fabric berkembang pesat di bidang-bidang ini.

Keamanan dan perlindungan data di OneLake

OneLake menambahkan model lengkap dari keamanan akses data dengan:

- Peran akses data untuk lakehouse dengan izin yang dapat dikonfigurasi dari antarmuka keamanan berbasis folder.

- Dukungan keamanan untuk pintasan agar pihak ketiga dapat menghormati kebijakan yang telah ditetapkan.

- API keamanan akses data OneLake, yang memungkinkan manajemen izin otomatis.

- Perluasan model ke mesin eksternal (otorisasi keamanan OneLake untuk pihak ketiga).

Secara paralel, perlindungan sedang diperluas dengan DLP membatasi akses mencakup seluruh data terstruktur di OneLake (SQL, KQL, gudang data) dan diperkenalkan. DSPM untuk AI bagi Fabric Copilot dan agen datayang memantau interaksi AI untuk informasi sensitif dan perilaku berisiko, dengan integrasi dengan Purview Audit dan eDiscovery.

Dari segi identitas, karakteristik seperti berikut ini muncul: identitas yang terkait dengan item (misalnya, Lakehouse dan Eventstream) melalui API REST, yang menghilangkan ketergantungan pemilik untuk operasi tertentu, dan autentikasi pintasan OneDrive dan SharePoint menggunakan identitas ruang kerja atau prinsipal layanan.

Tata kelola terpusat dan katalog OneLake

Pengalaman tata kelola data diperkuat oleh sebuah panel terpusat baru di katalog OneLakedi mana pemilik data dapat melihat tampilan agregat dari item yang telah mereka buat, menerima rekomendasi tindakan tata kelola, dan mengakses semua alat yang tersedia untuk meningkatkan keamanan dan kepatuhan.

Selain itu, sebuah API Pencarian Katalog OneLake bersama dengan alat MCP, yang memungkinkan penemuan item di seluruh lingkungan Fabric dari kode atau agen AI, dalam satu panggilan, dengan tetap memperhatikan izin katalog dan metadata.

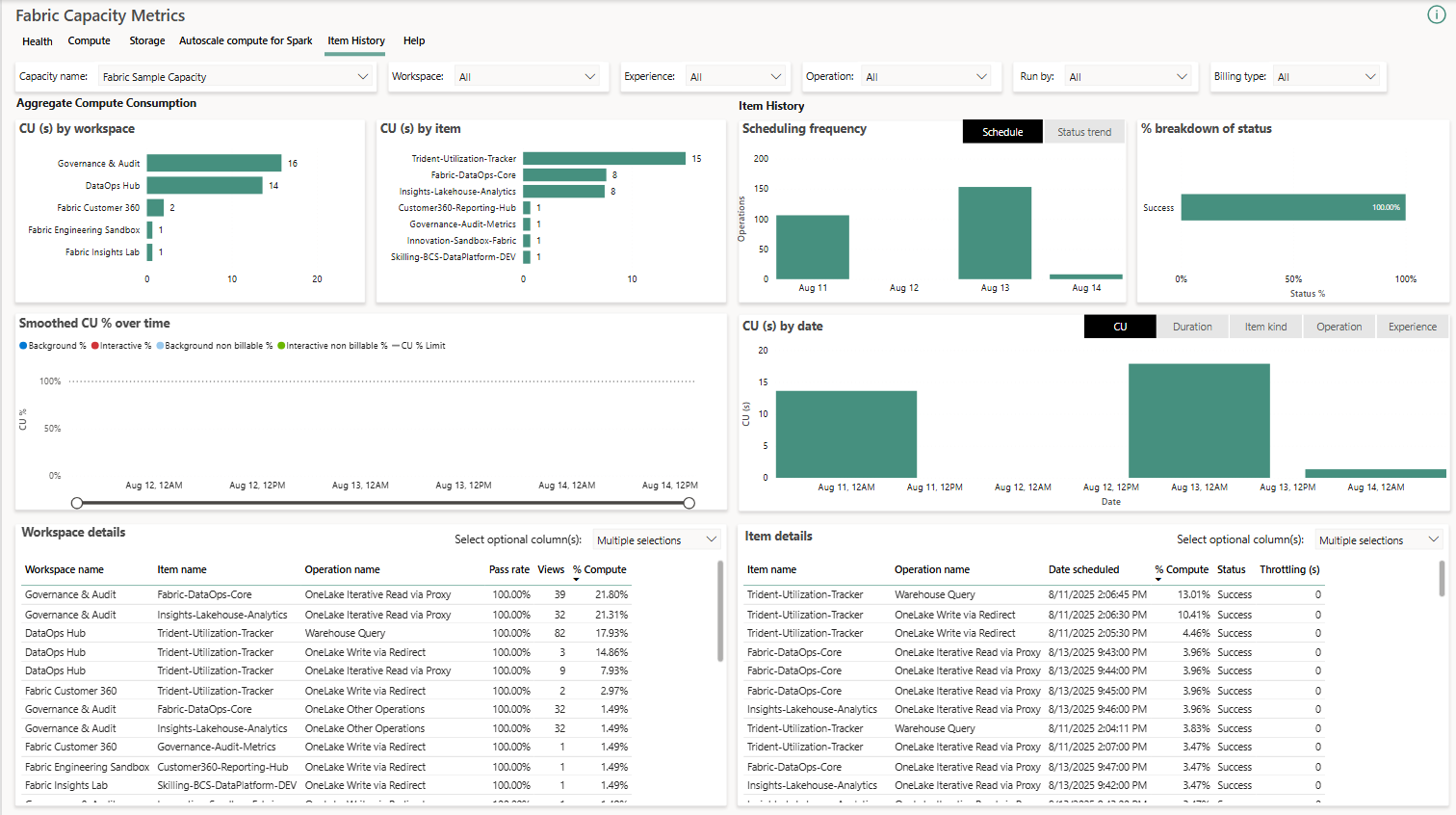

Pemantauan kapasitas, konsumsi, dan pekerjaan

Fabric menyediakan beberapa lapisan pengamatan:

- Pemantauan ruang kerja, yang membuat basis data di Fabric tempat log dan metrik dari berbagai item dikonsolidasikan (termasuk pekerjaan Copy dengan pemantauan terperinci).

- Pemantauan ruang kerja untuk tugas penyalinandengan metrik seperti throughput, volume data, kode kesalahan, dan waktu, semuanya diarahkan untuk analisis terpusat.

- Riwayat Item dalam penerapan metrik kapasitas, dengan tampilan 30 hari tentang konsumsi CU untuk setiap item, yang dapat difilter berdasarkan ruang kerja dan jenisnya.

- Perlindungan lonjakan arus listrik tingkat ruang kerjayang memungkinkan pengaturan ambang batas konsumsi per ruang kerja dalam jendela bergulir 24 jam, secara otomatis memblokir ruang kerja yang melebihi ambang batas tersebut, dan menandai ruang kerja sebagai "sangat penting" untuk mengecualikannya dari pembatasan.

Sebagai pelengkap, serangkaian awal API Admin Fabric Berfokus pada penemuan ruang kerja, barang, dan detail akses pengguna, memfasilitasi inventaris dinamis dan kontrol akses berkala.

Pemodelan bisnis, perencanaan, dan beban kerja baru

Di luar lapisan teknis, Microsoft memperkenalkan beban kerja baru yang berorientasi bisnis Tentang Fabric. Salah satu yang paling menonjol adalah Fabric IQ, yang berupaya menyatukan semantik bisnis, data, dan model untuk agen cerdas yang membuat keputusan berdasarkan pandangan holistik terhadap organisasi.

Di dalam Fabric IQ, hal-hal berikut muncul:

- Ontologi (pratinjau), suatu jenis item di mana entitas, relasi, properti, dan batasan didefinisikan sesuai dengan bahasa bisnis perusahaan.

- Rencana (pratinjau), sebuah platform tanpa kode untuk perencanaan, pelaporan, analitik, integrasi, dan manajemen kolaboratif.

Intelijen waktu nyata juga muncul. pembuat kembaran digital, sebuah item yang khusus dirancang untuk memodelkan kembaran digital berdasarkan data waktu nyata, dengan tujuan mengoptimalkan operasi fisik, memantau kondisi, dan mensimulasikan skenario.

Di sisi lain, hal itu diperkenalkan Beban kerja Fabric IQ Sebagai beban kerja terpisah, dan alat pendukung untuk tata kelola dan penyelarasan semantik terus berkembang, menutup lingkaran antara model data, logika bisnis, dan aplikasi AI/analitik.

Peningkatan kinerja, pengalaman pengguna, dan produktivitas.

Sebagai penutup ulasan ini, perlu digarisbawahi sejumlah peningkatan lintas sektor yang Meskipun tidak selalu menjadi berita utama, peristiwa-peristiwa tersebut sangat memengaruhi kehidupan sehari-hari. dari tim.

Pada bagian Spark dan komputasi terdistribusi, Fabric memperkenalkan:

- Fabric Runtime 2.0 (pratinjau) dengan Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 dan Python 3.12 di Azure Linux 3.0.

- Alat perbandingan aplikasi Sparkyang memungkinkan Anda untuk memilih dan membandingkan hingga empat eksekusi Spark secara paralel.

- Pemancar Diagnostik Percikanyang mengumpulkan log, metrik, dan peristiwa dari aplikasi Spark dan mengirimkannya ke tujuan seperti Event Hubs, penyimpanan, atau Log Analytics.

- Pustaka diagnostik JobInsight, sebuah pustaka untuk menganalisis eksekusi Spark yang telah selesai melalui API (kueri, pekerjaan, tahapan, tugas, eksekutor, log peristiwa).

Pada lapisan gudang, berikut ini ditambahkan: pengelompokan data Untuk meningkatkan kinerja dan mengurangi biaya akses, kolom IDENTITY untuk kunci pengganti, dan dukungan kontrol versi dan CI/CD melalui proyek Basis Data SQL di VS Code (kontrol sumber gudang).

Pengalaman pengguna portal Fabric juga berevolusi seiring dengan Penjelajahan bertab dan penjelajah objekIni memungkinkan Anda untuk membuka beberapa item sekaligus dan beralih di antara item tersebut dengan cepat. Hal ini, dikombinasikan dengan peningkatan seperti pengikatan otomatis Lakehouse di Git dan serangkaian utilitas untuk pemeliharaan Lakehouse (aktivitas pemeliharaan dan penyegaran titik akhir SQL), berkontribusi pada platform yang lebih ramah pengguna dan lincah.

Terakhir, fitur-fitur seperti Impor/ekspor definisi item secara massal (untuk migrasi, templat, dan pencadangan metadata), REST untuk folder, dukungan parameter dalam aktivasi item dari Activator, dan pemuatan data OneLake di Excel dengan katalog terintegrasi, melengkapi ekosistem yang mulai mencakup hampir semua kebutuhan umum tim data modern.

Dengan seluruh rangkaian kemampuan ini—mulai dari tata kelola terpusat, keamanan terperinci, dan orkestrasi cerdas, hingga AI yang tertanam dalam SQL, analitik waktu nyata, kembaran digital, dan agen MCP—Microsoft Fabric memperkuat posisinya sebagai platform data lengkap di mana Kuncinya bukan lagi hanya menyimpan dan memvisualisasikan data, tetapi mengatur, mengotomatisasi, dan memanfaatkan AI untuk mengendalikan setiap bagian dari siklus hidup data.Memungkinkan organisasi untuk mengembangkan arsitektur mereka secara bertahap, memigrasikan apa yang sudah mereka miliki dan memungkinkan solusi baru jauh lebih cepat daripada pendekatan tradisional.

Daftar isi

- Microsoft Fabric dan Kerangka Kerja Adopsi Cloud: tata kelola, biaya, dan otomatisasi

- Pembaruan penting dalam analitik, AI, dan tata kelola untuk Microsoft Fabric

- Fungsi AI dalam Gudang Data dan fungsi multimodal

- OneLake, Delta, Apache Iceberg dan akses multiplatform

- SQL Database on Fabric: performa, keamanan, dan virtualisasi

- Intelijen Waktu Nyata, Eventhouse, Eventstream, dan Activator

- Kemampuan Copilot dan AI di seluruh platform.

- Agen Data Fabric, MCP, dan alat pengembang

- Data Factory, migrasi data, dan orkestrasi di Fabric.

- Keamanan, tata kelola tingkat lanjut, dan pemantauan di Fabric

- Pemodelan bisnis, perencanaan, dan beban kerja baru

- Peningkatan kinerja, pengalaman pengguna, dan produktivitas.