- Microsoft Fabric centralizza dati, governance, intelligenza artificiale e analisi in tempo reale su OneLake e offre funzionalità unificate.

- La piattaforma rafforza la governance, la sicurezza e la gestione dei costi tramite Purview, la sicurezza OneLake, DLP, DSPM e l'integrazione con Azure Cost Management.

- Data Factory, Dataflow Gen2 e gli strumenti di migrazione semplificano lo spostamento dei carichi di lavoro esistenti e l'orchestrazione di pipeline complesse.

- Copilot, agenti dati, MCP e nuovi carichi di lavoro come Fabric IQ e Real-Time Intelligence guidano scenari avanzati di intelligenza artificiale e automazione.

Se lavori con i dati nell'ecosistema Microsoft da un po' di tempo, avrai notato che Microsoft Fabric è diventato il fulcro dell'analisi modernaUnificare in un'unica piattaforma tutto ciò che era precedentemente distribuito tra Power BI, Azure Synapse, Data Factory e altri servizi. In questo articolo, esamineremo in modo approfondito e dettagliato le ultime funzionalità, la roadmap e le implicazioni pratiche di Fabric per l'analisi, la governance, l'intelligenza artificiale e il calcolo in tempo reale.

L'idea è che, quando avrai finito di leggere, avrai una chiara comprensione di Che cosa offre Microsoft Fabric oggi, quali sono le sue prospettive future e in che modo influisce sull'architettura dei dati? della tua organizzazione: funzionalità di governance con Purview, automazione con API e Git, nuove funzionalità di intelligenza artificiale, intelligence in tempo reale, sicurezza in OneLake, migrazioni, prestazioni e molto altro.

Microsoft Fabric e il Cloud Adoption Framework: governance, costi e automazione

Nell'ambito del Cloud Adoption Framework (CAF), Microsoft ha pubblicato una serie di guide per allineare Progettazione con Microsoft Fabric utilizzando i pilastri di progettazione delle landing zoneLa parte finale di questa serie affronta tre aree chiave: governance, ottimizzazione della capacità e automazione/DevOps.

Nella sezione sulla governance, I costi di capacità dell'infrastruttura sono visibili tramite Azure Cost Management.Ciò consente di integrare nativamente i dati di utilizzo della capacità F (e di altri SKU) nei dashboard dei costi, negli avvisi e nelle analisi della spesa di Azure. Non si tratta solo di visualizzare la fattura: è possibile confrontare queste informazioni con tag, sottoscrizioni o gruppi di risorse per capire chi spende cosa e perché.

L'architettura tecnica e il modello di business di Fabric consentono ai clienti controllare con precisione il consumo di capacità per ottimizzare i costi operativiIn pratica, ciò si traduce in diverse leve:

- Scalabilità delle capacità F: aumentare o diminuire la capacità in base a picchi prevedibili, come campagne di vendita, scadenze contabili o carichi di dati elevati.

- Funzionalità di pausa e ripresaGli amministratori della rete possono sospendere una capacità F quando non è necessaria (ad esempio, durante la notte o nei fine settimana in ambienti non critici) per ridurre i costi di elaborazione.

- Protezione contro le sovratensioniDue parametri relativi al livello di capacità controllano la gestione dei processi in background per evitare che saturino l'ambiente: la soglia di rifiuto dei processi in background e la soglia di ripristino dei processi in background.

- Prenotazioni di capacitàÈ possibile riservare capacità per periodi definiti al fine di ottenere sconti, a condizione che il consumo previsto sia pianificato con precisione.

Nell'ambito della governance dei dati, Fabric si affida a Microsoft Purview come componente centrale per la catalogazione, la tracciabilità e la classificazione.Da Purview è possibile applicare etichette di sensibilità, visualizzare la provenienza dei dati, le trasformazioni e il loro utilizzo, certificare le risorse dati o potenziare le campagne di qualità dei dati, il tutto integrando gli elementi di Fabric (Lakehouse, Warehouse, KQL, Power BI, ecc.).

La sezione "Automazione della piattaforma e DevOps" è strutturata principalmente attorno a Integrazione con Git, pipeline di distribuzione e API RESTGli spazi di lavoro di Fabric possono essere collegati a repository Git, consentendo a più sviluppatori di collaborare allo stesso progetto di ingegneria dei dati, scienza dei dati o analisi in tempo reale senza sovrapposizioni di lavoro.

Git e le pipeline di distribuzione consentono orchestrare i cicli di vita di sviluppo, test e produzione in modo controllatoPromozione dei contenuti, tracciamento delle modifiche, sincronizzazione degli artefatti e gestione delle versioni. Da marzo 2025, queste pipeline supportano (in versione generale o di anteprima) un'ampia gamma di tipi di elementi come trigger, dashboard, flussi di dati, pipeline di dati, data mart, lakehouse, data warehouse, KQL, notebook, report impaginati, applicazioni aziendali, ecc.

Nel frattempo, Fabric mette in mostra un insieme molto ampio di API REST con cui automatizzare quasi ogni attività amministrativa o di distribuzione: creazione di aree di lavoro e cartelle, migrazione in blocco di elementi, gestione di connessioni e gateway, estrazione di definizioni, attivazione di pipeline o notebook, tra le altre cose.

Principali aggiornamenti in materia di analisi, intelligenza artificiale e governance per Microsoft Fabric.

L'evoluzione di Fabric è caratterizzata da un numero enorme di funzionalità di anteprima e nuove capacità che Riguardano praticamente tutte le aree della piattaformaVengono quindi raggruppati e discussi in modo strutturato, in modo da poterne avere una visione completa.

Funzioni di intelligenza artificiale nel Data Warehouse e funzioni multimodali

Nell'ambito dei dati relazionali, Fabric Data Warehouse incorpora Funzioni di intelligenza artificiale direttamente in T-SQL (anteprima). Ciò consente:

- Classificare o categorizzare il testo.

- Analizzare il sentiment.

- Estrarre informazioni strutturate da testo libero.

- Traduci testi tra lingue diverse.

- Grammatica corretta.

L'obiettivo è quello Non è necessario uscire dal contesto SQL per arricchire i dati con l'intelligenza artificiale.Queste funzionalità sono integrate con un supporto multimodale più generale nelle funzioni di intelligenza artificiale di Fabric, che ora possono elaborare immagini (JPG/JPEG, PNG, GIF, WebP), PDF e formati di testo comuni, nonché input sotto forma di percorsi di file.

Servizi come aifunc.load per l'inserimento di cartelle in tabelle Grazie alle opzioni di prompt e schema, `aifunc.list_file_paths` consente di iterare sui percorsi dei file, mentre `ai.infer_schema` deduce schemi compatibili con `ai.extract`. Tutto ciò permette di trasformare e arricchire i dati senza dover costruire pipeline complesse da zero.

OneLake, Delta, Apache Iceberg e accesso multipiattaforma

A livello di storage, OneLake rimane il lago unificato in cui risiede tutta Fabric. Uno dei principali miglioramenti è la capacità di Esposizione delle tabelle di Delta Lake come tabelle di Apache Iceberg. senza spostare o duplicare i dati, in modo che i motori compatibili con Iceberg possano leggere direttamente ciò che è presente su OneLake.

Inoltre, OneLake ora supporta I dati di Apache Iceberg vengono scritti direttamente da Snowflake e utilizzati in Fabric tramite accesso senza copia.Questa strategia rafforza l'interoperabilità: Fabric non vuole essere un silo, ma un "hub" di dati che altri motori possono sfruttare senza duplicare lo storage.

Sulla stessa linea, OneLake ammette Collegamenti rapidi ad Azure Blob StorageOneDrive e SharePoint, ed estende la sicurezza con ruoli di accesso, sicurezza a livello di cartella, riga e colonna, e un modello di sicurezza che terze parti possono rispettare grazie all'estensione del modello del motore autorizzato.

Un punto particolarmente rilevante è la federazione del catalogo OneLake in Azure Databricks, che consente Accesso senza copia da Unity Catalog alle tabelle di OneLakeIn questo modo, OneLake rimane la fonte di verità, ma Databricks può interrogare i dati direttamente, sincronizzando solo i metadati.

Database SQL su Fabric: prestazioni, sicurezza e virtualizzazione

Il database SQL di Fabric sta acquisendo nuove funzionalità: ALTER DATABASE SET opzioniSupporto per la collazione e l'indicizzazione full-text in anteprima. Al livello di prestazioni del database Per quanto riguarda i costi, ci sono diversi miglioramenti:

- Compattazione automatica dell'indice per ridurre lo spazio di archiviazione, le operazioni di I/O e migliorare i tempi di interrogazione senza dover pianificare interventi di manutenzione.

- Limite massimo di vCore per controllare l'utilizzo delle risorse di calcolo (4 o 32 vCore), progettato per impedire che un carico di lavoro consumi troppe risorse condivise.

- Pool SQL personalizzati che offrono agli amministratori dello spazio di lavoro un controllo granulare sull'allocazione delle risorse e sull'instradamento delle query in base al nome dell'applicazione.

È anche abilitato Virtualizzazione dei dati in un database SQLche consente di interrogare dati esterni archiviati in OneLake con T-SQL, unendo file in formati comuni con tabelle relazionali locali tramite join, senza dover importare fisicamente i dati.

In termini di sicurezza, il database SQL supporta Link privato a livello di inquilino (anteprima)Ciò semplifica il canalizzazione del traffico dati in modo privato e controllato, integrandosi con la configurazione di rete sicura complessiva di Fabric.

Real-Time Intelligence, Eventhouse, Eventstream e Activator

Il modulo Real-Time Intelligence (RTI) è diventato uno dei principali elementi distintivi di Fabric. Eventhouse ed Eventstream si combinano per Acquisire, elaborare e attivare eventi in tempo reale da ogni tipo di fonte, e Activator orchestra le azioni che vengono attivate in determinate condizioni.

Tra le nuove funzionalità più potenti figurano:

- Rilevamento delle anomalie senza codice con selezione automatica del modello, interfaccia semplice e avvisi flessibili.

- Eventi aziendaliche catturano i momenti chiave del business generati dalle Funzioni dati utente e dai Notebook e consentono di attivare avvisi, logiche personalizzate, flussi, modelli di intelligenza artificiale o processi Spark.

- Integrazione delle funzioni dei dati utente e dell'attivatoreIn questo modo, le funzioni create in Fabric possono elaborare eventi provenienti da qualsiasi fonte, inclusi eventi interni della piattaforma stessa e di OneLake.

- Possibilità di elaborare eventi con SQL (operatore SQL in Eventstream), consentendo la trasformazione di flussi in tempo reale con sintassi SQL nota.

Vengono aggiunti connettori pertinenti come Culla (per l'acquisizione di log e dati di telemetria da più fonti), un connettore con Solace PubSub+ e supporto per lo streaming su reti private tramite Azure Virtual Network, VPN, ExpressRoute o endpoint privati.

Per gli schemi di dati e i contratti, Eventstream introduce un Registro degli schemi che definisce e convalida gli schemi degli eventi per pipeline più robuste e supporta il Confluent Schema Registry per connettersi a Kafka in Confluent Cloud nel rispetto dei contratti esistenti.

Funzionalità di copilota e intelligenza artificiale su tutta la piattaforma.

Copilot in Fabric è ora disponibile a livello globale, con una presenza in Power BI, Data Factory, Data Science e Data Engineering e scrittura di query KQLInoltre, sono state integrate funzionalità specifiche:

- Copilot per Dataflow Gen2 (Modern Get Data)che aiuta ad acquisire e trasformare i dati con istruzioni in linguaggio naturale.

- Copilota per Data Warehouse (chat), accessibile tramite un pulsante sulla barra multifunzione per accelerare le attività di gestione del magazzino attraverso una finestra di dialogo.

- Copilot per endpoint di analisi SQLche genera e ottimizza query SQL a partire da descrizioni aziendali.

- Copilota sui notebook Grazie alla conoscenza del contesto dell'area di lavoro, di Lakehouse, della struttura dei notebook e dell'ambiente di esecuzione, è in grado di generare codice multistep, effettuare il refactoring, riassumere notebook complessi e diagnosticare errori con l'opzione "Correggi con Copilot".

- Completamento automatico in linea (completamento del codice in linea) e completamento del codice in linea di Notebook Copilot (anteprima), per scrivere codice Python più velocemente e con meno errori.

Inoltre, la base tecnologica dell'IA viene ampliata con Strumenti di fonderia preconfigurati integrati (Azure OpenAI, Azure Language, Azure Translator), plugin OpenAI per Eventhouse (ai_embed_text e ai_chat_completion) e una serie di agenti e agenti dati che consentono ad altre applicazioni, tra cui Copilot Studio, di lavorare sui dati di Fabric in modo orchestrato.

Agenti dati Fabric, MCP e strumenti per sviluppatori

I tessuti introducono agenti dati in grado di orchestrare l'accesso a dati e strumenti Per gli agenti di intelligenza artificiale, con un SDK Python e l'integrazione diretta con Microsoft Copilot Studio. Questo semplifica la creazione di assistenti conversazionali che interagiscono con i dati aziendali gestiti in Fabric.

Parallelamente, il Protocollo del contesto modello (MCP) Diventa un componente chiave dell'integrazione tra agenti di intelligenza artificiale e servizi Fabric. Sono disponibili server MCP dedicati per Activator ed Eventhouse, e un Fabric MCP orientato allo sviluppo che:

- Consente agli assistenti basati sull'intelligenza artificiale di generare codice e contenuti per gli elementi di Fabric.

- Si integra con strumenti di sviluppo come VS Code e GitHub Codespaces.

- Offre strumenti per la consultazione e l'elaborazione di dati in tempo reale all'interno di Eventhouse.

Per il lavoro quotidiano dello sviluppatore, ci sono diversi elementi chiave da evidenziare, tra cui: sviluppo dell'ambiente: Estensione MSSQL per VS Code con supporto per il database Fabric SQL, il driver Microsoft ADO.NET e il driver ODBC per Fabric Data Engineering (connessione a Spark SQL tramite Livy) e un connettore Spark per database SQL che semplifica l'accesso autenticato da Spark ai database SQL in Azure e Fabric.

Appare anche il CLI di Fabric, disponibile come attività integrata in Azure DevOps, che consente di automatizzare la gestione di aree di lavoro, elementi e distribuzioni senza installare manualmente strumenti esterni.

Data Factory, migrazioni di dati e orchestrazione in Fabric

Il livello di integrazione dati di Fabric si basa su Data Factory e Dataflow Gen2, che sono funzioni di ricezione per... L'orchestrazione sarà più intelligente, più automatizzabile e con migrazioni più semplici. dalle piattaforme esistenti.

Dataflow Gen2: prestazioni, API pubbliche e diagnostica

In Dataflow Gen2 troviamo diverse funzionalità in anteprima:

- Modifica avanzata delle query di destinazione per regolare la logica di destinazione direttamente dall'ambiente di authoring.

- Calcolo partizionatoCiò consente l'esecuzione in parallelo di alcune parti del flusso di dati, riducendo il tempo totale di valutazione.

- Scarica la diagnostica a livello di esecuzione, con pacchetti di log strutturati per l'analisi delle prestazioni e la risoluzione degli incidenti.

- API pubbliche per la creazione, l'aggiornamento, l'eliminazione, la pianificazione e il monitoraggio programmatico dei flussi di dati.

- Parametri pubblici con supporto CI/CDche consentono di aggiornare i flussi di dati passando valori da pipeline o altre fonti.

- Dati recenti per un accesso rapido agli elementi utilizzati di recente nella barra multifunzione di Power Query e in Ottieni dati moderni.

Tutto ciò è completato dalle capacità di Valutare Power Query a livello programmatico tramite RESTQuesto apre la strada all'esecuzione di script M come parte di processi automatizzati, integrandoli con Spark, pipeline o strumenti esterni, sfruttando i connettori di Power Query.

Data Factory: prestazioni adattive, connettività e dbt

Nella parte più "classica" dell'integrazione, Data Factory all'interno di Fabric introduce:

- Regolazione adattiva delle prestazioni per l'attività di copia, che regola in modo intelligente i parametri di prestazione in base alla configurazione e al contesto di esecuzione.

- Supporto Change Data Capture (CDC) nel processo di copia, per replicare continuamente solo le modifiche (inserimenti, aggiornamenti, eliminazioni).

- Gateway locali con opzione di aggiornamento manuale Gestito tramite il portale Fabric, API o script.

- connessioni recentiche aggiunge proprietà di ultimo utilizzo alle connessioni per facilitare la verifica e la gestione del ciclo di vita.

- Lavoro nativo dbtche consente di eseguire progetti dbt all'interno di Fabric con orchestrazione, test, documentazione e governance integrati.

- Richiama l'attività del pacchetto SSIS nelle pipeline, per eseguire pacchetti SSIS direttamente dall'orchestrazione in Fabric.

L'esperienza utente è inoltre migliorata con un Selettore del sito SharePoint (SharePoint Site Picker) che evita di digitare manualmente gli URL e, grazie al supporto MCP per Data Factory, consente agli assistenti AI di creare e distribuire Dataflow Gen2 semplicemente tramite istruzioni in linguaggio naturale.

Strumenti per la migrazione e la replica dei dati

Microsoft sta promuovendo attivamente la migrazione a Fabric attraverso diversi strumenti specifici:

- Valutazione della migrazione dell'infrastruttura per Data Factoryche analizza la preparazione delle pipeline ADF e migra quelle supportate in un'area di lavoro Fabric con mappatura delle connessioni.

- Assistente alla migrazione per Data Warehouseche ora può connettersi direttamente al data warehouse di origine per spostarlo in Fabric Data Warehouse.

- Assistente alla migrazione per database SQL, finalizzato alla migrazione di carichi di lavoro SQL Server locali, con importazione dello schema tramite DACPAC, rilevamento delle incompatibilità e raccomandazioni.

Per quanto riguarda la replica, viene fornito supporto a replicazione di più fonti operative (Azure Database per MySQL, Google BigQuery, SQL Server, ecc.) a Fabric, con la possibilità di controllare quali tabelle vengono replicate, riavviare i processi di mirroring tramite REST e, nel caso di Databricks, mappare le policy di Unity Catalog alla sicurezza di OneLake.

È incluso anche un connettore di replica di Lakehouse che utilizza Feed di dati sulle variazioni delta, che espone le modifiche alle schede Lakehouse Delta verso destinazioni compatibili senza dover reinventare la ruota con le soluzioni sviluppate internamente da CDC.

Sicurezza, governance avanzata e monitoraggio in Fabric

Una delle maggiori preoccupazioni in qualsiasi piattaforma di analisi è come proteggere i dati, regolarne l'utilizzo e monitorare il consumo delle risorseIl settore tessile sta maturando rapidamente su questi fronti.

Sicurezza e protezione dei dati presso OneLake

OneLake aggiunge un modello completo di sicurezza dell'accesso ai dati con:

- Ruoli di accesso ai dati per Lakehouse con autorizzazioni configurabili tramite un'interfaccia di sicurezza basata su cartelle.

- Supporto di sicurezza per i collegamenti in modo che terze parti possano rispettare le politiche definite.

- L'API di sicurezza per l'accesso ai dati di OneLake consente la gestione automatizzata delle autorizzazioni.

- Estensione del modello a motori esterni (autorizzazione di sicurezza OneLake per terze parti).

Parallelamente, la protezione viene ampliata con DLP limita l'accesso su tutti i dati strutturati in OneLake (SQL, KQL, data warehouse) e viene introdotto DSPM per l'IA per Fabric Copilots e agenti datiche monitora le interazioni dell'IA per individuare informazioni sensibili e comportamenti a rischio, con integrazione con Purview Audit ed eDiscovery.

In termini di identità, emergono caratteristiche quali le seguenti: identità associate agli elementi (ad esempio, Lakehouse ed Eventstream) tramite API REST, che eliminano la dipendenza dal proprietario per determinate operazioni, e l'autenticazione dei collegamenti di OneDrive e SharePoint utilizzando identità di spazio di lavoro o entità servizio.

governance centralizzata e catalogo OneLake

L'esperienza di governance dei dati è rafforzata da un nuovo pannello centralizzato nel catalogo OneLakedove i proprietari dei dati possono visualizzare una panoramica aggregata degli elementi che hanno creato, ricevere raccomandazioni sulle azioni di governance e accedere a tutti gli strumenti disponibili per migliorare la sicurezza e la conformità.

Inoltre, un API di ricerca del catalogo OneLake insieme a uno strumento MCP, che consente di individuare elementi nell'intero ambiente Fabric tramite codice o agenti di intelligenza artificiale, con una singola chiamata, nel rispetto delle autorizzazioni del catalogo e dei metadati.

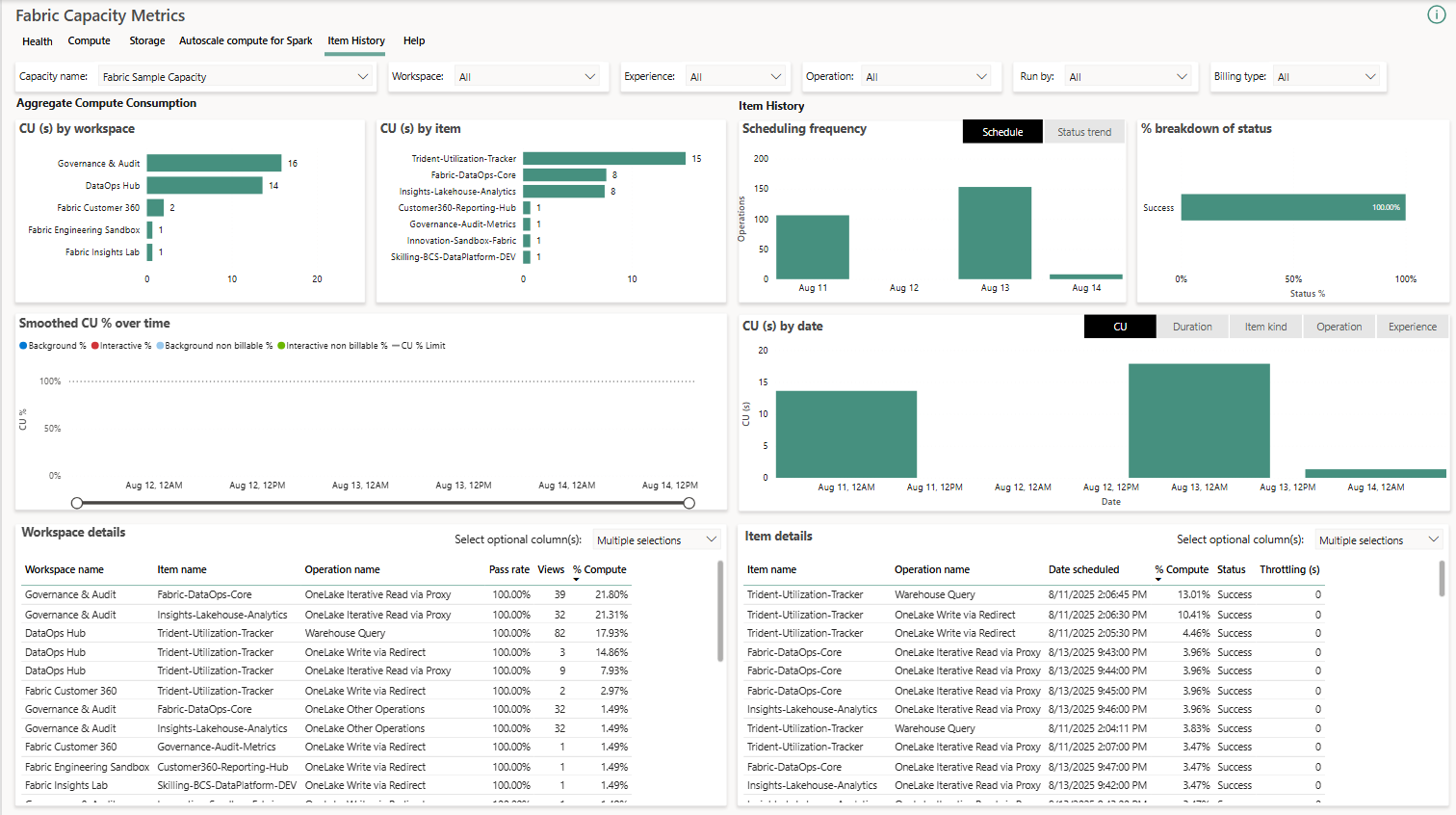

Monitoraggio delle capacità, dei consumi e del lavoro

Fabric offre diversi livelli di osservabilità:

- Monitoraggio dell'area di lavoro, che crea un database in Fabric in cui vengono consolidati i log e le metriche di più elementi (inclusi i processi di copia con monitoraggio dettagliato).

- Monitoraggio dello spazio di lavoro per il processo di copiacon metriche quali velocità di elaborazione, volume dei dati, codici di errore e tempi, tutte orientate all'analisi centralizzata.

- Cronologia degli elementi nell'applicazione delle metriche di capacità, con visualizzazioni a 30 giorni del consumo di CU per ogni elemento, filtrabili per area di lavoro e tipologia.

- Protezione contro le sovratensioni a livello di postazione di lavoroche consente di impostare soglie di consumo per ogni spazio di lavoro in una finestra temporale di 24 ore, bloccando automaticamente quelli che le superano e contrassegnando gli spazi di lavoro come "critici" per escluderli dalle limitazioni.

A complemento di ciò, un set iniziale di API di amministrazione di Fabric focalizzato sulla scoperta di spazi di lavoro, oggetti e dettagli di accesso degli utenti, facilitando inventari dinamici e controlli di accesso periodici.

Modellazione aziendale, pianificazione e nuovi carichi di lavoro

Oltre lo strato tecnico, Microsoft sta introducendo nuovi carichi di lavoro orientati al business Informazioni su Fabric. Uno dei progetti più importanti è Fabric IQ, che mira a unificare semantica aziendale, dati e modelli per agenti intelligenti in grado di prendere decisioni basate su una visione olistica dell'organizzazione.

All'interno di Fabric IQ vengono visualizzati i seguenti elementi:

- Ontologia (anteprima), un tipo di elemento in cui entità, relazioni, proprietà e vincoli sono definiti secondo il linguaggio aziendale dell'azienda.

- Piano (anteprima), una piattaforma senza codice per la pianificazione, la creazione di report, l'analisi, l'integrazione e la gestione collaborativa.

Emerge anche l'intelligenza in tempo reale costruttore di gemelli digitali, un elemento specializzato nella modellazione di gemelli digitali basati su dati in tempo reale, con l'obiettivo di ottimizzare le operazioni fisiche, monitorare gli stati e simulare scenari.

D'altra parte, viene introdotto Carico di lavoro Fabric IQ come carico di lavoro separato, e gli strumenti di supporto per la governance e l'allineamento semantico continuano ad espandersi, chiudendo il cerchio tra modelli di dati, logica aziendale e applicazioni di IA/analisi.

Miglioramenti in termini di prestazioni, esperienza utente e produttività.

Per concludere questa revisione, vale la pena evidenziare una serie di miglioramenti trasversali che Non sempre finiscono sui titoli dei giornali, ma influenzano notevolmente la vita quotidiana. delle squadre.

Nella sezione dedicata a Spark e al calcolo distribuito, Fabric introduce:

- Fabric Runtime 2.0 (anteprima) con Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 e Python 3.12 su Azure Linux 3.0.

- Strumento di confronto delle app Sparkche consente di selezionare e confrontare fino a quattro esecuzioni Spark in parallelo.

- Emettitore diagnostico Sparkche raccoglie log, metriche ed eventi dalle applicazioni Spark e li invia a destinazioni quali Event Hubs, sistemi di archiviazione o Log Analytics.

- Libreria diagnostica JobInsight, una libreria per l'analisi delle esecuzioni Spark completate tramite API (query, job, stage, task, executor, registri eventi).

Nel livello del magazzino vengono aggiunti i seguenti elementi: raggruppamento dei dati Per migliorare le prestazioni e ridurre i costi di accesso, colonne IDENTITY per chiavi surrogate e supporto per il controllo della versione e CI/CD tramite progetti di database SQL in VS Code (controllo del codice sorgente del data warehouse).

Anche l'esperienza utente del portale Fabric si evolve con Navigazione a schede ed esploratore di oggettiCiò consente di aprire più elementi contemporaneamente e di passare rapidamente da uno all'altro. Questa funzionalità, unita a miglioramenti come l'associazione automatica di Lakehouse in Git e la suite di utilità per la manutenzione di Lakehouse (attività di manutenzione e aggiornamento degli endpoint SQL), contribuisce a creare una piattaforma più intuitiva e agile.

Infine, caratteristiche come Importazione/esportazione in blocco delle definizioni degli articoli (per migrazioni, modelli e backup dei metadati), REST per le cartelle, supporto dei parametri nelle attivazioni degli elementi da Activator e caricamento dei dati OneLake in Excel con catalogo integrato, completano un ecosistema che inizia a coprire praticamente tutte le esigenze tipiche di un moderno team di dati.

Con questo insieme completo di funzionalità, dalla governance centralizzata, alla sicurezza granulare e all'orchestrazione intelligente, fino all'IA integrata in SQL, all'analisi in tempo reale, ai gemelli digitali e agli agenti MCP, Microsoft Fabric consolida la sua posizione di piattaforma dati completa in cui La chiave non è più solo archiviare e visualizzare i dati, ma governarli, automatizzarli e sfruttare l'intelligenza artificiale per controllare ogni fase del ciclo di vita dei dati.Consente alle organizzazioni di far evolvere gradualmente le proprie architetture, migrando quelle già esistenti e abilitando nuove soluzioni molto più rapidamente rispetto agli approcci tradizionali.

Sommario

- Microsoft Fabric e il Cloud Adoption Framework: governance, costi e automazione

- Principali aggiornamenti in materia di analisi, intelligenza artificiale e governance per Microsoft Fabric.

- Funzioni di intelligenza artificiale nel Data Warehouse e funzioni multimodali

- OneLake, Delta, Apache Iceberg e accesso multipiattaforma

- Database SQL su Fabric: prestazioni, sicurezza e virtualizzazione

- Real-Time Intelligence, Eventhouse, Eventstream e Activator

- Funzionalità di copilota e intelligenza artificiale su tutta la piattaforma.

- Agenti dati Fabric, MCP e strumenti per sviluppatori

- Data Factory, migrazioni di dati e orchestrazione in Fabric

- Sicurezza, governance avanzata e monitoraggio in Fabric

- Modellazione aziendale, pianificazione e nuovi carichi di lavoro

- Miglioramenti in termini di prestazioni, esperienza utente e produttività.