- „Microsoft Fabric“ centralizuoja duomenis, valdymą, dirbtinį intelektą ir realaus laiko analizę „OneLake“ platformoje ir suvienodintose funkcijose.

- Platforma stiprina valdymą, saugumą ir sąnaudas per „Purview“, „OneLake“ saugumą, DLP, DSPM ir integraciją su „Azure Cost Management“.

- „Data Factory“, „Dataflow Gen2“ ir perkėlimo įrankiai leidžia lengvai perkelti esamus darbo krūvius ir organizuoti sudėtingus srautus.

- „Copilot“, duomenų agentai, MCP ir nauji darbo krūviai, tokie kaip „Fabric IQ“ ir realaus laiko intelektas, skatina pažangius dirbtinio intelekto ir automatizavimo scenarijus.

Jei jau kurį laiką dirbate su duomenimis „Microsoft“ ekosistemoje, tikriausiai pastebėjote, kad „Microsoft Fabric“ tapo šiuolaikinės analizės centruVisko, kas anksčiau buvo paskirstyta „Power BI“, „Azure Synapse“, „Data Factory“ ir kitose paslaugose, sujungimas į vieną platformą. Šiame straipsnyje išsamiai ir detaliai apžvelgsime naujausias „Fabric“ funkcijas, veiksmų planą ir praktinį pritaikymą analizei, valdymui, dirbtiniam intelektui ir realaus laiko skaičiavimams.

Idėja ta, kad baigę skaityti, aiškiai suprasite Ką „Microsoft Fabric“ siūlo šiandien, kur ji juda ir kaip ji veikia duomenų architektūrą? jūsų organizacijos: valdymo galimybės su „Purview“, automatizavimas su API ir „Git“, naujos dirbtinio intelekto funkcijos, realaus laiko analizė, saugumas „OneLake“, perkėlimai, našumas ir daug daugiau.

„Microsoft Fabric“ ir debesijos diegimo sistema: valdymas, išlaidos ir automatizavimas

Pagal debesijos diegimo sistemą (CAF) „Microsoft“ paskelbė keletą vadovų, skirtų suderinti „Microsoft Fabric“ dizainas su nusileidimo zonų dizaino principaisPaskutinėje šios serijos dalyje aptariamos trys pagrindinės sritys: valdymas, pajėgumų optimizavimas ir automatizavimas / „DevOps“.

Valdymo skyriuje Tinklo pajėgumų sąnaudos atskleidžiamos naudojant „Azure Cost Management“Tai leidžia jums integruoti F pajėgumų (ir kitų SKU) naudojimo duomenis į „Azure“ sąnaudų ataskaitų suvestines, įspėjimus ir išlaidų analizę. Svarbu ne tik matyti sąskaitą: galite susieti šią informaciją su žymėmis, prenumeratomis ar išteklių grupėmis, kad suprastumėte, kas ką ir kodėl išleidžia.

„Fabric“ techninė architektūra ir verslo modelis suteikia klientams galimybę tiksliai kontroliuokite pajėgumų suvartojimą, kad optimizuotumėte eksploatavimo išlaidasPraktiškai tai reiškia keletą svertų:

- Pajėgumų mastelio keitimas F: padidinkite arba sumažinkite pajėgumus pagal nuspėjamus pikus, pvz., pardavimo kampanijas, apskaitos terminus arba didelius duomenų kiekius.

- Pristabdymo ir tęsimo galimybėsTinklo administratoriai gali pristabdyti F pajėgumus, kai jų nereikia (pavyzdžiui, naktį arba savaitgaliais nekritinėse aplinkose), kad sumažintų skaičiavimo išlaidas.

- Apsauga nuo viršįtampiųDu pajėgumo lygio parametrai kontroliuoja, kaip tvarkomos foninės užduotys, kad jos neapkrautų aplinkos: fono atmetimo slenkstis ir fono atkūrimo slenkstis.

- Pajėgumų rezervavimasGalima rezervuoti pajėgumus nustatytiems laikotarpiams, kad būtų galima gauti nuolaidas, jei numatomas suvartojimas yra kruopščiai planuojamas.

Duomenų valdymo srityje „Fabric“ remiasi „Microsoft Purview“ kaip pagrindinis katalogavimo, kilmės nustatymo ir klasifikavimo komponentasIš „Purview“ galima taikyti jautrumo žymas, matyti ryšį tarp kilmės, transformacijų ir vartojimo, sertifikuoti duomenų išteklius arba pagerinti duomenų kokybės kampanijas, tuo pačiu integruojant „Fabric“ elementus („Lakehouse“, „Warehouse“, „KQL“, „Power BI“ ir kt.).

Skyrius „Platformos automatizavimas ir DevOps“ daugiausia sudarytas iš Integracija su „Git“, diegimo srautais ir REST API„Fabric“ darbo sritis galima susieti su „Git“ saugyklomis, kad keli kūrėjai galėtų bendradarbiauti tame pačiame duomenų inžinerijos, duomenų mokslo ar realaus laiko analizės projekte be persidengiančio darbo.

„Git“ ir diegimo kanalai leidžia kontroliuojamu būdu organizuoti kūrimo, testavimo ir gamybos gyvavimo ciklusTurinio reklama, pakeitimų stebėjimas, artefaktų sinchronizavimas ir versijų valdymas. Nuo 2025 m. kovo mėn. šie srautai palaiko (bendrąja arba peržiūros būsena) platų elementų tipų spektrą, pvz., paleidiklius, ataskaitų sritis, duomenų srautus, duomenų srautus, duomenų saugyklas, ežerų pastatus, sandėlius, KQL, užrašines, puslapiuotas ataskaitas, organizacines programas ir kt.

Tuo tarpu „Fabric“ atskleidžia labai platus REST API rinkinys su kuria galima automatizuoti beveik bet kokią administravimo ar diegimo užduotį: darbo sričių ir aplankų kūrimą, masinį elementų perkėlimą, ryšių ir šliuzų valdymą, apibrėžimų išgavimą, kanalų ar užrašinių aktyvinimą ir kt.

Svarbiausi „Microsoft Fabric“ analizės, dirbtinio intelekto ir valdymo atnaujinimai

„Fabric“ evoliuciją žymi daugybė peržiūros funkcijų ir naujų galimybių, kurios Jie paliečia praktiškai visas platformos sritisTada jie sugrupuojami ir aptariami struktūrizuotai, kad būtų galima matyti visą apimtį.

DI funkcijos duomenų saugykloje ir multimodalinės funkcijos

Reliacinių duomenų srityje „Fabric Data Warehouse“ apima Dirbtinis intelektas veikia tiesiogiai T-SQL (peržiūra). Tai leidžia:

- Klasifikuoti arba suskirstyti tekstą į kategorijas.

- Išanalizuokite nuotaiką.

- Iš laisvos formos teksto išgauti struktūrizuotą informaciją.

- Versti tekstą tarp kalbų.

- Taisyklinga gramatika.

Tikslas yra tas Nereikia palikti SQL konteksto, kad duomenis būtų galima praturtinti dirbtiniu intelektuŠios funkcijos derinamos su bendresniu multimodaliniu palaikymu „Fabric“ dirbtinio intelekto funkcijose, kurios dabar gali apdoroti vaizdus (JPG/JPEG, PNG, GIF, WebP), PDF ir įprastus teksto formatus, taip pat įvestis failų kelių formatu.

Komunalinės paslaugos, tokios kaip aifunc.load aplankų įtraukimui į lenteles Naudodama raginimų ir schemų parinktis, „aifunc.list_file_paths“ leidžia iteruoti failų kelius, o „ai.infer_schema“ – schemas, suderinamas su „ai.extract“. Visa tai leidžia transformuoti ir praturtinti duomenis nekuriant sudėtingų duomenų srautų nuo nulio.

„OneLake“, „Delta“, „Apache Iceberg“ ir prieiga prie kelių platformų

Saugojimo sluoksnyje „OneLake“ išlieka vieningu ežeru, kuriame yra visas „Fabric“. Vienas iš pagrindinių patobulinimų yra galimybė Delta Lake lentelių atskleidimas kaip Apache Iceberg lentelių neperkeliant ir nedubliuojant duomenų, kad su „Iceberg“ suderinami varikliai galėtų tiesiogiai nuskaityti „OneLake“ duomenis.

Be to, „OneLake“ dabar palaiko „Apache Iceberg“ duomenys, parašyti tiesiogiai „Snowflake“, panaudoti „Fabric“ sistemoje be kopijavimo prieigosŠi strategija sustiprina sąveikumą: „Fabric“ nenori būti atskira saugykla, o duomenų „centru“, kurį kiti varikliai gali išnaudoti nedubliuodami saugyklos.

Panašiai pripažįsta ir „OneLake“. spartieji klavišai į „Azure Blob Storage“„OneDrive“ ir „SharePoint“, ir išplečia saugumą prieigos vaidmenimis, aplankų, eilučių ir stulpelių lygio saugumu bei saugos modeliu, kurio trečiosios šalys gali laikytis dėl įgaliotojo modulio modelio išplėtimo.

Ypač svarbus aspektas yra „OneLake“ katalogo federacija „Azure Databricks“ sistemoje, kuri leidžia Nulinės kopijavimo prieiga iš Unity katalogo į OneLake lentelesTokiu būdu „OneLake“ išlieka tiesos šaltiniu, tačiau „Databricks“ gali tiesiogiai pateikti užklausas duomenims, sinchronizuodami tik metaduomenis.

SQL duomenų bazė „Fabric“ tinkle: našumas, saugumas ir virtualizacija

„Fabric“ SQL duomenų bazė įgyja savo galimybes: KEISTI DUOMENŲ BAZĖS NUSTATYMO parinktisPalaikymas rikiavimui ir viso teksto indeksavimui peržiūros versijoje. Šiuo lygiu duomenų bazės našumas Kalbant apie kainą, yra keletas patobulinimų:

- Automatinis indekso glaudinimas sumažinti saugyklos, įvesties/išvesties apimtį ir pagerinti užklausų laiką neplanuojant priežiūros darbų.

- Maksimalus virtualiųjų branduolių limitas valdyti skaičiavimo išteklių (4 arba 32 vCore) naudojimą, siekiant užkirsti kelią per dideliam bendrinamų pajėgumų kiekiui darbo krūvyje.

- Pasirinktiniai SQL telkiniai kurios suteikia darbo srities administratoriams išsamią išteklių paskirstymo ir užklausų nukreipimo kontrolę pagal programos pavadinimą.

Taip pat įjungta Duomenų virtualizavimas SQL duomenų bazėje, kuri leidžia atlikti užklausas apie išorinius duomenis, saugomus „OneLake“ sistemoje naudojant T-SQL, sujungti įprastų formatų failus su vietinėmis reliacinėmis lentelėmis naudojant sujungimus, fiziškai neimportuojant duomenų.

Kalbant apie saugumą, SQL duomenų bazė palaiko Privatus susiejimas nuomininko lygmeniu (peržiūra)Tai leidžia lengviau nukreipti duomenų srautą privačiu ir kontroliuojamu būdu, integruojant jį su bendra saugia „Fabric“ tinklo konfigūracija.

Realaus laiko žvalgyba, „Eventhouse“, „Eventstream“ ir „Activator“

Realaus laiko intelekto (RTI) modulis tapo vienu iš pagrindinių „Fabric“ skiriamųjų bruožų. „Eventhouse“ ir „Eventstream“ susijungia, kad... priimti, apdoroti ir suaktyvinti realaus laiko įvykius iš visų šaltinių, o „Activator“ koordinuoja veiksmus, kurie suaktyvinami tam tikromis sąlygomis.

Tarp galingiausių naujų funkcijų yra šios:

- Anomalijų aptikimas be kodo su automatiniu modelio pasirinkimu, paprasta sąsaja ir lanksčiais įspėjimais.

- Verslo renginiai, kurie fiksuoja pagrindinius verslo momentus, sugeneruotus iš vartotojo duomenų funkcijų ir užrašų knygų, ir leidžia aktyvuoti įspėjimus, pasirinktinę logiką, srautus, dirbtinio intelekto modelius arba „Spark“ užduotis.

- Aktyvatoriaus ir vartotojo duomenų funkcijų integracijakad „Fabric“ sukurtos funkcijos galėtų apdoroti įvykius iš bet kurio šaltinio, įskaitant vidinius įvykius iš pačios platformos ir iš „OneLake“.

- Galimybė apdoroti įvykius naudojant SQL (SQL operatorius „Eventstream“), leidžiantis transformuoti realaus laiko srautus su žinoma SQL sintaksė.

Pridedamos atitinkamos jungtys, pvz. Cribl (žurnalų ir telemetrijos įkėlimui iš kelių šaltinių), jungtis su „Solace PubSub+“ ir srautinio perdavimo palaikymas privačiuose tinkluose per „Azure Virtual Network“, VPN, „ExpressRoute“ arba privačius galinius taškus.

Duomenų schemoms ir sutartims „Eventstream“ pristato Schemos registras kuri apibrėžia ir patvirtina įvykių schemas patikimesniems srautams ir palaiko „Confluent Schema Registry“, kad jis galėtų prisijungti prie „Kafka“ „Confluent Cloud“ sistemoje, laikantis galiojančių sutarčių.

„Copilot“ ir dirbtinio intelekto galimybės visoje platformoje

„Copilot in Fabric“ dabar galima įsigyti visame pasaulyje, o platforma veikia šiose srityse: „Power BI“, duomenų gamykla, duomenų mokslas ir duomenų inžinerija bei KQL užklausų rašymasBe to, buvo įdiegtos konkrečios funkcijos:

- „Copilot“ duomenų srautui „Gen2“ (modernus duomenų gavimas), kuris padeda apdoroti ir transformuoti duomenis naudojant instrukcijas natūralia kalba.

- Duomenų saugyklos „Copilot“ (pokalbis), pasiekiama per mygtuką juostelėje, kad būtų galima paspartinti sandėliavimo užduotis dialogo lange.

- „Copilot“ SQL analizės galiniam punktui, kuri generuoja ir optimizuoja SQL užklausas iš verslo aprašymų.

- Kopiavimas nešiojamuosiuose kompiuteriuose išmanantis darbo srities kontekstą, „Lakehouse“, užrašų knygelės struktūrą ir vykdymo aplinką, gebantis generuoti daugiapakopį kodą, pertvarkyti, apibendrinti sudėtingas užrašų knygeles ir diagnozuoti klaidas naudojant parinktį „Taisyti naudojant „Copilot“.

- Įterptinis automatinis užbaigimas (įterptinio kodo užbaigimas) ir „Notebook Copilot“ įterptinis kodo užbaigimas (peržiūra), kad Python būtų galima rašyti greičiau ir su mažiau klaidų.

Be to, plečiama dirbtinio intelekto technologijų bazė iš anksto pagaminti liejyklų įrankiai integruoti („Azure OpenAI“, „Azure Language“, „Azure Translator“), „OpenAI“ papildiniai, skirti „Eventhouse“ („ai_embed_text“ ir „ai_chat_completion“) ir agentų bei duomenų agentų serija, leidžianti kitoms programoms, įskaitant „Copilot Studio“, dirbti su „Fabric“ duomenimis orkestruotu būdu.

„Fabric“ duomenų agentai, MCP ir kūrėjo įrankiai

Audinys pristatomas duomenų agentai, galintys organizuoti prieigą prie duomenų ir įrankių Dirbtinio intelekto agentams, naudojant „Python SDK“ ir tiesioginę integraciją su „Microsoft Copilot Studio“. Tai leidžia lengvai kurti pokalbių asistentus, kurie veiktų su įmonės duomenimis, valdomais „Fabric“.

Lygiagrečiai, Modelio konteksto protokolas (MCP) Tai tampa pagrindiniu dirbtinio intelekto agentų ir „Fabric“ paslaugų integracijos komponentu. Yra skirti MCP serveriai, skirti „Activator“ ir „Eventhouse“, ir į kūrimą orientuotas „Fabric“ MCP, kuris:

- Tai leidžia dirbtinio intelekto asistentams generuoti kodą ir turinį „Fabric“ elementams.

- Jis integruojamas su kūrimo įrankiais, tokiais kaip „VS Code“ ir „GitHub Codespaces“.

- Jame pateikiami įrankiai, skirti konsultuotis ir reaguoti į realaus laiko duomenis „Eventhouse“ platformoje.

Kalbant apie kasdienį kūrėjo darbą, reikia pabrėžti kelis svarbius dalykus, įskaitant plėtros aplinka: MSSQL plėtinys, skirtas VS Code, su palaikymu „Fabric SQL“ duomenų bazei, „Microsoft ADO.NET“ tvarkyklę ir ODBC tvarkyklę, skirtą „Fabric“ duomenų inžinerijai (ryšys su „Spark SQL“ per „Livy“), ir „Spark“ jungtį, skirtą SQL duomenų bazėms, kuri supaprastina autentifikuotą prieigą iš „Spark“ prie SQL duomenų bazių „Azure“ ir „Fabric“.

Taip pat pasirodo, Audinio CLI, pasiekiama kaip integruota užduotis „Azure DevOps“, kuri leidžia automatizuoti darbo sričių, elementų ir diegimų valdymą rankiniu būdu neįdiegiant išorinių įrankių.

Duomenų fabrikas, duomenų perkėlimas ir orkestravimas „Fabric“ aplinkoje

„Fabric“ duomenų integravimo sluoksnis remiasi „Data Factory“ ir „Dataflow Gen2“, kurios gauna funkcijas, skirtas... Orkestravimas bus išmanesnis, labiau automatizuojamas ir su paprastesnėmis migracijomis. iš esamų platformų.

„Dataflow Gen2“: našumas, viešosios API ir diagnostika

„Dataflow Gen2“ peržiūros versijoje randame keletą funkcijų:

- Išplėstinis tikslinių užklausų redagavimas , kad būtų galima koreguoti logiką paskirties vietoje tiesiai iš pačios kūrimo aplinkos.

- Padalintas skaičiavimaso tai leidžia duomenų srauto dalims veikti lygiagrečiai, taip sutrumpinant bendrą vertinimo laiką.

- Atsisiųsti diagnostiką vykdymo lygmeniu, naudojant struktūrizuotus žurnalų paketus našumo analizei ir incidentų sprendimui.

- Viešosios API programiniam duomenų srautų kūrimui, atnaujinimui, naikinimui, planavimui ir stebėjimui.

- Viešieji parametrai su CI/CD palaikymukurie leidžia atnaujinti duomenų srautus perduodant reikšmes iš vamzdynų ar kitų šaltinių.

- Naujausi duomenys kad būtų galima greitai pasiekti neseniai naudotus elementus „Power Query“ juostelėje ir moderniame duomenų gavimo įrankyje.

Visa tai papildo galimybės, Programiškai įvertinkite „Power Query“ naudodami RESTTai atveria duris M scenarijų vykdymui kaip automatizuotų procesų daliai, integruojant juos su „Spark“, srautais ar išoriniais įrankiais, pasinaudojant „Power Query“ jungtimis.

Duomenų fabrikas: adaptyvus našumas, ryšys ir duomenų fabrikas (dbt)

Klasikinėje integracijos dalyje „Data Factory within Fabric“ pristato:

- Adaptyvus našumo derinimas kopijavimo veiklai, kuri išmaniai koreguoja našumo parametrus pagal konfigūraciją ir vykdymo kontekstą.

- Duomenų fiksavimo (CDC) palaikymas kopijavimo užduotyje, kad būtų nuolat atkartoti tik pakeitimai (įterpimai, atnaujinimai, ištrynimai).

- Vietiniai šliuzai su rankinio atnaujinimo galimybe valdoma iš „Fabric“ portalo, API arba scenarijų.

- neseniai prisijungęs, kuris prie ryšių prideda paskutinio naudojimo ypatybes, kad būtų lengviau audituoti ir valdyti gyvavimo ciklą.

- gimtoji DBT Darbas, kuri leidžia vykdyti DBT projektus „Fabric“ aplinkoje su integruotu orkestravimu, testavimu, dokumentavimu ir valdymu.

- SSIS paketo iškvietimo veikla vamzdynuose, kad būtų galima paleisti SSIS paketus iš pačios orkestravimo sistemos „Fabric“.

Vartotojo patirtis taip pat pagerinama naudojant „SharePoint“ svetainės parinkiklis („SharePoint Site Picker“), kuri leidžia išvengti URL adresų įvedimo ranka ir su MCP palaikymu „Data Factory“, kad dirbtinio intelekto asistentai galėtų kurti ir diegti „Dataflow Gen2“ tiesiog pagal natūralios kalbos instrukcijas.

Duomenų perkėlimo ir replikavimo įrankiai

„Microsoft“ aktyviai skatina migraciją į „Fabric“ naudodama kelias konkrečias priemones:

- Duomenų gamyklos audinio migracijos vertinimas, kuris analizuoja ADF kanalų paruošimą ir palaikomus perkelia į „Fabric“ darbo sritį su ryšio susiejimu.

- Duomenų saugyklos perkėlimo asistentaskuris dabar gali tiesiogiai prisijungti prie šaltinio saugyklos, kad perkeltų jį į „Fabric“ duomenų saugyklą.

- SQL duomenų bazės migracijos asistentas, skirtas vietinių SQL serverio darbo krūvių perkėlimui, importuojant schemas per DACPAC, aptinkant nesuderinamumus ir teikiant rekomendacijas.

Kalbant apie replikaciją, parama teikiama kelių operacinių šaltinių atspindėjimas („Azure“ duomenų bazė, skirta „MySQL“, „Google BigQuery“, „SQL Server“ ir kt.) į „Fabric“, su galimybe valdyti, kurios lentelės replikuojamos, iš naujo paleisti veidrodinio atspindėjimo procesus naudojant REST ir, „Databricks“ atveju, susieti „Unity Catalog“ strategijas su „OneLake“ saugumu.

Taip pat pridedama „Lakehouse“ replikacijos jungtis, naudojanti Deltos pakeitimų duomenų srautas, kuri leidžia pakeisti „Lakehouse Delta“ lentas suderinamoms paskirties vietoms, nereikalaujant išradinėti dviračio naudojant CDC sukurtus sprendimus.

Saugumas, išplėstinis valdymas ir stebėjimas „Fabric“ sistemoje

Vienas didžiausių rūpesčių bet kurioje analizės platformoje yra tai, kaip apsaugoti duomenis, valdyti naudojimą ir stebėti išteklių suvartojimąŠiuose frontuose audiniai greitai bręsta.

Saugumas ir duomenų apsauga „OneLake“

„OneLake“ prideda pilną modelį duomenų prieigos saugumas su:

- Duomenų prieigos vaidmenys „Lakehouse“ sistemoje su konfigūruojamomis teisėmis iš aplankais pagrįstos saugos sąsajos.

- Saugumo palaikymas spartiesiems klavišams, kad trečiosios šalys galėtų laikytis apibrėžtų politikų.

- „OneLake“ duomenų prieigos saugumo API, leidžianti automatiškai valdyti leidimus.

- Modelio išplėtimas į išorinius variklius („OneLake“ saugumo autorizacija trečiosioms šalims).

Tuo pačiu metu apsauga plečiama, DLP riboja prieigą visiems struktūrizuotiems duomenims „OneLake“ sistemoje (SQL, KQL, sandėliuose) ir yra įvesta DSPM, skirtas dirbtiniam intelektui, skirtam „Fabric Copilots“ ir duomenų agentams, kuri stebi dirbtinio intelekto sąveikas, ieškodama neskelbtinos informacijos ir rizikingo elgesio, integruodama ją su „Purview Audit“ ir „eDiscovery“.

Kalbant apie tapatybę, išryškėja tokios savybės kaip: su elementais susijusios tapatybės (pavyzdžiui, „Lakehouse“ ir „Eventstream“) per REST API, kurios pašalina savininko priklausomybę atliekant tam tikras operacijas, ir „OneDrive“ bei „SharePoint“ nuorodų autentifikavimą naudojant darbo srities tapatybes arba paslaugų principus.

Centralizuotas valdymas ir „OneLake“ katalogas

Duomenų valdymo patirtį sustiprina naujas centralizuotas skydelis „OneLake“ katalogekur duomenų savininkai gali matyti apibendrintą savo sukurtų elementų vaizdą, gauti valdymo veiksmų rekomendacijas ir pasiekti visus galimus įrankius, skirtus saugumui ir atitikčiai pagerinti.

Be to, a „OneLake“ katalogo paieškos API kartu su MCP įrankiu, kuris leidžia vienu iškvietimu atrasti elementus visoje „Fabric“ aplinkoje naudojant kodą arba dirbtinio intelekto agentus, atsižvelgiant į katalogo teises ir metaduomenis.

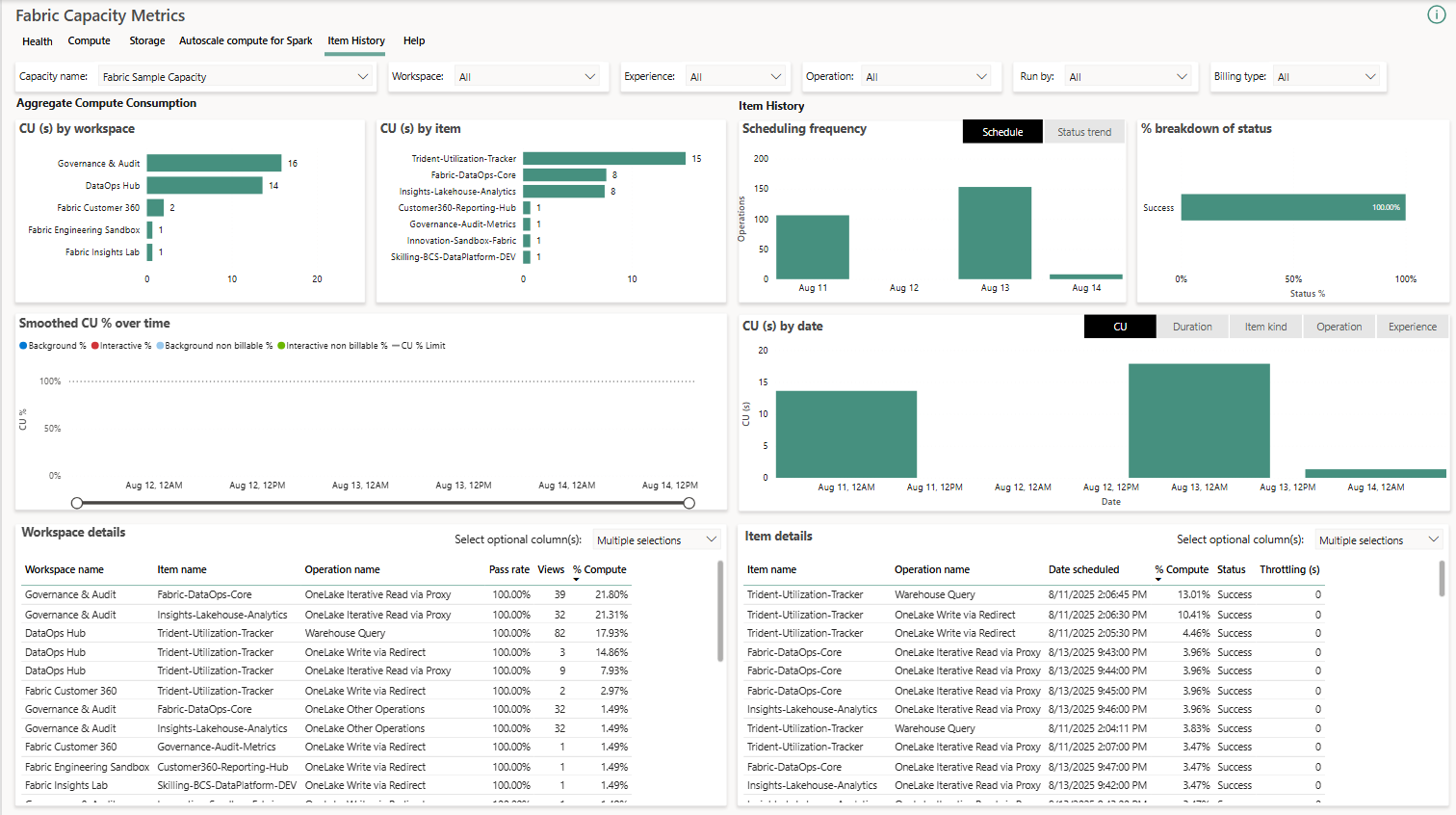

Pajėgumų, suvartojimo ir darbo stebėjimas

Audinys suteikia kelis stebimumo lygius:

- Darbo vietos stebėjimas, kuri sukuria „Fabric“ duomenų bazę, kurioje konsoliduojami kelių elementų žurnalai ir metrika (įskaitant kopijavimo užduotis su išsamiu stebėjimu).

- Darbo srities stebėjimas kopijavimo užduočiaisu tokiais rodikliais kaip pralaidumas, duomenų kiekis, klaidų kodai ir laikas, visi skirti centralizuotai analizei.

- Elementų istorija taikant pajėgumų metriką, su 30 dienų CU suvartojimo kiekvieno elemento rodiniais, filtruojamais pagal darbo sritį ir tipą.

- Darbo vietos lygio apsauga nuo viršįtampiųkuri leidžia nustatyti suvartojimo ribas kiekvienai darbo sričiai 24 valandų slenkančiame lange, automatiškai blokuoti tas, kurios jas viršija, ir pažymėti darbo sritis kaip „kritines“, kad joms nebūtų taikomi apribojimai.

Papildant tai, pradinis rinkinys „Fabric Admin“ API daugiausia dėmesio skirta darbo sričių, elementų ir vartotojų prieigos duomenų paieškai, dinaminių inventorizacijų ir periodinės prieigos kontrolės palengvinimui.

Verslo modeliavimas, planavimas ir nauji darbo krūviai

Be techninio lygio, „Microsoft“ pristato nauji, į verslą orientuoti darbo krūviai apie „Fabric“. Vienas žymiausių yra „Fabric IQ“, kuriuo siekiama suvienodinti verslo semantiką, duomenis ir modelius, skirtus intelektualiems agentams, priimantiems sprendimus, pagrįstus holistiniu organizacijos požiūriu.

„Fabric IQ“ rodoma:

- Ontologija (peržiūra), elemento tipas, kuriame subjektai, ryšiai, savybės ir apribojimai apibrėžiami pagal įmonės verslo kalbą.

- Planas (peržiūra), be kodo veikianti platforma planavimui, ataskaitų teikimui, analizei, integracijai ir bendradarbiavimui valdyti.

Taip pat atsiranda realaus laiko intelektas skaitmeninių dvynių kūrėjas, gaminys, specializuojantis skaitmeninių dvynių modeliavime remiantis realaus laiko duomenimis, siekiant optimizuoti fizines operacijas, stebėti būsenas ir imituoti scenarijus.

Kita vertus, jis pristatomas Fabric IQ darbo krūvis kaip atskiras darbo krūvis, o valdymo ir semantinio suderinimo palaikymo įrankiai toliau plečiasi, uždarydami ratą tarp duomenų modelių, verslo logikos ir dirbtinio intelekto / analizės programų.

Našumo, naudotojo patirties ir produktyvumo patobulinimai

Baigiant šią apžvalgą, verta atkreipti dėmesį į keletą horizontalių patobulinimų, kurie Jie ne visada patenka į antraštes, bet daro didelę įtaką kasdieniam gyvenimui. komandų.

Skyriuje „Spark“ ir paskirstytieji skaičiavimai „Fabric“ pristato:

- „Fabric Runtime 2.0“ (peržiūra) su „Apache Spark 4.0“, „Delta Lake 4.0“, „Java 21“, „Scala 2.13“ ir „Python 3.12“ „Azure Linux 3.0“ aplinkoje.

- „Spark“ programų palyginimo įrankiskuri leidžia jums pasirinkti ir palyginti iki keturių „Spark“ vykdymų lygiagrečiai.

- Kibirkščių diagnostikos skleidėjas, kuri renka žurnalus, metriką ir įvykius iš „Spark“ programų ir siunčia juos į tokias paskirties vietas kaip įvykių centrai, saugykla arba „Log Analytics“.

- „JobInsight“ diagnostikos biblioteka, biblioteka, skirta užbaigtų „Spark“ vykdymų analizei naudojant API (užklausas, užduotis, etapus, užduotis, vykdytojus, įvykių žurnalus).

Sandėlio sluoksnyje pridedama: duomenų klasterizavimas Siekiant pagerinti našumą ir sumažinti prieigos išlaidas, naudojami IDENTITY stulpeliai pakaitiniams raktams, versijų kontrolė ir CI/CD palaikymas per SQL duomenų bazių projektus VS Code (sandėlio šaltinio kontrolė).

„Fabric“ portalo naudotojo patirtis taip pat kinta kartu su Naršymas skirtukais ir objektų naršyklėTai leidžia atidaryti kelis elementus vienu metu ir greitai tarp jų perjungti. Kartu su tokiais patobulinimais kaip automatinis „Lakehouse“ susiejimas „Git“ ir „Lakehouse“ priežiūros priemonių rinkinys (priežiūros veikla ir SQL galinių taškų atnaujinimas), tai prisideda prie patogesnės ir lankstesnės platformos.

Galiausiai, tokios funkcijos kaip Masinis elementų apibrėžimų importavimas / eksportavimas (migracijai, šablonams ir metaduomenų atsarginėms kopijoms), REST aplankams, parametrų palaikymas aktyvinant elementus iš „Activator“ ir „OneLake“ duomenų įkėlimas į „Excel“ su integruotu katalogu – visa tai užbaigia ekosistemą, kuri pradeda tenkinti praktiškai visus įprastus šiuolaikinės duomenų komandos poreikius.

Turėdama visą šį galimybių rinkinį – nuo centralizuoto valdymo, detalaus saugumo ir intelektualaus orkestravimo iki dirbtinio intelekto, integruoto į SQL, realaus laiko analizės, skaitmeninių dvynių ir MCP agentų – „Microsoft Fabric“ įtvirtina savo, kaip visavertės duomenų platformos, poziciją. Svarbiausia ne tik saugoti ir vizualizuoti duomenis, bet ir valdyti, automatizuoti bei panaudoti dirbtinį intelektą, siekiant kontroliuoti kiekvieną duomenų gyvavimo ciklo dalį.leidžia organizacijoms palaipsniui tobulinti savo architektūras, perkelti tai, kas jau yra, ir daug greičiau nei taikant tradicinius metodus diegti naujus sprendimus.

Turinys

- „Microsoft Fabric“ ir debesijos diegimo sistema: valdymas, išlaidos ir automatizavimas

- Svarbiausi „Microsoft Fabric“ analizės, dirbtinio intelekto ir valdymo atnaujinimai

- DI funkcijos duomenų saugykloje ir multimodalinės funkcijos

- „OneLake“, „Delta“, „Apache Iceberg“ ir prieiga prie kelių platformų

- SQL duomenų bazė „Fabric“ tinkle: našumas, saugumas ir virtualizacija

- Realaus laiko žvalgyba, „Eventhouse“, „Eventstream“ ir „Activator“

- „Copilot“ ir dirbtinio intelekto galimybės visoje platformoje

- „Fabric“ duomenų agentai, MCP ir kūrėjo įrankiai

- Duomenų fabrikas, duomenų perkėlimas ir orkestravimas „Fabric“ aplinkoje

- Saugumas, išplėstinis valdymas ir stebėjimas „Fabric“ sistemoje

- Verslo modeliavimas, planavimas ir nauji darbo krūviai

- Našumo, naudotojo patirties ir produktyvumo patobulinimai