- Microsoft Fabric memusatkan data, tadbir urus, AI dan analitik masa nyata pada OneLake dan keupayaan bersepadu.

- Platform ini memperkukuh tadbir urus, keselamatan dan kos melalui Purview, keselamatan OneLake, DLP, DSPM dan penyepaduan dengan Azure Cost Management.

- Data Factory, Dataflow Gen2 dan alatan migrasi memudahkan pemindahan beban kerja sedia ada dan mengatur saluran paip yang kompleks.

- Kopilot, ejen data, MCP dan beban kerja baharu seperti Fabric IQ dan Real-Time Intelligence memacu senario AI dan automasi termaju.

Jika anda telah lama bekerja dengan data dalam ekosistem Microsoft, anda pasti perasan bahawa Microsoft Fabric telah menjadi hab utama analitik modenMenyatukan semua yang sebelum ini tersebar merentasi Power BI, Azure Synapse, Data Factory dan perkhidmatan lain ke dalam satu platform. Dalam artikel ini, kami akan melihat secara menyeluruh dan terperinci tentang ciri-ciri terkini, pelan tindakan dan implikasi praktikal Fabric untuk analitik, tadbir urus, AI dan pengkomputeran masa nyata.

Ideanya ialah, apabila anda selesai membaca, anda akan mempunyai pemahaman yang jelas tentang Apakah yang ditawarkan oleh Microsoft Fabric hari ini, ke mana hala tujunya dan bagaimanakah ia mempengaruhi seni bina data? organisasi anda: keupayaan tadbir urus dengan Purview, automasi dengan API dan Git, ciri AI baharu, kecerdasan masa nyata, keselamatan dalam OneLake, migrasi, prestasi dan banyak lagi.

Microsoft Fabric dan Rangka Kerja Penerimaan Awan: tadbir urus, kos dan automasi

Dalam Rangka Kerja Penerimaan Awan (CAF), Microsoft telah menerbitkan satu siri panduan untuk menyelaraskan Reka bentuk Microsoft Fabric dengan tiang reka bentuk zon pendaratanBahagian terakhir siri ini membincangkan tiga bidang utama: tadbir urus, pengoptimuman kapasiti dan automasi/DevOps.

Dalam bahagian tadbir urus, Kos kapasiti fabrik didedahkan melalui Azure Cost ManagementIni membolehkan anda mengintegrasikan data penggunaan kapasiti F (dan SKU lain) secara asli ke dalam papan pemuka kos, amaran dan analitik perbelanjaan Azure. Ia bukan sekadar melihat bil: anda boleh merujuk silang maklumat ini dengan tag, langganan atau kumpulan sumber untuk memahami siapa yang membelanjakan apa dan mengapa.

Seni bina teknikal dan model perniagaan Fabric membolehkan pelanggan mengawal penggunaan kapasiti dengan teliti untuk mengoptimumkan kos operasiDalam praktiknya, ini diterjemahkan kepada beberapa tuas:

- Penskalaan keupayaan F: meningkatkan atau mengurangkan kapasiti berdasarkan puncak yang boleh diramal, seperti kempen jualan, tarikh akhir perakaunan atau beban data yang besar.

- Keupayaan jeda dan sambung semulaPentadbir fabrik boleh menjeda kapasiti F apabila ia tidak diperlukan (contohnya, bermalam atau pada hujung minggu dalam persekitaran yang tidak kritikal) untuk mengurangkan kos pengiraan.

- Perlindungan lonjakanDua parameter peringkat kapasiti mengawal cara kerja latar belakang diuruskan untuk mengelakkannya daripada menepu persekitaran: Ambang Penolakan Latar Belakang dan Ambang Pemulihan Latar Belakang.

- Tempahan kapasitiAnda boleh menempah kapasiti untuk tempoh yang ditetapkan bagi mendapatkan diskaun, dengan syarat penggunaan yang dijangkakan dirancang dengan teliti.

Dalam bidang tadbir urus data, Fabric bergantung pada Microsoft Purview sebagai komponen utama untuk pengkatalogan, salasilah dan pengelasanDari Purview, adalah mungkin untuk menggunakan label sensitiviti, melihat keturunan antara asal usul, transformasi dan penggunaan, mengesahkan aset data atau meningkatkan kempen kualiti data, semuanya sambil mengintegrasikan elemen Fabric (Lakehouse, Warehouse, KQL, Power BI, dll.).

Bahagian "Automasi Platform dan DevOps" terutamanya distrukturkan sekitar Integrasi dengan Git, saluran penggunaan dan API RESTRuang kerja fabrik boleh dipautkan ke repositori Git supaya berbilang pembangun boleh bekerjasama dalam projek kejuruteraan data, sains data atau analitik masa nyata yang sama tanpa kerja bertindih.

Saluran Paip Git dan Pelaksanaan membenarkan mengatur pembangunan, pengujian dan kitaran hayat pengeluaran secara terkawalPromosi kandungan, penjejakan perubahan, penyegerakan artifak dan pengurusan versi. Sejak Mac 2025, saluran paip ini telah menyokong (secara umum atau keadaan pratonton) pelbagai jenis elemen seperti pencetus, papan pemuka, aliran data, saluran paip data, datamart, lakehouse, gudang, KQL, buku nota, laporan berhalaman, aplikasi organisasi dan sebagainya.

Sementara itu, Fabric mendedahkan satu set API REST yang sangat luas yang boleh digunakan untuk mengautomasikan hampir semua tugas pentadbiran atau penggunaan: penciptaan ruang kerja dan folder, penghijrahan pukal item, pengurusan sambungan dan gerbang, pengekstrakan definisi, pengaktifan saluran paip atau buku nota, antara lain.

Kemas kini penting dalam analitik, AI dan tadbir urus untuk Microsoft Fabric

Evolusi Fabric ditandai dengan sejumlah besar ciri pratonton dan keupayaan baharu yang Mereka menyentuh hampir semua bahagian platformKemudian, ia dikumpulkan dan dibincangkan secara berstruktur supaya skop penuh dapat dilihat.

Fungsi AI dalam Gudang Data dan fungsi multimodal

Dalam bidang data hubungan, Fabric Data Warehouse menggabungkan AI berfungsi secara langsung dalam T-SQL (pratonton). Ini membolehkan:

- Kelaskan atau kategorikan teks.

- Analisis sentimen.

- Mengekstrak maklumat berstruktur daripada teks bebas.

- Terjemahkan teks antara bahasa.

- Tatabahasa yang betul.

Objektifnya ialah Tidak perlu meninggalkan konteks SQL untuk memperkayakan data dengan AIFungsi-fungsi ini digabungkan dengan sokongan multimodal yang lebih umum dalam fungsi AI Fabric, yang kini boleh memproses imej (JPG/JPEG, PNG, GIF, WebP), PDF dan format teks biasa, serta input dalam bentuk laluan fail.

Utiliti seperti aifunc.load untuk memasukkan folder ke dalam jadual Dengan pilihan gesaan dan skema, `aifunc.list_file_paths` membolehkan anda membuat iterasi melalui laluan fail dan `ai.infer_schema` menyimpulkan skema yang serasi dengan `ai.extract`. Semua ini membolehkan anda mengubah dan memperkayakan data tanpa membina saluran paip yang kompleks dari awal.

OneLake, Delta, Apache Iceberg dan akses berbilang platform

Di lapisan storan, OneLake kekal sebagai tasik bersatu tempat semua Fabric berada. Salah satu penambahbaikan utama ialah keupayaan untuk Mendedahkan jadual Delta Lake sebagai jadual Apache Iceberg tanpa memindahkan atau menduplikasi data, supaya enjin yang serasi dengan Iceberg boleh membaca terus apa yang ada di OneLake.

Di samping itu, OneLake kini menyokong Data Apache Iceberg yang ditulis terus oleh Snowflake, digunakan dalam Fabric melalui akses bebas salinanStrategi ini memperkukuh kebolehkendalian: Fabric tidak mahu menjadi silo, tetapi "hab" data yang boleh dieksploitasi oleh enjin lain tanpa menduplikasi storan.

Begitu juga, OneLake mengakui pintasan ke Azure Blob StorageOneDrive dan SharePoint, dan melanjutkan keselamatan dengan peranan akses, keselamatan folder, peringkat baris dan lajur, serta model keselamatan yang boleh dihormati oleh pihak ketiga hasil daripada peluasan model enjin yang dibenarkan.

Satu perkara yang amat relevan ialah gabungan katalog OneLake dalam Azure Databricks, yang membolehkan Akses tanpa salinan daripada Katalog Unity ke jadual OneLakeDengan cara ini, OneLake kekal sebagai sumber kebenaran, tetapi Databricks boleh membuat pertanyaan secara langsung terhadap data, hanya menyegerakkan metadata.

Pangkalan Data SQL pada Fabric: prestasi, keselamatan dan virtualisasi

Pangkalan data SQL Fabric semakin mendapat keupayaannya sendiri: UBAH pilihan SET PANGKALAN DATASokongan untuk pengumpulan dan pengindeksan teks penuh dalam pratonton. Pada tahap prestasi pangkalan data Dan mengenai kos, terdapat beberapa penambahbaikan:

- Pemadatan indeks automatik untuk mengurangkan storan, I/O dan menambah baik masa pertanyaan tanpa perlu menjadualkan kerja penyelenggaraan.

- Had maksimum vCores untuk mengawal penggunaan sumber pengkomputeran (4 atau 32 vCores), yang direka untuk mengelakkan beban kerja daripada menggunakan terlalu banyak dalam kapasiti yang dikongsi.

- Kolam SQL Tersuai yang memberikan pentadbir ruang kerja kawalan terperinci ke atas peruntukan sumber dan penghalaan pertanyaan mengikut nama aplikasi.

Ia juga didayakan Virtualisasi data dalam pangkalan data SQL, yang membolehkan pertanyaan data luaran yang disimpan dalam OneLake dengan T-SQL, menggabungkan fail dalam format biasa dengan jadual hubungan setempat menggunakan gabungan, tanpa perlu mengimport data secara fizikal.

Dari segi keselamatan, pangkalan data SQL menyokong Pautan Persendirian di peringkat penyewa (pratonton)Ini memudahkan penyaluran trafik data secara peribadi dan terkawal, disepadukan dengan konfigurasi rangkaian selamat keseluruhan Fabric.

Kecerdasan Masa Nyata, Eventhouse, Eventstream dan Activator

Modul Kecerdasan Masa Nyata (RTI) telah menjadi salah satu pembeza utama Fabric. Eventhouse dan Eventstream bergabung untuk menelan, memproses dan mencetuskan peristiwa masa nyata daripada pelbagai jenis sumber, dan Activator mengatur tindakan yang dicetuskan di bawah keadaan tertentu.

Antara ciri-ciri baharu yang paling berkuasa ialah:

- Pengesanan anomali tanpa kod dengan pemilihan model automatik, antara muka mudah dan amaran fleksibel.

- Peristiwa Perniagaan, yang merakam detik perniagaan penting yang dijana daripada Fungsi Data Pengguna dan Buku Nota serta membolehkan anda mengaktifkan makluman, logik tersuai, aliran, model AI atau kerja Spark.

- Integrasi Fungsi Pengaktif-Data Penggunasupaya fungsi yang dicipta dalam Fabric boleh memproses peristiwa daripada sebarang sumber, termasuk peristiwa dalaman daripada platform itu sendiri dan daripada OneLake.

- Keupayaan untuk memproses peristiwa dengan SQL (Operator SQL dalam Eventstream), membolehkan transformasi aliran masa nyata dengan sintaks SQL yang diketahui.

Penyambung yang berkaitan ditambah seperti Cribl (untuk pengingesan log dan telemetri daripada pelbagai sumber), penyambung dengan Solace PubSub+ dan sokongan penstriman melalui rangkaian persendirian melalui Azure Virtual Network, VPN, ExpressRoute atau titik akhir persendirian.

Untuk skema dan kontrak data, Eventstream memperkenalkan Daftar Skema yang mentakrifkan dan mengesahkan skema peristiwa untuk saluran paip yang lebih mantap, dan sokongan untuk Daftar Skema Confluent untuk berhubung dengan Kafka dalam Confluent Cloud sambil menghormati kontrak sedia ada.

Keupayaan Copilot dan AI merentasi platform

Copilot in Fabric kini tersedia di seluruh dunia, dengan kehadiran di Power BI, Kilang Data, Sains Data & Kejuruteraan Data dan penulisan pertanyaan KQLDi samping itu, keupayaan khusus telah digabungkan:

- Juruterbang Bersama untuk Aliran Data Gen2 (Dapatkan Data Moden), yang membantu menyerap dan mengubah data dengan arahan dalam bahasa semula jadi.

- Juruterbang Bersama untuk Gudang Data (sembang), boleh diakses daripada butang pada reben untuk mempercepatkan tugas pergudangan melalui dialog.

- Copilot untuk titik akhir analitik SQL, yang menjana dan mengoptimumkan pertanyaan SQL daripada perihalan perniagaan.

- Juruterbang bersama pada buku nota dengan pengetahuan tentang konteks ruang kerja, lakehouse, struktur buku nota dan persekitaran pelaksanaan, berupaya menjana kod berbilang langkah, memfaktor semula, meringkaskan buku nota yang kompleks dan mendiagnosis ralat dengan pilihan "Betulkan dengan Copilot".

- Pelengkapan automatik sebaris (penyelesaian kod sebaris) dan penyelesaian kod sebaris Kopilot Notebook (pratonton), untuk menulis Python dengan lebih pantas dan dengan lebih sedikit ralat.

Tambahan pula, asas teknologi AI sedang diperluas dengan Alat Foundry prabina bersepadu (Azure OpenAI, Azure Language, Azure Translator), plugin OpenAI untuk Eventhouse (ai_embed_text dan ai_chat_completion) dan satu siri ejen dan ejen data yang membolehkan aplikasi lain, termasuk Copilot Studio, berfungsi pada data Fabric secara tersusun.

Ejen Data Fabrik, MCP dan alatan pembangun

Fabrik memperkenalkan ejen data yang mampu mengatur akses kepada data dan alatan Untuk ejen AI, dengan SDK Python dan penyepaduan langsung dengan Microsoft Copilot Studio. Ini memudahkan untuk membina pembantu perbualan yang berfungsi dengan data perusahaan yang dikawal dalam Fabric.

Secara selari, yang Protokol Konteks Model (MCP) Ia menjadi komponen utama penyepaduan antara ejen AI dan perkhidmatan Fabric. Terdapat pelayan MCP khusus untuk Activator dan Eventhouse, dan Fabric MCP berorientasikan pembangunan yang:

- Ia membolehkan pembantu AI menjana kod dan kandungan untuk item Fabrik.

- Ia berintegrasi dengan alatan pembangunan seperti VS Code dan GitHub Codespaces.

- Ia membentangkan alat untuk berunding dan bertindak berdasarkan data masa nyata dalam Eventhouse.

Untuk kerja harian pembangun, terdapat beberapa perkara penting yang perlu diserlahkan, termasuk persekitaran pembangunan: Sambungan MSSQL untuk VS Code dengan sokongan untuk pangkalan data Fabric SQL, Pemacu Microsoft ADO.NET dan Pemacu ODBC untuk Kejuruteraan Data Fabric (sambungan ke Spark SQL melalui Livy), dan penyambung Spark untuk pangkalan data SQL yang memudahkan akses yang disahkan daripada Spark kepada pangkalan data SQL dalam Azure dan Fabric.

Juga muncul Fabrik CLI, tersedia sebagai tugas bersepadu dalam Azure DevOps, yang membolehkan anda mengautomasikan pengurusan ruang kerja, item dan penggunaan tanpa memasang alat luaran secara manual.

Kilang Data, migrasi data dan orkestrasi dalam Fabric

Lapisan integrasi data Fabric bergantung pada Data Factory dan Dataflow Gen2, yang menerima fungsi untuk... Orkestrasi akan menjadi lebih pintar, lebih automatik dan dengan migrasi yang lebih mudah. daripada platform sedia ada.

Aliran Data Gen2: prestasi, API awam dan diagnostik

Dalam Dataflow Gen2, kami menemui beberapa ciri dalam pratonton:

- Pengeditan lanjutan pertanyaan sasaran untuk melaraskan logik di destinasi terus daripada persekitaran pengarangan itu sendiri.

- Pengkomputeran berpartisiyang membolehkan sebahagian aliran data berjalan secara selari, sekali gus mengurangkan jumlah masa penilaian.

- Muat turun diagnostik pada peringkat pelaksanaan, dengan pakej log berstruktur untuk analisis prestasi dan penyelesaian insiden.

- API Awam untuk mencipta, mengemas kini, memadam, menjadualkan dan memantau aliran data secara pengaturcaraan.

- Parameter awam dengan sokongan CI/CDyang membolehkan aliran data yang menyegarkan dengan menghantar nilai daripada saluran paip atau sumber lain.

- Data terkini untuk akses pantas kepada item yang digunakan baru-baru ini dalam reben Power Query dan dalam Modern Get Data.

Semua ini dilengkapi dengan keupayaan Nilaikan Power Query secara pengaturcaraan melalui RESTIni membuka pintu untuk menjalankan skrip M sebagai sebahagian daripada proses automatik, mengintegrasikannya dengan Spark, saluran paip atau alat luaran, memanfaatkan penyambung Power Query.

Kilang Data: prestasi adaptif, ketersambungan dan dbt

Dalam bahagian integrasi yang lebih "klasik", Data Factory dalam Fabric memperkenalkan:

- Penalaan prestasi adaptif untuk aktiviti salinan, yang melaraskan parameter prestasi secara bijak mengikut konteks konfigurasi dan pelaksanaan.

- Tukar sokongan Tangkapan Data (CDC) dalam kerja Salin, untuk hanya meniru perubahan (sisipan, kemas kini, pemadaman) secara berterusan.

- Gerbang di premis dengan pilihan naik taraf manual diuruskan daripada portal Fabric, API atau skrip.

- sambungan baru-baru ini, yang menambah sifat penggunaan terakhir pada sambungan untuk memudahkan pengauditan dan pengurusan kitaran hayat.

- Kerja dbt asli, yang membolehkan menjalankan projek dbt dalam Fabric dengan orkestrasi, pengujian, dokumentasi dan tadbir urus bersepadu.

- Sebut aktiviti Pakej SSIS dalam saluran paip, untuk menjalankan pakej SSIS daripada orkestrasi itu sendiri dalam Fabric.

Pengalaman pengguna juga dipertingkatkan dengan Pemilih tapak SharePoint (SharePoint Site Picker) yang mengelakkan daripada menaip URL secara manual dan dengan sokongan MCP untuk Data Factory supaya pembantu AI boleh mencipta dan menggunakan Dataflow Gen2 hanya daripada arahan bahasa semula jadi.

Alat penghijrahan dan replikasi data

Microsoft sedang giat mempromosikan migrasi ke Fabric melalui beberapa alat khusus:

- Penilaian Migrasi Fabrik untuk Kilang Data, yang menganalisis penyediaan saluran paip ADF dan memindahkan saluran paip yang disokong ke ruang kerja Fabric dengan pemetaan sambungan.

- Pembantu Migrasi untuk Gudang Datayang kini boleh bersambung terus ke gudang sumber untuk memindahkannya ke Gudang Data Fabric.

- Pembantu Migrasi untuk pangkalan data SQL, bertujuan untuk memindahkan beban kerja SQL Server di premis, dengan import skema melalui DACPAC, pengesanan ketidakserasian dan cadangan.

Berkenaan replikasi, sokongan diberikan kepada pencerminan pelbagai sumber operasi (Pangkalan Data Azure untuk MySQL, Google BigQuery, SQL Server, dll.) kepada Fabric, dengan keupayaan untuk mengawal jadual yang direplikasi, memulakan semula proses pencerminan melalui REST dan, dalam kes Databricks, memetakan dasar Katalog Unity kepada keselamatan OneLake.

Turut disertakan ialah penyambung replikasi daripada Lakehouse menggunakan Suapan Data Perubahan Delta, yang mendedahkan perubahan pada papan Lakehouse Delta ke arah destinasi yang serasi tanpa perlu mencipta semula roda dengan penyelesaian buatan tempatan CDC.

Keselamatan, tadbir urus lanjutan dan pemantauan dalam Fabric

Salah satu kebimbangan terbesar dalam mana-mana platform analitik ialah bagaimana selamatkan data, kawal selia penggunaan dan pantau penggunaan sumberFabrik matang dengan cepat dalam bidang ini.

Keselamatan dan perlindungan data di OneLake

OneLake menambah model lengkap bagi keselamatan akses data dengan:

- Peranan akses data untuk Lakehouse dengan kebenaran yang boleh dikonfigurasikan daripada antara muka keselamatan berasaskan folder.

- Sokongan keselamatan untuk pintasan supaya pihak ketiga dapat menghormati dasar yang ditetapkan.

- API keselamatan akses data OneLake, yang membolehkan pengurusan kebenaran automatik.

- Peluasan model kepada enjin luaran (kebenaran keselamatan OneLake untuk pihak ketiga).

Secara selari, perlindungan sedang diperluas dengan DLP menyekat akses ke atas semua data berstruktur dalam OneLake (SQL, KQL, gudang) dan diperkenalkan DSPM untuk AI untuk Pembantu Juruterbang Fabrik dan ejen data, yang memantau interaksi AI untuk maklumat sensitif dan tingkah laku berisiko, dengan penyepaduan dengan Purview Audit dan eDiscovery.

Dari segi identiti, ciri-ciri seperti berikut muncul: identiti yang berkaitan dengan barang-barang (contohnya, Lakehouse dan Eventstream) melalui API REST, yang menghapuskan kebergantungan pemilik untuk operasi tertentu dan pengesahan pintasan OneDrive dan SharePoint menggunakan identiti ruang kerja atau prinsipal perkhidmatan.

Tadbir urus berpusat dan katalog OneLake

Pengalaman tadbir urus data diperkukuh oleh panel berpusat baharu dalam katalog OneLaketempat pemilik data dapat melihat paparan agregat item yang telah mereka cipta, menerima cadangan tindakan tadbir urus dan mengakses semua alat yang tersedia untuk meningkatkan keselamatan dan pematuhan.

Di samping itu, seorang API Carian Katalog OneLake bersama-sama dengan alat MCP, yang membolehkan penemuan item di seluruh persekitaran Fabric daripada kod atau ejen AI, dalam satu panggilan, dengan menghormati kebenaran katalog dan metadata.

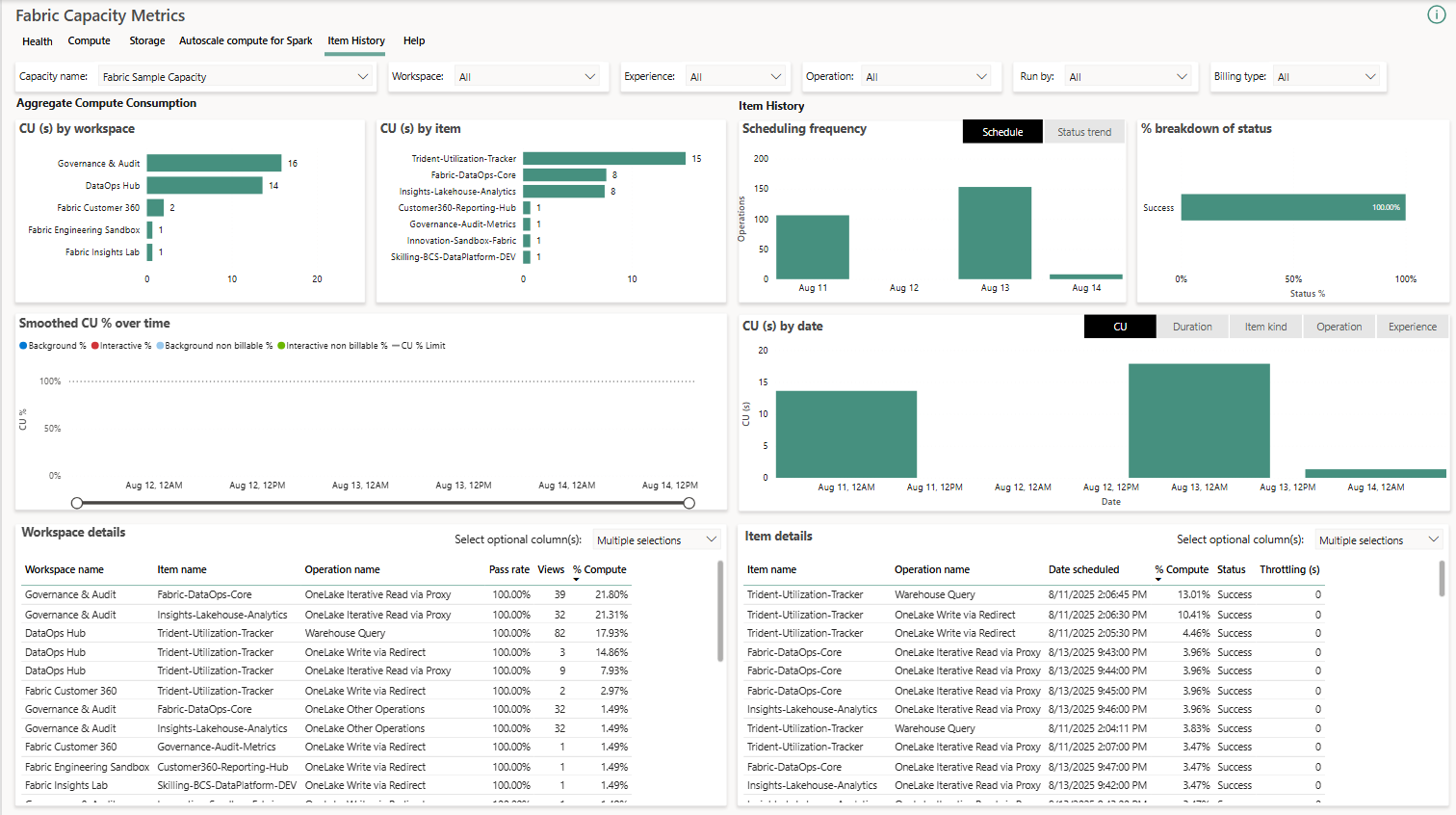

Pemantauan kapasiti, penggunaan dan kerja

Fabrik menyediakan beberapa lapisan kebolehcerapan:

- Pemantauan ruang kerja, yang mencipta pangkalan data dalam Fabric di mana log dan metrik daripada berbilang item disatukan (termasuk kerja Salin dengan pemantauan terperinci).

- Pemantauan ruang kerja untuk kerja Salinandengan metrik seperti daya pemprosesan, jumlah data, kod ralat dan masa, semuanya menjurus ke arah analisis berpusat.

- Sejarah Item dalam aplikasi metrik kapasiti, dengan paparan 30 hari tentang penggunaan CU untuk setiap item, boleh ditapis mengikut ruang kerja dan jenis.

- Perlindungan lonjakan tahap ruang kerjayang membolehkan penetapan ambang penggunaan setiap ruang kerja dalam tempoh 24 jam, menyekat ruang kerja yang melebihinya secara automatik dan menandakan ruang kerja sebagai "misi kritikal" untuk mengecualikannya daripada batasan.

Melengkapi ini, satu set awal API Pentadbir Fabrik memberi tumpuan kepada penemuan ruang kerja, item dan butiran akses pengguna, memudahkan inventori dinamik dan kawalan akses berkala.

Pemodelan perniagaan, perancangan dan beban kerja baharu

Di luar lapisan teknikal, Microsoft memperkenalkan beban kerja berorientasikan perniagaan baharu tentang Fabric. Salah satu yang paling menonjol ialah Fabric IQ, yang bertujuan untuk menyatukan semantik perniagaan, data dan model untuk ejen pintar yang membuat keputusan berdasarkan pandangan holistik organisasi.

Dalam Fabric IQ, perkara berikut muncul:

- Ontologi (pratonton), sejenis item yang mana entiti, perhubungan, sifat dan kekangan ditakrifkan mengikut bahasa perniagaan syarikat.

- Pelan (pratonton), platform tanpa kod untuk perancangan, pelaporan, analitik, integrasi dan pengurusan kolaboratif.

Kecerdasan Masa Nyata juga muncul pembina kembar digital, item khusus dalam pemodelan kembar digital berdasarkan data masa nyata, dengan tujuan untuk mengoptimumkan operasi fizikal, memantau keadaan dan mensimulasikan senario.

Sebaliknya, ia diperkenalkan Beban kerja Fabrik IQ sebagai beban kerja yang berasingan, dan alat sokongan untuk tadbir urus dan penjajaran semantik terus berkembang, menutup lingkaran antara model data, logik perniagaan dan aplikasi AI/analitik.

Prestasi, pengalaman pengguna dan peningkatan produktiviti

Untuk mengakhiri ulasan ini, adalah wajar untuk mengetengahkan beberapa penambahbaikan merentas sektor yang Mereka tidak selalu menjadi berita utama, tetapi mereka sangat mempengaruhi kehidupan seharian. pasukan.

Dalam bahagian Spark dan pengkomputeran teragih, Fabric memperkenalkan:

- Masa Larian Fabrik 2.0 (pratonton) dengan Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 dan Python 3.12 pada Azure Linux 3.0.

- Alat perbandingan aplikasi Sparkyang membolehkan anda memilih dan membandingkan sehingga empat pelaksanaan Spark secara selari.

- Pemancar Diagnostik Percikan, yang mengumpul log, metrik dan peristiwa daripada aplikasi Spark dan menghantarnya ke destinasi seperti Hab Peristiwa, storan atau Analisis Log.

- Pustaka diagnostik JobInsight, sebuah perpustakaan untuk menganalisis pelaksanaan Spark yang telah selesai melalui API (pertanyaan, kerja, peringkat, tugasan, pelaksana, log peristiwa).

Dalam lapisan gudang, perkara berikut ditambah: pengelompokan data Untuk meningkatkan prestasi dan mengurangkan kos akses, lajur IDENTITY untuk kunci pengganti dan kawalan versi serta sokongan CI/CD melalui projek Pangkalan Data SQL dalam Kod VS (Kawalan sumber Gudang).

Pengalaman pengguna portal Fabric juga berkembang seiring dengan Pelayaran tab dan penjelajah objekIni membolehkan anda membuka berbilang item sekaligus dan bertukar antara item tersebut dengan cepat. Ini, digabungkan dengan penambahbaikan seperti pengikatan automatik Lakehouse dalam Git dan suit utiliti untuk penyelenggaraan Lakehouse (aktiviti penyelenggaraan dan penyegaran titik akhir SQL), menyumbang kepada platform yang lebih mesra pengguna dan tangkas.

Akhir sekali, ciri-ciri seperti Import/eksport pukal definisi item (untuk migrasi, templat dan sandaran metadata), REST untuk folder, sokongan parameter dalam pengaktifan item daripada Activator dan pemuatan data OneLake dalam Excel dengan katalog bersepadu, melengkapkan ekosistem yang mula meliputi hampir semua keperluan biasa pasukan data moden.

Dengan keseluruhan set keupayaan ini—daripada tadbir urus berpusat, keselamatan terperinci dan orkestrasi pintar, kepada AI yang terbenam dalam SQL, analitik masa nyata, kembar digital dan ejen MCP—Microsoft Fabric mengukuhkan kedudukannya sebagai platform data lengkap di mana Kuncinya bukan lagi sekadar menyimpan dan menggambarkan data, tetapi juga mentadbir, mengautomasikan dan memanfaatkan AI untuk mengawal setiap bahagian kitaran hayat data.membolehkan organisasi mengembangkan seni bina mereka secara beransur-ansur, memindahkan apa yang telah mereka miliki dan membolehkan penyelesaian baharu dengan lebih pantas berbanding pendekatan tradisional.

Isi kandungan

- Microsoft Fabric dan Rangka Kerja Penerimaan Awan: tadbir urus, kos dan automasi

- Kemas kini penting dalam analitik, AI dan tadbir urus untuk Microsoft Fabric

- Fungsi AI dalam Gudang Data dan fungsi multimodal

- OneLake, Delta, Apache Iceberg dan akses berbilang platform

- Pangkalan Data SQL pada Fabric: prestasi, keselamatan dan virtualisasi

- Kecerdasan Masa Nyata, Eventhouse, Eventstream dan Activator

- Keupayaan Copilot dan AI merentasi platform

- Ejen Data Fabrik, MCP dan alatan pembangun

- Kilang Data, migrasi data dan orkestrasi dalam Fabric

- Keselamatan, tadbir urus lanjutan dan pemantauan dalam Fabric

- Pemodelan perniagaan, perancangan dan beban kerja baharu

- Prestasi, pengalaman pengguna dan peningkatan produktiviti