- La seguridad de contenedores Docker exige controlar imágenes, host, red y orquestación de forma conjunta.

- Usar imágenes mínimas, firmadas y escaneadas reduce drásticamente vulnerabilidades y superficie de ataque.

- El principio de mínimo privilegio, la segmentación de red y la gestión segura de secretos son pilares imprescindibles.

- La combinación de escaneo continuo, monitorización en tiempo de ejecución y cultura DevSecOps refuerza todo el ciclo de vida.

Los contenedores han cambiado por completo la forma en la que desarrollamos y desplegamos software. Docker ha pasado de ser una curiosidad de nicho a convertirse en el estándar de facto para empaquetar aplicaciones, microservicios e incluso bases de datos. Todo es más rápido, más portátil y mucho más fácil de automatizar; la optimización de contenedores es clave, pero si bajas la guardia con la seguridad, el susto puede ser grande.

Un único contenedor mal configurado o una imagen con una vulnerabilidad crítica pueden propagarse por toda tu infraestructura en segundos. La misma agilidad que utilizas para desplegar en CI/CD es la que aprovecha un atacante para escalar privilegios, moverse lateralmente por la red o extraer datos sensibles. Por eso merece la pena pararse, revisar buenas prácticas y montar una estrategia seria de seguridad para contenedores Docker.

Qué es Docker y por qué su seguridad es tan delicada

Docker es una plataforma de contenedores que permite empaquetar una aplicación junto con sus librerías, binarios y dependencias en una unidad estandarizada llamada imagen de contenedor. A partir de esa imagen se pueden lanzar tantas instancias como quieras, que son los contenedores en sí.

Estos contenedores se ejecutan como procesos aislados sobre un sistema operativo compartido. No son máquinas virtuales completas: comparten el kernel del host, lo que los vuelve muy ligeros y perfectos para arquitecturas de microservicios, pipelines CI/CD y despliegues nativos en la nube.

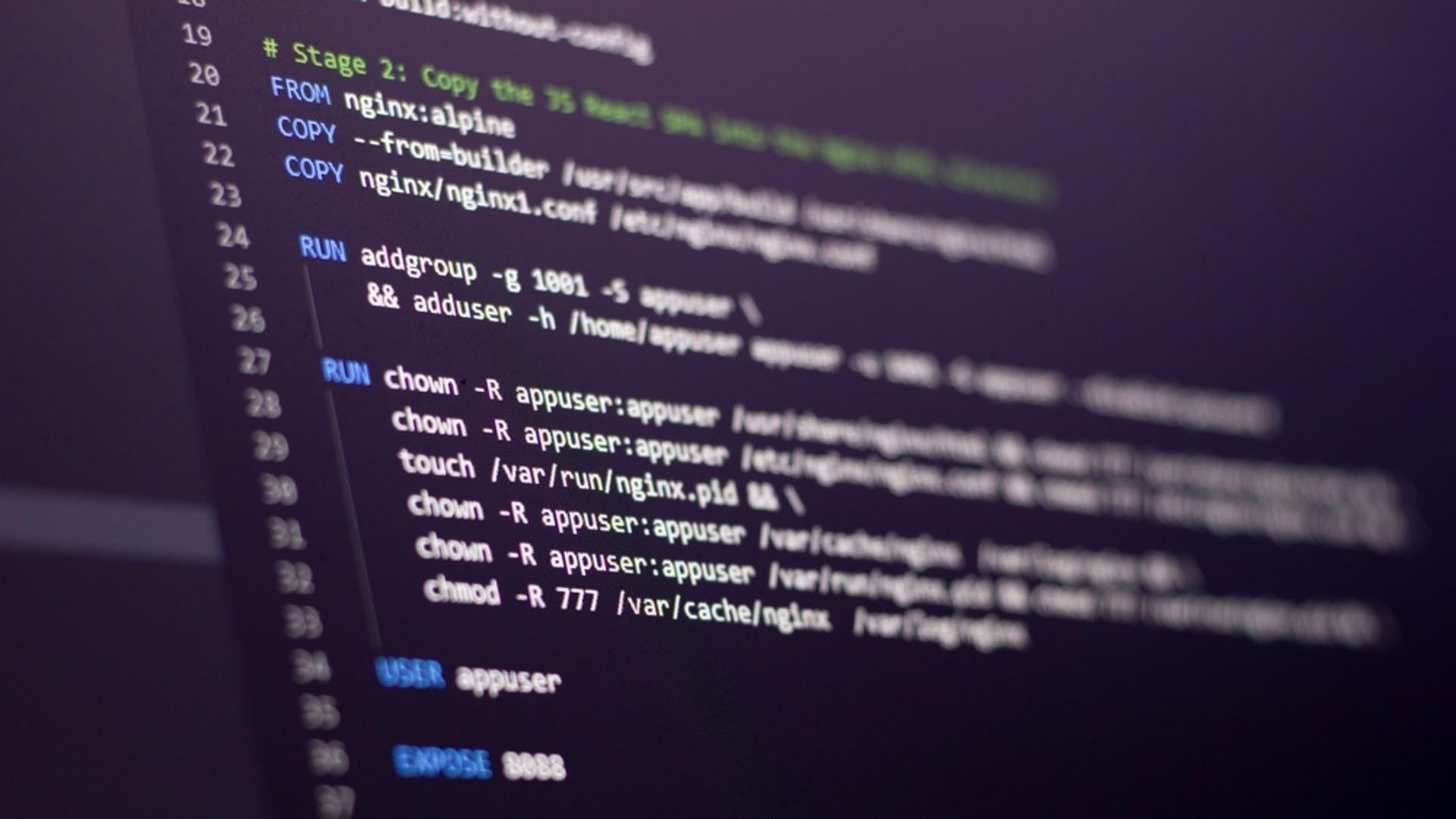

Las imágenes se definen normalmente mediante Dockerfile, un archivo de texto donde se especifican qué base se usa, qué paquetes se instalan, qué puertos se exponen, qué usuario se ejecuta y otros detalles. Una vez construida, la imagen se guarda en un registro (Docker Hub, registro corporativo, etc.) y desde ahí se despliega en desarrollo, preproducción o producción.

Todo este modelo aporta agilidad y escalabilidad, pero también abre puertas nuevas a los atacantes. Cualquier fallo en la imagen, el host, la red o el orquestador puede comprometer desde una app aislada hasta todo un clúster de Kubernetes (por ejemplo, Docker Swarm).

Principales riesgos y amenazas en contenedores Docker

Antes de empezar a endurecer el entorno, conviene tener claro qué te puede pasar. Los ataques contra contenedores suelen pivotar sobre unos cuantos vectores muy repetidos.

Imágenes vulnerables o maliciosas

Cada imagen Docker suele incluir un sistema base y un buen puñado de paquetes. Basta con que una de esas dependencias tenga una vulnerabilidad conocida para que tu superficie de ataque se dispare. El uso de imágenes obsoletas, no oficiales o modificadas por terceros es una fuente constante de problemas.

Se han encontrado miles de imágenes públicas en registros como Docker Hub que incluían malware, puertas traseras o configuraciones peligrosas. Si las usas sin validar, básicamente estás ejecutando código de desconocidos en tus servidores.

Fuga de contenedores (container escape)

Los contenedores comparten el kernel del host; si alguien logra explotar un bug en ese kernel, en el runtime o en la configuración de privilegios, puede saltar del contenedor al sistema anfitrión o a otros contenedores. Es lo que se conoce como escape de contenedor.

Este tipo de ataque se facilita cuando se ejecutan contenedores con modo privilegiado, capacidades de Linux excesivas o sin mecanismos como AppArmor, SELinux o seccomp correctamente aplicados.

Configuraciones de red inseguras

Docker facilita la creación de redes puente, superposición y publicación de puertos hacia el exterior. Si todo esto se deja en modo «por defecto», es fácil acabar con servicios internos expuestos en Internet, comunicaciones entre contenedores sin restricciones o la posibilidad de moverse lateralmente por todo el entorno.

Una mala segmentación, la ausencia de cortafuegos a nivel de host o políticas laxas en el orquestador pueden permitir que la intrusión en un único contenedor se convierta en un compromiso generalizado.

Daemon Docker mal protegido

El demonio de Docker (dockerd) es el corazón de la plataforma: controla imágenes, contenedores y redes. Si un atacante llega al socket del daemon tiene, de facto, control sobre todo el host. Esto incluye el acceso a volúmenes, imágenes, redes y otros contenedores.

Entre las malas prácticas típicas están exponer la API de Docker sin TLS, no pedir autenticación al socket remoto, ejecutar el daemon con más privilegios de los necesarios o no auditar nunca su configuración.

Secretos y variables de entorno expuestos

Es muy común encontrar contraseñas, tokens de API o claves privadas metidas a capón en Dockerfile, en variables de entorno o incluso en el código. Esos secretos acaban siendo visibles en las capas de la imagen, en los logs o mediante un simple docker inspect.

Cuando esas imágenes se suben a un registro compartido, cualquiera con acceso al registro puede recuperar credenciales que luego reutilizará para pivotar hacia bases de datos, colas de mensajes u otros servicios internos.

Vulnerabilidades del kernel y del sistema host

Dado que todos los contenedores dependen del mismo kernel, cualquier fallo de seguridad a nivel del sistema operativo afecta a todo el clúster. Un host desactualizado, con parches de seguridad pendientes, es un regalo para quien busca exploits conocidos.

Además, si el host ejecuta otros servicios además de Docker, un fallo en uno de esos servicios puede usarse como puerta de entrada para después atacar el entorno de contenedores.

Comunicación sin restricciones entre contenedores

De fábrica, muchos despliegues permiten que todos los contenedores se hablen entre sí sin demasiados filtros. Esto es muy cómodo para los desarrolladores, pero fatal para la seguridad. Si un contenedor cae, el atacante puede usarlo como cabeza de playa para atacar al resto.

Sin segmentación de redes, sin políticas de tráfico y sin inspección, el movimiento lateral dentro del clúster es cuestión de tiempo una vez conseguido el primer acceso.

Buenas prácticas clave antes de usar Docker en producción

Todo arranca en el host donde se va a ejecutar Docker. Montar contenedores sobre sistemas operativos inseguros es empezar la casa por el tejado, así que conviene sentar unas bases mínimas.

Lo ideal es destinar servidores o VMs exclusivamente para cargas de trabajo en contenedores. No mezcles Docker con bases de datos físicas, aplicaciones legacy u otros servicios en el mismo host si puedes evitarlo: reduces superficie de ataque y evitas interferencias.

Mantén el kernel y el sistema operativo del host al día con parches de seguridad, preferiblemente con versiones LTS y un proceso claro de actualización. Refuerza también el sistema de ficheros, la configuración SSH, los servicios en segundo plano y, en general, todo lo que no sea estrictamente necesario para correr Docker.

En entornos Linux es muy recomendable activar y configurar correctamente mecanismos como AppArmor, configurar SELinux, cgroups y namespaces. Son la base del aislamiento entre contenedores y del control fino de permisos sobre recursos del host.

Imágenes Docker seguras: la base de todo

La seguridad de tus contenedores empieza en la imagen. Si tu imagen ya viene torcida, da igual lo bien que configures el resto. Aquí es donde más valor aporta ser disciplinado.

Usar imágenes oficiales, verificadas y mínimas

Siempre que puedas, tira de imágenes oficiales o verificadas (por ejemplo, imágenes de proveedores certificados o registries corporativos de confianza). Estas suelen mantenerse actualizadas, se someten a escaneos frecuentes y reducen el riesgo de encontrarte código malicioso.

Empieza siempre desde una base mínima: alpine, debian:slim o equivalentes reducen drásticamente el número de paquetes instalados. Cuantos menos componentes tenga tu imagen, menos vulnerabilidades potenciales arrastras y más fácil es mantenerla al día.

Firmar y verificar las imágenes

Para evitar sorpresas con imágenes modificadas, usa mecanismos de confianza de contenido como Docker Content Trust o sistemas tipo Notary. La idea es tirar solo de imágenes firmadas por quien tú consideras de confianza y verificar esa firma antes de ejecutar nada.

En muchos casos basta con activar el uso obligatorio de firmas antes de desplegar, de forma que cualquier imagen sin firma válida o procedente de un origen desconocido quede automáticamente bloqueada.

Evitar información sensible dentro de la imagen

Incluir claves, certificados o contraseñas en la propia imagen es uno de los fallos más clásicos. Cualquier persona con acceso al registro puede descargar la imagen y extraer esos secretos. No hace falta ser un genio para ello.

La forma correcta es inyectar secretos en tiempo de ejecución: Docker Secrets, Kubernetes Secrets u otras herramientas open-source como Vault o Consul permiten gestionar credenciales de forma centralizada, cifrarlas y exponerlas solo a los contenedores que realmente las necesitan.

Escaneo de vulnerabilidades en imágenes

Integrar escáneres de vulnerabilidades en el ciclo de vida es imprescindible. Herramientas como Trivy, Clair, Grype, Snyk, Anchore u otras se conectan a tu pipeline CI/CD, a tus registros o a tu orquestador y analizan cada imagen en busca de CVE conocidos y configuraciones peligrosas.

Lo ideal es que este escaneo ocurra automáticamente en cada build o antes de subir la imagen al registro, y que se impida promocionar a producción cualquier imagen con vulnerabilidades de alta o crítica gravedad sin una excepción explícita.

Multi-stage builds y reducción de superficie

Las compilaciones en varias etapas permiten compilar tu aplicación en una imagen «gorda» con todas las herramientas de desarrollo y copiar solo el artefacto final a una imagen de ejecución muy ligera. De este modo evitas dejar compiladores, gestores de paquetes y utilidades innecesarias dentro de la imagen de producción.

Al final obtienes contenedores más pequeños, que se descargan y arrancan más rápido, y que además ofrecen menos oportunidades a un atacante para moverse dentro del sistema.

Gestión de privilegios, usuario y recursos de los contenedores

Uno de los errores más repetidos es lanzar contenedores como root y olvidarse del tema. Si el proceso dentro del contenedor corre como root y se produce un escape, el atacante será root en el host, con todo lo que eso implica.

Lo correcto es crear usuarios específicos dentro de la imagen y utilizar la directiva USER en Dockerfile, o bien asignar un usuario no privilegiado con la opción –user al arrancar el contenedor. Combínalo con sistemas de ficheros de solo lectura y volúmenes con permisos ajustados.

Además, revisa las capacidades de Linux y el modo privilegiado: evita a toda costa la opción –privileged salvo en casos muy concretos y controlados, y aplica perfiles de seccomp, AppArmor o SELinux para limitar las llamadas al sistema que puede ejecutar el contenedor.

En paralelo, define cuotas de recursos mediante cgroups para limitar CPU, RAM e I/O. Así evitas que un contenedor comprometido acabe tumbando el host o afectando al rendimiento del resto de servicios, ya sea por accidente o como parte de un ataque DoS interno.

Red, registros y segmentación del entorno Docker

La red es otra pieza crítica en la seguridad de contenedores. No todo servicio necesita ser accesible desde todas partes, y menos aún desde Internet.

Usa redes Docker personalizadas y separa tráfico de frontend, backend, bases de datos y servicios internos. Limita qué contenedores pueden hablar entre sí y por qué puertos. En muchos casos bastará con que los servicios internos solo escuchen en redes privadas sin exposición pública.

Configura cortafuegos en el host (iptables, nftables, UFW, firewalld) para filtrar el tráfico hacia y desde los puertos que Docker publica. Aplica también políticas de red a nivel de orquestador (por ejemplo, NetworkPolicies en Kubernetes) para reforzar esta segmentación.

En cuanto a los registros de contenedores, usa registries de confianza, idealmente un registro privado detrás de tu propio firewall y con control de acceso basado en roles (RBAC). Restringe quién puede subir y descargar imágenes, y evita que todo el mundo pueda hacer push de cualquier cosa.

Implementar una política clara sobre etiquetado (tags) ayuda a saber qué versión está desplegada en cada entorno. Evita abusar de «latest» y utiliza versionado semántico o similar para mantener control sobre qué se está ejecutando donde.

Monitorización, logging y respuesta ante incidentes

Sin visibilidad, la seguridad es básicamente fe. Los contenedores son efímeros y se crean y destruyen a gran velocidad, así que necesitas una capa de monitorización centralizada que no dependa del ciclo de vida de cada contenedor.

Centraliza los logs con soluciones como ELK, Grafana Loki, Fluentd u otras, y asegúrate de que tanto el daemon de Docker como los contenedores y el host envían sus registros a ese sistema. Esto te permitirá correlacionar eventos y detectar patrones anómalos.

Para la detección de amenazas en tiempo de ejecución, herramientas como Falco se han convertido en un estándar de facto. Analizan llamadas al sistema en tiempo real y disparan alertas cuando detectan comportamientos sospechosos: shells interactivos dentro de contenedores, accesos extraños a ficheros sensibles, conexiones de red raras, etc.

Completa todo esto con un plan de respuesta a incidentes específico para contenedores. Define de antemano cómo vas a aislar contenedores comprometidos, qué evidencias vas a recopilar, cómo vas a reconstruir imágenes limpias y cómo vas a revisar las reglas y configuraciones tras un ataque.

Herramientas y plataformas especializadas en seguridad de Docker

El ecosistema de seguridad de contenedores es enorme. Existen soluciones para prácticamente cada capa del ciclo de vida: desde el código hasta el runtime pasando por el registro y la nube.

Plataformas de seguridad de ciclo completo

Algunas herramientas están pensadas para dar cobertura de extremo a extremo. Plataformas como Aqua Security, Prisma Cloud, Check Point Container Security o Aikido Security combinan escaneo de imágenes, protección en tiempo de ejecución, gestión de vulnerabilidades, cumplimiento normativo y visibilidad multinube.

Este tipo de soluciones resultan especialmente útiles en grandes organizaciones que necesitan consolidar en una única consola la seguridad de contenedores, Kubernetes, máquinas virtuales y servicios cloud, reduciendo así la fragmentación de herramientas y la fatiga de alertas.

Herramientas centradas en desarrolladores

Otros enfoques se orientan a meter la seguridad directamente en el flujo de trabajo del desarrollador. Plataformas como Snyk, Aikido Security o los escáneres de Anchore se integran con GitHub, GitLab, IDEs y pipelines CI/CD para dar feedback temprano, sugerir correcciones y priorizar vulnerabilidades realmente explotables.

La idea es que sea el propio equipo de desarrollo quien asuma parte de la responsabilidad de seguridad, corrigiendo imágenes base inseguras, dependencias vulnerables o configuraciones peligrosas antes de que nada llegue a producción.

Seguridad en tiempo de ejecución y detección de amenazas

Para el momento en el que los contenedores ya están corriendo, entran en juego soluciones de runtime: Falco como proyecto open source, Sysdig Secure, módulos EDR/IDS adaptados a contenedores y otros productos similares.

Estas herramientas observan lo que realmente ocurre en los contenedores y en el host, y pueden bloquear comportamientos maliciosos, reforzar políticas o, al menos, generar alertas muy detalladas con contexto de pods, namespaces, imágenes, etc.

Gestión de vulnerabilidades e inventario

La generación y gestión de SBOM (Software Bill of Materials) se ha vuelto un punto clave. Herramientas como Anchore (con Syft y Grype), Qualys Container Security y soluciones equivalentes permiten inventariar qué paquetes y librerías se incluyen en cada imagen y cruzarlo con bases de datos de vulnerabilidades.

De este modo, cuando aparece un nuevo CVE crítico, puedes localizar rápidamente qué imágenes y contenedores están afectados en tu entorno y planificar su actualización con cabeza.

Cultura DevSecOps y buenas prácticas organizativas

Más allá de la tecnología, la seguridad de Docker pasa por una cuestión de cultura. Si la seguridad se deja para el final, acabará siendo un freno para los despliegues, y la tentación será saltarse controles.

El enfoque DevSecOps propone integrar la seguridad desde el inicio del ciclo de vida: revisar Dockerfiles, escanear dependencias, aplicar políticas de calidad y seguridad en cada commit o cada merge request, y automatizar la mayor parte de estos controles.

También es clave que los equipos de arquitectura y seguridad definan módulos de buenas prácticas, plantillas de Dockerfile, imágenes base corporativas endurecidas y requisitos mínimos para que un contenedor pueda llegar a producción (puertos permitidos, logging, usuarios, límites de recursos, etc.).

La formación juega un papel enorme: cuanto mejor entiendan desarrolladores y operadores las implicaciones de correr contenedores como root, exponer puertos o mezclar entornos, menos errores básicos se colarán en tus despliegues y más natural será aplicar las recomendaciones anteriores.

Al final, proteger aplicaciones en contenedores Docker pasa por un enfoque por capas: imágenes fiables y mínimas, hosts reforzados, privilegios ajustados, redes segmentadas, escaneo continuo, monitorización inteligente y una cultura DevSecOps madura. Combinando estas piezas, se puede aprovechar todo lo bueno de Docker sin vivir con el miedo constante a que el próximo despliegue abra una brecha en producción.

Tabla de Contenidos

- Qué es Docker y por qué su seguridad es tan delicada

- Principales riesgos y amenazas en contenedores Docker

- Buenas prácticas clave antes de usar Docker en producción

- Imágenes Docker seguras: la base de todo

- Gestión de privilegios, usuario y recursos de los contenedores

- Red, registros y segmentación del entorno Docker

- Monitorización, logging y respuesta ante incidentes

- Herramientas y plataformas especializadas en seguridad de Docker

- Cultura DevSecOps y buenas prácticas organizativas