- Microsoft Fabric centralizira podatke, upravljanje, umetno inteligenco in analitiko v realnem času na OneLake in poenotenih zmogljivostih.

- Platforma krepi upravljanje, varnost in stroške prek Purview, varnosti OneLake, DLP, DSPM in integracije z Azure Cost Management.

- Orodja za tovarno podatkov, Dataflow Gen2 in migracijo olajšajo premikanje obstoječih delovnih obremenitev in orkestriranje kompleksnih cevovodov.

- Copilot, podatkovni agenti, MCP in nove delovne obremenitve, kot sta Fabric IQ in Real-Time Intelligence, poganjajo napredne scenarije umetne inteligence in avtomatizacije.

Če že nekaj časa delate s podatki v Microsoftovem ekosistemu, ste verjetno opazili, da Microsoft Fabric je postal osrednje središče sodobne analitikeZdruževanje vsega, kar je bilo prej razpršeno po storitvah Power BI, Azure Synapse, Data Factory in drugih storitvah, v eno samo platformo. V tem članku si bomo podrobno ogledali najnovejše funkcije, načrt in praktične posledice platforme Fabric za analitiko, upravljanje, umetno inteligenco in računalništvo v realnem času.

Ideja je, da boste po branju imeli jasno razumevanje Kaj ponuja Microsoft Fabric danes, kam gre in kako vpliva na podatkovno arhitekturo? vaše organizacije: zmogljivosti upravljanja s Purviewom, avtomatizacija z API-ji in Gitom, nove funkcije umetne inteligence, obveščanje v realnem času, varnost v OneLakeu, migracije, zmogljivost in še veliko več.

Microsoft Fabric in ogrodje za uvedbo v oblak: upravljanje, stroški in avtomatizacija

V okviru programa za uvajanje storitev v oblak (CAF) Microsoft objavlja vrsto vodnikov za uskladitev Oblikovanje Microsoft Fabric z oblikovalskimi stebri pristajalnih conZadnji del te serije obravnava tri ključna področja: upravljanje, optimizacijo zmogljivosti in avtomatizacijo/DevOps.

V razdelku o upravljanju, Stroški zmogljivosti Fabric so razkriti prek storitve Azure Cost ManagementTo vam omogoča, da podatke o uporabi zmogljivosti F (in drugih SKU-jev) izvorno integrirate v nadzorne plošče stroškov, opozorila in analitiko porabe Azure. Ne gre le za ogled računa: te podatke lahko primerjate z oznakami, naročninami ali skupinami virov, da razumete, kdo kaj porablja in zakaj.

Tehnična arhitektura in poslovni model podjetja Fabric strankam omogočata natančen nadzor porabe zmogljivosti za optimizacijo obratovalnih stroškovV praksi se to prevede v več vzvodov:

- Skaliranje zmogljivosti F: povečajte ali zmanjšajte zmogljivost glede na predvidljive konice, kot so prodajne kampanje, računovodski roki ali velike količine podatkov.

- Zmogljivosti za začasno ustavitev in nadaljevanjeSkrbniki Fabric lahko začasno ustavijo zmogljivost F, ko ni potrebna (na primer čez noč ali ob vikendih v nekritičnih okoljih), da zmanjšajo stroške računanja.

- Zaščita pred prenapetostjoDva parametra na ravni zmogljivosti nadzorujeta, kako se upravljajo opravila v ozadju, da se prepreči njihova preobremenitev okolja: prag zavrnitve v ozadju in prag obnovitve v ozadju.

- Rezervacije zmogljivostiRezervacija zmogljivosti za določena obdobja je mogoča za pridobitev popustov, pod pogojem, da je predvidena poraba natančno načrtovana.

Na področju upravljanja podatkov se Fabric zanaša na Microsoft Purview kot osrednja komponenta za katalogizacijo, rodovnik in klasifikacijoV Purviewu je mogoče uporabljati oznake občutljivosti, si ogledati povezavo med izvorom, transformacijami in porabo, certificirati podatkovna sredstva ali izboljšati kampanje za kakovost podatkov, vse to ob integraciji elementov Fabrica (Lakehouse, Warehouse, KQL, Power BI itd.).

Razdelek »Avtomatizacija platform in DevOps« je strukturiran predvsem okoli Integracija z Gitom, cevovodi za uvajanje in REST API-jiDelovne prostore Fabric je mogoče povezati z repozitoriji Git, tako da lahko več razvijalcev sodeluje pri istem projektu podatkovnega inženiringa, podatkovne znanosti ali analitike v realnem času brez prekrivanja dela.

Git in cevovodi za uvajanje omogočajo nadzorovano orkestrirajte življenjske cikle razvoja, testiranja in produkcijePromocija vsebine, sledenje spremembam, sinhronizacija artefaktov in upravljanje različic. Od marca 2025 ti cevovodi podpirajo (v splošnem ali predoglednem stanju) širok nabor vrst elementov, kot so sprožilci, nadzorne plošče, podatkovni tokovi, podatkovni cevovodi, podatkovne skladišča, skladišča podatkov, KQL, zvezki, oštevilčena poročila, organizacijske aplikacije itd.

Medtem Fabric razkriva zelo širok nabor REST API-jev s katerim lahko avtomatizirate skoraj vsako administrativno ali uvajalno nalogo: ustvarjanje delovnih prostorov in map, množično selitev elementov, upravljanje povezav in prehodov, ekstrahiranje definicij, aktiviranje cevovodov ali zvezkov, med drugim.

Ključne posodobitve na področju analitike, umetne inteligence in upravljanja za Microsoft Fabric

Razvoj Fabrica zaznamuje ogromno število predoglednih funkcij in novih zmogljivosti, ki Dotikajo se praktično vseh področij platformeNato so združeni in obravnavani na strukturiran način, tako da je mogoče videti celoten obseg.

Funkcije umetne inteligence v podatkovnem skladišču in multimodalne funkcije

Na področju relacijskih podatkov Fabric Data Warehouse vključuje Umetna inteligenca deluje neposredno v T-SQL (predogled). To omogoča:

- Razvrstite ali kategorizirajte besedilo.

- Analizirajte čustva.

- Iz prostega besedila izluščite strukturirane informacije.

- Prevajajte besedilo med jeziki.

- Pravilna slovnica.

Cilj je ta Za obogatitev podatkov z umetno inteligenco ni treba zapustiti konteksta SQL.Te funkcije so združene s splošno večmodalno podporo v funkcijah umetne inteligence Fabric, ki lahko zdaj obdelujejo slike (JPG/JPEG, PNG, GIF, WebP), PDF-je in običajne besedilne formate ter vnose v obliki poti datotek.

Pripomočki, kot so aifunc.load za vnašanje map v tabele Z možnostmi poziva in sheme vam `aifunc.list_file_paths` omogoča iteracijo po poteh datotek, `ai.infer_schema` pa sklepa na sheme, ki so združljive z `ai.extract`. Vse to vam omogoča preoblikovanje in obogatitev podatkov, ne da bi morali iz nič graditi zapletene cevovode.

OneLake, Delta, Apache Iceberg in dostop do več platform

Na plasti shranjevanja OneLake ostaja enotno jezero, kjer se nahaja celoten Fabric. Ena glavnih izboljšav je možnost Razkrivanje tabel Delta Lake kot tabel Apache Iceberg brez premikanja ali podvajanja podatkov, tako da lahko motorji, združljivi z Icebergom, neposredno berejo, kaj je na OneLakeu.

Poleg tega OneLake zdaj podpira Podatki Apache Iceberg, ki jih neposredno piše Snowflake, se uporabljajo v Fabricu prek dostopa brez kopiranjaTa strategija krepi interoperabilnost: Fabric ne želi biti silos, temveč podatkovno "vozlišče", ki ga lahko drugi motorji izkoristijo brez podvajanja shranjevanja.

Podobno priznava tudi OneLake bližnjice do shrambe Azure Blob StorageOneDrive in SharePoint ter razširja varnost z vlogami dostopa, varnostjo na ravni map, vrstic in stolpcev ter varnostnim modelom, ki ga lahko tretje osebe spoštujejo zaradi razširitve modela pooblaščenega mehanizma.

Posebej pomembna točka je federacija kataloga OneLake v Azure Databricks, ki omogoča Dostop brez kopiranja iz kataloga Unity do tabel OneLakeNa ta način OneLake ostaja vir resnice, vendar lahko Databricks neposredno poizveduje po podatkih in sinhronizira le metapodatke.

SQL Database on Fabric: zmogljivost, varnost in virtualizacija

Fabric-ova baza podatkov SQL pridobiva svoje lastne zmogljivosti: Možnosti SPREMENI NABOR ZBIRKE PODATKOVPodpora za primerjavo in indeksiranje celotnega besedila v predogledu. Na ravni zmogljivost baze podatkov Kar zadeva stroške, obstaja več izboljšav:

- Samodejno zbijanje indeksa za zmanjšanje shranjevanja, V/I in izboljšanje časov poizvedb brez načrtovanja vzdrževalnih opravil.

- Največja omejitev števila virtualnih jeder za nadzor uporabe računalniških virov (4 ali 32 vCore), zasnovanih tako, da preprečijo, da bi delovna obremenitev porabila preveč deljene zmogljivosti.

- Prilagojeni SQL bazeni ki skrbnikom delovnega prostora omogočajo natančen nadzor nad dodeljevanjem virov in usmerjanjem poizvedb po imenu aplikacije.

Omogočeno je tudi Virtualizacija podatkov v zbirki podatkov SQL, ki omogoča poizvedovanje po zunanjih podatkih, shranjenih v OneLakeu, s T-SQL, združevanje datotek v običajnih formatih z lokalnimi relacijskimi tabelami z uporabo združevanj, ne da bi bilo treba podatke fizično uvoziti.

Kar zadeva varnost, baza podatkov SQL podpira Zasebna povezava na ravni najemnika (predogled)To olajša zasebno in nadzorovano usmerjanje podatkovnega prometa, saj se integrira s celotno konfiguracijo varnega omrežja Fabric.

Obveščanje v realnem času, Eventhouse, Eventstream in Activator

Modul za obveščanje v realnem času (RTI) je postal ena ključnih prednosti podjetja Fabric. Eventhouse in Eventstream se združujeta v vnašati, obdelovati in sprožati dogodke v realnem času iz vseh vrst virov, Activator pa orkestrira dejanja, ki se sprožijo pod določenimi pogoji.

Med najmočnejšimi novimi funkcijami so:

- Zaznavanje anomalij brez kode z avtomatsko izbiro modela, preprostim vmesnikom in prilagodljivimi opozorili.

- Poslovni dogodki, ki zajemajo ključne poslovne trenutke, ustvarjene iz funkcij uporabniških podatkov in zvezkov, ter vam omogočajo aktiviranje opozoril, logike po meri, tokov, modelov umetne inteligence ali opravil Spark.

- Integracija funkcij aktivatorja in uporabniških podatkovtako da lahko funkcije, ustvarjene v Fabricu, obdelujejo dogodke iz katerega koli vira, vključno z notranjimi dogodki iz same platforme in iz OneLake.

- Zmožnost obdelave dogodkov s SQL-om (operator SQL v Eventstream-u), kar omogoča transformacijo tokov v realnem času z znano sintakso SQL.

Dodani so ustrezni konektorji, kot so Kribl (za vnos dnevnikov in telemetrije iz več virov), povezovalnik s Solace PubSub+ in podpora za pretakanje prek zasebnih omrežij prek Azure Virtual Network, VPN, ExpressRoute ali zasebnih končnih točk.

Za podatkovne sheme in pogodbe Eventstream uvaja Register shem ki definira in potrjuje sheme dogodkov za robustnejše cevovode ter podpira register shem Confluent za povezavo s Kafko v Confluent Cloudu ob spoštovanju obstoječih pogodb.

Zmogljivosti Copilota in umetne inteligence na celotni platformi

Copilot v Fabricu je zdaj na voljo po vsem svetu, s prisotnostjo v Power BI, tovarna podatkov, podatkovna znanost in podatkovno inženirstvo ter pisanje poizvedb KQLPoleg tega so bile vključene posebne zmogljivosti:

- Copilot za Dataflow Gen2 (Modern Get Data), ki pomaga pri vnosu in preoblikovanju podatkov z navodili v naravnem jeziku.

- Copilot za podatkovno skladišče (klepet), dostopen prek gumba na traku za pospešitev skladiščnih opravil prek pogovornega okna.

- Končna točka Copilot za analitiko SQL, ki generira in optimizira poizvedbe SQL iz opisov podjetij.

- Kopilot na prenosnikih s poznavanjem konteksta delovnega prostora, jezernega okolja, strukture zvezkov in izvajalnega okolja, sposoben ustvarjati večstopenjsko kodo, refaktorirati, povzeti kompleksne zvezke in diagnosticirati napake z možnostjo »Popravi s Copilotom«.

- Samodokončanje v vrstici (dokončanje kode v vrstici) in dokončanje kode v vrstici Notebook Copilot (predogled), da bi Python pisali hitreje in z manj napakami.

Poleg tega se baza tehnologije umetne inteligence širi z integrirana vnaprej izdelana orodja za livarne (Azure OpenAI, Azure Language, Azure Translator), vtičniki OpenAI za Eventhouse (ai_embed_text in ai_chat_completion) ter vrsta agentov in podatkovnih agentov, ki omogočajo drugim aplikacijam, vključno s Copilot Studio, orkestrirano delo s podatki Fabric.

Agenti podatkov Fabric, MCP in orodja za razvijalce

Predstavitev tkanine podatkovni agenti, ki so sposobni orkestrirati dostop do podatkov in orodij Za agente umetne inteligence, s kompletom za razvoj programske opreme Python in neposredno integracijo z Microsoft Copilot Studio. To olajša izdelavo pogovornih pomočnikov, ki delajo z upravljanimi poslovnimi podatki v okolju Fabric.

Vzporedno s tem Model Context Protocol (MCP) Postane ključna komponenta integracije med agenti umetne inteligence in storitvami Fabric. Na voljo so namenski strežniki MCP za Activator in Eventhouse ter razvojno usmerjen Fabric MCP, ki:

- Omogoča pomočnikom umetne inteligence ustvarjanje kode in vsebine za izdelke Fabric.

- Integrira se z razvojnimi orodji, kot sta VS Code in GitHub Codespaces.

- Predstavlja orodja za svetovanje in ukrepanje na podlagi podatkov v realnem času v Eventhouseu.

Za vsakodnevno delo razvijalca je treba izpostaviti več ključnih delov, vključno z razvojno okolje: Razširitev MSSQL za VS Code s podporo za bazo podatkov Fabric SQL, gonilnik Microsoft ADO.NET in gonilnik ODBC za Fabric Data Engineering (povezava s Spark SQL prek Livyja) ter priključek Spark za baze podatkov SQL, ki poenostavlja overjen dostop iz Spark do baz podatkov SQL v Azure in Fabric.

Pojavi se tudi CLI tkanine, ki je na voljo kot integrirana naloga v storitvi Azure DevOps in omogoča avtomatizacijo upravljanja delovnih prostorov, elementov in uvajanj brez ročne namestitve zunanjih orodij.

Tovarna podatkov, migracije podatkov in orkestracija v Fabricu

Fabric-ova plast integracije podatkov se opira na Data Factory in Dataflow Gen2, ki sprejemata funkcije za ... Orkestracija bo pametnejša, bolj avtomatizirana in z enostavnejšimi migracijami. z obstoječih platform.

Dataflow Gen2: zmogljivost, javni API-ji in diagnostika

V Dataflow Gen2 najdemo v predogledni različici več funkcij:

- Napredno urejanje ciljnih poizvedb za prilagoditev logike na cilju neposredno iz samega avtorskega okolja.

- Razdeljeno računanjekar omogoča vzporedno delovanje delov podatkovnega toka, s čimer se skrajša skupni čas ocenjevanja.

- Prenesi diagnostiko na ravni izvedbe, s strukturiranimi paketi dnevnikov za analizo učinkovitosti delovanja in reševanje incidentov.

- Javni API-ji za programsko ustvarjanje, posodabljanje, brisanje, razporejanje in spremljanje podatkovnih tokov.

- Javni parametri s podporo CI/CDki omogočajo osveževanje podatkovnih tokov s posredovanjem vrednosti iz cevovodov ali drugih virov.

- Nedavni podatki za hiter dostop do nedavno uporabljenih elementov na traku Power Query in v funkciji Modern Get Data.

Vse to dopolnjujejo zmogljivosti Programsko ovrednotenje Power Queryja prek REST-aTo odpira vrata izvajanju skriptov M kot dela avtomatiziranih procesov, njihovi integraciji s Sparkom, cevovodi ali zunanjimi orodji, pri čemer se izkoriščajo prednosti povezovalnikov Power Query.

Tovarna podatkov: prilagodljiva zmogljivost, povezljivost in DBT

V bolj "klasičnem" delu integracije Data Factory znotraj Fabrica uvaja:

- Prilagodljivo uglaševanje zmogljivosti za kopiranje, ki inteligentno prilagaja parametre delovanja glede na konfiguracijo in kontekst izvajanja.

- Podpora za zajem podatkov o spremembah (CDC) v opravilu kopiranja, da se neprekinjeno podvajajo samo spremembe (vstavljanja, posodabljanja, brisanja).

- Lokalni prehodi z možnostjo ročne nadgradnje upravljano prek portala Fabric, API-ja ali skriptov.

- nedavna povezava, ki povezavam doda lastnosti zadnje uporabe za lažje revidiranje in upravljanje življenjskega cikla.

- izvorno delo DBT, ki omogoča izvajanje projektov DBT znotraj Fabrica z integrirano orkestracijo, testiranjem, dokumentacijo in upravljanjem.

- Klic dejavnosti paketa SSIS v cevovodih, za zagon paketov SSIS iz same orkestracije v Fabricu.

Uporabniška izkušnja je izboljšana tudi z Izbirnik spletnega mesta SharePoint (SharePoint Site Picker), ki preprečuje ročno vnašanje URL-jev, in s podporo MCP za tovarno podatkov, tako da lahko pomočniki umetne inteligence ustvarijo in uvedejo Dataflow Gen2 preprosto iz navodil v naravnem jeziku.

Orodja za migracijo in replikacijo podatkov

Microsoft močno spodbuja selitev na Fabric z več specifičnimi orodji:

- Ocena migracije Fabric za Data Factory, ki analizira pripravo cevovodov ADF in podprte preseli v delovni prostor Fabric s preslikavo povezav.

- Pomočnik za migracijo za podatkovno skladiščeki se lahko zdaj neposredno poveže z izvornim skladiščem in ga premakne v podatkovno skladišče Fabric.

- Pomočnik za migracijo za bazo podatkov SQL, namenjen selitvi delovnih obremenitev lokalnega strežnika SQL Server, z uvozom shem prek DACPAC, zaznavanjem nezdružljivosti in priporočili.

Kar zadeva replikacijo, je zagotovljena podpora zrcaljenje več operativnih virov (Azure Database za MySQL, Google BigQuery, SQL Server itd.) v Fabric, z možnostjo nadzora nad tem, katere tabele se replicirajo, ponovnega zagona procesov zrcaljenja prek REST in, v primeru Databricksa, preslikave pravilnikov kataloga Unity na varnost OneLake.

Vključen je tudi replikacijski konektor iz Lakehousea z uporabo Vir podatkov o spremembah delte, ki omogoča spremembe plošč Lakehouse Delta v smeri združljivih destinacij, ne da bi bilo treba s pomočjo domačih rešitev CDC-ja znova izumljati kolo.

Varnost, napredno upravljanje in spremljanje v storitvi Fabric

Ena največjih skrbi pri kateri koli analitični platformi je, kako zavarovati podatke, upravljati porabo in spremljati porabo virovTkanina na teh področjih hitro dozoreva.

Varnost in zaščita podatkov pri OneLake

OneLake dodaja celoten model varnost dostopa do podatkov z:

- Vloge za dostop do podatkov za Lakehouse z nastavljivimi dovoljenji iz varnostnega vmesnika, ki temelji na mapah.

- Varnostna podpora za bližnjice, da lahko tretje osebe spoštujejo določene pravilnike.

- API za varnost dostopa do podatkov OneLake, ki omogoča avtomatizirano upravljanje dovoljenj.

- Razširitev modela na zunanje iskalnike (varnostna avtorizacija OneLake za tretje osebe).

Vzporedno se zaščita širi z Omejevanje dostopa DLP nad vsemi strukturiranimi podatki v OneLake (SQL, KQL, skladišča) in je uveden DSPM za umetno inteligenco za Fabric Copilots in podatkovne agente, ki spremlja interakcije umetne inteligence za občutljive informacije in tvegano vedenje, z integracijo s Purview Audit in eDiscovery.

Kar zadeva identiteto, se pojavijo značilnosti, kot so naslednje: identitete, povezane s predmeti (na primer Lakehouse in Eventstream) prek REST API-jev, ki odpravljajo odvisnost lastnika za določene operacije, in preverjanje pristnosti bližnjic OneDrive in SharePoint z uporabo identitet delovnega prostora ali principalov storitev.

Centralizirano upravljanje in katalog OneLake

Izkušnje z upravljanjem podatkov so okrepljene z nova centralizirana plošča v katalogu OneLakekjer si lahko lastniki podatkov ogledajo združeni pogled na elemente, ki so jih ustvarili, prejmejo priporočila za ukrepe upravljanja in dostopajo do vseh razpoložljivih orodij za izboljšanje varnosti in skladnosti s predpisi.

Poleg tega, a API za iskanje po katalogu OneLake skupaj z orodjem MCP, ki omogoča odkrivanje elementov v okolju Fabric iz kode ali agentov umetne inteligence v enem samem klicu, pri čemer se upoštevajo dovoljenja kataloga in metapodatki.

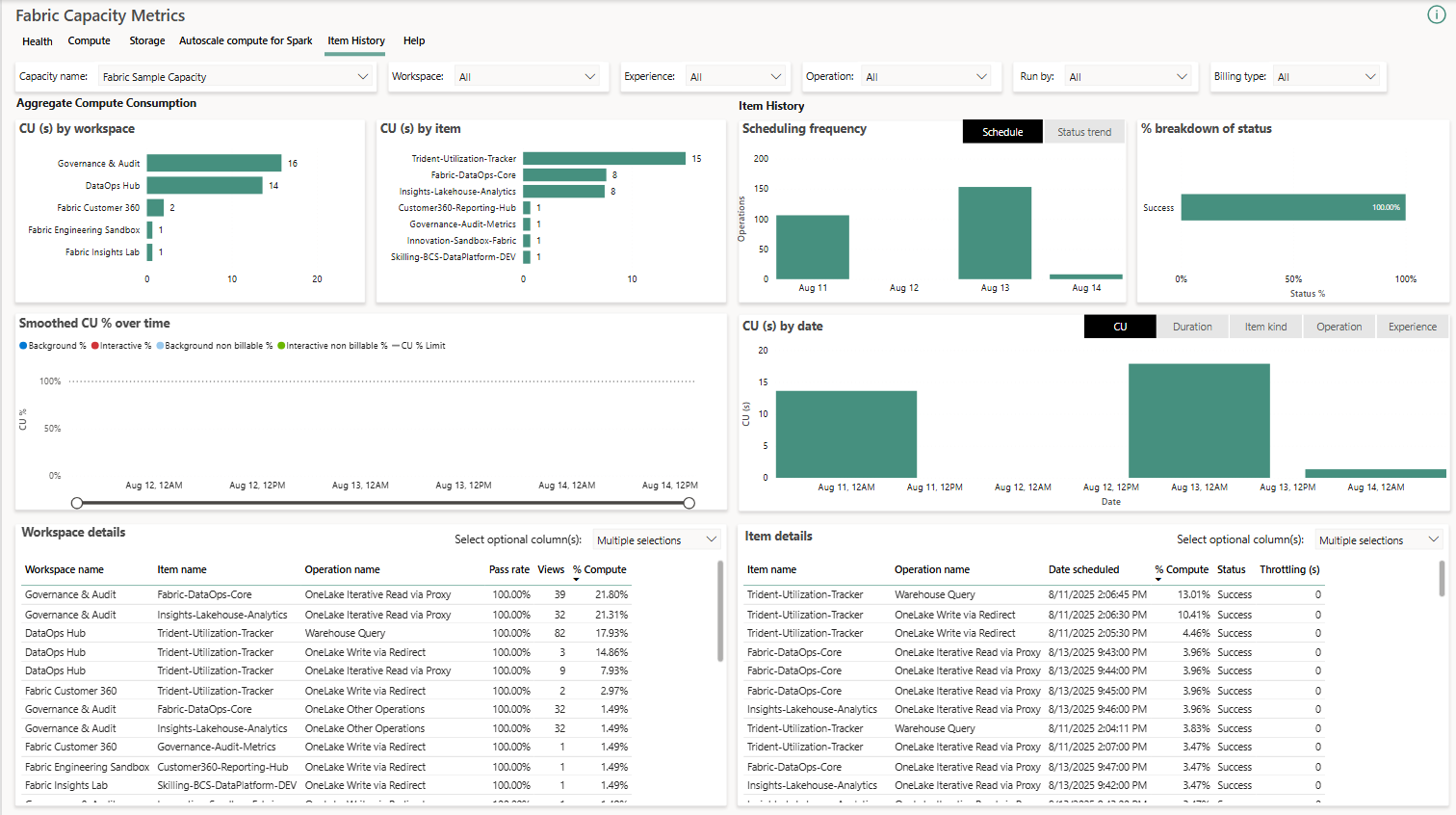

Spremljanje zmogljivosti, porabe in dela

Tkanina zagotavlja več plasti opaznosti:

- Spremljanje delovnega prostora, ki v storitvi Fabric ustvari bazo podatkov, kjer so združeni dnevniki in metrike iz več elementov (vključno z opravili kopiranja s podrobnim spremljanjem).

- Spremljanje delovnega prostora za opravilo kopiranjaz metrikami, kot so prepustnost, količina podatkov, kode napak in časi, vse usmerjene v centralizirano analizo.

- Zgodovina elementov pri uporabi metrik zmogljivosti, s 30-dnevnimi pogledi na porabo CU za vsak element, ki jih je mogoče filtrirati po delovnem prostoru in vrsti.

- Prenapetostna zaščita na ravni delovnega prostoraki omogoča nastavitev pragov porabe na delovni prostor v 24-urnem tekočem oknu, samodejno blokiranje tistih, ki jih presežejo, in označevanje delovnih prostorov kot »kritičnih«, da se izključijo iz omejitev.

Kot dopolnitev tega je bil pripravljen začetni niz API-ji za skrbnike Fabric osredotočeno na odkrivanje delovnih prostorov, predmetov in podrobnosti o dostopu uporabnikov, omogočanje dinamičnih popisov in periodičnih kontrol dostopa.

Poslovno modeliranje, načrtovanje in nove delovne obremenitve

Poleg tehnične ravni Microsoft uvaja nove poslovno usmerjene delovne obremenitve o Fabricu. Eden najvidnejših je Fabric IQ, ki si prizadeva poenotiti poslovno semantiko, podatke in modele za inteligentne agente, ki sprejemajo odločitve na podlagi celostnega pogleda na organizacijo.

Znotraj Fabric IQ se prikaže naslednje:

- Ontologija (predogled), vrsta postavke, kjer so entitete, odnosi, lastnosti in omejitve definirane v skladu s poslovnim jezikom podjetja.

- Načrt (predogled), platforma brez kode za načrtovanje, poročanje, analitiko, integracijo in skupno upravljanje.

Pojavlja se tudi obveščevalni sistem v realnem času graditelj digitalnih dvojčkov, izdelek, specializiran za modeliranje digitalnih dvojčkov na podlagi podatkov v realnem času, s ciljem optimizacije fizičnih operacij, spremljanja stanj in simuliranja scenarijev.

Po drugi strani pa je predstavljen Delovna obremenitev Fabric IQ kot ločena delovna obremenitev, podporna orodja za upravljanje in semantično usklajevanje pa se še naprej širijo, s čimer se zapira krog med podatkovnimi modeli, poslovno logiko in aplikacijami za umetno inteligenco/analitiko.

Izboljšave zmogljivosti, uporabniške izkušnje in produktivnosti

Za zaključek tega pregleda je treba izpostaviti številne medsektorske izboljšave, ki Ne pridejo vedno v naslovnice, vendar močno vplivajo na vsakdanje življenje. ekip.

V razdelku Spark in porazdeljeno računalništvo Fabric predstavlja:

- Fabric Runtime 2.0 (predogled) z Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 in Python 3.12 na Azure Linux 3.0.

- Orodje za primerjavo aplikacij Sparkkar vam omogoča, da vzporedno izberete in primerjate do štiri izvedbe Spark.

- Diagnostični oddajnik isker, ki zbira dnevnike, metrike in dogodke iz aplikacij Spark ter jih pošilja na cilje, kot so središča dogodkov, shramba ali analitika dnevnikov.

- Knjižnica diagnostike JobInsight, knjižnica za analizo zaključenih izvedb Spark prek API-jev (poizvedbe, opravila, faze, naloge, izvajalci, dnevniki dogodkov).

V sloju skladišča so dodani naslednji elementi: združevanje podatkov v gruče Za izboljšanje zmogljivosti in zmanjšanje stroškov dostopa, stolpci IDENTITY za nadomestne ključe ter nadzor različic in podpora CI/CD prek projektov SQL Database v VS Code (nadzor izvorne kode Warehouse).

Uporabniška izkušnja portala Fabric se prav tako razvija z Brskanje z zavihki in raziskovalec objektovTo vam omogoča, da hkrati odprete več elementov in hitro preklapljate med njimi. To v kombinaciji z izboljšavami, kot sta samodejno vezanje Lakehouse v Gitu in nabor pripomočkov za vzdrževanje Lakehouse (vzdrževalne dejavnosti in osvežitev končnih točk SQL), prispeva k uporabniku prijaznejši in agilnejši platformi.

Nenazadnje, funkcije, kot so Množični uvoz/izvoz definicij elementov (za migracije, predloge in varnostne kopije metapodatkov), REST za mape, podpora parametrov pri aktivacijah elementov iz Activatorja in nalaganje podatkov OneLake v Excelu z integriranim katalogom dopolnjujejo ekosistem, ki začenja pokrivati praktično vse običajne potrebe sodobne podatkovne ekipe.

S celotnim naborom zmogljivosti – od centraliziranega upravljanja, granularne varnosti in inteligentne orkestracije do umetne inteligence, vgrajene v SQL, analitike v realnem času, digitalnih dvojčkov in agentov MCP – Microsoft Fabric utrjuje svoj položaj celovite podatkovne platforme, kjer Ključ ni več le shranjevanje in vizualizacija podatkov, temveč upravljanje, avtomatizacija in izkoriščanje umetne inteligence za nadzor vsakega dela življenjskega cikla podatkov.kar organizacijam omogoča postopno razvijanje svojih arhitektur, migracijo obstoječega in omogočanje novih rešitev veliko hitreje kot pri tradicionalnih pristopih.

Vsebina

- Microsoft Fabric in ogrodje za uvedbo v oblak: upravljanje, stroški in avtomatizacija

- Ključne posodobitve na področju analitike, umetne inteligence in upravljanja za Microsoft Fabric

- Funkcije umetne inteligence v podatkovnem skladišču in multimodalne funkcije

- OneLake, Delta, Apache Iceberg in dostop do več platform

- SQL Database on Fabric: zmogljivost, varnost in virtualizacija

- Obveščanje v realnem času, Eventhouse, Eventstream in Activator

- Zmogljivosti Copilota in umetne inteligence na celotni platformi

- Agenti podatkov Fabric, MCP in orodja za razvijalce

- Tovarna podatkov, migracije podatkov in orkestracija v Fabricu

- Varnost, napredno upravljanje in spremljanje v storitvi Fabric

- Poslovno modeliranje, načrtovanje in nove delovne obremenitve

- Izboljšave zmogljivosti, uporabniške izkušnje in produktivnosti