- ChatGPT comete fallos estructurales en razonamiento, datos y sentido común, pese a su apariencia “inteligente”.

- Los errores derivan del modo de entrenamiento estadístico, los sesgos de datos y la falta de comprensión real.

- Muchas profesiones y tareas educativas cambiarán, pero la IA actuará sobre todo como asistente, no como sustituta total.

- Usar ChatGPT con verificación de fuentes, buenos prompts y revisión humana permite aprovecharlo sin asumir riesgos excesivos.

La inteligencia artificial generativa se ha colado en nuestro día a día, y ChatGPT se ha convertido en la herramienta estrella para escribir, resumir, programar o buscar ideas. Sin embargo, por muy impresionante que parezca, está lejos de ser perfecta. Confiar ciegamente en sus respuestas puede darte más de un susto si no conoces bien dónde cojea.

Por eso, cada vez más expertos insisten en que entender las tareas donde ChatGPT falla es casi tan importante como saber usarlo. No se trata de demonizar la tecnología, sino de aprender a convivir con sus límites: cuándo es fiable, cuándo hay que coger sus respuestas con pinzas y cómo aprovecharla sin perder el juicio crítico humano.

Por qué es clave conocer las limitaciones de ChatGPT

Detrás de la interfaz del chat hay un sistema complejo que combina grandes modelos de lenguaje con mecanismos internos que priorizan velocidad o razonamiento según la pregunta. Esta “decisión” automática no siempre coincide con lo que el usuario necesita: a veces prima contestar rápido aunque el problema exija pensar paso a paso. Puedes profundizar en cómo los parámetros de la inteligencia artificial influyen en ese comportamiento.

Además, el comportamiento del modelo cambia con cada actualización, lo que hace que ChatGPT pueda responder de forma distinta a la misma consulta en momentos diferentes. A eso se suman límites de contexto en conversaciones largas, donde empieza a “olvidar” partes del hilo, y filtros de seguridad que bloquean temas sensibles o perfectamente legítimos por exceso de prudencia.

Este cóctel de factores provoca que, en la práctica, la experiencia de uso oscile entre lo brillante y lo frustrante en cuestión de segundos. La diferencia entre un resultado útil y uno desastroso suele estar en si el usuario sabe detectar cuándo la IA está saliéndose de la pista y cómo reconducirla.

Varios estudios y encuestas recientes muestran que una parte importante de los usuarios no termina de fiarse de las respuestas de ChatGPT. En una encuesta de la OCU, muchas personas señalaban la “falta de confianza” en la información generada como principal motivo para no usarlo a diario, a pesar de haberlo probado.

En consecuencia, especialistas en inteligencia artificial y en educación recomiendan usar ChatGPT como una fuente adicional y nunca como árbitro definitivo de la verdad. Validar datos con otras fuentes, tener conocimientos mínimos del tema y asumir que puede inventarse información (las famosas “alucinaciones”) es, hoy por hoy, obligatorio.

Errores frecuentes y limitaciones técnicas de ChatGPT

En la literatura técnica se ha documentado que estos sistemas tienden a alucinar respuestas verosímiles pero falsas, sobre todo cuando la pregunta es ambigua, muy específica o se aparta de los datos que vieron durante el entrenamiento. El problema es que la forma de redactar es tan convincente que resulta difícil detectar el error si el usuario no domina el tema. Herramientas como extensiones para detectar contenido generado por IA pueden ayudar a identificar algunas de esas alucinaciones.

Expertos como el profesor Josep Curto subrayan que algunos de los fallos más comunes son de calado profundo y afectan a la fiabilidad global del sistema. Entre ellos menciona descripciones erróneas de hechos verificables, respuestas incompletas, explicaciones inventadas del “proceso de razonamiento” del modelo y un comportamiento menos preciso en idiomas distintos del inglés.

Además, aunque se van introduciendo mejoras, las restricciones éticas y de seguridad no siempre están bien calibradas. En ocasiones bloquean solicitudes legítimas mientras permiten otras problemáticas, o producen respuestas cargadas de sesgos heredados de los datos de entrenamiento, tanto culturales como políticos o de género.

Pese a todo, investigaciones continuas en aprendizaje profundo y procesamiento del lenguaje natural han logrado que las versiones más recientes, como GPT‑4, alcancen rendimientos cercanos al humano en tareas complejas de matemáticas, programación, derecho, medicina o psicología. Pero rendimiento alto no significa infalibilidad, y los puntos ciegos siguen ahí.

7 tareas donde ChatGPT falla (o es poco fiable)

Aunque ChatGPT puede ser muy útil en muchas situaciones, hay ciertos tipos de tareas donde la probabilidad de obtener una respuesta incorrecta, sesgada o engañosa aumenta considerablemente. Conviene conocer bien estos escenarios para extremar la precaución.

1. Razonamiento lógico y matemáticas complejas

Cuando el problema exige cálculos encadenados, demostraciones lógicas o pruebas matemáticas formales, ChatGPT suele patinar. Puede equivocarse en operaciones sencillas, saltarse pasos clave o presentar como correctos resultados directamente erróneos.

Esto se nota especialmente en ejercicios con muchos pasos intermedios, combinatoria, probabilidad, álgebra avanzada o geometría. Aunque el texto parezca bien argumentado, pequeños deslices en un paso arrastran todo el resultado, y el modelo no tiene forma de “revisar” de verdad su propio razonamiento.

2. Sentido común, intuición y contexto humano

La IA interpreta lo que se le dice de forma literal, de modo que captar ironías, dobles sentidos, sarcasmos o referencias culturales muy localizadas le resulta complicado. Esto da lugar a respuestas que, para un humano, son claramente “fuera de lugar”.

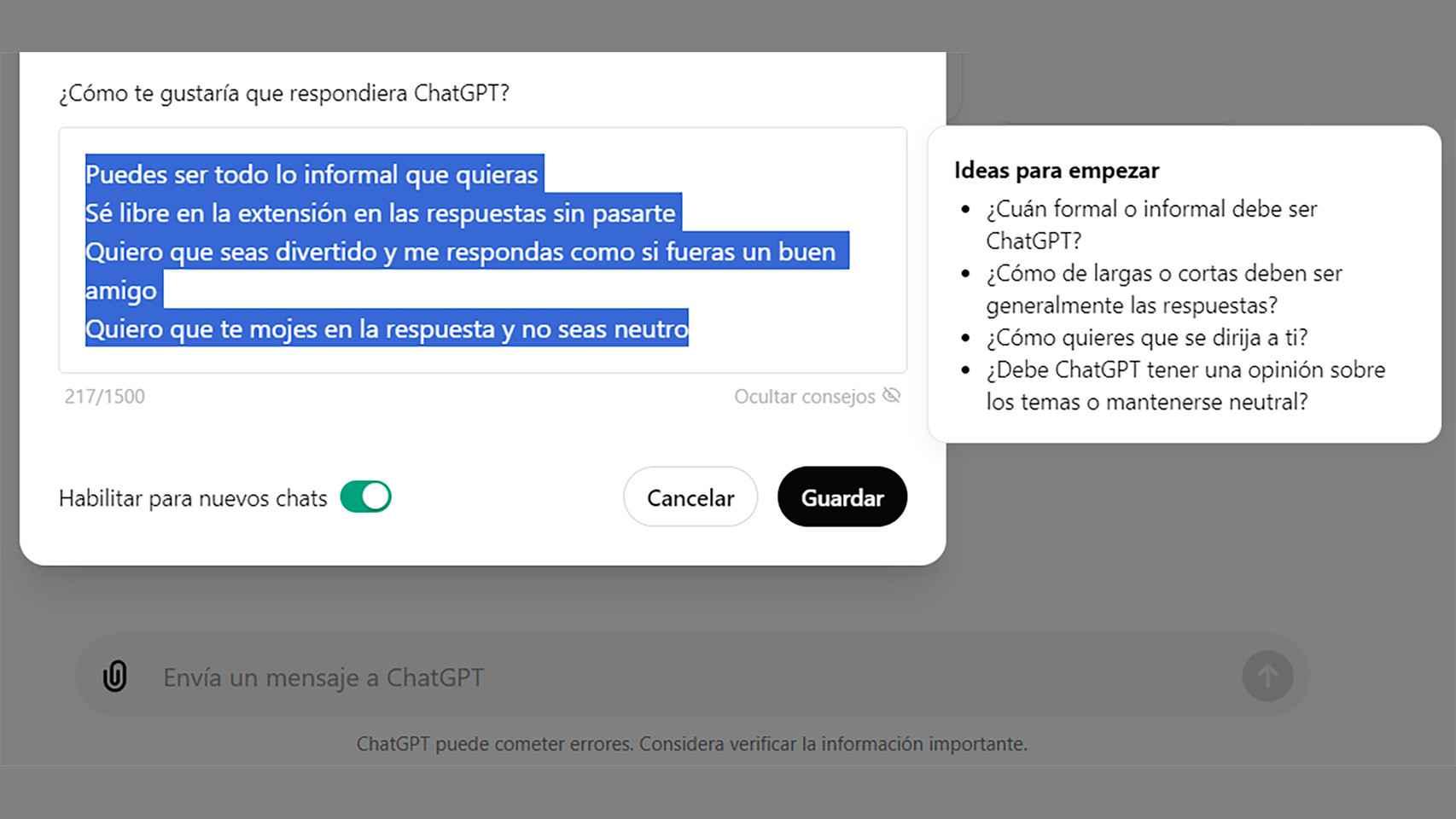

Cuando la tarea exige empatía genuina, comprensión emocional profunda o conocimiento práctico del mundo real, el modelo se limita a imitar patrones de lenguaje, pero sin vivencias propias. Puede sonar empático, pero no siente nada ni percibe situaciones como lo haría una persona. Para mejorar el tono y adaptar respuestas conviene personalizar ChatGPT y ajustar estilos y roles.

3. Memoria de largo plazo y continuidad de proyectos

Aunque parezca que “recuerda” la conversación, ChatGPT tiene un contexto limitado y puede perder partes del historial sin aviso. Conversaciones muy largas o proyectos que se alargan en el tiempo terminan sufriendo cortes de memoria.

Esto afecta directamente a tareas como redacción de libros, informes extensos o proyectos de programación de varias sesiones. Si no se guarda y gestiona el contenido externamente, se corre el riesgo de perder consistencia, repetir decisiones ya tomadas o contradecirse sin que el modelo sea consciente.

4. Supuesto ahorro de tiempo que sale caro

Mucha gente acude a ChatGPT para ir más rápido, pero cuando las respuestas contienen errores sutiles o falta información clave, revisar y corregir puede llevar más tiempo que hacerlo desde cero. Esto se nota mucho en tareas profesionales que requieren un estándar alto de calidad.

En ámbitos como informes técnicos, documentación legal, contenidos académicos o código de producción, el tiempo extra invertido en verificación puede hacer que el supuesto beneficio de usar la IA se diluya por completo si no se tiene un proceso riguroso de revisión.

5. Datos desactualizados y falta de conexión en tiempo real

Los modelos como GPT‑3 o GPT‑4 se entrenan con un corte temporal de datos, por lo que no tienen acceso directo a la web para consultar información en tiempo real. Dependiendo de la versión, su conocimiento puede detenerse en un año concreto.

Esto implica que, en temas de actualidad, cambios legislativos recientes, novedades científicas o noticias de última hora, las respuestas pueden estar obsoletas o ser directamente falsas. Si el usuario no contrasta con fuentes actualizadas, el error pasa desapercibido.

6. Rendimiento variable y saturación

En momentos de alta demanda, especialmente en cuentas gratuitas, la calidad y la velocidad de las respuestas pueden verse afectadas. El modelo puede contestar con menos detalle, cortar las respuestas antes de tiempo o dar soluciones más superficiales.

Esta variabilidad hace que no siempre sea un sustituto fiable para tareas críticas con plazos estrictos. Depender totalmente del servicio en horas punta sin un plan B puede convertirse en un riesgo operativo para empresas y profesionales.

7. Restricciones, filtros y sesgos

Por motivos de seguridad, ChatGPT incluye filtros para evitar contenidos dañinos, ilegales o extremadamente sensibles. El problema es que estos sistemas de moderación no son perfectos y, a veces, bloquean solicitudes legítimas o responden de forma vaga por exceso de prudencia.

Aun así, diversos investigadores han mostrado que los modelos pueden seguir generando respuestas con sesgos racistas, sexistas o ideológicos, reflejando los prejuicios presentes en los datos de entrenamiento. Se han documentado casos de bots entrenados con técnicas similares que terminan produciendo contenidos discriminatorios. La evaluación ética de chatbots ayuda a entender y mitigar estos sesgos.

Errores de fondo: por qué ChatGPT se equivoca tanto

Al analizar estos fallos, filósofos de la mente y expertos en IA apuntan a límites estructurales: ChatGPT no piensa, ni entiende, ni tiene conciencia de lo que dice. Su aparente inteligencia emerge de correlaciones estadísticas a gran escala, no de razonamiento auténtico.

El profesor Ned Block, por ejemplo, ha señalado experimentos con modelos generativos de imagen en los que se pide dibujar un reloj marcando horas como las 12:03 o las 6:28 y casi siempre aparece un reloj a las 10:10. Esa hora domina en las fotos publicitarias de Internet porque es estéticamente atractiva y no tapa el logotipo.

Este comportamiento ilustra cómo los modelos tienden a replicar los patrones más frecuentes de sus datos de entrenamiento, aunque contradigan la instrucción concreta. No “entienden” la noción de hora: solo repiten la configuración estadísticamente más común.

Algo parecido ocurre cuando se pide una imagen de una persona escribiendo con la mano izquierda. Muchos modelos acaban generando sistemáticamente diestros, porque la mayoría de ejemplos en los datos también lo son. Conseguir un zurdo bien representado requiere insistir con prompts muy específicos y aun así no siempre sale bien.

Este tipo de fallos estructurales hace que ni siquiera los desarrolladores consigan corregir del todo algunos sesgos profundamente arraigados. El entrenamiento por refuerzo con feedback humano ayuda, pero reforzar manualmente todos los casos posibles (todas las horas del reloj, todas las posturas de escritura, etc.) es inviable.

En el plano textual, el problema se traduce en explicaciones demasiado seguras de cosas que el modelo realmente no “sabe”. Puede detallar paso a paso un supuesto método que jamás ha ejecutado o inventar referencias académicas y enlaces con un aire totalmente convincente.

Cómo se entrenó ChatGPT y por qué eso influye en sus fallos

Modelos como GPT‑3 y GPT‑4 se basan en la arquitectura Transformer, y se han entrenado con cantidades masivas de texto procedente de Internet: páginas web, libros, artículos científicos, noticias y otros recursos públicos como Wikipedia o Common Crawl.

El proceso tiene dos grandes fases. Primero, un preentrenamiento masivo en el que el modelo aprende a predecir la siguiente palabra en millones de frases. En esta etapa no se le enseña “gramática” explícita, sino que deduce patrones al rellenar huecos en el texto, una especie de ejercicio gigante de completar palabras.

Después se realiza un ajuste fino para tareas concretas, como traducción, resumen, respuesta a preguntas o diálogo conversacional. Aquí entran en juego datos más pequeños y específicos, etiquetados para enseñar al modelo qué tipo de respuesta se considera adecuada en cada contexto.

En el caso de ChatGPT, también se ha usado aprendizaje por refuerzo con retroalimentación humana (RLHF). Entrenadores humanos evaluaban varias posibles respuestas del modelo a una misma entrada y las ordenaban de mejor a peor. Con esa información, el sistema aprendía a preferir las salidas mejor valoradas.

Este enfoque mejora la calidad percibida de las respuestas, pero no elimina el problema de fondo: el modelo sigue sin tener comprensión semántica ni acceso directo a la realidad. Solo afina sus probabilidades para sonar más útil, educado y seguro, lo que a veces hace todavía más peligrosas las alucinaciones.

Además, aunque se aplican técnicas de limpieza de datos, regularización y evaluación humana para reducir sesgos y estereotipos presentes en los textos de entrenamiento, es imposible filtrarlos por completo. Por eso las empresas recomiendan supervisar de forma continua las salidas, sobre todo en aplicaciones sensibles.

Impacto de ChatGPT en estudios y mundo laboral

Desde su lanzamiento, ChatGPT ha reavivado el debate sobre cómo afectará la IA generativa a los trabajos humanos y al sistema educativo. Grandes tecnológicas lo presentan como “copiloto” o asistente, pero muchos estudios apuntan a transformaciones profundas en numerosas profesiones.

Investigaciones de universidades como la de Nueva York o Pensilvania, junto con análisis de OpenAI y otras entidades, muestran que tareas basadas en lenguaje (escritura, traducción, análisis de textos, documentación, contabilidad básica) son especialmente vulnerables a la automatización parcial.

En el mercado laboral, se han identificado como especialmente expuestos teleoperadores de ventas, profesores universitarios de idiomas y literatura, docentes de historia o derecho, traductores, administrativos y ciertos perfiles de redacción. No significa que todos vayan a desaparecer, pero sí que buena parte de sus funciones podrá apoyarse fuertemente en la IA.

Otros estudios encuentran efectos positivos claros. En pruebas con desarrolladores de software, por ejemplo, quienes usaban asistentes de codificación basados en modelos similares completaban las tareas hasta un 55 % más rápido que quienes trabajaban sin ayuda. La productividad en tareas rutinarias aumenta, lo que permite dedicar más tiempo a problemas complejos.

En educación, el debate está especialmente caliente. Hay experiencias que muestran que es cada vez más difícil distinguir si un ensayo corto lo ha escrito un estudiante o ChatGPT, incluso para docentes experimentados y autores profesionales. En algunos experimentos, profesores y expertos fallaban al identificar al verdadero autor.

Ante esto, muchos educadores empiezan a plantear más evaluación oral, trabajos en clase y actividades donde se vea el proceso de pensamiento del alumno, no solo el producto final. Otros proponen usar ChatGPT como herramienta didáctica: punto de partida que el estudiante debe criticar, corregir, comparar con fuentes reales y mejorar.

Buenas prácticas para usar ChatGPT sin caer en sus trampas

A pesar de todos estos problemas, ChatGPT es extremadamente útil si se le da el rol adecuado. La clave está en combinar un buen diseño de prompts con un control humano riguroso de lo que genera, especialmente cuando hay implicaciones académicas, legales o profesionales.

Una primera recomendación básica es verificar siempre datos, cifras, referencias y nombres propios antes de utilizarlos. No basta con que “suene bien”: hay que comprobar con fuentes fiables (artículos científicos, legislación oficial, libros de referencia, bases de datos especializadas, etc.).

También conviene no basar decisiones críticas en una única respuesta del modelo. Cuando el asunto es importante, lo prudente es contrastar varias opiniones (otras herramientas, expertos humanos, documentación) y usar el chat solo como apoyo o generador de borradores.

El diseño de las instrucciones influye muchísimo: prompts claros, específicos y bien estructurados reducen la ambigüedad y suelen producir salidas más útiles. Pedir que explique su razonamiento paso a paso, que incluya contraejemplos o que señale posibles limitaciones puede ayudar a detectar errores.

Por último, resulta muy potente usar ChatGPT como generador de plantillas, esquemas, borradores y listas de ideas sobre las que luego trabaja la persona, en lugar de aceptar sin más el texto final. De ese modo, se ahorra tiempo en la parte más mecánica, pero el contenido final sigue siendo reelaborado y validado por un humano.

La experiencia de los últimos años muestra que la inteligencia artificial generativa funciona mejor cuando la tratamos como asistente potente pero falible. Con algo de espíritu crítico, buen criterio para escoger tareas y un sistema serio de revisión, se convierte en una aliada valiosa en lugar de un riesgo silencioso.

Tabla de Contenidos

- Por qué es clave conocer las limitaciones de ChatGPT

- Errores frecuentes y limitaciones técnicas de ChatGPT

- 7 tareas donde ChatGPT falla (o es poco fiable)

- 1. Razonamiento lógico y matemáticas complejas

- 2. Sentido común, intuición y contexto humano

- 3. Memoria de largo plazo y continuidad de proyectos

- 4. Supuesto ahorro de tiempo que sale caro

- 5. Datos desactualizados y falta de conexión en tiempo real

- 6. Rendimiento variable y saturación

- 7. Restricciones, filtros y sesgos

- Errores de fondo: por qué ChatGPT se equivoca tanto

- Cómo se entrenó ChatGPT y por qué eso influye en sus fallos

- Impacto de ChatGPT en estudios y mundo laboral

- Buenas prácticas para usar ChatGPT sin caer en sus trampas