- Microsoft Fabric รวบรวมข้อมูล การกำกับดูแล ปัญญาประดิษฐ์ และการวิเคราะห์แบบเรียลไทม์ไว้ในที่เดียวบน OneLake พร้อมความสามารถแบบครบวงจร

- แพลตฟอร์มนี้ช่วยเสริมสร้างการกำกับดูแล ความปลอดภัย และลดต้นทุนผ่าน Purview, ระบบรักษาความปลอดภัย OneLake, DLP, DSPM และการผสานรวมกับ Azure Cost Management

- Data Factory, Dataflow Gen2 และเครื่องมือการย้ายข้อมูล ช่วยให้การย้ายเวิร์กโหลดที่มีอยู่และการจัดการไปป์ไลน์ที่ซับซ้อนเป็นเรื่องง่าย

- Copilot, ตัวแทนข้อมูล, MCP และเวิร์กโหลดใหม่ ๆ เช่น Fabric IQ และ Real-Time Intelligence ช่วยขับเคลื่อนสถานการณ์ AI และระบบอัตโนมัติขั้นสูง

หากคุณทำงานกับข้อมูลในระบบนิเวศของ Microsoft มาสักระยะ คุณคงสังเกตเห็นว่า Microsoft Fabric ได้กลายเป็นศูนย์กลางของการวิเคราะห์ข้อมูลสมัยใหม่การรวมทุกอย่างที่เคยกระจัดกระจายอยู่ทั่ว Power BI, Azure Synapse, Data Factory และบริการอื่นๆ เข้าไว้ในแพลตฟอร์มเดียว ในบทความนี้ เราจะมาดูรายละเอียดอย่างเจาะลึกเกี่ยวกับคุณสมบัติล่าสุด แผนงาน และผลกระทบในทางปฏิบัติของ Fabric สำหรับการวิเคราะห์ การกำกับดูแล AI และการประมวลผลแบบเรียลไทม์

แนวคิดก็คือ เมื่อคุณอ่านจบ คุณจะมีความเข้าใจอย่างชัดเจนเกี่ยวกับ ปัจจุบัน Microsoft Fabric นำเสนออะไรบ้าง มีทิศทางอย่างไร และส่งผลกระทบต่อสถาปัตยกรรมข้อมูลอย่างไร? ขององค์กรของคุณ: ความสามารถด้านการกำกับดูแลด้วย Purview, ระบบอัตโนมัติด้วย API และ Git, ฟีเจอร์ AI ใหม่, ระบบอัจฉริยะแบบเรียลไทม์, ความปลอดภัยใน OneLake, การย้ายข้อมูล, ประสิทธิภาพ และอื่นๆ อีกมากมาย

Microsoft Fabric และ Cloud Adoption Framework: การกำกับดูแล ต้นทุน และระบบอัตโนมัติ

ภายใต้กรอบการนำระบบคลาวด์มาใช้ (Cloud Adoption Framework หรือ CAF) ไมโครซอฟต์ได้เผยแพร่คู่มือหลายชุดเพื่อให้สอดคล้องกับกรอบดังกล่าว การออกแบบ Microsoft Fabric โดยใช้หลักการออกแบบของโซนลงจอด (landing zones)ส่วนสุดท้ายของชุดบทความนี้จะกล่าวถึงสามประเด็นหลัก ได้แก่ การกำกับดูแล การเพิ่มประสิทธิภาพกำลังการผลิต และระบบอัตโนมัติ/DevOps

ในส่วนของการกำกับดูแล ต้นทุนความจุของโครงสร้างพื้นฐานจะแสดงผ่าน Azure Cost Managementฟังก์ชันนี้ช่วยให้คุณสามารถผสานรวมข้อมูลการใช้งานความจุ F (และ SKU อื่นๆ) เข้ากับแดชบอร์ดต้นทุน การแจ้งเตือน และการวิเคราะห์การใช้จ่ายของ Azure ได้โดยตรง ไม่ใช่แค่การดูบิลเท่านั้น คุณยังสามารถเปรียบเทียบข้อมูลนี้กับแท็ก การสมัครใช้งาน หรือกลุ่มทรัพยากร เพื่อทำความเข้าใจว่าใครใช้จ่ายอะไรและเพราะเหตุใด

สถาปัตยกรรมทางเทคนิคและรูปแบบธุรกิจของ Fabric ช่วยให้ลูกค้าสามารถใช้งานเทคโนโลยีต่างๆ ได้ ควบคุมการใช้กำลังการผลิตอย่างแม่นยำเพื่อเพิ่มประสิทธิภาพต้นทุนการดำเนินงานในทางปฏิบัติ สิ่งนี้สามารถแปลได้เป็นกลไกหลายประการ:

- การปรับขนาดความสามารถ F: เพิ่มหรือลดกำลังการผลิตตามช่วงเวลาที่มีความต้องการสูงสุดที่คาดการณ์ได้ เช่น แคมเปญการขาย กำหนดส่งเอกสารบัญชี หรือปริมาณข้อมูลจำนวนมาก

- ความสามารถในการหยุดชั่วคราวและดำเนินการต่อผู้ดูแลระบบเครือข่ายสามารถระงับการใช้งานความจุ F ชั่วคราวได้เมื่อไม่จำเป็นต้องใช้งาน (เช่น ในช่วงกลางคืนหรือวันหยุดสุดสัปดาห์ในสภาพแวดล้อมที่ไม่สำคัญ) เพื่อลดต้นทุนการประมวลผล

- ระบบป้องกันไฟกระชากพารามิเตอร์ระดับความจุสองตัวจะควบคุมวิธีการจัดการงานเบื้องหลังเพื่อป้องกันไม่ให้งานเหล่านั้นทำให้ระบบทำงานหนักเกินไป ได้แก่ เกณฑ์การปฏิเสธงานเบื้องหลัง (Background Rejection Threshold) และเกณฑ์การกู้คืนงานเบื้องหลัง (Background Recovery Threshold)

- การจองความจุสามารถจองกำลังการผลิตสำหรับช่วงเวลาที่กำหนดเพื่อรับส่วนลดได้ โดยมีเงื่อนไขว่าต้องวางแผนการบริโภคที่คาดการณ์ไว้อย่างรอบคอบ

ในด้านการกำกับดูแลข้อมูล Fabric อาศัย... Microsoft Purview เป็นส่วนประกอบหลักสำหรับการจัดทำแคตตาล็อก ลำดับวงศ์ตระกูล และการจำแนกประเภทจาก Purview คุณสามารถติดป้ายกำกับความไวต่อการเปลี่ยนแปลง ดูลำดับความสัมพันธ์ระหว่างแหล่งที่มา การแปลง และการใช้งาน รับรองสินทรัพย์ข้อมูล หรือเพิ่มประสิทธิภาพแคมเปญคุณภาพข้อมูล ทั้งหมดนี้ในขณะที่ผสานรวมองค์ประกอบต่างๆ ของ Fabric (Lakehouse, Warehouse, KQL, Power BI เป็นต้น) เข้าด้วยกันได้

ส่วน "ระบบอัตโนมัติของแพลตฟอร์มและ DevOps" นั้นจัดโครงสร้างหลัก ๆ โดยเน้นที่... การผสานรวมกับ Git, ไปป์ไลน์การปรับใช้ และ REST APIพื้นที่ทำงานของ Fabric สามารถเชื่อมโยงกับที่เก็บ Git เพื่อให้นักพัฒนาหลายคนสามารถทำงานร่วมกันในโครงการด้านวิศวกรรมข้อมูล วิทยาศาสตร์ข้อมูล หรือการวิเคราะห์แบบเรียลไทม์เดียวกันได้โดยไม่เกิดการทำงานซ้ำซ้อน

Git และ Deployment Pipelines ช่วยให้ วางแผนและจัดการวงจรการพัฒนา การทดสอบ และการผลิตอย่างเป็นระบบและมีประสิทธิภาพการส่งเสริมเนื้อหา การติดตามการเปลี่ยนแปลง การซิงโครไนซ์อาร์ติแฟกต์ และการจัดการเวอร์ชัน ตั้งแต่เดือนมีนาคม 2025 ระบบเหล่านี้ได้รองรับ (ในสถานะทั่วไปหรือสถานะพรีวิว) ประเภทองค์ประกอบที่หลากหลาย เช่น ทริกเกอร์ แดชบอร์ด ดาต้าโฟลว์ ดาต้าไพพ์ดีกรี ดาต้ามาร์ท เลคเฮาส์ แวร์เฮาส์ KQL โน้ตบุ๊ก รายงานแบบแบ่งหน้า แอปพลิเคชันขององค์กร เป็นต้น

ในขณะเดียวกัน Fabric ก็เปิดเผยเรื่องราวต่างๆ ชุด REST API ที่หลากหลายมาก ซึ่งสามารถใช้ในการทำงานอัตโนมัติเกือบทุกอย่าง ไม่ว่าจะเป็นการสร้างพื้นที่ทำงานและโฟลเดอร์ การย้ายข้อมูลจำนวนมาก การจัดการการเชื่อมต่อและเกตเวย์ การดึงข้อมูลคำจำกัดความ การเปิดใช้งานไปป์ไลน์หรือสมุดบันทึก และอื่นๆ อีกมากมาย

การอัปเดตที่สำคัญด้านการวิเคราะห์ ปัญญาประดิษฐ์ และการกำกับดูแลสำหรับ Microsoft Fabric

วิวัฒนาการของ Fabric โดดเด่นด้วยฟีเจอร์ทดลองใช้งานจำนวนมากและความสามารถใหม่ๆ ที่ พวกเขากล่าวถึงแทบทุกด้านของแพลตฟอร์มจากนั้นจึงนำมาจัดกลุ่มและอภิปรายอย่างเป็นระบบ เพื่อให้เห็นภาพรวมทั้งหมด

ฟังก์ชัน AI ในคลังข้อมูลและฟังก์ชันมัลติโมดอล

ในด้านข้อมูลเชิงสัมพันธ์ Fabric Data Warehouse ได้รวมเอาคุณสมบัติต่างๆ ไว้ด้วย AI ทำงานโดยตรงใน T-SQL (ดูตัวอย่าง) ซึ่งช่วยให้:

- จำแนกหรือจัดหมวดหมู่ข้อความ

- วิเคราะห์ความรู้สึก

- ดึงข้อมูลที่มีโครงสร้างจากข้อความอิสระ

- แปลข้อความระหว่างภาษาต่างๆ

- ไวยากรณ์ถูกต้อง

เป้าหมายก็คือ ไม่จำเป็นต้องออกจากบริบทของ SQL เพื่อเพิ่มคุณค่าให้กับข้อมูลด้วย AIฟังก์ชันเหล่านี้ถูกรวมเข้ากับการรองรับมัลติโมดอลทั่วไปในฟังก์ชัน AI ของ Fabric ซึ่งขณะนี้สามารถประมวลผลภาพ (JPG/JPEG, PNG, GIF, WebP), PDF และรูปแบบข้อความทั่วไป รวมถึงอินพุตในรูปแบบของเส้นทางไฟล์ได้แล้ว

สาธารณูปโภค เช่น ฟังก์ชัน aifunc.load ใช้สำหรับนำเข้าโฟลเดอร์ลงในตาราง ด้วยตัวเลือกพรอมต์และสคีมา `aifunc.list_file_paths` ช่วยให้คุณวนลูปผ่านเส้นทางไฟล์ได้ และ `ai.infer_schema` จะอนุมานสคีมาที่เข้ากันได้กับ `ai.extract` ทั้งหมดนี้ช่วยให้คุณสามารถแปลงและเพิ่มคุณค่าให้กับข้อมูลได้โดยไม่ต้องสร้างไปป์ไลน์ที่ซับซ้อนตั้งแต่เริ่มต้น

OneLake, Delta, Apache Iceberg และการเข้าถึงแบบหลายแพลตฟอร์ม

ในระดับการจัดเก็บข้อมูล OneLake ยังคงเป็นที่เก็บข้อมูลรวมที่เป็นที่อยู่ของ Fabric ทั้งหมด การปรับปรุงที่สำคัญอย่างหนึ่งคือความสามารถในการ การเปิดเผยตารางทะเลสาบเดลต้าว่าเป็นตารางภูเขาน้ำแข็งอะปาเช่ โดยไม่ต้องเคลื่อนย้ายหรือทำสำเนาข้อมูล เพื่อให้เครื่องมือที่ใช้งานร่วมกับ Iceberg ได้สามารถอ่านข้อมูลบน OneLake ได้โดยตรง

นอกจากนี้ OneLake ยังรองรับการใช้งานเพิ่มเติมอีกด้วย ข้อมูล Apache Iceberg ถูกเขียนโดยตรงโดย Snowflake และนำไปใช้งานใน Fabric ผ่านการเข้าถึงแบบไม่ต้องคัดลอกกลยุทธ์นี้ช่วยเสริมสร้างความสามารถในการทำงานร่วมกัน: Fabric ไม่ต้องการเป็นระบบปิด แต่ต้องการเป็น "ศูนย์กลาง" ข้อมูลที่เครื่องมืออื่นๆ สามารถใช้ประโยชน์ได้โดยไม่ต้องจัดเก็บข้อมูลซ้ำซ้อน

ในทำนองเดียวกัน OneLake ก็ยอมรับว่า ทางลัดไปยัง Azure Blob StorageOneDrive และ SharePoint รวมถึงขยายการรักษาความปลอดภัยด้วยบทบาทการเข้าถึง การรักษาความปลอดภัยในระดับโฟลเดอร์ แถว และคอลัมน์ และรูปแบบการรักษาความปลอดภัยที่บุคคลที่สามสามารถยอมรับได้ด้วยการขยายรูปแบบกลไกการอนุญาต

ประเด็นสำคัญประการหนึ่งคือการรวมแคตตาล็อก OneLake เข้ากับ Azure Databricks ซึ่งช่วยให้สามารถดำเนินการได้หลากหลายยิ่งขึ้น การเข้าถึงแบบไม่ต้องคัดลอกข้อมูลจาก Unity Catalog ไปยังตาราง OneLakeด้วยวิธีนี้ OneLake จึงยังคงเป็นแหล่งข้อมูลที่ถูกต้อง แต่ Databricks สามารถสอบถามข้อมูลได้โดยตรง โดยจะซิงโครไนซ์เฉพาะข้อมูลเมตาเท่านั้น

SQL Database บน Fabric: ประสิทธิภาพ ความปลอดภัย และเวอร์ชวลไลเซชัน

ฐานข้อมูล SQL ของ Fabric กำลังพัฒนาความสามารถของตัวเองมากขึ้น: ALTER DATABASE SET optionsรองรับการเรียงลำดับและการจัดทำดัชนีข้อความเต็มรูปแบบในโหมดพรีวิว ในระดับของ ประสิทธิภาพของฐานข้อมูล และในส่วนของค่าใช้จ่ายนั้น มีการปรับปรุงหลายประการ:

- การบีอัดดัชนีอัตโนมัติ เพื่อลดพื้นที่จัดเก็บข้อมูล การรับส่งข้อมูล และปรับปรุงความเร็วในการสืบค้นข้อมูลโดยไม่ต้องกำหนดเวลาการบำรุงรักษา

- ขีดจำกัดสูงสุดของ vCores เพื่อควบคุมการใช้ทรัพยากรการประมวลผล (4 หรือ 32 vCores) ซึ่งออกแบบมาเพื่อป้องกันไม่ให้ภาระงานใช้ทรัพยากรส่วนกลางมากเกินไป

- กลุ่ม SQL แบบกำหนดเอง ซึ่งช่วยให้ผู้ดูแลระบบพื้นที่ทำงานสามารถควบคุมการจัดสรรทรัพยากรและการกำหนดเส้นทางการสืบค้นตามชื่อแอปพลิเคชันได้อย่างละเอียด

มันยังเปิดใช้งานได้ การจำลองข้อมูลในฐานข้อมูล SQLซึ่งช่วยให้สามารถสอบถามข้อมูลภายนอกที่จัดเก็บไว้ใน OneLake ด้วย T-SQL โดยการเชื่อมไฟล์ในรูปแบบทั่วไปกับตารางเชิงสัมพันธ์ในเครื่องโดยใช้การเชื่อมต่อ (joins) โดยไม่ต้องนำเข้าข้อมูลจริง ๆ

ในด้านความปลอดภัย ฐานข้อมูล SQL รองรับ... การเชื่อมต่อส่วนตัวในระดับผู้เช่า (เวอร์ชันทดลองใช้)วิธีนี้ช่วยให้การจัดการข้อมูลเป็นไปในลักษณะที่เป็นส่วนตัวและควบคุมได้ง่ายขึ้น โดยผสานรวมเข้ากับการกำหนดค่าเครือข่ายที่ปลอดภัยโดยรวมของ Fabric

ระบบข่าวกรองแบบเรียลไทม์, อีเวนท์เฮาส์, อีเวนท์สตรีม และแอคทิเวเตอร์

โมดูล Real-Time Intelligence (RTI) ได้กลายเป็นหนึ่งในจุดเด่นสำคัญของ Fabric Eventhouse และ Eventstream ผสานรวมกันเพื่อ... รับข้อมูล ประมวลผล และเรียกใช้งานเหตุการณ์แบบเรียลไทม์ ข้อมูลจากแหล่งต่างๆ ทุกประเภท และ Activator จะทำหน้าที่ประสานงานการกระทำต่างๆ ที่จะถูกกระตุ้นภายใต้เงื่อนไขบางประการ

คุณสมบัติใหม่ที่ทรงพลังที่สุด ได้แก่:

- การตรวจจับความผิดปกติโดยไม่ต้องเขียนโค้ด มาพร้อมระบบเลือกโมเดลอัตโนมัติ อินเทอร์เฟซใช้งานง่าย และระบบแจ้งเตือนที่ยืดหยุ่น

- กิจกรรมทางธุรกิจซึ่งจะบันทึกช่วงเวลาสำคัญทางธุรกิจที่เกิดขึ้นจากฟังก์ชันข้อมูลผู้ใช้และสมุดบันทึก และช่วยให้คุณสามารถเปิดใช้งานการแจ้งเตือน ตรรกะที่กำหนดเอง โฟลว์ โมเดล AI หรืองาน Spark ได้

- การผสานรวมฟังก์ชันข้อมูลผู้ใช้และตัวกระตุ้นเพื่อให้ฟังก์ชันที่สร้างขึ้นใน Fabric สามารถประมวลผลเหตุการณ์จากแหล่งใดก็ได้ รวมถึงเหตุการณ์ภายในจากแพลตฟอร์มเองและจาก OneLake

- ความสามารถในการประมวลผลเหตุการณ์ด้วย SQL (ตัวดำเนินการ SQL ใน Eventstream)ซึ่งช่วยให้สามารถแปลงกระแสข้อมูลแบบเรียลไทม์ด้วยไวยากรณ์ SQL ที่รู้จักได้

มีการเพิ่มตัวเชื่อมต่อที่เกี่ยวข้อง เช่น เปล (สำหรับการนำเข้าบันทึกและข้อมูลโทรมาตรจากหลายแหล่ง) ตัวเชื่อมต่อที่มี Solace PubSub+ และรองรับการสตรีมผ่านเครือข่ายส่วนตัวโดยใช้ Azure Virtual Network, VPN, ExpressRoute หรือปลายทางส่วนตัว

สำหรับโครงสร้างข้อมูลและสัญญา Eventstream ได้นำเสนอสิ่งต่อไปนี้ รีจิสทรีสคีมา ซึ่งกำหนดและตรวจสอบความถูกต้องของรูปแบบเหตุการณ์สำหรับไปป์ไลน์ที่มีประสิทธิภาพยิ่งขึ้น และรองรับ Confluent Schema Registry เพื่อเชื่อมต่อกับ Kafka ใน Confluent Cloud ในขณะที่เคารพสัญญาที่มีอยู่เดิม

ความสามารถด้าน Copilot และ AI ทั่วทั้งแพลตฟอร์ม

Copilot ใน Fabric พร้อมใช้งานแล้วทั่วโลก โดยมีฐานอยู่ใน... Power BI, Data Factory, วิทยาศาสตร์ข้อมูล, วิศวกรรมข้อมูล และการเขียนคำสั่ง KQLนอกจากนี้ ยังได้มีการเพิ่มความสามารถเฉพาะด้านต่างๆ ดังนี้:

- Copilot สำหรับ Dataflow Gen2 (Modern Get Data)ซึ่งช่วยในการรับและแปลงข้อมูลด้วยคำสั่งในภาษาธรรมชาติ

- ผู้ช่วยนักบินสำหรับคลังข้อมูล (แชท)สามารถเข้าถึงได้จากปุ่มบนแถบเครื่องมือ เพื่อเร่งกระบวนการจัดการคลังสินค้าผ่านการสนทนา

- Copilot สำหรับเอนด์พอยต์การวิเคราะห์ SQLซึ่งจะสร้างและปรับแต่งคำสั่ง SQL จากคำอธิบายทางธุรกิจ

- ผู้ช่วยนักบินบนโน้ตบุ๊ก ด้วยความรู้เกี่ยวกับบริบทของพื้นที่ทำงาน โครงสร้าง Lakehouse โครงสร้างของโน้ตบุ๊ก และสภาพแวดล้อมการทำงาน ทำให้สามารถสร้างโค้ดหลายขั้นตอน ปรับโครงสร้างใหม่ สรุปโน้ตบุ๊กที่ซับซ้อน และวินิจฉัยข้อผิดพลาดด้วยตัวเลือก "แก้ไขด้วย Copilot" ได้

- การเติมข้อความอัตโนมัติแบบอินไลน์ (การเติมโค้ดแบบอินไลน์) และการเติมโค้ดแบบอินไลน์ของ Notebook Copilot (เวอร์ชันทดลอง)เพื่อเขียนโปรแกรม Python ได้เร็วขึ้นและมีข้อผิดพลาดน้อยลง

นอกจากนี้ ฐานเทคโนโลยี AI ยังกำลังขยายตัวอย่างต่อเนื่องด้วย เครื่องมือหล่อโลหะสำเร็จรูปที่ผสานรวมเข้าด้วยกัน (Azure OpenAI, Azure Language, Azure Translator), ปลั๊กอิน OpenAI สำหรับ Eventhouse (ai_embed_text และ ai_chat_completion) และเอเจนต์และเอเจนต์ข้อมูลต่างๆ ที่ช่วยให้แอปพลิเคชันอื่นๆ รวมถึง Copilot Studio สามารถทำงานกับข้อมูล Fabric ได้อย่างเป็นระบบ

ตัวแทนข้อมูล Fabric, MCP และเครื่องมือสำหรับนักพัฒนา

ผ้าชนิดนี้แนะนำ ตัวแทนข้อมูลที่สามารถจัดการการเข้าถึงข้อมูลและเครื่องมือต่างๆ ได้ สำหรับเอเจนต์ AI นั้น มาพร้อมกับ SDK สำหรับ Python และการผสานรวมโดยตรงกับ Microsoft Copilot Studio ทำให้การสร้างผู้ช่วยสนทนาที่ทำงานร่วมกับข้อมูลองค์กรที่ควบคุมโดย Fabric ทำได้ง่ายขึ้น

ควบคู่กันไป โมเดลบริบทโปรโตคอล (MCP) สิ่งนี้กลายเป็นส่วนประกอบสำคัญของการบูรณาการระหว่างเอเจนต์ AI และบริการ Fabric โดยมีเซิร์ฟเวอร์ MCP เฉพาะสำหรับ Activator และ Eventhouse และ MCP สำหรับ Fabric ที่เน้นการพัฒนาซึ่งมีคุณสมบัติดังนี้:

- ระบบนี้ช่วยให้ผู้ช่วย AI สามารถสร้างโค้ดและเนื้อหาสำหรับผลิตภัณฑ์ Fabric ได้

- มันสามารถทำงานร่วมกับเครื่องมือพัฒนาซอฟต์แวร์ เช่น VS Code และ GitHub Codespaces ได้

- โปรแกรมนี้เสนอเครื่องมือสำหรับการให้คำปรึกษาและการดำเนินการกับข้อมูลแบบเรียลไทม์ใน Eventhouse

สำหรับงานประจำวันของนักพัฒนา มีประเด็นสำคัญหลายประการที่ควรกล่าวถึง ได้แก่ การพัฒนาสภาพแวดล้อม: ส่วนขยาย MSSQL สำหรับ VS Code พร้อมรองรับฐานข้อมูล Fabric SQLรวมถึง Microsoft ADO.NET Driver และ ODBC Driver สำหรับ Fabric Data Engineering (การเชื่อมต่อกับ Spark SQL ผ่าน Livy) และตัวเชื่อมต่อ Spark สำหรับฐานข้อมูล SQL ที่ช่วยลดความซับซ้อนของการเข้าถึงฐานข้อมูล SQL จาก Spark ไปยัง Azure และ Fabric โดยไม่ต้องมีการตรวจสอบสิทธิ์

ยังปรากฏว่า แฟบริค ซีแอลไอซึ่งมีให้ใช้งานในรูปแบบงานแบบบูรณาการใน Azure DevOps ช่วยให้คุณสามารถจัดการพื้นที่ทำงาน รายการ และการปรับใช้โดยอัตโนมัติโดยไม่ต้องติดตั้งเครื่องมือภายนอกด้วยตนเอง

Data Factory, การย้ายข้อมูล และการจัดการกระบวนการใน Fabric

ชั้นการผสานรวมข้อมูลของ Fabric อาศัย Data Factory และ Dataflow Gen2 ซึ่งทำหน้าที่รับข้อมูลจาก... การจัดการระบบจะชาญฉลาดขึ้น สามารถทำงานอัตโนมัติได้มากขึ้น และมีขั้นตอนการโยกย้ายที่ง่ายขึ้น จากแพลตฟอร์มที่มีอยู่เดิม

Dataflow Gen2: ประสิทธิภาพ, API สาธารณะ และการวินิจฉัยปัญหา

ใน Dataflow Gen2 เราพบฟีเจอร์หลายอย่างที่อยู่ในช่วงทดลองใช้งาน:

- การแก้ไขขั้นสูงของแบบสอบถามเป้าหมาย เพื่อปรับตรรกะที่ปลายทางโดยตรงจากสภาพแวดล้อมการสร้างเนื้อหาเอง

- การประมวลผลแบบแบ่งส่วนซึ่งช่วยให้ส่วนต่างๆ ของกระบวนการไหลของข้อมูลทำงานพร้อมกันได้ ส่งผลให้ลดเวลาการประเมินผลโดยรวมลง

- ดาวน์โหลดข้อมูลการวินิจฉัย ในระดับการดำเนินการ โดยใช้แพ็กเกจบันทึกข้อมูลที่มีโครงสร้างสำหรับการวิเคราะห์ประสิทธิภาพและการแก้ไขปัญหา

- API สาธารณะ สำหรับการสร้าง อัปเดต ลบ กำหนดเวลา และตรวจสอบการไหลของข้อมูลโดยใช้โปรแกรม

- พารามิเตอร์สาธารณะที่รองรับ CI/CDซึ่งช่วยให้สามารถรีเฟรชกระแสข้อมูลได้โดยการส่งค่าจากไปป์ไลน์หรือแหล่งข้อมูลอื่นๆ

- ข้อมูลล่าสุด เพื่อให้เข้าถึงรายการที่ใช้ล่าสุดได้อย่างรวดเร็วในแถบเครื่องมือ Power Query และใน Modern Get Data

ทั้งหมดนี้ได้รับการเสริมด้วยความสามารถของ ประเมิน Power Query ด้วยวิธีการเขียนโปรแกรมผ่าน RESTสิ่งนี้เปิดโอกาสให้สามารถเรียกใช้สคริปต์ M เป็นส่วนหนึ่งของกระบวนการอัตโนมัติ ผสานรวมเข้ากับ Spark, ไปป์ไลน์ หรือเครื่องมือภายนอก และใช้ประโยชน์จากตัวเชื่อมต่อ Power Query ได้

โรงงานข้อมูล: ประสิทธิภาพที่ปรับเปลี่ยนได้ การเชื่อมต่อ และ dbt

ในส่วนที่ "คลาสสิก" มากขึ้นของการผสานรวมนั้น Data Factory ภายใน Fabric นำเสนอสิ่งต่อไปนี้:

- การปรับแต่งประสิทธิภาพแบบปรับตัวได้ สำหรับกิจกรรมการคัดลอก ซึ่งจะปรับพารามิเตอร์ประสิทธิภาพอย่างชาญฉลาดตามการกำหนดค่าและบริบทการดำเนินการ

- รองรับการบันทึกการเปลี่ยนแปลงข้อมูล (Change Data Capture - CDC) ในงานคัดลอกเพื่อจำลองเฉพาะการเปลี่ยนแปลง (การเพิ่ม การอัปเดต การลบ) อย่างต่อเนื่องเท่านั้น

- เกตเวย์แบบติดตั้งในสถานที่พร้อมตัวเลือกการอัปเกรดด้วยตนเอง สามารถจัดการได้จากพอร์ทัล Fabric, API หรือสคริปต์

- การเชื่อมต่อล่าสุดซึ่งจะเพิ่มคุณสมบัติการใช้งานครั้งล่าสุดให้กับการเชื่อมต่อ เพื่ออำนวยความสะดวกในการตรวจสอบและการจัดการวงจรชีวิต

- งาน dbt ดั้งเดิมซึ่งช่วยให้สามารถเรียกใช้โปรเจกต์ dbt ภายใน Fabric ได้ พร้อมการจัดการ การทดสอบ เอกสารประกอบ และการกำกับดูแลแบบบูรณาการ

- เรียกใช้กิจกรรมแพ็กเกจ SSIS ในไปป์ไลน์ สามารถเรียกใช้แพ็กเกจ SSIS จากออร์เคสเตรชันโดยตรงใน Fabric ได้

ประสบการณ์การใช้งานของผู้ใช้ยังได้รับการปรับปรุงให้ดียิ่งขึ้นด้วย ตัวเลือกไซต์ SharePoint (ตัวเลือกไซต์ SharePoint) ซึ่งช่วยหลีกเลี่ยงการพิมพ์ URL ด้วยตนเอง และรองรับ Data Factory ผ่าน MCP ทำให้ผู้ช่วย AI สามารถสร้างและปรับใช้ Dataflow Gen2 ได้ง่ายๆ จากคำสั่งภาษาธรรมชาติ

เครื่องมือสำหรับการย้ายและจำลองข้อมูล

ไมโครซอฟต์กำลังส่งเสริมการเปลี่ยนไปใช้ Fabric อย่างจริงจังผ่านเครื่องมือเฉพาะหลายอย่าง:

- การประเมินการย้ายโครงสร้างข้อมูลสำหรับ Data Factoryซึ่งจะวิเคราะห์การเตรียมไปป์ไลน์ ADF และย้ายไปป์ไลน์ที่รองรับไปยังพื้นที่ทำงาน Fabric พร้อมการแมปการเชื่อมต่อ

- ผู้ช่วยในการย้ายข้อมูลสำหรับคลังข้อมูลซึ่งขณะนี้สามารถเชื่อมต่อโดยตรงกับคลังข้อมูลต้นทางเพื่อย้ายข้อมูลไปยังคลังข้อมูล Fabric Data Warehouse ได้แล้ว

- ตัวช่วยในการย้ายข้อมูลสำหรับฐานข้อมูล SQLโดยมีเป้าหมายเพื่อย้ายเวิร์กโหลด SQL Server ที่ติดตั้งบนระบบภายในองค์กร พร้อมด้วยการนำเข้าสคีมาผ่าน DACPAC การตรวจจับความไม่เข้ากัน และคำแนะนำ

ในส่วนของการจำลองข้อมูลนั้น มีการให้การสนับสนุนแก่ การจำลองแหล่งข้อมูลปฏิบัติการหลายแหล่ง (เช่น Azure Database for MySQL, Google BigQuery, SQL Server เป็นต้น) ไปยัง Fabric พร้อมความสามารถในการควบคุมว่าตารางใดบ้างที่จะถูกจำลอง เริ่มกระบวนการจำลองใหม่ผ่าน REST และในกรณีของ Databricks สามารถแมปนโยบาย Unity Catalog กับความปลอดภัยของ OneLake ได้

นอกจากนี้ยังรวมถึงตัวเชื่อมต่อการจำลองข้อมูลจาก Lakehouse ด้วย ฟีดข้อมูลการเปลี่ยนแปลงเดลต้าซึ่งจะเปิดเผยการเปลี่ยนแปลงบนกระดาน Lakehouse Delta ไปสู่จุดหมายปลายทางที่เข้ากันได้โดยไม่ต้องคิดค้นสิ่งใหม่ทั้งหมดด้วยโซลูชันที่พัฒนาขึ้นเองของ CDC

ระบบรักษาความปลอดภัย การกำกับดูแลขั้นสูง และการตรวจสอบใน Fabric

หนึ่งในข้อกังวลที่ใหญ่ที่สุดในแพลตฟอร์มวิเคราะห์ข้อมูลใดๆ ก็คือ วิธีการใช้งาน รักษาความปลอดภัยของข้อมูล ควบคุมการใช้งาน และตรวจสอบการใช้ทรัพยากรพัฒนาการด้านผ้าในด้านเหล่านี้กำลังไปได้ดีอย่างรวดเร็ว

ระบบรักษาความปลอดภัยและการปกป้องข้อมูลที่ OneLake

OneLake เพิ่มโมเดลที่สมบูรณ์แบบของ ความปลอดภัยในการเข้าถึงข้อมูล ด้วย:

- บทบาทการเข้าถึงข้อมูลสำหรับ Lakehouse พร้อมสิทธิ์ที่กำหนดค่าได้จากอินเทอร์เฟซความปลอดภัยแบบโฟลเดอร์

- มีระบบรักษาความปลอดภัยสำหรับทางลัด เพื่อให้บุคคลภายนอกสามารถปฏิบัติตามนโยบายที่กำหนดไว้ได้

- OneLake API ด้านความปลอดภัยในการเข้าถึงข้อมูล ซึ่งช่วยให้สามารถจัดการสิทธิ์การเข้าถึงได้โดยอัตโนมัติ

- การขยายโมเดลไปยังเครื่องมือภายนอก (การอนุญาตด้านความปลอดภัยของ OneLake สำหรับบุคคลที่สาม)

ขณะเดียวกัน การคุ้มครองก็กำลังขยายวงกว้างขึ้นด้วย DLP จำกัดการเข้าถึง ครอบคลุมข้อมูลที่มีโครงสร้างทั้งหมดใน OneLake (SQL, KQL, คลังข้อมูล) และได้มีการนำเสนอข้อมูลเหล่านั้นเข้ามา DSPM สำหรับ AI สำหรับ Fabric Copilots และตัวแทนข้อมูลซึ่งตรวจสอบการโต้ตอบของ AI เพื่อค้นหาข้อมูลที่ละเอียดอ่อนและพฤติกรรมเสี่ยง โดยผสานรวมกับ Purview Audit และ eDiscovery

ในแง่ของเอกลักษณ์ จะปรากฏลักษณะดังต่อไปนี้: เอกลักษณ์ที่เกี่ยวข้องกับสิ่งของ (ตัวอย่างเช่น Lakehouse และ Eventstream) ผ่าน REST API ซึ่งช่วยขจัดความจำเป็นในการพึ่งพาเจ้าของสำหรับการดำเนินการบางอย่าง และการตรวจสอบสิทธิ์ทางลัด OneDrive และ SharePoint โดยใช้ข้อมูลประจำตัวของพื้นที่ทำงานหรือหลักการบริการ

การกำกับดูแลจากส่วนกลางและแคตตาล็อก OneLake

ประสบการณ์ด้านการกำกับดูแลข้อมูลได้รับการเสริมสร้างด้วย แผงควบคุมส่วนกลางใหม่ในแคตตาล็อก OneLakeซึ่งเจ้าของข้อมูลสามารถดูภาพรวมของรายการต่างๆ ที่พวกเขาสร้างขึ้น รับคำแนะนำเกี่ยวกับการดำเนินการด้านการกำกับดูแล และเข้าถึงเครื่องมือทั้งหมดที่มีอยู่เพื่อปรับปรุงความปลอดภัยและการปฏิบัติตามกฎระเบียบ

นอกจากนี้ API ค้นหาแคตตาล็อก OneLake พร้อมด้วยเครื่องมือ MCP ซึ่งช่วยให้สามารถค้นหารายการต่างๆ ทั่วทั้งสภาพแวดล้อม Fabric จากโค้ดหรือเอเจนต์ AI ได้ในการเรียกเพียงครั้งเดียว โดยคำนึงถึงสิทธิ์การเข้าถึงแคตตาล็อกและข้อมูลเมตา

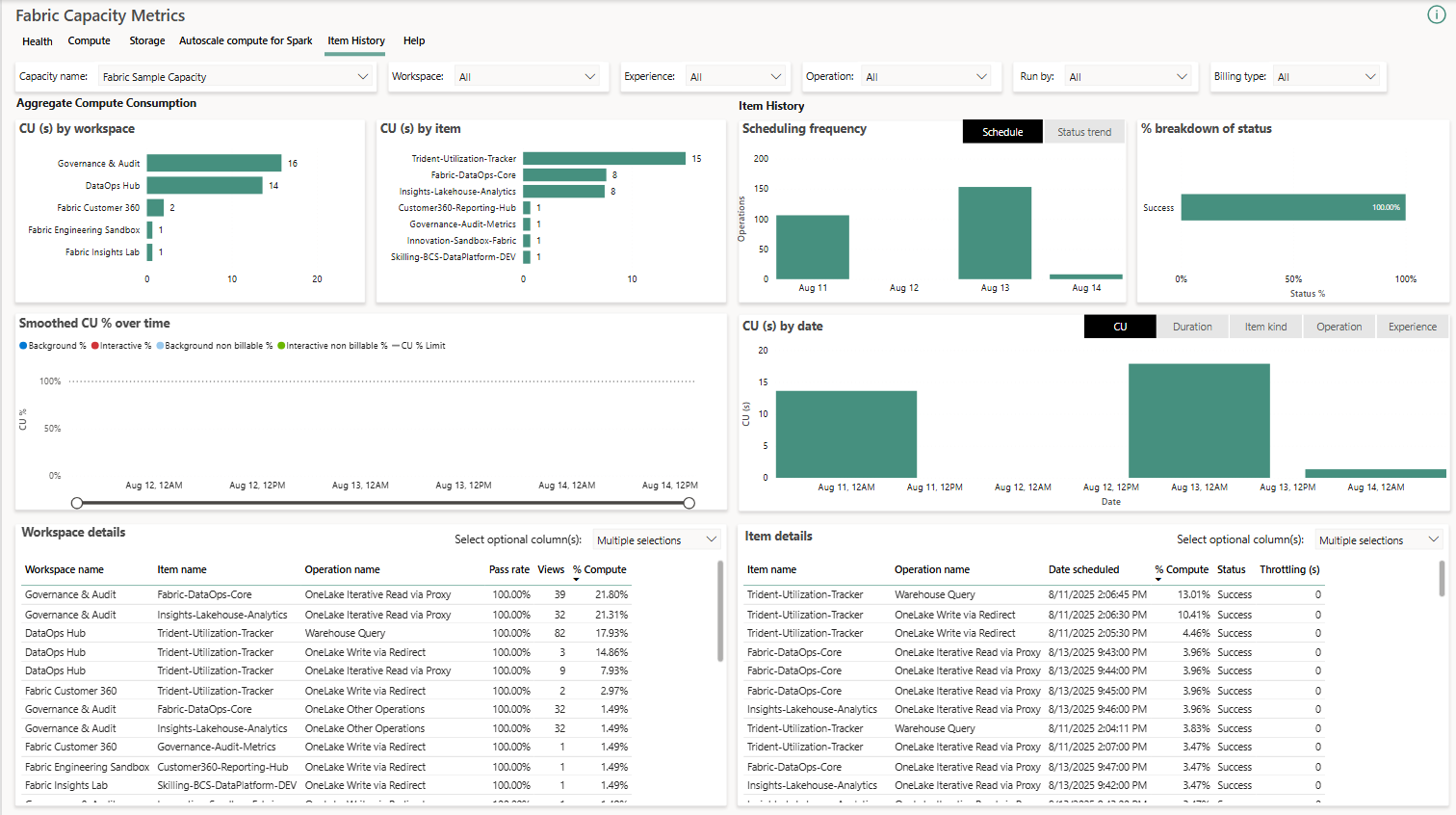

การตรวจสอบกำลังการผลิต การบริโภค และปริมาณงาน

ผ้าชนิดนี้มีคุณสมบัติในการสังเกตการณ์ได้หลายระดับ:

- การตรวจสอบพื้นที่ทำงานซึ่งจะสร้างฐานข้อมูลใน Fabric ที่รวบรวมบันทึกและตัวชี้วัดจากหลายรายการ (รวมถึงงานคัดลอกที่มีการตรวจสอบอย่างละเอียด)

- การตรวจสอบพื้นที่ทำงานสำหรับงานคัดลอกโดยใช้ตัวชี้วัดต่างๆ เช่น อัตราการประมวลผล ปริมาณข้อมูล รหัสข้อผิดพลาด และเวลา ซึ่งทั้งหมดนี้มุ่งเน้นไปที่การวิเคราะห์แบบรวมศูนย์

- ประวัติรายการในการประยุกต์ใช้ตัวชี้วัดกำลังการผลิตโดยแสดงข้อมูลการใช้ CU ในช่วง 30 วันที่ผ่านมาสำหรับแต่ละรายการ พร้อมระบบกรองข้อมูลตามพื้นที่ทำงานและประเภทได้

- ระบบป้องกันไฟกระชากระดับพื้นที่ทำงานซึ่งช่วยให้สามารถกำหนดขีดจำกัดการใช้งานต่อพื้นที่ทำงานได้ในรอบ 24 ชั่วโมง โดยจะบล็อกพื้นที่ทำงานที่เกินขีดจำกัดโดยอัตโนมัติ และกำหนดพื้นที่ทำงานที่เป็น "ภารกิจสำคัญ" เพื่อยกเว้นพื้นที่ทำงานเหล่านั้นจากข้อจำกัด

เพื่อเสริมสิ่งนี้ ชุดเริ่มต้นของ API สำหรับผู้ดูแลระบบ Fabric มุ่งเน้นการค้นหาพื้นที่ทำงาน สิ่งของ และรายละเอียดการเข้าถึงของผู้ใช้ เพื่ออำนวยความสะดวกในการตรวจสอบสินค้าคงคลังแบบไดนามิกและการควบคุมการเข้าถึงเป็นระยะ

การสร้างแบบจำลองธุรกิจ การวางแผน และปริมาณงานใหม่

นอกเหนือจากชั้นทางเทคนิคแล้ว ไมโครซอฟต์กำลังนำเสนอสิ่งใหม่ๆ ภาระงานใหม่ที่มุ่งเน้นธุรกิจ เกี่ยวกับ Fabric หนึ่งในคุณสมบัติที่โดดเด่นที่สุดคือ Fabric IQ ซึ่งมุ่งมั่นที่จะผสานรวมความหมายทางธุรกิจ ข้อมูล และแบบจำลองสำหรับเอเจนต์อัจฉริยะที่ทำการตัดสินใจโดยพิจารณาจากมุมมองแบบองค์รวมขององค์กร

ภายใน Fabric IQ จะปรากฏสิ่งต่อไปนี้:

- ออนโทโลยี (ตัวอย่าง)ซึ่งเป็นประเภทของข้อมูลที่กำหนดเอนทิตี ความสัมพันธ์ คุณสมบัติ และข้อจำกัดต่างๆ ตามภาษาทางธุรกิจของบริษัท

- แผน (ตัวอย่าง)แพลตฟอร์มแบบไม่ต้องเขียนโค้ดสำหรับการวางแผน การรายงาน การวิเคราะห์ การบูรณาการ และการจัดการแบบร่วมมือกัน

ระบบอัจฉริยะแบบเรียลไทม์ก็เริ่มปรากฏขึ้นเช่นกัน ผู้สร้างดิจิทัลทวินเป็นอุปกรณ์เฉพาะทางที่สร้างแบบจำลองดิจิทัลทวินโดยใช้ข้อมูลแบบเรียลไทม์ โดยมีเป้าหมายเพื่อเพิ่มประสิทธิภาพการดำเนินงานทางกายภาพ ตรวจสอบสถานะ และจำลองสถานการณ์ต่างๆ

ในทางกลับกัน มันถูกนำเสนอ ปริมาณงาน Fabric IQ ในฐานะภาระงานที่แยกต่างหาก และเครื่องมือสนับสนุนสำหรับการกำกับดูแลและการจัดเรียงความหมายยังคงขยายตัวอย่างต่อเนื่อง ทำให้วงจรเชื่อมโยงระหว่างแบบจำลองข้อมูล ตรรกะทางธุรกิจ และแอปพลิเคชัน AI/การวิเคราะห์สมบูรณ์ยิ่งขึ้น

การปรับปรุงประสิทธิภาพ ประสบการณ์ผู้ใช้ และผลผลิต

โดยสรุปแล้ว การทบทวนนี้ควรเน้นย้ำถึงการปรับปรุงที่สำคัญหลายประการดังนี้ เรื่องราวเหล่านี้อาจไม่เป็นข่าวพาดหัวเสมอไป แต่มีอิทธิพลอย่างมากต่อชีวิตประจำวัน ของทีม

ในส่วนของ Spark และการประมวลผลแบบกระจาย Fabric ได้นำเสนอสิ่งต่อไปนี้:

- Fabric Runtime 2.0 (เวอร์ชันทดลอง) โดยใช้ Apache Spark 4.0, Delta Lake 4.0, Java 21, Scala 2.13 และ Python 3.12 บน Azure Linux 3.0

- เครื่องมือเปรียบเทียบแอป Sparkซึ่งช่วยให้คุณสามารถเลือกและเปรียบเทียบการทำงานของ Spark ได้สูงสุดถึงสี่รายการพร้อมกัน

- ตัวปล่อยประกายไฟเพื่อการวินิจฉัยซึ่งทำหน้าที่รวบรวมบันทึกข้อมูล ตัวชี้วัด และเหตุการณ์ต่างๆ จากแอปพลิเคชัน Spark และส่งไปยังปลายทางต่างๆ เช่น Event Hubs, พื้นที่จัดเก็บข้อมูล หรือ Log Analytics

- คลังข้อมูลการวินิจฉัยของ JobInsightไลบรารีสำหรับวิเคราะห์การทำงานของ Spark ที่เสร็จสมบูรณ์แล้วผ่าน API ต่างๆ (คำสั่งค้นหา งาน ขั้นตอน งานย่อย ตัวดำเนินการ บันทึกเหตุการณ์)

ในเลเยอร์คลังสินค้า จะมีการเพิ่มสิ่งต่อไปนี้: การจัดกลุ่มข้อมูล เพื่อปรับปรุงประสิทธิภาพและลดต้นทุนการเข้าถึง จึงมีการเพิ่มคอลัมน์ IDENTITY สำหรับคีย์ทดแทน และรองรับการควบคุมเวอร์ชันและ CI/CD ผ่านโปรเจ็กต์ฐานข้อมูล SQL ใน VS Code (ระบบควบคุมเวอร์ชันซอร์สโค้ด)

ประสบการณ์การใช้งานพอร์ทัล Fabric ของผู้ใช้ก็ได้รับการพัฒนาไปด้วยเช่นกัน การเรียกดูแบบแท็บและการสำรวจวัตถุคุณสมบัตินี้ช่วยให้คุณเปิดหลายรายการพร้อมกันและสลับไปมาระหว่างรายการเหล่านั้นได้อย่างรวดเร็ว นอกจากนี้ การปรับปรุงอื่นๆ เช่น การเชื่อมโยงอัตโนมัติของ Lakehouse กับ Git และชุดเครื่องมือสำหรับการบำรุงรักษา Lakehouse (กิจกรรมการบำรุงรักษาและการรีเฟรชปลายทาง SQL) ยังช่วยให้แพลตฟอร์มใช้งานง่ายและคล่องตัวยิ่งขึ้น

สุดท้ายนี้ คุณสมบัติต่างๆ เช่น การนำเข้า/ส่งออกข้อมูลนิยามสินค้าจำนวนมาก (สำหรับการย้ายข้อมูล เทมเพลต และการสำรองข้อมูลเมตาเดต้า) REST สำหรับโฟลเดอร์ การสนับสนุนพารามิเตอร์ในการเปิดใช้งานรายการจาก Activator และการโหลดข้อมูล OneLake ใน Excel พร้อมแคตตาล็อกแบบบูรณาการ ทำให้เกิดระบบนิเวศที่ครอบคลุมความต้องการทั่วไปเกือบทั้งหมดของทีมข้อมูลสมัยใหม่

ด้วยความสามารถทั้งหมดนี้ ตั้งแต่การกำกับดูแลแบบรวมศูนย์ การรักษาความปลอดภัยแบบละเอียด และการประสานงานอัจฉริยะ ไปจนถึง AI ที่ฝังอยู่ใน SQL การวิเคราะห์แบบเรียลไทม์ ดิจิทัลทวิน และเอเจนต์ MCP ทำให้ Microsoft Fabric กำลังเสริมสร้างตำแหน่งของตนในฐานะแพลตฟอร์มข้อมูลที่สมบูรณ์แบบ สิ่งสำคัญไม่ได้อยู่ที่การจัดเก็บและแสดงผลข้อมูลเพียงอย่างเดียวอีกต่อไป แต่เป็นการกำกับดูแล การทำให้เป็นอัตโนมัติ และการใช้ประโยชน์จาก AI เพื่อควบคุมทุกส่วนของวงจรชีวิตข้อมูลช่วยให้องค์กรต่างๆ สามารถพัฒนาสถาปัตยกรรมของตนได้อย่างค่อยเป็นค่อยไป โดยโยกย้ายสิ่งที่มีอยู่แล้วและเปิดใช้งานโซลูชันใหม่ๆ ได้เร็วกว่าวิธีการแบบดั้งเดิมมาก

สารบัญ

- Microsoft Fabric และ Cloud Adoption Framework: การกำกับดูแล ต้นทุน และระบบอัตโนมัติ

- การอัปเดตที่สำคัญด้านการวิเคราะห์ ปัญญาประดิษฐ์ และการกำกับดูแลสำหรับ Microsoft Fabric

- ฟังก์ชัน AI ในคลังข้อมูลและฟังก์ชันมัลติโมดอล

- OneLake, Delta, Apache Iceberg และการเข้าถึงแบบหลายแพลตฟอร์ม

- SQL Database บน Fabric: ประสิทธิภาพ ความปลอดภัย และเวอร์ชวลไลเซชัน

- ระบบข่าวกรองแบบเรียลไทม์, อีเวนท์เฮาส์, อีเวนท์สตรีม และแอคทิเวเตอร์

- ความสามารถด้าน Copilot และ AI ทั่วทั้งแพลตฟอร์ม

- ตัวแทนข้อมูล Fabric, MCP และเครื่องมือสำหรับนักพัฒนา

- Data Factory, การย้ายข้อมูล และการจัดการกระบวนการใน Fabric

- ระบบรักษาความปลอดภัย การกำกับดูแลขั้นสูง และการตรวจสอบใน Fabric

- การสร้างแบบจำลองธุรกิจ การวางแผน และปริมาณงานใหม่

- การปรับปรุงประสิทธิภาพ ประสบการณ์ผู้ใช้ และผลผลิต