- GPUHammer demuestra que es posible degradar la precisión de modelos de IA hasta niveles inútiles explotando vulnerabilidades físicas en la memoria de las GPU.

- La seguridad de la IA abarca hardware, datos, modelos e infraestructura, e incluye la defensa frente a ataques adversarios y a ingeniería social potenciada por IA.

- Las cargas de trabajo de IA requieren estrategias de protección específicas, con uso de ECC, aislamiento de GPU, monitoreo continuo y controles sobre el ciclo de vida del modelo.

- La IA es un arma de doble filo en ciberseguridad: potencia tanto las capacidades defensivas como las ofensivas, por lo que la ventaja la marca la estrategia y la gobernanza.

La seguridad de la inteligencia artificial ha dejado de ser un tema puramente académico para convertirse en un problema muy real para empresas, investigadores y administraciones públicas. No solo hablamos de malware o de phishing clásico: ahora existen ataques capaces de degradar por completo la precisión de un modelo de IA, explotar vulnerabilidades físicas del hardware e incluso manipular la percepción humana a través de deepfakes y campañas de desinformación automatizadas.

Dentro de este nuevo escenario destaca GPUHammer, un ataque que reduce la precisión de la inteligencia artificial a niveles ridículos aprovechando fallos en la memoria de las GPU. Pero no es la única amenaza: se suman ataques adversarios sobre los datos, ingeniería social potenciada por IA, sesgos algorítmicos con impacto social y una infraestructura de IA que, en muchos casos, no fue diseñada pensando en la seguridad. Vamos a desgranarlo con calma, pero con la profundidad técnica que requiere.

Qué es GPUHammer y por qué puede destrozar la precisión de un modelo de IA

GPUHammer es un tipo de ataque de la familia Rowhammer, una técnica que explota una falla física en las celdas de memoria. Mientras que los Rowhammer clásicos se han centrado en la memoria DRAM utilizada por las CPU, GPUHammer desplaza el foco hacia la memoria de las GPU, que es el corazón del entrenamiento y la inferencia de modelos de inteligencia artificial modernos.

El ataque funciona martilleando (es decir, accediendo de forma repetitiva y controlada) determinadas filas de memoria de la GPU. Con estas operaciones intensivas y cuidadosamente sincronizadas, se induce una fuga de carga eléctrica que acaba provocando que bits cercanos cambien de valor. Un 0 pasa a 1 o al revés, sin que el sistema lo detecte como un fallo evidente, porque se manifiesta como errores silenciosos en los datos.

En el contexto de un modelo de IA, estos bits alterados pueden afectar tanto a parámetros del modelo como a activaciones intermedias o datos de entrada procesados en la GPU. Al corromper pesos o tensores clave, las operaciones matemáticas dejan de ser fiables y las predicciones se desploman en calidad. Lo más preocupante es que el sistema sigue funcionando aparentemente con normalidad, pero la precisión del modelo cae en picado.

Los investigadores que han demostrado GPUHammer explican que el vector de ataque puede apoyarse en entornos de cómputo como CUDA para inyectar accesos específicos a memoria y controlar el patrón de martilleo. Aprovechando la alta capacidad de ejecución en paralelo de las GPU modernas, se puede maximizar el número de accesos en muy poco tiempo y aumentar la probabilidad de conseguir flips de bits útiles para el atacante.

El gran reto para quienes idean estos ataques ha sido la opacidad de las implementaciones de seguridad en memorias GDDR, los mapeos internos de direcciones y la distinta latencia respecto a DRAM de CPU. Mediante ingeniería inversa de esos mapeos, sincronización con las ventanas de actualización de memoria y optimización del paralelismo, han conseguido superar esas barreras teóricas.

El impacto de GPUHammer: de un 80 % de precisión a un 0,1 %

El caso más llamativo documentado por los investigadores es el de una NVIDIA A6000, una aceleradora de gama alta usada habitualmente para cargas de trabajo de IA profesional. Un modelo que normalmente alcanzaba alrededor de un 80 % de precisión en su tarea se vio reducido hasta un paupérrimo 0,1 % tras aplicar el ataque GPUHammer.

Hablamos de una caída que convierte una GPU de varios miles de euros en poco más que un pisapapeles de lujo en lo que respecta a tareas de IA. Un modelo con 0,1 % de precisión es, en la práctica, inútil para cualquier aplicación seria: diagnósticos médicos, sistemas de detección de fraude, predicción financiera o clasificación de imágenes pasan de ser herramientas de apoyo a la decisión a simples generadores de ruido.

En entornos empresariales, esto significa que los modelos pueden tomar decisiones erróneas de forma masiva, sin que a simple vista se perciba el motivo. Un sistema de scoring crediticio podría aprobar a quien no debe o denegar a clientes solventes; un sistema de ciberseguridad basado en IA podría dejar pasar amenazas reales y generar falsos positivos por todas partes. El impacto se traduce en pérdidas económicas, daños reputacionales e incluso posibles consecuencias legales si se demuestra negligencia en la protección de la infraestructura.

Curiosamente, el ataque no se comporta igual en todas las tarjetas. Los experimentos muestran éxito en GPUs como la NVIDIA A6000 con GDDR6, pero no en modelos como la RTX 3080. La hipótesis es que, al utilizar memorias de distintos fabricantes, con mecanismos de mitigación y mapeos diferentes, la viabilidad del ataque varía. Eso abre la puerta a que determinados diseños de memoria sean intrínsecamente más resistentes.

Para probar y documentar el ataque, los investigadores han publicado detalles técnicos en la web oficial del proyecto, donde explican el proceso, las limitaciones actuales y las posibles extensiones futuras, poniendo el foco en que este tipo de ataques sobre GPU suponen una nueva frontera en la seguridad del hardware orientado a inteligencia artificial.

Evolución de los ataques Rowhammer: de ZenHammer a GPUHammer

GPUHammer no aparece de la nada; forma parte de una línea evolutiva de ataques Rowhammer que lleva años preocupando a la comunidad de seguridad. En 2024 salió a la luz ZenHammer, un ataque diseñado para explotar vulnerabilidades en CPUs AMD Ryzen y EPYC, donde se demostraba que la estructura interna de la DRAM permitía provocar flips de bits martilleando filas adyacentes.

Posteriormente, investigaciones adicionales han señalado problemas similares en memorias DRAM clásicas y en generaciones más recientes como DDR5 de ciertos fabricantes. Año tras año se han ido descubriendo nuevos vectores o variaciones del mismo principio: forzar físicamente a la memoria a comportarse de forma incorrecta bajo patrones de acceso muy concretos.

La gran diferencia es que, hasta ahora, la mayoría de estudios miraban sobre todo a la memoria principal de la CPU. Con GPUHammer el foco se desplaza claramente a la memoria de las tarjetas gráficas, elemento crítico para el procesamiento masivo paralelo que exige el aprendizaje profundo. Esto significa que toda la infraestructura basada en GPU para IA —desde servidores de data center hasta estaciones de trabajo y tarjetas gráficas de consumo de gama alta— entra directamente en el radar de estas amenazas.

Esta progresión deja claro que la carrera entre fabricantes de hardware e investigadores de seguridad no va a detenerse. Cada nueva generación de memoria (GDDR6, GDDR7, HBM3, etc.) añade capacidades de rendimiento, pero también nuevas superficies de ataque potenciales que deben ser evaluadas desde el diseño, no solo parcheadas a posteriori.

Mitigaciones actuales: ECC, nuevas memorias y sus costes

La primera línea de defensa frente a ataques tipo GPUHammer pasa por activar la memoria con corrección de errores (ECC) siempre que esté disponible. ECC añade bits adicionales a los datos para detectar y, en muchos casos, corregir errores de uno o más bits en tiempo real, neutralizando el efecto de muchos flips provocados por el ataque.

El problema es que activar ECC no sale gratis: los estudios hablan de una pérdida de rendimiento aproximada del 10 % en algunas GPU cuando se habilita esta funcionalidad. Para organizaciones obsesionadas con exprimir cada teraFLOP, esta penalización puede resultar incómoda, pero es el precio a pagar por una mejora sustancial en integridad de datos.

En las generaciones más nuevas de memoria como GDDR7 o HBM3, muchos fabricantes ya integran mecanismos de ECC en los propios chips de memoria, lo que reduce la exposición a ataques Rowhammer y sus variantes. Estas tecnologías están diseñadas con la idea de que las cargas de trabajo de IA exigen no solo velocidad, sino también resiliencia frente a errores silenciosos, independientemente de si se originan por fallos físicos o por ataques maliciosos.

Los investigadores que han presentado GPUHammer señalan que siguen trabajando en nuevas técnicas para intentar saltarse incluso estas protecciones, buscando caminos alternativos donde la corrección de errores sea insuficiente o donde sea posible forzar condiciones extremas que superen los mecanismos de ECC.

Por su parte, fabricantes como NVIDIA fueron notificados de la vulnerabilidad con antelación (en este caso, en torno a enero), y recomiendan explícitamente la activación de ECC en entornos sensibles, así como el despliegue de buenas prácticas de aislamiento de cargas de trabajo cuando se comparten recursos de GPU entre clientes o aplicaciones.

Seguridad de la IA: más allá del hardware y de GPUHammer

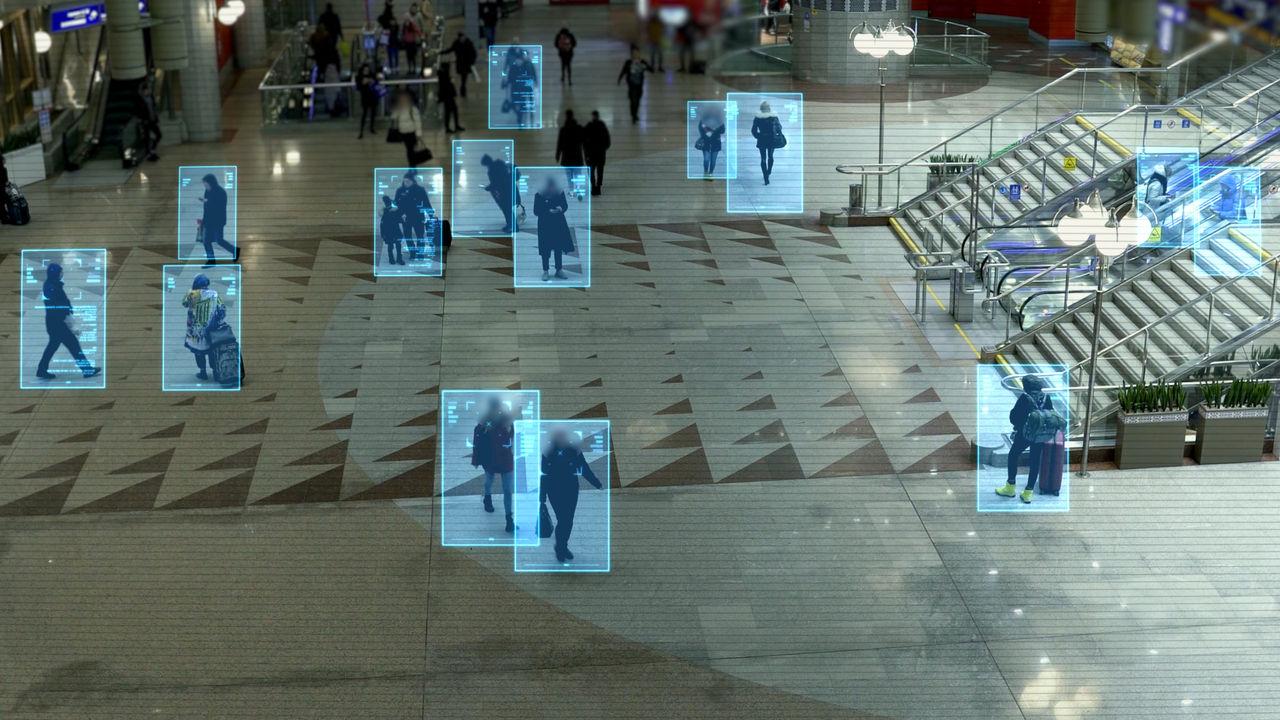

Aunque GPUHammer atrae muchos titulares, la seguridad de la inteligencia artificial abarca un espectro mucho más amplio que el ataque físico a memoria. Las cargas de trabajo de IA introducen superficies de ataque que las estrategias tradicionales de ciberseguridad no cubrían completamente: datos de entrenamiento, modelos, pipelines de inferencia, APIs de servicio y la propia infraestructura de GPU y aceleradoras.

La seguridad de la IA se centra en proteger estas cargas de trabajo frente a usos malintencionados o manipulaciones, garantizando que los modelos se ejecutan según lo previsto y sin interferencias externas. Eso implica salvaguardar la integridad de los datos de entrenamiento, asegurar la procedencia del modelo (saber quién, cómo y con qué se ha entrenado) y establecer mecanismos de aislamiento de GPU y otros aceleradores en las plataformas donde se alojan.

La mayoría de estrategias de seguridad corporativa se diseñaron para proteger aplicaciones clásicas: servidores web, bases de datos, estaciones de trabajo. En cambio, una solución de IA se parece más a un “edificio de apartamentos en otro planeta”: múltiples modelos, fuentes de datos heterogéneas, APIs externas, pipelines de MLOps, GPUs compartidas en la nube… y un gran número de puntos de entrada que quizá no se habían considerado como vectores de ataque.

Para que la IA sea confiable a nivel empresarial, hace falta una estrategia de seguridad específica que se integre con los controles ya existentes: segmentación de redes, gestión de identidades, cumplimiento normativo, supervisión continua y respuesta a incidentes. No basta con añadir un firewall más; es necesario entender cómo fluye el dato desde su origen hasta la inferencia, y dónde puede ser manipulado.

Infraestructura de IA: nuevos puntos débiles y requisitos de protección

Cuando pensamos en infraestructura de IA, no hablamos solo de servidores potentes: hablamos de un ecosistema completo que incluye GPU, almacenamiento de alto rendimiento, redes de baja latencia, plataformas de orquestación de contenedores, servicios cloud y herramientas de MLOps. Cada capa añade funcionalidades, pero también nuevas oportunidades para el atacante.

Uno de los puntos críticos es la falta de aislamiento fuerte en muchas GPU. Históricamente, las tarjetas gráficas no se diseñaron con el mismo nivel de compartimentación y mecanismos de seguridad que las CPU, lo que las convierte en objetivos atractivos. Ataques como GPUHammer explotan precisamente esta realidad: logs deficientes, poca visibilidad sobre accesos a memoria y una superficie privilegiada con capacidad de pasar bastante desapercibida.

A esto se suma que, en muchas organizaciones, se comparten recursos de GPU entre diferentes equipos, proyectos o incluso clientes (en entornos multi-tenant). Sin una segmentación clara y controles de acceso estrictos, es factible que una carga de trabajo maliciosa afecte a modelos de alto valor que se ejecutan en la misma máquina física.

Una estrategia de seguridad de IA bien planteada no solo protege datos sensibles frente a exfiltración, sino que aplica medidas preventivas frente a ataques sobre modelos, refuerza el cumplimiento regulatorio (por ejemplo, la Ley de IA de la UE), e integra capacidades de monitorización para detectar anomalías en la ejecución de las cargas de trabajo de IA.

En definitiva, cuanto mejor se comprenda la tecnología subyacente —cómo se entrena, despliega y escala la IA—, más sencillo es identificar y cerrar esas “puertas y ventanas” adicionales que no existen en la infraestructura TI tradicional.

Ataques adversarios: manipulando los datos para confundir a la IA

Más allá del hardware, la IA es especialmente vulnerable a los ataques adversarios, que se centran en manipular las entradas de los modelos (imágenes, audio, texto, datos tabulares) mediante perturbaciones muy pequeñas pero cuidadosamente diseñadas para provocar errores de clasificación o decisiones equivocadas.

En la práctica, un atacante introduce cambios imperceptibles para el ojo humano en una imagen de un panda y consigue que el modelo lo etiquete como un animal completamente distinto. Lo mismo puede ocurrir con señales de tráfico en vehículos autónomos, imágenes médicas en diagnóstico asistido o documentos usados por sistemas de control de fraude.

Estos ataques aprovechan el hecho de que los modelos de aprendizaje profundo basan su funcionamiento en patrones estadísticos de alta dimensión, no en “comprender” el contexto como una persona. Técnicas como el Método del Signo del Gradiente Rápido (FGSM), el Descenso de Gradiente Proyectado (PGD) o el ataque de Carlini & Wagner calculan perturbaciones que, con un mínimo cambio en los píxeles o en los vectores de entrada, maximizan la probabilidad de que el modelo se equivoque.

Los riesgos son claros: en un entorno sanitario, manipular de forma adversaria una resonancia puede llevar a diagnósticos erróneos; en ciberseguridad, ejemplos especialmente diseñados pueden permitir que malware pase desapercibido para detectores basados en IA; en reconocimiento facial, ligeras modificaciones en una imagen pueden suplantar identidades o evadir controles.

De hecho, ya existen demostraciones reales: ataques contra clasificadores de imágenes de grandes proveedores tecnológicos, comandos de voz ocultos en audio aparentemente inocuo para asistentes digitales o correos electrónicos ligeramente modificados para esquivar filtros de spam basados en machine learning.

Defensa frente a ataques adversarios: robustez y detección

Blindar la IA frente a ataques adversarios exige un enfoque en varias capas. Una de las tácticas más estudiadas es el entrenamiento adversario, que consiste en incluir ejemplos adversos durante el entrenamiento de los modelos para que aprendan a reconocer y resistir este tipo de perturbaciones. Aunque mejora mucho la robustez, también incrementa el coste computacional y no garantiza cubrir todos los vectores imaginables.

Otra línea de defensa es el preprocesamiento y validación de entradas. Operaciones como filtrado, suavizado de imágenes o reducción de ruido pueden mitigar perturbaciones, pero hay que aplicarlas con cuidado para no degradar la precisión del modelo en casos legítimos. Complementariamente, se utilizan técnicas de detección de anomalías y análisis estadístico para identificar patrones de entrada sospechosos.

También se investiga en arquitecturas más robustas de forma intrínseca, como la destilación defensiva o los enfoques de ensemble (combinar varios modelos y comparar sus salidas), que dificultan predecir exactamente cómo reaccionará el sistema ante pequeñas perturbaciones. La idea es reducir la sensibilidad del modelo a estos cambios microscópicos.

Aun así, defenderse de los ataques adversarios es un juego del gato y el ratón: cada avance defensivo suele ir seguido de nuevas técnicas de ataque que tratan de sortearlo. Por eso, además de mejorar los modelos, es importante establecer controles de contexto: quién puede enviar qué tipo de datos, en qué canal, bajo qué autenticación, y cómo se monitorizan los resultados anómalos.

Mirando al futuro, gana relevancia la IA explicable (XAI), que ayuda a entender por qué un modelo toma determinadas decisiones y a detectar patrones de comportamiento inusuales que podrían estar relacionados con un ataque adversario todavía desconocido.

No todo gira en torno a bits y modelos matemáticos; una parte importante de la amenaza viene de la ingeniería social reforzada por IA. Los atacantes están utilizando modelos de lenguaje, sistemas de análisis de datos y herramientas de generación de contenido para diseñar fraudes mucho más personalizados, creíbles y difíciles de detectar.

Lo que antes requería tiempo, habilidad psicológica y buena redacción —investigar a la víctima, entender su contexto y construir un mensaje convincente— ahora se puede automatizar. La IA permite recopilar información pública de redes sociales, webs corporativas y filtraciones, perfilar objetivos y generar en segundos correos, mensajes y scripts de llamadas con un tono adaptado a cada país, sector o cultura.

Expertos en ciberseguridad señalan que las barreras idiomáticas y culturales prácticamente han desaparecido para los atacantes. Un delincuente puede pedir a un asistente de chat con IA que redacte un correo creíble dirigido a empleados de una empresa en España, con referencias sectoriales correctas y un tono corporativo verosímil, sin necesidad de dominar el idioma.

Investigadores de amenazas destacan que esta capacidad ya se está explotando para campañas masivas de phishing, estafas y distribución de malware, donde lo que más ha mejorado es precisamente la calidad de la redacción y la ausencia de señales sospechosas típicas (faltas de ortografía, expresiones raras, etc.). Las páginas de phishing también se benefician de diseños más cuidados, con menos pistas visuales de fraude.

Con este contexto, los ataques dejan de ser tiros al aire para convertirse en campañas muy afinadas, con un nivel de personalización que hace que el destinatario perciba el mensaje como parte natural de su rutina digital.

Dentro de este ecosistema destacan varios tipos de ataques que se han visto amplificados por la inteligencia artificial:

Por un lado, el phishing personalizado mediante modelos de lenguaje, donde la IA analiza datos públicos y genera mensajes coherentes, bien redactados y alineados con el rol y el contexto de la víctima. Dejan de verse errores básicos, y los correos parecen comunicaciones internas legítimas sobre revisiones de seguridad, procesos de RR. HH. o incidencias técnicas.

Más dirigido aún es el spear phishing automatizado, que se centra en personas o grupos muy concretos dentro de una organización (dirección financiera, administradores de sistemas, mandos intermedios). La IA cruza perfiles sociales, jerarquías corporativas y relaciones de confianza para crear mensajes que encajan con proyectos reales y dinámicas internas conocidas.

En el terreno de la voz, el vishing con clonación de voz da un salto cualitativo. Modelos de IA son capaces de replicar el timbre y la entonación de una persona real con pocos segundos de audio. Una llamada que parece venir del CEO, de un proveedor clave o de un responsable de seguridad puede presionar a la víctima para que realice transferencias o cambie credenciales sin verificar por otros canales.

Otro frente es el smishing inteligente (phishing por SMS o mensajería instantánea), donde la IA analiza los hábitos de uso del móvil y elige el mejor momento, tono y contenido del mensaje para que la víctima haga clic en un enlace, descargue una app maliciosa o ceda credenciales. Los mensajes se camuflan como avisos de paquetería, notificaciones bancarias o comunicaciones de servicios habituales.

Finalmente, el uso de deepfakes de vídeo para suplantación ejecutiva multiplica el riesgo en entornos con videollamadas frecuentes. Un vídeo aparentemente real de un directivo solicitando una acción urgente genera una impresión visual y auditiva de autenticidad que derriba muchas barreras de verificación si no hay protocolos claros.

Chatbots maliciosos, suplantación de identidad y desinformación

La IA conversacional también se ha convertido en un arma para los atacantes. Los chatbots maliciosos con procesamiento de lenguaje natural pueden suplantar servicios de soporte, asistentes internos o canales oficiales de empresas. Mantienen conversaciones fluidas, responden rápido y van guiando a la víctima hasta que descarga un archivo malicioso o introduce credenciales en una web falsa.

Un nivel más sutil es la suplantación de identidad basada en patrones de comunicación. Aquí la IA aprende cómo escribe una persona real a partir de sus correos y mensajes previos: vocabulario, estructuras, coletillas, tono. El resultado son mensajes que “suenan” exactamente a esa persona, lo que reduce drásticamente la sospecha del receptor, sobre todo si se trata de alguien con autoridad dentro de la empresa.

En el plano colectivo, las campañas de desinformación automatizadas aprovechan modelos de generación de texto y análisis de emociones para producir y difundir contenidos falsos a gran escala. Bots coordinados amplifican mensajes, alimentan polarización o manipulan la percepción pública sobre temas políticos, sanitarios o económicos, con el objetivo de influir en decisiones sociales más que robar datos concretos.

También se han visto casos de grooming digital asistido por análisis semántico, donde la IA ayuda a identificar perfiles vulnerables (por ejemplo, menores en redes sociales) y ajustar el discurso del atacante para construir una relación progresiva de confianza y manipulación, con un riesgo especialmente alto por desarrollarse de forma lenta y silenciosa.

Por último, el baiting inteligente utiliza contenido generado por IA (documentos, supuestos informes, recursos exclusivos) ajustado a los intereses de la víctima para que esta descargue un archivo o acceda a un sitio malicioso creyendo que está aprovechando una oportunidad profesional o personal.

Más allá de los ataques intencionados, la IA también puede causar daños por sesgos y disparidades en sus datos y modelos. Cuando ciertas poblaciones están infrarrepresentadas o mal etiquetadas en los datos de entrenamiento, los sistemas resultantes tienden a ofrecer peores resultados para esos grupos, generando discriminaciones sutiles pero muy reales.

En sanidad, por ejemplo, se ha observado que los sistemas de diagnóstico asistido tienen menor precisión con pacientes afroamericanos que con pacientes blancos debido a la falta de datos equilibrados. Esto puede derivar en diagnósticos tardíos o incorrectos para determinados colectivos.

En el ámbito laboral, herramientas de IA utilizadas en procesos de selección pueden reforzar estereotipos. Algo tan aparentemente inocuo como usar la palabra “ninja” en una oferta de empleo puede atraer mayoritariamente a hombres, alterando el pool de candidatos sin que se haya pretendido de forma explícita discriminar a nadie.

Estudios sobre modelos de generación de imágenes muestran que muchas herramientas producen un mundo claramente sesgado: directivos casi siempre hombres blancos, mujeres rara vez representadas como médicas o juezas, hombres de piel oscura asociados a delitos y mujeres de piel oscura a trabajos precarios. Incluso cuando se piden imágenes neutras de profesionales, los resultados reproducen roles de género y raciales heredados de los datos.

En el sistema de justicia penal, las herramientas de policía predictiva basadas en IA suelen apoyarse en datos históricos de detenciones y patrullas. Si esos datos ya contienen sesgos raciales o geográficos, los modelos tienden a señalar una y otra vez las mismas zonas y comunidades, reforzando patrones de vigilancia desproporcionados y perpetuando la desigualdad.

La IA en ciberseguridad: arma de doble filo

En el terreno puramente defensivo, la IA se ha convertido también en una pieza clave de la ciberseguridad moderna. Desde 2025 y principios de 2026 se ha consolidado como herramienta fundamental para analizar grandes volúmenes de eventos, detectar comportamientos anómalos difíciles de ver a ojo humano, priorizar alertas y reducir los tiempos de respuesta ante incidentes.

Los sistemas basados en IA permiten correlacionar logs de múltiples fuentes, modelar el comportamiento normal de usuarios y dispositivos y disparar alertas en tiempo casi real cuando se detectan desviaciones, algo especialmente útil en entornos cloud e híbridos con miles de endpoints.

Sin embargo, la IA defensiva no sustituye al criterio humano ni a la necesidad de procesos maduros. Sin una estrategia clara, monitoreo constante y equipos formados, la automatización puede generar una falsa sensación de seguridad o, por el contrario, inundar a los analistas con alertas sin priorizar.

En estos años se ha visto que los atacantes también integran IA en su arsenal: mejores campañas de phishing, suplantaciones creíbles, reconocimiento automatizado de objetivos, generación de malware polimórfico y ajustes dinámicos de los ataques según las defensas que van encontrando. El resultado es un entorno donde tanto atacantes como defensores juegan con las mismas cartas tecnológicas, y la diferencia la marca la estrategia y la capacidad de adaptación.

De cara a los próximos años, la ventaja competitiva no estará simplemente en usar IA, sino en integrarla dentro de una arquitectura de seguridad 360º, con pruebas constantes, modelos actualizados, monitorización continua y una buena gestión del riesgo.

Todo este panorama —desde ataques físicos como GPUHammer que convierten una GPU en un dispositivo inservible para IA, hasta manipulaciones sutiles en datos, campañas de ingeniería social hiperpersonalizadas y sesgos estructurales con impacto social— deja claro que la seguridad de la inteligencia artificial ya no es opcional; es un requisito básico para poder seguir confiando en sistemas que, de una forma u otra, están empezando a influir en casi todas las decisiones relevantes de nuestra vida digital y, cada vez más, de la vida real.

Tabla de Contenidos

- Qué es GPUHammer y por qué puede destrozar la precisión de un modelo de IA

- El impacto de GPUHammer: de un 80 % de precisión a un 0,1 %

- Evolución de los ataques Rowhammer: de ZenHammer a GPUHammer

- Mitigaciones actuales: ECC, nuevas memorias y sus costes

- Seguridad de la IA: más allá del hardware y de GPUHammer

- Infraestructura de IA: nuevos puntos débiles y requisitos de protección

- Ataques adversarios: manipulando los datos para confundir a la IA

- Defensa frente a ataques adversarios: robustez y detección

- Ingeniería social potenciada por IA: precisión, automatización y engaño a escala

- Principales tipos de ataques de ingeniería social con IA

- Chatbots maliciosos, suplantación de identidad y desinformación

- Sesgos, disparidades y daños sociales causados por la IA

- La IA en ciberseguridad: arma de doble filo