- La IA permite detectar y responder a ciberamenazas y delitos físicos con mayor rapidez, precisión y contexto.

- Los atacantes también se apoyan en la IA para fraudes, deepfakes y automatizar la explotación de vulnerabilidades.

- Proteger la IA exige asegurar datos, modelos y API, con visibilidad completa en entornos híbridos y multicloud.

- Integrar seguridad desde el diseño y apostar por la resiliencia convierte la IA en una verdadera ventaja competitiva.

La inteligencia artificial aplicada a la seguridad se ha convertido en uno de los grandes temas de conversación en empresas, administraciones públicas y cuerpos de seguridad. El salto a la nube, los entornos híbridos y el crecimiento masivo de los datos han cambiado por completo el terreno de juego, y los atacantes se están aprovechando de ello a una velocidad de vértigo.

Al mismo tiempo, la IA abre una ventana de oportunidades enorme: desde detectar ciberataques en tiempo real hasta anticipar delitos físicos en determinadas zonas, pasando por automatizar tareas pesadas en los centros de operaciones de seguridad. Eso sí, todo este potencial viene acompañado de riesgos muy serios si no se protege bien la propia IA, sus datos y las interfaces que la rodean.

El nuevo panorama de amenazas y por qué la IA es clave

El entorno de ciberamenazas actual es mucho más complejo y agresivo que hace apenas unos años. La migración masiva a la nube y a arquitecturas híbridas ha hecho que las superficies de ataque se disparen: ahora hay datos repartidos entre centros de datos propios, distintos proveedores cloud y entornos edge, lo que complica enormemente el control.

Este cambio coincide con una clara escasez de profesionales de ciberseguridad. Solo en Estados Unidos hay cientos de miles de puestos sin cubrir, lo que se traduce en equipos saturados, con poco tiempo para investigar en profundidad y obligados a priorizar a toda prisa.

El resultado es que los ataques son hoy más frecuentes y más caros. Informes recientes sitúan el coste medio mundial de una brecha de datos por encima de los 4 millones de dólares, con incrementos acumulados de dos dígitos en apenas tres años. Cuando se analiza el efecto de la IA en estos incidentes, la diferencia es notable: las organizaciones que no utilizan IA en su estrategia de seguridad pagan, de media, bastante más por cada brecha que aquellas que sí la emplean.

Las empresas que cuentan con capacidades de seguridad basadas en IA consiguen recortar los costes medios de una filtración de datos en cientos de miles de dólares. Incluso disponer de controles de IA parciales o limitados supone una rebaja significativa frente a quienes no han invertido nada en este campo.

En este contexto, la IA no es solo “un plus”: se está convirtiendo en una pieza estratégica imprescindible para poder monitorizar grandes volúmenes de información de seguridad, detectar comportamientos anómalos y responder a incidentes antes de que escalen.

Cómo utilizan la IA los ciberdelincuentes

La otra cara de la moneda es que los mismos avances en IA que ayudan a defenderse también han sido rápidamente adoptados por los atacantes. La capacidad de generar contenido falso convincente a bajo coste está cambiando el fraude, la desinformación e incluso la extorsión personal.

Por un lado, los generadores de texto avanzados permiten crear noticias falsas, correos de phishing y mensajes de ingeniería social muy pulidos, adaptados al contexto de la víctima y con un estilo que imita a profesionales del periodismo o a directivos de empresa. Ya no hablamos de emails llenos de faltas, sino de comunicaciones muy creíbles.

Por otro lado, las herramientas para crear deepfakes de vídeo y audio han dado un salto brutal. Con software especializado, los atacantes pueden superponer rostros en vídeos reales (deepfaces) o clonar voces (deepvoices) con un nivel de realismo que engaña fácilmente a cualquiera que no esté prevenido.

Un caso ilustrativo es el fraude telefónico basado en la clonación de la voz de un familiar. Los delincuentes, tras obtener grabaciones de audio de una persona, entrenan un modelo capaz de imitar su tono, acento y forma de hablar. Luego llaman a un pariente haciéndose pasar por ese familiar, inventan una emergencia y solicitan una transferencia urgente de dinero. Al reconocer la voz, la víctima baja completamente la guardia.

Más allá del engaño directo, la IA también se utiliza para automatizar el descubrimiento de vulnerabilidades, perfeccionar ataques de fuerza bruta contra credenciales o redactar código malicioso. Las fuerzas de seguridad y organismos como el FBI ya han detectado un aumento claro de intrusiones relacionadas con el uso malicioso de IA generativa, y muchos responsables de ciberseguridad reconocen que una parte importante del crecimiento de los ataques se debe justamente a estas nuevas herramientas.

Aplicaciones de la IA en ciberseguridad: del endpoint a la nube

Frente a este aumento del riesgo, la IA también está transformando la defensa cibernética en toda la pila tecnológica. Las empresas integran capacidades de machine learning tanto en soluciones de endpoint como en firewalls, plataformas SIEM o herramientas específicas para la nube.

En el extremo del usuario, las soluciones de seguridad de endpoint impulsadas por IA analizan continuamente el comportamiento de procesos, ficheros y conexiones. En lugar de basarse solo en firmas, aprenden qué es “normal” en cada dispositivo y detectan desviaciones sospechosas, como la ejecución repentina de scripts desconocidos o el cifrado masivo de archivos típico de un ransomware.

Los firewalls de nueva generación basados en IA (NGFW con capacidades inteligentes) son capaces de inspeccionar tráfico cifrado, detectar patrones anómalos y correlacionar eventos en múltiples puertos y protocolos. Esto permite frenar comunicaciones con servidores de mando y control o bloquear intentos de exfiltración de datos que, de otro modo, pasarían bajo el radar.

En la capa de supervisión global, las plataformas de Security Information and Event Management (SIEM) y las soluciones XDR generan miles de alertas diarias. La IA se usa para priorizar, agrupar eventos relacionados y convertir esa avalancha de datos crudos en unos pocos incidentes de alto impacto que realmente merecen atención inmediata.

Además, en entornos cloud se despliegan soluciones de seguridad específicas basadas en IA que identifican errores de configuración, permisos excesivos o movimientos de datos inusuales entre regiones y servicios. A esto se suman tecnologías de Network Detection and Response (NDR) impulsadas por IA que vigilan el tráfico interno de red en busca de comportamientos propios de un atacante ya dentro del sistema.

Beneficios de la IA para los equipos de seguridad

Los equipos de ciberseguridad se enfrentan a un reto doble: gestionar un volumen de datos inmenso y una complejidad técnica creciente. Aquí la IA se ha convertido en un aliado fundamental para hacer más con los mismos recursos.

Uno de los beneficios más claros es la detección de amenazas mucho más rápida. Donde antes un analista tenía que revisar eventos de forma manual, ahora los algoritmos aprenden patrones de ataque, costumbres de los usuarios y comportamientos típicos de cada sistema. Con ello identifican incidentes críticos en cuestión de segundos, incluso cuando se manifiestan como una combinación de señales sutiles repartidas en distintos orígenes de datos.

Otro punto clave es la reducción de falsos positivos y falsos negativos. Mediante técnicas de reconocimiento de patrones, detección de anomalías y aprendizaje continuo, la IA consigue filtrar el “ruido” de las alertas irrelevantes y centrarse en las que realmente representan una amenaza. Esto evita que los equipos se quemen atendiendo avisos que, al final, no llevan a nada.

La IA generativa también está cambiando la forma en que los analistas trabajan con la información. Al poder traducir datos técnicos a lenguaje natural, las herramientas pueden elaborar informes claros que se comparten fácilmente con directivos u otros departamentos, explicar qué implica una vulnerabilidad concreta o detallar los pasos recomendados para corregirla.

Esta capacidad de presentar la información de manera comprensible y guiar la respuesta hace que los analistas junior puedan asumir tareas más complejas sin necesidad de dominar lenguajes de consulta o herramientas avanzadas desde el primer día. En la práctica, la IA genera pasos de remediación, sugerencias concretas y contexto adicional que acelera la curva de aprendizaje.

Por último, la IA aporta una visión más completa del entorno al agregar y correlacionar datos de registros de seguridad, tráfico de red, telemetría de la nube y fuentes externas de inteligencia de amenazas. Esto ayuda a revelar patrones de ataque que, visto desde un único sistema, pasarían desapercibidos.

Autenticación, contraseñas y análisis de comportamiento

Más allá de la detección de intrusiones, la IA está cambiado la forma en que se protegen las identidades y se gestionan los accesos. Las contraseñas tradicionales siguen existiendo, pero cada vez más se combinan con modelos de análisis de comportamiento y factores adicionales impulsados por IA.

La IA se emplea en sistemas de autenticación adaptativa que valoran el contexto de cada inicio de sesión: ubicación, dispositivo, horario, historial de uso, velocidad de tecleo y otros factores. Si algo se sale de lo habitual, el sistema incrementa el nivel de seguridad pidiendo factores extra o bloqueando la sesión.

En paralelo, las soluciones de análisis conductual permiten detectar intentos de suplantación de identidad o cuentas comprometidas estudiando cómo interactúan los usuarios con las aplicaciones, qué recursos consultan y cómo se mueven por la red. Un cambio acusado en esos patrones puede indicar que alguien está utilizando unas credenciales robadas.

La administración de vulnerabilidades también se apoya en la IA para ir más allá de las típicas listas interminables de fallos. Los modelos analizan qué vulnerabilidades tienen mayor probabilidad de ser explotadas según la actividad real de los atacantes, la disponibilidad de exploits públicos y la exposición de cada activo, ayudando a priorizar los esfuerzos de parcheo.

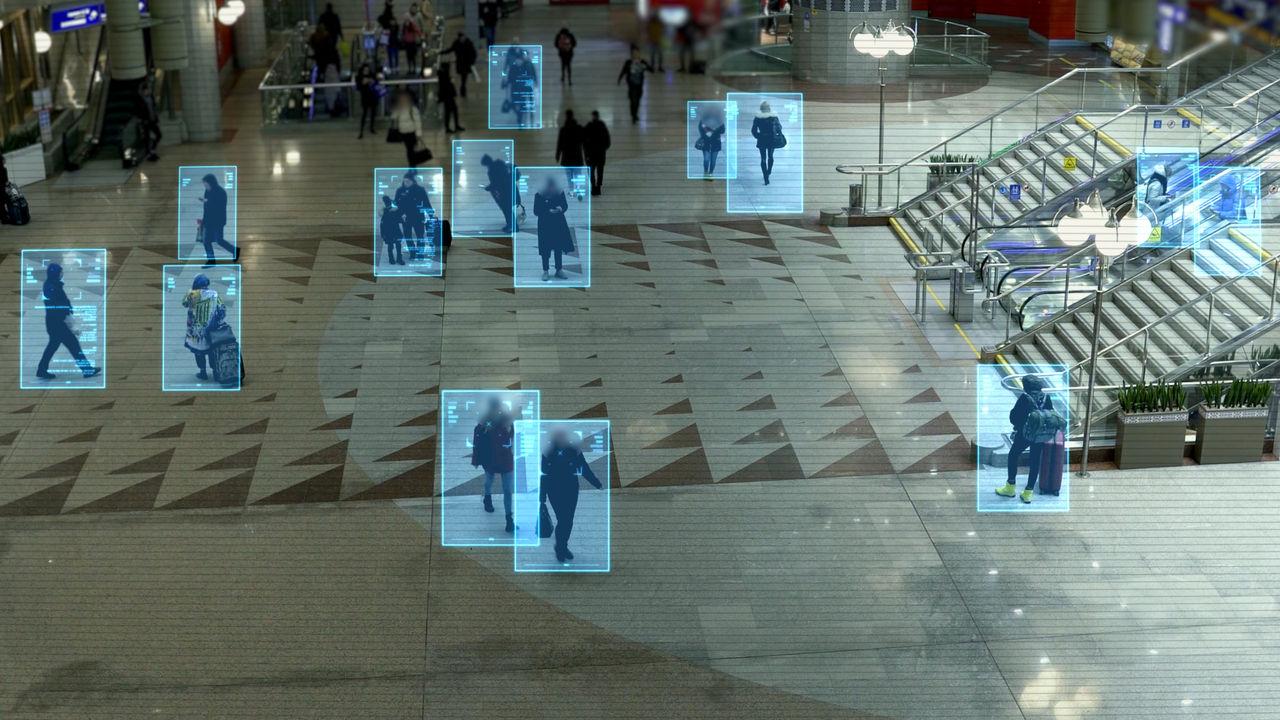

En entornos físicos, la vigilancia con cámaras y sensores se potencia con modelos de IA capaces de detectar comportamientos sospechosos, identificar matrículas, reconocer patrones de movimiento o avisar de aglomeraciones inusuales. Al combinar esta información con datos históricos y contexto, se pueden activar sistemas de alerta temprana en zonas de elevada actividad delictiva.

Prevención y predicción de delitos en el mundo físico

Fuera del ciberespacio, la IA también empieza a jugar un papel importante en la prevención de delitos en entornos urbanos. Al analizar grandes volúmenes de datos históricos, las autoridades pueden localizar patrones que ayuden a planificar mejor los recursos.

Entre las aplicaciones más habituales está el análisis de patrones delictivos: qué tipo de delitos se concentran en determinadas zonas, a qué horas son más frecuentes o cómo evolucionan con el tiempo. Esta información sirve para ajustar patrullas, mejorar la iluminación, instalar cámaras adicionales o diseñar campañas de prevención específicas.

La IA también se usa en sistemas de alerta temprana que combinan datos en tiempo real (cámaras, sensores, redes sociales, incluso variables meteorológicas) para estimar cuándo es más probable que se produzcan determinados incidentes. Aunque no son sistemas infalibles, pueden ayudar a anticipar escenarios de riesgo.

En el ámbito de la investigación, los algoritmos permiten realizar análisis forense digital de grandes volúmenes de datos forenses (huellas, ADN, registros de casos, historiales de detenciones) para identificar conexiones que, a simple vista, serían muy difíciles de ver. De este modo se pueden relacionar casos aparentemente independientes o afinar la búsqueda de sospechosos.

Todo este despliegue debe equilibrarse constantemente con el respeto a la privacidad y a los derechos humanos. El riesgo de sesgos en los datos de entrenamiento es real: si los modelos se alimentan de historiales policiales ya sesgados, pueden reforzar discriminaciones existentes al “predecir” más delitos en comunidades concretas, aunque el problema de fondo sea otro.

Riesgos y desafíos: seguridad de los datos, de los modelos y de las API

Para que la IA sea fiable, la seguridad ya no puede limitarse a proteger servidores o redes. Es imprescindible proteger la propia inteligencia: los datos que alimentan los modelos, las arquitecturas de IA y las interfaces que los hacen accesibles.

Los modelos solo son tan buenos como sus datos de entrenamiento. Si esos datos están manipulados o sesgados, la IA tomará decisiones erróneas. Un ejemplo muy claro se ve en modelos utilizados para procesos de selección de personal: si se entrenan con historiales donde se han favorecido de forma sistemática ciertos perfiles, la IA puede reforzar sesgos de género, raza u origen, discriminando a candidatos perfectamente válidos.

En el terreno puramente técnico, los modelos de lenguaje y otras IAs avanzadas afrontan nuevas categorías de ataques, como la inyección de prompts. Consiste en esconder instrucciones maliciosas en la entrada de datos para alterar el comportamiento del modelo, eludir restricciones o provocar que devuelva información perjudicial.

Otro gran riesgo es la exposición de información sensible. Si los sistemas están mal configurados, pueden revelar datos confidenciales de clientes, secretos industriales o fragmentos del propio conjunto de entrenamiento, ya sea directamente o a través de técnicas como la inferencia de pertenencia o la extracción de modelos.

Las API utilizadas para acceder, entrenar o explotar modelos de IA representan un frente crítico. Sin una autenticación robusta, limitación de peticiones y validación de entradas, se convierten en objetivos fáciles para ataques de fuerza bruta, scraping masivo o cambios no autorizados en los parámetros del modelo. No es casual que una mayoría de empresas haya sufrido incidentes de seguridad relacionados con API en los últimos meses.

Complejidad de los entornos híbridos y necesidad de visibilidad total

La mayoría de organizaciones ejecuta sus soluciones de IA en infraestructuras híbridas que combinan nube pública, nube privada, on-premise y, cada vez más, edge computing. Esta dispersión dificulta mantener una visión clara de dónde están los datos, cómo se mueven y quién tiene acceso en cada momento.

La falta de visibilidad genera controles fragmentados y puntos ciegos. Hay modelos que se entrenan en un cloud, se afinan en otro y luego se despliegan en distintos países, con datos que saltan de un entorno a otro. Sin una observabilidad adecuada, es fácil que surjan brechas de seguridad o incumplimientos regulatorios sin que nadie los detecte a tiempo.

Además, a diferencia del software tradicional, los modelos de IA evolucionan con el uso. Pueden ir adaptando sus parámetros según los nuevos datos que procesan, lo que complica detectar si han sido manipulados o si han ido desviándose poco a poco de su comportamiento esperado.

Por todo ello, es crucial desplegar monitorización continua y analítica avanzada, incluida la seguridad en tu homelab, sobre el rendimiento, las respuestas y las decisiones de los modelos. Solo así se pueden identificar patrones extraños, degradaciones sutiles o intentos de ataque que pasan desapercibidos en los logs clásicos.

Esta necesidad de control se extiende también a las capas de red y aplicación. Tecnologías de protección de aplicaciones web y API, combinadas con capacidades de inspección profunda del tráfico, permiten detectar consultas sospechosas, intentos de extracción de datos o comportamientos anómalos hacia los servicios de IA, bloqueándolos antes de que comprometan información sensible.

Seguridad desde el diseño y resiliencia como ventaja competitiva

Para que la IA sea una palanca real de negocio y no una fuente constante de sustos, la seguridad tiene que integrarse desde el primer día. No vale con montar el modelo, ponerlo en producción y, después, parchear con prisas.

Una estrategia madura pasa por validar y proteger los datos en todas las fases, aplicar controles de acceso estrictos, separar entornos de desarrollo, pruebas y producción, y firmar criptográficamente los artefactos del modelo para garantizar su integridad a lo largo del ciclo de vida.

También es clave diseñar capacidades de detección y respuesta automatizada: cuando un modelo se comporta de forma extraña, cuando una API recibe un patrón de peticiones anómalo o cuando se detecta un cambio inesperado en un dataset, el sistema debe poder reaccionar rápido, aislar componentes y avisar a los equipos adecuados.

La resiliencia, entendida como la capacidad de la IA para resistir ataques y recuperarse sin perder funcionalidad, se está convirtiendo en un factor de confianza esencial para los directivos. Si la organización sabe que sus modelos son seguros, observables y cumplen con la normativa, tendrá mucha más libertad para innovar y experimentar con casos de uso avanzados.

En la práctica, muchas empresas combinan servicios especializados de ciberseguridad con soluciones de protección de aplicaciones y gestión de tráfico que permiten aplicar estrategias de defensa en profundidad: inspección avanzada de tráfico, aislamiento de entornos, mitigación de exposición de datos, monitorización de modelos y enrutado inteligente de solicitudes según coste, cumplimiento y rendimiento.

Todo esto no elimina la necesidad de supervisión humana, pero sí reduce drásticamente las tareas manuales y repetitivas. La IA se encarga del triage de alertas, la correlación de eventos y el resumen de información, mientras que los especialistas se centran en entender la intención de los atacantes, investigar incidentes complejos y diseñar ciberdefensas más robustas.

En última instancia, el uso de IA en seguridad exige asumir tres ideas básicas: que IA y seguridad deben avanzar juntas, que proteger la IA implica blindar datos, modelos e interfaces (no solo infraestructura) y que la resiliencia generada por una IA bien protegida se traduce en una ventaja competitiva real frente a quienes improvisan sobre la marcha.

La inteligencia artificial ha dejado de ser un experimento en los márgenes para convertirse en el motor de la innovación digital en prácticamente todos los sectores. Incorporarla a la seguridad —y, a la vez, protegerla adecuadamente— permite reducir el impacto de las brechas, adelantarse a las amenazas, mejorar la prevención de delitos y liberar a los equipos humanos de gran parte del trabajo pesado, siempre que se mantenga un equilibrio cuidadoso entre eficacia, ética y respeto a los derechos de las personas.

Tabla de Contenidos

- El nuevo panorama de amenazas y por qué la IA es clave

- Cómo utilizan la IA los ciberdelincuentes

- Aplicaciones de la IA en ciberseguridad: del endpoint a la nube

- Beneficios de la IA para los equipos de seguridad

- Autenticación, contraseñas y análisis de comportamiento

- Prevención y predicción de delitos en el mundo físico

- Riesgos y desafíos: seguridad de los datos, de los modelos y de las API

- Complejidad de los entornos híbridos y necesidad de visibilidad total

- Seguridad desde el diseño y resiliencia como ventaja competitiva