- Изкуственият интелект позволява откриването и реагирането на киберзаплахи и физически престъпления с по-голяма скорост, точност и контекст.

- Атакуващите също разчитат на изкуствен интелект за измами, фалшиви атаки и автоматизиране на експлоатацията на уязвимости.

- Защитата на изкуствения интелект изисква осигуряване на сигурност на данни, модели и API, с пълна видимост в хибридни и многооблачни среди.

- Интегрирането на сигурността още при проектирането и фокусирането върху устойчивостта превръщат изкуствения интелект в истинско конкурентно предимство.

La изкуствен интелект, приложен в сигурността Това се превърна в една от най-големите теми за разговор в бизнеса, публичната администрация и правоприлагащите органи. Преминаването към облачни технологии, хибридните среди и огромният растеж на данните напълно промениха условията на игра, а нападателите се възползват от това с главоломна скорост.

В същото време, изкуственият интелект отваря огромен прозорец от възможности: от откриване на кибератаки в реално време Това включва предвиждане на физически престъпления в специфични области и автоматизиране на досадни задачи в центровете за сигурност. Целият този потенциал обаче е свързан с много сериозни рискове, ако самият изкуствен интелект, неговите данни и интерфейсите около него не са правилно защитени.

Новият пейзаж на заплахите и защо изкуственият интелект е ключов

Настоящата среда на киберзаплахи е много по-сложно и агресивно което беше само преди няколко години. Масовата миграция към облачните и хибридни архитектури доведе до рязко увеличение на повърхностите за атаки: сега данните са разпръснати в локални центрове за данни, различни доставчици на облачни услуги и периферни среди, което значително усложнява контрола.

Тази промяна съвпада с ясно недостиг на специалисти по киберсигурностСамо в Съединените щати има стотици хиляди незаети позиции, което води до претоварени екипи с малко време за задълбочени проучвания и принудени да приоритизират прибързано.

Резултатът е, че атаките се случват днес. по-често и по-скъпоПоследните доклади посочват, че средна глобална цена на нарушение на данните надхвърляйки 4 милиона долара, с кумулативно двуцифрено увеличение само за три години. При анализа на въздействието на изкуствения интелект върху тези инциденти, разликата е поразителна: организациите, които не използват изкуствен интелект в своята стратегия за сигурност, плащат средно значително повече за всяко нарушение, отколкото тези, които го правят.

Компании, които имат Възможности за сигурност, базирани на изкуствен интелект Те успяват да намалят средните разходи за нарушение на данните със стотици хиляди долари. Дори частичният или ограничен контрол с изкуствен интелект представлява значителна икономия в сравнение с тези, които не са инвестирали нищо в тази област.

В този контекст, изкуственият интелект не е просто „бонус“: той се превръща в важен стратегически елемент да могат да наблюдават големи обеми от информация за сигурността, да откриват аномално поведение и да реагират на инциденти, преди те да ескалират.

Как киберпрестъпниците използват изкуствен интелект

Другата страна на монетата е, че същите постижения в областта на изкуствения интелект, които помагат в защитата, са били... бързо възприети от нападателитеСпособността за генериране на убедително фалшиво съдържание на ниска цена променя измамите, дезинформацията и дори личното изнудване.

От една страна, усъвършенстваните генератори на текст ви позволяват да създавате фалшиви новини, фишинг имейли И висококачествени съобщения, използвани чрез социално инженерство, съобразени с контекста на жертвата и написани в стил, имитиращ журналисти или бизнес ръководители. Вече не говорим за имейли, пълни с грешки, а по-скоро за изключително достоверни комуникации.

От друга страна, инструментите за създаване видео и аудио дийпфейкове Те направиха гигантска крачка напред. Със специализиран софтуер, нападателите могат да наслагват лица върху реални видеоклипове (deepfaces) или да клонират гласове (deepvoices) с ниво на реализъм, което лесно заблуждава всеки, който не е подготвен.

Илюстративен случай е телефонната измама, основана на клониране на глас на член на семействотоСлед като получат аудиозаписи на дадено лице, престъпниците обучават модел, способен да имитира неговия тон, акцент и начин на говорене. След това се обаждат на роднина, представяйки се за негов член, изфабрикуват спешен случай и искат спешен паричен превод. След като разпознаят гласа, жертвата напълно сваля гарда си.

Освен откровената измама, изкуственият интелект се използва и за автоматизиране на откриването на уязвимостиТова включва усъвършенстване на атаки с груба сила срещу идентификационни данни или писане на зловреден код. Правоприлагащите органи и организации като ФБР вече са засекли ясно увеличение на проникванията, свързани със злонамереното използване на генеративен изкуствен интелект, а много специалисти по киберсигурност признават, че значителна част от ръста на атаките се дължи именно на тези нови инструменти.

Приложения на изкуствен интелект в киберсигурността: от крайна точка до облак

Изправен пред този повишен риск, изкуственият интелект също трансформира киберзащита в целия технологичен стекКомпаниите интегрират възможности за машинно обучение в решения за крайни точки, защитни стени, SIEM платформи и инструменти, специфични за облака.

От страна на потребителя, решенията на Защита на крайните точки, задвижвана от изкуствен интелект Те непрекъснато анализират поведението на процесите, файловете и връзките. Вместо да разчитат единствено на сигнатури, те научават какво е „нормално“ на всяко устройство и откриват подозрителни отклонения, като например внезапното изпълнение на неизвестни скриптове или масовото криптиране на файлове, типично за ransomware.

Защитни стени от следващо поколение, базирани на изкуствен интелект (NGFW с интелигентни възможности), са способни проверява криптиран трафик, открива аномални модели и да съпоставят събития между множество портове и протоколи. Това позволява прекъсване на комуникациите със сървъри за командване и контрол или блокиране на опити за изтичане на данни, които иначе биха останали незабелязани.

На глобалния мониторингов слой, платформите на Информация за сигурността и управление на събития (SIEM) А XDR решенията генерират хиляди сигнали дневно. Изкуственият интелект се използва за приоритизиране, групиране на свързани събития и превръщане на тази лавина от сурови данни в няколко инцидента с голямо въздействие, които наистина заслужават незабавно внимание.

Освен това, те са разположени в облачни среди Целенасочени решения за сигурност, базирани на изкуствен интелект Тези технологии идентифицират неправилни конфигурации, прекомерни разрешения или необичайно движение на данни между региони и услуги. В допълнение, технологиите за откриване и реагиране в мрежа (NDR), задвижвани от изкуствен интелект, наблюдават вътрешния мрежов трафик за поведение, типично за нападател, който вече е в системата.

Предимства на изкуствения интелект за екипите по сигурността

Екипите по киберсигурност са изправени пред двойно предизвикателство: управление на огромен обем данни и нарастваща техническа сложностТук изкуственият интелект се превърна в ключов съюзник за постигане на повече резултати със същите ресурси.

Едно от най-ясните предимства е много по-бързо откриване на заплахиДокато преди анализаторите трябваше ръчно да преглеждат събитията, сега алгоритмите изучават модели на атаки, потребителски навици и типично системно поведение. Това им позволява да идентифицират критични инциденти за секунди, дори когато те се проявяват като комбинация от фини сигнали, разпръснати в различни източници на данни.

Друг ключов момент е намаляване на фалшиво положителните и фалшиво отрицателните резултатиИзползвайки разпознаване на модели, откриване на аномалии и техники за непрекъснато обучение, изкуственият интелект филтрира „шума“ от неподходящи сигнали и се фокусира върху тези, които наистина представляват заплаха. Това предотвратява прегарянето на екипите, като реагират на сигнали, които в крайна сметка не водят до никъде.

Генеративният изкуствен интелект променя и начина, по който анализаторите работят с информация. Като е способен превеждат технически данни на естествен езикИнструментите могат да генерират ясни отчети, които лесно се споделят с мениджъри или други отдели, да обясняват какво представлява дадена уязвимост или да описват подробно препоръчителните стъпки за нейното коригиране.

Тази способност да се представя информацията по разбираем начин и да се насочва отговорът я прави Младшите анализатори могат да поемат по-сложни задачи без да е необходимо да овладявате езици за заявки или усъвършенствани инструменти от първия ден. На практика, изкуственият интелект генерира стъпки за отстраняване на проблеми, конкретни предложения и допълнителен контекст, който ускорява кривата на обучение.

И накрая, изкуственият интелект предоставя по-пълна представа за околната среда, обобщаване и съпоставяне на данни записи за сигурност, мрежов трафикОблачната телеметрия и външните източници на информация за заплахи помагат за разкриването на модели на атаки, които иначе биха останали незабелязани от една-единствена система.

Удостоверяване, пароли и поведенчески анализ

Отвъд откриването на проникване, изкуственият интелект променя начина, по който... Самоличността е защитена, а достъпът се управляваТрадиционните пароли все още съществуват, но те все по-често се комбинират с модели за поведенчески анализ и допълнителни фактори, задвижвани от изкуствен интелект.

Изкуственият интелект се използва в системи от адаптивно удостоверяване Те оценяват контекста на всяко влизане: местоположение, устройство, време, история на употреба, скорост на писане и други фактори. Ако нещо изглежда необичайно, системата повишава нивото на сигурност, като изисква допълнителна информация или блокира сесията.

Успоредно с това, решенията за поведенчески анализ позволяват откриване на опити за фишинг или компрометирани акаунти чрез изучаване на това как потребителите взаимодействат с приложенията, до какви ресурси имат достъп и как навигират в мрежата. Значителна промяна в тези модели може да показва, че някой използва откраднати идентификационни данни.

Управлението на уязвимостите също разчита на изкуствен интелект, за да надхвърли типичните безкрайни списъци с недостатъци. Моделите анализират кои уязвимости е най-вероятно да бъдат използвани въз основа на действителната активност на нападателите, наличието на публични експлойти и изложеността на всеки актив, което помага за приоритизиране на усилията за отстраняване на закърпвания.

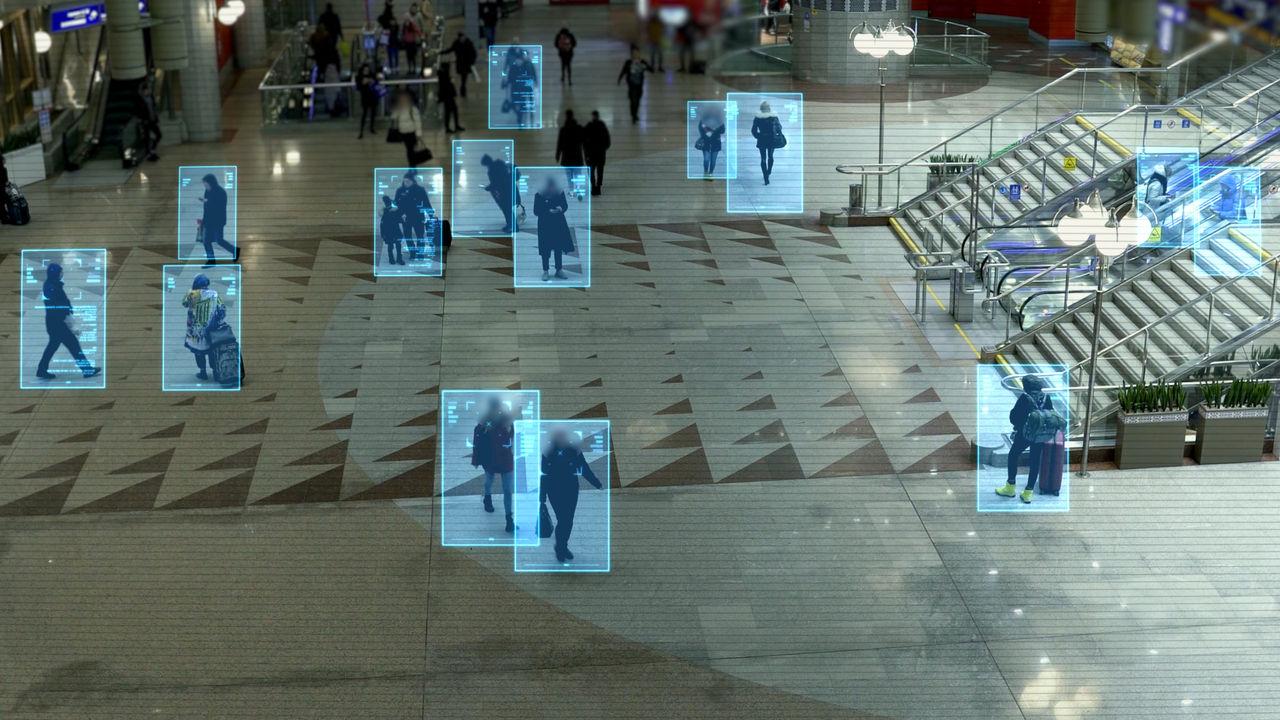

Във физически среди, наблюдение с камери и сензори Захранва се от модели с изкуствен интелект, способни откриване на подозрително поведениеИдентифициране на регистрационни номера, разпознаване на модели на движение или предупреждаване за необичайни събирания. Чрез комбиниране на тази информация с исторически данни и контекст, системите за ранно предупреждение могат да бъдат активирани в райони с висока престъпна активност.

Предотвратяване и прогнозиране на престъпления във физическия свят

Извън киберпространството, изкуственият интелект също започва да играе важна роля в превенция на престъпността в градска средаЧрез анализ на големи обеми от исторически данни, властите могат да идентифицират модели, които им помагат да планират по-добре ресурсите.

Сред най-често срещаните приложения е анализ на моделите на престъпностТази информация помага да се определи какви видове престъпления са концентрирани в определени райони, в кое време са най-чести и как се развиват с течение на времето. Тя се използва за коригиране на патрулите, подобряване на осветлението, инсталиране на допълнителни камери и разработване на целенасочени превантивни кампании.

Изкуственият интелект се използва и в системи за ранно предупреждение Тези системи комбинират данни в реално време (камери, сензори, социални медии, дори метеорологични променливи), за да преценят кога е най-вероятно да се случат определени инциденти. Макар и да не са непогрешими, те могат да помогнат за предвиждане на рискови сценарии.

В областта на научните изследвания алгоритмите позволяват извършване на дигитален криминалистичен анализ Те използват големи обеми от криминалистични данни (пръстови отпечатъци, ДНК, досиета, история на арести), за да идентифицират връзки, които биха били много трудни за откриване на пръв поглед. Това им позволява да свържат привидно несвързани случаи или да прецизират търсенето на заподозрени.

Цялото това внедряване трябва да бъде постоянно балансирано с зачитане на неприкосновеността на личния живот и човешките праваРискът от пристрастност в данните от обучението е реален: ако моделите се захранват с вече пристрастни полицейски досиета, те могат да засилят съществуващата дискриминация, като „предсказват“ повече престъпления в определени общности, въпреки че основният проблем е нещо друго.

Рискове и предизвикателства: сигурност на данните, сигурност на модела и сигурност на API

За да бъде надежден изкуственият интелект, сигурността вече не може да се ограничава само до защита на сървъри или мрежи. Тя е от съществено значение. защита на собствения интелект: данните, които захранват моделите, архитектурите на изкуствения интелект и интерфейсите, които ги правят достъпни.

Моделите са толкова добри, колкото са добри техните данни за обучение. Ако тези данни са... манипулирани или предубедениИзкуственият интелект ще взема погрешни решения. Много ясен пример може да се види в моделите, използвани за процесите на подбор на персонал: ако те са обучени с история, в която определени профили са били систематично предпочитани, изкуственият интелект може да засили предразсъдъците, основани на пол, раса или произход, дискриминирайки напълно квалифицирани кандидати.

На чисто техническо ниво, езиковите модели и други усъвършенствани изкуствени интелекти са изправени пред нови категории атаки, като например бърза инжекцияСъстои се от скриване на злонамерени инструкции във входните данни, за да се промени поведението на модела, да се заобиколят ограниченията или да се накара той да връща вредна информация.

Друг основен риск е разкриване на чувствителна информацияАко системите са неправилно конфигурирани, те могат да разкрият поверителни данни за клиентите, търговски тайни или фрагменти от самия набор за обучение, директно или чрез техники като извод за членство или извличане на модел.

API-тата, използвани за достъп, обучение или използване на модели на изкуствен интелект, представляват критичен фронт. Без такъв надеждно удостоверяване, ограничаване на заявките и валидиране на входните данниТе стават лесни мишени за атаки с груба сила, масово извличане на данни или неоторизирани промени в параметрите на модела. Не е случайно, че през последните месеци повечето компании са претърпели инциденти със сигурността, свързани с API.

Сложност на хибридните среди и необходимостта от пълна видимост

Повечето организации използват своите решения с изкуствен интелект в хибридни инфраструктури които комбинират публичен облак, частен облак, локални и все по-често периферни изчисления. Тази разпръснатост затруднява поддържането на ясна представа къде се намират данните, как се движат и кой има достъп до тях във всеки един момент.

Липсата на видимост поражда фрагментирани контроли и слепи зониНякои модели се обучават в един облак, усъвършенстват се в друг и след това се внедряват в различни страни, като данните се преместват от една среда в друга. Без адекватна наблюдаемост, пробиви в сигурността или несъответствия с регулаторните изисквания могат лесно да възникнат, без никой да ги открие навреме.

Освен това, за разлика от традиционния софтуер, моделите с изкуствен интелект Те се развиват с употребатаТе могат да адаптират параметрите си според новите данни, които обработват, което затруднява откриването дали са били манипулирани или постепенно са се отклонили от очакваното си поведение.

Следователно е изключително важно да се внедри непрекъснато наблюдение и усъвършенствани анализи, включително сигурност във вашата домашна лабораторияЩо се отнася до производителността, отговорите и решенията на моделите, само по този начин могат да бъдат идентифицирани странни модели, фини деградации или опити за атаки, които остават незабелязани в традиционните лог файлове.

Тази нужда от контрол се простира и до мрежовия и приложния слой. Технологиите за защита на уеб приложенията и API, комбинирани с възможности за задълбочена проверка на трафика, позволяват откриването на подозрителни запитвания, опити за извличане на данни или аномално поведение спрямо услуги с изкуствен интелект, блокирайки ги, преди да компрометират чувствителна информация.

Сигурност по дизайн и устойчивост като конкурентно предимство

За да бъде изкуственият интелект истински лост за бизнеса, а не постоянен източник на страхове, сигурността трябва интегрира от първия денНе е достатъчно просто да се построи моделът, да се пусне в производство и след това да се закърпи набързо.

Зрялата стратегия включва валидирайте и защитете данните Във всички фази прилагайте строги контроли за достъп, отделни среди за разработка, тестване и производство и криптографски подписвайте артефактите на модела, за да осигурите тяхната цялост през целия жизнен цикъл.

Това е ключово и за дизайнерските възможности на автоматизирано откриване и реагиранеКогато даден модел се държи странно, когато API получи аномален модел на заявка или когато се открие неочаквана промяна в набор от данни, системата трябва да може да реагира бързо, да изолира компоненти и да уведоми съответните екипи.

Устойчивост, разбирана като способността на ИИ да издържат на атаки и се възстановяват без загуба на функционалностТова се превръща в съществен фактор за доверието на мениджърите. Ако една организация знае, че нейните модели са сигурни, наблюдаеми и съвместими, тя ще има много повече свобода да внедрява иновации и да експериментира с напреднали случаи на употреба.

На практика много компании комбинират специализирани услуги за киберсигурност с решения за защита на приложенията и управление на трафика които позволяват прилагането на стратегии за дълбока защита: разширена проверка на трафика, изолиране на средата, смекчаване на излагането на данни, наблюдение на модели и интелигентно маршрутизиране на заявки въз основа на цена, съответствие и производителност.

Всичко това не елиминира нуждата от човешки надзор, но драстично намалява ръчните и повтарящи се задачи. Изкуственият интелект обработва сигналите за тревоги, корелацията на събитията и обобщаването на информацията, докато специалистите се фокусират върху разбирането на намеренията на нападателите, разследването на сложни инциденти и проектирането на по-стабилна киберзащита.

В крайна сметка, използването на изкуствен интелект в сигурността изисква приемането на три основни идеи: че Изкуственият интелект и сигурността трябва да се развиват заедно.Защитата на ИИ включва опазване на данни, модели и интерфейси (не само инфраструктура), а устойчивостта, генерирана от добре защитен ИИ, се превръща в реално конкурентно предимство пред тези, които импровизират в движение.

Изкуственият интелект е преминал отвъд това да бъде маргинален експеримент и се е превърнал в движещата сила зад дигиталните иновации в почти всеки сектор. Интегрирането му в сигурността – като едновременно с това се осигурява адекватна защита – позволява смекчаване на въздействието на нарушенията, предвиждане на заплахи, подобряване на предотвратяването на престъпления и освобождаване на човешките екипи от голяма част от тежката работа, при условие че се поддържа внимателен баланс между ефективност, етика и зачитане на правата на човека.

Съдържание

- Новият пейзаж на заплахите и защо изкуственият интелект е ключов

- Как киберпрестъпниците използват изкуствен интелект

- Приложения на изкуствен интелект в киберсигурността: от крайна точка до облак

- Предимства на изкуствения интелект за екипите по сигурността

- Удостоверяване, пароли и поведенчески анализ

- Предотвратяване и прогнозиране на престъпления във физическия свят

- Рискове и предизвикателства: сигурност на данните, сигурност на модела и сигурност на API

- Сложност на хибридните среди и необходимостта от пълна видимост

- Сигурност по дизайн и устойчивост като конкурентно предимство