- LM Studio permite ejecutar modelos de lenguaje avanzados en local con una interfaz gráfica sencilla y compatible con formatos optimizados como GGUF.

- Para obtener un buen rendimiento se recomienda CPU moderna con AVX2, al menos 16 GB de RAM y, en Mac, procesador Apple Silicon.

- La combinación de chat, RAG, modo Developer y System Prompt ofrece gran control sobre el comportamiento del modelo y el uso de documentos propios.

- Ejecutar LLM en tu equipo aporta privacidad, autonomía y posibilidades de personalización difíciles de igualar con servicios puramente en la nube.

La inteligencia artificial generativa ha dejado de ser cosa exclusiva de grandes empresas y hoy cualquiera puede experimentar con modelos de lenguaje avanzados directamente desde su propio ordenador. Gracias a herramientas como LM Studio, es posible chatear con modelos tipo ChatGPT, crear resúmenes, analizar documentos o generar textos sin depender de la nube ni exponer tus datos a terceros.

Si te has preguntado cómo instalar LM Studio en Windows o en Mac y qué necesitas para que funcione fluido en un equipo normalito de casa, en esta guía tienes el recorrido completo: requisitos, instalación paso a paso, descarga de modelos, uso del modo chat, RAG para trabajar con tus documentos privados y opciones avanzadas para exprimir al máximo tu hardware.

Qué es LM Studio y por qué merece la pena usarlo en local

LM Studio es una aplicación de escritorio pensada para ejecutar modelos de lenguaje (LLM) en tu propio ordenador de forma sencilla, mediante una interfaz gráfica clara y sin tener que escribir comandos en la terminal. Permite descargar modelos, cargarlos en memoria y conversas con ellos como si estuvieras usando un chat online, con la ventaja de que todo ocurre en tu máquina.

La principal diferencia frente a usar herramientas puramente de línea de comandos como llama.cpp, KoboldAI u otras alternativas similares es la comodidad. En lugar de pelearte con argumentos, rutas y scripts, LM Studio te muestra menús y secciones bien organizadas: pestaña de modelos, pestaña de chat, ajustes, modo desarrollador, etc., lo que lo hace ideal para usuarios menos técnicos o para quien quiere ir al grano.

Otra ventaja clave de LM Studio es que trabaja con modelos en formato GGUF, un estándar muy extendido y optimizado para ejecución local, tanto en CPU como en GPU. Esto se traduce en mejor rendimiento, menor consumo de memoria y compatibilidad con un amplio catálogo de modelos como LLaMA, Mistral, Falcon, Granite u otros disponibles en los repositorios más populares.

Al funcionar de manera local, LM Studio ofrece un plus importante de privacidad: lo que escribes y los documentos que utilices para hacer preguntas se quedan en tu ordenador. No necesitas enviar información sensible a la nube, lo que lo convierte en una opción muy interesante para tratar contratos, informes internos, apuntes académicos o cualquier contenido delicado.

Si eres desarrollador, estudiante o simplemente una persona curiosa que quiere trastear con IA, LM Studio combina lo mejor de ambos mundos: facilidad de uso para el día a día y funciones avanzadas (modo Developer, API local, parámetros de generación, etc.) para quien desea un mayor control sobre el comportamiento de los modelos.

Requisitos de sistema en Windows y Mac antes de instalar LM Studio

Antes de lanzarte a descargar LM Studio es fundamental comprobar que tu equipo cumple unos mínimos, sobre todo si quieres que la experiencia sea fluida y no se convierta en una tortura a base de cuelgues y esperas eternas. Los dos componentes clave son el procesador (CPU) y la memoria RAM.

En un PC con Windows, se recomienda contar al menos con 16 GB de RAM para usar modelos de tamaño medio con cierta soltura. Con 8 GB puedes trastear con modelos pequeños y hacer pruebas básicas, pero notarás limitaciones en velocidad y tamaño de los modelos que puedes cargar. A partir de 16 GB la cosa mejora bastante, y si tienes 32 GB o más, mejor que mejor para modelos grandes.

En cuanto al procesador en Windows, es importante que sea compatible con las instrucciones AVX2. La mayoría de CPUs modernas Intel y AMD lo soportan, pero conviene verificarlo. Para ello puedes hacer lo siguiente:

- Abre la herramienta “Información del sistema” de Windows (la puedes buscar desde el menú Inicio).

- Localiza el apartado “Procesador” y anota el nombre completo de tu CPU.

- Entra en la web ARK de Intel o en la página de especificaciones del fabricante (AMD u otros) y busca tu procesador por su nombre exacto.

- En el bloque de tecnologías o extensiones de instrucciones revisa si aparece AVX2. Si está listado, estás cubierto para usar LM Studio con buen rendimiento.

Sobre Mac, la situación es algo distinta pero, en cierto modo, más sencilla. LM Studio está optimizado para ordenadores con procesador Apple Silicon: M1, M2, M3, M4 y sus variantes. Estos chips ofrecen un rendimiento excelente con modelos locales y un consumo ajustado, por lo que son una plataforma muy recomendable para este tipo de tareas.

Si tienes un Mac antiguo con procesador Intel, LM Studio no es la mejor opción porque su soporte se centra en Apple Silicon. Para estas máquinas, una alternativa muy interesante es Msty, otra herramienta que permite ejecutar modelos LLM de forma local y que está más adaptada a esa arquitectura. En cualquier caso, si dispones de un Mac con chip M1 o superior, LM Studio es una apuesta segura.

Además de CPU y RAM, ayuda contar con una GPU dedicada o la propia integrada en Apple Silicon, especialmente si quieres acelerar la generación de texto. LM Studio puede aprovechar estos recursos para que las respuestas lleguen en segundos. También necesitarás espacio en disco suficiente, ya que cada modelo puede ocupar desde unos cientos de MB hasta varios GB.

Descarga e instalación de LM Studio en Windows y Mac paso a paso

Una vez verificado que tu ordenador cumple con los requisitos mínimos, el siguiente paso es descargar el instalador desde la web oficial de LM Studio. El proceso es muy parecido en Windows y macOS, con ligeras diferencias en cómo se ejecuta el archivo.

Para empezar, accede a la página oficial de LM Studio (lmstudio.ai) y localiza la sección de descargas. Verás que aparecen las versiones para Windows, macOS e incluso Linux. Simplemente selecciona la apropiada para tu sistema operativo.

En Windows, el archivo que bajarás será un ejecutable o instalador típico. Elige una carpeta cómoda, por ejemplo Escritorio o Descargas, para que te resulte fácil encontrarlo después. Si usas navegadores como Edge o Chrome, echa un vistazo a la barra de descargas por si el navegador ha bloqueado el archivo por seguridad al ser un ejecutable.

En macOS, la descarga suele venir en forma de archivo .dmg o similar. Igual que en Windows, guarda el archivo en una carpeta accesible. Una vez descargado, haz doble clic para montarlo y arrastra el icono de LM Studio a la carpeta Aplicaciones cuando el sistema te lo indique.

En ambos sistemas, el asistente de instalación de LM Studio es bastante directo. En Windows, haz doble clic sobre el instalador y sigue los pasos del asistente: aceptar licencia, elegir carpeta de instalación y poco más. Puedes dejar todas las opciones por defecto si no quieres complicarte.

Durante el proceso es habitual que LM Studio te proponga descargar un primer modelo por defecto, normalmente uno ligero, como Llama 3.2 1B de Meta o algún modelo básico equivalente, para que puedas empezar a chatear sin tener que buscar nada más. En muchas instalaciones también se sugiere descargar modelos populares como DeepSeek R1.

Cuando finalice la instalación, puedes marcar la casilla para abrir LM Studio directamente o buscar la aplicación desde el menú Inicio en Windows o desde Launchpad y Aplicaciones en Mac. El primer arranque puede tardar un poco más de lo normal, ya que la aplicación prepara algunas configuraciones internas.

Primer inicio de LM Studio y exploración de la interfaz

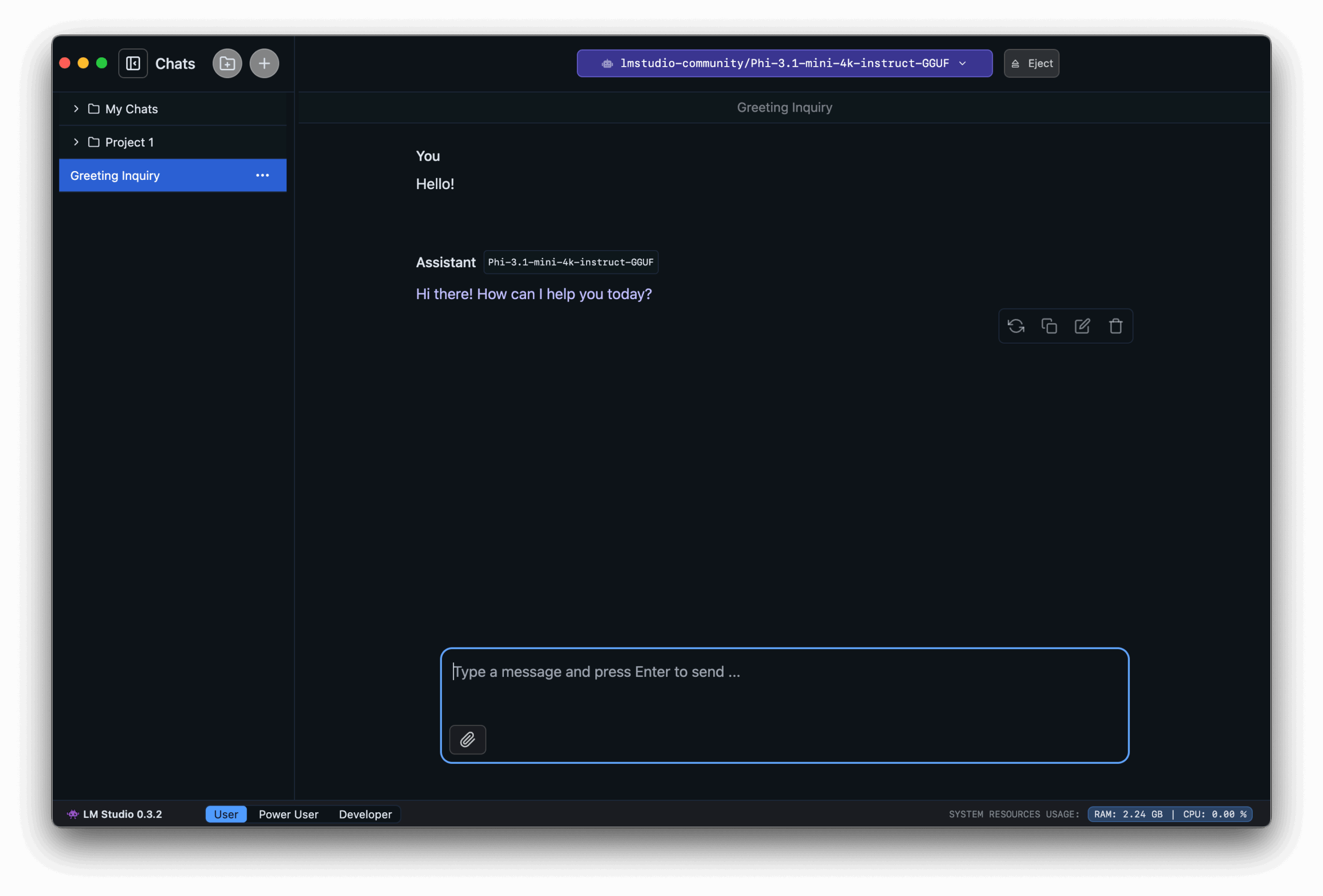

Al abrir LM Studio por primera vez, verás una interfaz limpia pensada para que cualquiera pueda orientarse en pocos minutos. Suele aparecer una pantalla de bienvenida y, dependiendo de cómo hayas instalado, un modelo ya seleccionado para empezar a probar el chat.

Por defecto, LM Studio cargará el modelo que hayas instalado durante la configuración inicial. Este modelo suele ser pequeño y poco exigente con la memoria RAM, lo que es perfecto para comprobar que todo funciona bien antes de ponerte a bajar modelos más grandes que estresen tu hardware.

En la barra lateral encontrarás secciones clave como “Models”, “Chat” y los ajustes. Desde “Models” podrás buscar, descargar y gestionar los modelos disponibles; desde “Chat” tendrás la experiencia de conversación con el modelo que esté activo en ese momento, y en el área de configuración encontrarás parámetros avanzados, modo Developer y otras opciones.

Una de las grandes virtudes de LM Studio es que puedes comunicarte con el modelo en el idioma que quieras, incluido el español de España sin ningún problema. Basta con escribir tu mensaje o pregunta en el cuadro de texto y pulsar Enter para que el modelo empiece a generar la respuesta.

Además del modelo preinstalado, desde la propia aplicación puedes buscar otros modelos haciendo clic en el icono de búsqueda (generalmente representado con una lupa) dentro de la sección de modelos. Ahí verás listados como Granite de IBM y otras alternativas de distintas familias (LLaMA, Mistral, Falcon, etc.).

Cómo descargar y cambiar de modelo dentro de LM Studio

Para sacarle todo el partido a LM Studio no te limites al modelo que viene por defecto; la gracia está en poder probar diferentes LLM, compararlos y elegir el que mejor se adapte a lo que necesitas: escritura creativa, explicación de conceptos, análisis técnico, etc.

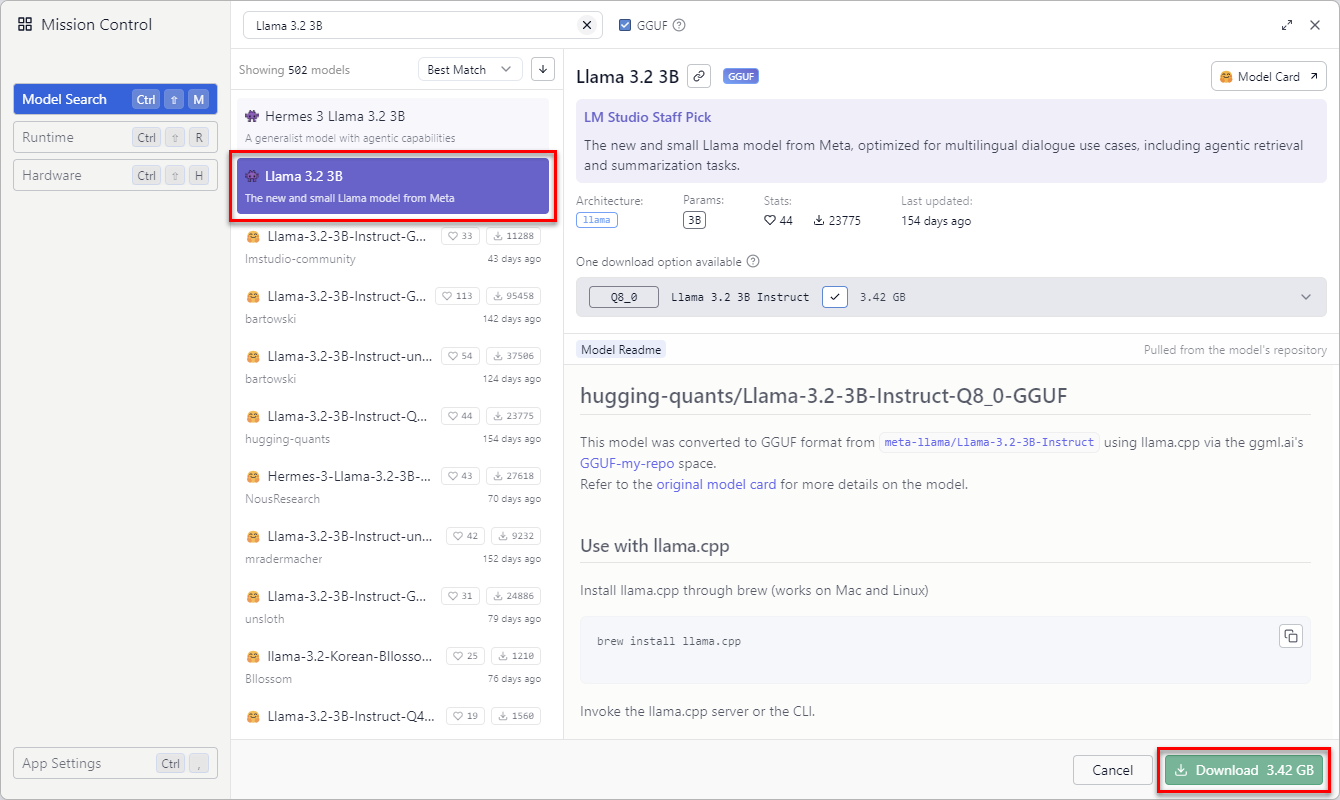

En la pestaña “Models” verás un buscador y un listado de modelos disponibles. Puedes introducir el nombre de la familia que te interese (por ejemplo, Mistral 7B, LLaMA 2 o alguna variante específica) y LM Studio te mostrará las opciones compatibles en formato GGUF, listas para descargar.

Cuando encuentres un modelo que te encaje, haz clic sobre él para ver sus versiones. Normalmente se muestran distintas variantes según el tamaño y el grado de cuantización (que influye en el consumo de memoria y en la calidad de respuesta). La versión más reciente o recomendada suele aparecer en la parte superior de la lista.

Asegúrate de seleccionar la versión adecuada para tu hardware: si tienes poca RAM, quizá te interese una versión más pequeña o más cuantizada; si cuentas con muchos recursos, puedes optar por variantes más pesadas que, por lo general, ofrecen mejor rendimiento en calidad de texto.

Para iniciar la descarga, basta con pulsar el botón “Download”. Verás aparecer una barra de progreso que indica cómo va la descarga del modelo; el tiempo que tarde dependerá tanto del tamaño del archivo como de la velocidad de tu conexión. Una vez completada, el modelo quedará disponible en tu lista.

Para usar cualquiera de los modelos que hayas descargado, ve a la pestaña “Chat”. En la parte superior suele haber un desplegable tipo “Select a model to chat with” donde puedes elegir entre todos los modelos instalados. Selecciona el que quieras probar y, a partir de ese momento, las respuestas del chat las generará ese modelo en concreto.

No tengas miedo de descargar varios modelos para comparar comportamientos: algunos serán más rápidos pero menos precisos, otros más lentos pero muy detallistas. Eso sí, recuerda que cada modelo ocupa espacio en disco y consume memoria RAM y CPU, por lo que conviene ir revisando qué usas realmente y borrar los que no necesites.

Uso del chat, ejemplos prácticos y control de parámetros básicos

La sección de chat de LM Studio es donde vas a pasar la mayor parte del tiempo, ya que es el punto de entrada natural para interactuar con los modelos. El funcionamiento recuerda mucho a un chat tradicional: escribes un mensaje, pulsas Enter y recibes una respuesta generada por el modelo local.

Un ejemplo muy sencillo para empezar podría ser preguntarle al modelo por la propia herramienta, con algo como: “¿Qué es LM Studio y para qué sirve?”; en unos segundos deberías ver cómo el modelo te explica que es una aplicación para ejecutar modelos de lenguaje en local, sin necesidad de conectarte a servicios en la nube, ideal para tareas de experimentación, desarrollo o aprendizaje.

En la configuración de LM Studio encontrarás parámetros que influyen mucho en el estilo de las respuestas. Uno de los más importantes es la temperatura: valores bajos (por ejemplo 0.1-0.3) producen respuestas más sobrias, coherentes y repetibles; valores altos (0.8-1.0) generan textos más creativos y variados, aunque también con más riesgo de divagar o cometer errores.

Otros parámetros habituales son Top-K y Top-P, que controlan cuántas opciones de palabras o tokens se tienen en cuenta en cada paso de generación. Ajustarlos permite jugar con el equilibrio entre precisión y diversidad: valores más restrictivos hacen la respuesta más “rígida” y centrada, mientras que valores más amplios abren la puerta a respuestas más imaginativas.

También podrás modificar el máximo de tokens a generar y el contexto máximo, es decir, la longitud de las respuestas y cuánta conversación previa o texto de entrada tiene en cuenta el modelo. Subir estos límites suele mejorar la coherencia en diálogos largos o resúmenes extensos, pero a costa de consumir más memoria y tiempo de cómputo.

Adjuntar archivos y usar RAG para aprovechar tus propios documentos

Uno de los puntos débiles de cualquier modelo de lenguaje es que sólo sabe lo que se le enseñó durante el entrenamiento. No tiene acceso directo a tus archivos ni a información privada reciente, por lo que, de serie, no puede contestar preguntas basadas en tus contratos, apuntes o informes personales.

Aquí entra en juego la técnica de Retrieval Augmented Generation (RAG), que permite cargar documentos propios y utilizarlos como base para las respuestas del modelo. LM Studio incorpora esta funcionalidad para que puedas hacer preguntas directamente sobre tus archivos sin tener que copiar y pegar textos enormes.

En LM Studio puedes adjuntar hasta 5 archivos a la vez, con un tamaño combinado máximo de 30 MB. Los formatos admitidos incluyen documentos PDF, archivos DOCX de Word, ficheros de texto TXT y hojas de cálculo CSV. Esta flexibilidad hace que puedas trabajar con muchos tipos de contenido sin necesidad de convertirlos.

Una vez cargados los documentos, lo ideal es que seas muy específico en tus preguntas. Por ejemplo, si has subido un contrato de arrendamiento en PDF, puedes preguntarle algo como: “Según el contrato cargado, ¿qué plazo de preaviso necesito para rescindir el alquiler?”. Añadir detalles concretos ayuda al modelo a recuperar el fragmento relevante del documento y darte una respuesta ajustada.

El modelo combinará tu consulta con la información extraída de los documentos y generará una respuesta que, en principio, estará mucho más pegada a la realidad de tu situación que si sólo se basara en su entrenamiento general. Puedes repetir el proceso con distintos documentos, probar diferentes prompts y ver cómo cambian los resultados.

Modo Developer y ajustes avanzados para usuarios más exigentes

Si quieres ir un paso más allá y tener un control fino sobre cómo se comporta el modelo, LM Studio ofrece un modo “Developer” con opciones avanzadas que resultan muy útiles tanto para desarrolladores como para usuarios que estén afinando flujos de trabajo específicos.

Desde este modo puedes, por ejemplo, ajustar en detalle la temperatura, Top-K y Top-P, definir el número máximo de tokens en cada generación y optimizar cómo se reparten los recursos entre CPU y GPU. Estos cambios pueden marcar la diferencia a la hora de equilibrar creatividad, precisión y rendimiento en tu máquina.

Otra funcionalidad clave del modo Developer es la posibilidad de establecer un “System Prompt”: un mensaje de contexto inicial que guía el comportamiento del modelo durante toda la conversación. Aquí puedes indicarle cosas como “Eres un experto en derecho laboral español”, “Responde siempre de forma muy concisa” o “Incluye ejemplos prácticos en todas tus respuestas”.

Al establecer un buen System Prompt, puedes convertir al modelo en un asistente especializado adaptado a tu necesidad concreta: redacción de correos formales, explicación de conceptos de programación, ayuda con trabajos académicos, generación de informes, etc. Esto es especialmente poderoso cuando combinas RAG con instrucciones bien definidas.

Debes tener en cuenta que todos estos ajustes también influyen en el consumo de recursos. Por ejemplo, un contexto muy amplio y respuestas largas pueden disparar el uso de RAM y CPU, lo que en equipos modestos se traduce en tiempos de espera más largos. Lo ideal es ir probando valores hasta encontrar el punto donde obtienes buena calidad de respuesta sin penalizar demasiado el rendimiento.

Ventajas de ejecutar modelos LLM en tu propio ordenador

Trabajar con modelos de lenguaje en local con LM Studio tiene una serie de ventajas nada despreciables frente a depender siempre de servicios en la nube, tanto para usuarios particulares como para profesionales que manejan información sensible.

La primera gran ventaja es la privacidad. Al no tener que subir tus textos ni tus documentos a servidores externos, minimizas el riesgo de fugas de información o usos no deseados. Esto es clave cuando trabajas con contratos, datos internos de empresa, notas personales o cualquier contenido que prefieras mantener bajo llave.

La segunda ventaja es la autonomía. Una vez tienes tus modelos descargados y configurados, puedes seguir usándolos aunque la conexión a Internet falle o sea muy lenta. Es perfecto para quien se mueve con un portátil y trabaja en sitios con mala cobertura, o para quienes no quieren depender de la disponibilidad de un servicio externo.

Además, la ejecución local te permite personalizar mucho más tu entorno de trabajo. Puedes escoger qué modelos instalar, cómo configurarlos, qué parámetros usar para cada tarea, e incluso combinar diferentes herramientas: LM Studio para el día a día, scripts en Python conectados a su API local para automatizaciones, etc.

Otro aspecto interesante es el ahorro económico a medio y largo plazo. Si tus necesidades no requieren modelos gigantes de última generación en la nube, es posible que con un equipo medianamente potente y modelos locales bien escogidos tengas más que suficiente, evitando cuotas mensuales o limitaciones estrictas de uso en servicios gratuitos.

Por último, trabajar con LM Studio y modelos locales es una forma estupenda de aprender cómo funciona la IA generativa por dentro. Al ir descargando modelos diferentes, ajustando temperatura, probando RAG y tocando el System Prompt, ganas una comprensión mucho más profunda de lo que puedes conseguir con esta tecnología y de sus límites reales.

Para aprovechar al máximo LM Studio, conviene probar distintos modelos, revisar su impacto en RAM y CPU, ir ajustando sus parámetros y mantener siempre la aplicación actualizada a la última versión disponible. De este modo, te aseguras tener las últimas mejoras de rendimiento, nuevas funciones y correcciones de errores que vayan apareciendo con el tiempo.

Con todo lo anterior, LM Studio se convierte en una herramienta muy completa para quien quiera tener modelos de lenguaje potentes en su PC o Mac, combinando privacidad, control, flexibilidad y una curva de aprendizaje amable gracias a su interfaz gráfica. Ya sea para experimentar, estudiar, automatizar tareas o simplemente jugar con la IA, tener estos modelos corriendo en tu propia máquina abre un abanico de posibilidades enorme sin depender continuamente de la nube.

Tabla de Contenidos

- Qué es LM Studio y por qué merece la pena usarlo en local

- Requisitos de sistema en Windows y Mac antes de instalar LM Studio

- Descarga e instalación de LM Studio en Windows y Mac paso a paso

- Primer inicio de LM Studio y exploración de la interfaz

- Cómo descargar y cambiar de modelo dentro de LM Studio

- Uso del chat, ejemplos prácticos y control de parámetros básicos

- Adjuntar archivos y usar RAG para aprovechar tus propios documentos

- Modo Developer y ajustes avanzados para usuarios más exigentes

- Ventajas de ejecutar modelos LLM en tu propio ordenador