- Docker Swarm permite crear clústeres de nodos para orquestar servicios en contenedores con alta disponibilidad y balanceo de carga integrado.

- Los conceptos de nodo, manager, worker, servicio, tarea y redes overlay son la base para entender cómo Swarm gestiona y distribuye contenedores.

- Comandos como docker swarm init, docker service create o docker service scale facilitan el despliegue, escalado y actualización de aplicaciones.

- Swarm encaja muy bien en proyectos pequeños y medianos, integrándose con servicios cloud, prácticas DevOps, IA e inteligencia de negocio.

Gestionar docenas o cientos de contenedores repartidos entre varias máquinas puede convertirse en un auténtico quebradero de cabeza si solo tiras de Docker “a pelo”. Cuando empiezas a hablar de alta disponibilidad, escalado automático o despliegues sin caída, necesitas algo más que contenedores sueltos: necesitas orquestación de contenedores. Y ahí es donde entra en juego Docker Swarm, la solución nativa de Docker para coordinar contenedores en clúster.

Si vienes de usar Docker Compose en una única máquina y notas que se te queda corto para entornos reales, Swarm es el siguiente paso lógico. Te permite montar un clúster de nodos, repartir servicios entre ellos, balancear tráfico, reemplazar contenedores caídos y, en definitiva, convertir un montón de servidores en una única plataforma coherente y preparada para producción, sin tener que dar el salto directo a Kubernetes si te parece demasiado pesado o complejo.

Qué es Docker Swarm y por qué importa en la orquestación de contenedores

Docker Swarm es el motor de clustering y orquestación integrado directamente en Docker. No es una herramienta externa, sino un modo de operación del propio Docker Engine que te permite agrupar varias máquinas (físicas o virtuales) en un clúster lógico, llamado swarm, sobre el que despliegas servicios en lugar de contenedores aislados.

La gracia de Swarm es que abstrae el conjunto de nodos y te deja trabajar como si tuvieras un solo “súper servidor”. Tú defines servicios, su número de réplicas, puertos expuestos y restricciones, y Swarm decide dónde ejecutar cada contenedor (tareas), cómo redistribuirlos si un nodo cae y cómo balancear el tráfico entre ellos.

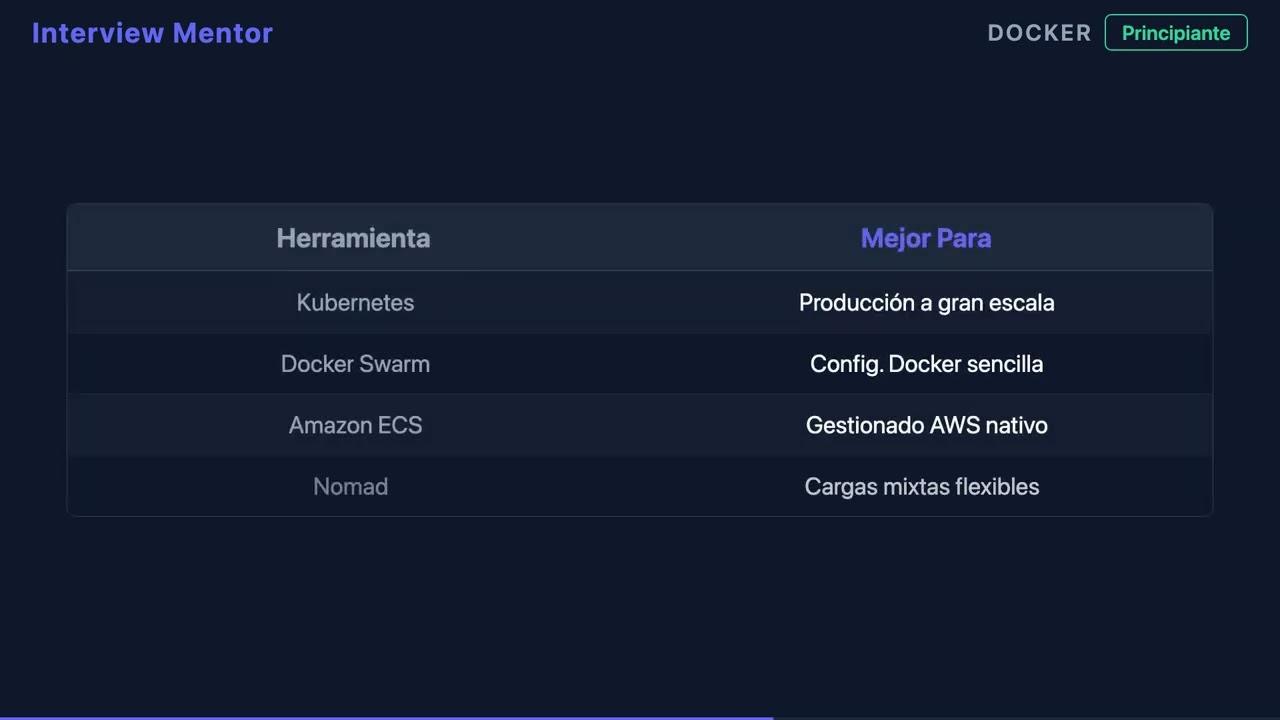

En términos de orquestación de contenedores, Docker Swarm cubre las necesidades típicas de muchos equipos DevOps: escalado horizontal sencillo, alta disponibilidad básica, balanceo de carga interno, redes superpuestas entre nodos y despliegues controlados, y resulta apropiado para arquitecturas de microservicios. Es especialmente interesante en proyectos pequeños y medianos, o en organizaciones muy acostumbradas al ecosistema Docker que no necesitan toda la complejidad de Kubernetes.

Swarm se ajusta muy bien a escenarios donde se busca simplicidad: laboratorios, entornos de staging, clusters on-premise dentro de una pyme, o incluso producción en la nube cuando no quieres gestionar un monstruo de plataforma. Además, encaja a la perfección con pipelines de CI/CD y prácticas de DevOps que ya usan Docker para empaquetar aplicaciones.

Conceptos clave en Docker Swarm: nodos, servicios y redes

Antes de ponerte a escribir comandos como loco, es fundamental entender cómo llama Swarm a cada pieza del puzzle. Estos conceptos son los que vas a ver todo el rato en la CLI y en la documentación.

Nodo: es cualquier máquina que forma parte del swarm, puede ser un servidor físico, una VM en la nube o incluso tu portátil en un entorno de pruebas. Cada nodo ejecuta Docker Engine y se registra en el clúster con un rol concreto.

Nodo Manager: es el cerebro del clúster. Se encarga del control del estado deseado, el planificador (scheduling) de tareas y la orquestación. Puede haber varios managers para garantizar alta disponibilidad del plano de control, pero uno de ellos actúa como líder y coordina el resto.

Nodo Worker: son los “currantes” del swarm. No toman decisiones de orquestación; se limitan a ejecutar las tareas (contenedores) que les asigna el manager. Esto permite escalar la capacidad de cómputo añadiendo más workers cuando haga falta.

Servicio: es la unidad de despliegue en Swarm. Define la imagen de contenedor a usar, el número de réplicas, puertos, variables de entorno, configuraciones, secretos y otras opciones. A diferencia de ejecutar un contenedor suelto con docker run, con docker service create describes un servicio que Swarm mantiene en el estado deseado.

Tarea: es la instancia concreta de un contenedor asociada a un servicio y asignada a un nodo. Si pides un servicio con 3 réplicas, Swarm crea 3 tareas. Si una tarea muere, el manager crea otra en su lugar para mantener el número de réplicas.

Overlay Network: es un tipo de red virtual distribuida que permite que contenedores situados en nodos distintos se comuniquen como si estuvieran en la misma red local. Swarm se apoya en estas redes overlay para conectar servicios, aplicar balanceo entre réplicas y aislar aplicaciones entre sí.

Primeros pasos: inicializar y comprobar un clúster Docker Swarm

Montar un swarm básico es sorprendentemente directo si ya tienes Docker instalado en tus máquinas. No necesitas software extra: solo habilitar el modo swarm y unir nodos al clúster.

Paso 1: crear el primer manager. En la máquina que quieras usar como nodo manager inicial, ejecuta:

docker swarm init –advertise-addr <MANAGER-IP>

El parámetro –advertise-addr indica la IP con la que el resto de nodos verá a este manager. Tras ejecutar el comando, Docker te mostrará automáticamente un token y un comando preparado para que otros nodos puedan unirse al swarm como workers.

Paso 2: unir nodos worker al clúster. En cada máquina que vaya a actuar como worker, ejecuta algo similar a:

docker swarm join –token <WORKER-TOKEN> <MANAGER-IP>:2377

El token de unión y la IP del manager salen del output del docker swarm init. El puerto 2377 es el usado por defecto para la comunicación de control. A partir de ese momento, el nodo aparecerá como parte del swarm y estará listo para recibir tareas.

Verificando el estado del clúster es tan sencillo como irte a un manager (no funciona en un worker aislado) y lanzar:

docker node ls

Este comando te muestra todos los nodos del swarm, su ID, hostname, rol (manager o worker) y estado actual. Desde aquí podrás detectar si algún nodo está down, en modo drain o presenta problemas de conexión.

Despliegue de servicios en Docker Swarm: del primer nginx a la producción

Una vez que tienes el clúster en marcha, llega lo interesante: desplegar servicios. En lugar de lanzar contenedores únicos con docker run, defines servicios que Swarm mantiene y reequilibra automáticamente.

Crear un servicio sencillo como un servidor web Nginx accesible desde fuera del clúster se hace con un comando del estilo:

docker service create –name my-nginx -p 80:80 nginx

Con esto levantas un servicio llamado my-nginx que expone el puerto 80 del contenedor en el puerto 80 de los nodos del clúster. Swarm se encarga de publicar el servicio y balancear las peticiones entrantes entre las distintas réplicas cuando las escales.

Listar los servicios desplegados te ayuda a tener bajo control qué está corriendo en el swarm:

docker service ls

Aquí ves el nombre del servicio, su modo y el número de réplicas en formato actual/deseado. Si, por ejemplo, pones 3/5 significa que aún está en proceso de crear tareas para llegar a ese estado deseado.

Consultar los detalles y el estado de las tareas de un servicio en concreto te permite identificar en qué nodo corre cada instancia:

docker service ps my-nginx

En la salida se muestran las tareas, el nodo asignado, el estado (Running, Preparing, Shutdown, etc.), la imagen usada y el tiempo que llevan ejecutándose. Es básico para depurar problemas de despliegue o de distribución de carga.

Gestión del ciclo de vida: escalar, actualizar y eliminar servicios

Una de las grandes ventajas de la orquestación es la capacidad de escalar y actualizar servicios sin tener que ir servidor por servidor. Swarm te lo pone bastante fácil desde la línea de comandos.

Escalar un servicio en Docker Swarm significa indicar cuántas réplicas de un servicio quieres en total. Por ejemplo, si has creado my-nginx con una sola réplica y quieres pasar a tres:

docker service scale my-nginx=3

Swarm se encarga de programar las nuevas tareas en los nodos disponibles, respetando recursos y estado de los workers. Si más adelante necesitas todavía más capacidad, puedes subir a cinco réplicas con:

docker service scale my-nginx=5

Actualizar la imagen de un servicio es otro punto clave, sobre todo en producción. En lugar de parar y borrar contenedores manualmente, puedes hacer un update controlado:

docker service update –image nginx:latest my-nginx

Este comando ordena a Swarm que cambie progresivamente las tareas existentes a la nueva imagen, siguiendo la estrategia de actualización definida (por defecto, rolling update). Así minimizas el impacto sobre los usuarios finales.

Eliminar un servicio cuando ya no lo necesitas también se hace a nivel de swarm, no de contenedores individuales:

docker service rm my-nginx

Con esto Swarm detiene y elimina todas las tareas asociadas y libera recursos en los nodos. Es una forma limpia de desmantelar componentes que ya no tienen sentido dentro de tu arquitectura.

Práctica guiada: montar tu propio clúster y desplegar un servicio

Para afianzar conceptos, nada como un pequeño ejercicio que puedes replicar en un entorno de laboratorio, con máquinas virtuales locales o instancias baratas en la nube.

Ejercicio 1: configurar un clúster Docker Swarm. La idea es que tengas al menos tres nodos: uno como manager y dos como workers. En el manager, habilita el swarm con:

docker swarm init –advertise-addr <MANAGER-IP>

A continuación copia el comando de unión que te muestra la salida y ejecútalo en cada worker:

docker swarm join –token <token> <manager-ip>:2377

Comprueba que todo ha ido bien con:

docker node ls

Verás el manager en estado Leader y los workers como Active. Si alguno aparece como Down, revisa conectividad, firewall y versión de Docker.

Ejercicio 2: desplegar y escalar un servicio. Con el cluster listo, crea un servicio nginx accesible por HTTP:

docker service create –name my-nginx -p 80:80 nginx

Comprueba su existencia con:

docker service ls

Escala el servicio a tres réplicas usando:

docker service scale my-nginx=3

Revisa dónde se han desplegado las tareas con:

docker service ps my-nginx

Como solución básica al ejercicio, deberías ver las tres tareas repartidas entre distintos nodos (si hay recursos suficientes), y al hacer peticiones HTTP al puerto 80 del cluster, Swarm irá enrutando el tráfico a las diferentes réplicas según su balanceador interno.

Ventajas de Docker Swarm frente a la gestión manual de contenedores

Usar Swarm en vez de lanzar contenedores sueltos aporta una serie de beneficios que se notan desde el momento en que necesitas algo más que un entorno de pruebas simple.

Despliegue sencillo e integrado en la CLI de Docker: no tienes que aprender una herramienta completamente nueva; los comandos de gestión de servicios y clúster se parecen mucho a lo que ya haces con docker run, docker ps o docker images.

Balanceo de carga incorporado: cuando expones un servicio con -p, Swarm publica el puerto en los nodos necesarios y reparte el tráfico entre las réplicas disponibles. No necesitas añadir un balanceador externo básico como Traefik para distribuir peticiones, lo que simplifica la arquitectura inicial.

Alta disponibilidad y tolerancia a fallos: si un contenedor revienta o un nodo worker se cae, Swarm detecta la pérdida de tareas e intenta recrearlas en otros nodos para mantener el número de réplicas. Esto evita muchas caídas de servicio por fallos puntuales.

Gestión centralizada del estado deseado: tú declaras cuántas réplicas quieres, qué imagen usar, qué puertos abrir y qué restricciones aplicar, y es el clúster quien se encarga de converger a ese estado. Cambios futuros (updates, escalados, drena de nodos) también se gestionan desde ese plano de control.

Cuándo tiene sentido usar Docker Swarm en tus proyectos

No todas las situaciones requieren Kubernetes ni microservicios hipervitaminados. Docker Swarm encaja muy bien en una serie de casos de uso en los que se busca equilibrio entre simplicidad y capacidades de orquestación.

Clústeres de producción pequeños y medianos: si gestionas unas cuantas aplicaciones de negocio, APIs o servicios internos y el tamaño de tu infraestructura no es masivo, Swarm ofrece lo necesario sin obligarte a aprender un ecosistema enorme.

Equipos muy integrados con Docker que quieren dar el salto a la orquestación sin pegarse con la curva de aprendizaje de Kubernetes. Como Swarm forma parte del propio Docker Engine, la transición suele ser más suave y rápida.

Entornos cloud y arquitecturas distribuidas donde deseas seguir usando servicios gestionados de los grandes proveedores (bases de datos, colas de mensajes, almacenamiento, etc.) mientras tus aplicaciones corren en contenedores orquestados con Swarm. Es una forma razonable de combinar simplicidad con las prestaciones de la nube.

Casos de uso de DevOps y automatización donde necesitas pipelines que construyan imágenes, las suban a un registro y desplieguen automáticamente en un clúster. Swarm se integra bien con herramientas de CI/CD y facilita ciclos rápidos de entrega continua.

Cuando necesites un control extremo, ecosistema masivo o integraciones complejas quizá Kubernetes tenga más sentido. Pero para muchísimos proyectos reales, Swarm proporciona la orquestación necesaria con menos fricción operativa.

Guías prácticas y enfoque DevOps: de los fundamentos a despliegues avanzados

Si te has sentido perdido entre tutoriales sueltos, errores raros en producción y documentación inconexa sobre Docker Swarm, no eres el único. Muchos perfiles de desarrollo y operaciones se ven desbordados al pasar de contenedores individuales a una plataforma orquestada.

Una guía práctica completa de DevOps centrada en Swarm suele organizarse en varios bloques clave. Primero se asientan los fundamentos de Docker: creación de imágenes, gestión de contenedores y optimización de contenedores, uso de registros (registries) y buenas prácticas de empaquetado. Esa base sólida es indispensable para que luego la orquestación no se convierta en un infierno.

Después se profundiza en redes y persistencia: tipos de redes Docker (bridge, host, overlay, macvlan), manejo de volúmenes y persistencia de datos, así como despliegue de aplicaciones multicontenedor con Docker Compose. Esto te da una maqueta clara de cómo debe lucir tu stack antes de llevarlo a un swarm distribuido.

El siguiente nivel se centra en la implementación de servicios Swarm, cubriendo desde la inicialización del clúster hasta características avanzadas como secretos, configs y stacks (pilas). Ahí ya trabajas con definiciones declarativas de servicios, credenciales cifradas y configuraciones compartidas entre contenedores.

Otro bloque indispensable es el de balanceo, registro y observabilidad: aprender a exponer servicios correctamente, revisar logs, detectar cuellos de botella y aplicar técnicas de troubleshooting para mantener alta disponibilidad en el día a día. Para monitorizar y diagnosticar sistemas te vendrá bien una guía de monitorización avanzada que cubra métricas y alertas.

Finalmente se integra todo en pipelines de DevOps con ejercicios de programación práctica: desde el build automatizado de imágenes hasta su despliegue continuo en el clúster, garantizando que cada cambio en el código recorra el camino hasta producción de forma fiable y repetible.

Más allá de lo básico: redes Docker y próximos pasos con Swarm

Cuando dominas el arranque del clúster y los primeros servicios, el siguiente salto de nivel suele ser comprender a fondo cómo se comunican tus contenedores entre sí y con el exterior.

Las redes Docker de tipo bridge y host gobiernan gran parte de la comunicación en una sola máquina, mientras que las redes overlay son la pieza clave para conectar contenedores en distintos nodos de un swarm. Entender sus diferencias, cuándo usar cada una y cómo interactúan con firewalls y balanceadores externos es fundamental para evitar sorpresas en producción.

Redes como macvlan permiten asignar direcciones IP “reales” de la red física a los contenedores, lo que puede ser muy útil en entornos específicos donde necesitas que los servicios se comporten como hosts independientes a nivel de red, pero también añade complejidad y requisitos adicionales de configuración.

Un “deep dive” en redes Docker te ayudará a alinear mejor tu diseño de servicios Swarm con la topología de red de tu organización o de tu proveedor cloud, definiendo claramente qué servicios son internos, cuáles se exponen al exterior y cómo segmentar el tráfico entre entornos (desarrollo, pruebas, producción).

Otra línea de avance interesante en Swarm es profundizar en el uso de secretos y configs para manejar credenciales, certificados y ficheros de configuración sin meterlos a pelo en la imagen ni en variables de entorno planas. Esto aumenta la seguridad y hace mucho más ordenada la gestión de entornos.

Servicios de desarrollo a medida, cloud e inteligencia de negocio alrededor de Docker Swarm

La orquestación de contenedores no vive aislada del resto del ecosistema TI. Empresas de desarrollo especializadas en aplicaciones a medida y software a medida suelen apoyarse en plataformas de contenedores como Swarm para entregar soluciones más robustas y fáciles de escalar.

Integrar Swarm con servicios cloud de AWS y Azure permite desplegar clústeres flexibles

y aprovechar componentes gestionados de la nube (bases de datos, colas de mensajes, almacenamiento de objetos), manteniendo al mismo tiempo el control directo sobre la capa de ejecución de contenedores.

En paralelo, la inteligencia artificial y la IA para empresas se encajan muy bien en un entorno orquestado con contenedores: modelos de IA, microservicios de inferencia y agentes IA pueden ejecutarse como servicios Swarm que escalan según la carga, evitando que una sola máquina se convierta en cuello de botella.

En el ámbito de inteligencia de negocio y Power BI, contar con un backend desplegado en Docker Swarm facilita sacar datos desde APIs, servicios ETL y pipelines de procesamiento de forma robusta. La orquestación asegura que estos servicios estén siempre disponibles para alimentar cuadros de mando y análisis.

La ciberseguridad también gana peso en este contexto: un clúster bien configurado, con comunicaciones TLS, actualización controlada de imágenes, escaneo de vulnerabilidades y gestión centralizada de secretos, reduce riesgos frente a despliegues caóticos de contenedores independientes. Además, prácticas de hardening y control de acceso elevan la protección general del entorno.

Al final, combinar desarrollo a medida, servicios cloud, IA y BI sobre una plataforma de orquestación como Docker Swarm permite construir soluciones modernas, escalables y resilientes, sin disparar la complejidad técnica ni los costes operativos.

Dominar Docker Swarm como herramienta de orquestación de contenedores te coloca en una posición muy potente dentro del mundo DevOps: pasas de pelearte con contenedores dispersos y despliegues frágiles a trabajar con un clúster coherente, escalable y seguro, capaz de soportar desde aplicaciones web sencillas hasta arquitecturas distribuidas con servicios cloud, inteligencia artificial, automatizaciones y soluciones de inteligencia de negocio integradas.

Tabla de Contenidos

- Qué es Docker Swarm y por qué importa en la orquestación de contenedores

- Conceptos clave en Docker Swarm: nodos, servicios y redes

- Primeros pasos: inicializar y comprobar un clúster Docker Swarm

- Despliegue de servicios en Docker Swarm: del primer nginx a la producción

- Gestión del ciclo de vida: escalar, actualizar y eliminar servicios

- Práctica guiada: montar tu propio clúster y desplegar un servicio

- Ventajas de Docker Swarm frente a la gestión manual de contenedores

- Cuándo tiene sentido usar Docker Swarm en tus proyectos

- Guías prácticas y enfoque DevOps: de los fundamentos a despliegues avanzados

- Más allá de lo básico: redes Docker y próximos pasos con Swarm

- Servicios de desarrollo a medida, cloud e inteligencia de negocio alrededor de Docker Swarm