- La seguridad de contenedores Docker abarca host, imágenes, red, secretos y orquestación, no solo el propio contenedor.

- Los mayores riesgos provienen de imágenes vulnerables, configuraciones inseguras, exceso de privilegios y mala gestión de secretos.

- Buenas prácticas como usar imágenes minimalistas, limitar capacidades, segmentar redes y monitorizar en tiempo real reducen drásticamente la superficie de ataque.

- Integrar escaneos y políticas de seguridad en el pipeline CI/CD y apoyarse en herramientas especializadas permite escalar la seguridad sin frenar DevOps.

Docker ha cambiado para siempre la forma en la que desarrollamos y desplegamos aplicaciones: empaquetar código, librerías y configuración en un contenedor y moverlo del portátil a producción sin sorpresas es casi magia (qué es Docker). Pero esa magia tiene truco: si descuidamos la seguridad, un solo contenedor mal configurado puede servir de puerta de entrada a toda la infraestructura.

Muchos equipos siguen confiando ciegamente en el aislamiento de los contenedores y en la orquestación con Kubernetes (ver Docker Compose y Kubernetes) como si fueran una caja fuerte, cuando en realidad hablamos de procesos que comparten kernel, redes y, en demasiados casos, permisos exagerados. Vamos a ver con detalle por qué la seguridad de contenedores Docker es un pilar crítico, qué riesgos reales existen y qué técnicas y herramientas se usan hoy en producción para mitigarlos sin cargarse la agilidad de DevOps.

Qué es realmente la seguridad de contenedores Docker

Cuando hablamos de seguridad de contenedores Docker nos referimos al conjunto de prácticas, configuraciones y herramientas que protegen tanto los contenedores como el host, la red y la propia cadena de suministro del software frente a vulnerabilidades, errores de configuración y ataques activos. No se trata solo de “cuidar la imagen”, sino de blindar todo el ciclo de vida: construcción, publicación, despliegue y ejecución.

El gran reto de los contenedores es que comparten el kernel del sistema operativo anfitrión (namespaces y cgroups en Linux). Eso significa que un fallo a nivel de kernel o un escape de contenedor mal protegido puede impactar en todos los contenedores del nodo. La seguridad de Docker, por tanto, no es únicamente cuestión de la imagen: implica endurecer el host, limitar privilegios, segmentar redes, controlar quién habla con la API del daemon y cómo se gestionan los secretos.

Otro aspecto clave es la seguridad de los procesos y la orquestación: cómo se ejecutan los contenedores, bajo qué usuario, qué capacidades del kernel tienen, qué recursos pueden consumir o qué políticas se aplican en un clúster Kubernetes. Aquí entran conceptos como el principio de mínimo privilegio, los perfiles de seguridad (seccomp, AppArmor, SELinux) y las políticas de acceso basadas en roles (RBAC).

Riesgos y problemas de seguridad más frecuentes en Docker

Los incidentes en entornos de contenedores suelen venir de un combo de errores humanos y malas decisiones técnicas. A continuación se recogen los problemas que más se repiten en auditorías y brechas reales.

Imágenes vulnerables o maliciosas

Cada imagen de contenedor es un pequeño sistema con su propio conjunto de paquetes y dependencias; si tiras de una imagen obsoleta, inflada o de origen dudoso, te llevas también sus CVEs, backdoors y malas prácticas. Escaneos a millones de imágenes públicas han demostrado que una fracción nada despreciable contiene malware o vulnerabilidades críticas conocidas.

El problema se agrava cuando se usan distribuciones completas como base (Ubuntu, Debian, etc.) para aplicaciones que solo necesitan unas pocas librerías. Esos cientos de paquetes extra (editores, shells, gestores de paquetes, herramientas de red…) amplían la superficie de ataque sin aportar valor en producción. Para un atacante que consiga entrar, encontrar un apt-get o un curl listo para descargar malware es un regalo.

Escape de contenedores al host

Un escape de contenedor ocurre cuando un atacante consigue salir del espacio aislado del contenedor y ejecutar acciones en el sistema anfitrión o en otros contenedores. Suele explotar vulnerabilidades del kernel, configuraciones inseguras (por ejemplo, volúmenes con acceso excesivo) o contenedores ejecutados con privilegios exagerados.

Si el contenedor comprometido se ejecuta como root y con capacidades amplias, el salto al host o al resto de la infraestructura es mucho más sencillo. De ahí la insistencia continua en no usar –privileged, en restringir capacidades del kernel y en ejecutar procesos con usuarios sin privilegios, tanto dentro como fuera del contenedor (user namespaces, rootless, etc.).

Configuraciones de red inseguras

La red es otro de los puntos donde más se mete la pata con Docker y Kubernetes: puertos publicado alegremente, uso de –network=host sin necesidad, políticas de red inexistentes en el clúster o contenedores hablando entre sí sin restricciones.

Cuando todos los contenedores pueden comunicarse libremente, un atacante que comprometa un microservicio puede moverse lateralmente hacia bases de datos, colas de mensajes o paneles internos. Además, exponer servicios de administración o APIs internas por error es una causa recurrente de incidentes.

Daemon Docker expuesto o mal protegido

El daemon de Docker es el “cerebro” que gestiona la creación, destrucción y control de contenedores. Si su API está accesible sin cifrado ni autenticación, quien llegue hasta ahí puede ejecutar contenedores arbitrarios, montar volúmenes del host, leer secretos o incluso borrar toda la infraestructura.

Proteger el socket del daemon y su API es crítico: usar TLS, restringir el acceso al socket Unix, no exponer el endpoint TCP salvo que sea imprescindible y auditar regularmente su configuración son medidas básicas para no regalar el control de la plataforma.

Secretos y variables de entorno expuestos

Un clásico en entornos de contenedores es dejar credenciales y claves de API donde no deben estar: embebidas en Dockerfiles, dentro de la propia imagen, en variables de entorno planas o incluso subidas sin querer al control de versiones.

Una vez que un secreto viaja dentro de una imagen, cualquiera con acceso al registro o al propio contenedor puede recuperarlo con un simple comando de inspección. Esto incluye contraseñas de bases de datos, tokens de servicios externos o claves de acceso a la nube; el tipo de material que no quieres ver en manos de un atacante.

Vulnerabilidades del kernel y del host

Como todos los contenedores comparten kernel, cualquier fallo a ese nivel impacta en el conjunto (monitor de sistema avanzado para Linux). Si el sistema anfitrión no está parcheado o se usan kernels antiguos sin soporte, las probabilidades de que exista un exploit público aprovechable suben como la espuma.

Además del kernel, la propia configuración del sistema operativo del host (cgroups, namespaces, módulos cargados, servicios innecesarios) influye directamente en el riesgo. Un host descuidado convierte en papel mojado el aislamiento lógico de los contenedores.

Falta de visibilidad y monitorización

Sin buenos registros y monitorización en tiempo real, un ataque puede permanecer activo durante semanas sin que nadie repare en ello. Herramientas tradicionales de seguridad (por ejemplo, qué es Wazuh) muchas veces no ven lo que ocurre dentro de un contenedor o no lo relacionan con el contexto de Kubernetes.

La visibilidad granular a nivel de contenedor y pod (procesos, conexiones de red, cambios en el sistema de archivos, consumo de recursos) es esencial para detectar comportamientos anómalos, indicadores de compromiso y movimientos laterales.

Buenas prácticas antes de desplegar contenedores Docker

La seguridad de Docker empieza mucho antes de que el contenedor llegue a producción. Desde la elección del host hasta el Dockerfile, cada decisión suma o resta superficie de ataque.

Endurecer el sistema host

Lo primero es contar con un sistema operativo del host limpio, actualizado y dedicado a contenedores (ver guía para montar y administrar un servidor Ubuntu Server). Cuanto menos compartas el nodo con otras aplicaciones “legacy”, menos caminos habrá para que un fallo en otro servicio afecte a tus workloads en contenedores.

Actualizar el kernel con rapidez y optar por versiones LTS con soporte activo reduce de forma drástica el riesgo de que un exploit conocido sirva para saltarse el aislamiento. Además, activar y configurar correctamente mecanismos como AppArmor, SELinux y cgroups ayuda a limitar lo que un proceso comprometido puede hacer.

Elegir imágenes oficiales y minimalistas

Usar imágenes oficiales y verificadas como base debería ser la norma. Repositorios como Docker Hub marcan a los publishers verificados y muchas empresas mantienen registries privados con sus propias imágenes endurecidas, sometidas a escaneos y revisiones continuas.

Siempre que sea posible conviene elegir imágenes “slim”, Alpine o incluso distroless, incluyendo solo las dependencias estrictamente necesarias. Al reducir el número de paquetes de usuario y herramientas interactivas se minimiza la cantidad de vulnerabilidades potenciales, se acelera el despliegue y se complica mucho la vida a un atacante que consiga ejecución de código dentro del contenedor.

Construir Dockerfiles con seguridad en mente

El Dockerfile es el guion de todo lo que va dentro de tu contenedor, así que conviene escribirlo con mentalidad de hardening: eliminar herramientas de depuración en producción, no dejar restos de credenciales, fijar versiones concretas de paquetes, limpiar caches de gestores de paquetes y separar en varias capas las fases de compilación y ejecución (multi-stage builds).

Otro paso fundamental es definir un usuario no privilegiado dentro del Dockerfile y cambiar el contexto de ejecución con la instrucción USER. Nada de lanzar servicios como root dentro del contenedor “porque es más fácil”; en cuanto haya un fallo de seguridad, esa comodidad se convierte en un problema enorme.

Escaneo sistemático de imágenes

Escanear las imágenes en busca de vulnerabilidades conocidas antes de que lleguen al registro debería ser obligatorio. Herramientas como Trivy, Clair, Anchore, Snyk Container o las capacidades de Docker Scout permiten analizar tanto imágenes base como builds propias.

Integrar estos escáneres en el pipeline de CI/CD evita que una imagen con CVEs críticos pase a producción “porque se nos pasó revisar”. Lo ideal es definir políticas claras: por ejemplo, bloquear el despliegue si hay vulnerabilidades de alta o crítica gravedad sin parche disponible o sin justificación documentada.

Gestión segura de secretos y configuración

La gestión de secretos es uno de los talones de Aquiles típicos en contenedores. No serviría de mucho tener la imagen perfecta si dentro viajan contraseñas y claves embebidas en texto plano.

La regla de oro es que los secretos nunca formen parte de la imagen: nada de escribir credenciales en el Dockerfile, ni de copiarlas como ficheros dentro del contenedor. En su lugar, se deben usar mecanismos de inyección en tiempo de ejecución: Docker Secrets (en Swarm), gestores externos como HashiCorp Vault, AWS Secrets Manager, Azure Key Vault u otros servicios equivalentes.

Si se usan variables de entorno, hay que tratarlas con sumo cuidado: evitar volcarlas a logs, no subir a repositorios de código ficheros con valores reales, revisar qué comandos de diagnóstico podrían mostrar valores sensibles y rotar las claves con frecuencia. Cifrar los secretos en reposo y aplicar controles de acceso estrictos (quién puede leer qué) cierra muchas puertas.

Red, control de acceso y ejecución endurecida

Una vez que las imágenes y el host están bajo control, hay que pensar en cómo se conectan, quién puede lanzarlas y qué pueden hacer en tiempo de ejecución. Aquí entran redes, RBAC, capacidades del kernel, cuotas de recursos y herramientas de monitorización.

Diseño de red y segmentación

En Docker es recomendable usar redes personalizadas y evitar publicar puertos al exterior salvo que sea estrictamente necesario. Definir redes de tipo bridge u overlay específicas por aplicación o dominio funcional ayuda a contener un posible compromiso (ver arquitectura de microservicios).

En entornos orquestados con Kubernetes, las Network Policies son imprescindibles: permiten definir qué pods pueden hablar con cuáles, y en qué puertos. De fábrica, muchos clústeres permiten comunicación libre entre pods, lo cual es cómodo para empezar pero desastroso en caso de intrusión. Incorporar firewalls de capa 7 y TLS en las comunicaciones entre servicios añade otra capa de protección.

Control de acceso, autenticación y firma de imágenes

El acceso a registros, a la API de Docker y al plano de control de Kubernetes debe pasar siempre por autenticación robusta y control de permisos. No todo el mundo necesita poder hacer push de imágenes o desplegar en producción.

Docker Content Trust y mecanismos de firma de imágenes permiten asegurarse de que solo se usan imágenes firmadas por entidades de confianza. En paralelo, RBAC tanto en Kubernetes como en la propia plataforma de CI/CD controla quién puede lanzar, escalar, modificar o borrar contenedores y recursos asociados.

Ejecutar contenedores con el mínimo privilegio posible

Nada de contenedores con –privileged “porque si no no funciona”. Ese flag otorga acceso prácticamente total al host y elimina muchas medidas de aislamiento. Lo correcto es arrancar los servicios con –cap-drop=ALL y luego ir añadiendo únicamente las capacidades del kernel que la aplicación necesita (por ejemplo, NET_BIND_SERVICE para escuchar en puertos bajos).

También es importante usar sistemas de archivos de solo lectura siempre que se pueda (–read-only) y montar volúmenes concretos para los datos que sí tengan que persistir. Esto dificulta que un atacante escriba binarios maliciosos o modifique configuraciones dentro del contenedor. Limitar la creación de nuevos procesos y deshabilitar la escalada de privilegios completan el endurecimiento.

Perfiles de seguridad del kernel: seccomp, AppArmor y SELinux

Docker ya incluye un perfil seccomp por defecto que filtra las llamadas al sistema consideradas peligrosas, pero en muchos casos conviene ajustar o crear perfiles específicos para cada tipo de carga de trabajo. Cuantas menos syscalls expuestas tenga el proceso, menos margen le queda a un exploit.

En distribuciones como Ubuntu y RHEL, AppArmor y SELinux añaden otra capa de control sobre qué puede hacer cada contenedor: acceso a ficheros, dispositivos, redes, etc. Bien configurados, estos mecanismos de Mandatory Access Control dificultan mucho la vida a un ataque incluso si se explota una vulnerabilidad en la aplicación.

Cuotas de recursos y protección frente a abusos

Configurar límites de CPU, memoria y, si procede, I/O para cada contenedor no solo ayuda al rendimiento del clúster, también limita el impacto de ataques que intentan agotar recursos (DoS desde dentro) o de bugs que provocan fugas de memoria.

Los cgroups permiten definir estas cuotas con bastante precisión y son un complemento natural al resto de medidas. Un atacante que intente minar criptomonedas dentro de un contenedor con límites estrictos lo tendrá mucho más difícil para afectar al resto de servicios del host.

Monitorización, respuesta a incidentes y herramientas especializadas

Cerrar la foto de la seguridad de contenedores sin hablar de monitorización sería un error. La realidad es que tarde o temprano habrá vulnerabilidades nuevas, fallos humanos o comportamientos inesperados; la diferencia está en cuánto tardas en detectarlos y cómo respondes.

Centralizar los logs de contenedores, del host, de la orquestación y del registro permite correlacionar eventos y ver patrones que pasarían desapercibidos si cada pieza se mira por separado. Soluciones como ELK, Grafana Loki o servicios gestionados en la nube son habituales para este cometido.

En la parte de detección de amenazas en tiempo de ejecución, Falco se ha convertido en un estándar de facto en código abierto. Inspecciona las llamadas al sistema y genera alertas cuando detecta acciones sospechosas: shells interactivos en contenedores que no deberían tenerlos, escrituras en rutas sensibles, conexiones de red inusuales, etc. Integrado con herramientas SIEM o plataformas de respuesta, permite reaccionar con rapidez.

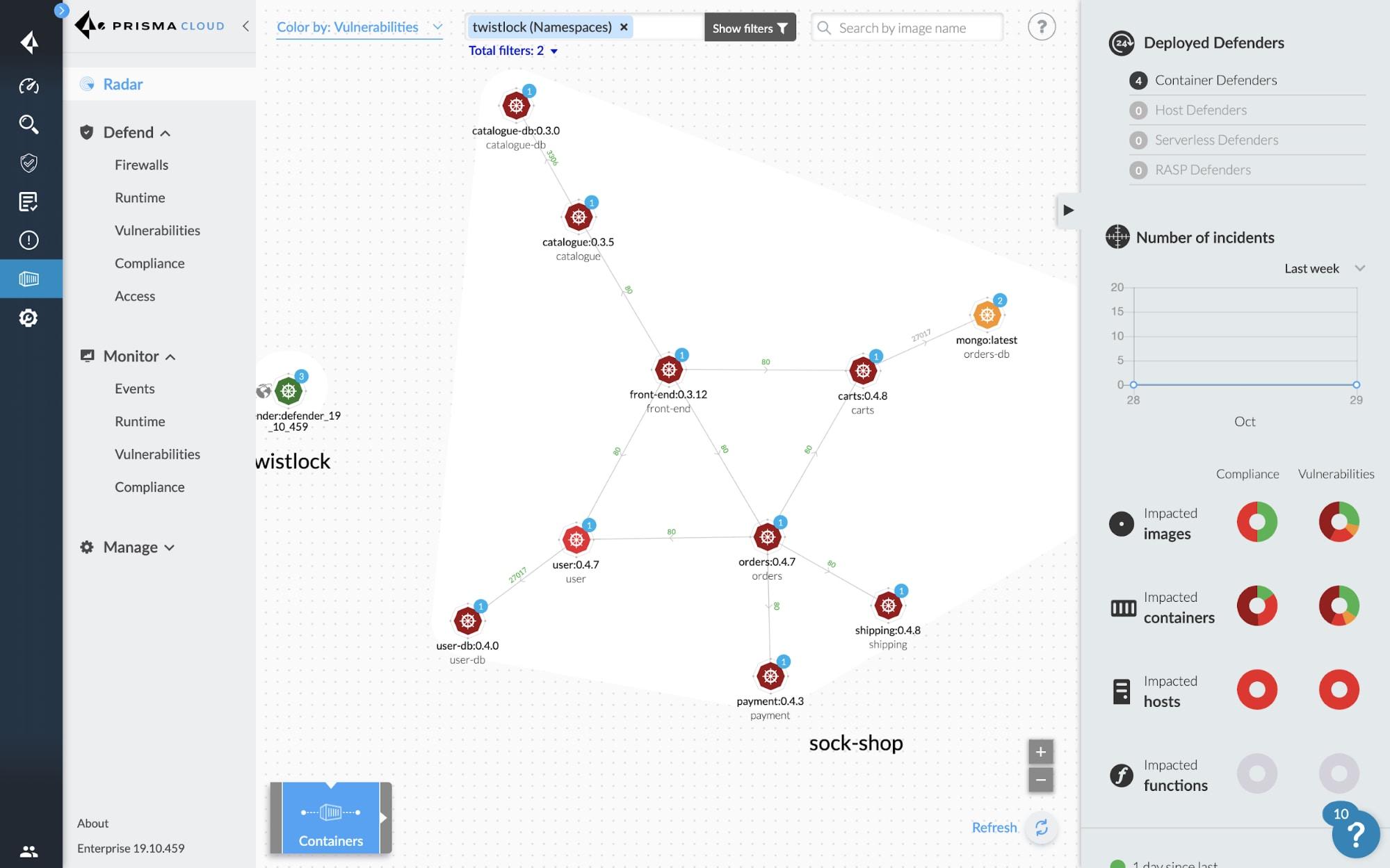

Para una cobertura más amplia de ciclo de vida completo existen plataformas de seguridad nativas de la nube como Aqua Security, Prisma Cloud, Sysdig Secure, Qualys Container Security o suites unificadas centradas en el desarrollador como Aikido Security. Estas soluciones combinan escaneo de imágenes, seguridad en tiempo de ejecución, gestión de la postura en la nube, análisis de código, detección de secretos, generación de SBOM y mucho más.

El valor añadido de estas plataformas suele estar en la consolidación de hallazgos y en la priorización inteligente: en lugar de inundar a los equipos con miles de alertas, destacan las vulnerabilidades realmente explotables en tu entorno, ofrecen guías de remediación claras e incluso parches sugeridos mediante IA para que los desarrolladores corrijan más rápido.

Automatización de la seguridad en el pipeline CI/CD

Intentar gestionar la seguridad de contenedores a mano es receta segura para olvidos y brechas. Por eso, una de las recomendaciones más repetidas es integrar todos los chequeos posibles en el pipeline de CI/CD: cuanto antes se detecten los problemas, menos costoso será corregirlos.

Lo ideal es que cada cambio de código dispare una cadena automática: construcción de la imagen, escaneo de vulnerabilidades, análisis de dependencias, revisión de ficheros de infraestructura como código, comprobación de políticas (por ejemplo, que ningún contenedor vaya como root) y, solo si todo pasa, push al registro y despliegue.

Este enfoque reduce mucho la dependencia de la memoria o la disciplina individual. Si el sistema no te deja desplegar una imagen con vulnerabilidades críticas o una configuración que rompe las políticas, es mucho más difícil que “por prisas” se cuele algo inaceptable en producción. Además, automatizar la rotación de imágenes y el redeploy frecuente ayuda a mantener siempre versiones parcheadas, evitando esos pods que llevan meses corriendo con software desactualizado.

En organizaciones con varios equipos y docenas de microservicios, contar con una plataforma centralizada que consolide la información de seguridad (código, contenedores, nube, dependencias) y ofrezca una visión clara del riesgo por proyecto facilita muchísimo la vida a los responsables de seguridad y a los líderes técnicos.

Al final, la seguridad de los contenedores Docker y de los clústeres Kubernetes no depende solo de una pieza o herramienta concreta, sino de combinar una buena higiene en las imágenes, un host bien parcheado, redes segmentadas, privilegios mínimos, gestión rigurosa de secretos, monitorización continua y una fuerte dosis de automatización en el pipeline. Convertir estas prácticas en rutina diaria, más que en proyectos puntuales, es lo que marca la diferencia entre un entorno que “funciona hasta que pasa algo” y una plataforma preparada para soportar incidentes sin poner en jaque el negocio.

Tabla de Contenidos

- Qué es realmente la seguridad de contenedores Docker

- Riesgos y problemas de seguridad más frecuentes en Docker

- Buenas prácticas antes de desplegar contenedores Docker

- Gestión segura de secretos y configuración

- Red, control de acceso y ejecución endurecida

- Monitorización, respuesta a incidentes y herramientas especializadas

- Automatización de la seguridad en el pipeline CI/CD