- NVMe reduce drásticamente la latencia y aumenta el rendimiento frente a SATA y SAS gracias a su arquitectura PCIe paralela.

- La combinación de NVMe con estrategias avanzadas de caché y RAID optimiza bases de datos, hosting y aplicaciones de alto tráfico.

- Esquemas de caché colaborativa como Co-Active mejoran tiempo de respuesta, throughput y durabilidad de la memoria NAND.

- Una correcta selección de hardware, controladores y monitorización continua es esencial para exprimir al máximo NVMe.

La combinación de unidades NVMe y sistemas de caché inteligentes se ha convertido en uno de los pilares del rendimiento en servidores modernos, plataformas de bases de datos y soluciones de hosting profesional. Ya no basta con tener un buen procesador o mucha RAM: el cuello de botella suele estar en el almacenamiento y en cómo se gestionan las operaciones de entrada/salida (E/S) a nivel de controladores y caché.

Cuando se integran bien NVMe, controladores optimizados, esquemas de RAID y políticas de caché avanzadas, es posible recortar la latencia de forma drástica, disparar las tasas de lectura/escritura y soportar cargas de trabajo muy intensivas sin que el sistema se venga abajo. Esto aplica tanto a webs WordPress con miles de visitas simultáneas como a bases de datos críticas, entornos de big data o máquinas virtuales en data centers de alto rendimiento.

Qué es NVMe y por qué marca tanta diferencia

NVMe (Non-Volatile Memory Express) es un protocolo diseñado desde cero para unidades de estado sólido basadas en memoria flash, dejando atrás las limitaciones históricas de SATA o SAS, que venían heredadas del mundo de los discos duros mecánicos. En lugar de comunicarse mediante buses pensados para HDD, NVMe se apoya en PCI Express, lo que abre la puerta a un ancho de banda muy superior y a una latencia de acceso mucho más baja.

Una de las claves de NVMe es su arquitectura altamente paralela: en lugar de manejar una única cola de comandos limitada, permite trabajar con múltiples colas de E/S y miles de comandos por cola. Esto encaja como anillo al dedo con cargas de trabajo que generan muchas peticiones simultáneas, como bases de datos relacionales, aplicaciones web complejas o sitios de comercio electrónico con gran volumen de usuarios.

En comparación con SSD SATA, las unidades NVMe pueden ofrecer varias veces más rendimiento en lectura y escritura secuencial, pero donde realmente brillan es en operaciones aleatorias y en la reducción de la latencia. Esa combinación es la que hace que un CMS como WordPress, Joomla o Drupal se sienta “ligero” incluso bajo picos de tráfico, y que consultas a MySQL o MariaDB se resuelvan en menos tiempo.

Otro aspecto relevante de NVMe es su eficiencia energética y capacidad de procesamiento. Al aprovechar mejor el bus PCIe y reducir el trabajo extra de traducción de protocolos, las unidades NVMe suelen consumir menos por operación útil de E/S, generando menos calor y alargando la vida útil del sistema, especialmente en racks muy densos en centros de datos.

En el contexto de las bases de datos, esta mejora en velocidad y latencia es crítica: si el motor de base de datos puede acceder más rápido a los datos y registrar escrituras con menor retraso, se reducen los tiempos de respuesta de las aplicaciones, se acortan las ventanas de mantenimiento y se soportan cargas más pesadas sin necesidad de escalar inmediatamente a hardware mucho más caro.

Ventajas de NVMe frente a SATA y SAS en hosting y bases de datos

Cuando comparamos NVMe con tecnologías de almacenamiento tradicionales como SATA o SAS, la diferencia no es solo un “poco más de velocidad”: hablamos de cambios profundos en la forma en que el sistema se comunica con el almacenamiento.

El uso de PCIe permite a las SSD NVMe alcanzar tasas de transferencia muy superiores tanto en lectura como en escritura, lo que se traduce en un throughput mucho más alto para operaciones secuenciales. Pero más allá de las cifras teóricas, lo interesante es la caída de latencia y la capacidad para procesar muchas solicitudes de manera concurrente.

La latencia reducida de NVMe es clave para cargas de trabajo con acceso aleatorio intenso, como tablas muy grandes con índices complejos, sistemas OLTP o aplicaciones que hacen miles de pequeñas operaciones por segundo. Al acortar el tiempo de ida y vuelta de cada petición, el sistema operativo y las bases de datos pueden encadenar más trabajo en el mismo intervalo de tiempo.

Además, NVMe admite una mayor capacidad de procesamiento agregado, lo que le permite escalar con mayor facilidad cuando se añaden más unidades o cuando se trabaja con varias colas de comandos. En entornos de hosting compartido, VPS o servidores dedicados, esto se traduce en más clientes o más contenedores por nodo sin penalizar tanto el rendimiento.

La eficiencia energética de las SSD NVMe también es un punto fuerte. Aunque a veces puedan parecer más “calientes” por densidad de rendimiento, el coste energético por operación útil suele ser más bajo que en soluciones SATA o SAS. Para un data center, esto significa menos gasto eléctrico y menores problemas de refrigeración a igualdad de carga de trabajo.

Selección de hardware y controladores para aprovechar NVMe

Para explotar de verdad el potencial de NVMe no basta con pinchar una unidad en cualquier placa: es necesario que el conjunto procesador-placa base-controladores-sistema operativo esté alineado y sea compatible con el estándar.

En cuanto al procesador, la mayoría de CPUs modernas ya soportan sin problemas NVMe, pero conviene revisar las especificaciones del fabricante, especialmente en plataformas de servidor o en configuraciones multi-socket donde el reparto de líneas PCIe puede condicionar el rendimiento efectivo de las unidades.

La placa base es un componente crítico porque define cuántas líneas PCIe hay disponibles, a qué velocidad trabajan (PCIe 3.0, 4.0, 5.0) y cuántas ranuras M.2 o slots para tarjetas NVMe se pueden usar simultáneamente sin recortar ancho de banda. También es importante que el firmware (UEFI/BIOS) y el chipset soporten NVMe de forma nativa.

Cuando se necesitan más unidades NVMe de las que admite la placa de forma directa, se recurre a tarjetas de expansión que permiten añadir varios SSD NVMe sobre uno o más enlaces PCIe. En servidores PowerEdge o plataformas similares, es habitual encontrar backplanes específicos diseñados para NVMe de alto rendimiento.

La RAM también tiene un papel clave en el rendimiento global. Aunque NVMe reduce los tiempos de acceso al almacenamiento, si el sistema se queda corto de memoria principal, aparecerán cuellos de botella por swapping, cachés de disco poco eficaces y mayor presión sobre el subsistema de E/S. Disponer de RAM suficiente para las bases de datos, cachear índices y manejar buffers de E/S es tan importante como elegir buenas SSD.

Configuraciones RAID con unidades NVMe y su impacto

El uso de RAID sobre NVMe es una estrategia habitual para equilibrar rendimiento, redundancia y capacidad, sobre todo en bases de datos empresariales y servicios críticos. La elección del nivel RAID influye directamente en cómo se aprovechan las ventajas de NVMe.

RAID 0 es la opción más agresiva en rendimiento: distribuye los datos en bandas entre varias unidades, lo que permite lecturas y escrituras en paralelo a una velocidad muy elevada. Combinado con NVMe, se logran cifras espectaculares de throughput, pero sin ninguna tolerancia a fallos; si cae un disco, se pierde el conjunto completo.

Otros niveles como RAID 1, RAID 5 o RAID 10 introducen redundancia a costa de sacrificar algo de rendimiento o capacidad bruta. En entornos de bases de datos que requieren alta disponibilidad, RAID 10 suele ser una solución equilibrada: ofrece buena velocidad de lectura y mejor resiliencia que RAID 0, aunque el coste en unidades es mayor.

El propio esquema RAID tiene impacto en la amplificación de escritura. En NVMe, este factor es relevante para la durabilidad de la memoria NAND: ciertos niveles RAID generan escrituras adicionales que, si no se controlan bien, pueden acortar la vida útil de las unidades. Por eso suele ser recomendable combinar RAID con políticas de caché y escritura diferida bien diseñadas.

Además del RAID tradicional gestionado por el sistema operativo o por controladoras dedicadas, los proveedores de servidores (por ejemplo, en gamas como PowerEdge) integran firmware y herramientas específicas para optimizar el comportamiento de NVMe bajo diferentes arreglos RAID, permitiendo ajustes finos según el tipo de carga (lectura intensiva, mixta, OLTP, etc.).

Caché y NVMe: aliados para reducir latencia y carga del servidor

La caché es el complemento natural de NVMe en cualquier infraestructura moderna. Aunque NVMe ya ofrece una latencia muy baja, la idea de servir datos desde una capa aún más rápida (memoria principal, caché de objetos, caché del navegador) multiplica el efecto beneficioso sobre el rendimiento.

A nivel de servidor web, las cachés de página y de contenido dinámico —como LiteSpeed Cache, Varnish o configuraciones avanzadas de NGINX— permiten devolver páginas completas o fragmentos HTML sin tener que pasar por PHP, el intérprete de scripts o el motor de bases de datos en cada petición. Esto reduce drásticamente la carga de CPU y E/S.

La caché de objetos, mediante tecnologías como Redis o Memcached, almacena resultados de consultas frecuentes o estructuras de datos críticas en memoria RAM, evitando repetidas lecturas desde el almacenamiento. En combinación con NVMe, se consigue un backend muy ágil, capaz de soportar oleadas de tráfico sin que las consultas a la base de datos se conviertan en un cuello de botella.

La caché del navegador, por su parte, juega en el lado del cliente: archivos estáticos (imágenes, hojas de estilo, JavaScript) se guardan localmente en el dispositivo del usuario, reduciendo el número de peticiones al servidor y el volumen de datos transferidos. Esto no solo aligera el trabajo del servidor NVMe, sino que acorta los tiempos de carga percibidos.

La combinación de NVMe y caché bien ajustada puede reducir los tiempos de carga de un sitio web o aplicación por encima del 50 % frente a arquitecturas basadas en HDD o incluso SSD SATA. Menos latencia, más operaciones por segundo y menor consumo de recursos acaban traduciéndose también en una mejor experiencia de usuario y en una ventaja SEO tangible.

Estrategias avanzadas de caché para bases de datos sobre NVMe

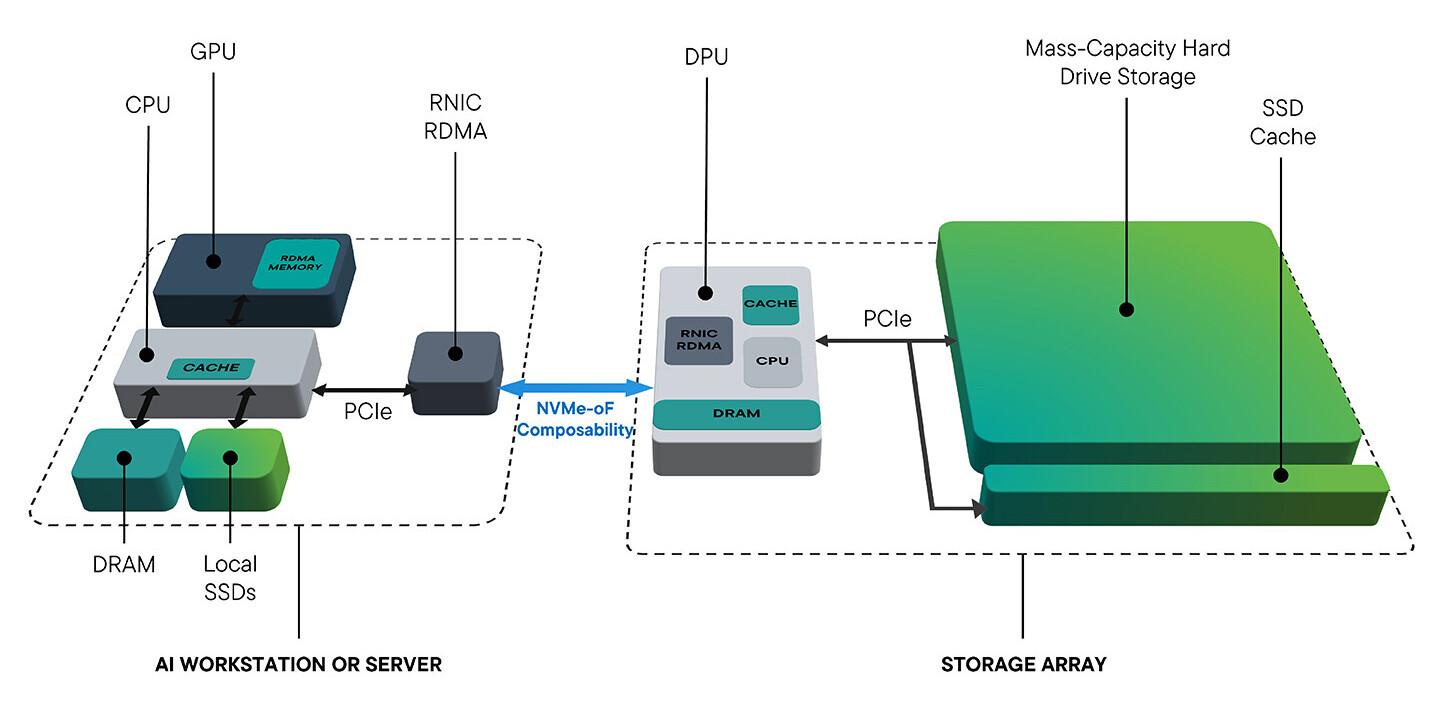

En el terreno de las bases de datos, las estrategias de caché van más allá del simple almacenamiento de páginas web. Se exploran técnicas como caché de lectura anticipada, escritura diferida o incluso jerarquías híbridas de almacenamiento entre SSD NVMe y HDD tradicionales.

La caché de lectura anticipada se centra en mantener en memoria los datos más consultados, de modo que se reduzca al mínimo el número de accesos directos al dispositivo de almacenamiento. El motor de la base de datos, o una capa intermedia, detecta patrones de acceso frecuentes y precarga bloques de datos potencialmente necesarios.

La caché de escritura diferida, en cambio, acumula temporalmente las escrituras en una zona rápida (por ejemplo, memoria RAM o una parte de la SSD) y las vuelca al almacenamiento permanente en momentos más favorables. Esto suaviza los picos de E/S, reduce la latencia aparente para la aplicación y permite agrupar escrituras para hacerlas más eficientes.

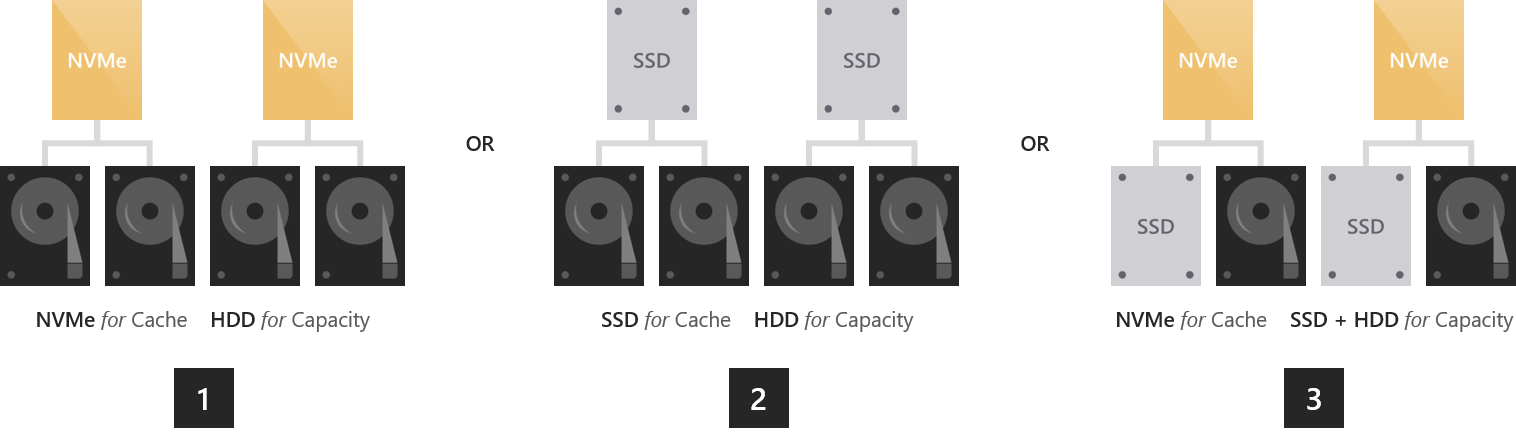

En algunos escenarios se diseña una estrategia híbrida NVMe + HDD: los datos más “calientes” o de acceso frecuente se ubican en unidades NVMe, mientras que los datos históricos o poco utilizados permanecen en discos duros convencionales. Esta arquitectura permite optimizar costes manteniendo un rendimiento muy alto en la parte crítica del dataset.

La clave está en definir bien las políticas que gobiernan qué datos se almacenan en qué nivel y cuándo se promueven o descienden entre capas (tiering). Una mala configuración puede provocar que datos importantes acaben en el nivel lento o que el sistema se pase el día moviendo información entre capas, perdiendo la ventaja de NVMe.

Co-Active: un esquema colaborativo de administración de caché para NVMe

Investigadores de varias instituciones chinas y estadounidenses han propuesto un esquema de caché llamado Co-Active, diseñado específicamente para cerrar la brecha entre la velocidad potencial de la memoria NAND flash y la capacidad real de los mecanismos de caché en SSD NVMe de alto rendimiento.

El problema de fondo es que, aunque la memoria NAND es muy rápida, la gestión de la caché intermedia (donde se atienden las solicitudes de E/S) puede convertirse en el nuevo cuello de botella, especialmente en escenarios de ráfagas intensas de operaciones de lectura y escritura que deben resolverse prácticamente en tiempo real.

Co-Active se plantea como un esquema colaborativo de gestión de caché de escritura diferida aditiva, adaptado tanto a los patrones de acceso de E/S como al estado de uso de los distintos chips flash. En lugar de limitarse a políticas pasivas como GCaR o LCR, el sistema actúa de forma proactiva sobre los datos almacenados en caché.

Cuando alguno de los chips flash se encuentra inactivo, los datos “fríos” y “sucios” que residen en caché se vacían hacia ese chip ocioso, liberando espacio para nuevas escrituras en las zonas más activas. Para reducir el coste temporal del reemplazo de datos, se da prioridad al desalojo de datos “limpios” en mitad del proceso de sustitución de entradas de caché.

Además, Co-Active establece un umbral máximo de escritura diferida en función del nivel de ráfagas de E/S de cada carga de trabajo, con la finalidad de evitar que escrituras redundantes se descarguen innecesariamente en la memoria flash. Con ello se mejora la resistencia de la NAND, al reducir la amplificación de escritura y el desgaste asociado.

Resultados de rendimiento del enfoque Co-Active en SSD NVMe

Los autores de Co-Active han comparado su esquema de gestión de caché con varios de los algoritmos más populares del mercado (LRU, CFLRU, GCaR, LCR y simuladores como MQSim), centrándose en escenarios de alto consumo de datos donde las SSD NVMe se someten a cargas intensivas.

Según sus pruebas, Co-Active reduce el tiempo medio de respuesta de las operaciones de E/S en hasta un 83,89 % en el mejor de los casos, con una mejora media cercana al 32,7 % frente a los demás esquemas evaluados. Esto supone un salto muy significativo para aplicaciones sensibles a la latencia.

En términos de rendimiento global, el esquema colaborativo reporta incrementos de hasta un 76,4 %, con un promedio del 42,3 %, lo que indica que no solo gana en tiempo de respuesta individual, sino también en throughput sostenido en cargas reales de trabajo.

Otro aspecto clave es la mejora de la tasa de amplificación de escritura, que llega a aumentar (es decir, se reduce el efecto negativo) hasta un 60,5 %, con una media alrededor del 5,4 %. Menos amplificación de escritura implica menor desgaste de los chips NAND y, por tanto, una vida útil potencialmente más larga para las unidades NVMe.

En conjunto, estos resultados sitúan a Co-Active como una propuesta muy interesante para futuras generaciones de controladores y firmware de SSD NVMe enfocadas a cargas de trabajo de datos intensivos, como bases de datos de gran tamaño, análisis masivo de datos o aplicaciones de inteligencia artificial.

Uso de NVMe como caché para HDD en Windows: límites prácticos

Una duda habitual es si se puede usar una unidad NVMe como caché para un disco duro grande mediante tecnologías como Espacios de Almacenamiento de Windows, con la idea de mantener velocidades muy altas de forma sostenida al copiar o mover datos.

En una configuración de prueba con un NVMe de 1 TB y un HDD de 2,5″ de 1 TB, se puede crear un espacio de almacenamiento que combine ambas unidades. Al copiar archivos grandes (por ejemplo, unos 80 GB) desde otro NVMe del sistema hacia ese espacio, se observa un comportamiento típico: al principio la copia arranca a unos 2 GB/s (velocidad de la SSD NVMe), pero pronto cae a alrededor de 140 MB/s, que es básicamente el máximo del disco duro mecánico.

Esta caída de rendimiento no es un fallo de configuración, sino una limitación del propio diseño de los Espacios de Almacenamiento y de cómo gestionan los datos entre diferentes tipos de discos. Aunque en ciertos escenarios se puede aprovechar el SSD como parte rápida del pool, el sistema acaba escribiendo de forma persistente en el HDD, arrastrando inevitablemente su rendimiento.

Ajustar la configuración puede mejorar algo la experiencia —por ejemplo, eligiendo un tipo de resiliencia o distribución de datos más adecuado— pero no convierte mágicamente el HDD en un dispositivo que mantenga velocidades de NVMe durante copias largas. La caché solo puede amortiguar las escrituras hasta cierto punto antes de que el disco mecánico marque el tope.

Si el objetivo es maximizar las ventajas de NVMe como caché real frente a HDD, a menudo resulta más eficaz recurrir a soluciones específicas de caché de bloque o de archivo, o a tecnologías de tiering automatizado, en lugar de depender exclusivamente de Espacios de Almacenamiento, que no están pensados como un sistema de caché agresivo en el sentido estricto.

Compatibilidad de NVMe con sistemas operativos y motores de base de datos

La buena noticia es que NVMe está ampliamente soportado por los principales sistemas operativos y plataformas de servidor. Distribuciones Linux modernas, Windows en sus versiones actuales y macOS integran controladores nativos para trabajar con dispositivos NVMe sin necesidad de software adicional en la mayoría de los casos.

En el campo de las bases de datos, motores como MySQL, MariaDB, Oracle Database o SQL Server funcionan perfectamente sobre unidades NVMe, siempre que el sistema operativo las reconozca correctamente. La configuración óptima puede variar, pero la compatibilidad básica no suele ser un problema.

En entornos empresariales, es frecuente que los fabricantes de servidores (por ejemplo, la familia PowerEdge en múltiples modelos de las gamas R, T, C, XE y XR) publiquen listas de hardware certificado y combinaciones de sistemas operativos soportadas, incluyendo Red Hat Enterprise Linux 7, 8 y 9, entre otros. Esto asegura que controladores, firmware y utilidades de gestión estén alineados.

Conviene revisar siempre las recomendaciones del proveedor de la base de datos y del fabricante del servidor acerca de alineación de particiones, tamaños de bloque, configuración de colas de E/S y opciones del scheduler de disco. Pequeños ajustes pueden marcar diferencias apreciables en latencia y throughput sostenido.

Cuando se usan características avanzadas como múltiples colas de comandos NVMe, no todos los sistemas operativos y controladores las soportan exactamente igual. Verificar la documentación y, si es posible, hacer pruebas de rendimiento antes de poner en producción ayuda a evitar sorpresas desagradables.

Cómo reducir la latencia con controladores y colas NVMe

Uno de los puntos más sensibles en el rendimiento con NVMe es la gestión de las colas de comandos. Un controlador bien afinado y actualizado puede reducir de forma notable la latencia observada por las aplicaciones.

Usar controladores NVMe actualizados y específicos del fabricante, cuando estén disponibles, suele ofrecer mejores resultados que depender de controladores genéricos antiguos. Estos drivers suelen incorporar optimizaciones para manejar mejor las ráfagas de E/S, aprovechar las múltiples colas y reducir la sobrecarga de CPU.

La configuración de la profundidad de cola y el número de colas concurrentes influye directamente en la capacidad del sistema para procesar operaciones en paralelo. Una cola demasiado corta puede infrautilizar la unidad, y una excesivamente larga puede añadir latencia en lugar de reducirla. Encontrar el equilibrio requiere pruebas con la carga real o aproximada.

NVMe permite usar múltiples colas de comandos, lo que es ideal para sistemas con varios hilos de ejecución (por ejemplo, aplicaciones multithread o bases de datos con muchos workers). Cada hilo puede enviar solicitudes a su propia cola, reduciendo la contención y mejorando la escalabilidad en servidores con muchas CPU o núcleos.

La combinación de buenas prácticas a nivel de driver, firmware y configuración de colas se traduce en menores tiempos de respuesta para lecturas y escrituras, lo que, de cara al usuario final, significa aplicaciones más reactivas y tiempos de carga mucho menores, especialmente bajo carga intensa.

Monitorización y optimización continua de entornos NVMe

Para mantener un entorno NVMe en su punto óptimo no basta con configurarlo bien una vez: es imprescindible monitorizar de manera constante el rendimiento y el estado de las unidades para detectar cuellos de botella y degradaciones antes de que afecten al negocio.

Las herramientas de monitorización deben ser capaces de registrar métricas clave como velocidad de lectura y escritura, latencia media y máxima, uso de CPU y RAM, profundidad de cola, IOPS y, en el caso de las SSD, parámetros de salud como ciclos de escritura consumidos o temperatura.

Con esta información se pueden ajustar parámetros de configuración como la estrategia de caché, la profundidad de las colas, el scheduler de E/S o incluso la distribución de datos entre distintas unidades y niveles de almacenamiento. Las pruebas de carga periódicas permiten comprobar si los cambios aplicados se traducen efectivamente en mejoras.

También es recomendable realizar benchmarks comparativos cuando se introducen nuevas versiones de firmware o controladores, ya que a veces las actualizaciones traen consigo tanto optimizaciones como cambios de comportamiento que pueden beneficiar a unas cargas de trabajo y perjudicar a otras.

En escenarios de bases de datos críticas o hosting con fuerte exigencia de SLA, tener alarmas basadas en umbrales de latencia, errores de E/S o degradación de unidades NVMe es fundamental para reaccionar antes de que se produzcan caídas o lentitud percibida por los usuarios.

A día de hoy, NVMe y las técnicas de caché avanzadas forman el núcleo de las plataformas de alto rendimiento, permitiendo a empresas, desarrolladores y proveedores de hosting ofrecer servicios más rápidos, estables y escalables. Desde sitios web de alta demanda hasta grandes bases de datos o entornos de análisis intensivo, invertir en una arquitectura bien pensada alrededor de NVMe, controladores optimizados, esquemas de caché colaborativa como Co-Active y una buena monitorización marca una diferencia clara frente a infraestructuras más tradicionales.

Tabla de Contenidos

- Qué es NVMe y por qué marca tanta diferencia

- Ventajas de NVMe frente a SATA y SAS en hosting y bases de datos

- Selección de hardware y controladores para aprovechar NVMe

- Configuraciones RAID con unidades NVMe y su impacto

- Caché y NVMe: aliados para reducir latencia y carga del servidor

- Estrategias avanzadas de caché para bases de datos sobre NVMe

- Co-Active: un esquema colaborativo de administración de caché para NVMe

- Resultados de rendimiento del enfoque Co-Active en SSD NVMe

- Uso de NVMe como caché para HDD en Windows: límites prácticos

- Compatibilidad de NVMe con sistemas operativos y motores de base de datos

- Cómo reducir la latencia con controladores y colas NVMe

- Monitorización y optimización continua de entornos NVMe