- Definir bien necesidades de negocio, hardware, sistema operativo y ubicación del servidor es clave para una infraestructura estable.

- La seguridad y el mantenimiento continuo (actualizaciones, copias y monitorización) son imprescindibles para proteger datos críticos.

- Virtualización, nube híbrida, edge computing e inteligencia artificial permiten optimizar recursos y aumentar la resiliencia.

- Empezar con un servidor Linux de pruebas y buenas guías facilita aprender administración de sistemas de forma progresiva.

Configurar un servidor puede imponer bastante respeto cuando empiezas: hay hardware, sistemas operativos, redes, seguridad, copias de seguridad… y parece que todo puede romperse a la mínima. Pero con buenos tutoriales y una guía clara, montar y administrar servidores deja de ser cosa exclusiva de expertos y se convierte en algo asumible paso a paso.

En las siguientes líneas vas a encontrar un recorrido completo por el mundo de los servidores: qué son y para qué sirven en una pyme, cómo elegir hardware y sistema operativo, qué opciones tienes (físico, centro de datos o nube), cómo instalar y configurar un servidor Linux desde cero, qué medidas de seguridad aplicar, cómo mantenerlo en el tiempo y qué tendencias vienen empujando fuerte (nube híbrida, edge computing, inteligencia artificial, automatización…).

Qué es un servidor y por qué es clave en una pyme

Un servidor es básicamente un ordenador especializado en ofrecer servicios a otros dispositivos conectados a la red: almacena archivos, ejecuta aplicaciones, aloja páginas web, gestiona bases de datos, correo, copias de seguridad y un largo etcétera. La idea es que actúe como un “bibliotecario digital” que organiza y entrega información de forma rápida y segura a muchos usuarios al mismo tiempo.

En el entorno de una pequeña o mediana empresa, tener un servidor propio permite centralizar la información en un único punto, lo que facilita muchísimo la gestión de documentos, permisos y seguridad. En lugar de tener archivos sueltos en cada ordenador, todo se guarda en el servidor y se comparte de forma ordenada.

Gracias a esa centralización, mejora la colaboración interna: varios empleados pueden trabajar sobre los mismos proyectos, ya sea desde la oficina o en remoto, con acceso controlado a las carpetas y aplicaciones que necesiten.

Otro punto fuerte es la capacidad de escalar recursos. Cuando la empresa crece, un servidor bien pensado permite ampliar almacenamiento, memoria, procesador o servicios sin tener que reinventar toda la infraestructura desde cero.

Además, un servidor bien protegido aporta un plus muy importante de seguridad y continuidad de negocio: se pueden definir políticas de copias de seguridad, recuperación ante desastres, restricción de accesos y registro de lo que ocurre en el sistema para reaccionar rápido ante cualquier problema.

Ventajas de tener un servidor propio frente a depender de terceros

Montar tu propio servidor implica cierta inversión y responsabilidad, pero también da un control enorme sobre la infraestructura. La empresa decide cómo se organizan los datos, qué servicios se ofrecen, qué políticas se aplican y cómo se cumplen las normativas de seguridad o privacidad.

Al gestionar el servidor internamente, la flexibilidad es mayor: se pueden personalizar configuraciones, automatizar procesos a medida y adaptar el entorno de trabajo a las necesidades reales de la organización, desde el correo corporativo hasta las aplicaciones de gestión.

Otra ventaja es la optimización del uso de recursos. En lugar de depender de múltiples servicios externos, se concentran varias funciones (archivos, bases de datos, web, copias de seguridad…) en una única plataforma bien dimensionada.

También se gana en independencia tecnológica: si todo está en manos de un tercero, cualquier cambio de precios, condiciones o fallo de ese proveedor puede dejar a la empresa vendida. Con un servidor propio, al menos el control del entorno básico es tuyo.

Por supuesto, esto no significa que la nube deje de ser interesante. Lo habitual hoy en día es combinar recursos propios con servicios en la nube, aprovechando lo mejor de cada mundo según el tipo de carga de trabajo.

Evolución de los servidores y auge de la nube

Los servidores han cambiado radicalmente en las últimas décadas. De aquellas máquinas enormes, ruidosas y tragadoras de energía, hemos pasado a equipos compactos, eficientes y, sobre todo, altamente virtualizados.

La virtualización permitió dar un salto clave: un solo servidor físico puede alojar varias máquinas virtuales, cada una con su propio sistema operativo y aplicaciones, aisladas entre sí. Esto mejora el aprovechamiento del hardware y facilita la gestión y la alta disponibilidad.

Con el tiempo, sobre esa base ha llegado la computación en la nube. Los proveedores de nube pública ofrecen servidores virtuales “de alquiler” que puedes encender, apagar o redimensionar casi al instante, pagando solo por lo que consumes.

Las empresas que necesitan un control extremo han apostado por la nube privada: infraestructura propia o alojada en centros de datos, pero administrada con las mismas tecnologías de orquestación que la nube pública, manteniendo los datos dentro de un entorno muy controlado.

En muchos casos, la mejor opción termina siendo una arquitectura híbrida o incluso multi-nube, donde parte de los servicios se ejecutan en la infraestructura interna y otros se derivan a uno o varios proveedores de nube pública, optimizando costes, rendimiento y resiliencia.

Conceptos básicos antes de lanzarte a configurar un servidor

Si es la primera vez que te enfrentas a un servidor, es normal sentirte algo perdido. Para no ahogarte, viene bien tener claros tres bloques: hardware, software y redes.

En la parte de hardware entran el procesador (CPU), la memoria RAM, los discos (HDD o SSD), las tarjetas de red y el resto de componentes. Cada pieza contribuye al rendimiento general y debe estar acorde con las necesidades de la empresa.

El software lo protagoniza el sistema operativo de servidor (por ejemplo, Windows Server o alguna distribución Linux tipo Ubuntu Server, Debian, AlmaLinux…). Sobre él se instalan las aplicaciones necesarias: servidor web, bases de datos, correo, herramientas de copia de seguridad, etc.

En cuanto a redes, hay que tratar temas como IP estática, configuración de interfaces, uso de protocolos TCP/IP, DNS para resolver nombres de dominio, DHCP para repartir direcciones, y otros servicios que permiten que los equipos de la organización se comuniquen sin problemas.

La planificación inicial también debe tener en cuenta la inversión económica: coste del hardware, licencias de software si las hay, honorarios del técnico o equipo que realice la instalación y la configuración, y el mantenimiento a medio y largo plazo.

Hardware: el corazón de tu servidor

Elegir el hardware adecuado es crítico para que el servidor responda bien y no se quede corto al poco tiempo. No se trata solo de comprar “lo más caro”, sino de ajustar componentes a la carga de trabajo real.

La CPU actúa como el cerebro: cuantos más núcleos y mejor frecuencia, más peticiones podrá procesar simultáneamente. Para servidores con virtualización, bases de datos o muchas conexiones concurrentes, conviene que soporte tecnologías como VT-x o AMD-V.

La memoria RAM es el espacio de trabajo de las aplicaciones. Si es escasa, el sistema empezará a usar disco como memoria de apoyo y el rendimiento se hundirá. Para servicios con múltiples aplicaciones o máquinas virtuales, es mejor ir sobrado de RAM que corto.

En almacenamiento, hay que decidir entre discos duros mecánicos (HDD) o unidades SSD. Los HDD ofrecen más capacidad por menos dinero, pero los SSD son muchísimo más rápidos y mejoran tanto el arranque como la respuesta de aplicaciones y bases de datos.

También importa el formato del servidor: equipos tipo torre (ideales para oficinas pequeñas con pocos servidores) o formato rack para montar varios en un armario de comunicaciones, muy útiles en armarios de CPD o empresas con previsión de crecimiento.

Criterios para dimensionar correctamente el hardware

Antes de comprar nada, conviene pensar qué uso va a tener el servidor: ¿va a alojar una web corporativa sencilla?, ¿llevará varias bases de datos?, ¿será un servidor de archivos para toda la oficina?, ¿tendrá máquinas virtuales?

La carga de trabajo prevista determina necesidades mínimas de CPU, RAM y almacenamiento. Un servidor pensado solo para ficheros internos no requiere lo mismo que uno que va a servir páginas a miles de usuarios externos.

Hay que estimar también el número de usuarios simultáneos que se conectarán. Cuantos más haya, más memoria y recursos de procesamiento serán necesarios para que la respuesta siga siendo fluida.

Otro aspecto clave es el crecimiento futuro de la empresa. Si se prevé aumentar plantilla, servicios o volumen de datos, es mejor invertir en un servidor con margen de ampliación en lugar de quedarse cortos y tener que cambiarlo de inmediato.

Finalmente, todo esto se debe equilibrar con el presupuesto disponible. Se trata de encontrar el punto medio entre coste razonable y equipo lo bastante potente y ampliable para durar varios años.

Sistema operativo: la base de software del servidor

El sistema operativo de servidor es la capa que controla el hardware y ofrece el entorno donde se ejecutan las aplicaciones. Las dos grandes familias son Windows Server y Linux (en sus múltiples variantes).

Como contrapartida, las licencias de Windows Server tienen un coste que hay que sumar al presupuesto y puede ser algo menos flexible que Linux cuando se trata de automatizar o personalizar entornos muy específicos.

En el otro lado está Linux, con distribuciones como Ubuntu Server, Debian, CentOS/AlmaLinux/Rocky Linux u openSUSE Leap. Son sistemas robustos, con un rendimiento excelente y una enorme comunidad que aporta documentación, herramientas y soporte informal.

Linux ofrece la ventaja de ser gratuito y altamente configurable, pero a cambio suele exigir una curva de aprendizaje mayor, especialmente si no se está habituado a trabajar con la terminal y la administración por línea de comandos.

Cómo elegir entre Windows Server y Linux

La decisión no es solo técnica, también influye la experiencia del equipo, el tipo de aplicaciones que se van a utilizar y el presupuesto disponible para licencias.

Si las aplicaciones clave de la empresa están pensadas para entorno Windows o se requiere una integración profunda con servicios de Microsoft, lo lógico es optar por Windows Server, aprovechando su ecosistema.

Si en cambio se busca minimizar costes y tener máxima libertad de configuración, Linux es una opción muy atractiva, especialmente en servidores web, bases de datos de código abierto o entornos de desarrollo.

También es importante ver qué sabe hacer ya el equipo técnico. Si las personas encargadas de administrar el servidor controlan más de Windows, tal vez sea preferible quedarse en ese terreno. Si dominan Linux, aprovecharán mejor sus ventajas.

En temas de seguridad, tanto Windows Server como Linux han evolucionado muchísimo. Linux suele tener una comunidad muy activa que detecta y corrige vulnerabilidades rápido, mientras que Microsoft publica parches de forma periódica. En ambos casos, lo crucial es mantener el sistema siempre actualizado.

Virtualización: muchos servidores lógicos en una sola máquina

La virtualización permite exprimir el hardware creando varias máquinas virtuales independientes sobre un único servidor físico. Cada máquina virtual tiene su propio sistema operativo, configuración y aplicaciones.

Con esta técnica, es posible consolidar varios servidores físicos antiguos en uno más moderno y potente, reduciendo consumo eléctrico, espacio, mantenimiento y complejidad de la infraestructura.

Además, la virtualización facilita la alta disponibilidad: si un hardware falla, las máquinas virtuales pueden moverse a otro servidor físico (según la solución utilizada) con una interrupción mínima.

En entornos donde hay que probar nuevas aplicaciones o configuraciones, la virtualización ofrece una flexibilidad tremenda, ya que permite crear y destruir máquinas virtuales en cuestión de minutos, sin afectar al servidor principal.

Sobre la virtualización se apoyan muchas de las soluciones de nube y de automatización modernas, por lo que entenderla es casi obligatorio para cualquier persona que quiera profundizar en la administración de sistemas.

Dónde colocar tu servidor: oficina, centro de datos o nube

La ubicación física o lógica del servidor importa tanto como el hardware o el sistema operativo. Elegir entre tenerlo en la sede de la empresa, en un centro de datos externo o directamente en la nube marcará costes, seguridad y posibilidades de crecimiento.

Montar el servidor dentro de la propia oficina da un enorme control: acceso directo a la máquina, a sus discos y a toda la parte física. También suele ofrecer una latencia mínima para la red local y facilita ciertas tareas de mantenimiento si hay personal técnico interno.

El lado negativo es que requiere espacio físico, refrigeración adecuada, protección frente a cortes de luz y medidas de seguridad para que nadie no autorizado pueda toquetear el equipo. Además, escalar a muchas máquinas puede ser complicado.

La alternativa es alojar el servidor en un centro de datos profesional. Allí se cuenta con sistemas de alimentación redundante, climatización, vigilancia, control de accesos y técnicos especializados, lo que aumenta la fiabilidad del servicio.

Eso sí, implica pagar cuotas mensuales o anuales por el espacio, la energía y la conectividad, y se pierde cierto control directo sobre el entorno físico, ya que para cualquier intervención habrá que coordinarse con el proveedor.

Opciones en la nube y consideraciones ambientales

La nube ofrece otra forma de “tener” servidores sin preocuparse de hardware físico. Contratas instancias virtuales, bases de datos gestionadas, almacenamiento y otros servicios bajo un modelo de pago por uso.

Para muchas pymes, esta opción aporta una escalabilidad brutal: cuando hay picos de demanda, se aumentan recursos; cuando baja la actividad, se reducen para ahorrar costes. Todo ello sin comprar ningún aparato.

Sin embargo, apoyarse por completo en la nube implica una dependencia importante del proveedor, tanto a nivel de disponibilidad como de cambios en precios o condiciones. También puede haber limitaciones de personalización en comparación con un servidor propio.

Cuando se opta por servidores físicos (en oficina o centro de datos), hay que cuidar el entorno ambiental: mantener la temperatura en rangos seguros, controlar la humedad para evitar corrosión o condensación y proteger el equipo de accesos no autorizados.

La alimentación eléctrica es crítica: un sistema SAI (UPS) ayuda a evitar apagones bruscos y picos de tensión que podrían dañar el hardware o corromper datos, algo especialmente importante en servidores de producción.

Conectividad a Internet y calidad de la red

La conexión a Internet es la “carretera” por la que se mueven los datos cuando el servidor ofrece servicios hacia fuera (por ejemplo, una web pública o acceso remoto por VPN o SSH).

Es recomendable contratar una línea de banda ancha con suficiente capacidad de subida y bajada para soportar el tráfico que se generará, sin que el resto de la red de la empresa se quede estrangulada.

Para proyectos críticos, suele ser buena idea disponer de conexión redundante: dos proveedores o al menos dos rutas diferentes que entren al edificio, de forma que si una falla, la otra mantenga los servicios en marcha.

No solo importa el ancho de banda; la latencia (tiempo que tarda un paquete en ir y volver) también es clave en aplicaciones en tiempo real, como videollamadas, videojuegos en línea o sistemas de control remoto.

Una red interna bien diseñada, con switches adecuados, cableado correcto y segmentación por VLAN si hace falta, ayudará a que el servidor rinda al máximo sin cuellos de botella innecesarios.

Seguridad de los servidores: amenazas y buenas prácticas

La seguridad es uno de los temas más delicados cuando se habla de servidores. Allí se guardan datos de clientes, documentos internos, bases de datos sensibles y muchas veces información crítica para el negocio.

Entre los riesgos más frecuentes están los ataques desde Internet (intentos de intrusión, fuerza bruta contra contraseñas, explotación de fallos en aplicaciones, instalación de malware, ransomware, etc.).

También hay que vigilar las vulnerabilidades del software: cualquier sistema operativo o aplicación puede tener fallos que, si no se corrigen con parches y actualizaciones, se convierten en una puerta abierta para atacantes.

No se puede olvidar el factor humano: errores de configuración, contraseñas débiles, cuentas sin control o prácticas poco seguras (como usar siempre el usuario administrador) son una de las principales fuentes de problemas.

Para reducir estos riesgos, conviene aplicar un conjunto de buenas prácticas de seguridad desde el primer día y mantenerlas en el tiempo, revisando periódicamente que todo sigue bajo control.

Cómo proteger tu servidor paso a paso

La primera línea de defensa es mantener todo el software al día: sistema operativo, paneles de control, aplicaciones, firmware de dispositivos… Los parches de seguridad se publican precisamente para cerrar agujeros conocidos.

El uso de contraseñas robustas y únicas en cada cuenta es imprescindible. Siempre que sea posible, conviene activar autenticación en dos pasos para accesos sensibles e impedir así que una contraseña filtrada sea suficiente para entrar.

Un firewall bien configurado limita qué puertos y servicios son accesibles desde el exterior y desde la red interna, reduciendo la superficie de ataque. En Linux se puede usar ufw o iptables, y en Windows los cortafuegos integrados.

Las copias de seguridad periódicas son tu salvavidas: si algo sale mal (ataque, borrado accidental, fallo de hardware), podrás recuperar datos. Lo ideal es combinar copias completas con incrementales o diferenciales para optimizar tiempo y espacio.

Además, es fundamental monitorizar el servidor con herramientas que alerten de actividad sospechosa, consumos anómalos de recursos o servicios que se caen, de forma que puedas reaccionar antes de que el problema se haga enorme.

Seguridad física, de la información y copias de seguridad

La seguridad física suele pasarse por alto, pero es tan importante como la lógica. Limitar el acceso al lugar donde se encuentra el servidor mediante tarjetas, llaves o sistemas biométricos evita que cualquiera pueda manipular el hardware.

Refuerza esa protección con cámaras de vigilancia y sistemas de alarma, sobre todo si el servidor está en una habitación separada o en un armario de comunicaciones al que pasa gente a menudo.

En el plano lógico, hay que contar con firewalls y sistemas de detección de intrusos (IDS) que analicen el tráfico en busca de patrones extraños e intentos de ataque, alertando al administrador.

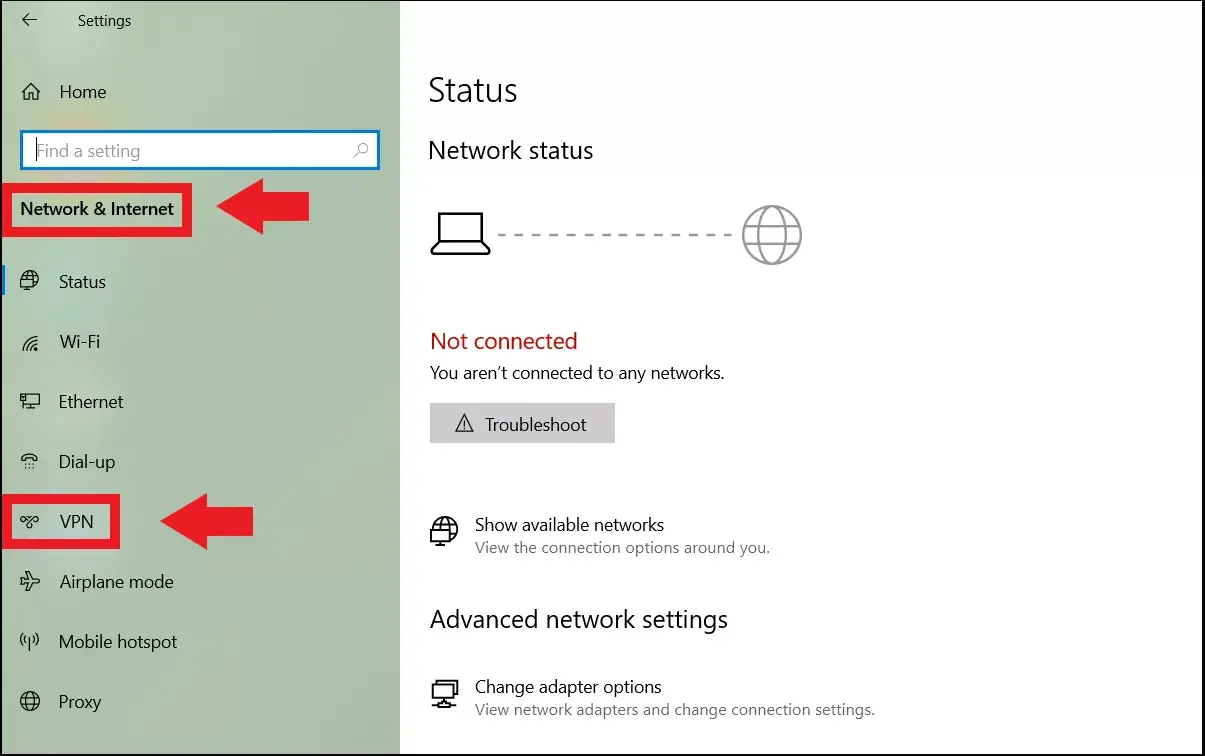

El cifrado de datos en tránsito y en reposo es otra capa importante: usar HTTPS (SSL/TLS) para servicios web, VPN para accesos remotos y cifrado de discos o volúmenes para los datos almacenados reduce el impacto de posibles filtraciones.

Por último, conviene definir bien la gestión de usuarios y permisos, aplicando el principio de privilegio mínimo: cada persona debe tener solo los accesos necesarios para su trabajo, ni más ni menos.

Tareas de mantenimiento para que el servidor dure años

Un servidor no es algo que se instala y se olvida. Requiere mantenimiento regular para seguir siendo estable, seguro y rápido a medida que pasa el tiempo.

Entre las tareas de rutina están las actualizaciones periódicas del sistema operativo y las aplicaciones, que no solo corrigen fallos de seguridad, sino también errores y problemas de compatibilidad.

Las copias de seguridad deben revisarse con frecuencia: no basta con programarlas, también hay que comprobar que se realizan sin errores y que los procedimientos de restauración funcionan.

El monitoreo continuo del rendimiento ayuda a detectar cuellos de botella, procesos que se disparan, discos que se quedan sin espacio o servicios que se reinician solos, antes de que afecten a los usuarios.

De vez en cuando conviene hacer tareas de limpieza de archivos obsoletos, logs y restos de aplicaciones que ya no se usan, para liberar espacio y mantener el sistema ordenado.

Instalación paso a paso de tu primer servidor Linux

Si estás empezando en administración de sistemas, una de las mejores formas de aprender es montar un servidor Linux de pruebas, sin miedo a romper nada. Un ordenador viejo o una máquina virtual sirven de sobra para ello.

Lo primero es elegir la distribución. Para empezar, Ubuntu Server suele ser muy recomendable: es estable, con mucha documentación y una comunidad enorme. Otras opciones sólidas son Debian, CentOS/AlmaLinux/Rocky Linux u openSUSE Leap.

Después necesitas preparar la máquina. Puedes instalar en un equipo físico (ideal si quieres algo “real”) o crear una máquina virtual con herramientas como VirtualBox o VMware, lo que te permite experimentar sin tocar tu sistema principal.

Descarga la imagen ISO de la distribución elegida, arranca la máquina desde esa ISO y sigue el asistente de instalación, que te pedirá idioma, zona horaria, configuración de disco y creación del usuario administrador.

En esta fase es buena idea elegir una instalación mínima, sin entorno gráfico, para que el servidor consuma menos recursos y puedas centrarte en los servicios realmente necesarios.

Configuración inicial: red, actualizaciones y servicios básicos

Una vez instalado el sistema y tras el primer arranque, el siguiente paso es confirmar que tienes conectividad de red. Un simple ping a un dominio conocido te indica si hay salida a Internet.

Si la red está en orden, deberías ejecutar las actualizaciones de paquetes para asegurarte de que el servidor queda con las últimas versiones y parches de seguridad disponibles en los repositorios de la distribución.

El siguiente paso suele ser instalar servicios básicos como un servidor web. En Ubuntu Server, por ejemplo, puedes desplegar Apache de forma sencilla y luego comprobar desde otro equipo que la página de bienvenida se muestra al acceder a la IP del servidor.

También es buena idea añadir herramientas prácticas como OpenSSH para acceso remoto seguro, ufw para gestionar el firewall y utilidades de monitorización como htop, que te permiten ver de un vistazo el consumo de CPU y memoria.

A medida que avanzas, irás añadiendo más servicios (bases de datos, DNS, correo, etc.) según lo que quieras aprender o las necesidades de tu entorno, siempre intentando que cada cambio esté bien documentado.

Gestión de usuarios, permisos y firewall

No es recomendable trabajar siempre como root en un servidor Linux. Lo habitual es crear un usuario normal y darle privilegios de administrador mediante el grupo sudo para ejecutar tareas críticas solo cuando sea necesario.

Una buena política es crear un usuario por persona que vaya a tocar el servidor y ajustar sus permisos según las tareas que vaya a realizar. De esta manera, si se produce un problema, es más sencillo rastrear qué cuenta se ha visto comprometida o ha cometido un error.

El firewall es otra pieza imprescindible: con ufw puedes permitir solo los servicios necesarios (por ejemplo, SSH, HTTP y HTTPS) y bloquear el resto de puertos, reduciendo el riesgo de ataques.

Además, conviene revisar periódicamente qué puertos están abiertos y qué servicios se están ejecutando, para evitar dejar activos demonios o aplicaciones que ya no usas y que podrían servir de puerta de entrada.

Una vez configurado el acceso remoto mediante SSH y el firewall, podrás administrar el servidor cómodamente desde otro equipo, sin necesidad de estar físicamente delante de la máquina.

Tendencias: nube híbrida, edge computing e inteligencia artificial

El mundo de los servidores está en plena transformación gracias a nuevas formas de desplegar y gestionar la infraestructura. Las arquitecturas de nube híbrida y multi-nube se han vuelto muy populares en empresas que quieren flexibilidad y evitar depender de un único proveedor.

En una nube híbrida, parte de los servicios se ejecutan en la nube pública y otros en infraestructuras privadas, eligiendo en cada caso dónde tiene más sentido por temas de seguridad, coste o rendimiento.

La estrategia multi-nube va un paso más allá y combina recursos de varios proveedores de nube pública, repartiendo las cargas para aprovechar lo mejor de cada uno y reducir riesgos de caída generalizada.

Estas aproximaciones permiten adaptarse muy rápido a cambios en la demanda, optimizar gastos pagando solo por lo que se usa y mejorar la resiliencia, ya que no se depende de un único punto de fallo.

En paralelo, el edge computing traslada parte del procesamiento de datos cerca de donde se generan (por ejemplo, en dispositivos IoT o nodos regionales), reduciendo latencia y descargando la nube central para tareas de mayor envergadura.

El papel de la inteligencia artificial y la automatización

La inteligencia artificial está entrando de lleno en la gestión de servidores, analizando logs, métricas de uso y patrones de tráfico para detectar anomalías que podrían indicar un ataque o un fallo inminente de hardware.

Mediante técnicas de aprendizaje automático, se pueden optimizar automáticamente los recursos del servidor, ajustando memoria, CPU o almacenamiento asignados a distintos servicios para mejorar rendimiento y reducir costes.

La IA también permite una gestión predictiva: detecta síntomas tempranos de avería en discos, tarjetas o software, dando tiempo al administrador para actuar antes de que algo se rompa del todo y cause una caída del servicio.

En seguridad, los sistemas inteligentes ayudan a identificar patrones de tráfico sospechosos y bloquear amenazas en tiempo casi real, respondiendo más rápido de lo que podría hacerlo una persona analizando los datos a mano.

Todo esto se combina con una fuerte tendencia a la automatización de tareas repetitivas (despliegue de servidores, configuración estándar, parches, copias, monitorización), lo que reduce errores humanos y hace viable gestionar infraestructuras cada vez más grandes.

Una visión de conjunto para aprender a gestionar servidores

Desde la elección del hardware y el sistema operativo hasta la seguridad avanzada, la nube híbrida y la inteligencia artificial, el mundo de los servidores abarca muchas piezas que se conectan entre sí. Para quien empieza, lo más inteligente es avanzar por fases: montar un pequeño servidor Linux o Windows, practicar con la red, usuarios, firewall y copias de seguridad, y luego ir incorporando virtualización, servicios adicionales y automatización. Con buenos tutoriales para configurar servidores, algo de paciencia y ganas de trastear, puedes pasar de no haber tocado nunca un servidor a administrarlos con soltura y sentar las bases de una infraestructura sólida para cualquier pyme.

Tabla de Contenidos

- Qué es un servidor y por qué es clave en una pyme

- Ventajas de tener un servidor propio frente a depender de terceros

- Evolución de los servidores y auge de la nube

- Conceptos básicos antes de lanzarte a configurar un servidor

- Hardware: el corazón de tu servidor

- Criterios para dimensionar correctamente el hardware

- Sistema operativo: la base de software del servidor

- Cómo elegir entre Windows Server y Linux

- Virtualización: muchos servidores lógicos en una sola máquina

- Dónde colocar tu servidor: oficina, centro de datos o nube

- Opciones en la nube y consideraciones ambientales

- Conectividad a Internet y calidad de la red

- Seguridad de los servidores: amenazas y buenas prácticas

- Cómo proteger tu servidor paso a paso

- Seguridad física, de la información y copias de seguridad

- Tareas de mantenimiento para que el servidor dure años

- Instalación paso a paso de tu primer servidor Linux

- Configuración inicial: red, actualizaciones y servicios básicos

- Gestión de usuarios, permisos y firewall

- Tendencias: nube híbrida, edge computing e inteligencia artificial

- El papel de la inteligencia artificial y la automatización

- Una visión de conjunto para aprender a gestionar servidores