- SDN separa el plano de control del plano de datos, permitiendo programar la red mediante controladores y APIs abiertas como OpenFlow.

- Las redes definidas por software simplifican la gestión, mejoran la visibilidad y la escalabilidad, y reducen CAPEX y OPEX frente a redes tradicionales.

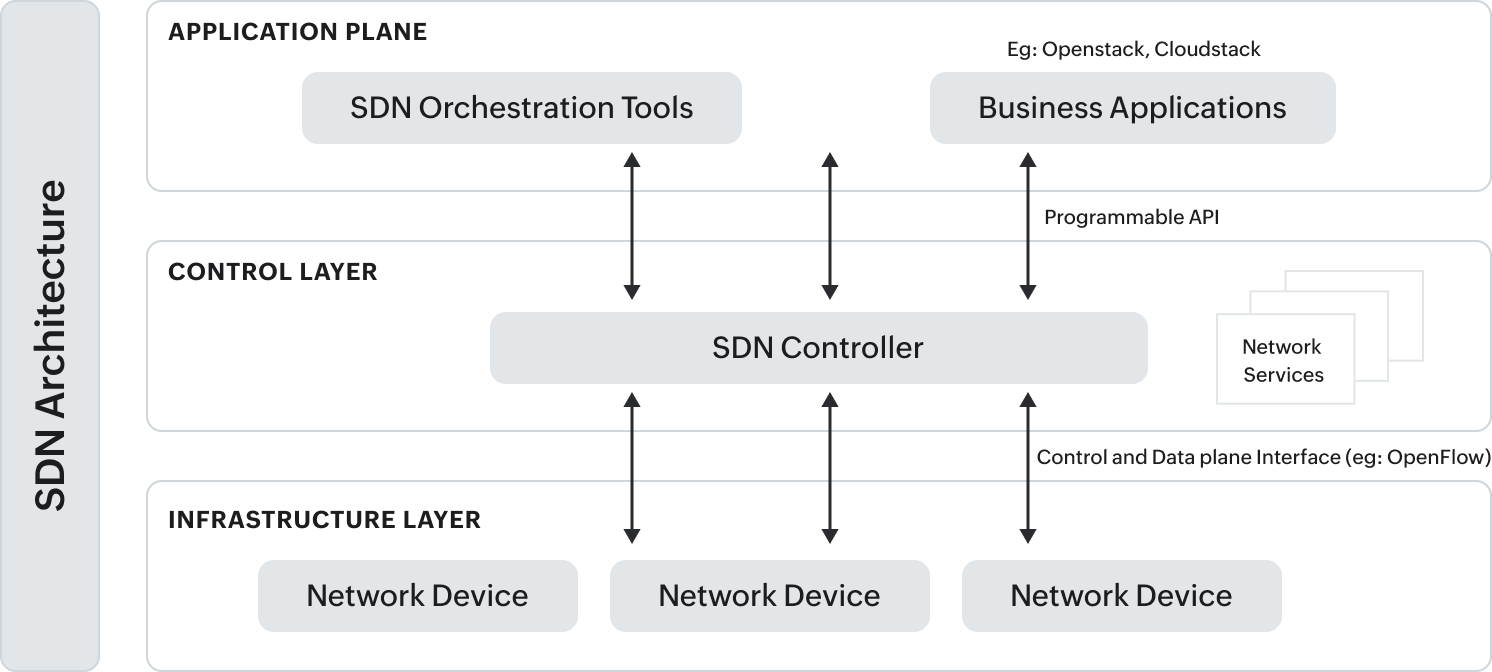

- Su arquitectura se basa en aplicaciones SDN, controladores lógicos centralizados y datapaths programables, coordinados por interfaces norte y sur.

- La ONF y otros actores impulsan estándares y casos de uso reales que abarcan WAN corporativas, centros de datos, nube, big data e IoT.

Las redes definidas por software (SDN) han cambiado por completo la forma en que se diseñan, despliegan y administran las infraestructuras de comunicaciones. Lo que antes era un entramado rígido de equipos físicos y configuraciones manuales, ahora puede gestionarse como si fuera código, con mucha más rapidez, flexibilidad y visibilidad sobre lo que está ocurriendo en cada rincón de la red.

Este nuevo enfoque no ha surgido de la nada: es el resultado de décadas de investigación y de varios hitos tecnológicos que van desde las redes activas de los 90 hasta la estandarización de OpenFlow y la creación de un ecosistema completo de controladores, APIs y aplicaciones. Vamos a ver, paso a paso y con calma, cómo hemos llegado hasta aquí, qué problemas resuelve SDN, cómo funciona por dentro y en qué escenarios reales se está usando hoy en día.

Origen e historia de las redes definidas por software (SDN)

La historia de SDN arranca hace unos 20 años, en los inicios de Internet comercial, cuando el éxito de la red global hizo evidente que las infraestructuras de comunicaciones tenían que poder modificarse y evolucionar con mucha más facilidad. A partir de entonces se pueden distinguir tres grandes etapas que van preparando el terreno a lo que hoy llamamos SDN.

La primera etapa corresponde a las redes activas (aprox. 1995-2000). La idea era abrir la red a la programación, de forma parecida a como se programa un PC, pero aplicada a cada nodo de comunicaciones. Para ello se definía una API en los dispositivos de red que exponía recursos como capacidad de cómputo, almacenamiento, colas de paquetes o funciones de procesado, permitiendo cargar código que aplicaba comportamientos personalizados a determinados flujos de tráfico.

Este enfoque chocaba con la visión de quienes defendían que la única forma de que Internet escalara y siguiera funcionando era mantener la red lo más simple posible. Aun así, el programa de redes activas impulsó avances clave: reducción del coste computacional, mejoras en lenguajes de programación, auge de las máquinas virtuales y, sobre todo, la idea de que la red se podía tratar como una plataforma programable y no solo como un conjunto de cajas cerradas.

Un catalizador importante de aquella época fue el apoyo de agencias como DARPA, que lanzó el Active Networks Program, activo desde mediados de los 90 hasta principios de los 2000. Aunque las redes activas nunca llegaron a desplegarse masivamente, sembraron conceptos que más tarde serían fundamentales para SDN: funciones programables en la red, virtualización de recursos y una visión unificada de distintos dispositivos (cortafuegos, IDS, NAT, etc.).

Con el cambio de década y el crecimiento brutal del tráfico, comenzó la segunda fase, centrada en la separación del plano de control y el plano de datos (2001-2007). Los routers y switches tradicionales combinaban en el mismo equipo la lógica de control (elección de rutas, protocolos de enrutamiento) y el plano de datos (reenvío efectivo de paquetes), lo que hacía muy complicado depurar errores, ajustar ingeniería de tráfico o introducir nuevos servicios.

Para lidiar con este escenario, las operadoras empezaron a implementar el reenvío de paquetes en hardware especializado, mientras el control se mantenía más separado, y al mismo tiempo buscaban formas de gestionar redes cada vez más grandes y complejas, con servicios como VPN y otras funciones avanzadas. De ahí nacen dos líneas de innovación: por un lado, interfaces abiertas entre control y reenvío, como ForCES (IETF) o Netlink en Linux; por otro, arquitecturas con control lógico centralizado, como RCP, SoftRouter o el protocolo PCE, que permitían tomar decisiones de enrutamiento con una visión global.

La tercera etapa llega con el proyecto 4D y el posterior Ethane, que cristalizan la idea de un controlador lógico central con cuatro planos claramente definidos: datos (procesado de paquetes según reglas), descubrimiento (recogida de información topológica y de tráfico), diseminación (instalación de reglas de procesado) y decisión (políticas globales traducidas a reglas concretas). Ethane, desplegado en entornos reales como la Universidad de Stanford, aportó un diseño de switch extremadamente simple que se convertiría en la base de lo que hoy conocemos como OpenFlow.

Mientras tanto, el ecosistema de experimentación también avanzaba: infraestructuras como PlanetLab o Emulab, proyectos como GENI o el programa europeo FIRE, y el Clean Slate Program de Stanford fomentaron pruebas a gran escala con arquitecturas de red alternativas. En ese caldo de cultivo nace OpenFlow como una forma práctica de exponer capacidades de reenvío de los switches a un controlador externo mediante una API estándar.

Un hito industrial relevante fue la demostración de Avaya en 2014, donde se combinaba Shortest Path Bridging con OpenStack para construir redes definidas por software sin apenas configuración manual. Y, poco a poco, gracias a simples actualizaciones de firmware, muchos switches comerciales empezaron a soportar OpenFlow sin necesidad de cambiar el hardware.

Problemas de las redes tradicionales que resuelve SDN

Las redes convencionales, basadas casi en exclusiva en equipos físicos configurados uno a uno, están llegando a sus límites frente a las necesidades actuales de empresas, proveedores de servicios y usuarios finales. Su principal talón de Aquiles es la complejidad acumulada durante años.

Para cubrir todas las casuísticas, la industria ha ido sumando protocolos de red cada vez más específicos que solucionan problemas concretos (seguridad, eficiencia, redundancia…), pero normalmente diseñados en aislamiento. El resultado es una maraña de mecanismos que hay que coordinar a mano, sin una capa de abstracción común que simplifique el conjunto.

Cuando una organización quiere aplicar políticas coherentes en toda la red -por ejemplo, quién puede acceder a qué recursos-, los administradores tienen que tocar cientos o miles de dispositivos. Algo tan simple como añadir una máquina virtual nueva puede implicar modificaciones en numerosas listas de control de acceso (ACL) repartidas por todo el entorno, con el riesgo de errores humanos y retrasos de horas.

La falta de escalabilidad es otro problema serio. El auge de los centros de datos, el crecimiento de usuarios y el aumento del tráfico obligan a sumar cada vez más dispositivos. Cada equipo adicional implica más configuración, más gestión y más puntos potenciales de fallo. Mantener todo eso alineado con las necesidades de negocio se vuelve una tarea hercúlea.

A nivel económico, las organizaciones sufren una fuerte dependencia de los ciclos de producto de los fabricantes. Si se necesita una funcionalidad nueva en la red, a menudo no basta con actualizar software: hay que esperar a que el proveedor lance el modelo adecuado, pasen las certificaciones internas, se adquiera el equipo, se despliegue… Un proceso que puede alargarse años y frenar la innovación.

Por si fuera poco, las tendencias recientes complican aún más la foto: aparecen patrones de tráfico mucho más heterogéneos, con flujos máquina a máquina, bases de datos distribuidas, microservicios y usuarios que se conectan desde cualquier lugar con móviles, tablets y portátiles. La carga de trabajo de los administradores aumenta, intentando proteger datos sensibles mientras el perímetro clásico de la red prácticamente desaparece.

A esto se suma el crecimiento de los servicios en la nube (SaaS, IaaS, PaaS), que demandan provisión rápida, escalado dinámico de cómputo, almacenamiento y red, así como requisitos de seguridad más sofisticados. El auge de big data exige anchos de banda masivos y una capacidad de transporte entre miles de servidores que las redes tradicionales no siempre pueden seguir.

Qué es realmente SDN y cómo lo soluciona

SDN aparece como una nueva arquitectura pensada para dar flexibilidad, control centralizado y programabilidad a la red, traspasando la complejidad al software y quitándosela al hardware. Ya no se trata de ir dispositivo por dispositivo, sino de definir el comportamiento deseado de la red desde una capa lógica superior.

El principio clave es la separación del plano de control y el plano de datos. El plano de datos (data plane) se encarga de mover los paquetes a toda velocidad entre los puntos finales; el plano de control (control plane) decide cómo y por dónde deben circular esos paquetes, aplicando políticas, rutas y reglas. En SDN estos planos se desacoplan y el control se concentra en uno o varios controladores lógicos.

Entre ambos se establece una interfaz bien definida, habitualmente mediante un protocolo estándar como OpenFlow. Gracias a esa interfaz, el controlador puede instalar, modificar o eliminar reglas de reenvío en los switches y routers, que pasan a comportarse como dispositivos programables y no como cajas cerradas. OpenFlow no es el único protocolo posible, pero sí el más extendido y el que ha marcado el estándar de facto.

Encima de los controladores, las aplicaciones SDN usan APIs hacia el norte (northbound APIs) para expresar qué comportamiento necesitan de la red: priorizar cierto tráfico, segmentar departamentos, balancear cargas, mejorar la calidad de servicio, reaccionar ante un ataque de denegación de servicio, etc. El controlador traduce esas peticiones de alto nivel en reglas concretas de reenvío que se aplican en el plano de datos.

En otras palabras, SDN convierte la red en una plataforma en la que se pueden desarrollar aplicaciones y servicios como si fueran software puro, olvidándose de los detalles de cada modelo de equipo o de cada protocolo de bajo nivel. Esa abstracción facilita la automatización, reduce errores y permite adaptarse mucho más deprisa a cambios en la demanda.

Arquitectura SDN: controladores, APIs y componentes clave

Una red SDN típica se estructura en varias capas lógicas y componentes bien diferenciados. El corazón de todo es el controlador SDN, que actúa como cerebro de la red, recogiendo información del plano de datos y aplicando las decisiones de las aplicaciones.

El controlador mantiene una vista abstracta de la red: topología, capacidades de cada dispositivo, estadísticas de tráfico, estados de los enlaces, etc. Con esa información, y apoyándose en módulos plug-in que se pueden activar o desactivar (gestión de inventario, recolección de estadísticas, módulos de seguridad, balanceo de carga…), toma decisiones y las comunica a los dispositivos a través de la interfaz hacia el sur (southbound API), generalmente OpenFlow u otros protocolos como OVSDB o Cisco OpFlex.

Los dispositivos del plano de datos -switches físicos, conmutadores virtuales, routers- implementan lo que la ONF denomina SDN Datapath: un conjunto de motores de reenvío y funciones de procesado de tráfico expuestos de forma lógica. Dentro de cada datapath hay un agente de la interfaz de control (CDPI agent) que recibe las instrucciones del controlador y las traduce a reglas en las tablas de flujo o a acciones específicas de hardware.

En la parte superior de la arquitectura están las aplicaciones SDN. Son programas que hablan con el controlador mediante APIs hacia el norte (NBI) y expresan necesidades de negocio o técnicas: gestión de direcciones IP (IPAM), orquestación de servicios, control de calidad de servicio (QoS), sistemas de defensa frente a ataques DoS, herramientas de analítica avanzada, etc. Cada aplicación contiene su propia lógica y uno o varios NBIs para interactuar con el controlador.

Entre estos bloques se sitúa la interfaz de control a plano de datos (CDPI), que es la responsable de ofrecer programabilidad sobre el reenvío, anunciar capacidades de los dispositivos, exponer estadísticas y notificar eventos. Los controladores implementan drivers de esta interfaz y los dispositivos implementan agentes, de manera que cada par driver/agente configura una relación concreta entre la infraestructura física y las aplicaciones.

Además de estas tres capas principales, la ONF identifica un plano de gestión y administración que cubre tareas más estáticas: asignación de recursos a clientes, configuración básica de equipos físicos, gestión de credenciales y asociaciones entre entidades lógicas y físicas. Estas tareas suelen gestionarse fuera del ciclo dinámico de control de tráfico.

Interfaces norte y sur, y modelos de programación de flujos

La API hacia el sur (southbound API) es la que conecta el controlador con el hardware o los datapaths. OpenFlow fue la primera interfaz ampliamente adoptada: define cómo el controlador instala entradas en las tablas de flujos de los switches, cómo recoge estadísticas, cómo se notifican eventos como paquetes sin coincidencia, etc. Otras alternativas como Cisco OpFlex proponen modelos diferentes, pero con la misma idea básica de permitir a un elemento central influir en el comportamiento de los dispositivos.

La API hacia el norte (northbound API) es la que permite a las aplicaciones hablar con el controlador y recibir una vista abstracta de la red. Aquí no existe un estándar tan consolidado como OpenFlow: hay muchas propuestas y librerías situadas en diferentes capas de la pila (REST, gRPC, SDKs específicos, modelos basados en intent, etc.), y precisamente por esa diversidad la ONF ha puesto mucho énfasis en definir mejores prácticas y converger hacia enfoques compatibles.

A nivel de funcionamiento, los controladores pueden seguir un modelo proactivo, reactivo o híbrido para instalar reglas de flujo en los dispositivos. En el enfoque reactivo, el switch consulta al controlador cuando recibe un paquete que no coincide con ninguna entrada de su tabla; el controlador responde con instrucciones y, si procede, crea una regla nueva para futuros paquetes similares.

En el modelo proactivo, el controlador instala de antemano reglas para los flujos esperables, de forma parecida a cómo se rellenan las tablas de enrutamiento tradicionales. Así se minimizan las consultas en tiempo real y se reduce la latencia de las primeras comunicaciones. Muchos despliegues reales combinan ambos modelos, siendo reactivos ante tráfico imprevisible y proactivos para los flujos bien conocidos.

La verdadera fuerza de SDN está en la programabilidad que proporcionan estas APIs abiertas. Gracias a ellas, es posible ajustar rutas dinámicamente según la carga, priorizar tráfico crítico, automatizar la respuesta ante fallos o incidentes de seguridad, o incluso permitir que las propias aplicaciones negocien con la red las condiciones que necesitan (ancho de banda, latencia máxima, nivel de redundancia, etc.).

Casos de uso de la programabilidad en SDN

Para aterrizar el concepto de programabilidad de la red, se suele hablar de tres grandes casos de uso que ilustran cómo se aprovecha SDN en la práctica. El primero es el ajuste fino de flujos: con protocolos tipo OpenFlow el controlador puede decidir, casi al vuelo, qué caminos deben seguir determinados tipos de tráfico, equilibrando carga entre enlaces, evitando congestiones o aplicando políticas de seguridad más estrictas donde haga falta.

El segundo gran caso está en el soporte avanzado a las aplicaciones. En vez de que la red sea ciega a lo que hacen las aplicaciones, éstas pueden exponer sus necesidades (por ejemplo, baja latencia para voz o vídeo, alto ancho de banda para ciertas transferencias, aislamiento rígido entre clientes) y el controlador adapta la configuración para cumplirlas. Además, la automatización de despliegues -especialmente en entornos cloud y de virtualización masiva- permite levantar rápidamente nuevos servicios sin que un administrador tenga que ir cambiando parámetros a mano.

El tercer eje es la automatización de la operación de red. En un escenario SDN bien diseñado, la red puede reaccionar sola ante muchos eventos: si cae un enlace, se recalculan rutas; si aparece un patrón de tráfico sospechoso, se aplican reglas de bloqueo o redirección hacia sistemas de análisis; si se activa una nueva aplicación, la red reserva recursos de forma automatizada. El rol del administrador pasa de “cambiar comandos” a definir políticas de alto nivel y supervisar que todo se cumple.

Ventajas de SDN para las organizaciones

La propuesta de valor de SDN se traduce en una serie de ventajas muy claras para empresas y proveedores de servicios. Una de las más destacadas es la gestión centralizada: desde el controlador se pueden definir políticas de acceso, reglas de seguridad, prioridades de tráfico o aprovisionamiento de servicios para toda la red, sin ir dispositivo por dispositivo ni depender del interfaz particular de cada fabricante.

En términos de escalabilidad, SDN ofrece una agilidad enorme. Los administradores pueden añadir o quitar dispositivos virtuales, segmentar redes, conectar sucursales o centros de datos y ajustar rutas casi en tiempo real, muchas veces integrados con plataformas de orquestación cloud. Todo ello sin tocar apenas la infraestructura física subyacente, que se mantiene como un sustrato relativamente estable.

Otra ventaja importante es la visibilidad global del comportamiento de la red. Al centralizar la información en el controlador o en un dominio de controladores coordinados, se obtiene un panel completo del rendimiento, de los cuellos de botella, de los flujos activos y de posibles amenazas. Esa visibilidad facilita no solo la operación del día a día, sino también la planificación de capacidad y la detección temprana de problemas.

Desde la perspectiva económica, SDN ayuda a reducir tanto el CAPEX como el OPEX. Por un lado, permite reutilizar gran parte del hardware existente, ya que muchos switches pueden habilitar funciones SDN con simples actualizaciones de firmware. Por otro, la automatización disminuye el tiempo que el personal dedica a tareas repetitivas de configuración, reduce errores humanos y simplifica el mantenimiento y las actualizaciones.

El último gran bloque de beneficios tiene que ver con la innovación y la rapidez de respuesta. Al desacoplar hardware y software, las organizaciones pueden crear nuevos servicios, experimentar con modelos de negocio diferentes o adaptar la red a nuevos requerimientos (cloud híbrida, IoT, informática perimetral, big data) sin estar atadas al ritmo de lanzamiento de productos de un fabricante concreto.

Desventajas y retos de las redes SDN

SDN no es una panacea y también arrastra desafíos que hay que tener muy presentes a la hora de diseñar y operar este tipo de redes. Uno de los más citados es la vulnerabilidad potencial del controlador: al concentrar tanta lógica y decisiones, se convierte en un punto crítico cuya caída o compromiso puede arrastrar a todo el sistema.

Esto obliga a desplegar mecanismos de alta disponibilidad, redundancia y conmutación por error, así como controles de acceso muy estrictos. Los ataques de denegación de servicio (DDoS) contra el controlador, por ejemplo, deben mitigarse con capacidad suficiente para que la red no quede “ciega” ante eventos importantes.

Otro reto es la posible aumento de latencia y complejidad cuando crece el número de dispositivos y flujos. Si el controlador tiene que gestionar demasiadas interacciones con el plano de datos, puede verse sobrecargado. Una arquitectura SDN bien dimensionada debe repartir funciones, mantener parte del control en los elementos distribuidos cuando tiene sentido (por ejemplo, recuperación rápida ante fallos locales) y escalar horizontalmente los controladores.

En el plano de seguridad, aunque SDN aporta mejor visibilidad, también carece por defecto de algunos mecanismos que solían venir integrados en routers, switches o cortafuegos físicos tradicionales. Es imprescindible proteger las comunicaciones entre controlador, aplicaciones y dispositivos, garantizar autenticidad e integridad, y diseñar un entorno robusto de definición de políticas que permita verificar que se aplica exactamente lo que se pretende.

Además, resulta crítico establecer procesos para análisis forense de la red: registro detallado de eventos, trazabilidad de cambios y capacidad de reconstruir qué ocurrió en caso de incidente. Todo ello debe convivir con el dinamismo propio de SDN, evitando que la seguridad se convierta en un cuello de botella pero sin dejar zonas oscuras.

Papeles de la ONF y otros actores en el ecosistema SDN

La Open Networking Foundation (ONF) juega un papel fundamental en la evolución de SDN. Se trata de una organización impulsada por usuarios finales (operadoras, grandes corporaciones) con el objetivo de promover la adopción de redes definidas por software a través de estándares abiertos y procesos colaborativos.

La ONF ha sido la encargada de definir, mantener y evolucionar el estándar OpenFlow, que fue el primer estándar SDN reconocido y sigue siendo un elemento central en muchas arquitecturas. Pero su labor va más allá: lidera grupos de trabajo que analizan requerimientos de despliegues comerciales, proponen nuevas interfaces, modelos de datos y terminología, y fomentan un ecosistema de múltiples proveedores.

En paralelo, empresas tecnológicas y fabricantes de equipos han desarrollado sus propias plataformas SDN y enfoques híbridos. Algunos, como soluciones basadas en controladores lógicamente centralizados tipo Blue Planet de Ciena, combinan funciones centralizadas (visibilidad extremo a extremo, políticas, ancho de banda) con capacidades distribuidas en los elementos de red para recuperación de fallos, monitorización local o seguridad.

Este enfoque híbrido refleja una realidad práctica: no todo el control tiene que subirse al controlador central, y es conveniente que ciertos mecanismos de reacción rápida sigan residiendo cerca del tráfico, mientras la inteligencia más compleja y la orquestación se gestionan de manera centralizada y programable.

SDN, virtualización de red y casos de uso reales

En muchas organizaciones, SDN se adopta junto con técnicas de virtualización de red para crear redes superpuestas (overlays) sobre la infraestructura física existente. Estas redes virtuales pueden segmentar diferentes entornos (producción, desarrollo, clientes distintos) aprovechando el mismo hardware subyacente, o bien interconectar varias redes físicas como si fueran una sola entidad lógica.

Este enfoque es especialmente potente cuando se integra con servicios de cloud computing tipo SaaS, IaaS y PaaS. La red definida por software se coordina con plataformas de orquestación para que el ciclo completo de aprovisionamiento -máquinas virtuales, almacenamiento, red, seguridad- se realice de forma coherente, rápida y automatizada, muchas veces a través de APIs.

En grandes empresas y operadores, SDN se utiliza para construir WAN corporativas más inteligentes, en las que se gestiona de forma fina el tráfico entre sedes, centros de datos y nubes públicas. Google, por ejemplo, lleva años utilizando SDN para interconectar sus centros de datos globales y ha colaborado con la ONF en la definición de nuevas interfaces de control más allá de OpenFlow.

En el entorno de centros de datos, SDN es una pieza clave para lograr escalado rápido y eficiente: permitir que un nuevo centro de datos quede operativo en horas y que los recursos de red se provisionen en minutos. También facilita la implantación de entornos IoT a gran escala, gestionando miles de dispositivos y sensores distribuidos sin que la complejidad se dispare.

Por último, SDN se enmarca en una tendencia más amplia de infraestructuras definidas por software, donde no solo la red sino también el almacenamiento (SDS) y otros recursos se controlan desde planos de control lógicos, independientes del hardware específico. Esto da a las organizaciones mayor portabilidad, agilidad y capacidad para mover cargas de trabajo entre la nube y las instalaciones propias según convenga en cada momento.

Con todo este recorrido histórico, técnico y práctico, SDN se consolida como una forma distinta de entender las redes: más cercana al mundo del software, centrada en la automatización y la programabilidad, y capaz de responder al reto del crecimiento del tráfico, la nube, el big data y el IoT sin obligar a multiplicar indefinidamente el hardware ni la complejidad operativa.

Tabla de Contenidos

- Origen e historia de las redes definidas por software (SDN)

- Problemas de las redes tradicionales que resuelve SDN

- Qué es realmente SDN y cómo lo soluciona

- Arquitectura SDN: controladores, APIs y componentes clave

- Interfaces norte y sur, y modelos de programación de flujos

- Casos de uso de la programabilidad en SDN

- Ventajas de SDN para las organizaciones

- Desventajas y retos de las redes SDN

- Papeles de la ONF y otros actores en el ecosistema SDN

- SDN, virtualización de red y casos de uso reales